'n Skepper se Gids om Lippensink KI te Beheers

Ontdek hoe lippensink KI videoskepping transformeer. Leer wat dit is, hoe dit werk, en hoe om dit te gebruik om perfek gedubde inhoud vir 'n wêreldwye gehoor te skep.

Het jy al ooit gewens om enige taal in jou video’s te praat, met jou mond perfek passend by elke enkele woord, selfs al ken jy nie die taal nie? Dis presies wat lip-sync AI moontlik maak. In die kern neem hierdie tegnologie ’n aparte audio-spoor en animeer outomaties ’n persoon se mond—of ’n avatar s’n—om perfek daarmee te sinkroniseer.

Dit is nie net ’n mooi partytjie-triek nie; dis ’n massiewe sprong vorentoe, wat inhoudskepping en lokalisering toeganklik maak vir almal.

Waarom Lip Sync AI Belangrik is vir Skeppers

Dink aan lip-sync AI as ’n digitale poppenspeler vir jou video’s. Vir die langste tyd was dit realistiese lip-sinkronisering iets wat slegs hoëbegrotings fliekateljees met toegewyde VFX-spanne kon regkry. Dit het beteken om mondbewegings raam vir raam pynlik aan te animeer. Nou is daardie selfde krag in die hande van skeppers orals, en dit verander heeltemal hoe video gemaak word vir platforms soos YouTube, TikTok en Instagram.

Die hooftaak van hierdie AI is om die gaping tussen wat jy sien en wat jy hoor te oorbrug, en ’n heeltemal naadlose en oortuigende ervaring vir die kykers te skep. Vergeet daardie ou, lomp dubbings waar die oudio pynlik uit sinkronisasie is. Hierdie tegnologie verseker dat ’n spreker se mond perfek in harmonie beweeg met ’n nuwe audio-spoor, hetsy dit ’n ander taal, ’n heropgeneemde stemoorlas of selfs ’n skrip gelees deur ’n AI-stem is.

Jou Bereik Uitbrei en Tyd Bespaar

Die impak op inhoudskeppers is groot. Jy is nie meer beperk tot jou moedertaal of vasgevang met die gedoente van duur heropnames net om ’n klein oudio-fout reg te maak nie.

Hierdie tegnologie gee jou die krag om:

- Taalversperrings Te Verbreek: Dub jou video’s onmiddellik in veelvuldige tale. Jy kan jou inhoud oopmaak vir massiewe internasionale gehore sonder om ooit ’n woord Spaans, Japanees of Hindi te praat nie.

- Inhoud Moeiteloos Skaal: Neem een video en hergebruik dit vir verskillende globale markte. Al wat jy hoef te doen, is om die audio-lêer te wissel en die AI die res te laat hanteer.

- Produksiewaarde Te Verhoog: Skep professionele-klinkende stemoorlêers vir jou advertensies of sosiale media-video’s en verseker dat jou skermtalent of avatar heeltemal natuurlik en outentiek lyk.

Dit is nie net ’n tegniese nuwigheid nie; dis ’n strategiese voordeel. Lip sync AI laat solo-skeppers en klein spanne op globale skaal kompeteer, en produseer meertalige inhoud wat eens slegs moontlik was vir groot mediabedrywe.

Uiteindelik gaan hierdie hulpmiddel oor om slimmer te werk, nie harder nie. Deur outomatisering van wat eens ’n uitputtende nageskeppings-taak was, maak dit jou vry om te fokus op wat jy die beste doen: groot idees bedink. Om die volle prentjie te sien, help dit om die breër wêreld van AI Powered Content Creation te verstaan en hoe gereedskap soos dié die hele bedryf hervorm. Lip-sync AI is ’n sleutelstuk van daardie legkaart, wat jou die vermoë gee om met meer mense op ’n veel outentiekere manier te verbind.

Hoe Lip Sync AI Werklik Werk

Het jy al gewonder wat onder die kap van ’n lip-sync AI aangaan? Dit is nie net ’n digitale poppenshow wat ’n mond op en af beweeg nie. Dink eerder aan dit as ’n sofistikeerde vertaal-diens, maar in plaas van woorde van een taal na ’n ander te omskakel, vertaal dit klanke in ongelooflik presiese gesigsbewegings.

Kom ons gebruik ’n analogie. As jy ’n robot leer praat, sou jy nie net die alfabet wys nie. Jy sou dit leer hoe elke letter klink. Lip-sync AI doen iets baie soortgelyks deur jou audio-spoor af te breek in die kleinste eenhede van klank, wat phonemes genoem word. Byvoorbeeld, die woord "hello" word afgebreek in duidelike klanke soos "h," "eh," "l," en "ow."

Sodra die AI hierdie phonemes geïdentifiseer het, begin dit met sy hooftaak: elke klank te kartoefen na die presiese mondvorm wat ’n persoon maak wanneer hulle dit sê. Hierdie visuele mondvorms word visemes genoem. Die AI is opgelei op berge data, so dit weet instinktief dat die "f"-klank beteken die bo-tande moet die onderlip raak. Dis ’n blitsvinnige vertaling van audio na visueel.

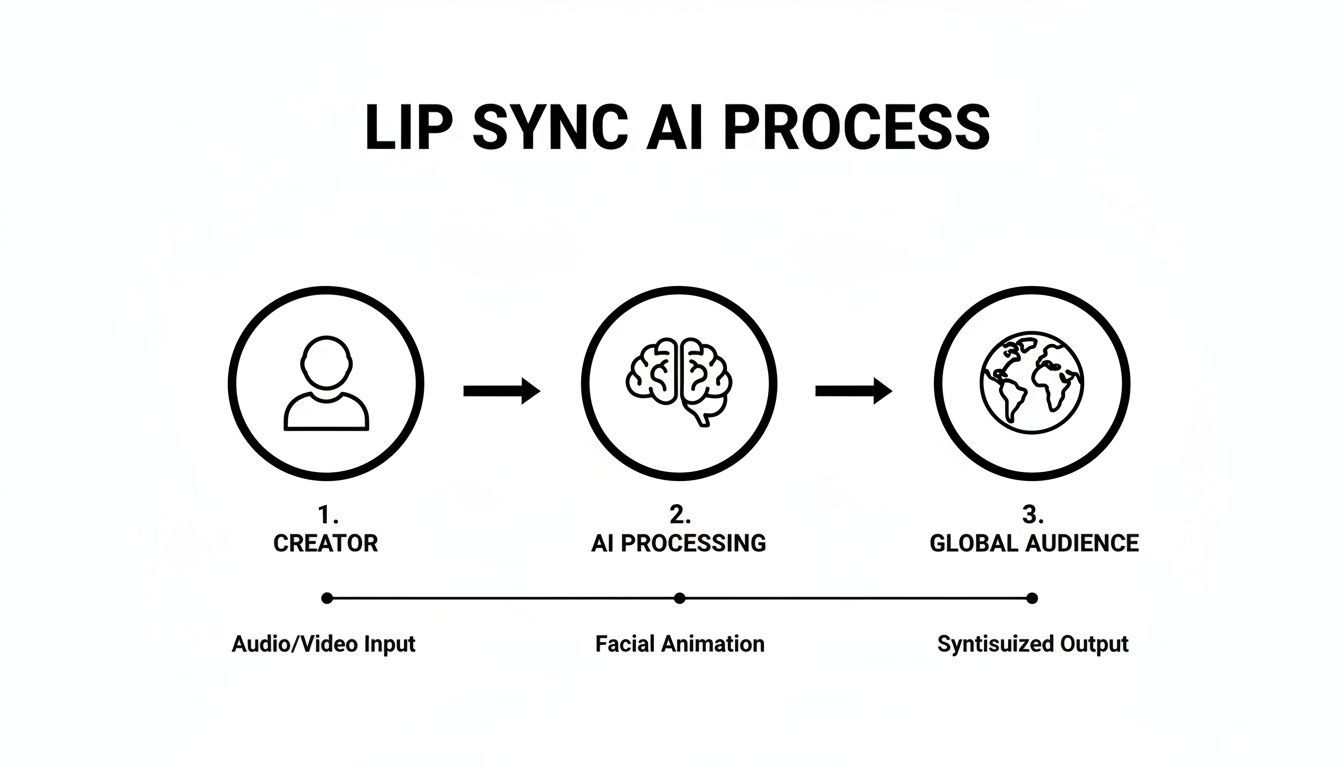

Hierdie diagram breek af hoe ’n stukkie inhoud gaan van ’n eenvoudige opname aan jou kant na ’n video wat gereed is vir ’n globale gehoor.

Soos jy kan sien, verskaf die skepper die rou materiaal, die AI doen die swaar werk, en die resultaat is gepoleerde inhoud wat met kykers oral verbind.

Die Twee Kernbestanddele

Om hierdie digitale towers te regkry, het die AI regtig net twee dinge van jou nodig. Hierdie eenvoudigheid is ’n groot deel van wat gereedskap soos ShortGenius so nuttig maak vir skeppers wat vinnig moet werk.

- Die Audio-lêer: Dit is jou bloudruk. Dit kan ’n stemoorlas wees wat jy pas opgeneem het, ’n professioneel gedubde audio-spoor vir ’n nuwe taal, of enige ander opname van iemand wat praat. Hoe skoner die audio, hoe beter. Krisper, duidelike spraak gee die AI ’n veel makliker stel phonemes om mee te werk, wat altyd lei tot ’n meer akkurate en oortuigende resultaat.

- Die Video of Avatar: Dit is jou doek. Jy kan ’n video van ’n regte persoon gebruik of selfs ’n statiese beeld van ’n AI-gegenereerde avatar. Die AI gebruik hierdie visuele basis om nuwe, perfek gesinkroniseerde mondbewegings te genereer en oor te lê.

Maar moderne deep learning-algoritmes stop nie daar nie. Hulle gaan ’n stap verder deur die nuanses in die audio te analiseer—die toon, die emosie, selfs die spoed van die spreker. Dit help om die finale animasie veel natuurliker te laat voel. In die kern gaan lip-sync AI oor die kundige vermoë om audio video te sinkroniseer sodanig naadloos dat die kyker nooit eens daaroor dink nie.

Die kernboodskap is dit: Dit gaan nie net oor lippe beweeg nie. Dis ’n diepgaande analise van klank wat spraak vertaal in realistiese gesigsuitdrukkings, en die klein detail vang wat ’n optrede werklik menslik laat voel.

Hierdie vlak van outomatisering dryf ernstige bedryfsgroei. Die globale mark vir lip-sync-tegnologie is op koers om te spring van USD 1.12 miljard in 2024 na ’n geskatte USD 5.76 miljard teen 2034. Die feit dat audio-gedrewe machine learning reeds ’n 40.7% mark-aandeel besit, wys net hoe noodsaaklik hierdie tegnologie geword het om inhoud globaal te neem.

Hierdie selfde tegnologie is ’n sleutelbestanddeel in baie AI-video-gereedskap. Dis wat ’n skepper toelaat om ’n enkele stil foto in ’n oortuigende, dinamiese video te omskep. Jy kan dieper ingaan oor hoe dit werk deur ons gids oor hoe om beelde in video met AI te omskep te lees.

Praktiese Toepassings vir Skeppers en Bemarkers

Om die tegniese detail van lip sync AI te ken, is een ding, maar die werklike towers gebeur wanneer jy sien hoe dit nuwe kreatiewe en besigheidsdeure oopmaak. Vir skeppers en bemarkers is dit nie net ’n nuwigheid nie; dis ’n ernstige gereedskap vir skaal van inhoud, intapping van nuwe markte en werklik verbind met gehore wêreldwyd.

Die mees voor die hand liggende en kragtige gebruiksgeval is inhoudlokalisering. Sê nou jy het ’n TikTok wat virus word of ’n YouTube-toglas wat jy jou hart in gestort het. In plaas van beperk te wees tot slegs Engelssprekendes, kan jy nou weergawes vir Spaans, Hindi of Japanees gehore amper onmiddellik skep. Die AI plak nie net ’n nuwe audio-spoor op nie—dit heranimeer jou lipbewegings sorgvuldig om by die nuwe taal te pas, en maak die finale video heeltemal natuurlik.

Dit herskryf heeltemal die speelboek vir globale uitbreiding. Die ou manier om ’n video-veldtog te lokaliseren, het behels om stemaktiers vir elke taal aan te stel, duur ateljeetyd te bespreek en weke of maande nageskepping deur te sukkel. Nou is daardie hele werkstroom vinniger en baie bekostigbaarder.

Van Globale Advertensies tot AI Avatars

Bo en behalwe net video’s te vertaal, ontgrendel lip sync AI ’n hele reeks strategieë vir die bou van handelsmerke en die skep van oortuigende advertensies. In die kern neem elke toepassing voordeel van die vermoë om te skei wat iemand sê van hoe hulle lyk terwyl hulle dit sê.

Hier is ’n paar spelveranderende maniere waarop hierdie tegnologie nou gebruik word:

- Betrokke AI Avatars Skep: Jy kan ’n enkele beeld neem—van ’n stokperdjie, ’n stigter of ’n virtuele influencer—en dit tot lewe bring. Voed dit net ’n text-to-speech stemoorlas, en jy het ’n oneindige voorraad sosiale media-inhoud sonder dat enigiemand voor ’n kamera hoef te staan nie.

- Advertensie-veldtogte Lokaliseren: ’n Handelsmerk kan een fantastiese, hoëbegroting advertensie produseer en dan AI gebruik om dit aan te pas vir dosyne internasionale markte. Dit hou die handelsmerkvastheid konsekwent terwyl die boodskap lokaal en persoonlik voel. Hierdie benadering is ’n lewensredder vir advertensie-platforms wat ’n konstante stroom vars kreatiewe eis. Jy kan sien hoe dit werk in ’n breër strategie deur ons gids oor die skep van doeltreffende AI UGC-styl advertensies te lees.

- Moeiteloze Audio-regstellings: Ons was almal daar. Jy voltooi ’n perfekte video-bewerking, net om ’n fout in die stemoorlas op te merk. In plaas van ’n frustrasie heropname, kan jy net die reggestelde audio-lyn opneem en die AI naadloos laat inskakel, met jou lippe perfek passend.

Die werklike krag hier is ontkoppel van die visuele van die audio. Dit gee skeppers enorme buigsaamheid om te eksperimenteer, foute reg te stel en inhoud aan te pas vir verskillende platforms en gehore sonder om elke keer van voor af te begin nie.

Om te wys hoe hierdie idees tot lewe kom, is hier ’n vinnige afbreek van hoe skeppers en handelsmerke lip sync AI gebruik.

Lip Sync AI Toepassings vir Skeppers en Handelsmerke

| Gebruikgeval | Primêre Voordeel | Voorbeeldtoepassing |

|---|---|---|

| Globale Inhoudverspreiding | Gehoergroei | ’n YouTuber vertaal hul toppresterende video in 5 nuwe tale om ’n globale gehoor te bereik, en verdriedubbel hul potensiële kykersgetal. |

| Meertalige Advertensie-veldtogte | Verhoogde ROI | ’n D2C-handelsmerk skep 10 gelokaliseerde weergawes van ’n enkele advertensie vir verskillende lande, en verbeter advertensierelevansie en konversietempo’s. |

| AI Influencers & Avatars | Inhoudskaalbaarheid | ’n Maatskappy gebruik sy geanimeerde stokperdjie om daaglikse sosiale media-opdaterings te skep sonder ’n video-span vir elke plasing nie. |

| Nageskepping-regstellings | Tyd & Koste-besparings | ’n Filmmaker korrigeer ’n verkeerd gesêde lyn in ’n cruciale toneel sonder heropname, en spaar duisende dollars. |

Dit is nie net ’n geringe verbetering nie—dis ’n fundamentele verskuiwing in hoe video gemaak word.

Die AI-video-dubbing-mark was gewaardeer op $31.5 miljoen in 2024 en word verwag om te raket na $397 miljoen teen 2032. Hierdie eksplosiewe groei is te danke aan die ongelooflike tyd en geld wat dit spaar. ’n Meertalige veldtog wat eens ’n groot begroting en maande werk geverg het, kan nou in minder as ’n week vir onder $2,000 omgedraai word, en sit globale bereik in die hande van solo-skeppers. Jy kan meer leer oor die evoluerende ekonomie van AI lip sync-tegnologie en sien hoe dit die hele skepper-ekonomie verander.

Hoe om die Regte Lip Sync AI-gereedskap te Kies

Met ’n vloed nuwe gereedskap wat die mark tref, kan die keuse van die regte lip sync AI voel soos ’n skot in die donker. Maar nie alle platforms is ewe gebou nie, en die verkeerde keuse kan jou met robotagtige, ongemaklike video’s laat wat kykers afstoot in plaas van betrokke te hou. Jy het ’n eenvoudige kontrolelys nodig om deur die bemarkingsfluff te sny.

Die absolute nommer een faktor is die kwaliteit van die sinkronisering self. lyk die finale video natuurlik, of val dit in daardie grillerige "uncanny valley"? ’n Groot gereedskap verstaan die klein, subtiele bewegings van ’n regte mond—hoe dit vorm om verskillende klanke en verbind met die spreker se uitdrukking.

’n Goedkoop of swak opgelei AI mag net die mond oop en toe flap, wat onmiddellik verklap dat iets vals is. Die beste manier om dit te beoordeel, is om dieselfde kort audio-knippie deur ’n paar verskillende gereedskap te loop. Sit die resultate langs mekaar en vertrou jou instink.

Sleutelkenmerke en Prestasie Evalueer

Bo en behalwe suiwer realisme, moet jy aan jou spesifieke kreatiewe behoeftes dink. Die perfekte gereedskap vir ’n meertalige korporatiewe instrukteur is waarskynlik oordadig vir ’n meme-skepper. Om jou evalueringsproses van voren af te nag, sal jou ’n wêreld kopseer later spaar.

Hier is die essensiële dinge om te soek:

- Taal- en Aksent-ondersteuning: Dit is ’n deurbreekder as jy ’n globale gehoor wil bereik. Vind uit hoeveel tale die gereedskap ondersteun en, net so belangrik, hoe goed dit verskillende aksente en dialekte hanteer. ’n Gereedskap wat ’n Glaswegian-aksent kan nag, is baie indrukwekkender as een wat slegs werk met ’n generiese, robotagtige stem.

- Verwerkingsspoed: Hoe lank sal jy na ’n vorderingsbalk staar vir ’n een-minuut knippie? In die wêreld van kortvorm-inhoud is spoed alles. Sommige platforms kan ’n video in minute omdraai, terwyl ander jou laat wag vir wat soos ’n ewigheid voel.

- Gebruiksgemak: ’n Gereedskap met ’n miljoen kenmerke is worthless as die koppelvlak ’n nagmerrie is. Soek na ’n skoon, eenvoudige ontwerp wat jou toelaat om jou video en audio te laai, dan die lip sync in net ’n paar klikke toe te pas. Platforms soos ShortGenius streef daarna om hierdie stap ’n naadlose deel van ’n veel groter video-skeppingspyplyn te maak.

Die uiteindelike doel is om ’n oplossing te vind wat in jou bestaande proses pas sonder nuwe bottels nekke te skep. Die regte gereedskap moet voel soos ’n uitbreiding van jou kreatiewe gereedskapstel, nie nog ’n ingewikkelde sagteware wat jy moet leer nie.

Integrasie en Markneigings Oorweeg

Ten slotte, dink groter prentjie. Hoe pas hierdie lip sync AI in jou werkstroom? Speel dit goed saam met die video-bonders wat jy reeds liefhet? Kan dit die video-formate en resolusies hanteer wat jy nodig het? Gladde integrasie is net so krities soos tegniese prestasie.

Die eksplosiewe groei in hierdie ruimte vertel jou alles wat jy moet weet. Die mark vir AI in media, wat lip-sync-tegnologie insluit, word verwag om te baljaar van USD 8.21 miljard in 2024 na USD 51.08 miljard teen 2030. Daardie soort vinnige uitbreiding beteken dat sofistikeerde oudio-visuele AI vinnig ’n kernonderdeel van enige moderne inhoudstrategie word. Jy kan meer besonderhede kry oor die AI media-mark op datainsightsmarket.com.

Deur ’n gereedskap te kies wat goed ondersteun word en deurlopend verbeter, los jy nie net ’n probleem vir vandag op nie—jy belê in jou vermoë om verbysterende inhoud vir jare te skep.

’n Stap-vir-Stap Gids vir Jou Eerste Lip Sync Video

Goed, kom ons maak ons hande vuil. Om jou eerste video met lip sync AI te maak, is nie so ingewikkeld soos dit klink nie. Ons kan dit afbreek in ’n eenvoudige, vier-stap proses wat jou neem van ’n growwe idee na ’n voltooide video gereed om te deel.

Dit is die basiese werkstroom wat jy in platforms soos ShortGenius sal vind, wat hierdie kragtige tegnologie reg by jou vingerpunte sit.

Stap 1: Berei Jou Audio-spoor Voor

Alles begin met die audio. Dink daaraan as die bloudruk vir jou video—die AI het ’n skoon, duidelike spoor nodig om uit te vind watter mondvorms om te skep. Jy kan jou eie stem opneem of ’n kwaliteit text-to-speech-generator gebruik vir ’n konsekwent krisper vertelling.

Vir die beste uitkoms, verseker dat jou audio min tot geen agtergrondgeraas het. Duidelik praat maak ook ’n groot verskil. Hoe duideliker jou woorde, hoe beter kan die AI die lipbewegings pasmaak. Om hierdie eerste stap reg te kry, stel jou op vir ’n veel oortuigendere resultaat.

Stap 2: Kies Jou Video of Avatar

Volgende, moet jy kies wie (of wat) die praatwerk sal doen. Dit kan ’n videoknippie wees wat jy reeds het van iemand wat praat of selfs net ’n statiese beeld van ’n AI-avatar wat jy geskep het. Die sleutel hier is ’n duidelike skoot van die gesig.

Hier’s ’n pro-tippie: ’n Reguit-van-voor, voor-ooghoek werk die beste. Die AI het ’n direkte, onbelemmerde sig van die mond nodig om realistiese bewegings te genereer. As die gesig weggedraai is of iets die sig blokkeer, sal die finale animasie ’n bietjie skeef lyk.

Die kwaliteit van jou insette bepaal direk die kwaliteit van jou uitset. ’n Skerp, goed verligte video en skoon audio verskaf die AI met die beste moontlike materiaal om mee te werk, en verminder foute en verseker ’n meer lewendige resultaat.

Stap 3: Pas die Lip Sync AI Toe

Hier begin die werklike pret, en dit is gewoonlik net ’n saak van ’n knoppie druk. Sodra jy jou audio- en video-lêers na die gereedskap opgelaai het, pas jy net die lip sync-funksie toe. Die AI begin dan werk, breek die klanke in jou audio af en skep nuwe mondbewegings op jou video-onderwerp om te pasmaak.

Die hele proses is verrassend vinnig, neem dikwels net ’n paar minute. Terwyl die AI die swaar werk doen, kan jy jou voorberei vir die laaste en mees belangrike stap.

Stap 4: Hersien en Verfyn die Uitset

Geen AI kry dit elke keer perfek nie, so ’n finale kontrole is noodsaaklik. Kyk na die gegenereerde video en let spesifiek op die tyding. lyk die sinkronisering natuurlik? Is daar enige vreemde twitches of oomblikke waar die lippe nie heeltemal by die audio pas nie?

Die meeste goeie gereedskap gee jou opsies om klein aanpassings te maak. Soms kan net die audio-tyding effens te stoot of ’n spesifieke afdeling her te loop gladde knoppies uitstryk. Sodra jy tevrede is, is jou video gereed om te uitvoer. Hierdie hele proses is ’n kernonderdeel van baie AI-video-werkstrome, en jy kan sien hoe dit in die groter prentjie pas deur ons gids oor text-to-video AI-modelle te lees.

Het Jy Vrae Oor Lip Sync AI? Ons Het Antwoorde.

Om in enige nuwe tegnologie te spring, bring ’n paar vrae op. Dis heeltemal normaal. Kom ons pak van die mees algemene wat ek van skeppers hoor oor lip sync AI sodat jy reguit kan gaan om groot inhoud te maak.

Hoe Hanteer Lip Sync AI Verskillende Tale?

Dit is ’n groot een. Die goeie nuus is dat die meeste topvlak AI-modelle opgelei is op reusagtige datasette vol ure meertalige spraak. Dit beteken hulle is verrassend vaardig om nie net verskillende tale te hanteer nie, maar verskillende aksente ook. Dit gaan nie net oor woorde nie; dis oor die leer van die spesifieke mondvorms—die tegniese term is visemes—wat by elke unieke klank hoort.

Natuurlik is nie alle gereedskap ewe gebou nie. Jy sal vind dat prestasie regtig kan verskil van een platform na die ander, wat waarom ek altyd aanbeveel om ’n kort toetsknippie in jou teikentaal te loop voor jy ’n groot projek verbind. Die beste stelsels sal daardie subtiele nuanses vang, en die spreker laat lyk soos ’n inheemse, in plaas van ’n generiese, "one-size-fits-all" mondbeweging toe te pas wat net skeef voel.

Wat is die Verskil Tussen Lip Sync en Dubbing?

Dis maklik om hierdie twee te vermeng, maar hulle is werklik twee kante van dieselfde munt, wat saamwerk om ’n video outentiek te laat voel in ’n nuwe taal.

Dink so daaraan:

- Video Dubbing: Dit gaan alles oor die audio. Dis die proses om die oorspronklike stemspoor te vervang met ’n nuwe een, gewoonlik in ’n ander taal.

- Lip Sync: Dit is die visuele opvolg. Sodra daardie nuwe audio neergelê is, begin die AI werk, en verander digitaal die spreker se mondbewegings om perfek by die nuwe dialoog te pas.

Wanneer jy hulle kombineer, kry jy ’n heeltemal gelokaliseerde video. Die klank is reg, en die visuele pas. Een hanteer wat jy hoor, die ander hanteer wat jy sien.

Hierdie een-twee stoot is wat ’n skepper toelaat om ’n enkele video te neem en dit inheems te laat voel vir gehore oral in die wêreld, sonder daardie afleidende, uit-sinkronisasie gevoel wat onmiddellik ’n kyker uit die ervaring trek.

Hoe Kan Ek Daardie Grillerige "Uncanny Valley"-effek Vermy?

Ag, die "uncanny valley." Dis daardie vreemde, ongemaklike gevoel wanneer iets amper menslik lyk, maar ’n paar subtiele dinge is net nie heeltemal reg nie. Dis ’n werklike bekommernis met lip sync AI, maar jy kan absoluut daaruit bly.

Eerstens, begin altyd met hoëkwaliteit bronmateriaal. ’n Krisper, goed verligte video of ’n gepoleerde avatar gee die AI ’n veel skoner doek om mee te werk. As jy onscherp of lae-res footage voed, vra jy prakties vir ’n vreemde resultaat.

Volgende, fokus op jou audio-kwaliteit. Gebruik ’n hoëkwaliteit AI-stem wat natuurlik klink, of beter nog, ’n skoon opname van ’n menslike stemakteur. ’n Robotagtige, plat stem gepaard met realistiese lipbewegings is ’n resep vir onmiddellike grillerigheid.

Laastens, onthou om daardie subtiele menslike raakpunte by te voeg. ’n AI-gegenereerde toneel kan op sy eie ’n bietjie steriel voel. Om klein dinge soos natuurlike kopbewegings, realistiese knip, of selfs net ’n interessante agtergrond by te voeg, kan die hele video meer gegrond en lewendig laat voel, en dit reg uit die uncanny valley trek.

Gereed om verbluffende, meertalige video’s te skep sonder die gedoente? ShortGenius integreer kragtige AI lip sync-vermoëns in ’n volledige video-skeppingswerkstroom. Produseer professionele advertensies en sosiale inhoud in minute. Begin gratis skep op shortgenius.com.