Odblokuj oszałamiającą jakość: AI do upskalowania wideo

Poznaj praktyczny workflow do upskalowania wideo AI. Omówimy przygotowanie nagrań, optymalne ustawienia, przetwarzanie wsadowe oraz eksport do mediów społecznościowych z ShortGenius.

Masz klip, który powinien działać.

Może to stare świadectwo klienta nagrane telefonem. Może to materiał wygenerowany przez użytkownika, który idealnie oddaje emocje, ale wygląda miękko na nowoczesnym ekranie. Może to dawny hit, który chcesz ponownie opublikować, przyciąć i przekształcić w świeże krótkie formy. Pomysł jest mocny. Plik źródłowy nie jest.

Tu upscale video ai przestaje być nowinką i staje się narzędziem produkcyjnym.

Dobre AI upscaling może uratować materiał, który inaczej wyrzuciłbyś. Złe AI upscaling marnuje godziny, wyolbrzymia szum kompresji i nadaje twarzom ten plastikowy, przegrzany wygląd, który widzowie zauważają natychmiast. Różnica sprowadza się do workflow. Jakość źródła, wybór modelu, obsługa batch i decyzje eksportu mają większe znaczenie niż marketingowe obietnice na stronie narzędzia.

Dlaczego skalowanie wideo AI to supermoc twórcy

Niskiej rozdzielczości materiał miał kiedyś twardy limit. Można go było powiększyć, ale nie poprawić. Tradycyjne skalowanie rozciągało piksele. Robiło klipy większymi, nie lepszymi.

Skalowanie wideo AI działa inaczej. Używa głębokiego uczenia do rekonstrukcji detali, interpretacji otaczających pikseli i zachowania ruchu między klatkami. Ta ostatnia część ma znaczenie. Pojedynczy obraz może wyglądać ostro, ale zawieść jako wideo, jeśli krawędzie migoczą lub tekstury migotają z klatki na klatkę.

Dlaczego twórcy dbają o to teraz

To już nie jest niszowa sztuczka restauracyjna. Rynek oprogramowania do skalowania wideo AI wzrósł z 550 milionów USD w 2024 r. do 670 milionów USD w 2025 r. i ma osiągnąć 5 miliardów USD do 2035 r., z CAGR 22,3%, napędzany popytem na dystrybucję w 4K i wyższą jakość wizualną dla zaangażowania, według Wise Guy Reports on the AI video upscaling software market.

To zgadza się z tym, z czym twórcy mierzą się co tydzień:

- Stary materiał nadal ma wartość: Dawne wywiady, webinary, dema i świadectwa często zawierają pomysły warte ponownego opublikowania.

- UGC rzadko jest idealnie nagrane: Świetne haki pochodzą z nieidealnych klipów.

- Każda platforma karze miękkość: Przycinanie, zmiana rozmiaru i ponowna kompresja słabego materiału uwypukla wady.

Praktyczna reguła: Używaj skalowania AI do odzyskania mocnego contentu. Nie oczekuj, że uratuje słabą kinematografię, nieostre ujęcia czy silne rozmycie ruchu.

Istnieje też szerszy kąt workflow. Jeśli już przekształcasz jeden asset w wiele, skalowanie staje się częścią repakowania, nie tylko naprawy. Dlatego naturalnie pasuje obok AI content repurposing. Pojedyncze niskiej rozdzielczości źródło może stać się shortami, edycjami kwadratowymi i odświeżonymi repostami, jeśli wyczyścisz źródło przed zmianą rozmiaru i dystrybucją.

W czym sprawdza się najlepiej

Skalowanie AI błyszczy w kilku konkretnych sytuacjach:

| Przypadek użycia | Dlaczego działa |

|---|---|

| Archiwalne klipy | Przywraca klarowność bez ręcznej odbudowy każdego ujęcia |

| Nagrania ekranu | Pomaga krawędziom tekstu i elementom UI przetrwać kompresję |

| UGC na reklamy | Podnosi bazową jakość przed napisami, brandingiem i eksportem |

| Przycięte edycje social | Dodatkowy zapas rozdzielczości pomaga przy przekształcaniu jednego mastera w wiele formatów |

Jeśli potrzebujesz szybkiego przypomnienia, co oznacza wyższa rozdzielczość w praktyce, ten podział https://shortgenius.com/blog/what-is-4-k-resolution jest przydatny, zanim zdecydujesz, czy klip zasługuje na wykończenie w 4K.

Przygotowanie materiału źródłowego do bezbłędnego skalowania

Największy błąd z upscale video ai to karmienie go najgorszym plikiem, jaki masz, i nadzieja, że model wyczaruje magię.

Nie wyczaruje.

Rynek rusza szybko. Szerszy rynek narzędzi do ulepszania wideo AI ma osiągnąć 1,166 miliarda USD do 2032 r., z CAGR 37,1%, napędzany systemami głębokiego uczenia, które dają natychmiastowe boosty rozdzielczości 2x do 4x, jednocześnie redukując przepustowość, według Intel Market Research on the video enhancing AI tool market. Ale lepsze modele nie anulują złych wejść.

Sprawdź klip przed przetworzeniem

Przed kolejkowaniem czegokolwiek sprawdzam, czy klip to dobry kandydat, czy pułapka.

Użyj tej krótkiej audyty:

- Uszkodzenia kompresji: Jeśli widzisz macroblocking, mosquito noise lub rozmazaane detale, model może traktować te uszkodzenia jak prawdziwą teksturę.

- Rozmycie ruchu: AI może wyostrzyć krawędzie, ale nie odzyska detali, których nigdy nie było w klatce.

- Ostrość: Lekko miękkie może być do uratowania. Przeskoczona ostrość zwykle zostaje przeskoczona.

- Stabilność klatek: Drgające klipy trudniej skalować czysto, zwłaszcza jeśli tło już się rozpada.

- Pochodzenie pliku: Eksportuj z najbliższego oryginału, jaki znajdziesz. Nie skaluj pliku, który już był几次 skompresowany.

Wybierz właściwe źródło, nie tylko największe

Twórcy często gonią rozdzielczość najpierw. To odwrotnie.

Czystszy master 720p może przewyższyć zniszczony repost 1080p. Liczy się, czy źródło zachowuje rzeczywiste informacje obrazu. Jeśli masz opcje, wybierz plik z najmniejszą ponowną kompresją i najmniejszą liczbą edycji wbudowanych.

Jeśli źródło już wygląda na szumne, chrupiące i niestabilne w natywnym rozmiarze, skalowanie zwykle sprawia, że te problemy łatwiej zauważyć.

Co naprawić przed skalowaniem

Małe przygotowanie oszczędza wiele rerenderów.

-

Przytnij klip najpierw

Nie przetwarzaj martwego powietrza, fałszywych startów czy alternatywnych ujęć, jeśli ich nie użyjesz. -

Oddziel typy materiałów

Talking head, gameplay, animacja i screen capture zachowują się inaczej. Nie batchuj ich pod jednym presetem. -

Zrób oczywiste czyszczenie wcześnie

Jeśli plik potrzebuje podstawowego denoise lub deinterlacing, zrób to przed passą skalowania. -

Uruchom krótki sample

Weź wymagający moment z klipu. Szybki ruch ręki, detale włosów, ruch kamery, drobny tekst. Jeśli sample zawiedzie, pełny render nie poprawi się później.

Złe kandydatki do skalowania AI

Niektóre klipy nie warte są obliczeń.

- Silnie filtrowane pobrania social

- Maleńkie repostowane memy

- Materiały z silnym rozkładem niskiego oświetlenia

- Klip y, gdzie twarze już są zniekształcone przez kompresję

To brzmi surowo, ale chroni twój czas. Najlepszy workflow zaczyna się od selekcji, nie ustawień oprogramowania.

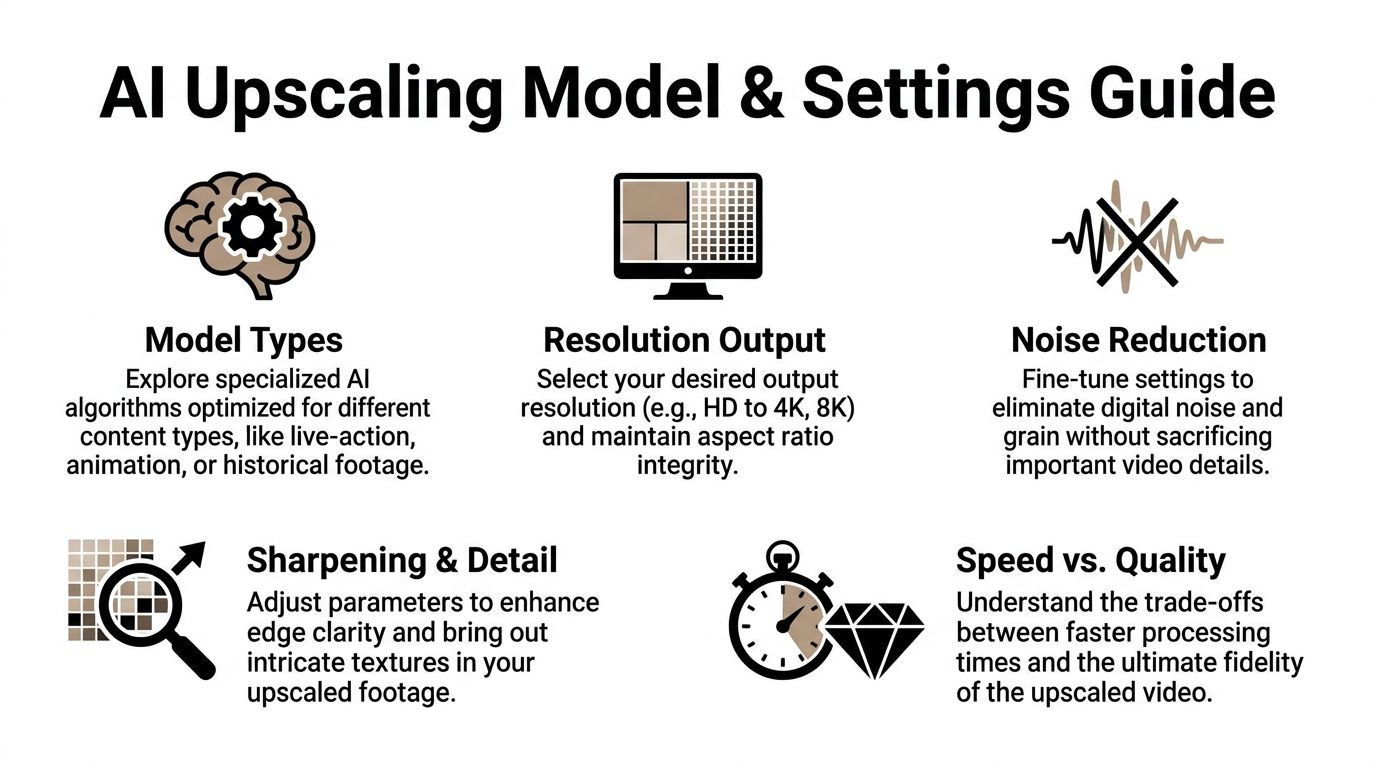

Wybór właściwego modelu AI i ustawień

Większość nieudanych upscale'ów pochodzi z tego samego nawyku. Ludzie ładują klip, wybierają najwyższy output, przesadzają z sharpeningiem i zakładają, że więcej przetwarzania to więcej jakości.

Nie jest.

Różne modele robią różne kompromisy. Niektóre zachowują realizm. Niektóre wymyślają więcej tekstury. Niektóre dobrze radzą sobie z animacją i zawodzą na skórze. Niektóre są stabilne w ruchu. Inne produkują imponujące statyczne klatki i brzydkie artefakty temporalne.

Przydatny benchmark stoi za tym wszystkim. W skalowaniu AI modele głębokiego uczenia jak basicVSR++ mogą osiągnąć ponad 13% wyższe wyniki VMAF niż tradycyjny Lanczos przy skalowaniu 540p do 1080p, z zyskami PSNR 2-4dB, ale ograniczenia sprzętowe na konsumenckich GPU mogą powodować wskaźniki awarii powyżej 50% dla klipów 4K dłuższych niż 2 minuty z powodu braku VRAM, jak podaje At Scale Conference coverage of on-device video playback upsampling.

Wybór modelu zaczyna się od typu materiału

Prosty sposób myślenia o modelach:

| Typ materiału | Co priorytetyzować | Powszechny tryb awarii |

|---|---|---|

| Live action | Naturalna skóra, stabilny ruch, powściągliwy sharpening | Woskowe twarze |

| Animacja | Czyste linie, spójność krawędzi | Haloing wokół konturów |

| Gameplay | Obsługa ruchu, klarowność tekstu/UI | Ghosting w szybkich scenach |

| Archiwalny materiał | Konserwatywna rekonstrukcja | Fałszywa tekstura zmieniająca oryginalny wygląd |

Jeśli narzędzie oferuje wiele rodzin modeli, nie używaj jednego uniwersalnego presetu. Tak dostajesz nadostre wywiady i zamuloną animację w tym samym folderze projektu.

Dla editorów porównujących narzędzia i workflow przed zobowiązaniem do stacka, ten roundup https://shortgenius.com/blog/najlepsze-programy-do-edycji-wideo-ai-2025 pomaga umieścić skalowanie w szerszym pipeline edycji.

Ustawienia, które mają największe znaczenie

Wiele etykiet UI brzmi technicznie, ale zachowuje się przewidywalnie.

Denoise

Używaj denoise, gdy źródło ma widoczny szum, który model myli z detailem. Używaj mniej, niż myślisz, że potrzebujesz.

Zbyt dużo denoise odbiera teksturę ze skóry, tkanin i tła. Potem sharpening próbuje odbudować fałszywą ostrość na spłaszczonym obrazie.

Deblock

Deblock pomaga przy uszkodzeniach kompresji. Może wygładzić brzydkie krawędzie bloków, zanim model upscale je wyolbrzymi.

To przydatne przy pobranych klipach i starych eksportach. Niebezpieczne na już czystym materiale, bo może zmiękczyć krawędzie, które chciałeś zachować.

Sharpen

Sharpen to miejsce, gdzie render często jest zepsuty.

Mało sharpeningu może odzyskać definicję krawędzi. Zbyt dużo tworzy halo, kruche włosy i ten syntetyczny wygląd „AI enhanced”. Jeśli sample wygląda imponująco na pauzie, ale brzydko w ruchu, sharpening jest często winowajcą.

Właściwe ustawienie sharpen powinno zniknąć w finalnym wideo. Jeśli widzowie czują przetwarzanie, zwykle jest zbyt agresywne.

Strategia rozdzielczości bije brute force

Idąc prosto do 4K często jest złym ruchem. Dla contentu social 1080p lub skromny krok w górę może wyglądać czyściej niż większy plik z wymyślonymi detalami.

Oto praktyczne porównanie:

| Podejście | Zaleta | Wada |

|---|---|---|

| Bezpośredni skok do 4K | Maksymalny rozmiar outputu | Więcej halucynowanych detali, cięższe rendery |

| Krok do 1080p najpierw | Lepsza kontrola, łatwiejszy QA | Dodatkowy punkt decyzyjny |

| Umiarkowane skalowanie tylko | Szybsze, bezpieczniejsze dla social | Mniej dramatyczne before-and-after |

Ta środkowa ścieżka wygrywa zaskakująco często. Zachowujesz kontrolę nad teksturą i ruchem, unikając całonocnego renderingu pliku, który i tak mocno skompresuje się przy uploadzie.

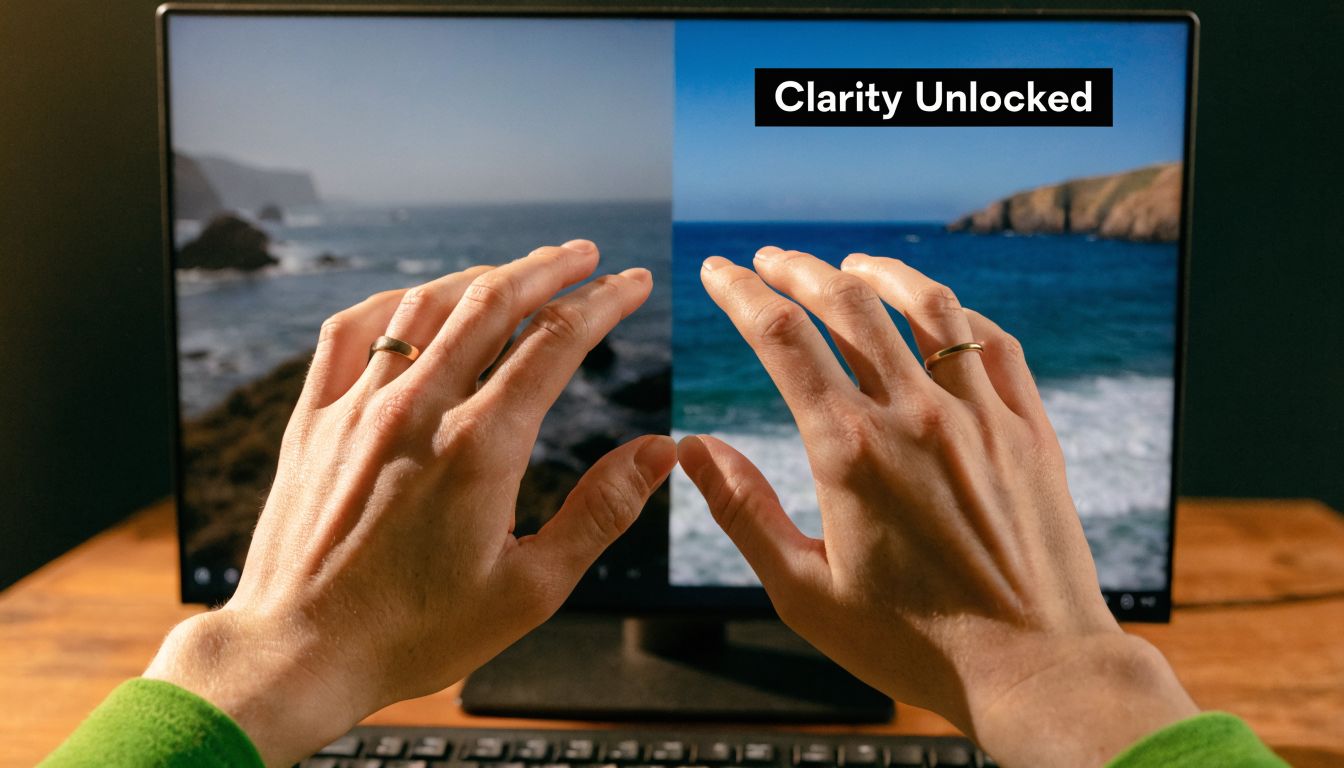

Szybki wizualny walkthrough pomaga przy ustawianiu:

Lokalne versus chmurowe przetwarzanie

Ten wybór to mniej ideologia, więcej ograniczenia.

Przetwarzanie lokalne daje kontrolę. Ale blokuje maszynę i szybko ujawnia limity GPU.

Przetwarzanie chmurowe usuwa wąskie gardło sprzętowe, ale tracisz kontrolę nad timingiem, kosztami i czasem drobnymi ustawieniami w zależności od platformy.

Wybieraj lokalne, gdy:

- Potrzebujesz powtarzalnych presetów na znanej maszynie

- Intensywnie testujesz

- Chcesz bezpośredni nadzór nad każdą passą

Wybieraj chmurowe, gdy:

- Twój GPU zawodzi na dłuższych klipach

- Potrzebujesz dostępu zespołowego

- Wolisz edytować, podczas gdy rendery dzieją się gdzie indziej

Buduj presety, potem im nie ufaj

Presety oszczędzają czas. Ślepe zaufanie niszczy jakość.

Trzymaj kilka startowych presetów wg typu contentu, potem testuj każdy nowy source krótkim segmentem przed pełnym renderem. Jeden preset dla czystego talking-head. Inny dla surowego UGC. Inny dla animacji czy screen recordings.

Ta dyscyplina ma większe znaczenie niż nazwa marki oprogramowania.

Opanowanie batch upscaling workflow

Skalowanie jednego klipu to eksperyment. Skalowanie dwudziestu to operacje.

Wiele twórców traci czas. Traktują każdy plik jak custom job, pilnują eksportów i rerenderują nieudane rendery, bo nic nie było zorganizowane na starcie. Batch workflow to naprawia.

Według Audials guidance on beginner mistakes in AI video upscaling, eksperci polecają zaczynać od wysokiej jakości, minimalnie skompresowanego wideo i testować przyrostowe skoki rozdzielczości jak 720p do 1080p przed 4K, by uniknąć nienaturalnych wyników i 4x dłuższych czasów renderu. Ta sama wskazówka zauważa, że agresywne modele mogą dawać 20-30% wskaźniki artefaktów w scenach z ciężkim ruchem, spadając do poniżej 5% z właściwym workflow.

Lokalny overnight workflow

Dla narzędzi desktopowych najbezpieczniejszy setup jest nudny celowo.

-

Stwórz trzy foldery

Użyjsource,test-rendersifinal-upscaled. Trzymaj je oddzielnie. -

Zmień nazwy klipów przed kolejkowaniem

Dodaj tagi platformy lub projektu do nazw plików, by szybko śledzić awarie. -

Grupuj wg zachowania materiału

Nie mieszaj drgającego UGC z wypolerowanym studio w jednym batch preset. -

Uruchom jeden stress test na grupę

Wybierz najtrudniejszy klip w każdej kategorii. Szybki ruch, włosy, tekst, ujęcia tłumu. Jeśli zadziała, łatwiejsze klipy zwykle idą za nim. -

Kolejkuj pełne joby na noc

Pozwól maszynie renderować, gdy nie edytujesz.

Chmurowy batch workflow

Chmurowe workflow działają lepiej przy wolumenie, współpracy lub maszynie, która nie wytrzyma obciążenia.

Proces jest inny:

- Uploaduj tylko zatwierdzone źródła: Nie używaj chmury jako pokoju sortowniczego.

- Używaj jasnych konwencji nazewniczych: Zamieszanie z wersjami narasta szybko w shared projektach.

- Dokumentuj preset: Gdy dobry batch wyląduje, zapisz dokładną konfigurację.

- Przypisz własność review: Ktoś musi spot-checkować outputy, nie tylko potwierdzić, że pliki istnieją.

Co sprawdzić po batch run

Ukończona kolejka renderów to nie to samo co użyteczny batch.

Sprawdź te najpierw:

| Sprawdzenie | Dlaczego ma znaczenie |

|---|---|

| Spójność ruchu | Migotanie często ukrywa się do playbacku |

| Twarze i ręce | Agresywne modele zawodzą tu pierwsze |

| Drobny tekst i UI | Świetne dla screen recordings, łatwe do zepsucia |

| Integralność frame rate | Niezgodności tworzą stutter na eksporcie |

| Aspect ratio | Nieprawidłowa obsługa powoduje awkward crops później |

Batch upscaling oszczędza czas tylko, jeśli twój verification pass jest szybki i bezlitosny.

Błędy, które niszczą skalę

Największe awarie zwykle pochodzą z procesu, nie jakości modelu.

- Jeden preset na każdy klip: Szybkie, ale niewiarygodne.

- Brak sample render: Tak budzisz się z folderem pełnym nieużywalnych plików.

- Pomijanie QC, bo thumbnails wyglądają dobrze: Wiele artefaktów pojawia się tylko w playbacku.

- Skalowanie po wielu eksportach edycji: Każde re-encode obniża sufit.

Dla zespołów cel to nie tylko szybsze przetwarzanie. To przewidywalne przetwarzanie. Stabilny system batch czyni upscale video ai częścią regularnej produkcji zamiast misji ratunkowej za każdym razem, gdy pojawi się low-res asset.

Edycja po upscale i inteligentne presety eksportu

Upscalowany plik to nie ukończony plik.

To bliżej przywróconego negatywu. Nadal musisz go ukształtować, sprawdzić i wyeksportować dla miejsca, w którym ma żyć. Ta ostatnia część ma znaczenie, bo twórcy często gonią rozdzielczość, ignorując warunki dystrybucji.

Pytanie ROI jest realne. Jak podaje Cloudinary’s guide to using AI to upscale video, wiele narzędzi obiecuje 4K, ale platformy jak TikTok i Instagram Reels i tak downscalują content. To stawia praktyczne pytanie dla twórców. Czy upscale do 4K jest korzystny, czy zoptymalizowany eksport HD sprawdzi się równie dobrze dla mobile-first viewing?

Passa czyszczenia ma znaczenie

Modele AI często wprowadzają subtelne problemy, które nie widać w side-by-side still frame.

Powszechne to:

- Dryf kolorów: Odcienie skóry mogą lekko się przesunąć po enhancement.

- Chattering krawędzi: Drobne detale mogą pulsować w ruchu.

- Niespójność tekstury: Włosy, tkaniny i tła mogą przechodzić między ostrym a miękkim.

Traktuję edycję po upscale jak finishing work, nie opcjonalny polish.

Napraw kolory przed eksportem

Nawet lekki grade może ujednolicić obraz. Dopasuj odcienie skóry, cofnij highlights, jeśli upscale je uczynił kruchymi, i upewnij się, że czernie nie stały chrupiące.

Przejrzyj ruch w playbacku

Nie inspekcjonuj tylko frame grabs. Obejrzyj klip full screen, potem jeszcze raz na telefonie. Problemy ruchu ujawniają się w playbacku, nie screenshotach.

Jeśli upscale wygląda świetnie na pauzie i dziwnie w ruchu, eksport nie jest gotowy.

Inteligentne eksporty biją max eksporty

Twórcy często domyślnie wybierają „najwyższa jakość dostępna”. Brzmi bezpiecznie, ale nie zawsze jest użyteczne.

Dla dystrybucji short-form myśl w kategoriach platform fit:

| Destynacja | Lepsze domyślne nastawienie | Czego unikać |

|---|---|---|

| TikTok | Czysty, stabilny HD master | Ogromne pliki z marginalnym widocznym zyskiem |

| Instagram Reels | Silna odporność na kompresję | Nadostre eksporty, które psują się po uploadzie |

| YouTube Shorts | Ostry tekst i stabilny ruch | Bez potrzeby oversized rendery, jeśli źródło było słabe |

Chodzi nie o to, że 4K jest złe. Chodzi o to, że 4K nie jest automatycznie lepsze dla każdego social uploadu.

Praktyczna polityka eksportu

Użyj tego zestawu reguł:

-

Eksportuj dla platformy, nie dumy

Widzowie dbają o klarowność i płynność bardziej niż o twoje menu render settings. -

Zachowaj high-quality archive master

Zapisz czysty master na przyszłe użycie, cięcia czy delivery klientowi. -

Stwórz platform-specific derivatives

Jeden plik archiwum, potem eksporty dostrojone do vertical, square czy horizontal needs. -

Sprawdź wynik po uploadzie

Platformy social to część łańcucha renderingu. Twój lokalny eksport to nie finalny look.

Wiele twórców kompromituje jakość przy eksporcie. Spędzają czas na upscale, potem oddają finalny wynik kompresji platformy bez strategii. Inteligentne presety eksportu chronią pracę, którą już zrobiłeś.

Automatyzacja skalowania w pipeline ShortGenius

Manualne skalowanie działa przy naprawie jednego klipu. Załamuje się przy produkcji social contentu co tydzień na wielu kanałach.

To wąskie gardło dla zespołów. Według Perfect Corp coverage of AI video enhancer workflow limitations, największe wyzwanie to integracja skalowania w multi-channel workflow, bo większość standalone narzędzi brakuje batch processing na skalę lub API availability. Zunifikowany publishing pipeline ma większe znaczenie niż kolejna izolowana app enhancement.

Co automatyzacja powinna naprawdę robić

Przydatny zautomatyzowany pipeline nie tylko „dodaje upscale”.

Powinien obsługiwać łańcuch jak ten:

- Ingest source clip

- Route wg typu contentu

- Apply właściwy enhancement preset

- Przekaż wynik do edycji

- Resize i package dla każdego kanału

- Schedule dystrybucji

Ta struktura czyni skalowanie z kroku naprawy w infrastrukturę.

Gdzie pasuje w produkcji

Dla short-form teams najlepszy punkt wstawienia to zwykle wczesny. Wyczyść visual asset przed napisami, brandingiem, reframingiem i eksportami.

To ma znaczenie, bo każdy późniejszy krok zależy od stabilnego wyglądu źródła. Jeśli dodasz animowane napisy, cut-ins i brand overlays na słaby materiał najpierw, potem spróbujesz upscale później, zmuszasz model do interpretacji elementów designu i uszkodzeń kompresji jednocześnie.

Bardziej niezawodna kolejność to:

| Etap | Lepsza sekwencja |

|---|---|

| Obsługa źródła | Wybierz i zatwierdź raw clip |

| Enhancement | Upscale i wyczyść ruch najpierw |

| Warstwa edycji | Dodaj napisy, trims, branding, voice |

| Dystrybucja | Eksport per platform i publish |

Jedna wzmianka o platformie, użyta tam, gdzie pasuje

W zunifikowanym workflow ShortGenius może siedzieć w tym łańcuchu produkcji jako opcja dla zespołów, które chcą video assembly, voiceovers, editing, resizing, scheduling i API-driven automation w tym samym środowisku. Taki setup ma znaczenie, gdy próbujesz przekształcić surowy materiał w powtarzalny output bez bouncing plików między appkami. Jeśli budujesz szerszy system wokół recurring channel production, ten guide https://shortgenius.com/blog/automatyzacja-youtube-ai jest relevant, bo automatyzacja działa tylko, gdy każdy krok produkcji łączy się czysto.

Co działa, a co nie

Co działa

- Traktowanie skalowania jako preprocessing stage

- Zapisywanie presetów wg klasy materiału

- Automatyzacja powtarzalnych pass, nie estetycznej oceny

- Zachowanie ludzkiego review step przed publish

Co nie działa

- Wysyłanie każdego klipu przez ten sam enhancement profile

- Automatyzacja bez QC ownership

- Budowanie pipeline wymagającego manual file wrangling między toolami

- Zakładanie, że AI-generated i organic footage zachowują się tak samo pod upscale

Wygrana to nie tylko lepiej wyglądający materiał. Wygrana to usunięcie kolejnego manual bottleneck z produkcji contentu.

Dla agencji, brand teams i high-volume twórców to fundamentalna zmiana. Skalowanie przestaje być specjalną poprawką dla złych plików i staje się standardowym background processem. Odzyskujesz więcej użytecznego materiału, spędzasz mniej czasu na powtarzalnym cleanup i trzymasz jakość outputu spójną na kanałach.

Jeśli chcesz przekształcić ten workflow w powtarzalny system, ShortGenius (AI Video / AI Ad Generator) wnosi video creation, editing, resizing, voiceovers, scheduling i automated publishing do jednej platformy, więc skalowanie może wpasować się w szerszy production pipeline zamiast żyć jako one-off manual task.