Przewodnik twórcy po opanowaniu lip sync AI

Odkryj, jak lip sync AI rewolucjonizuje tworzenie wideo. Dowiedz się, czym jest, jak działa i jak go używać do tworzenia idealnie zdubbingowanych treści dla globalnej publiczności.

Czy kiedykolwiek chciałeś mówić w dowolnym języku w swoich wideo, z ustami idealnie pasującymi do każdego słowa, nawet jeśli nie znasz tego języka? Dokładnie to umożliwia lip-sync AI. W swej istocie ta technologia pobiera oddzielną ścieżkę audio i automatycznie animuje usta osoby – lub awatara – idealnie synchronizując je z dźwiękiem.

To nie jest tylko fajna sztuczka na imprezę; to ogromny krok naprzód, czyniący tworzenie treści i lokalizację dostępną dla każdego.

Dlaczego lip-sync AI jest ważny dla twórców

Pomyśl o lip-sync AI jako o cyfrowym lalkarzu dla twoich wideo. Przez długi czas realistyczna synchronizacja ust była możliwa tylko dla studiów filmowych z wielkimi budżetami i dedykowanymi zespołami VFX. Wymagała mozolnej animacji ruchów ust klatka po klatce. Teraz ta sama moc jest w rękach twórców na całym świecie i całkowicie zmienia sposób tworzenia wideo dla platform takich jak YouTube, TikTok i Instagram.

Głównym zadaniem tego AI jest zniwelowanie różnicy między tym, co widzisz, a tym, co słyszysz, tworząc całkowicie płynne i wiarygodne doświadczenie dla widza. Zapomnij o starych, topornych dubbingach, gdzie audio jest boleśnie poza synchronem. Ta technologia zapewnia, że usta mówcy poruszają się w idealnej harmonii z nową ścieżką audio, niezależnie od tego, czy to inny język, ponowne nagranie voiceoveru, czy nawet skrypt odczytany przez głos AI.

Rozszerzanie zasięgów i oszczędzanie czasu

Wpływ na twórców treści jest ogromny. Nie jesteś już ograniczony do swojego języka ojczystego ani nie musisz zmagać się z kosztownymi ponownymi nagraniami tylko po to, by poprawić mały błąd audio.

Ta technologia daje ci moc do:

- Niszczenia barier językowych: Natychmiast dubbinguj swoje wideo na wiele języków. Możesz otworzyć swoją treść na masowe międzynarodowe publiczności bez konieczności mówienia ani słowa po hiszpańsku, japońsku czy hindi.

- Skalowania treści bez wysiłku: Weź jedno wideo i dostosuj je do różnych rynków globalnych. Wszystko, co musisz zrobić, to wymienić plik audio i pozwolić AI zająć się resztą.

- Podnoszenia wartości produkcji: Twórz profesjonalnie brzmiące voiceovery dla swoich reklam lub wideo na media społecznościowe i upewnij się, że twój talent na ekranie lub awatar wygląda całkowicie naturalnie i autentycznie.

To nie jest tylko techniczna nowinka; to strategiczna przewaga. Lip-sync AI pozwala samotnym twórcom i małym zespołom konkurować na skalę globalną, tworząc treści wielojęzyczne, które kiedyś były możliwe tylko dla dużych firm medialnych.

Ostatecznie to narzędzie chodzi o pracę mądrzej, a nie ciężej. Automatyzując zadanie postprodukcyjne, które kiedyś było wyczerpujące, uwalnia cię do skupienia się na tym, co robisz najlepiej: wymyślaniu świetnych pomysłów. Aby zobaczyć pełny obraz, warto zrozumieć szerszy świat AI Powered Content Creation i jak narzędzia takie jak to zmieniają całą branżę. Lip-sync AI to kluczowy element tej układanki, dający ci możliwość łączenia się z większą liczbą ludzi w znacznie bardziej autentyczny sposób.

Jak działa lip-sync AI

Czy kiedykolwiek zastanawiałeś się, co dzieje się pod maską lip-sync AI? To nie jest tylko cyfrowe przedstawienie lalkowe, poruszające ustami w górę i w dół. Pomyśl o tym raczej jak o zaawansowanej usłudze tłumaczeniowej, ale zamiast przekształcać słowa z jednego języka na drugi, przekształca dźwięki w niezwykle precyzyjne ruchy twarzy.

Użyjmy analogii. Jeśli uczyłbyś robota mówić, nie pokazałbyś mu tylko alfabetu. Nauczyłbyś go, jak każde litera brzmi. Lip-sync AI robi coś bardzo podobnego, rozkładając twoją ścieżkę audio na najmniejsze jednostki dźwięku, zwane phonemes. Na przykład słowo "hello" jest rozkładane na oddzielne dźwięki takie jak "h", "eh", "l" i "ow".

Gdy AI zidentyfikuje te phonemes, przystępuje do głównego zadania: mapowania każdego dźwięku na dokładny kształt ust, jaki robi osoba, mówiąc go. Te wizualne kształty ust nazywają się visemes. AI zostało przeszkolone na górach danych, więc instynktownie wie, że dźwięk "f" oznacza, że górne zęby powinny dotknąć dolnej wargi. To błyskawiczne tłumaczenie z audio na wizualne.

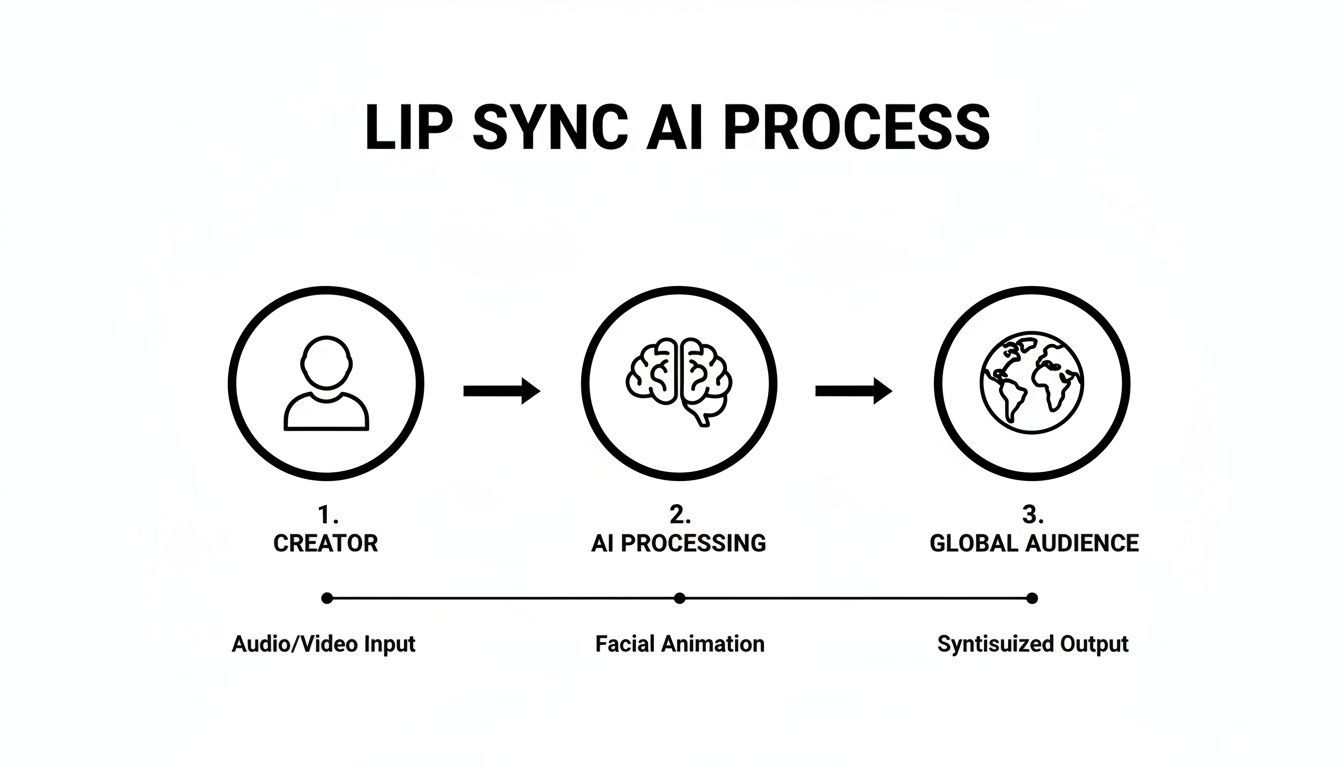

Ten diagram pokazuje, jak treści przechodzą od prostego nagrania po twojej stronie do wideo gotowego dla globalnej publiczności.

Jak widzisz, twórca dostarcza surowe materiały, AI wykonuje ciężką pracę, a rezultat to dopracowane treści, które łączą się z widzami na całym świecie.

Dwa kluczowe składniki

Aby wykonać tę cyfrową magię, AI naprawdę potrzebuje od ciebie tylko dwóch rzeczy. Ta prostota to ogromna część tego, co czyni narzędzia takie jak ShortGenius tak użytecznymi dla twórców, którzy muszą pracować szybko.

- Plik audio: To twój plan. Może to być voiceover, który właśnie nagrałeś, profesjonalnie zdubbingowana ścieżka audio w nowym języku lub jakiekolwiek inne nagranie kogoś mówiącego. Im czystsze audio, tym lepiej. Ostre, klarowne mowy dają AI znacznie łatwiejszy zestaw phonemes do pracy, co zawsze prowadzi do bardziej dokładnego i wiarygodnego rezultatu.

- Wideo lub awatar: To twoje płótno. Możesz użyć wideo z prawdziwą osobą lub nawet statycznego obrazu AI-generowanego awatara. AI używa tej wizualnej bazy do generowania i nakładania nowych, idealnie zsynchronizowanych ruchów ust.

Ale nowoczesne algorytmy głębokiego uczenia nie zatrzymują się na tym. Idą o krok dalej, analizując niuanse w audio – ton, emocje, nawet prędkość mówcy. To pomaga sprawić, by ostateczna animacja czuła się znacznie bardziej naturalnie. W swej istocie lip-sync AI chodzi o mistrzowską umiejętność sync audio video tak płynnie, że widz nawet o tym nie myśli.

Podsumowując: To nie chodzi tylko o poruszanie ustami. To głęboka analiza dźwięku, która przekłada mowę na realistyczne wyrazy twarzy, wychwytując małe detale, które sprawiają, że występ wydaje się naprawdę ludzki.

Ten poziom automatyzacji napędza poważny wzrost branży. Globalny rynek technologii lip-sync jest na dobrej drodze, by skoczyć z USD 1.12 billion w 2024 do szacowanych USD 5.76 billion do 2034. Fakt, że uczenie maszynowe napędzane audio już dominuje z 40.7% udziałem w rynku, pokazuje, jak kluczowa stała się ta technologia dla globalizacji treści.

Ta sama technologia to kluczowy składnik wielu narzędzi wideo AI. To właśnie dzięki niej twórca może przekształcić pojedyncze zdjęcie w przekonujące, dynamiczne wideo. Możesz zgłębić, jak to działa, czytając nasz przewodnik po transform images into video with AI.

Praktyczne zastosowania dla twórców i marketerów

Zrozumienie szczegółów technicznych lip-sync AI to jedno, ale prawdziwa magia dzieje się, gdy widzisz, jak otwiera nowe kreatywne i biznesowe drzwi. Dla twórców i marketerów to nie tylko nowinka; to poważne narzędzie do skalowania treści, wchodzenia na nowe rynki i autentycznego łączenia się z publicznościami na całym świecie.

Najbardziej oczywistym i potężnym przypadkiem użycia jest lokalizacja treści. Załóżmy, że masz viralowe TikTok lub tutorial YouTube, w który włożyłeś serce. Zamiast ograniczać się do anglojęzycznych widzów, możesz teraz stworzyć wersje dla publiczności hiszpańskojęzycznej, hindi czy japońskiej niemal natychmiast. AI nie tylko nakłada nową ścieżkę audio – starannie reanimuje ruchy twoich ust, by pasowały do nowego języka, sprawiając, że ostateczne wideo wydaje się całkowicie naturalne.

To całkowicie zmienia reguły gry w ekspansji globalnej. Stary sposób lokalizacji kampanii wideo obejmował zatrudnianie aktorów głosowych dla każdego języka, rezerwowanie drogiego czasu studyjnego i mozolne tygodnie lub miesiące postprodukcji. Teraz cały ten workflow jest szybszy i znacznie tańszy.

Od globalnych reklam po awatary AI

Poza samym tłumaczeniem wideo, lip-sync AI odblokowuje cały zakres strategii budowania marek i tworzenia przekonujących reklam. W swej istocie każde zastosowanie korzysta z możliwości oddzielenia tego, co ktoś mówi, od tego, jak wygląda podczas mówienia.

Oto kilka przełomowych sposobów, w jakie ta technologia jest używana już teraz:

- Tworzenie angażujących awatarów AI: Możesz wziąć pojedynczy obraz – maskotki, założyciela czy wirtualnego influencera – i ożywić go. Wystarczy podać voiceover text-to-speech, a masz nieskończony zapas treści na media społecznościowe bez konieczności stawiania się przed kamerą.

- Lokalizacja kampanii reklamowych: Marka może wyprodukować jedną fantastyczną, wysokobudżetową reklamę, a potem użyć AI do dostosowania jej do dziesiątek rynków międzynarodowych. To zachowuje spójność brandingową, jednocześnie sprawiając, że przekaz wydaje się lokalny i osobisty. Ten sposób to wybawienie dla platform reklamowych wymagających stałego strumienia świeżych kreacji. Możesz zobaczyć, jak to działa w szerszej strategii, czytając nasz przewodnik po tworzeniu effective AI UGC-style ads.

- Bezproblemowe poprawki audio: Wszyscy to znamy. Kończysz idealny montaż wideo, tylko po to, by zauważyć błąd w voiceoverze. Zamiast frustrującego ponownego nagrywania, możesz po prostu nagrać poprawioną linię audio i pozwolić AI bezszwowo ją wkleić, idealnie dopasowując usta.

Prawdziwa moc tkwi w oddzielaniu wizualnego od audio. To daje twórcom ogromną elastyczność do eksperymentowania, poprawiania błędów i dostosowywania treści do różnych platform i publiczności bez zaczynania od zera za każdym razem.

Aby pokazać, jak te pomysły ożywają, oto szybki podział, jak twórcy i marki wykorzystują lip-sync AI.

Zastosowania lip-sync AI dla twórców i marek

| Use Case | Primary Benefit | Example Application |

|---|---|---|

| Globalna dystrybucja treści | Wzrost publiczności | YouTuber tłumaczy swój najlepiej performujące wideo na 5 nowych języków, by dotrzeć do globalnej publiczności, potrajając potencjalną liczbę wyświetleń. |

| Wielojęzyczne kampanie reklamowe | Zwiększony ROI | Marka D2C tworzy 10 zlokalizowanych wersji jednej reklamy dla różnych krajów, poprawiając trafność reklam i wskaźniki konwersji. |

| Influencerzy AI i awatary | Skalowalność treści | Firma używa swojej animowanej maskotki do tworzenia codziennych aktualizacji na media społecznościowe bez potrzeby zespołu wideo do każdego posta. |

| Poprawki postprodukcyjne | Oszczędność czasu i kosztów | Filmmaker poprawia źle wypowiedzianą kwestię w kluczowej scenie bez ponownego nagrywania, oszczędzając tysiące dolarów. |

To nie jest tylko drobna poprawka – to fundamentalna zmiana w sposobie tworzenia wideo.

Rynek dubbingu wideo AI był wyceniony na $31.5 million w 2024 i ma wzrosnąć do $397 million do 2032. Ten wybuchowy wzrost zawdzięczamy niesamowitym oszczędnościom czasu i pieniędzy. Wielojęzyczna kampania, która kiedyś wymagała ogromnego budżetu i miesięcy pracy, może teraz być zrealizowana w mniej niż tydzień za mniej niż $2,000, dając zasięg globalny samotnym twórcom. Możesz dowiedzieć się więcej o ewoluującej ekonomii technologii lip-sync AI i zobaczyć, jak zmienia całą ekonomię twórców.

Jak wybrać odpowiednie narzędzie lip-sync AI

Z zalewem nowych narzędzi na rynku, wybór odpowiedniego lip-sync AI może wydawać się strzałem w ciemno. Ale nie wszystkie platformy są takie same, a zły wybór może zostawić cię z robotycznymi, niezdarnymi wideo, które odstraszają widzów zamiast ich angażować. Potrzebujesz prostej listy kontrolnej, by przebić się przez marketingowy szum.

Absolutnie najważniejszym czynnikiem jest jakość samego synchronu. Czy ostateczne wideo wygląda naturalnie, czy wpada w creepy "uncanny valley"? Świetne narzędzie rozumie drobne, subtelne ruchy prawdziwych ust – jak formują się wokół różnych dźwięków i łączą z wyrazem mówcy.

Tanie lub słabo przeszkolone AI może tylko otwierać i zamykać usta, co natychmiast zdradza fałsz. Najlepszym sposobem oceny jest wzięcie tego samego krótkiego klipu audio i przetestowanie go w kilku narzędziach. Porównaj wyniki obok siebie i zaufaj swojej intuicji.

Ocena kluczowych funkcji i wydajności

Poza czystym realizmem, musisz myśleć o swoich konkretnych potrzebach kreatywnych. Idealne narzędzie dla wielojęzycznego trenera korporacyjnego to pewnie przesada dla twórcy memów. Dopracowanie procesu oceny na starcie oszczędzi ci wiele bólów głowy później.

Oto niezbędne rzeczy, na które warto zwrócić uwagę:

- Wsparcie języków i akcentów: To deal-breaker, jeśli celujesz w globalną publiczność. Sprawdź, ile języków obsługuje narzędzie i, co równie ważne, jak radzi sobie z różnymi akcentami i dialektami. Narzędzie, które idealnie odda akcent z Glasgow, jest znacznie bardziej imponujące niż to, które działa tylko z generycznym, robotycznym głosem.

- Szybkość przetwarzania: Jak długo będziesz patrzył na pasek postępu dla klipu jednominutowego? W świecie treści short-form prędkość to wszystko. Niektóre platformy przetwarzają wideo w minuty, inne każą czekać wieki.

- Łatwość użycia: Narzędzie z milionem funkcji jest bezwartościowe, jeśli interfejs to koszmar. Szukaj czystego, prostego designu, który pozwala wgrać wideo i audio, a potem zastosować lip-sync w kilka kliknięć. Platformy jak ShortGenius dążą do tego, by ten krok był seamless częścią znacznie szerszego pipeline'u tworzenia wideo.

Ostatecznym celem jest znalezienie rozwiązania, które wpasuje się w twój istniejący proces bez tworzenia nowych wąskich gardeł. Odpowiednie narzędzie powinno czuć się jak rozszerzenie twojego kreatywnego zestawu narzędzi, a nie kolejny skomplikowany program, którego musisz się uczyć.

Rozważanie integracji i trendów rynkowych

Na koniec pomyśl szerzej. Jak ten lip-sync AI wpasowuje się w twój workflow? Czy współpracuje z edytorami wideo, które kochasz? Czy obsługuje potrzebne formaty i rozdzielczości wideo? Płynna integracja jest równie krytyczna co wydajność techniczna.

Wybuchowy wzrost w tej przestrzeni mówi wszystko. Rynek AI w mediach, w tym technologii lip-sync, ma urosnąć z USD 8.21 billion w 2024 do USD 51.08 billion do 2030. Taki szybki rozwój oznacza, że zaawansowane AI audio-wizualne szybko staje się rdzeniem każdej nowoczesnej strategii treści. Możesz znaleźć więcej szczegółów o rynku AI w mediach na datainsightsmarket.com.

Wybierając dobrze wspierane narzędzie, które ciągle się poprawia, nie tylko rozwiązujesz problem na dziś – inwestujesz w swoją zdolność tworzenia niesamowitych treści na lata.

Krok po kroku: Twój pierwszy film z lip-sync

W porządku, zabrudźmy ręce. Stworzenie pierwszego wideo z lip-sync AI nie jest tak skomplikowane, jak brzmi. Możemy to rozłożyć na prosty, czterostopniowy proces, który zabierze cię od surowego pomysłu do gotowego wideo do udostępnienia.

To podstawowy workflow, który znajdziesz w platformach jak ShortGenius, które stawiają tę potężną technologię na wyciągnięcie ręki.

Krok 1: Przygotuj ścieżkę audio

Wszystko zaczyna się od audio. Pomyśl o nim jak o planie twojego wideo – AI potrzebuje czystej, klarownej ścieżki, by określić, jakie kształty ust stworzyć. Możesz nagrać swój głos lub użyć jakościowego generatora text-to-speech dla konsekwentnie ostrej narracji.

Dla najlepszego rezultatu upewnij się, że audio ma mało lub zero szumów tła. Mówienie wyraźnie też robi ogromną różnicę. Im bardziej wyraźne są twoje słowa, tym lepiej AI dopasuje ruchy ust. Dopracowanie tego pierwszego kroku ustawia cię na znacznie bardziej wiarygodny rezultat.

Krok 2: Wybierz wideo lub awatara

Następnie musisz wybrać, kto (lub co) będzie mówić. To może być klip wideo, który już masz z kimś mówiącym, lub nawet statyczny obraz AI-generowanego awatara. Klucz to wyraźny widok twarzy.

Oto profesjonalna wskazówka: Kąt prosto z przodu działa najlepiej. AI potrzebuje bezpośredniego, niezasłoniętego widoku ust, by wygenerować realistyczne ruchy. Jeśli twarz jest odwrócona lub coś blokuje widok, ostateczna animacja będzie trochę nie tak.

Jakość twoich wejść bezpośrednio decyduje o jakości wyjścia. Ostre, dobrze oświetlone wideo i czyste audio dają AI najlepszy możliwy materiał do pracy, minimalizując błędy i zapewniając bardziej realistyczny rezultat.

Krok 3: Zastosuj lip-sync AI

Tu zaczyna się prawdziwa zabawa i zwykle wystarczy kliknąć przycisk. Gdy wgrasz pliki audio i wideo do narzędzia, po prostu zastosuj funkcję lip-sync. AI zabiera się do pracy, rozkładając dźwięki w twoim audio i tworząc zupełnie nowe ruchy ust na podmiocie wideo, by pasowały.

Cały proces jest zaskakująco szybki, często trwający tylko kilka minut. Podczas gdy AI wykonuje ciężką pracę, możesz przygotować się do ostatniego i najważniejszego kroku.

Krok 4: Przejrzyj i dopracuj wyjście

Żadne AI nie jest idealne za każdym razem, więc ostateczna kontrola jest kluczowa. Obejrzyj wygenerowane wideo i zwróć szczególną uwagę na timing. Czy synchron wygląda naturalnie? Czy są jakieś dziwne drgnięcia lub momenty, gdzie usta nie do końca pasują do audio?

Większość dobrych narzędzi daje opcje na małe poprawki. Czasem wystarczy lekko przesunąć timing audio lub uruchomić ponownie konkretny fragment, by wygładzić niedoskonałości. Gdy będziesz zadowolony, twoje wideo jest gotowe do eksportu. Ten cały proces to rdzeń wielu workflowów wideo AI, a możesz zobaczyć, jak wpasowuje się w szerszy obraz, czytając nasz przewodnik po text-to-video AI models.

Masz pytania o lip-sync AI? Mamy odpowiedzi.

Wskakiwanie w nową technologię zawsze rodzi pytania. To zupełnie normalne. Rozwiążmy kilka najczęstszych, które słyszę od twórców o lip-sync AI, byś mógł od razu tworzyć świetne treści.

Jak lip-sync AI radzi sobie z różnymi językami?

To duże pytanie. Dobra wiadomość jest taka, że większość topowych modeli AI jest trenowana na gigantycznych zbiorach danych z niezliczonymi godzinami wielojęzycznej mowy. Oznacza to, że zaskakująco dobrze radzą sobie nie tylko z różnymi językami, ale też akcentami. Chodzi nie tylko o słowa; chodzi o naukę specyficznych kształtów ust – techniczny termin to visemes – pasujących do każdego unikalnego dźwięku.

Oczywiście, nie wszystkie narzędzia są równe. Wydajność może naprawdę różnić się między platformami, dlatego zawsze polecam przetestowanie krótkiego klipu w docelowym języku przed dużym projektem. Najlepsze systemy wychwycą te subtelne niuanse, sprawiając, że mówca wygląda jak native speaker, zamiast stosować generyczny, "jeden-pasuje-do-wszystkich" ruch ust, który po prostu wydaje się nie tak.

Jaka jest różnica między lip-sync a dubbingiem?

Łatwo je pomylić, ale to naprawdę dwie strony tej samej monety, pracujące razem, by wideo wydawało się autentyczne w nowym języku.

Pomyśl o tym tak:

- Dubbing wideo: To wszystko o audio. To proces wymiany oryginalnej ścieżki głosowej na nową, zwykle w innym języku.

- Lip-sync: To wizualne dopełnienie. Gdy nowa ścieżka audio jest nałożona, AI zabiera się do pracy, cyfrowo zmieniając ruchy ust mówcy, by idealnie pasowały do nowego dialogu.

Gdy je połączysz, dostajesz całkowicie zlokalizowane wideo. Dźwięk jest właściwy, a wizualia pasują. Jedno zajmuje się tym, co słyszysz, drugie – tym, co widzisz.

Ten cios jeden-dwa pozwala twórcom wziąć pojedyncze wideo i sprawić, by wydawało się native dla publiczności na całym świecie, bez tego rozpraszającego uczucia braku synchronu, które natychmiast wytrąca widza z doświadczenia.

Jak uniknąć creepy efektu "uncanny valley"?

Ach, "uncanny valley". To dziwne, niepokojące uczucie, gdy coś wygląda prawie jak człowiek, ale kilka subtelnych rzeczy jest nie tak. To realny problem z lip-sync AI, ale możesz go całkowicie uniknąć.

Po pierwsze, zawsze zaczynaj od wysokiej jakości materiałów źródłowych. Ostre, dobrze oświetlone wideo lub dopracowany awatar daje AI znacznie czystsze płótno do pracy. Jeśli dasz mu rozmazane lub niskiej rozdzielczości ujęcia, prosisz się o dziwny rezultat.

Następnie, skup się na jakości audio. Użyj wysokiej jakości głosu AI brzmiącego naturalnie lub lepiej – czystego nagrania ludzkiego aktora głosowego. Robotyczny, płaski głos z realistycznymi ruchami ust to przepis na natychmiastową creepy.

W końcu pamiętaj o dodaniu subtelnych ludzkich akcentów. Scena wygenerowana przez AI może wydawać się trochę sterylna sama w sobie. Dodanie małych rzeczy jak naturalne ruchy głowy, realistyczne mruganie czy nawet ciekawy background może sprawić, że całe wideo wyda się bardziej ugruntowane i żywe, wyciągając je prosto z uncanny valley.

Gotowy na tworzenie oszałamiających, wielojęzycznych wideo bez komplikacji? ShortGenius integruje potężne możliwości lip-sync AI w kompletny workflow tworzenia wideo. Produkuj profesjonalne reklamy i treści społecznościowe w minuty. Zacznij tworzyć za darmo na shortgenius.com.