Sblocca una Qualità Stupefacente: Upscale Video AI

Impara un workflow pratico per l'upscale video con AI. Copre la preparazione del footage, impostazioni ottimali, elaborazione batch ed esportazione per social media con ShortGenius.

Hai un clip che dovrebbe funzionare.

Forse è una vecchia testimonianza di un cliente registrata con il telefono. Forse è un footage generato dagli utenti che cattura l'emozione ma appare morbido su uno schermo moderno. Forse è un vecchio top performer che vuoi ripubblicare, ritagliare e trasformare in nuovi asset short-form. L'idea è forte. Il file sorgente no.

È qui che upscale video ai smette di essere una novità e diventa uno strumento di produzione.

Buon AI upscaling può salvare footage che altrimenti butteresti via. Cattivo AI upscaling fa perdere ore, esagera il rumore da compressione e dà ai volti quell'aspetto plastico e stracotto che i viewer notano immediatamente. La differenza sta nel workflow. Qualità sorgente, scelta del model, gestione batch e decisioni di export contano più delle promesse di marketing sulla homepage di uno strumento.

Perché l'AI Video Upscaling È il Superpotere di un Creator

I footage a bassa risoluzione avevano un hard ceiling. Potevi ingrandirli, ma non migliorarli davvero. Lo scaling tradizionale stirava i pixel. Rendava i clip più grandi, non migliori.

AI video upscaling funziona diversamente. Usa deep learning per ricostruire i dettagli, interpretare i pixel circostanti e preservare il motion tra i frame. Quella parte conta. Un'immagine singola può sembrare nitida e fallire come video se i bordi tremolano o le texture sfarfallano da frame a frame.

Perché ora i creator ci tengono

Non è più un trucco di restoration di nicchia. Il mercato del software AI Video Upscaling è cresciuto da 550 milioni di USD nel 2024 a 670 milioni di USD nel 2025, e si prevede raggiunga i 5 miliardi entro il 2035, con un CAGR del 22,3%, guidato dalla domanda di delivery in 4K e maggiore qualità visiva per l'engagement, secondo Wise Guy Reports on the AI video upscaling software market.

Questo è in linea con ciò che i creator affrontano ogni settimana:

- Footage vecchio ha ancora valore: Interviste passate, webinar, demo e testimonianze spesso contengono idee valide da ripubblicare.

- UGC è raramente catturato perfettamente: Grandi hook vengono da clip imperfette.

- Ogni piattaforma punisce la morbidezza: Ritagliare, ridimensionare e recomprimere footage debole rende i difetti più evidenti.

Regola pratica: Usa AI upscaling per recuperare contenuto forte. Non aspettarti che salvi cinematografia debole, focus mancato o heavy motion blur.

C'è anche un'angolazione workflow più ampia. Se stai già trasformando un asset in molti, l'upscaling diventa parte del repackaging, non solo repair. Per questo si integra naturalmente con AI content repurposing. Un singolo source a bassa risoluzione può diventare shorts, edit quadrati e repost rinfrescati se pulisci la sorgente prima di ridimensionare e distribuire.

Cosa fa meglio

AI upscaling eccelle in poche situazioni specifiche:

| Use case | Perché funziona |

|---|---|

| Archival clips | Ripristina chiarezza senza ricostruire manualmente ogni shot |

| Screen recordings | Aiuta i bordi del testo e gli elementi UI a sopravvivere meglio alla compressione |

| UGC per ads | Alza la qualità baseline prima di caption, branding ed export |

| Cropped social edits | Headroom extra di risoluzione aiuta quando trasformi un master in multiple formati |

Se hai bisogno di un rapido refresher su cosa significa delivery a risoluzione più alta in pratica, questa breakdown di https://shortgenius.com/blog/what-is-4-k-resolution è utile prima di decidere se un clip merita una finitura 4K.

Preparare il Footage Sorgente per un Upscaling Perfetto

Il più grande errore con upscale video ai è nutrirlo con il peggior file che hai e sperare che il model faccia magie.

Non lo farà.

Il mercato si muove veloce. Il più ampio mercato dei tool Video Enhancing AI è previsto raggiungere 1.166 milioni di USD entro il 2032, con un CAGR del 37,1%, alimentato da sistemi deep learning che consegnano boost di risoluzione 2x a 4x istantanei riducendo la bandwidth, secondo Intel Market Research on the video enhancing AI tool market. Ma modelli migliori non annullano input cattivi.

Audita il clip prima di processarlo

Prima di mettere in coda qualcosa, controllo se il clip è un buon candidato o una trappola.

Usa questa breve audit:

- Danno da compressione: Se vedi macroblocking, mosquito noise o dettagli sfocati, il model potrebbe trattare quel danno come texture reale.

- Motion blur: AI può affilare i bordi, ma non può recuperare dettagli che non esistevano nel frame.

- Focus: Leggermente morbido può essere gestibile. Focus mancato di solito resta mancato.

- Stabilità frame: Clip shaky sono più difficili da upscale pulitamente, specialmente se lo sfondo si rompe già.

- Lineage del file: Export dal nearest original che trovi. Non upscale un file già compresso più volte.

Scegli la sorgente giusta, non solo la più grande

I creator spesso inseguono prima la risoluzione. È al contrario.

Un master 720p più pulito può superare un repost 1080p malridotto. Conta se la sorgente preserva informazioni immagine reali. Se hai opzioni, scegli il file con meno recompressione e meno edit incorporati.

Se la sorgente appare già rumorosa, croccante e instabile a dimensione nativa, l'upscaling di solito rende quei problemi più visibili.

Cosa sistemare prima dell'upscaling

Un po' di prep salva un sacco di rerender.

-

Trimma il clip prima

Non processare dead air, false starts o alternate takes se non li userai. -

Separa i tipi di footage

Talking head, gameplay, animation e screen capture si comportano diversamente. Non batcharli sotto un preset unico. -

Gestisci cleanup ovvio presto

Se il file ha bisogno di basic denoise o deinterlacing, fallo prima del tuo upscale pass. -

Esegui un sample corto

Prendi un momento demanding dal clip. Movimento veloce della mano, dettaglio capelli, motion camera, testo fine. Se il sample fallisce, il full render non migliorerà dopo.

Cattivi candidati per AI upscaling

Alcuni clip non valgono il compute.

- Social download heavily filtered

- Tiny reposted memes

- Footage con severe low-light breakup

- Clip dove i volti sono già distorti da compressione

Sembra stretto, ma protegge il tuo tempo. Il miglior workflow inizia con la selezione, non con le impostazioni software.

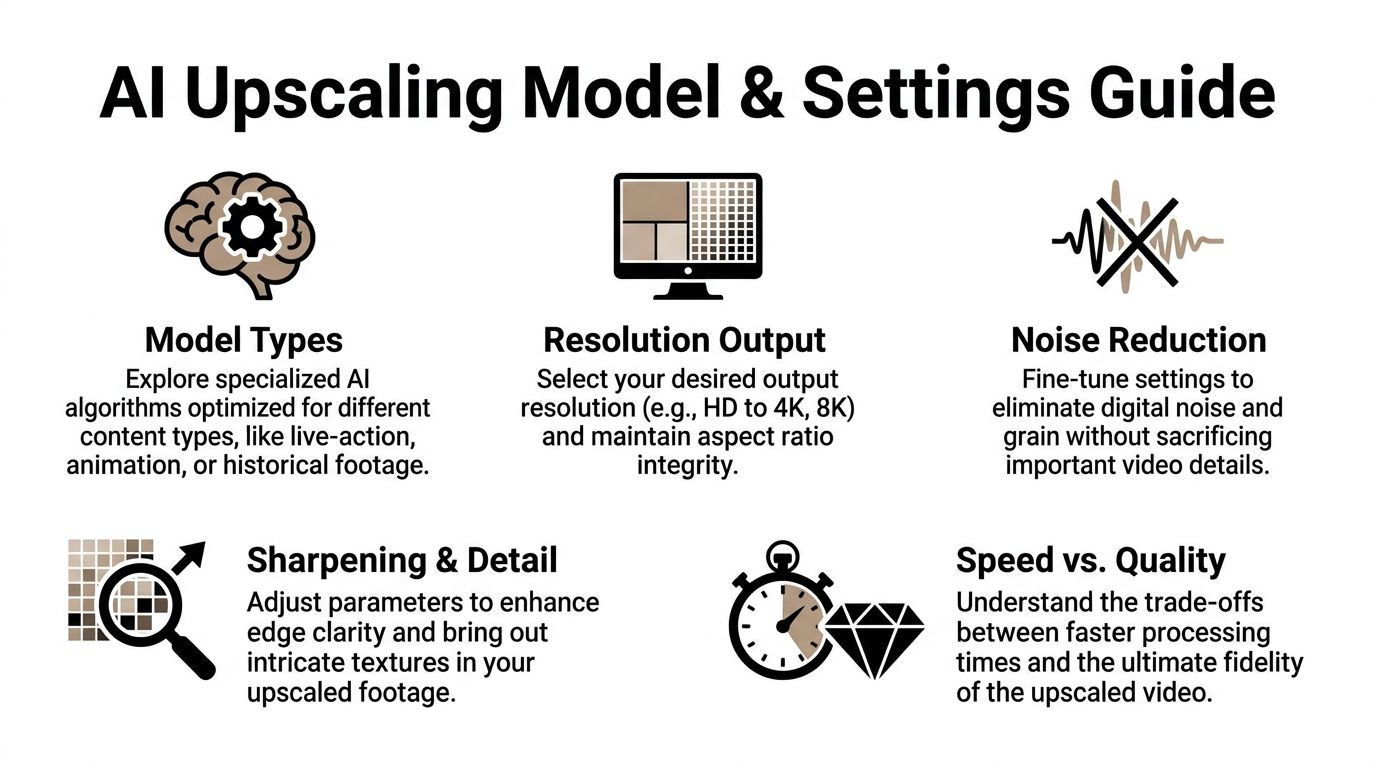

Scegliere il Model AI e le Impostazioni Giuste

La maggior parte degli upscale falliti viene dalla stessa abitudine. Le persone caricano un clip, scelgono l'output più alto, spingono lo sharpening troppo lontano e assumono che più processamento uguagli più qualità.

Non è così.

Diversi model fanno trade-off diversi. Alcuni preservano il realismo. Alcuni inventano più texture. Alcuni vanno bene su animation e faticano sulla pelle. Alcuni sono stabili sul motion. Altri producono still frame impressionanti e ugly temporal artifacts.

Un benchmark utile sta dietro tutto questo. In AI upscaling, deep-learning models come basicVSR++ possono raggiungere oltre il 13% di VMAF scores più alti rispetto al tradizionale Lanczos quando si upscale da 540p a 1080p, con guadagni PSNR di 2-4dB, ma limiti hardware su consumer GPU possono causare tassi di fallimento del 50%+ per clip 4K più lunghe di 2 minuti a causa di shortage VRAM, come noto da At Scale Conference coverage of on-device video playback upsampling.

La scelta del model inizia dal tipo di footage

Un modo semplice per pensare ai model:

| Footage type | Cosa prioritizzare | Common failure mode |

|---|---|---|

| Live action | Pelle naturale, motion stabile, sharpening restrained | Volti cerosi |

| Animation | Linee pulite, consistenza bordi | Haloing intorno alle outlines |

| Gameplay | Gestione motion, chiarezza testo/UI | Ghosting in scene veloci |

| Archival footage | Ricostruzione conservativa | Fake texture che cambia l'aspetto originale |

Se uno strumento offre multiple famiglie di model, non usare un preset universale. È così che ottieni interviste oversharpened e animation muddy nella stessa cartella progetto.

Per editor che confrontano tool e workflow prima di impegnarsi in uno stack, questo roundup di https://shortgenius.com/blog/migliori-software-editing-video-ai aiuta a inquadrare dove l'upscaling si inserisce in una pipeline edit più ampia.

Le impostazioni che contano di più

Molte etichette UI suonano tecniche ma si comportano in modi prevedibili.

Denoise

Usa denoise quando la sorgente ha noise visibile che il model continua a scambiare per dettaglio. Usa meno di quanto pensi ne serva.

Troppo denoise strappa texture da pelle, tessuto e sfondi. Poi lo sharpening cerca di ricostruire fake crispness su un'immagine appiattita.

Deblock

Deblock aiuta con danno da compressione. Può smoothare ugly block edges prima che il model upscale li esageri.

È utile su clip scaricati ed export vecchi. È pericoloso su footage già pulito perché può softenare bordi che volevi preservare.

Sharpen

Sharpen è dove il render spesso si rovina.

Un po' di sharpening può recuperare definizione bordi. Troppo crea halos, capelli fragili e quell'aspetto sintetico “AI enhanced”. Se un sample appare impressionante in pausa ma ugly in motion, lo sharpening è spesso il colpevole.

L'impostazione sharpen giusta dovrebbe sparire nel video finale. Se i viewer possono sentire il processamento, di solito è troppo aggressiva.

La strategia risoluzione batte brute force

Andare dritti al 4K è spesso la mossa sbagliata. Per social content, 1080p o un passo modesto su può apparire più pulito di un file più grande con dettaglio inventato.

Ecco il confronto pratico:

| Approach | Upside | Downside |

|---|---|---|

| Salto diretto a 4K | Dimensione output massima | Più dettaglio hallucinato, render più pesanti |

| Passo a 1080p prima | Miglior controllo, QA più facile | Punto decisione extra |

| Upscale moderato solo | Più veloce, più sicuro per social delivery | Meno dramatic before-and-after |

Quella via di mezzo vince sorprendentemente spesso. Mantieni controllo su texture e motion, ed eviti di passare la notte a rendere un file che si comprime duramente all'upload comunque.

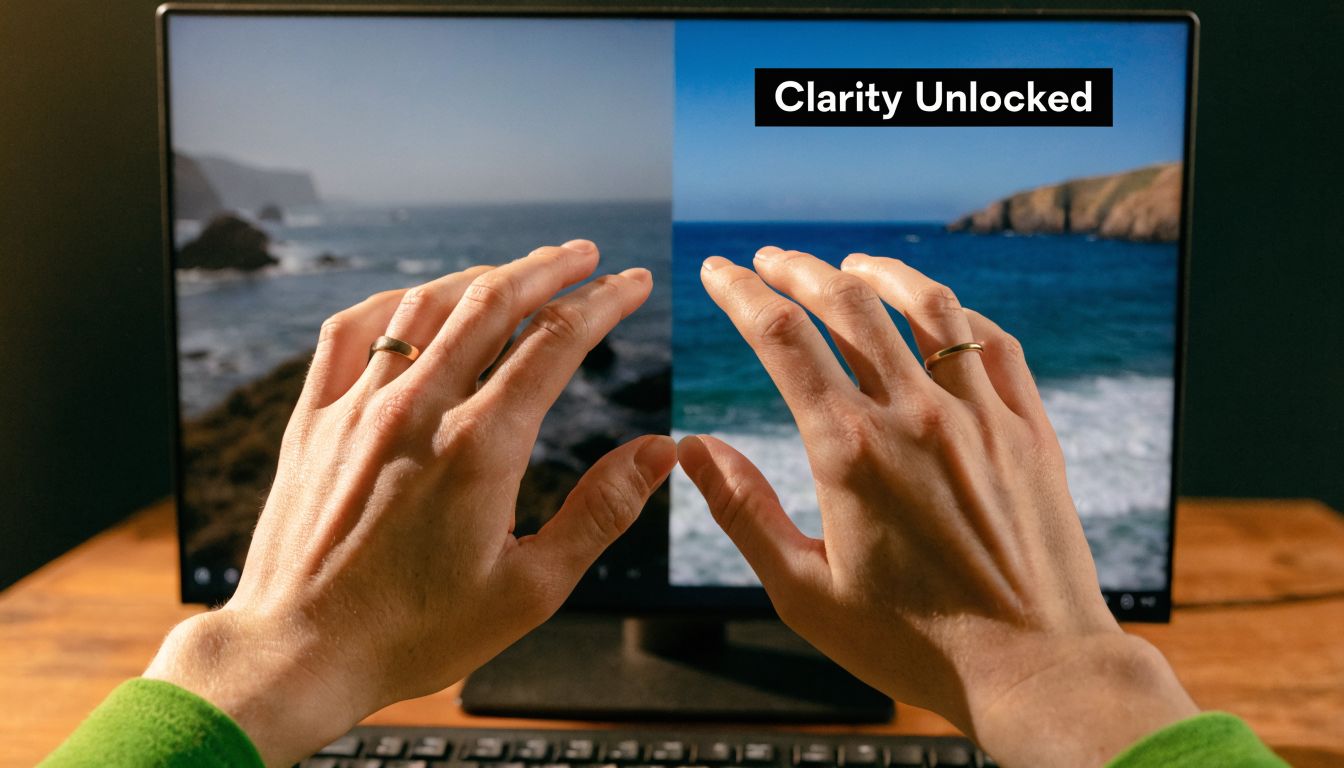

Un quick visual walkthrough aiuta quando stai calibrando:

Local versus cloud processing

Questa scelta è meno ideologica e più su constraints.

Local processing dà controllo. Lega anche la tua macchina e espone i limiti GPU velocemente.

Cloud processing rimuove il bottleneck hardware, ma scambii controllo su timing, struttura costi e a volte impostazioni fine-grained a seconda della piattaforma.

Scegli local quando:

- Hai bisogno di preset ripetibili su una macchina nota

- Stai testando pesantemente

- Vuoi oversight diretto su ogni pass

Scegli cloud quando:

- La tua GPU fallisce su clip più lunghe

- Hai bisogno di accesso team

- Preferisci continuare a editare mentre i render accadono altrove

Crea preset, poi diffidane

I preset risparmiano tempo. Fiducia cieca distrugge qualità.

Tieni pochi preset di partenza per tipo di content, poi testa ogni nuova sorgente con un segmento corto prima di lanciare il full render. Un preset per talking-head pulito. Un altro per UGC rough. Un altro per animation o screen recordings.

Quella disciplina conta più del nome del brand sul software.

Dominare il Tuo Workflow Batch Upscaling

Upscalare un clip è un esperimento. Upscalare venti clip è operations.

Molti creator perdono tempo frequentemente. Trattano ogni file come un custom job, babysittano gli export e rerun render falliti perché nulla era organizzato all'inizio. Un workflow batch fixa quello.

Secondo Audials guidance on beginner mistakes in AI video upscaling, gli esperti raccomandano di partire con video high-quality e minimamente compresso e testare salti risoluzione incrementali come 720p a 1080p prima del 4K per evitare risultati unnaturali e tempi render 4x più lunghi. La stessa guidance nota che model aggressivi possono produrre tassi artifact del 20-30% in scene motion-heavy, scendendo a meno del 5% con un workflow appropriato.

Un workflow local overnight

Per tool desktop, il setup più sicuro è noioso di proposito.

-

Crea tre folder

Usasource,test-rendersefinal-upscaled. Tienile separate. -

Rinomina i clip prima di queueing

Aggiungi tag platform o project ai filename per tracciare fallimenti velocemente. -

Grouppa per comportamento footage

Non mischiare UGC shaky con footage studio polished in un batch preset. -

Esegui un stress test per group

Prendi il clip più hard in ogni categoria. Fast motion, capelli, testo, crowd shots. Se funziona, i clip più facili di solito seguono. -

Mette in coda full job overnight

Lascia la macchina rendere quando non stai editando.

Un workflow cloud batch

I workflow cloud funzionano meglio con volume, collaborazione o una macchina che non regge il carico.

Il processo è diverso:

- Upload solo source approvati: Non usare il cloud come sorting room.

- Usa naming conventions chiare: Confusione version compounda veloce in progetti shared.

- Documenta il preset: Il momento in cui un buon batch atterra, salva la configurazione esatta.

- Assegna ownership review: Qualcuno deve spot-check gli output, non solo confermare che i file esistano.

Cosa controllare dopo un batch run

Una queue render completata non è uguale a un batch usabile.

Reviewra questi prima:

| Check | Perché conta |

|---|---|

| Motion consistency | Flicker si nasconde spesso fino al playback |

| Volti e mani | Model aggressivi falliscono qui per primi |

| Testo fine e UI | Grande per screen recordings, facile da rompere |

| Frame rate integrity | Mismatches creano stutter su export |

| Aspect ratio | Gestione errata causa awkward crops dopo |

Batch upscaling risparmia tempo solo se il tuo verification pass è veloce e ruthless.

Errori che distruggono la scala

I più grandi fallimenti vengono di solito dal process, non dalla qualità model.

- Un preset per ogni clip: Veloce, ma unreliable.

- No sample render: È così che ti svegli con una folder piena di file inutili.

- Saltare QC perché thumbnail sembrano buoni: Molti artifact appaiono solo in playback.

- Upscalare dopo multiple edit export: Ogni re-encode abbassa il tuo ceiling.

Per team, l'obiettivo non è solo processing più veloce. È processing prevedibile. Un sistema batch stabile rende upscale video ai parte della produzione regolare invece di una rescue mission ogni volta che appare un asset low-res.

Editing Post-Upscale e Smart Export Presets

Un file upscaled non è un file finito.

È più vicino a un negative restaurato. Devi ancora shapparlo, controllarlo ed exportarlo per il posto dove vivrà. Quella parte conta perché i creator spesso inseguono risoluzione ignorando delivery conditions.

La domanda ROI è reale. Come nota Cloudinary’s guide to using AI to upscale video, molti tool promettono 4K, ma piattaforme come TikTok e Instagram Reels downscalano comunque il content. Questo solleva una domanda pratica per i creator. Un upscale 4K è benefico, o un export HD ottimizzato performerebbe altrettanto bene per viewing mobile-first?

Il cleanup pass conta

I model AI spesso introducono subtle issues che non appaiono in side-by-side still frame.

Quelli comuni includono:

- Color drift: Skin tones possono shiftare leggermente dopo enhancement.

- Edge chatter: Dettaglio fine può pulsare sul motion.

- Texture inconsistency: Capelli, tessuto e sfondi possono alternare tra sharp e soft.

Tratto l'editing post-upscale come finishing work, non polish opzionale.

Fixa il colore prima dell'export

Anche un light grade può unificare l'immagine. Matcha skin tones, tira indietro highlights se l'upscale li ha resi brittle, e assicurati che i neri non siano crunchy.

Review motion in playback

Non ispeziona solo frame grabs. Guarda il clip full screen, poi ancora su un telefono. I problemi motion si rivelano in playback, non screenshots.

Se un upscale appare grande in pausa e strano in movimento, l'export non è pronto.

Smart export battono max export

I creator spesso defaultano a “highest quality available”. Suona safe, ma non sempre utile.

Per short-form distribution, pensa in termini di platform fit:

| Destination | Better default mindset | Cosa evitare |

|---|---|---|

| TikTok | Master HD pulito e stabile | File huge con marginal visible gain |

| Instagram Reels | Forte resistenza compressione | Export over-sharpened che si rompono dopo upload |

| YouTube Shorts | Testo crisp e motion stabile | Render needlessly oversized se source era debole |

Il punto non è che 4K sia cattivo. È che 4K non è automaticamente meglio per ogni social upload.

Una policy export pratica

Usa questo rule set:

-

Export per la piattaforma, non per il tuo orgoglio

I viewer si preoccupano di chiarezza e smoothness più del tuo menu impostazioni render. -

Tieni un high-quality archive master

Salva un master pulito per future reuse, crops o client delivery. -

Crea derivative platform-specific

Un file archive, poi export tuned per vertical, square o horizontal needs. -

Controlla il risultato uploaded

Le piattaforme social sono parte della rendering chain. Il tuo export local non è l'aspetto finale.

Molti creator compromettono qualità all'export. Passano tempo a upscalare, poi consegnano il risultato finale alla compressione piattaforma senza strategy. Smart export presets proteggono il lavoro già fatto.

Automatizzare l'Upscaling in una Pipeline ShortGenius

Upscaling manuale funziona quando fixi un clip. Si rompe quando produci social content ogni settimana su multiple channels.

È il bottleneck per i team. Secondo Perfect Corp coverage of AI video enhancer workflow limitations, la più grande sfida è integrare l'upscaling in workflow multi-channel perché la maggior parte dei tool standalone manca di batch processing at scale o API availability. Una unified publishing pipeline conta più di un'altra isolated enhancement app.

Cosa dovrebbe fare realmente l'automazione

Una pipeline automatizzata utile non “aggiunge solo upscale”.

Dovrebbe gestire una chain così:

- Ingest the source clip

- Route it by content type

- Apply the right enhancement preset

- Pass the result into editing

- Resize and package for each channel

- Schedule distribution

Quella struttura trasforma l'upscaling da repair step a infrastructure.

Dove si inserisce in produzione

Per short-form team, il miglior insertion point è di solito presto. Pulisci l'asset visivo prima di caption, branding, reframing ed export.

Conta perché ogni step successivo dipende dalla sorgente che appare stabile. Se aggiungi animated caption, cut-in e brand overlay su footage debole prima, poi provi a upscale dopo, forzi il model a interpretare design elements e danno compressione contemporaneamente.

Un order più reliable è:

| Stage | Better sequence |

|---|---|

| Source handling | Select and approve raw clip |

| Enhancement | Upscale and clean motion first |

| Edit layer | Add captions, trims, branding, voice |

| Distribution | Export per platform and publish |

Una menzione piattaforma, usata dove serve

In un workflow unified, ShortGenius può sedersi in quella production chain come opzione per team che vogliono video assembly, voiceover, editing, resizing, scheduling e API-driven automation nello stesso ambiente. Quel tipo di setup conta quando provi a trasformare rough footage in output ripetibile senza bouncing file tra app separate. Se stai costruendo un sistema più ampio intorno a recurring channel production, questa guida a https://shortgenius.com/blog/youtube-automazione-ai è rilevante perché l'automazione funziona solo quando ogni production step si connette pulitamente.

Cosa funziona e cosa no

Cosa funziona

- Trattare l'upscaling come preprocessing stage

- Salvare preset per classe footage

- Automatizzare repetitive pass, non aesthetic judgment

- Tenere un human review step prima di publish

Cosa non funziona

- Mandare ogni clip attraverso lo stesso enhancement profile

- Automatizzare senza QC ownership

- Costruire una pipeline che richiede manual file wrangling tra tool

- Assumere che AI-generated e organic footage si comportino uguale sotto upscale

Il win non è solo footage dall'aspetto migliore. Il win è rimuovere un altro manual bottleneck dalla content production.

Per agenzie, brand team e high-volume creator, quello è il fundamental shift. L'upscaling smette di essere un special fix per file cattivi e diventa un standard background process. Recuperi più footage usabile, spendi meno tempo su repetitive cleanup e mantieni output quality consistente su channels.

Se vuoi trasformare questo workflow in un sistema ripetibile, ShortGenius (AI Video / AI Ad Generator) porta video creation, editing, resizing, voiceover, scheduling e automated publishing in una piattaforma unica, così l'upscaling può inserirsi in una production pipeline più ampia invece di vivere come one-off manual task.