Questioni legali con gli attori AI nella pubblicità per brand moderni

Esplora le principali questioni legali con gli attori AI nella pubblicità. Impara a navigare i diritti di immagine, il diritto d'autore e la conformità FTC per il tuo brand.

Benvenuti nella nuova era della pubblicità, dove gli attori generati da AI stanno attirando l'attenzione e fermando lo scroll sui social media. Mentre questa tecnologia apre un mondo di possibilità creative, pone anche un campo minato legale per marchi e creatori. Navigare questi problemi legali con attori AI nella pubblicità è ora una competenza critica.

La Nuova Frontiera degli Attori AI e dei Rischi Legali

La legge sta giocando una frenetica partita di recupero con la tecnologia. I marchi possono ora ideare e generare intere campagne video con protagonisti persone sintetiche, ma questo potere comporta una serie pesante di responsabilità. Ogni singolo elemento—da una voce che suona un po' troppo familiare a una dichiarazione su un prodotto scritta da un'AI—ha un peso legale reale.

Pensatela come il campionamento musicale. Prima di lanciare un nuovo brano, dovete ottenere i diritti per ogni beat, melodia e hook vocale preso in prestito. È lo stesso nella pubblicità con AI. Dovete avere i diritti per ogni pezzo della vostra creazione sintetica, altrimenti potreste trovarvi di fronte a gravi conseguenze finanziarie e danni al marchio.

Perché le Leggi Tradizionali sulla Pubblicità Non Bastano

Chiaramente: i quadri legali su cui abbiamo fatto affidamento per decenni non sono stati creati per un mondo con personalità generate da AI. Questo crea un enorme divario e alcune nuove sfide spinose per i marketer abituati a contratti standard e moduli di liberatoria per talenti umani. Le vecchie regole valgono ancora, ma vengono stirate in modi che non abbiamo mai visto prima.

Il caso coinvolge una serie di domande difficili, alcune di prima impressione. Porta anche potenziali conseguenze pesanti non solo per i doppiatori, ma anche per l'industria nascente dell'AI, altri detentori e utenti di proprietà intellettuale, e cittadini comuni che potrebbero temere la perdita del controllo sulle proprie identità.

In questo nuovo ambiente, una consapevolezza legale proattiva non è solo un "bel-da-avere"—è un pilastro essenziale di qualsiasi strategia di marketing moderna. Capire i rischi è il primo passo verso un'innovazione responsabile e la protezione del vostro marchio da un pericoloso punto cieco. Per una visione più ampia, vale la pena esplorare il panorama legale generale sull'AI.

Uno Sguardo Rapido alle Principali Aree di Rischio Legale

Per avere un'idea, aiuta suddividere le principali sfide legali. Ognuna rappresenta una potenziale trappola che potrebbe mandare all'aria una campagna altrimenti brillante. Questa tabella offre un riassunto rapido dei principali mal di testa legali di cui dovete essere consapevoli quando usate attori generati da AI.

| Principali Aree di Rischio Legale per l'AI nella Pubblicità | ||

|---|---|---|

| Area Legale | Problema Principale | Conseguenza Potenziale |

| Diritto di Immagine e Pubblicità | Uso di una persona generata da AI che assomiglia o suona come un individuo reale senza permesso. | Cause da celebrità o cittadini privati per appropriazione indebita della loro identità. |

| IP e Copyright | Il modello AI è stato addestrato su foto, video o script protetti da copyright senza licenza. | Richieste di violazione del copyright, multe salate e ordini di rimozione della campagna. |

| FTC e Divulgazioni Pubblicitarie | Mancata divulgazione che un'endorsement proviene da un attore AI, ingannando i consumatori. | Azioni di enforcement FTC, multe per pubblicità ingannevole, perdita di fiducia dei consumatori. |

| Diffamazione e Privacy | L'AI crea contenuti che danneggiano falsamente la reputazione di una persona o un marchio. | Cause per diffamazione (libello/calunnia) e rivendicazioni di invasione della privacy. |

In sintesi, dovete pensare da dove proviene il vostro contenuto generato da AI e cosa comunica. Sbagliare uno dei due può portare a seri problemi.

Ecco le principali categorie di preoccupazione che ogni marchio e creatore deve tenere d'occhio:

- Diritto di Immagine e Pubblicità: Questa è grande. Copre l'uso non autorizzato dell'immagine, voce o qualsiasi altra caratteristica identificativa di una persona. Non importa se l'AI somiglia solo a qualcuno—può bastare per scatenare una causa.

- Proprietà Intellettuale e Copyright: Questo si complica in fretta. Chi possiede davvero il contenuto creato da un'AI? E, più importante, il modello AI è stato addestrato su una montagna di materiale protetto da copyright raschiato da internet senza permesso?

- Regole FTC e Divulgazione: Le regole della Federal Trade Commission sulla veridicità nella pubblicità non spariscono. Gli annunci devono essere veritieri e non ingannevoli, e ciò include la trasparenza quando un attore AI dà una testimonianza o un'endorsement.

- Diffamazione e Privacy: L'AI può deragliare e generare informazioni false o dannose su persone reali o persino marchi concorrenti. Questo può portare rapidamente a rivendicazioni di libello o invasione della privacy.

Navigare il Diritto di Immagine nell'Era dell'AI

Di tutte le mine legali associate agli attori AI, il diritto di immagine è probabilmente il più grande. Pensatela così: tutti hanno un marchio personale e possiedono il diritto di controllare come il loro nome, volto, voce o qualsiasi altro tratto unico—la loro "somiglianza"—venga usato per fare soldi. Non appena il vostro attore generato da AI somiglia vagamente a una persona reale, state entrando in un campo minato legale.

E non si tratta solo di creare un deepfake perfetto di una celebrità. La legge è spesso abbastanza ampia da coprire "voci somiglianti" e "volti somiglianti" che sono solo abbastanza simili da far pensare a qualcuno alla persona reale. Se il vostro pubblico collega il vostro attore AI a un individuo specifico, potreste essere responsabili per aver appropriato indebitamente la loro somiglianza.

Il vero mal di testa per i creatori è come questi modelli AI vengono costruiti. Sono addestrati su quantità sbalorditive di dati, spesso raschiati direttamente da internet. Questo significa che l'AI ha imparato da innumerevoli volti e voci reali, rendendo un'accidentale somiglianza inquietante un rischio molto reale.

Cosa Conta come Uso Commerciale

Capire cosa significa "uso commerciale" è critico qui. Non si tratta solo di mettere un volto generato da AI su una scatola di prodotto. Ogni volta che usate una persona AI in un annuncio per attirare attenzione e aumentare le vendite, è uno scopo commerciale. Questo è particolarmente vero per gli annunci in stile user-generated content (UGC) che vedete ovunque su Instagram e YouTube.

Ad esempio, se generate un influencer sintetico che esalta la vostra nuova linea di skincare, è un uso commerciale diretto. Se quell'influencer digitale somiglia in modo impressionante a un creatore del mondo reale, quel creatore ha un caso forte che state lucrando sulla loro somiglianza senza permesso o pagamento.

I tribunali stanno già affrontando questi scenari complicati. Il caso landmark In re Clearview AI Consumer Privacy Litigation è un esempio perfetto. I querelanti hanno sostenuto con successo che addestrare un'AI di riconoscimento facciale su oltre 3 miliardi di foto raschiate da internet violava i diritti di immagine in diversi stati.

La decisione del tribunale ha inviato un segnale chiaro: l'"uso commerciale" avviene quando le identità vengono usate per promuovere un prodotto, non solo quando vengono vendute come il prodotto. Come dettagliato in questa analisi dei diritti di immagine da Quinn Emanuel, questa sentenza ha spalancato le porte a cause collettive con potenziali risarcimenti da capogiro.

Considerazioni Chiave per la Somiglianza AI

Per evitare di impantanarvi in una causa per diritti di immagine, dovete essere vigili. Non si tratta di una teoria legale astratta; può portare a parcelle legali paralizzanti, rimozioni forzate di campagne e un duro colpo alla reputazione del vostro marchio.

Ecco le cose principali da tenere d'occhio:

- Somiglianza a Celebrità: Questa è la più ovvia. Generare un attore AI che assomiglia o suona come una persona famosa è chiedere guai. Evitate prompt come "crea un attore che somiglia a [Nome Celebrità]".

- Somiglianza a Influencer e Micro-Influencer: La zona di pericolo si estende ben oltre le star di Hollywood. Gli influencer sui social hanno costruito i loro propri marchi personali preziosi, e i loro diritti di immagine sono altrettanto protetti legalmente.

- Individui Comuni: Anche se il vostro personaggio AI somiglia a un cittadino privato, quella persona ha diritti. Se le loro foto delle vacanze sono state inconsapevolmente aspirate nei dati di addestramento dell'AI, una rivendicazione potrebbe emergere.

Il pericolo legale non risiede nell'intento dell'AI, ma nella percezione del pubblico. Se una persona ragionevole assocerebbe il vostro attore AI a un individuo reale, avete un potenziale problema legale.

Passi Pratici per Proteggere le Vostre Campagne

Dovete essere proattivi per proteggere il vostro marchio. Non potete assumere che uno strumento AI produca un volto o una voce "sicura" o legalmente autorizzata. Non c'è sostituto per la supervisione umana e un processo di revisione ben definito.

Prima che qualsiasi annuncio con un attore AI vada online, il vostro team deve fare un controllo approfondito di somiglianze. Questo significa far vedere il creativo finale a più paia di occhi, con l'obiettivo specifico di individuare potenziali somiglianze a figure pubbliche. Documentare questo processo di revisione può anche darvi uno strato di protezione legale dimostrando che avete fatto i vostri compiti.

Alla fine della giornata, l'unica difesa sicura contro una rivendicazione di diritto di immagine è garantire che i vostri attori generati da AI siano veramente originali. È un passo extra, ma essenziale per mantenere le vostre campagne al sicuro da costose battaglie legali in futuro.

Chi Possiede una Performance Generata da AI?

Quindi, avete usato un'AI per generare uno script, una voce over o magari un video intero. È brillante. Ma incombe una grossa domanda: chi possiede davvero questa cosa? La risposta non è semplice e, francamente, tocca le basi stesse del diritto d'autore. Capire questo è critico per navigare uno dei più grandi problemi legali con attori AI nella pubblicità.

Al momento, l'U.S. Copyright Office ha una posizione piuttosto ferma: un'opera ha bisogno di autoria umana per ottenere protezione del copyright. Se un'AI crea qualcosa da sola, senza un umano che guidi il processo creativo in modo significativo, generalmente non ottiene un copyright. Questo significa che il concetto pubblicitario straordinario che la vostra AI ha appena prodotto potrebbe non essere legalmente vostro.

Questo crea un serio mal di testa per i marketer. Se non detenete il copyright, cosa impedisce a un concorrente di lanciare un annuncio AI-generato quasi identico? La vostra campagna unica, e tutti i soldi investiti, potrebbero essere alla mercé di chiunque.

Il Ghostwriter e lo Strumento

Un buon modo per pensarla è vedere l'AI come un ghostwriter super-avanzato o un pennello molto sofisticato. Lo strumento stesso non possiede il libro finito o il dipinto. La proprietà dipende da quanto input creativo e originale proviene dalla persona che usa lo strumento.

Se date un prompt vago come "crea un video ad per una nuova sneaker", l'AI fa la maggior parte del lavoro pesante. L'output è per lo più macchina-fatto. Ma se siete voi a creare meticolosamente prompt dettagliati, curare gli output e fare modifiche significative per cucirli insieme, il vostro caso per l'autoria si rafforza molto. Più creatività umana inietti, meglio è la vostra possibilità di ottenere un copyright.

Un takeaway critico per i creatori è che il vostro livello di coinvolgimento creativo diretto nel processo di generazione AI è ciò che costruisce il caso per la proprietà. Premere semplicemente un pulsante "genera" non basta per essere considerati autore.

Questo intero dibattito su chi possiede l'output di un'AI fa parte di una conversazione molto più ampia su protezione dei diritti di proprietà intellettuale nel nostro mondo sempre più digitale. Man mano che questi strumenti diventano una parte normale del lavoro creativo, capire dove finisce l'autoria umana e inizia la creazione macchina sarà un campo di battaglia legale centrale.

La Realtà Complicata dei Dati di Addestramento

Il puzzle della proprietà si complica ulteriormente quando guardate sotto il cofano ai dati di addestramento del modello AI. Molti strumenti AI generativi imparano raschiando quantità colossali di dati da internet—che, ovviamente, includono immagini, articoli, musica e video protetti da copyright. Questo apre il rischio molto reale che l'output dell'AI possa essere considerato un'"opera derivata" di materiale protetto di qualcun altro.

E non è solo un problema teorico. Ad esempio, i doppiatori Paul Lehrman e Linnea Sage hanno citato in giudizio Lovo Inc., sostenendo che l'azienda ha usato le loro registrazioni vocali senza permesso per addestrare e poi vendere cloni vocali AI. Il tribunale ha permesso che la maggior parte delle loro rivendicazioni procedesse, sottolineando davvero l'esposizione legale seria quando i dati di addestramento AI calpestano diritti esistenti.

Cosa significa questo per voi? Significa che il vostro nuovo annuncio AI-generato scintillante potrebbe accidentalmente contenere elementi che violano il copyright di un altro creatore, mettendo il vostro marchio nella linea del fuoco per una causa.

Possiamo Chiamarlo Semplicemente "Fair Use"?

Alcuni sviluppatori e utenti sostengono che usare materiale protetto da copyright per addestrare un'AI è coperto dalla dottrina legale del "fair use". Il fair use permette l'uso limitato di opere protette senza permesso per cose come critica, commento o ricerca.

Il dibattito nell mondo AI si riduce a un paio di domande chiave:

- È Trasformativo? L'output dell'AI crea qualcosa di fondamentalmente nuovo, o è solo una copia high-tech del materiale originale su cui è stato addestrato?

- Danneggia il Mercato? L'opera generata da AI compete o svaluta l'opera originale protetta da copyright?

I tribunali stanno ancora lavorando su queste domande, e il terreno legale è instabile al massimo. Affidarsi a una difesa di fair use per una pubblicità commerciale—che è esplicitamente creata per fare soldi—è una grossa scommessa. Fino a quando la legge non si chiarirà, la scommessa più sicura è lavorare con strumenti AI che sono trasparenti sui loro dati di addestramento e, idealmente, vi offrono protezione da potenziali rivendicazioni di copyright.

Rimanere dal Lato Giusto della FTC

Ora, parliamo della Federal Trade Commission (FTC). Che il vostro annuncio sia stato ideato in una sala riunioni o generato da un algoritmo, la regola principale è la stessa: deve essere veritiero e non ingannevole. Questa semplice idea si complica molto quando buttate dentro attori AI.

Il lavoro della FTC è proteggere i consumatori. Quando un annuncio presenta una persona sintetica o sputa fuori una dichiarazione fatta da AI, il potenziale di ingannare le persone è enorme. Per questo, le divulgazioni chiare e anticipate non sono più solo un bel-da-avere; sono un must per rimanere conformi.

Il Mandato della Veridicità nella Pubblicità

Al cuore di tutto c'è la Sezione 5 del FTC Act, che vieta "pratiche o atti sleali o ingannevoli". Questo significa che avete bisogno di prove solide per ogni dichiarazione che fate—esplicita o implicita—prima che il vostro annuncio veda la luce del giorno. Questa regola si applica ai contenuti generati da AI tanto quanto a un tradizionale spot TV.

Stiamo già vedendo un aumento di cause per falsa pubblicità sotto il Lanham Act, specificamente mirate ad annunci che usano deepfake di celebrità. Regolatori e tribunali stanno correndo per stare al passo con il potere dell'AI di ingannare. La FTC ha già avviato azioni di enforcement contro aziende per dichiarazioni AI bogus, come esagerare ciò che un prodotto può fare o semplicemente apporre un'etichetta "potenziato da AI" senza prove.

Un'analisi di Hogan Lovells su AI e annunci deepfake evidenzia quanto queste cause siano esplose, dimostrando che i regolatori stanno osservando questo spazio molto, molto da vicino.

Allucinazioni AI e Dichiarazioni False

Una delle più grandi mine qui è il fenomeno delle "allucinazioni AI". Questo è quando un modello AI inventa con sicurezza "fatti", creando benefici di prodotto, caratteristiche o persino testimonianze utente dal nulla.

Immaginate di chiedere a un'AI di scrivere uno script per un nuovo integratore salute. Potrebbe generare una riga che dichiara che il prodotto è "clinicamente provato per aumentare il metabolismo del 40%". Se non avete ricerche scientifiche credibili a sostegno di quel numero esatto, avete appena oltrepassato la linea della falsa pubblicità.

L'inserzionista—non l'AI—è 100% legalmente responsabile per ogni dichiarazione fatta. Dire alla FTC "l'AI l'ha scritto" non è una difesa che vi porterà da nessuna parte. Dovete verificare indipendentemente ogni singola affermazione fattuale.

Questo è un checkpoint critico. Il vostro team ha bisogno di un processo a prova di pallottola per il fact-checking di tutti i testi generati da AI prima che vadano pubblici.

Divulgare Attori AI e Endorsement

La trasparenza è tutto quando è coinvolto un attore AI. Se il vostro annuncio mostra una persona sintetica che dà una testimonianza, i consumatori devono sapere che quella persona non è reale.

Ecco alcune situazioni in cui la divulgazione è assolutamente essenziale:

- Testimonianze AI: Se un personaggio generato da AI dice "Questo prodotto ha cambiato la mia vita", deve essere ovvio che non è un cliente reale.

- Influencer Sintetici: I marchi che lavorano con influencer virtuali non possono presentarli come persone reali con esperienze genuine e autentiche con un prodotto.

- Endorsement Deepfake: Usare un deepfake di una celebrità per endorsare qualcosa senza il loro permesso esplicito è un modo sicuro per violare i loro diritti di immagine e infrangere le regole FTC.

La FTC offre molte risorse sul suo sito web per aiutare le aziende a capire le loro responsabilità.

Come chiarisce il portale di guidance aziendale della FTC, i principi classici della pubblicità valgono ancora, rafforzando la necessità di veridicità e prove per tutte le dichiarazioni, incluse quelle che provengono da un'AI.

Ecco una checklist rapida per far passare i vostri annunci generati da AI per la conformità FTC:

- Sostanziazione delle Dichiarazioni: Avete prove solide per dimostrare ogni singola affermazione fattuale nell'annuncio? Questo include statistiche di performance, benefici "provati" o confronti che fate.

- Divulgazioni Chiare: È immediatamente ovvio per la persona media che un attore, testimonianza o endorsement è generato da AI? Non seppellitelo nel piccolo—rendetelo chiaro e visibile.

- Evitare Formati Ingannevoli: Il vostro annuncio è progettato per sembrare un reportage, un post social di un utente reale o una recensione indipendente? Se potrebbe ingannare un consumatore, è un problema.

- Revisione per Dichiarazioni Implicite: Cosa potrebbe qualcuno ragionevolmente dedurre dal vostro annuncio, anche se non lo dichiarate esplicitamente? Quelle dichiarazioni implicite devono anch'esse essere veritiere e supportate da prove.

Se trattate ogni pezzo di contenuto generato da AI con lo stesso scrutinio legale del vostro lavoro creato da umani, potete innovare con fiducia e rimanere dal lato giusto della legge.

Un Quadro Pratico per Mitigare i Rischi Legali

Conoscere i rischi è una cosa; gestirli giorno per giorno è un'altra. Se volete navigare in sicurezza il campo minato legale degli attori AI nella pubblicità, il vostro team ha bisogno di un quadro chiaro e ripetibile. Non si tratta di soffocare la creatività—si tratta di costruire guardrail che permettano al vostro team di innovare con fiducia.

Prima di tutto: dovete valutare i vostri strumenti AI. Prima di iscrivervi a qualsiasi piattaforma, entrate nei dettagli dei loro termini di servizio. Dovete sapere esattamente da dove provengono i loro dati di addestramento e quali diritti ottenete davvero sul contenuto che create. Alcuni provider offrono persino indennizzo, che è un grosso vantaggio perché può proteggervi da rivendicazioni di copyright in futuro.

Sviluppare una Politica Chiara sull'Uso dell'AI

Una volta sistemati i vostri strumenti, è tempo di creare una Politica Interna sull'Uso dell'AI. Pensatela come il playbook ufficiale per il vostro team. Deve essere semplice, diretta e specificare i sì e i no dell'uso di AI generativa per le vostre campagne pubblicitarie.

La vostra politica dovrebbe inchiodare alcune cose chiave:

- Strumenti Approvati: Fate una lista delle piattaforme AI specifiche che il vostro team è autorizzato a usare. Questo impedisce alle persone di andare per i fatti loro con strumenti non valutati che potrebbero esporvi a rischi inutili.

- Input Proibiti: Rendete cristallino che nessuno debba mai inserire informazioni confidenziali dell'azienda, dati clienti o segreti industriali in un prompt AI.

- Restrizioni su Somiglianze: Stabilite una regola ferrea: niente prompt che chiedano all'AI di imitare la somiglianza o la voce di qualsiasi persona reale, celebrità o no.

- Revisione e Approvazione: Ogni pezzo di contenuto pubblicitario generato da AI deve passare attraverso un processo di revisione umana obbligatorio prima di vedere la luce del giorno.

Questa politica è la vostra prima linea di difesa. Mette tutti sulla stessa pagina, operando sotto le stesse linee guida consapevoli della sicurezza.

Rendere Obbligatoria la Supervisione Umana Sempre

Non importa quanto sembri intelligente uno strumento AI; non è un sostituto del giudizio umano. Ogni singolo annuncio fatto con AI deve essere rivisto da una persona reale per conformità legale, accuratezza fattuale e sicurezza del marchio. Questo approccio "human-in-the-loop" non è opzionale.

La supervisione umana è la vostra rete di sicurezza ultima. Un'AI non capisce le sfumature legali, la reputazione del marchio o le linee guida FTC, ma il vostro team sì. Ogni pezzo di contenuto generato da AI è responsabilità della vostra azienda dal momento in cui va pubblico.

Il compito del revisore è essere quel guardiano finale. È lì per catturare potenziali disastri—come una somiglianza accidentale, una dichiarazione non provata o un linguaggio ingannevole—prima che diventino problemi pubblici molto reali e costosi.

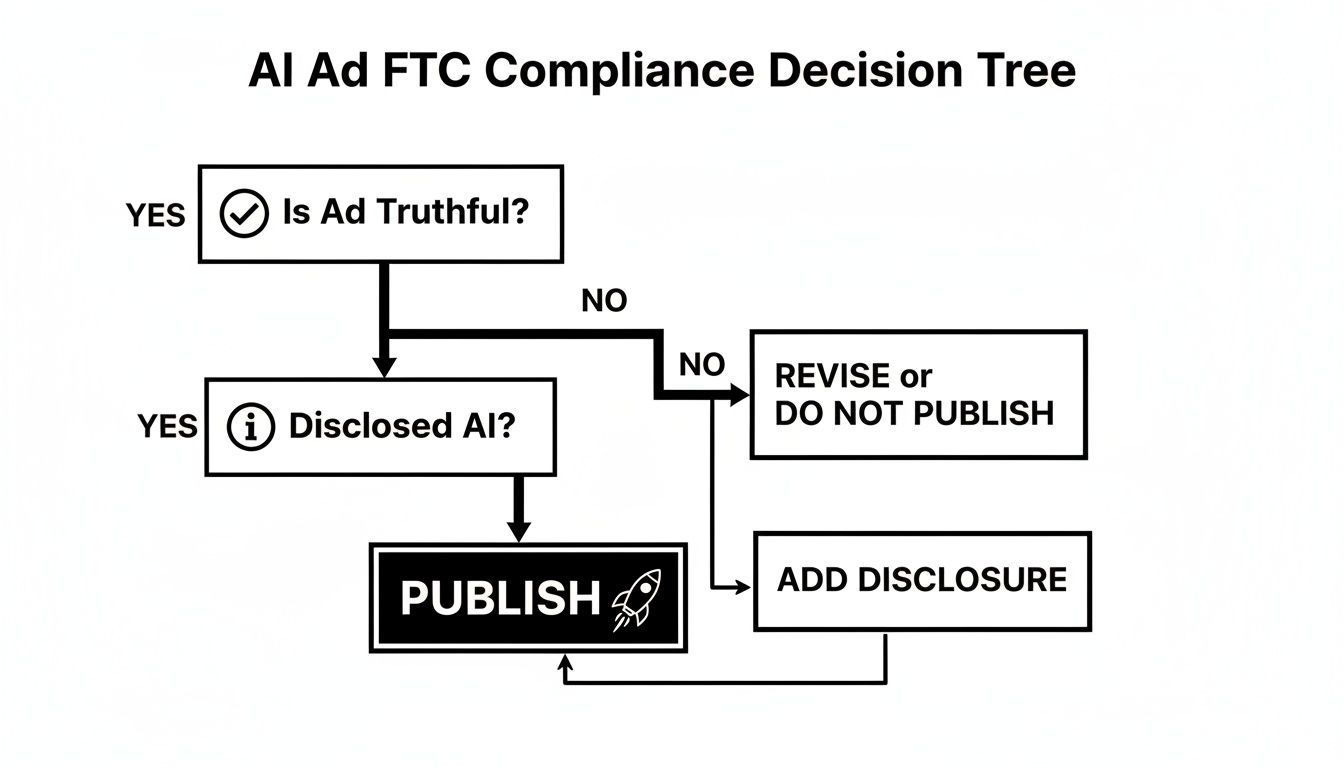

Questo albero decisionale vi dà un controllo di conformità semplificato per le regole FTC prima di pubblicare un annuncio potenziato da AI.

Come mostra la grafica, veridicità e divulgazione chiara sono la base assoluta e non negoziabile per qualsiasi pubblicità che coinvolge AI.

Checklist Pre-Pubblicazione per i Creatori

Per rendere questo semplicissimo per il vostro team, date loro una checklist rapida da seguire prima di spingere qualsiasi annuncio generato da AI live su piattaforme come Facebook o Instagram.

- Scansione Somiglianze: Almeno due persone diverse hanno guardato l'annuncio per assicurarsi che non somigli a una persona reale?

- Sostanziazione delle Dichiarazioni: Possiamo supportare ogni singola affermazione fattuale nel copy o voiceover dell'annuncio con prove concrete?

- Divulgazione AI: Se usiamo un attore AI per una testimonianza o endorsement, la divulgazione è impossibile da mancare?

- Controllo Copyright: C'è qualcosa nell'output che sembra preso dal lavoro protetto da copyright di qualcun altro?

- Allineamento al Marchio: Questo annuncio suona e sembra davvero il nostro marchio? Si allinea ai nostri valori e messaging?

Incorporando questi passi nel vostro workflow—valutazione strumenti, impostazione policy, supervisione umana obbligatoria e checklist finale—costruite un sistema forte per gestire le minacce legali più grandi. Questo quadro non vi rallenta; empowers il vostro team a essere creativo con AI mantenendo il marchio fuori da guai legali evitabili.

Rendere a Prova di Futuro la Vostra Strategia Pubblicitaria AI

Il terreno legale sotto la pubblicità AI si muove costantemente. Per stare avanti, dovete trattare la conformità non come una noia, ma come un vero vantaggio competitivo. Questo significa integrare trasparenza, consenso e sostanziazione solida nel cuore del vostro processo creativo fin dal primo giorno.

Nuove leggi spuntano continuamente, da regole federali sui deepfake ad atti di privacy a livello statale. Ma attraverso tutto, una verità fondamentale non cambierà: l'inserzionista è sempre responsabile del contenuto dell'annuncio. Accettare questo è il primo passo verso la gestione dei problemi legali con attori AI nella pubblicità.

La conformità legale proattiva non si tratta di avere paura dell'AI—si tratta di guadagnare la fiducia dei consumatori. Quando un marchio è aperto su come usa l'AI e attento alle sue dichiarazioni, è in una posizione molto migliore per costruire lealtà duratura ed evitare scontri costosi con i regolatori.

Dal Rischio Legale al Vantaggio Creativo

È facile vedere questi guardrail legali come un blocco creativo, ma è il modo sbagliato di guardarli. Pensateli come la base per un'innovazione intelligente e sostenibile. Una volta che il vostro team capisce le regole della strada, può sperimentare liberamente e spingere i confini creativi entro un quadro sicuro.

Ad esempio, immaginate di testare rapidamente centinaia di varianti di annunci per una nuova campagna. Perché avete un solido processo di revisione human-in-the-loop, sapete che potenziali violazioni di somiglianza o dichiarazioni non supportate saranno catturate molto prima che vedano la luce del giorno. Quella combinazione della velocità incredibile dell'AI con una supervisione umana affilata è dove accade la vera magia, specialmente nel performance marketing.

Questo approccio responsabile assicura che il vostro motore creativo non diventi una passività legale. Rimanendo in cima alle regole e integrando pratiche etiche nel vostro workflow, potete usare l'AI con fiducia per creare annunci ad alte performance che sono sia accattivanti che legalmente solidi.

Alla fine, l'obiettivo è creare un sistema in cui diligenza legale e brillantezza creativa sono due facce della stessa medaglia. Questa strategia integrata permette al vostro marchio di raccogliere i frutti della pubblicità guidata da AI proteggendolo dai rischi molto reali, assicurando che i vostri sforzi di marketing costruiscano valore per il marchio, non parcelle legali.

Domande Frequenti

Entrare nel mondo della pubblicità guidata da AI può sembrare navigare un campo minato di nuove domande. Analizziamo alcune delle preoccupazioni legali più comuni che i marketer hanno quando si tratta di usare attori AI.

Devo Divulgare il Mio Uso di un Attore AI?

Sì, assolutamente. La trasparenza non è solo una buona idea—è una necessità legale. La Federal Trade Commission (FTC) è stata molto chiara che la pubblicità non può essere ingannevole. Se usate una persona inesistente generata da AI per dare una testimonianza, e i consumatori pensano di guardare un cliente reale, avete oltrepassato la linea in territorio ingannevole.

La migliore pratica è sempre una divulgazione chiara e visibile. Una semplice nota a schermo come "Attore generato da AI" o "Immagine creata con AI" è tutto ciò che serve. Questo semplice passo protegge la fiducia dei consumatori, vi mantiene dal lato giusto della legge e salvaguarda l'integrità del vostro marchio.

Posso Essere Citato in Giudizio se un Attore AI Somiglia a Qualcuno per Coincidenza?

Questa è grossa, e la risposta è un deciso "forse". Qui le cose si complicano con il diritto di immagine. Se il vostro personaggio generato da AI finisce per somigliare molto a una persona reale (specialmente una celebrità), potreste trovarvi in acque legali bollenti.

Quella persona potrebbe sostenere che state usando la loro somiglianza per vendere un prodotto senza il loro permesso. La chiave per evitarlo è un processo di revisione umana inattaccabile. Qualcuno del vostro team deve dare un'occhiata finale al creativo specificamente per individuare somiglianze accidentali prima di premere "pubblica".

Il test legale cruciale non riguarda il vostro intento; riguarda come lo vede il pubblico. Se una persona ragionevole potrebbe collegare il vostro attore AI a un individuo reale, siete esposti a una potenziale causa.

Chi È Legalmente Responsabile per le Dichiarazioni Fatte da un'AI?

Voi lo siete. Sempre. Il marchio dietro l'annuncio è alla fine responsabile per ogni singola dichiarazione fatta, sia da un umano che da un'AI. Se il vostro attore AI dice che il vostro prodotto è "50% più efficace", fareste meglio ad avere i dati per supportarlo.

Non potete incolpare un'"allucinazione AI"—quando il modello inventa cose—se la FTC bussa alla porta. Non è una difesa legale. Per questo la supervisione umana è non negoziabile; ogni fatto, cifra e dichiarazione deve essere verificata da una persona reale prima che il vostro annuncio veda la luce del giorno.

Pronto a creare annunci ad alte performance senza mal di testa legali? ShortGenius ti aiuta a generare campagne video in stile UGC mozzafiato rapidamente, dandoti il controllo per garantire la conformità. Esplora i nostri strumenti e inizia a costruire annunci più sicuri ed efficaci oggi. Scopri di più su https://shortgenius.com.