Guida per i creatori: come padroneggiare il Lip Sync AI

Scopri come il Lip Sync AI trasforma la creazione di video. Impara cos'è, come funziona e come usarlo per creare contenuti doppiati perfettamente per un pubblico globale.

Hai mai voluto parlare qualsiasi lingua nei tuoi video, con la bocca che si adatta perfettamente a ogni singola parola, anche se non conosci la lingua? È esattamente quello che rende possibile la lip-sync AI. Alla base, questa tecnologia prende una traccia audio separata e anima automaticamente la bocca di una persona – o di un avatar – per sincronizzarla alla perfezione.

Non si tratta solo di un trucco da festa simpatico; è un enorme passo avanti che rende la creazione di contenuti e la localizzazione accessibili a tutti.

Perché la Lip Sync AI è Importante per i Creator

Pensa alla lip-sync AI come a un burattinaio digitale per i tuoi video. Per tanto tempo, ottenere una sincronizzazione labiale realistica era qualcosa che solo gli studi cinematografici ad alto budget con team VFX dedicati potevano realizzare. Significava animare i movimenti della bocca frame per frame con grande fatica. Ora, quel potere è nelle mani dei creator ovunque, e sta cambiando completamente il modo in cui i video vengono realizzati per piattaforme come YouTube, TikTok e Instagram.

Il compito principale di questa AI è colmare il divario tra ciò che vedi e ciò che senti, creando un'esperienza completamente fluida e credibile per lo spettatore. Dimentica quei vecchi doppiaggi goffi dove l'audio è dolorosamente fuori sincrono. Questa tecnologia assicura che la bocca del parlante si muova in perfetta armonia con una nuova traccia audio, che si tratti di una lingua diversa, di una voce registrata di nuovo o persino di uno script letto da una voce AI.

Espandere il Tuo Raggio d'Azione e Risparmiare Tempo

L'impatto sui content creator è enorme. Non sei più limitato alla tua lingua madre o bloccato con il fastidio di costose riprese extra solo per correggere un piccolo errore audio.

Questa tecnologia ti dà il potere di:

- Abbattere le Barriere Linguistiche: Doppiaggio istantaneo dei tuoi video in più lingue. Puoi aprire i tuoi contenuti a vasti pubblici internazionali senza dover mai pronunciare una parola di spagnolo, giapponese o hindi.

- Scalare i Contenuti Senza Sforzo: Prendi un video e riutilizzalo per diversi mercati globali. Tutto ciò che devi fare è sostituire il file audio e lasciare che l'AI si occupi del resto.

- Elevare il Valore della Produzione: Crea voiceover dal suono professionale per i tuoi annunci o video social e assicurati che il tuo talento on-screen o avatar sembri completamente naturale e autentico.

Non si tratta solo di una novità tecnica; è un vantaggio strategico. La lip sync AI permette a creator solisti e piccoli team di competere su scala globale, producendo contenuti multilingue che un tempo erano possibili solo per grandi aziende media.

In definitiva, questo strumento consiste nel lavorare in modo più intelligente, non più duro. Automatizzando ciò che un tempo era un compito estenuante di post-produzione, ti libera per concentrarti su ciò che fai meglio: ideare grandi idee. Per vedere il quadro generale, è utile comprendere il mondo più ampio della AI Powered Content Creation e come strumenti come questo stiano rimodellando l'intera industria. La lip-sync AI è un pezzo chiave di quel puzzle, dandoti la capacità di connetterti con più persone in modo molto più autentico.

Come Funziona Davvero la Lip Sync AI

Ti sei mai chiesto cosa succede sotto il cofano di una lip-sync AI? Non è solo uno spettacolo di burattini digitali che muove la bocca su e giù. Pensala più come un servizio di traduzione sofisticato, ma invece di convertire parole da una lingua all'altra, traduce suoni in movimenti facciali incredibilmente precisi.

Usiamo un'analogia. Se stessi insegnando a un robot a parlare, non gli mostreresti solo l'alfabeto. Gli insegneresti come suona ogni lettera. La lip-sync AI fa qualcosa di molto simile scomponendo la tua traccia audio nelle unità più piccole di suono, chiamate phonemes. Ad esempio, la parola "hello" viene scomposta in suoni distinti come "h", "eh", "l" e "ow".

Una volta che l'AI ha identificato questi phonemes, passa al suo compito principale: mappare ogni suono alla forma esatta della bocca che una persona fa quando lo pronuncia. Queste forme visive della bocca sono chiamate visemes. L'AI è stata addestrata su montagne di dati, quindi sa istintivamente che il suono "f" significa che i denti superiori devono toccare il labbro inferiore. È una traduzione fulminea dall'audio al visivo.

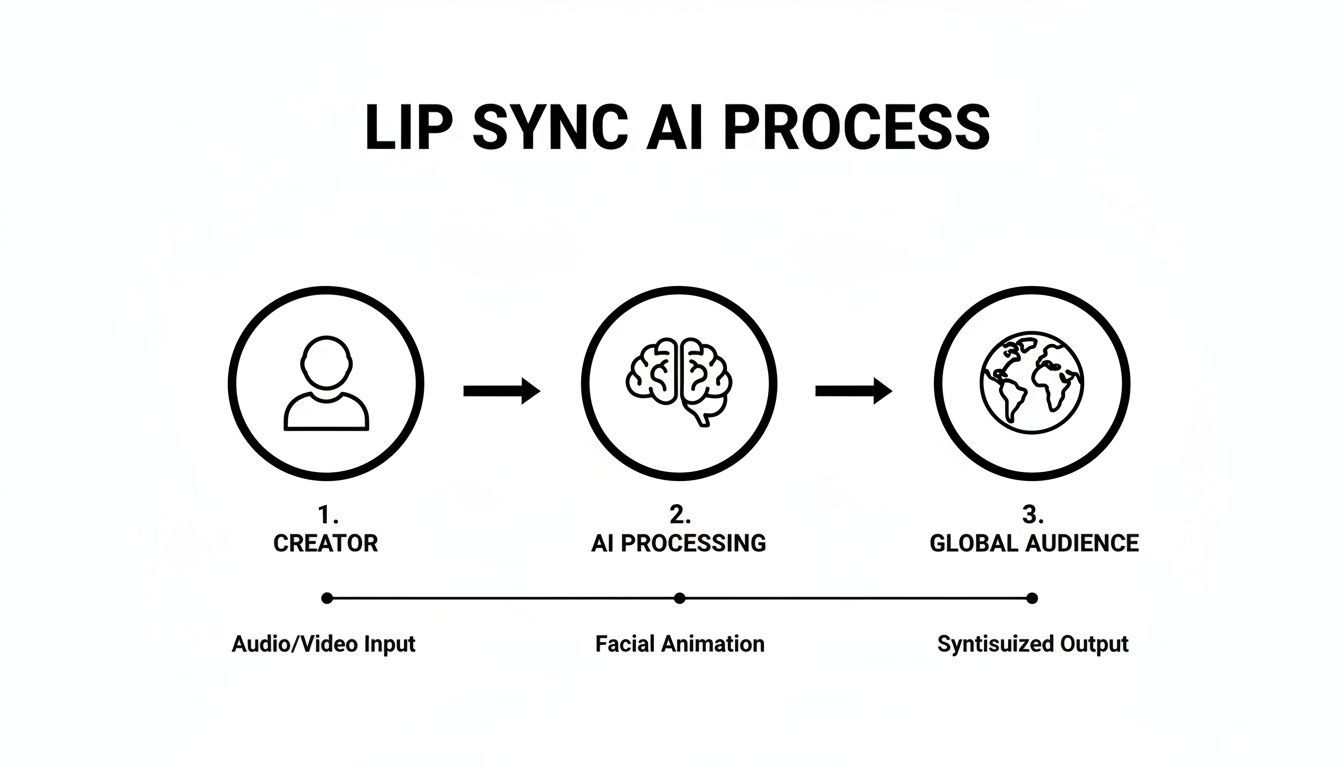

Questo diagramma spiega come un contenuto passa da una semplice registrazione dalla tua parte a un video pronto per un pubblico globale.

Come vedi, il creator fornisce i materiali grezzi, l'AI fa il lavoro pesante e il risultato è un contenuto raffinato che si connette con gli spettatori ovunque.

I Due Ingredienti Principali

Per realizzare questa magia digitale, l'AI ha bisogno davvero solo di due cose da te. Questa semplicità è una parte enorme di ciò che rende strumenti come ShortGenius così utili per i creator che devono lavorare velocemente.

- Il File Audio: Questo è il tuo blueprint. Potrebbe essere un voiceover che hai appena registrato, una traccia audio doppiata professionalmente per una nuova lingua o qualsiasi altra registrazione di qualcuno che parla. Più l'audio è pulito, meglio è. Un parlato nitido e chiaro dà all'AI un set di phonemes molto più facile da lavorare, portando sempre a un risultato più accurato e credibile.

- Il Video o l'Avatar: Questo è il tuo canvas. Puoi usare un video di una persona reale o persino un'immagine statica di un avatar generato da AI. L'AI usa questa base visiva per generare e sovrapporre i nuovi movimenti della bocca perfettamente sincronizzati.

Ma gli algoritmi di deep learning moderni non si fermano lì. Vanno un passo oltre analizzando le sfumature nell'audio – il tono, l'emozione, persino la velocità del parlante. Questo aiuta a rendere l'animazione finale molto più naturale. Nel suo cuore, la lip-sync AI consiste nell'abilità esperta di sync audio video così seamless che lo spettatore non ci pensa nemmeno.

Il fondo della questione è questo: Non si tratta solo di muovere le labbra. È un'analisi profonda del suono che traduce il parlato in espressioni facciali realistiche, catturando i piccoli dettagli che rendono una performance davvero umana.

Questo livello di automazione sta alimentando una crescita industriale seria. Il mercato globale per la tecnologia lip-sync è in pista per passare da USD 1.12 billion nel 2024 a un stimato USD 5.76 billion entro il 2034. Il fatto che il machine learning guidato dall'audio detenga già una quota di mercato del 40.7% mostra quanto questa tech sia diventata vitale per portare i contenuti nel mondo.

Questa stessa tecnologia è un ingrediente chiave in molti strumenti video AI. È ciò che permette a un creator di trasformare una singola foto ferma in un video dinamico e avvincente. Puoi approfondire come funziona con la nostra guida su come transform images into video with AI.

Applicazioni Pratiche per Creator e Marketer

Conoscere i dettagli tecnici della lip sync AI è una cosa, ma la vera magia accade quando vedi come apre nuove porte creative e di business. Per creator e marketer, non si tratta solo di una novità; è uno strumento serio per scalare i contenuti, accedere a nuovi mercati e connettersi genuinamente con pubblici in tutto il mondo.

Il caso d'uso più ovvio e potente è la localizzazione dei contenuti. Diciamo che hai un TikTok che sta diventando virale o un tutorial YouTube in cui hai messo il cuore. Invece di limitarti agli anglofoni, ora puoi creare versioni per pubblici spagnoli, hindi o giapponesi quasi istantaneamente. L'AI non si limita a sovrapporre una nuova traccia audio: rianima con cura i movimenti delle labbra per adattarli alla nuova lingua, rendendo il video finale completamente naturale.

Questo riscrive completamente il playbook per l'espansione globale. Il vecchio modo di localizzare una campagna video comportava assumere attori vocali per ogni lingua, prenotare costoso tempo in studio e faticare per settimane o mesi in post-produzione. Ora, quell'intero workflow è più veloce e molto più economico.

Da Annunci Globali a Avatar AI

Oltre alla semplice traduzione di video, la lip sync AI sblocca un'intera gamma di strategie per costruire brand e creare annunci avvincenti. Alla base, ogni applicazione sfrutta la capacità di separare ciò che qualcuno dice da come appare mentre lo dice.

Ecco alcuni modi game-changing in cui questa tecnologia viene usata ora:

- Creare Avatar AI Avvincenti: Puoi prendere una singola immagine – di un mascot, un fondatore o un influencer virtuale – e portarla in vita. Alimentala con un voiceover text-to-speech e hai una scorta infinita di contenuti social senza che nessuno debba mai stare davanti a una camera.

- Localizzare Campagne Pubblicitarie: Un brand può produrre un annuncio fantastico ad alto budget e poi usare l'AI per adattarlo a decine di mercati internazionali. Questo mantiene il branding coerente mentre fa sentire il messaggio locale e personale. Questo approccio è un salvavita per le piattaforme pubblicitarie che richiedono un flusso costante di creatività fresca. Puoi vedere come funziona in una strategia più ampia con la nostra guida sulla creazione di effective AI UGC-style ads.

- Correzioni Audio Senza Sforzo: Ci siamo passati tutti. Finisci un montaggio video perfetto, solo per notare un errore nel voiceover. Invece di una frustrante ripresa extra, puoi registrare la linea audio corretta e lasciare che l'AI la integri seamless, adattando perfettamente le labbra.

Il vero potere qui è la decoupling del visivo dall'audio. Questo dà ai creator un'immensa flessibilità per sperimentare, correggere errori e adattare i contenuti per diverse piattaforme e pubblici senza ripartire da zero ogni volta.

Per mostrare come queste idee prendono vita, ecco una rapida scomposizione di come creator e brand stanno mettendo al lavoro la lip sync AI.

Applicazioni Lip Sync AI per Creator e Brand

| Use Case | Primary Benefit | Example Application |

|---|---|---|

| Global Content Distribution | Audience Growth | Un YouTuber traduce il suo video top-performing in 5 nuove lingue per raggiungere un pubblico globale, triplicando il potenziale di visualizzazioni. |

| Multilingual Ad Campaigns | Increased ROI | Un brand D2C crea 10 versioni localizzate di un singolo annuncio per diversi paesi, migliorando rilevanza e tassi di conversione. |

| AI Influencers & Avatars | Content Scalability | Un'azienda usa il suo mascot animato per creare aggiornamenti social quotidiani senza bisogno di un team video per ogni post. |

| Post-Production Fixes | Time & Cost Savings | Un filmmaker corregge una battuta sbagliata in una scena cruciale senza dover riprendere, risparmiando migliaia di dollari. |

Non si tratta solo di un piccolo miglioramento: è un cambiamento fondamentale nel modo in cui i video vengono realizzati.

Il mercato del doppiaggio video AI era valutato a $31.5 million nel 2024 e si prevede che schizzi a $397 million entro il 2032. Questa crescita esplosiva è tutta grazie al tempo e ai soldi che risparmia. Una campagna multilingue che un tempo richiedeva un budget enorme e mesi di lavoro può ora essere realizzata in meno di una settimana per meno di $2,000, mettendo una portata globale nelle mani dei creator solisti. Puoi saperne di più sull'evolving economics of AI lip sync technology e vedere come sta cambiando l'intera economia dei creator.

Come Scegliere lo Strumento Lip Sync AI Giusto

Con un'inondazione di nuovi strumenti sul mercato, scegliere la lip sync AI giusta può sembrare un colpo nel buio. Ma non tutte le piattaforme sono uguali, e la scelta sbagliata può lasciarti con video robotici e goffi che respingono gli spettatori invece di coinvolgerli. Hai bisogno di una semplice checklist per tagliare il fluff di marketing.

Il fattore numero uno assoluto è la qualità della sync stessa. Il video finale sembra naturale, o cade in quella creepy "uncanny valley"? Uno strumento ottimo capisce i minuscoli movimenti sottili di una bocca reale – come si forma intorno a suoni diversi e si connette all'espressione del parlante.

Un'AI economica o scarsamente addestrata potrebbe solo far sbattere la bocca aperta e chiusa, che è un giveaway immediato che qualcosa è finto. Il modo migliore per giudicare è prendere lo stesso breve clip audio e provarlo su pochi strumenti diversi. Metti i risultati fianco a fianco e fidati del tuo istinto.

Valutare Funzionalità Chiave e Performance

Oltre al puro realismo, devi pensare alle tue esigenze creative specifiche. Lo strumento perfetto per un trainer corporate multilingue è probabilmente eccessivo per un creator di meme. Affinare il processo di valutazione all'inizio ti risparmierà un mondo di mal di testa dopo.

Ecco le cose essenziali da cercare:

- Supporto per Lingue e Accenti: È un deal-breaker se stai cercando di raggiungere un pubblico globale. Scopri quante lingue supporta lo strumento e, altrettanto importante, quanto bene gestisce accenti e dialetti diversi. Uno strumento che inchioda un accento di Glasgow è molto più impressionante di uno che funziona solo con una voce generica e robotica.

- Velocità di Elaborazione: Quanto tempo passerai a fissare una barra di progresso per un clip di un minuto? Nel mondo del contenuto short-form, la velocità è tutto. Alcune piattaforme girano un video in minuti, mentre altre ti fanno aspettare un'eternità.

- Facilità d'Uso: Uno strumento con un milione di feature è inutile se l'interfaccia è un incubo. Cerca un design pulito e semplice che ti permetta di caricare video e audio, poi applicare la lip sync in pochi clic. Piattaforme come ShortGenius mirano a rendere questo passo una parte seamless di un pipeline di creazione video molto più ampio.

L'obiettivo ultimo è trovare una soluzione che si inserisca nel tuo processo esistente senza creare nuovi colli di bottiglia. Lo strumento giusto dovrebbe sembrare un'estensione del tuo toolkit creativo, non un altro software complicato da imparare.

Considerare Integrazione e Tendenze di Mercato

Infine, pensa al quadro generale. Come si inserisce questa lip sync AI nel tuo workflow? Si integra bene con i video editor che ami già? Può gestire i formati e le risoluzioni video di cui hai bisogno? Un'integrazione fluida è critica quanto la performance tecnica.

La crescita esplosiva in questo spazio ti dice tutto ciò che devi sapere. Il mercato dell'AI nei media, che include la tech lip-sync, si prevede che gonfi da USD 8.21 billion nel 2024 a USD 51.08 billion entro il 2030. Quel tipo di espansione rapida significa che l'audio-visual AI sofisticata sta diventando rapidamente una parte core di qualsiasi strategia di contenuto moderna. Puoi ottenere più dettagli su the AI media market on datainsightsmarket.com.

Scegliendo uno strumento ben supportato e in costante miglioramento, non stai solo risolvendo un problema per oggi: stai investendo nella tua capacità di creare contenuti amazing per anni a venire.

Guida Passo-Passo per il Tuo Primo Video Lip Sync

Ok, mettiamoci le mani in pasta. Realizzare il tuo primo video con lip sync AI non è complicato come sembra. Possiamo suddividerlo in un semplice processo a quattro passi che ti porta da un'idea grezza a un video finito pronto da condividere.

Questo è il workflow base che trovi in piattaforme come ShortGenius, che mette questa potente tech proprio alle tue dita.

Passo 1: Prepara la Tua Traccia Audio

Tutto inizia con l'audio. Pensalo come il blueprint del tuo video: l'AI ha bisogno di una traccia pulita e chiara per capire quali forme di bocca creare. Puoi registrare la tua voce o usare un generatore text-to-speech di qualità per una narrazione costantemente nitida.

Per il miglior risultato, assicurati che l'audio abbia poco o nessun rumore di fondo. Parlare chiaramente fa una grande differenza. Più le tue parole sono distinte, meglio l'AI può adattare i movimenti delle labbra. Azzeccare questo primo passo ti prepara per un risultato molto più credibile.

Passo 2: Seleziona il Tuo Video o Avatar

Successivamente, devi scegliere chi (o cosa) parlerà. Può essere un clip video che hai già di qualcuno che parla o persino solo un'immagine statica di un avatar AI che hai creato. La chiave qui è un tiro chiaro del viso.

Ecco un pro tip: Un'angolazione frontale dritta funziona meglio. L'AI ha bisogno di una vista diretta e sgombra della bocca per generare movimenti realistici. Se il viso è girato o qualcosa lo blocca, l'animazione finale sembrerà un po' stonata.

La qualità dei tuoi input determina direttamente la qualità del tuo output. Un video nitido e ben illuminato e un audio pulito forniscono all'AI il miglior materiale possibile con cui lavorare, minimizzando errori e assicurando un risultato più lifelike.

Passo 3: Applica la Lip Sync AI

Qui inizia il vero divertimento, e di solito è solo questione di cliccare un pulsante. Una volta caricati i tuoi file audio e video nello strumento, applichi semplicemente la feature lip sync. L'AI allora si mette al lavoro, scomponendo i suoni nel tuo audio e creando nuovi movimenti della bocca sul soggetto del tuo video per adattarli.

L'intero processo è sorprendentemente veloce, spesso richiede solo pochi minuti. Mentre l'AI fa il lavoro pesante, puoi prepararti per l'ultimo e più importante passo.

Passo 4: Rivedi e Raffina l'Output

Nessuna AI lo fa perfetto ogni singola volta, quindi un controllo finale è cruciale. Guarda il video generato e presta attenzione ravvicinata al timing. La sync sembra naturale? Ci sono strani spasmi o momenti in cui le labbra non combaciano esattamente con l'audio?

La maggior parte degli strumenti buoni ti dà opzioni per fare piccole regolazioni. A volte, basta spostare leggermente il timing audio o rieseguire una sezione specifica per levigare qualsiasi problema. Una volta soddisfatto, il tuo video è pronto per l'export. Questo intero processo è una parte core di molti workflow video AI, e puoi vedere come si inserisce nel quadro generale leggendo la nostra guida sui text-to-video AI models.

Hai Domande sulla Lip Sync AI? Abbiamo le Risposte.

Buttarsi in una nuova tech porta sempre qualche domanda. È completamente normale. Rispondiamo ad alcune delle più comuni che sento dai creator sulla lip sync AI così puoi passare dritto a creare grandi contenuti.

Come Gestisce la Lip Sync AI le Diverse Lingue?

Questa è grossa. La buona notizia è che la maggior parte dei top-tier AI models sono addestrati su dataset giganteschi pieni di innumerevoli ore di parlato multilingue. Questo significa che sono sorprendentemente abili nel gestire non solo lingue diverse, ma anche accenti diversi. Non si tratta solo di parole; si tratta di imparare le forme specifiche della bocca – il termine tecnico è visemes – che vanno con ogni suono unico.

Ovviamente, non tutti gli strumenti sono uguali. Scoprirai che le performance possono variare davvero da una piattaforma all'altra, ed è per questo che consiglio sempre di eseguire un breve test clip nella tua lingua target prima di impegnarti in un grosso progetto. I migliori sistemi cattureranno quelle sfumature sottili, facendo sembrare il parlante un nativo, invece di applicare un movimento della bocca generico "one-size-fits-all" che sembra stonato.

Qual è la Differenza tra Lip Sync e Dubbing?

È facile confonderle, ma sono davvero due facce della stessa medaglia, che lavorano insieme per far sentire un video autentico in una nuova lingua.

Pensala così:

- Video Dubbing: Si tratta tutto dell'audio. È il processo di sostituire la traccia vocale originale con una nuova, solitamente in un'altra lingua.

- Lip Sync: È il follow-up visivo. Una volta posata la nuova audio, l'AI si mette al lavoro, alterando digitalmente i movimenti della bocca del parlante per adattarli perfettamente al nuovo dialogo.

Quando le combini, ottieni un video completamente localizzato. Il suono è giusto, e i visivi combaciano. Una gestisce ciò che senti, l'altra ciò che vedi.

Questo one-two punch è ciò che permette a un creator di prendere un singolo video e farlo sentire nativo per pubblici ovunque nel mondo, senza quella sensazione distraente di fuori sincrono che tira immediatamente lo spettatore fuori dall'esperienza.

Come Evitare l'Effetto Creepy "Uncanny Valley"?

Ah, la "uncanny valley". È quella sensazione strana e inquietante quando qualcosa sembra quasi umano, ma qualche cosa sottile non è proprio giusta. È una vera preoccupazione con la lip sync AI, ma puoi assolutamente evitarla.

Prima di tutto, inizia sempre con materiale sorgente di alta qualità. Un video nitido e ben illuminato o un avatar raffinato dà all'AI un canvas molto più pulito su cui lavorare. Se gli dai footage sfocato o low-res, praticamente gli chiedi un risultato strano.

Successivamente, concentrati sulla qualità audio. Usa una voce AI di alta qualità che suoni naturale, o meglio, una registrazione pulita di un attore vocale umano. Una voce robotica e piatta abbinata a movimenti labiali realistici è una ricetta per creepiness istantanea.

Infine, ricorda di aggiungere quei tocchi umani sottili. Una scena generata da AI può sembrare un po' sterile da sola. Aggiungere piccole cose come movimenti naturali della testa, sbatti realistici o persino solo uno sfondo interessante può far sentire l'intero video più radicato e vivo, tirandolo fuori dalla uncanny valley.

Pronto a creare video mozzafiato multilingue senza fastidi? ShortGenius integra potenti capacità AI lip sync in un workflow completo di creazione video. Produci annunci professionali e contenuti social in minuti. Inizia a creare gratis su shortgenius.com.