Le Guide du Créateur pour Maîtriser le Lip Sync IA

Découvrez comment le Lip Sync IA transforme la création vidéo. Apprenez ce que c'est, comment cela fonctionne et comment l'utiliser pour créer du contenu parfaitement doublé pour un public mondial.

Vous avez toujours voulu parler n'importe quelle langue dans vos vidéos, avec votre bouche s'accordant parfaitement à chaque mot, même si vous ne connaissez pas la langue ? C’est exactement ce que lip-sync AI rend possible. Au cœur de cette technologie, elle prend une piste audio séparée et anime automatiquement la bouche d’une personne – ou d’un avatar – pour qu’elle se synchronise parfaitement avec celle-ci.

Ce n’est pas seulement un tour de passe-passe amusant ; c’est un bond en avant massif, rendant la création de contenu et la localisation accessibles à tous.

Pourquoi le Lip Sync AI est important pour les créateurs

Imaginez le lip-sync AI comme un marionnettiste numérique pour vos vidéos. Pendant longtemps, obtenir une synchronisation labiale réaliste était une affaire réservée aux studios de cinéma à gros budget avec des équipes VFX dédiées. Cela impliquait d’animer les mouvements de la bouche image par image, de manière laborieuse. Désormais, ce même pouvoir est entre les mains des créateurs du monde entier, et cela change complètement la façon dont les vidéos sont produites pour des plateformes comme YouTube, TikTok et Instagram.

Le rôle principal de cette IA est de combler l’écart entre ce que l’on voit et ce que l’on entend, créant une expérience totalement fluide et crédible pour le spectateur. Oubliez ces anciens doublages maladroits où l’audio est douloureusement désynchronisé. Cette technologie garantit que la bouche du locuteur bouge en parfaite harmonie avec une nouvelle piste audio, qu’il s’agisse d’une autre langue, d’un voiceover réenregistré ou même d’un script lu par une voix IA.

Élargir votre portée et gagner du temps

L’impact sur les créateurs de contenu est énorme. Vous n’êtes plus limité à votre langue maternelle ni contraint à des reprises coûteuses juste pour corriger une petite erreur audio.

Cette technologie vous donne le pouvoir de :

- Briser les barrières linguistiques : Doubler instantanément vos vidéos dans plusieurs langues. Vous pouvez ouvrir votre contenu à d’immenses audiences internationales sans jamais avoir à prononcer un mot d’espagnol, de japonais ou d’hindi.

- Scaler votre contenu sans effort : Prendre une vidéo et la repurposer pour différents marchés mondiaux. Il suffit de remplacer le fichier audio et de laisser l’IA s’occuper du reste.

- Élever la qualité de production : Créer des voiceovers au son professionnel pour vos publicités ou vidéos sur les réseaux sociaux, et vous assurer que votre talent à l’écran ou votre avatar semble complètement naturel et authentique.

Ce n’est pas seulement une nouveauté technique ; c’est un avantage stratégique. Le lip sync AI permet aux créateurs solo et aux petites équipes de concurrencer à l’échelle mondiale, en produisant du contenu multilingue autrefois réservé aux grandes entreprises médiatiques.

En fin de compte, cet outil consiste à travailler plus intelligemment, pas plus dur. En automatisant une tâche de post-production autrefois épuisante, il vous libère pour vous concentrer sur ce que vous faites de mieux : inventer de grandes idées. Pour bien comprendre l’ensemble, il est utile d’explorer le monde plus large de la création de contenu alimentée par l’IA et comment des outils comme celui-ci redessinent toute l’industrie. Le lip-sync AI est une pièce clé de ce puzzle, vous donnant la capacité de vous connecter avec plus de personnes de manière beaucoup plus authentique.

Comment fonctionne réellement le Lip Sync AI

Vous êtes-vous déjà demandé ce qui se passe sous le capot d’un lip-sync AI ? Ce n’est pas juste un spectacle de marionnettes numériques qui fait monter et descendre une bouche. Imaginez plutôt un service de traduction sophistiqué, mais au lieu de convertir des mots d’une langue à une autre, il traduit les sons en mouvements faciaux incroyablement précis.

Prenons une analogie. Si vous appreniez à un robot à parler, vous ne lui montreriez pas seulement l’alphabet. Vous lui apprendriez comment chaque lettre sonne. Le lip-sync AI fait quelque chose de très similaire en décomposant votre piste audio en unités sonores les plus petites, appelées phonèmes. Par exemple, le mot « hello » est décomposé en sons distincts comme « h », « eh », « l » et « ow ».

Une fois que l’IA a identifié ces phonèmes, elle passe à sa tâche principale : mapper chaque son à la forme exacte de la bouche qu’une personne fait en le prononçant. Ces formes visuelles de la bouche sont appelées visèmes. L’IA a été entraînée sur des montagnes de données, elle sait instinctivement que le son « f » signifie que les dents du haut doivent toucher la lèvre inférieure. C’est une traduction fulgurante de l’audio vers le visuel.

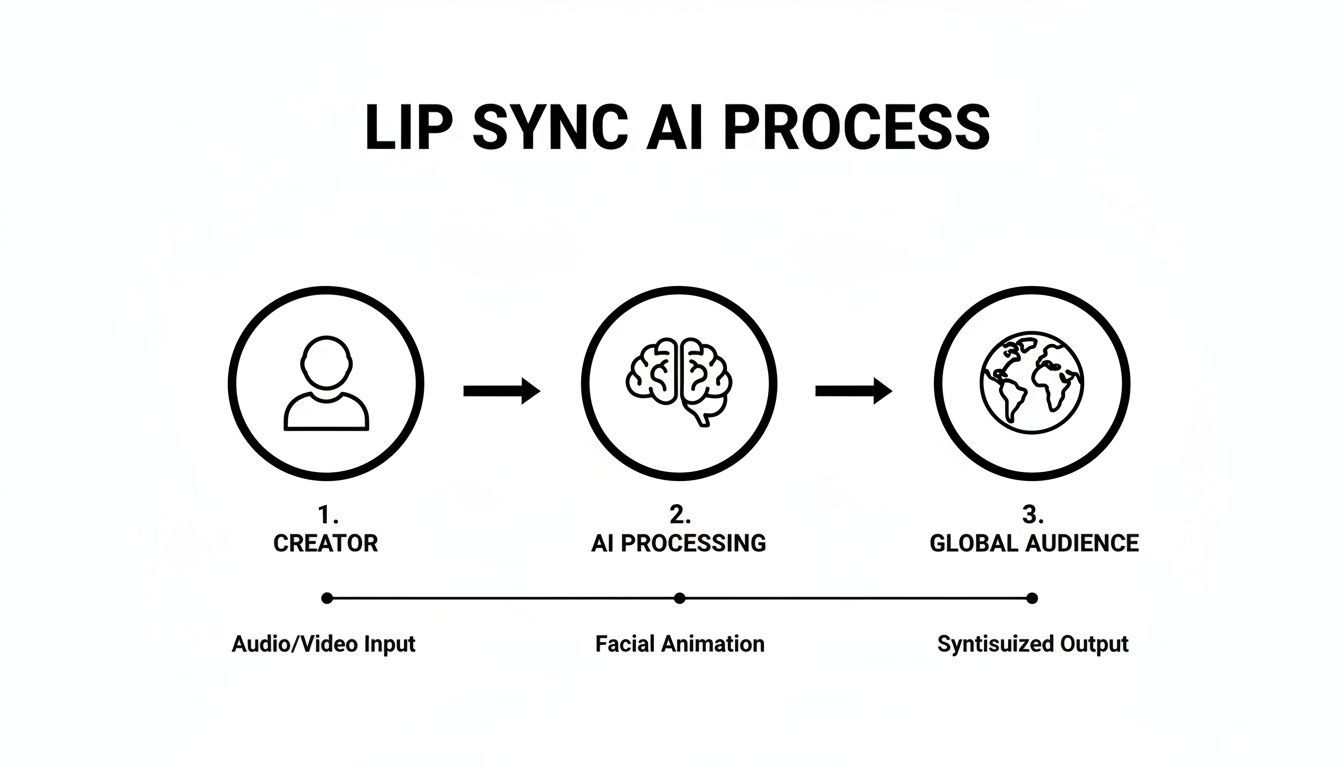

Ce diagramme décompose comment un contenu passe d’un simple enregistrement de votre côté à une vidéo prête pour un public mondial.

Comme vous pouvez le voir, le créateur fournit les matières premières, l’IA fait le gros du travail, et le résultat est un contenu poli qui connecte avec les spectateurs partout.

Les deux ingrédients essentiels

Pour réaliser cette magie numérique, l’IA a vraiment besoin de deux choses de votre part. Cette simplicité est une grande partie de ce qui rend des outils comme ShortGenius si utiles pour les créateurs qui doivent travailler vite.

- Le fichier audio : C’est votre plan. Il peut s’agir d’un voiceover que vous venez d’enregistrer, d’une piste audio doublée professionnellement pour une nouvelle langue, ou tout autre enregistrement de quelqu’un qui parle. Plus l’audio est propre, mieux c’est. Une parole nette et claire donne à l’IA un ensemble de phonèmes beaucoup plus facile à traiter, ce qui mène toujours à un résultat plus précis et crédible.

- La vidéo ou l’avatar : C’est votre toile. Vous pouvez utiliser une vidéo d’une personne réelle ou même une image statique d’un avatar généré par IA. L’IA utilise cette base visuelle pour générer et superposer les nouveaux mouvements de bouche parfaitement synchronisés.

Mais les algorithmes d’apprentissage profond modernes ne s’arrêtent pas là. Ils vont plus loin en analysant les nuances de l’audio – le ton, l’émotion, même la vitesse du locuteur. Cela aide à rendre l’animation finale bien plus naturelle. Au cœur du lip-sync AI, c’est l’expertise pour synchroniser audio et vidéo de manière si fluide que le spectateur n’y pense même pas.

Le fond de l’affaire est le suivant : Ce n’est pas seulement faire bouger les lèvres. C’est une analyse profonde du son qui traduit la parole en expressions faciales réalistes, capturant les petits détails qui rendent une performance vraiment humaine.

Ce niveau d’automatisation alimente une croissance industrielle sérieuse. Le marché mondial de la technologie lip-sync est en passe de passer de 1,12 milliard USD en 2024 à un estimé 5,76 milliards USD d’ici 2034. Le fait que l’apprentissage automatique piloté par l’audio détienne déjà une part de marché de 40,7 % montre à quel point cette technologie est vitale pour mondialiser le contenu.

Cette même technologie est un ingrédient clé de nombreux outils vidéo IA. C’est ce qui permet à un créateur de transformer une simple photo fixe en une vidéo dynamique et captivante. Vous pouvez approfondir son fonctionnement en consultant notre guide sur la façon de transformer des images en vidéo avec l’IA.

Applications pratiques pour les créateurs et les marketeurs

Connaître les détails techniques du lip sync AI est une chose, mais la vraie magie opère quand vous voyez comment il ouvre de nouvelles portes créatives et commerciales. Pour les créateurs et les marketeurs, ce n’est pas seulement une nouveauté ; c’est un outil sérieux pour scaler le contenu, accéder à de nouveaux marchés et se connecter réellement avec des audiences du monde entier.

Le cas d’usage le plus évident et puissant est la localisation de contenu. Disons que vous avez un TikTok qui devient viral ou un tutoriel YouTube dans lequel vous avez mis tout votre cœur. Au lieu d’être limité aux anglophones, vous pouvez maintenant créer des versions pour des audiences espagnoles, hindi ou japonaises presque instantanément. L’IA ne se contente pas de superposer une nouvelle piste audio – elle réanime minutieusement vos mouvements labiaux pour correspondre à la nouvelle langue, rendant la vidéo finale complètement naturelle.

Cela réécrit complètement la stratégie pour l’expansion mondiale. L’ancienne méthode pour localiser une campagne vidéo impliquait d’embaucher des acteurs vocaux pour chaque langue, de réserver du temps d’étude coûteux et de s’échiner sur des semaines ou des mois de post-production. Désormais, ce workflow entier est plus rapide et bien plus abordable.

Des publicités mondiales aux avatars IA

Au-delà de la simple traduction de vidéos, le lip sync AI débloque toute une gamme de stratégies pour construire des marques et créer des publicités captivantes. Au cœur de chaque application, il exploite la capacité à séparer ce que quelqu’un dit de la façon dont il paraît en le disant.

Voici quelques façons révolutionnaires dont cette technologie est utilisée actuellement :

- Créer des avatars IA engageants : Vous pouvez prendre une seule image – d’un mascotte, d’un fondateur ou d’un influenceur virtuel – et la faire vivre. Il suffit de lui fournir un voiceover text-to-speech, et vous avez un approvisionnement infini de contenu pour les réseaux sociaux sans que quiconque ait à se mettre devant une caméra.

- Localiser des campagnes publicitaires : Une marque peut produire une publicité fantastique à gros budget et utiliser l’IA pour l’adapter à des dizaines de marchés internationaux. Cela garde la cohérence de la marque tout en rendant le message local et personnel. Cette approche est un sauveur pour les plateformes publicitaires qui exigent un flux constant de créativité fraîche. Vous pouvez voir comment cela fonctionne dans une stratégie plus large en consultant notre guide sur la création d’publicités UGC-style efficaces avec l’IA.

- Corrections audio sans effort : Nous sommes tous passés par là. Vous terminez un montage vidéo parfait, pour remarquer une erreur dans le voiceover. Au lieu d’une reprise frustrante, vous pouvez simplement enregistrer la ligne audio corrigée et laisser l’IA la patcher de manière fluide, en accordant parfaitement vos lèvres.

Le vrai pouvoir réside dans le découplage du visuel de l’audio. Cela donne aux créateurs une flexibilité immense pour expérimenter, corriger des erreurs et adapter le contenu à différentes plateformes et audiences sans repartir de zéro à chaque fois.

Pour montrer comment ces idées prennent vie, voici un rapide aperçu de la façon dont les créateurs et les marques mettent le lip sync AI en œuvre.

Applications du Lip Sync AI pour les créateurs et les marques

| Cas d’usage | Avantage principal | Exemple d’application |

|---|---|---|

| Distribution de contenu mondial | Croissance d’audience | Un YouTuber traduit sa vidéo la plus performante en 5 nouvelles langues pour atteindre un public mondial, triplant son potentiel de vues. |

| Campagnes publicitaires multilingues | ROI accru | Une marque D2C crée 10 versions localisées d’une seule publicité pour différents pays, améliorant la pertinence et les taux de conversion des pubs. |

| Influenceurs IA & Avatars | Scalabilité de contenu | Une entreprise utilise son mascotte animé pour créer des mises à jour quotidiennes sur les réseaux sociaux sans besoin d’une équipe vidéo pour chaque post. |

| Corrections en post-production | Économies de temps & coûts | Un cinéaste corrige une ligne mal prononcée dans une scène cruciale sans devoir refilmer, économisant des milliers de dollars. |

Ce n’est pas juste une amélioration mineure – c’est un changement fondamental dans la façon dont les vidéos sont produites.

Le marché du doublage vidéo IA était évalué à 31,5 millions USD en 2024 et devrait exploser à 397 millions USD d’ici 2032. Cette croissance explosive est due aux énormes économies de temps et d’argent qu’il génère. Une campagne multilingue qui exigeait autrefois un gros budget et des mois de travail peut maintenant être bouclée en moins d’une semaine pour moins de 2 000 USD, mettant une portée mondiale entre les mains des créateurs solo. Vous pouvez en apprendre plus sur l’évolution économique de la technologie lip sync IA et voir comment elle transforme toute l’économie des créateurs.

Comment choisir le bon outil Lip Sync AI

Avec une vague d’outils nouveaux inondant le marché, choisir le bon lip sync AI peut ressembler à un tir dans le noir. Mais toutes les plateformes ne se valent pas, et un mauvais choix peut vous laisser avec des vidéos robotiques et maladroites qui repoussent les spectateurs au lieu de les engager. Vous avez besoin d’une checklist simple pour trancher dans le battage marketing.

Le facteur numéro un absolu est la qualité de la synchronisation elle-même. La vidéo finale semble-t-elle naturelle, ou tombe-t-elle dans cette vallée dérangeante de l’« uncanny valley » ? Un grand outil comprend les minuscules mouvements subtils d’une vraie bouche – comment elle se forme autour des différents sons et se connecte à l’expression du locuteur.

Une IA bon marché ou mal entraînée pourrait juste faire claquer la bouche d’ouverture et de fermeture, ce qui est un giveaway immédiat que quelque chose est faux. La meilleure façon de juger est de prendre le même court clip audio et de le passer dans plusieurs outils différents. Comparez les résultats côte à côte et faites confiance à votre instinct.

Évaluer les fonctionnalités clés et les performances

Au-delà du réalisme pur, vous devez penser à vos besoins créatifs spécifiques. L’outil parfait pour un formateur corporate multilingue est probablement excessif pour un créateur de mèmes. Maîtriser votre processus d’évaluation dès le départ vous évitera bien des maux de tête plus tard.

Voici les éléments essentiels à rechercher :

- Support des langues et accents : C’est un critère décisif si vous visez un public mondial. Vérifiez combien de langues l’outil supporte et, tout aussi important, à quel point il gère bien les différents accents et dialectes. Un outil qui maîtrise un accent de Glasgow est bien plus impressionnant qu’un qui ne fonctionne qu’avec une voix générique et robotique.

- Vitesse de traitement : Combien de temps allez-vous fixer une barre de progression pour un clip d’une minute ? Dans le monde du contenu court, la vitesse est tout. Certaines plateformes traitent une vidéo en minutes, tandis que d’autres vous font attendre une éternité.

- Facilité d’utilisation : Un outil avec un million de fonctionnalités est inutile si l’interface est un cauchemar. Cherchez un design propre et simple qui vous permet d’uploader votre vidéo et audio, puis d’appliquer le lip sync en quelques clics. Des plateformes comme ShortGenius visent à rendre cette étape une partie fluide d’un pipeline de création vidéo beaucoup plus large.

L’objectif ultime est de trouver une solution qui s’intègre à votre processus existant sans créer de nouveaux goulots d’étranglement. Le bon outil devrait sembler être une extension de votre boîte à outils créative, pas un autre logiciel compliqué à apprendre.

Considérer l’intégration et les tendances du marché

Enfin, pensez plus grand. Comment ce lip sync AI s’intègre-t-il à votre workflow ? S’accorde-t-il bien avec les éditeurs vidéo que vous adorez déjà ? Peut-il gérer les formats et résolutions vidéo dont vous avez besoin ? Une intégration fluide est aussi critique que les performances techniques.

La croissance explosive dans ce domaine vous dit tout ce que vous avez besoin de savoir. Le marché de l’IA dans les médias, qui inclut la technologie lip-sync, devrait passer de 8,21 milliards USD en 2024 à 51,08 milliards USD d’ici 2030. Cette expansion rapide signifie que l’IA audio-visuelle sophistiquée devient rapidement un élément central de toute stratégie de contenu moderne. Vous pouvez obtenir plus de détails sur le marché de l’IA dans les médias sur datainsightsmarket.com.

En choisissant un outil bien supporté et en constante amélioration, vous ne résolvez pas seulement un problème pour aujourd’hui – vous investissez dans votre capacité à créer du contenu incroyable pour les années à venir.

Un guide étape par étape pour votre première vidéo Lip Sync

Allons-y, mettons les mains dans le cambouis. Créer votre première vidéo avec lip sync AI n’est pas aussi compliqué que ça en a l’air. Nous pouvons le décomposer en un processus simple en quatre étapes qui vous emmène d’une idée brute à une vidéo finie prête à partager.

C’est le workflow de base que vous trouverez dans des plateformes comme ShortGenius, qui met cette technologie puissante à portée de main.

Étape 1 : Préparez votre piste audio

Tout commence par l’audio. Pensez-y comme au plan de votre vidéo – l’IA a besoin d’une piste propre et claire pour déterminer quelles formes de bouche créer. Vous pouvez enregistrer votre propre voix ou utiliser un générateur text-to-speech de qualité pour une narration constamment nette.

Pour le meilleur résultat, assurez-vous que votre audio a peu ou pas de bruit de fond. Parler clairement fait aussi une énorme différence. Plus vos mots sont distincts, mieux l’IA peut accorder les mouvements labiaux. Bien réussir cette première étape vous prépare à un résultat bien plus crédible.

Étape 2 : Sélectionnez votre vidéo ou avatar

Ensuite, vous devez choisir qui (ou quoi) va parler. Cela peut être un clip vidéo que vous avez déjà d’une personne qui parle ou même une simple image statique d’un avatar IA que vous avez créé. La clé ici est un plan clair du visage.

Voici un conseil pro : Un angle droit, face avant fonctionne le mieux. L’IA a besoin d’une vue directe et dégagée de la bouche pour générer des mouvements réalistes. Si le visage est tourné ou obstrué, l’animation finale semblera un peu décalée.

La qualité de vos entrées détermine directement la qualité de votre sortie. Une vidéo nette, bien éclairée et un audio propre fournissent à l’IA le meilleur matériau possible, minimisant les erreurs et assurant un résultat plus lifelike.

Étape 3 : Appliquez le Lip Sync AI

C’est là que le vrai plaisir commence, et c’est généralement juste une question de cliquer sur un bouton. Une fois que vous avez uploadé vos fichiers audio et vidéo dans l’outil, appliquez simplement la fonctionnalité lip sync. L’IA se met alors au travail, décomposant les sons de votre audio et créant de nouveaux mouvements de bouche sur votre sujet vidéo pour correspondre.

Le processus entier est étonnamment rapide, prenant souvent juste quelques minutes. Pendant que l’IA fait le gros du travail, vous pouvez vous préparer pour la dernière et plus importante étape.

Étape 4 : Vérifiez et affinez la sortie

Aucune IA ne réussit parfaitement à chaque fois, donc une vérification finale est cruciale. Regardez la vidéo générée et prêtez une attention particulière au timing. La synchronisation semble-t-elle naturelle ? Y a-t-il des tics étranges ou des moments où les lèvres ne correspondent pas tout à fait à l’audio ?

La plupart des bons outils vous donnent des options pour faire de petits ajustements. Parfois, juste décaler légèrement le timing audio ou relancer une section spécifique peut lisser les imperfections. Une fois satisfait, votre vidéo est prête à l’export. Ce processus entier est une partie centrale de nombreux workflows vidéo IA, et vous pouvez voir comment il s’intègre dans l’ensemble en lisant notre guide sur les modèles text-to-video IA.

Des questions sur le Lip Sync AI ? Nous avons les réponses.

Se lancer dans une nouvelle technologie soulève toujours quelques questions. C’est tout à fait normal. Tacklons certaines des plus courantes que j’entends des créateurs sur le lip sync AI pour que vous puissiez passer directement à la création de super contenu.

Comment le Lip Sync AI gère-t-il les différentes langues ?

C’est une grosse question. La bonne nouvelle est que la plupart des modèles IA de haut niveau sont entraînés sur d’énormes datasets remplis d’heures innombrables de parole multilingue. Cela signifie qu’ils sont étonnamment doués non seulement pour les différentes langues, mais aussi pour les accents. Ce n’est pas juste les mots ; c’est apprendre les formes spécifiques de bouche – le terme technique est visèmes – qui vont avec chaque son unique.

Bien sûr, tous les outils ne se valent pas. Vous verrez que les performances varient vraiment d’une plateforme à l’autre, c’est pourquoi je recommande toujours de tester un court clip dans votre langue cible avant de vous engager sur un gros projet. Les meilleurs systèmes capturent ces nuances subtiles, faisant ressembler le locuteur à un natif, plutôt que d’appliquer un mouvement de bouche générique « one-size-fits-all » qui semble décalé.

Quelle est la différence entre Lip Sync et Doublage ?

Il est facile de les confondre, mais ce sont vraiment deux faces d’une même pièce, travaillant ensemble pour rendre une vidéo authentique dans une nouvelle langue.

Imaginez cela ainsi :

- Doublage vidéo : C’est tout sur l’audio. C’est le processus de remplacer la piste vocale originale par une nouvelle, généralement dans une autre langue.

- Lip Sync : C’est la suite visuelle. Une fois que le nouvel audio est posé, l’IA entre en action, modifiant numériquement les mouvements de bouche du locuteur pour correspondre parfaitement au nouveau dialogue.

Quand vous les combinez, vous obtenez une vidéo complètement localisée. Le son est bon, et les visuels correspondent. L’un gère ce que vous entendez, l’autre ce que vous voyez.

Ce one-two punch permet à un créateur de prendre une seule vidéo et de la faire sentir native pour des audiences partout dans le monde, sans cette sensation distraite de désynchronisation qui sort immédiatement le spectateur de l’expérience.

Comment éviter l’effet creepy de l’« Uncanny Valley » ?

Ah, la « uncanny valley ». C’est cette sensation bizarre et déstabilisante quand quelque chose semble presque humain, mais que quelques détails subtils ne collent pas tout à fait. C’est une vraie préoccupation avec le lip sync AI, mais vous pouvez absolument l’éviter.

D’abord, commencez toujours avec du matériau source de haute qualité. Une vidéo nette, bien éclairée ou un avatar poli donne à l’IA une toile beaucoup plus propre. Si vous lui donnez du footage flou ou basse résolution, vous invitez presque un résultat bizarre.

Ensuite, concentrez-vous sur la qualité audio. Utilisez une voix IA de haute qualité qui sonne naturelle, ou mieux, un enregistrement propre d’un acteur vocal humain. Une voix robotique et plate associée à des mouvements labiaux réalistes est une recette pour une creepy instantanée.

Enfin, n’oubliez pas d’ajouter ces touches humaines subtiles. Une scène générée par IA peut sembler un peu stérile seule. Ajouter de petites choses comme des mouvements naturels de tête, un clignement réaliste, ou même un arrière-plan intéressant peut rendre toute la vidéo plus ancrée et vivante, la sortant directement de l’uncanny valley.

Prêt à créer des vidéos multilingues époustouflantes sans tracas ? ShortGenius intègre des capacités puissantes de lip sync IA dans un workflow complet de création vidéo. Produisez des publicités professionnelles et du contenu social en minutes. Commencez à créer gratuitement sur shortgenius.com.