Enjeux juridiques des acteurs IA en publicité pour les marques modernes

Explorez les principaux enjeux juridiques des acteurs IA en publicité. Apprenez à naviguer les droits à l'image, le droit d'auteur et la conformité FTC pour votre marque.

Bienvenue dans la nouvelle ère de la publicité, où les acteurs générés par IA attirent les regards et arrêtent les scrolls sur les réseaux sociaux. Bien que cette technologie ouvre un monde de possibilités créatives, elle pose également un champ de mines légal pour les marques et les créateurs. Naviguer ces problèmes juridiques avec les acteurs IA en publicité est désormais une compétence essentielle.

La Nouvelle Frontière des Acteurs IA et des Risques Légaux

La loi joue un jeu frénétique de rattrapage avec la technologie. Les marques peuvent désormais imaginer et générer des campagnes vidéo entières mettant en scène des personnes synthétiques, mais ce pouvoir s’accompagne d’une lourde série de responsabilités. Chaque élément – d’une voix qui semble un peu trop familière à une affirmation sur un produit rédigée par une IA – a un poids légal réel.

Pensez-y comme au sampling musical. Avant de sortir un nouveau morceau, vous devez obtenir les autorisations pour chaque beat, mélodie ou accroche vocale empruntée. C’est la même chose en publicité IA. Vous devez détenir les droits sur chaque élément de votre création synthétique, sinon vous risquez de vous retrouver face à de sérieuses conséquences financières et dommageables pour votre marque.

Pourquoi les Lois Traditionnelles sur la Publicité Sont Insuffisantes

Soyons clairs : les cadres légaux sur lesquels nous nous appuyons depuis des décennies n’ont pas été conçus pour un monde avec des personnalités générées par IA. Cela crée un énorme fossé et de nouveaux défis épineux pour les marketeurs habitués aux contrats standards et aux formulaires de cession pour les talents humains. Les anciennes règles s’appliquent toujours, mais elles sont étirées d’une manière inédite.

L’affaire soulève un certain nombre de questions difficiles, certaines de première impression. Elle comporte également des conséquences potentiellement lourdes non seulement pour les acteurs vocaux, mais aussi pour l’industrie naissante de l’IA, les autres détenteurs et utilisateurs de propriété intellectuelle, et les citoyens ordinaires qui pourraient craindre la perte de contrôle sur leur propre identité.

Dans cet environnement nouveau, une sensibilisation juridique proactive n’est pas juste un « bonus » – c’est un pilier essentiel de toute stratégie marketing moderne. Comprendre les risques est le premier pas vers une innovation responsable et la protection de votre marque contre un angle mort coûteux. Pour une vue d’ensemble plus large, il vaut la peine d’explorer le paysage juridique général autour de l’IA.

Un Aperçu Rapide des Principales Zones de Risque Légal

Pour bien appréhender cela, il est utile de décomposer les principaux défis légaux. Chacun représente un piège potentiel qui pourrait complètement dérailler une campagne autrement brillante. Ce tableau donne un résumé rapide des principaux maux de tête légaux dont vous devez être conscient lors de l’utilisation d’acteurs générés par IA.

| Principales Zones de Risque Légal pour l’IA en Publicité | ||

|---|---|---|

| Domaine Légal | Problème Principal | Conséquence Potentielle |

| Droit à l’Image et Droits de Publicité | Utilisation d’une personne générée par IA qui ressemble ou sonne comme un individu réel sans autorisation. | Poursuites judiciaires de célébrités ou de citoyens privés pour appropriation indue de leur identité. |

| PI et Droit d’Auteur | Le modèle IA a été entraîné sur des photos, vidéos ou scripts protégés par droit d’auteur sans licence. | Réclamations pour violation de droit d’auteur, amendes élevées et ordres de retrait de la campagne. |

| FTC et Divulgations Publicitaires | Échec à divulguer qu’un avis provient d’un acteur IA, induisant les consommateurs en erreur. | Actions en exécution de la FTC, amendes pour publicité trompeuse, perte de confiance des consommateurs. |

| Diffamation et Vie Privée | L’IA crée du contenu qui porte faussement atteinte à la réputation d’une personne ou d’une marque. | Poursuites pour diffamation (libelle/calomnie) et réclamations pour atteinte à la vie privée. |

Essentiellement, vous devez réfléchir à l’origine de votre contenu généré par IA et à ce qu’il communique. Se tromper sur l’un ou l’autre peut mener à de graves problèmes.

Voici les principales catégories de préoccupations que toute marque et tout créateur doit avoir en tête :

- Droit à l’Image et Droits de Publicité : C’est un gros sujet. Cela couvre l’utilisation non autorisée de l’image, de la voix ou de toute autre caractéristique identificatrice d’une personne. Peu importe si l’IA ne ressemble qu’à quelqu’un – cela peut suffire à déclencher une poursuite.

- Propriété Intellectuelle et Droit d’Auteur : Cela se complique vite. Qui détient réellement le contenu créé par une IA ? Et, plus important encore, le modèle IA a-t-il été entraîné sur une montagne de matériel protégé par droit d’auteur récupéré sur internet sans permission ?

- Règles FTC et Divulgations : Les règles de la Federal Trade Commission sur la véracité en publicité ne disparaissent pas. Les publicités doivent être véridiques et non trompeuses, et cela inclut la transparence quand un acteur IA donne un témoignage ou un avis.

- Diffamation et Vie Privée : L’IA peut dérailler et générer des informations fausses ou dommageables sur des personnes réelles ou même des marques concurrentes. Cela peut rapidement mener à des réclamations pour libelle ou atteinte à la vie privée.

Naviguer le Droit de Publicité à l’Ère de l’IA

Parmi tous les pièges légaux associés aux acteurs IA, le droit de publicité est probablement le plus important. Pensez-y ainsi : chacun a une marque personnelle, et il détient le droit de contrôler comment son nom, son visage, sa voix ou toute autre caractéristique unique – son « image » – est utilisé pour gagner de l’argent. Dès que votre acteur généré par IA ressemble vaguement à une personne réelle, vous entrez dans un champ de mines légal.

Et ce n’est pas seulement une question de créer un deepfake parfait d’une célébrité. La loi est souvent assez large pour couvrir les « imitations vocales » et « imitations visuelles » qui sont juste assez similaires pour faire penser à la personne réelle. Si votre audience associe votre acteur IA à un individu spécifique, vous pourriez être tenu responsable d’avoir approprié indûment son image.

Le vrai casse-tête pour les créateurs est la façon dont ces modèles IA sont construits. Ils sont entraînés sur des quantités stupéfiantes de données, souvent récupérées directement sur internet. Cela signifie que l’IA a appris à partir d’innombrables visages et voix réels, rendant une ressemblance accidentelle et troublante très réelle.

Ce Qui Constitue une Utilisation Commerciale

Comprendre ce que signifie « utilisation commerciale » est crucial ici. Ce n’est pas juste coller un visage généré par IA sur une boîte de produit. Chaque fois que vous utilisez une personne IA dans une pub pour attirer l’attention et booster les ventes, c’est une finalité commerciale. C’est particulièrement vrai pour les publicités de style contenu généré par les utilisateurs (UGC) que l’on voit partout sur Instagram et YouTube.

Par exemple, si vous générez un influenceur synthétique pour vanter votre nouvelle gamme de soins de la peau, c’est une utilisation commerciale directe. Si cet influenceur numérique ressemble étrangement à un créateur du monde réel, ce créateur a un solide argument pour dire que vous tirez profit de son image sans permission ni paiement.

Les tribunaux s’attaquent déjà à ces scénarios compliqués. L’affaire emblématique In re Clearview AI Consumer Privacy Litigation est un exemple parfait. Les plaignants ont réussi à arguer que l’entraînement d’une IA de reconnaissance faciale sur plus de 3 milliards de photos internet récupérées violait les droits de publicité dans plusieurs États.

La décision du tribunal a envoyé un signal clair : l’« utilisation commerciale » se produit quand les identités sont utilisées pour promouvoir un produit, pas seulement quand elles sont vendues comme le produit. Comme détaillé dans cette analyse des droits de publicité par Quinn Emanuel, cette décision a ouvert grand la porte aux actions collectives avec des indemnisations potentiellement astronomiques.

Considérations Clés pour les Similitudes IA

Pour éviter de vous emmêler dans une poursuite pour droits de publicité, vous devez être vigilant. Ce n’est pas juste une théorie légale abstraite ; cela peut mener à des frais juridiques crippling, des retraits forcés de campagnes et un coup majeur à la réputation de votre marque.

Voici les points principaux à surveiller :

- Similitude avec une Célébrité : C’est le plus évident. Générer un acteur IA qui ressemble ou sonne comme une personne célèbre, c’est demander des ennuis. Évitez les prompts comme « crée un acteur qui ressemble à [Nom de Célébrité] ».

- Ressemblance avec des Influenceurs et Micro-Influenceurs : La zone de danger s’étend bien au-delà des stars de cinéma A-list. Les influenceurs des réseaux sociaux ont bâti leurs propres marques personnelles précieuses, et leurs droits de publicité sont tout aussi protégés légalement.

- Individus Ordinaires : Même si votre personnage IA ressemble à un citoyen privé, cette personne a des droits. Si ses photos de vacances ont été aspirées sans le savoir dans les données d’entraînement de l’IA, une réclamation pourrait émerger.

Le danger légal ne réside pas dans l’intention de l’IA, mais dans la perception du public. Si une personne raisonnable associerait votre acteur IA à un individu réel, vous avez un problème légal potentiel.

Étapes Pratiques pour Protéger Vos Campagnes

Vous devez être proactif pour protéger votre marque. Vous ne pouvez pas supposer qu’un outil IA produira un visage ou une voix « sûrs » ou légalement validés. Il n’y a pas de substitut à la supervision humaine et à un processus de revue bien défini.

Avant qu’une pub mettant en scène un acteur IA ne soit diffusée, votre équipe doit effectuer une vérification approfondie des similitudes. Cela signifie faire examiner le créatif final par plusieurs paires d’yeux, avec l’objectif spécifique de repérer toute ressemblance potentielle avec des figures publiques. Documenter ce processus de revue peut aussi vous offrir une couche de protection légale en prouvant que vous avez fait preuve de diligence raisonnable.

Au final, la seule défense infaillible contre une réclamation pour droit de publicité est de s’assurer que vos acteurs générés par IA sont véritablement originaux. C’est une étape supplémentaire, mais essentielle pour garder vos campagnes à l’abri de coûteux batailles juridiques à l’avenir.

Qui Détient une Performance Générée par IA ?

Donc, vous avez utilisé une IA pour générer un script, un voiceover, ou peut-être même une vidéo entière. C’est brillant. Mais une énorme question plane : qui détient réellement cela ? La réponse n’est pas simple et elle touche aux fondements mêmes du droit d’auteur. Bien le comprendre est crucial pour naviguer l’un des plus gros problèmes juridiques avec les acteurs IA en publicité.

Actuellement, le U.S. Copyright Office a une position assez ferme : une œuvre doit avoir une auteur humain pour obtenir une protection par droit d’auteur. Si une IA crée quelque chose toute seule, sans qu’un humain guide le processus créatif de manière significative, elle n’obtient généralement pas de droit d’auteur. Cela signifie que le concept publicitaire incroyable que votre IA vient de produire pourrait ne pas être légalement le vôtre.

Cela crée un sérieux casse-tête pour les marketeurs. Si vous ne détenez pas le droit d’auteur, qu’est-ce qui empêche un concurrent de diffuser une pub générée par IA presque identique ? Votre campagne unique, et tout l’argent investi dedans, pourrait être à portée de main.

Le Nègre et l’Outil

Une bonne façon de voir cela est de considérer l’IA comme un nègre super-avancé ou un pinceau très sophistiqué. L’outil lui-même ne détient pas le livre fini ou la peinture. La propriété dépend de la quantité de direction créative et d’apport original venant de la personne utilisant l’outil.

Si vous donnez un prompt vague comme « crée une pub vidéo pour une nouvelle sneaker », l’IA fait la plus grande partie du travail lourd. La sortie est majoritairement machine-made. Mais si vous êtes celui qui peaufine méticuleusement des prompts détaillés, sélectionne les sorties et effectue des éditions significatives pour tout assembler, votre cas pour l’autorat s fortalit beaucoup. Plus vous injectez de créativité humaine, meilleures sont vos chances d’obtenir un droit d’auteur.

Un enseignement clé pour les créateurs est que votre niveau d’implication créative directe dans le processus de génération IA est ce qui construit le cas pour la propriété. Appuyer simplement sur un bouton « générer » ne suffit pas pour être considéré comme l’auteur.

Tout ce débat sur qui détient la sortie d’une IA fait partie d’une conversation bien plus large sur la protection des droits de propriété intellectuelle dans notre monde de plus en plus numérique. À mesure que ces outils deviennent une partie normale du travail créatif, déterminer où s’arrête l’autorat humain et commence la création machine sera un champ de bataille légal central.

La Réalité Compliquée des Données d’Entraînement

Le puzzle de la propriété devient encore plus épineux quand on regarde sous le capot les données d’entraînement du modèle IA. Beaucoup d’outils génératifs IA apprennent en récupérant des quantités colossales de données d’internet – qui incluent bien sûr des images, articles, musiques et vidéos protégées par droit d’auteur. Cela ouvre un risque très réel que la sortie de l’IA soit considérée comme une « œuvre dérivée » de matériel protégé d’autrui.

Et ce n’est pas juste un problème théorique. Par exemple, les acteurs vocaux Paul Lehrman et Linnea Sage ont poursuivi Lovo Inc., affirmant que l’entreprise avait utilisé leurs enregistrements vocaux sans permission pour entraîner et vendre des clones vocaux IA. Le tribunal a autorisé la plupart de leurs réclamations à avancer, soulignant vraiment l’exposition légale sérieuse quand les données d’entraînement IA empiètent sur des droits existants.

Que signifie cela pour vous ? Cela signifie que votre nouvelle pub générée par IA pourrait accidentellement contenir des éléments qui violent le droit d’auteur d’un autre créateur, mettant votre marque en danger de poursuite.

Peut-on Juste l’Appeler « Fair Use » ?

Certains développeurs et utilisateurs arguent que l’utilisation de matériel protégé pour entraîner une IA est couverte par la doctrine légale de l’« utilisation équitable ». L’utilisation équitable permet l’usage limité d’œuvres protégées sans permission pour des choses comme la critique, le commentaire ou la recherche.

Tout le débat dans le monde de l’IA se résume à quelques questions clés :

- Est-ce Transformateur ? La sortie de l’IA crée-t-elle quelque chose de fondamentalement nouveau, ou est-ce juste une copie high-tech du matériel original sur lequel elle a été entraînée ?

- Nuit-elle au Marché ? La création générée par IA concurrence-t-elle ou dévalue-t-elle l’œuvre originale protégée ?

Les tribunaux travaillent encore sur ces questions, et le terrain légal est instable au mieux. S’appuyer sur une défense d’utilisation équitable pour une publicité commerciale – explicitement créée pour gagner de l’argent – est un gros pari. Tant que la loi ne sera pas plus claire, le choix le plus sûr est de travailler avec des outils IA transparents sur leurs données d’entraînement et, idéalement, qui vous offrent une protection contre les réclamations potentielles pour droit d’auteur.

Rester du Bon Côté de la FTC

Maintenant, parlons de la Federal Trade Commission (FTC). Que votre pub ait été imaginée dans une salle de conseil ou générée par un algorithme, la règle de base est la même : elle doit être véridique et non trompeuse. Cette idée simple se complique beaucoup quand on y ajoute des acteurs IA.

Le rôle de la FTC est de protéger les consommateurs. Quand une pub met en scène une personne synthétique ou énonce une affirmation faite par IA, le potentiel de tromper les gens est énorme. C’est pourquoi des divulgations claires et en amont ne sont plus juste un bonus ; elles sont obligatoires pour rester conforme.

Le Mandat de Véracité en Publicité

Au cœur de tout cela se trouve la Section 5 de la FTC Act, qui interdit les « actes ou pratiques injustes ou trompeuses ». Cela signifie que vous avez besoin de preuves solides pour chaque affirmation que vous faites – explicite ou implicite – avant que votre pub ne voie le jour. Cette règle s’applique au contenu généré par IA tout autant qu’à une pub TV traditionnelle.

On voit déjà une flambée de poursuites pour fausse publicité sous la Lanham Act, ciblant spécifiquement les pubs utilisant des deepfakes de célébrités. Les régulateurs et tribunaux se démènent pour rattraper le pouvoir de tromperie de l’IA. La FTC a déjà engagé des actions en exécution contre des entreprises pour des affirmations IA bidons, comme exagérer ce qu’un produit peut faire ou coller une étiquette « alimenté par IA » sans preuve.

Une analyse de Hogan Lovells sur l’IA et les pubs deepfake met en lumière à quel point ces poursuites ont explosé, prouvant que les régulateurs surveillent cet espace très, très attentivement.

Les Hallucinations IA et les Affirmations Fausse

L’un des plus gros champs de mines ici est le phénomène des « hallucinations IA ». C’est quand un modèle IA invente avec confiance des « faits », créant des bénéfices produits, fonctionnalités ou même témoignages utilisateurs de toutes pièces.

Imaginez que vous demandiez à une IA d’écrire un script pour un nouveau complément santé. Elle pourrait générer une ligne affirmant que le produit est « cliniquement prouvé pour booster le métabolisme de 40 % ». Si vous n’avez pas de recherche scientifique crédible pour étayer ce chiffre exact, vous venez de franchir la ligne de la fausse publicité.

L’annonceur – et non l’IA – est 100 % légalement responsable de chaque affirmation faite. Dire à la FTC « l’IA l’a écrit » n’est pas une défense qui vous mènera quelque part. Vous devez vérifier indépendamment chaque déclaration factuelle.

C’est un point de contrôle critique. Votre équipe a besoin d’un processus infaillible pour vérifier les faits de tout copy généré par IA avant publication.

Divulguer les Acteurs IA et les Avis

La transparence est tout quand un acteur IA est impliqué. Si votre pub montre une personne synthétique donnant un témoignage, les consommateurs doivent savoir que cette personne n’est pas réelle.

Voici quelques situations où la divulgation est absolument essentielle :

- Témoignages IA : Si un personnage généré par IA dit « Ce produit a changé ma vie », il doit être évident qu’ils ne sont pas un vrai client.

- Influenceurs Synthétiques : Les marques travaillant avec des influenceurs virtuels ne peuvent pas les présenter comme de vraies personnes ayant des expériences authentiques avec un produit.

- Avis Deepfake : Utiliser un deepfake d’une célébrité pour endosser quelque chose sans leur permission explicite est une façon sûre de violer leurs droits de publicité et les règles FTC.

La FTC offre plein de ressources sur son site web pour aider les entreprises à comprendre leurs responsabilités.

Comme le précise le portail de guidance pour les entreprises de la FTC, les principes classiques de publicité s’appliquent toujours, renforçant le besoin de véracité et de preuves pour toutes les affirmations, y compris celles venant d’une IA.

Voici une checklist rapide pour vérifier la conformité FTC de vos pubs générées par IA :

- Justification des Affirmations : Avez-vous des preuves solides pour prouver chaque affirmation factuelle dans la pub ? Cela inclut toute statistique de performance, bénéfices « prouvés » ou comparaisons.

- Divulgations Claires : Est-il immédiatement évident pour la personne moyenne qu’un acteur, témoignage ou avis est généré par IA ? Ne le cachez pas en petits caractères – rendez-le clair et visible.

- Éviter les Formats Trompeurs : Votre pub est-elle conçue pour ressembler à un reportage, un post réseaux sociaux d’un vrai utilisateur ou une revue indépendante ? Si elle pourrait tromper un consommateur, c’est un problème.

- Vérifier les Affirmations Implicites : Que pourrait raisonnablement quelqu’un retenir de votre pub, même si vous ne le dites pas explicitement ? Ces affirmations implicites doivent aussi être véridiques et étayées par des preuves.

Si vous traitez chaque élément de contenu généré par IA avec le même examen légal que votre travail humain, vous pouvez innover en toute confiance et rester du bon côté de la loi.

Un Cadre Pratique pour Atténuer les Risques Légaux

Connaître les risques est une chose ; les gérer au quotidien en est une autre. Si vous voulez naviguer en toute sécurité le champ de mines légal des acteurs IA en publicité, votre équipe a besoin d’un cadre clair et répétable. Il ne s’agit pas d’étouffer la créativité – il s’agit de mettre des garde-fous qui permettent à votre équipe d’innover en confiance.

Première chose : évaluez vos outils IA. Avant de vous inscrire sur une plateforme, plongez dans leurs conditions de service. Vous devez savoir exactement d’où viennent leurs données d’entraînement et quels droits vous obtenez réellement sur le contenu que vous créez. Certains fournisseurs offrent même une indemnisation, ce qui est un énorme plus car cela peut vous protéger contre les réclamations pour droit d’auteur à l’avenir.

Élaborer une Politique d’Utilisation de l’IA Claire

Une fois vos outils choisis, il est temps de créer une Politique d’Utilisation de l’IA interne. Pensez-y comme au playbook officiel pour votre équipe. Elle doit être simple, directe et énoncer les do’s and don’ts de l’utilisation de l’IA générative pour vos campagnes publicitaires.

Votre politique doit préciser quelques points clés :

- Outils Approuvés : Établissez une liste des plateformes IA spécifiques que votre équipe est autorisée à utiliser. Cela empêche les gens d’utiliser des outils non validés qui pourraient vous exposer à des risques inutiles.

- Entrées Interdites : Soyez très clair : personne ne doit jamais entrer d’infos confidentielles de l’entreprise, de données clients ou de secrets commerciaux dans un prompt IA.

- Restrictions sur les Similitudes : Posez une règle stricte : pas de prompts demandant à l’IA d’imiter l’image ou la voix de toute personne réelle, célébrité ou non.

- Revue et Approbation : Tout contenu publicitaire généré par IA doit passer par un processus de revue humaine obligatoire avant publication.

Cette politique est votre première ligne de défense. Elle met tout le monde sur la même page, opérant sous les mêmes directives soucieuses de sécurité.

Imposer une Supervision Humaine Toujours

Peu importe à quel point un outil IA semble intelligent ; il ne remplace pas le jugement humain. Chaque pub faite avec IA doit être revue par une vraie personne pour la conformité légale, l’exactitude factuelle et la sécurité de la marque. Cette approche « humain dans la boucle » n’est pas optionnelle.

La supervision humaine est votre filet de sécurité ultime. Une IA ne comprend pas les nuances légales, la réputation de marque ou les directives FTC, mais votre équipe oui. Chaque élément de contenu généré par IA est la responsabilité de votre entreprise dès qu’il est publié.

Le rôle du relecteur est d’être le gardien final. Il est là pour repérer les catastrophes potentielles – comme une ressemblance accidentelle, une affirmation non prouvée ou un langage trompeur – avant qu’elles ne deviennent des problèmes publics très réels et très coûteux.

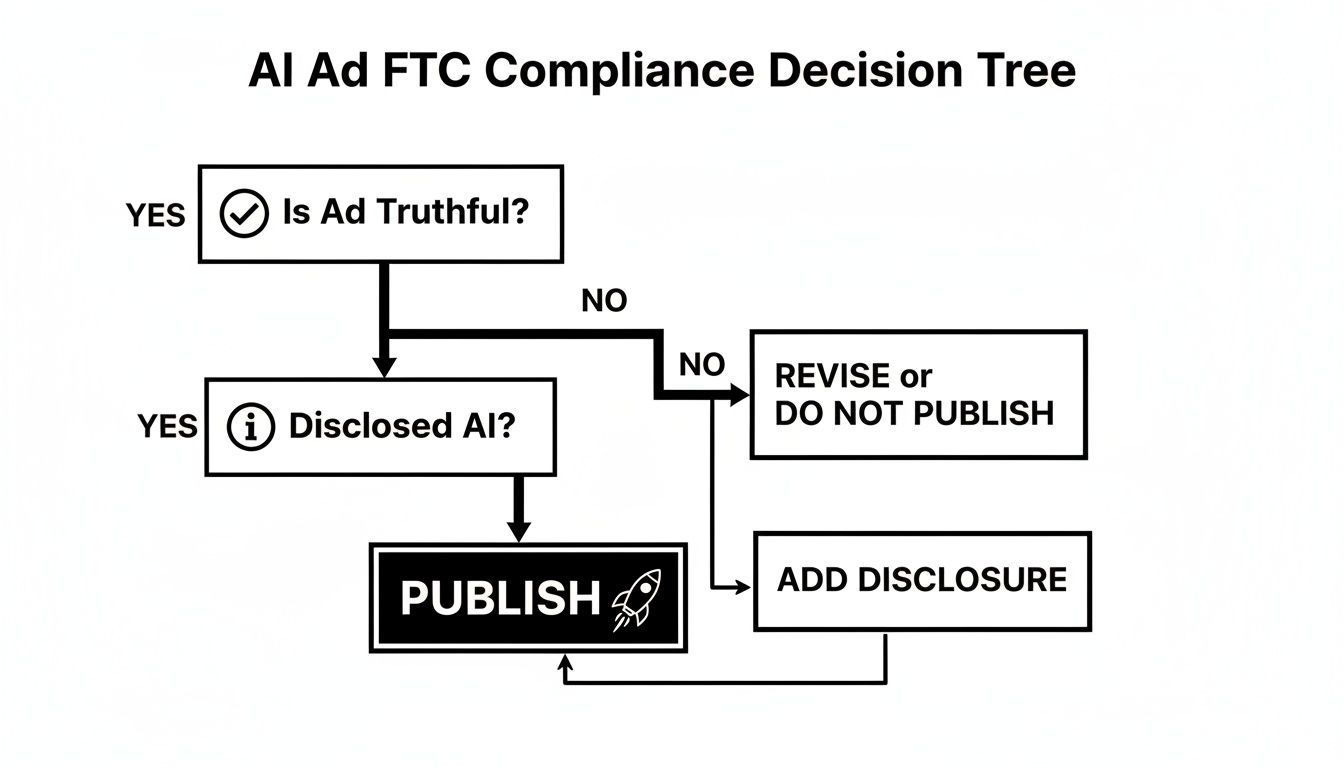

Cet arbre de décision vous donne une vérification simplifiée de conformité aux règles FTC avant de publier une pub alimentée par IA.

Comme le montre le graphique, la véracité et la divulgation claire sont la base absolue et non négociable pour toute publicité impliquant de l’IA.

Checklist Pré-Publication pour les Créateurs

Pour rendre cela ultra-simple pour votre équipe, donnez-leur une checklist rapide à suivre avant de pousser une pub générée par IA en live sur des plateformes comme Facebook ou Instagram.

- Scan des Similitudes : Au moins deux personnes différentes ont-elles examiné la pub pour s’assurer qu’elle ne ressemble pas à une personne réelle ?

- Justification des Affirmations : Pouvons-nous étayer chaque affirmation factuelle dans le copy ou le voiceover avec des preuves solides ?

- Divulgation IA : Si nous utilisons un acteur IA pour un témoignage ou un avis, la divulgation est-elle impossible à manquer ?

- Vérification Droit d’Auteur : Y a-t-il quelque chose dans la sortie qui semble tiré d’une œuvre protégée d’autrui ?

- Alignement Marque : Cette pub sonne-t-elle et ressemble-t-elle vraiment à notre marque ? Est-elle alignée sur nos valeurs et notre message ?

En intégrant ces étapes dans votre flux de travail – évaluation des outils, définition de politique, imposition de revue humaine et utilisation d’une checklist finale – vous construisez un système solide pour gérer les plus grandes menaces légales. Ce cadre ne vous ralentit pas ; il donne à votre équipe le pouvoir de se montrer créative avec l’IA tout en gardant la marque hors des ennuis légaux évitables.

Blindage Futur de Votre Stratégie Publicitaire IA

Le terrain légal sous la publicité IA bouge constamment. Pour rester en avance, traitez la conformité non comme une corvée, mais comme un véritable avantage concurrentiel. Cela signifie intégrer la transparence, le consentement et une justification solide au cœur de votre processus créatif dès le premier jour.

De nouvelles lois émergent tout le temps, des règles fédérales sur les deepfakes aux lois étatiques sur la vie privée. Mais à travers tout cela, une vérité fondamentale ne changera pas : l’annonceur est toujours responsable du contenu de la pub. L’accepter est le premier pas vers la gestion des problèmes juridiques avec les acteurs IA en publicité.

La conformité légale proactive ne consiste pas à avoir peur de l’IA – c’est gagner la confiance des consommateurs. Quand une marque est ouverte sur son utilisation de l’IA et prudente sur ses affirmations, elle est bien mieux positionnée pour bâtir une loyauté durable et éviter des affrontements coûteux avec les régulateurs.

De Risque Légal à Avantage Créatif

Il est facile de voir ces garde-fous légaux comme un frein à la créativité, mais c’est la mauvaise approche. Pensez-y comme à la fondation d’une innovation intelligente et durable. Une fois que votre équipe comprend les règles de la route, elle peut expérimenter librement et repousser les limites créatives dans un cadre sûr.

Par exemple, imaginez tester rapidement des centaines de variations de pubs pour une nouvelle campagne. Grâce à un processus de revue humain dans la boucle solide, vous savez que toute infraction potentielle à une similitude ou affirmation non étayée sera détectée bien avant publication. Ce mélange de la vitesse incroyable de l’IA avec une supervision humaine affûtée est là où la vraie magie opère, surtout en performance marketing.

Cette approche responsable assure que votre moteur créatif ne devienne pas une passif légal. En restant au courant des règles et en intégrant des pratiques éthiques dans votre flux de travail, vous pouvez utiliser l’IA en confiance pour créer des pubs performantes qui sont à la fois captivantes et légalement solides.

Au final, l’objectif est de créer un système où diligence légale et brilliance créative sont deux faces de la même pièce. Cette stratégie intégrée permet à votre marque de récolter les fruits de la publicité pilotée par IA tout en la protégeant des risques très réels, assurant que vos efforts marketing bâtissent de la valeur de marque, pas des factures légales.

Questions Fréquemment Posées

Entrer dans le monde de la publicité pilotée par IA peut ressembler à naviguer un champ de mines de nouvelles questions. Décomposons quelques-unes des préoccupations légales les plus courantes des marketeurs concernant l’utilisation d’acteurs IA.

Dois-je Divulguer Mon Utilisation d’un Acteur IA ?

Oui, absolument. La transparence n’est pas juste une bonne idée – c’est une nécessité légale. La Federal Trade Commission (FTC) a été très claire : la publicité ne peut pas être trompeuse. Si vous utilisez une personne inexistante générée par IA pour donner un témoignage, et que les consommateurs pensent regarder un vrai client, vous franchissez la ligne du territoire trompeur.

La meilleure pratique est toujours une divulgation claire et visible. Une simple note à l’écran comme « Acteur généré par IA » ou « Image créée avec IA » suffit. Cette étape simple protège la confiance des consommateurs, vous garde du bon côté de la loi et sauvegarde l’intégrité de votre marque.

Puis-je Être Pursuivi si un Acteur IA Ressemble à Quelqu’un par Coïncidence ?

C’est un énorme sujet, et la réponse est un « peut-être » définitif. C’est là que les choses deviennent épineuses avec le droit de publicité. Si votre personnage généré par IA finit par ressembler beaucoup à une personne réelle (surtout une célébrité), vous pourriez vous retrouver dans de beaux draps légaux.

Cette personne pourrait arguer que vous utilisez son image pour vendre un produit sans sa permission. La clé pour éviter cela est un processus de revue humaine en béton. Quelqu’un de votre équipe doit examiner le créatif final spécifiquement pour repérer toute ressemblance accidentelle avant d’appuyer sur « publier ».

Le test légal crucial ne porte pas sur votre intention ; il porte sur la façon dont le public le voit. Si une personne raisonnable pourrait lier votre acteur IA à un individu réel, vous êtes exposé à une poursuite potentielle.

Qui Est Légèrement Responsable des Affirmations Faites par une IA ?

Vous l’êtes. Toujours. La marque derrière la pub est ultimement responsable de chaque affirmation faite, qu’elle soit prononcée par un humain ou une IA. Si votre acteur IA dit que votre produit est « 50 % plus efficace », vous feriez mieux d’avoir les données pour l’étayer.

Vous ne pouvez pas blâmer une « hallucination IA » – quand le modèle invente des choses – si la FTC frappe à votre porte. Ce n’est pas une défense légale. C’est pourquoi la supervision humaine est non négociable ; chaque fait, chiffre et affirmation doit être vérifié par une vraie personne avant que votre pub ne voie le jour.

Prêt à créer des pubs performantes sans les maux de tête légaux ? ShortGenius vous aide à générer rapidement des campagnes vidéo de style UGC époustouflantes tout en vous donnant le contrôle pour assurer la conformité. Découvrez nos outils et commencez à bâtir des pubs plus sûres et plus efficaces dès aujourd’hui. En savoir plus sur https://shortgenius.com.