คู่มือสำหรับครีเอเตอร์ในการเชี่ยวชาญ Lip Sync AI

ค้นพบว่า Lip Sync AI เปลี่ยนแปลงการสร้างวิดีโออย่างไร เรียนรู้ว่ามันคืออะไร ทำงานอย่างไร และวิธีใช้เพื่อสร้างเนื้อหาพากย์เสียงที่สมบูรณ์แบบสำหรับผู้ชมทั่วโลก

เคยอยากพูดได้ทุกภาษาในวิดีโอของคุณ โดยให้ปากเคลื่อนไหวตรงกับทุกคำอย่างสมบูรณ์แบบ แม้ว่าคุณจะไม่รู้ภาษานั้นเลยหรือ? นั่นคือสิ่งที่ lip-sync AI ทำให้เป็นไปได้ ในแก่นแท้ เทคโนโลยีนี้จะนำแทร็กเสียงแยกต่างหากมา แล้วเคลื่อนไหวปากของบุคคลจริง—or อวตาร—ให้ซิงค์กับเสียงนั้นอย่างสมบูรณ์แบบ

นี่ไม่ใช่แค่ลูกเล่นสนุก ๆ; มันคือก้าวกระโดดครั้งใหญ่ที่ทำให้การสร้างเนื้อหาและการปรับให้เข้ากับท้องถิ่นเข้าถึงได้สำหรับทุกคน

ทำไม Lip Sync AI ถึงสำคัญสำหรับครีเอเตอร์

ลองนึกภาพ lip-sync AI เป็นนักแสดงหุ่นเชิดดิจิทัลสำหรับวิดีโอของคุณ มานานแล้ว การทำให้ริมฝีปากซิงค์กันอย่างสมจริงเป็นสิ่งที่สตูดิโอภาพยนตร์งบประมาณสูงที่มีทีม VFX เฉพาะทางเท่านั้นที่ทำได้ มันหมายถึงการเคลื่อนไหวปากเฟรมต่อเฟรมอย่างละเอียดยิบ ตอนนี้ พลังนั้นอยู่ในมือของครีเอเตอร์ทุกคน และมันกำลังเปลี่ยนแปลงวิธีการสร้างวิดีโอสำหรับแพลตฟอร์มอย่าง YouTube, TikTok และ Instagram อย่างสิ้นเชิง

หน้าที่หลักของ AI นี้คือการลดช่องว่างระหว่างสิ่งที่คุณเห็นและสิ่งที่คุณได้ยิน สร้างประสบการณ์ที่ราบรื่นและน่าเชื่อถืออย่างสมบูรณ์สำหรับผู้ชม ลืมการพากย์เก่า ๆ ที่เสียงไม่ตรงกันแบบน่าหงุดหงิดไปได้เลย เทคโนโลยีนี้ทำให้ปากของผู้พูดเคลื่อนไหวสอดคล้องกับแทร็กเสียงใหม่ได้อย่างสมบูรณ์แบบ ไม่ว่าจะเป็นภาษาอื่น เสียงพากย์ที่บันทึกใหม่ หรือแม้แต่สคริปต์ที่อ่านโดย AI voice

ขยายการเข้าถึงและประหยัดเวลา

ผลกระทบต่อครีเอเตอร์มีมหาศาล คุณไม่ถูกจำกัดด้วยภาษาแม่ของตัวเองอีกต่อไป หรือต้องยุ่งยากกับการถ่ายทำใหม่ที่แพงแสนแพงเพื่อแก้ไขข้อผิดพลาดเสียงเล็กน้อย

เทคโนโลยีนี้มอบพลังให้คุณ:

- ทำลายอุปสรรคภาษา: พากย์วิดีโอของคุณเป็นหลายภาษาทันที คุณสามารถเปิดเนื้อหาให้เข้าถึงผู้ชมระดับนานาชาติจำนวนมากโดยไม่ต้องพูดภาษาสเปน ญี่ปุ่น หรือฮินดีสักคำ

- ขยายเนื้อหาได้อย่างง่ายดาย: ใช้หนึ่งวิดีโอแล้วนำไปปรับใช้สำหรับตลาดโลกต่าง ๆ แค่เปลี่ยนไฟล์เสียง แล้วให้ AI จัดการส่วนที่เหลือ

- ยกระดับคุณภาพโปรดักชัน: สร้าง voiceover ที่ฟังดูโปรสำหรับโฆษณาหรือวิดีโอโซเชียลมีเดีย และทำให้พร็อพหรืออวตารบนหน้าจอดูเป็นธรรมชาติและแท้จริงอย่างสมบูรณ์

นี่ไม่ใช่แค่นวัตกรรมทางเทคนิค; มันคือข้อได้เปรียบเชิงกลยุทธ์ lip-sync AI ช่วยให้ครีเอเตอร์เดี่ยวและทีมเล็กแข่งขันในระดับโลกได้ สร้างเนื้อหาหลายภาษาที่เคยเป็นไปได้เฉพาะบริษัทสื่อใหญ่เท่านั้น

สุดท้าย เครื่องมือนี้คือเรื่องของการทำงานให้ฉลาดขึ้น ไม่ใช่ขยันขึ้น โดยการทำให้งาน post-production ที่เคยหนักหน่วงเป็นอัตโนมัติ มันปล่อยให้คุณโฟกัสกับสิ่งที่คุณถนัด: การคิดไอเดียเจ๋ง ๆ เพื่อเห็นภาพรวมใหญ่ ช่วยให้เข้าใจโลกที่กว้างขึ้นของ การสร้างเนื้อหาด้วย AI และเครื่องมืออย่างนี้กำลังเปลี่ยนอุตสาหกรรมทั้งหมดอย่างไร lip-sync AI คือชิ้นส่วนสำคัญของปริศนานั้น ให้คุณเชื่อมต่อกับผู้คนมากขึ้นในแบบที่แท้จริงยิ่งขึ้น

Lip Sync AI ทำงานอย่างไรจริง ๆ

เคยสงสัยไหมว่าภายใต้ฝากบังของ lip-sync AI มีอะไรเกิดขึ้น? มันไม่ใช่แค่การแสดงหุ่นเชิดดิจิทัลที่ขยับปากขึ้นลง ลองนึกถึงมันเหมือนบริการแปลที่ซับซ้อน แต่แทนที่จะแปลงคำจากภาษาหนึ่งเป็นอีกภาษา มันแปล เสียง เป็นการเคลื่อนไหวใบหน้าที่แม่นยำอย่างน่าทึ่ง

ลองใช้อุปมาอุปマイย์ ถ้าคุณสอนหุ่นยนต์ให้พูด คุณจะไม่แค่แสดงตัวอักษรให้ดู คุณจะสอนว่าตัวอักษรแต่ละตัว ฟังดู อย่างไร lip-sync AI ทำคล้าย ๆ กันโดยแยกแทร็กเสียงของคุณออกเป็นหน่วยเสียงเล็กสุดที่เรียกว่า phonemes เช่น คำว่า "hello" ถูกแยกเป็นเสียงต่าง ๆ อย่าง "h," "eh," "l," และ "ow."

เมื่อ AI ระบุ phonemes เหล่านี้ได้แล้ว มันจะเริ่มงานหลัก: จับคู่แต่ละเสียงกับรูปร่างปากที่แท้จริงที่คนเราทำตอนพูด รูปร่างปากเหล่านี้เรียกว่า visemes AI ได้รับการฝึกจากข้อมูลมหาศาล ดังนั้นมันรู้โดยสัญชาตญาณว่าเสียง "f" หมายถึงฟันบนต้องสัมผัสริมฝีปากล่าง มันคือการแปลจากเสียงเป็นภาพที่รวดเร็วราวฟ้าผ่า

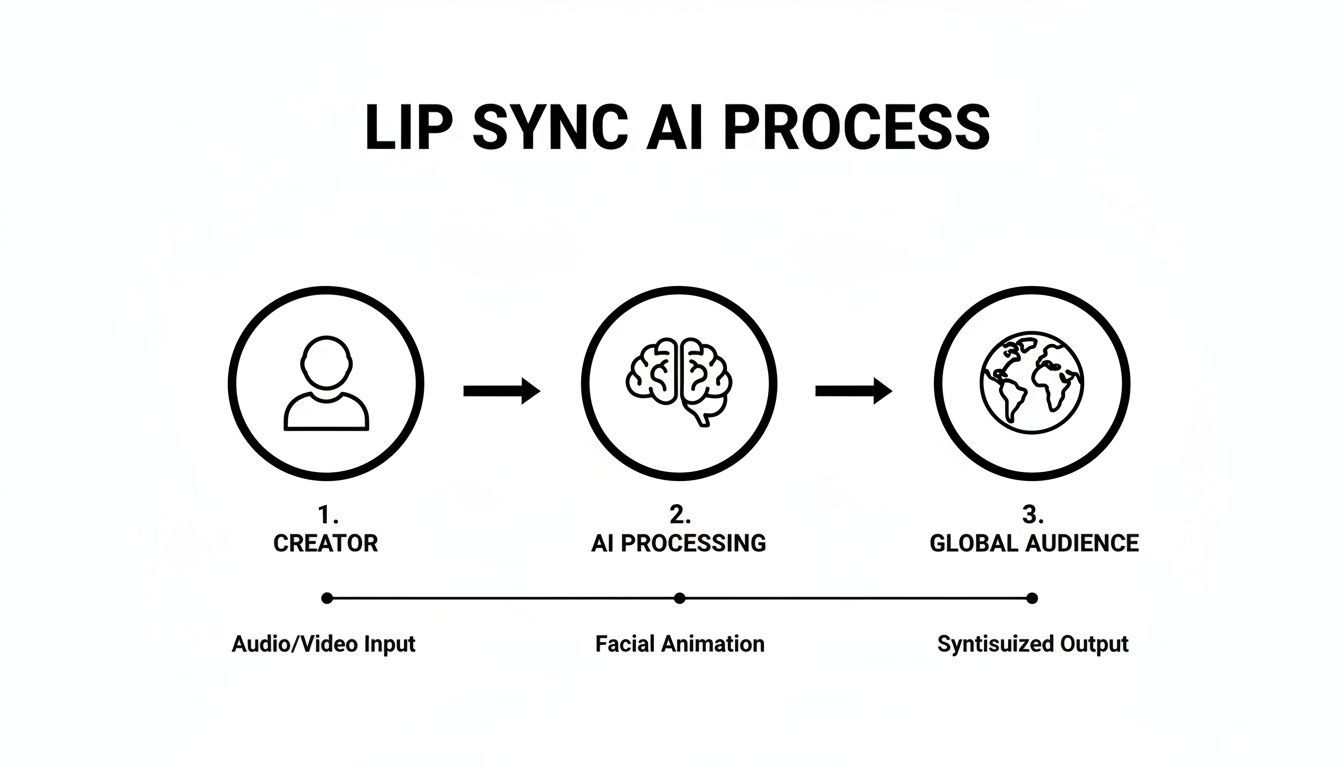

ไดอะแกรมนี้แสดงขั้นตอนที่เนื้อหาไปจากบันทึกง่าย ๆ ของคุณ สู่ วิดีโอพร้อมสำหรับผู้ชมทั่วโลก

อย่างที่เห็น ครีเอเตอร์ให้วัตถุดิบ AI ทำส่วนหนัก และผลลัพธ์คือเนื้อหาที่ขัดเกลาแล้ว เชื่อมต่อกับผู้ชมทุกที่

สองส่วนผสมหลัก

เพื่อสร้างเวทมนตร์ดิจิทัลนี้ AI ต้องการแค่สองสิ่งจากคุณ ความเรียบง่ายนี้คือส่วนสำคัญที่ทำให้เครื่องมืออย่าง ShortGenius มีประโยชน์สำหรับครีเอเตอร์ที่ต้องทำงานเร็ว

- ไฟล์เสียง: นี่คือพิมพ์เขียว อาจเป็น voiceover ที่คุณเพิ่งบันทึก เสียงพากย์โปรสำหรับภาษาใหม่ หรือการบันทึกใด ๆ ของคนพูด ยิ่งเสียงสะอาดยิ่งดี เสียงพูดที่ชัดเจนทำให้ AI มี phonemes ที่ง่ายต่อการจัดการ นำไปสู่ผลลัพธ์ที่แม่นยำและน่าเชื่อถือกว่าเสมอ

- วิดีโอหรืออวตาร: นี่คือผืนผ้าใบ คุณใช้ได้ทั้งวิดีโอคนจริงหรือภาพนิ่งของอวตารที่สร้างโดย AI AI ใช้ฐานภาพนี้เพื่อสร้างและวางทับการเคลื่อนไหวปากใหม่ที่ซิงค์สมบูรณ์แบบ

แต่ алгоритмы deep learning สมัยใหม่ไม่หยุดแค่นั้น พวกมันวิเคราะห์ ความละเอียดอ่อน ในเสียง—โทน อารมณ์ แม้แต่ความเร็วของผู้พูด เพื่อให้แอนิเมชันสุดท้ายดูเป็นธรรมชาติกว่า ในแก่นแท้ lip-sync AI คือความเชี่ยวชาญในการ sync audio video อย่างราบรื่นจนผู้ชมไม่เคยคิดถึงมันเลย

สรุปคือ: ไม่ใช่แค่ขยับริมฝีปาก มันคือการวิเคราะห์เสียงลึกซึ้งที่แปลคำพูดเป็นการแสดงสีหน้าที่สมจริง จับรายละเอียดเล็ก ๆ ที่ทำให้การแสดงดูมนุษย์จริง ๆ

ระดับอัตโนมัตินี้กำลังผลักดันการเติบโตของอุตสาหกรรมอย่างจริงจัง ตลาด lip-sync technology ทั่วโลกคาดว่าจะพุ่งจาก USD 1.12 billion ในปี 2024 เป็น USD 5.76 billion ภายในปี 2034 การที่ machine learning ขับเคลื่อนด้วยเสียงครองส่วนแบ่งตลาด 40.7% แสดงให้เห็นว่าเทคโนโลยีนี้สำคัญแค่ไหนสำหรับการทำให้เนื้อหาไปสู่ระดับโลก

เทคโนโลยีเดียวกันนี้เป็นส่วนผสมหลักในเครื่องมือวิดีโอ AI หลายตัว มันคือสิ่งที่ช่วยให้ครีเอเตอร์เปลี่ยนภาพนิ่งเดียวให้เป็นวิดีโอไดนามิกที่น่าดึงดูด คุณสามารถเจาะลึกวิธีการทำงานได้จากคู่มือของเราว่า เปลี่ยนภาพเป็นวิดีโอด้วย AI

การประยุกต์ใช้จริงสำหรับครีเอเตอร์และนักการตลาด

การรู้รายละเอียดทางเทคนิคของ lip sync AI เป็นเรื่องหนึ่ง แต่เวทมนตร์จริงเกิดขึ้นเมื่อคุณเห็นว่ามันเปิดประตูใหม่ทางสร้างสรรค์และธุรกิจอย่างไร สำหรับครีเอเตอร์และนักการตลาด นี่ไม่ใช่แค่นวัตกรรม; มันคือเครื่องมือจริงจังสำหรับการขยายเนื้อหา เข้าถึงตลาดใหม่ และเชื่อมต่อกับผู้ชมทั่วโลกอย่างแท้จริง

กรณีใช้งานที่ชัดเจนและทรงพลังที่สุดคือ content localization สมมติว่าคุณมี TikTok ที่กำลังไวรัลหรือ tutorial บน YouTube ที่คุณทุ่มเทหัวใจ แทนที่จะจำกัดแค่ผู้พูดภาษาอังกฤษ คุณสามารถสร้างเวอร์ชันสำหรับผู้ชมสเปน ฮินดี หรือญี่ปุ่นได้ทันที AI ไม่ใช่แค่ติดเสียงใหม่—มันเคลื่อนไหวริมฝีปากให้ตรงกับภาษาใหม่ ทำให้วิดีโอสุดท้ายดูเป็นธรรมชาติอย่างสมบูรณ์

นี่คือการเขียน playbook ใหม่สำหรับการขยายตัวระดับโลก วิธีเก่าของการ localize วิดีโอแคมเปญคือจ้างนักพากย์แต่ละภาษา จองสตูดิโอแพง ๆ และลุย post-production สัปดาห์หรือเดือน ตอนนี้ workflow ทั้งหมดเร็วกว่าและถูกกว่ามาก

จากโฆษณาระดับโลกสู่ AI Avatars

นอกจากการแปลวิดีโอ lip-sync AI ยังปลดล็อกกลยุทธ์หลากหลายสำหรับสร้างแบรนด์และโฆษณาน่าดึงดูด ในแก่นแท้ ทุกการประยุกต์ใช้ใช้ประโยชน์จากการแยก สิ่งที่พูด จาก รูปลักษณ์ขณะพูด

นี่คือวิธีปฏิวัติที่เทคโนโลยีนี้ถูกใช้ในตอนนี้:

- สร้าง AI Avatars ที่น่าดึงดูด: คุณนำภาพเดียว—ของมาสคอต ผู้ก่อตั้ง หรือ influencer เสมือน—มาชุบชีวิต แค่ป้อน text-to-speech voiceover คุณมีเนื้อหาโซเชียลมีเดียไม่สิ้นสุดโดยไม่ต้องให้ใครมาถ่ายหน้ากล้อง

- Localizing แคมเปญโฆษณา: แบรนด์สร้างโฆษณาเจ๋ง ๆ งบสูงตัวเดียว แล้วใช้ AI ปรับสำหรับตลาดนานาชาติหลายสิบแห่ง รักษา branding ให้สอดคล้องแต่ทำให้ข้อความดู local และ personal วิธีนี้ช่วยชีวิตสำหรับแพลตฟอร์มโฆษณาที่ต้องการครีเอทีฟใหม่ ๆ สม่ำเสมอ คุณเห็นว่ามันทำงานอย่างไรในกลยุทธ์กว้าง ๆ จากคู่มือสร้าง effective AI UGC-style ads

- แก้ไขเสียงอย่างง่ายดาย: เราเคยเจอหมด สิ้นสุดการตัดต่อวิดีโอเพอร์เฟกต์ แต่สังเกตข้อผิดพลาดใน voiceover แทนที่จะถ่ายใหม่น่าหงุดหงิด แค่บันทึกบรรทัดที่แก้แล้วให้ AI เย็บเข้าไปอย่างราบรื่น ตรงริมฝีปากเป๊ะ

พลังจริงอยู่ที่ decoupling ภาพจากเสียง นี่ให้ครีเอเตอร์ความยืดหยุ่นมหาศาลในการทดลอง แก้ไขข้อผิด และปรับเนื้อหาสำหรับแพลตฟอร์มและผู้ชมต่าง ๆ โดยไม่ต้องเริ่มจากศูนย์ทุกครั้ง

เพื่อแสดงว่าไอเดียเหล่านี้ทำงานอย่างไร นี่คือสรุปสั้น ๆ ว่าครีเอเตอร์และแบรนด์ใช้ lip-sync AI อย่างไร

การประยุกต์ใช้ Lip Sync AI สำหรับครีเอเตอร์และแบรนด์

| Use Case | Primary Benefit | Example Application |

|---|---|---|

| การกระจายเนื้อหาระดับโลก | การเติบโตของผู้ชม | YouTuber แปลวิดีโอทำผลงานดีที่สุดเป็น 5 ภาษาใหม่เพื่อเข้าถึงผู้ชมทั่วโลก เพิ่มโอกาสยอดวิวสามเท่า |

| แคมเปญโฆษณาหลายภาษา | เพิ่ม ROI | แบรนด์ D2C สร้างเวอร์ชัน localize 10 ตัวจากโฆษณาตัวเดียวสำหรับประเทศต่าง ๆ ปรับปรุงความเกี่ยวข้องและอัตราการแปลง |

| AI Influencers & Avatars | การขยายเนื้อหา | บริษัทใช้มาสคอตแอนิเมชันสร้างอัปเดตโซเชียลเดลี่โดยไม่ต้องมีทีมวิดีโอทุกโพสต์ |

| แก้ไข Post-Production | ประหยัดเวลาและต้นทุน | ผู้กำกับภาพยนตร์แก้บรรทัดที่พูดผิดในฉากสำคัญโดยไม่ต้องถ่ายใหม่ ประหยัดเงินหลายพันดอลลาร์ |

นี่ไม่ใช่การปรับปรุงเล็กน้อย—มันคือการเปลี่ยนแปลงพื้นฐานในวิธีสร้างวิดีโอ

ตลาด AI video dubbing มีมูลค่า $31.5 million ในปี 2024 และคาดว่าจะพุ่งสู่ $397 million ภายในปี 2032 การเติบโตระเบิดนี้มาจากเวลและเงินที่ประหยัดได้ แคมเปญหลายภาษาที่เคยต้องใช้งบใหญ่และเดือน ๆ สามารถทำเสร็จในน้อยกว่าสัปดาห์ด้วยเงินต่ำกว่า $2,000 วางการเข้าถึงระดับโลกไว้ในมือครีเอเตอร์เดี่ยว คุณเรียนรู้เพิ่มเติมเกี่ยวกับ evolving economics of AI lip sync technology และเห็นว่ามันเปลี่ยน creator economy ทั้งหมดอย่างไร

วิธีเลือกเครื่องมือ Lip Sync AI ที่เหมาะสม

ด้วยเครื่องมือใหม่ ๆ ท่วมตลาด การเลือก lip sync AI ที่ใช้อาจรู้สึกเหมือนยิงในที่มืด แต่ไม่ใช่ทุกแพลตฟอร์มเท่ากัน และการเลือกผิดอาจให้วิดีโอหุ่นยนต์ดูแปลก ๆ ที่ไล่ผู้ชมแทนที่จะดึงดูด คุณต้องการ checklist ง่าย ๆ เพื่อกรองการตลาดลวง

ปัจจัยอันดับหนึ่งคือคุณภาพของ sync เอง วิดีโอสุดท้ายดูเป็นธรรมชาติมั้ย หรือตกสู่ "uncanny valley" ที่น่าขนลุก? เครื่องมือดีเข้าใจการเคลื่อนไหวเล็ก ๆ ละเอียดของปากจริง—วิธีที่มันก่อตัวรอบเสียงต่าง ๆ และเชื่อมกับสีหน้าผู้พูด

AI ถูกหรือฝึกไม่ดีอาจแค่กระพือปากเปิดปิด ซึ่งบอกได้ทันทีว่า fake วิธีตัดสินที่ดีที่สุดคือเอา audio clip สั้น ๆ เดียวกันรันผ่านเครื่องมือต่าง ๆ วางผลลัพธ์ข้าง ๆ แล้วเชื่อสัญชาตญาณ

ประเมินคุณสมบัติหลักและประสิทธิภาพ

นอกจากความสมจริงล้วน ๆ คุณต้องคิดถึงความต้องการสร้างสรรค์เฉพาะ เครื่องมือเพอร์เฟกต์สำหรับ trainer บริษัทหลายภาษาอาจเกินไปสำหรับ meme creator การประเมินที่แม่นยำตั้งแต่แรกจะประหยัดปัญหาในภายหลัง

นี่คือสิ่งสำคัญที่ต้องมองหา:

- รองรับภาษาและสำเนียง: เป็น deal-breaker ถ้าคุณอยากเข้าถึงผู้ชมโลก ตรวจว่าคุณสมบัติรองรับกี่ภาษา และสำคัญไม่แพ้กันคือจัดการสำเนียงและ dialect ดีแค่ไหน เครื่องมือที่จับสำเนียง Glaswegian ได้น่าประทับใจกว่าแบบที่ใช้แค่น้ำเสียงหุ่นยนต์ทั่วไป

- ความเร็วประมวลผล: clip หนึ่งนาทีต้องรอ progress bar นานแค่ไหน? ในโลก short-form content ความเร็วคือทุกอย่าง บางแพลตฟอร์มทำเสร็จในนาที ขณะที่บางอันให้รอเหมือนนิรันดร์

- ใช้งานง่าย: เครื่องมือที่มีฟีเจอร์ล้านตัวไร้ค่า ถ้า interface น่าหงุดหงิด มองหาการออกแบบสะอาดเรียบง่ายที่อัปโหลดวิดีโอและเสียง แล้ว apply lip sync แค่ไม่กี่คลิก แพลตฟอร์มอย่าง ShortGenius มุ่งทำให้ขั้นตอนนี้เป็นส่วนไร้รอยต่อของ video creation pipeline ที่ใหญ่กว่า

เป้าหมายสูงสุดคือหา solution ที่เข้ากับกระบวนการปัจจุบันโดยไม่สร้าง bottleneck ใหม่ เครื่องมือที่ถูกต้องควรรู้สึกเหมือน extension ของ toolkit สร้างสรรค์ ไม่ใช่ซอฟต์แวร์ซับซ้อนที่ต้องเรียนรู้ใหม่

พิจารณาการรวมและเทรนด์ตลาด

สุดท้าย คิดภาพใหญ่ lip-sync AI นี้เข้ากับ workflow ของคุณอย่างไร? เข้ากันได้กับ video editor ที่คุณรักมั้ย? จัดการ format และ resolution ที่ต้องการได้? การรวมที่ราบรื่นสำคัญเท่าประสิทธิภาพทางเทคนิค

การเติบโตระเบิดในสเปซนี้บอกทุกอย่าง ตลาด AI ในสื่อที่รวม lip-sync tech คาดว่าจะพองตัวจาก USD 8.21 billion ในปี 2024 เป็น USD 51.08 billion ภายในปี 2030 การขยายตัวรวดเร็วแบบนี้หมายถึง audio-visual AI ที่ซับซ้อนกำลังกลายเป็น core ของ content strategy สมัยใหม่ คุณได้รายละเอียดเพิ่มจาก the AI media market on datainsightsmarket.com

โดยเลือกเครื่องมือที่ได้รับการสนับสนุนดีและพัฒนาต่อเนื่อง คุณไม่ใช่แค่แก้ปัญหาวันนี้—แต่ลงทุนในความสามารถสร้างเนื้อหาเจ๋ง ๆ ยาวนานหลายปี

คู่มือทีละขั้นตอนสำหรับวิดีโอ Lip Sync แรกของคุณ

เอาล่ะ ลงมือทำกันเลย การทำวิดีโอแรกด้วย lip sync AI ไม่ซับซ้อนอย่างที่คิด เราสามารถแยกเป็นกระบวนการสี่ขั้นตอนง่าย ๆ จากไอเดียหยาบ ๆ สู่ วิดีโอพร้อมแชร์

นี่คือ workflow พื้นฐานที่คุณพบในแพลตฟอร์มอย่าง ShortGenius ที่วางเทคโนโลยีทรงพลังนี้ไว้ใกล้มือคุณ

ขั้นตอน 1: เตรียมแทร็กเสียง

ทุกอย่างเริ่มจากเสียง คิดถึงมันเป็นพิมพ์เขียวสำหรับวิดีโอ—AI ต้องการแทร็กสะอาดชัดเพื่อหาว่าต้องสร้างรูปร่างปากไหน คุณบันทึกเสียงตัวเองหรือใช้ text-to-speech generator คุณภาพสูงสำหรับ narration ที่ชัดเจนสม่ำเสมอ

เพื่อผลลัพธ์ที่ดีที่สุด ให้แน่ใจว่าเสียงมี noise พื้นหลังน้อย พูดชัดเจนช่วยได้มาก ยิ่งคำพูดแยกจากกันชัด AI จับคู่ lip movements ได้ดีขึ้น การทำให้ขั้นตอนแรกถูกต้องตั้งแต่แรกเซ็ตอัพคุณให้ผลลัพธ์น่าเชื่อถือกว่า

ขั้นตอน 2: เลือกวิดีโอหรืออวตาร

ถัดมา คุณต้องเลือกใคร (หรืออะไร) จะพูด นี่อาจเป็น clip วิดีโอที่มีคนพูดอยู่แล้วหรือภาพนิ่งของ AI avatar ที่คุณสร้าง คีย์คือภาพหน้าชัด ๆ

เคล็ดลับโปร: มุมตรง หน้าเต็มทำงานดีที่สุด AI ต้องการมุมมองตรงไม่บังของปากเพื่อสร้างการเคลื่อนไหวสมจริง ถ้าหน้าหันข้างหรือมีอะไรบัง แอนิเมชันสุดท้ายจะดูเพี้ยนนิด ๆ

คุณภาพ input กำหนดคุณภาพ output โดยตรง วิดีโอคมชัด แสงดี และเสียงสะอาดให้วัตถุดิบที่ดีที่สุดแก่ AI ลดข้อผิดพลาดและให้ผลลัพธ์สมจริงกว่า

ขั้นตอน 3: ใช้ Lip Sync AI

นี่คือจุดที่สนุกจริงเริ่ม และมักแค่คลิกปุ่ม พออัปโหลดไฟล์เสียงและวิดีโอสู่เครื่องมือ แค่ apply ฟีเจอร์ lip sync AI จะเริ่มงาน แยกเสียงใน audio และสร้าง mouth movements ใหม่บน subject วิดีโอให้ตรงกัน

กระบวนการทั้งหมดเร็วกว่าที่คิด มักใช้แค่นาทีไม่กี่นาที ขณะที่ AI ทำงานหนัก คุณเตรียมขั้นตอนสุดท้ายที่สำคัญที่สุด

ขั้นตอน 4: ทบทวนและปรับแต่งผลลัพธ์

ไม่มี AI ไหนเพอร์เฟกต์ทุกครั้ง ดังนั้นการตรวจสุดท้ายสำคัญ ดูวิดีโอที่สร้างและโฟกัส timing Sync ดูเป็นธรรมชาติมั้ย? มี twitches แปลกหรือช่วงที่ริมฝีปากไม่ตรงเสียงมั้ย?

เครื่องมือดี ๆ ส่วนใหญ่ให้ตัวเลือกปรับเล็ก ๆ บางทีแค่นิด timing เสียงหรือรันส่วนนั้นใหม่ช่วยให้เรียบ เสร็จแล้วพอใจ วิดีโอพร้อม export กระบวนการทั้งหมดนี้เป็น core ของ AI video workflows หลายตัว และคุณเห็นว่ามันเข้ากับภาพใหญ่จากคู่มือ text-to-video AI models

มีคำถามเกี่ยวกับ Lip Sync AI มั้ย? เรามีคำตอบ

การเริ่มเทคโนโลยีใหม่มักมีคำถาม นั่นปกติ ลองตอบคำถามยอดฮิตที่ผมได้ยินจากครีเอเตอร์เกี่ยวกับ lip sync AI เพื่อให้คุณเริ่มสร้างเนื้อหาเจ๋ง ๆ ได้ตรง ๆ

Lip Sync AI จัดการภาษาต่าง ๆ อย่างไร?

นี่คือคำถามใหญ่ ข่าวดีคือโมเดล AI ชั้นนำส่วนใหญ่ฝึกจาก dataset ยักษ์ใหญ่ที่มีชั่วโมงนับไม่ถ้วนของ multilingual speech ทำให้เก่งจัดการไม่ใช่แค่ภาษาต่าง แต่สำเนียงต่างด้วย ไม่ใช่แค่คำ; มันเรียนรูปร่างปากเฉพาะ—คำศัพท์เทคนิคคือ visemes—ที่ตรงกับเสียงเฉพาะ

แน่นอน ไม่ใช่ทุกเครื่องมือเท่ากัน ประสิทธิภาพแตกต่างจริง ซึ่งเป็นเหตุผลที่ผมแนะนำรัน test clip สั้นในภาษาเป้าหมายก่อนคอมมิทโปรเจกต์ใหญ่ ระบบที่ดีที่สุดจะจับ nuance ละเอียด ทำให้ผู้พูดดูเหมือน native แทนการใช้ mouth movement ทั่วไปที่ "one-size-fits-all" ดูเพี้ยน

ความแตกต่างระหว่าง Lip Sync กับ Dubbing คืออะไร?

ง่ายที่จะสับสนทั้งสอง แต่จริง ๆ มันสองด้านของเหรียญเดียวกัน ทำงานร่วมเพื่อให้วิดีโอรู้สึกแท้จริงในภาษาใหม่

ลองคิดแบบนี้:

- Video Dubbing: ทุกอย่างเกี่ยวกับ เสียง คือกระบวนการเปลี่ยน voice track ต้นฉบับเป็นอันใหม่ มักในภาษาอื่น

- Lip Sync: คือ ภาพ follow-up พอวางเสียงใหม่ AI เริ่มงาน เปลี่ยน mouth movements ของผู้พูดให้ตรง dialogue ใหม่เป๊ะ

พอรวมกัน คุณได้วิดีโอ localize สมบูรณ์ เสียงถูก ภาพตรง ตัวหนึ่งจัดการสิ่งที่ได้ยิน อีกตัวจัดการสิ่งที่เห็น

one-two punch นี้คือสิ่งที่ช่วยให้ครีเอเตอร์นำวิดีโอตัวเดียวทำให้รู้สึก native สำหรับผู้ชมทั่วโลก โดยไร้ความรู้สึก out-of-sync ที่ดึงผู้ชมออกจากประสบการณ์ทันที

ฉันหลีกเลี่ยง "Uncanny Valley" ที่น่าขนลุกได้อย่างไร?

อ้อ "uncanny valley" ความรู้สึกแปลก ๆ ไม่สบายใจเมื่ออะไรดู เกือบ มนุษย์ แต่รายละเอียดเล็ก ๆ เพี้ยนนิดเดียว มันคือความกังวลจริงกับ lip sync AI แต่คุณหลีกเลี่ยงได้แน่นอน

ก่อนอื่น เริ่มด้วย source material คุณภาพสูง เสมอ วิดีโอ crisp แสงดีหรืออวตารขัดเกลาให้ AI มีผืนผ้าใบสะอาด ถ้าให้ footage เบลอหรือ low-res คุณแทบขอให้ผลแปลกเอง

ถัดมา โฟกัสคุณภาพเสียง ใช้ AI voice คุณภาพสูงที่ฟังดูเป็นธรรมชาติ หรือดีกว่านั้นคือบันทึกสะอาดจากนักพากย์มนุษย์ เสียงหุ่นยนต์แบน ๆ คู่กับ lip movements สมจริงคือสูตร creepy ทันที

สุดท้าย จำ เพิ่ม human touches ละเอียด ฉาก AI-generated อาจดู sterile เอง การเพิ่ม head movements ธรรมชาติ blinking สมจริง หรือแค่ background น่าสนใจช่วยให้วิดีโอทั้งหมด grounded และมีชีวิตชีวา ดึงออกจาก uncanny valley ทันที

พร้อมสร้างวิดีโอสวย ๆ หลายภาษาโดยไร้ความยุ่งยากหรือ? ShortGenius รวม lip sync AI ทรงพลังเข้า workflow สร้างวิดีโอสมบูรณ์ สร้างโฆษณาโปรและเนื้อหาโซเชียลในนาที เริ่มสร้างฟรีที่ shortgenius.com