Lås upp slående kvalitet: Upskala video AI

Lär dig ett praktiskt arbetsflöde för att upskala video med AI. Inklusive förberedelse av material, optimala inställningar, batchbearbetning och export till sociala medier med ShortGenius.

Du har en klipp som borde fungera.

Kanske är det en gammal kundrecension inspelad med en telefon. Kanske är det användargenererat material som träffar känslan perfekt men ser suddigt ut på en modern skärm. Kanske är det en tidigare topprekommendation du vill återpublicera, beskära och förvandla till fräscha short-form-innehåll. Idén är stark. Källfilen är det inte.

Det är här upscale video ai slutar vara en nyhet och börjar bli ett produktionsverktyg.

Bra AI-uppskalning kan rädda material du annars skulle slänga. Dålig AI-uppskalning slösar timmar, förstärker kompressionsbrus och ger ansikten det där plastiga, överkokta utseendet som tittarna märker direkt. Skillnaden beror på arbetsflödet. Källkvalitet, modellval, batchhantering och exportbeslut betyder mer än marknadsföringslöften på ett verktygs hemsida.

Varför AI-videoupskalning är en creators superkraft

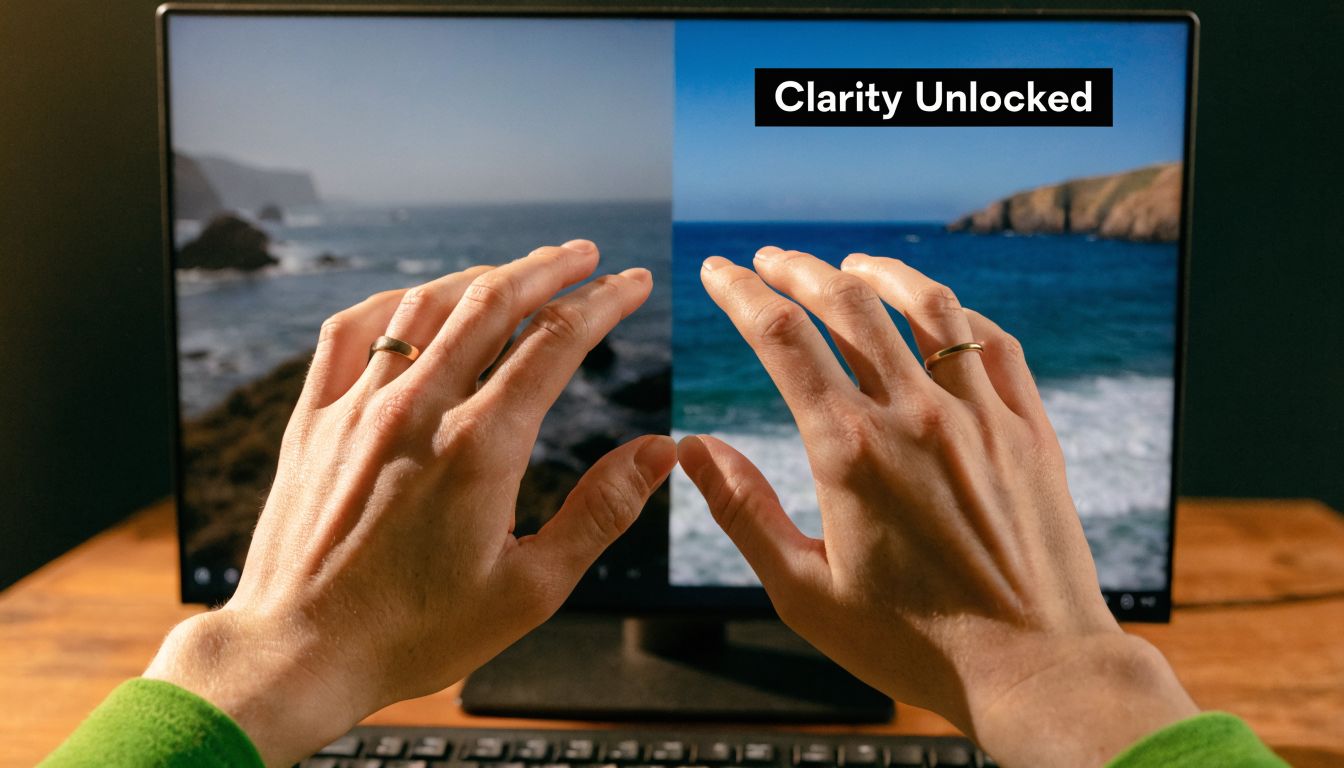

Låglösningsmaterial brukade ha ett hårt tak. Du kunde förstora det, men du kunde inte verkligen förbättra det. Traditionell skalning sträckte pixlar. Det gjorde klipp större, inte bättre.

AI video upscaling fungerar annorlunda. Det använder djupinlärning för att rekonstruera detaljer, tolka omgivande pixlar och bevara rörelse över frames. Den sista delen är viktig. En enskild bild kan se skarp ut och ändå misslyckas som video om kanter skimrar eller texturer flimrar från frame till frame.

Varför creators bryr sig nu

Det här är inte längre en nischad återställningsknep. AI Video Upscaling Software-marknaden växte från 550 miljoner USD 2024 till 670 miljoner USD 2025, och förväntas nå 5 miljarder USD år 2035, med en 22,3 % CAGR, drivet av efterfrågan på 4K-leverans och starkare visuell kvalitet för engagemang, enligt Wise Guy Reports on the AI video upscaling software market.

Det stämmer med vad creators hanterar varje vecka:

- Gammalt material har fortfarande värde: Tidigare intervjuer, webinars, demos och recensioner innehåller ofta idéer värda att återpublicera.

- UGC fångas sällan perfekt: Bra hooks kommer från ofullkomliga klipp.

- Alla plattformar straffar suddighet: Beskärning, ominstallning och rekomprimering av svagt material gör bristerna mer uppenbara.

Praktisk regel: Använd AI-uppskalning för att återställa starkt innehåll. Räkna inte med att det räddar svag kamerateknik, missad fokus eller kraftig rörelseoskärpa.

Det finns också en bredare workflow-vinkel. Om du redan förvandlar ett asset till många, blir uppskalning en del av ompacketering, inte bara reparation. Det är därför det passar naturligt bredvid AI content repurposing. En enda låglösningskälla kan bli shorts, fyrkantiga klipp och förfriskade reposts om du rengör källan innan du installer och distribuerar den.

Vad det är bäst på

AI-uppskalning lyser i några specifika situationer:

| Användningsfall | Varför det fungerar |

|---|---|

| Arkivklipp | Det kan återställa klarhet utan att manuellt bygga om varje shot |

| Skärminspelningar | Det hjälper textkanter och UI-element att överleva komprimering bättre |

| UGC för annonser | Det höjer baslinjenivån innan captions, branding och exports |

| Beskurna sociala klipp | Extra resolutionsmarginal hjälper när du förvandlar en master till flera format |

Om du behöver en snabb repetition på vad högre resolutionsleverans betyder i praktiken, är den här nedbrytningen av https://shortgenius.com/blog/what-is-4-k-resolution användbar innan du bestämmer om ett klipp förtjänar en 4K-finish.

Förbereda källmaterial för felfri uppskalning

Det största misstaget med upscale video ai är att mata in den sämsta filen du har och hoppas att modellen gör magi.

Det gör den inte.

Marknaden rör sig snabbt. Den bredare Video Enhancing AI Tool-marknaden förväntas nå 1 166 miljoner USD år 2032, med en 37,1 % CAGR, driven av djupinlärningssystem som levererar omedelbara 2x till 4x resolutionsboosts samtidigt som bandbredd minskas, enligt Intel Market Research on the video enhancing AI tool market. Men bättre modeller ogiltigförklarar inte dåliga inputs.

Granska klippet innan du bearbetar det

Innan jag köar något kollar jag om klippet är en bra kandidat eller en fälla.

Använd den här korta granskningen:

- Kompressionsskador: Om du ser macroblocking, mosquito noise eller utsmetad detalj kan modellen behandla den skadan som äkta textur.

- Rörelseoskärpa: AI kan skärpa kanter, men det kan inte återställa detaljer som aldrig fanns i framen.

- Fokus: Lätt suddigt kan fungera. Missat fokus förblir vanligtvis missat.

- Framestabilitet: Skakiga klipp är svårare att uppskalna rent, särskilt om bakgrunden redan faller isär.

- Filsläkt: Exportera från den närmaste originalet du kan hitta. Upskala inte en fil som redan komprimerats flera gånger.

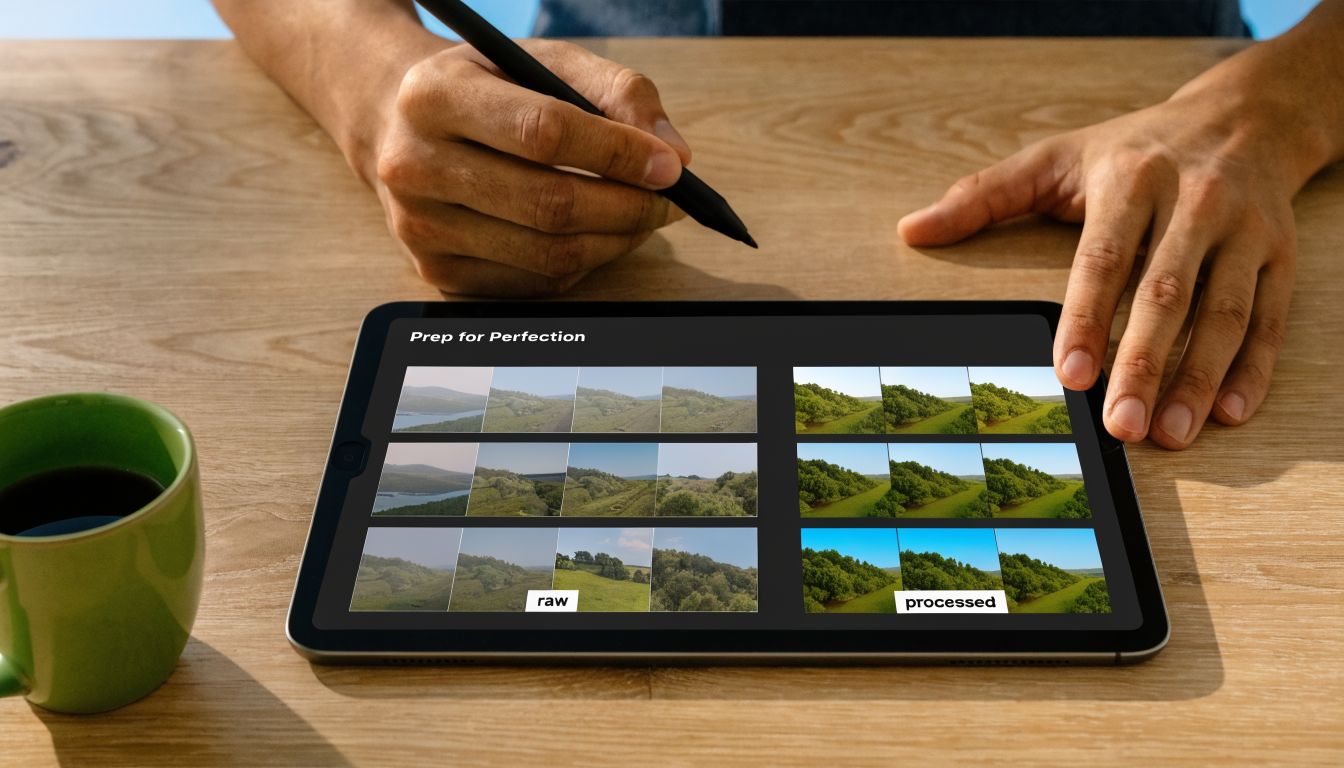

Välj rätt källa, inte bara den största källan

Creators jagar ofta resolution först. Det är bakvänt.

En renare 720p-master kan prestera bättre än en sliten 1080p-repost. Det som betyder något är om källan bevarar äkta bildinformation. Om du har alternativ, välj filen med minst rekomprimering och minst inbakade redigeringar.

Om källan redan ser brusig, krispig och instabil ut i native-storlek gör uppskalning vanligtvis problemen lättare att se.

Vad du ska fixa innan uppskalning

Lite förberedelse sparar massor av rerenders.

-

Beskär klippet först

Bearbeta inte död luft, falska starter eller alternativa takes om du inte ska använda dem. -

Separera materialtyper

Talking head, gameplay, animation och skärminspelning beter sig olika. Köra inte dem i batch under samma preset. -

Hantera uppenbar rengöring tidigt

Om filen behöver grundläggande denoise eller deinterlacing, gör det innan din upscale-pass. -

Kör ett kort sample

Ta ett krävande ögonblick från klippet. Snabb handrörelse, hår-detalj, kamerarörelse, fin text. Om samplet misslyckas förbättras inte fulla renderingen senare.

Dåliga kandidater för AI-uppskalning

Vissa klipp är inte värda compute.

- Starkt filtrerade sociala nedladdningar

- Små repostade memes

- Material med allvarlig low-light-uppdelning

- Klipp där ansikten redan är förvrängda av komprimering

Det låter strikt, men det skyddar din tid. Det bästa arbetsflödet börjar med urval, inte mjukvaruinställningar.

Välja rätt AI-modell och inställningar

De flesta misslyckade uppskalningar kommer från samma vana. Folk laddar ett klipp, väljer högsta output, trycker sharpening för långt och antar att mer bearbetning betyder mer kvalitet.

Det gör det inte.

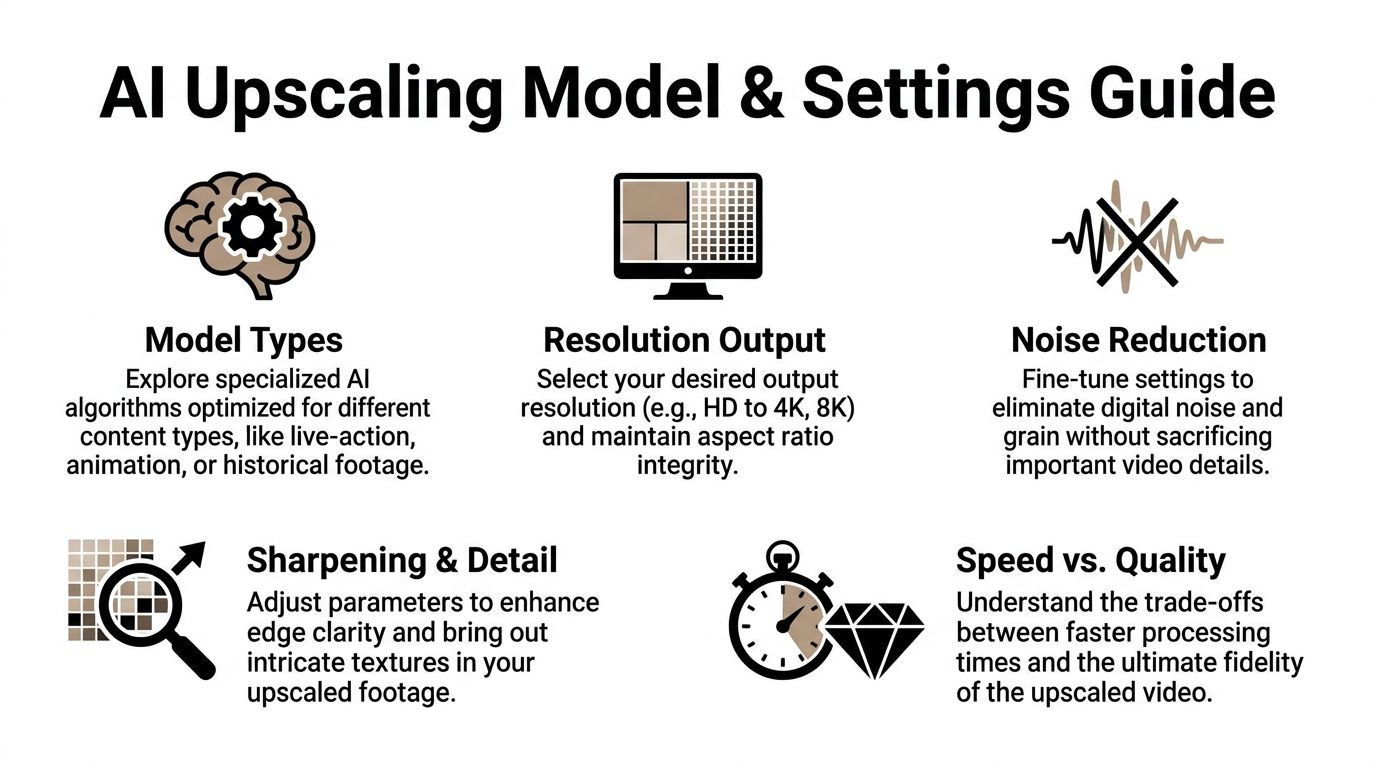

Olika modeller gör olika avvägningar. Vissa bevarar realism. Vissa hittar på mer textur. Vissa fungerar bra på animation och kämpar med hud. Vissa är stabila över rörelse. Andra producerar imponerande stillframes och fula temporala artefakter.

En användbar benchmark ligger bakom allt detta. I AI-uppskalning kan djupinlärningsmodeller som basicVSR++ uppnå över 13 % högre VMAF-poäng än traditionell Lanczos vid uppskalning från 540p till 1080p, med PSNR-förbättringar på 2-4 dB, men hårdvarubegränsningar på konsument-GPU:er kan orsaka 50 %+ felprocent för 4K-klipp längre än 2 minuter på grund av VRAM-brist, enligt At Scale Conference coverage of on-device video playback upsampling.

Modellval börjar med materialtyp

Ett enkelt sätt att tänka på modeller:

| Materialtyp | Vad du ska prioritera | Vanligt misslyckande |

|---|---|---|

| Live action | Naturlig hud, stabil rörelse, återhållsam sharpening | Vaxartade ansikten |

| Animation | Rena linjer, kantkonsistens | Haloing runt konturer |

| Gameplay | Rörelsehantering, text/UI-klarhet | Ghosting i snabba scener |

| Arkivmaterial | Konservativ rekonstruktion | Falsk textur som ändrar originalutseendet |

Om ett verktyg erbjuder flera modellfamiljer, använd inte en universell preset. Det är så du får oversharpenade intervjuer och lerig animation i samma projektmapp.

För redigerare som jämför verktyg och workflows innan de commitar till en stack hjälper den här sammanställningen av https://shortgenius.com/blog/basta-ai-videoredigeringsprogramvara att rama in var uppskalning passar i en större edit-pipeline.

De inställningar som betyder mest

Många UI-etiketter låter tekniska men beter sig på förutsägbara sätt.

Denoise

Använd denoise när källan har synligt brus som modellen misstar för detalj. Använd mindre än du tror du behöver.

För mycket denoise stripppar textur från hud, tyg och bakgrunder. Då försöker sharpening bygga falsk krispighet ovanpå en platt bild.

Deblock

Deblock hjälper när du hanterar kompressionsskador. Det kan släta ut fula blockkanter innan upscale-modellen förstärker dem.

Detta är användbart på nedladdade klipp och gamla exports. Det är farligt på material som redan är rent eftersom det kan mjuka upp kanter du ville bevara.

Sharpen

Sharpen är där renderingen ofta förstörs.

Lite sharpening kan återställa kantdefinition. För mycket skapar halos, sprött hår och det syntetiska ”AI-förbättrade” utseendet. Om ett sample ser imponerande ut på paus men fult i rörelse är sharpening ofta boven.

Rätt sharpen-inställning ska försvinna in i den färdiga videon. Om tittarna kan känna bearbetningen är det vanligtvis för aggressivt.

Resolutionsstrategi slår brute force

Att gå rakt på 4K är ofta fel drag. För socialt innehåll kan 1080p eller en modest steg upp se renare ut än en större fil med påhittad detalj.

Här är den praktiska jämförelsen:

| Tillvägagångssätt | Fördel | Nackdel |

|---|---|---|

| Direkt hopp till 4K | Maximal output-storlek | Mer hallucinerad detalj, tyngre renders |

| Steg upp till 1080p först | Bättre kontroll, enklare QA | Extra besluts Punkt |

| Måttlig upscale endast | Snabbare, säkrare för social leverans | Mindre dramatisk före-och-efter |

Den mellersta vägen vinner förvånansvärt ofta. Du behåller kontroll över textur och rörelse, och undviker att spendera hela natten på att rendra en fil som ändå komprimeras hårt vid upload.

En snabb visuell genomgång hjälper när du finjusterar detta:

Lokal vs molnbaserad bearbetning

Detta val handlar mindre om ideologi och mer om begränsningar.

Lokal bearbetning ger dig kontroll. Den binder också upp din maskin och exponerar GPU-begränsningar snabbt.

Molnbaserad bearbetning tar bort hårdvaruflaskhalsen, men du byter bort lite kontroll över timing, kostnadsstruktur och ibland fina inställningar beroende på plattform.

Välj lokal när:

- Du behöver upprepningsbara presets på en känd maskin

- Du testar intensivt

- Du vill ha direkt översyn av varje pass

Välj moln när:

- Din GPU misslyckas på längre klipp

- Du behöver teamåtkomst

- Du hellre vill fortsätta redigera medan renders sker någon annanstans

Bygg presets, sedan misstro dem

Presets sparar tid. Blind tillit förstör kvalitet.

Håll några startpresets per innehållstyp, testa sedan varje ny källa med ett kort segment innan du kör full render. En preset för rent talking-head-material. En annan för rough UGC. En annan för animation eller skärminspelningar.

Den disciplinen betyder mer än mjukvarumärkets namn.

Bemästra ditt batch-uppskalningsworkflow

Att uppskalna ett klipp är ett experiment. Att uppskalna tjugo klipp är operationer.

Många creators förlorar tid ofta. De behandlar varje fil som ett custom-jobb, babysittar exports och kör om misslyckade renders för att inget organiserades från början. Ett batch-workflow fixar det.

Enligt Audials guidance on beginner mistakes in AI video upscaling rekommenderar experter att börja med högkvalitativt, minimalt komprimerat video och testa inkrementella resolutionshopp som 720p till 1080p innan 4K för att undvika onaturliga resultat och 4x längre rendertider. Samma vägledning noterar att aggressiva modeller kan producera 20-30 % artefakthastighet i rörelsetunga scener, som sjunker till mindre än 5 % med rätt workflow.

Ett lokalt overnight-workflow

För desktop-verktyg är den säkraste setupen tråkig med flit.

-

Skapa tre mappar

Användsource,test-rendersochfinal-upscaled. Håll dem separata. -

Byt namn på klipp innan kö

Lägg till plattform- eller projekt-taggar i filnamn så du snabbt kan spåra misslyckanden. -

Gruppera efter materialbeteende

Blanda inte skakig UGC med polerat studiomaterial i samma batch-preset. -

Kör ett stress-test per grupp

Välj det svåraste klippet i varje kategori. Snabb rörelse, hår, text, folkmassashots. Om det fungerar följer lättare klipp vanligtvis. -

Kör fulla jobb overnight

Låt maskinen rendra när du inte redigerar.

Ett moln-batch-workflow

Moln-workflows fungerar bättre när du hanterar volym, samarbete eller en maskin som inte tål belastningen.

Processen skiljer sig:

- Ladda upp endast godkända källor: Använd inte molnet som sorteringsrum.

- Använd tydliga namngivningskonventioner: Versionsförvirring växer snabbt i delade projekt.

- Dokumentera preseten: När en bra batch landar, spara den exakta konfigurationen.

- Tilldela review-ägarskap: Någon måste spot-checka outputs, inte bara bekräfta att filer finns.

Vad du ska kolla efter en batch-körning

En slutförd render-kö är inte samma som en användbar batch.

Granska dessa först:

| Kolla | Varför det betyder något |

|---|---|

| Rörelsekonsistens | Flimmer döljer sig ofta tills playback |

| Ansikten och händer | Aggressiva modeller misslyckas här först |

| Fin text och UI | Bra för skärminspelningar, lätt att bryta |

| Framerate-integritet | Felmatchningar skapar stutter vid export |

| Aspect ratio | Felaktig hantering orsakar awkward crops senare |

Batch-uppskalning sparar bara tid om din verifieringspass är snabb och skoningslös.

Misstag som förstör skala

De största misslyckandena kommer vanligtvis från process, inte modellkvalitet.

- En preset för varje klipp: Snabbt, men opålitligt.

- Inget sample-render: Så vaknar du till en mapp full av oanvändbara filer.

- Hoppa över QC för att thumbnails ser bra ut: Många artefakter syns bara i playback.

- Upskala efter flera edit-exports: Varje re-encode sänker din takhöjd.

För team är målet inte bara snabbare bearbetning. Det är förutsägbar bearbetning. Ett stabilt batch-system gör upscale video ai till en del av vanlig produktion istället för en räddningsinsats varje gång ett låglösningsasset dyker upp.

Efter-uppskalningsredigering och smarta export-presets

En uppskalad fil är inte en färdig fil.

Den är närmare ett återställt negativ. Du behöver fortfarande forma den, kolla den och exportera den för platsen den ska leva på. Den sista delen betyder något eftersom creators ofta jagar resolution medan de ignorerar leveransvillkor.

ROI-frågan är verklig. Som Cloudinary’s guide to using AI to upscale video noterar lovar många verktyg 4K, men plattformar som TikTok och Instagram Reels downskalar innehåll ändå. Det väcker en praktisk fråga för creators. Är en 4K-uppskalning fördelaktig, eller skulle en optimerad HD-export prestera lika bra för mobile-first-visning?

Rengöringspasset betyder något

AI-modeller introducerar ofta subtila problem som inte syns i en side-by-side-stillframe.

Vanliga inkluderar:

- Färgdrift: Hudtoner kan skifta lätt efter förbättring.

- Kantchatter: Fin detalj kan pulsera över rörelse.

- Texturinkonsistens: Hår, tyg och bakgrunder kan växla mellan skarpt och mjukt.

Jag behandlar efter-uppskalningsredigering som finputsning, inte valfri polering.

Fixa färg innan export

Till och med en lätt grade kan unify bilden. Matcha hudtoner, dra tillbaka högdagrar om uppskalningen gjorde dem spröda, och se till att svarta inte blivit krispiga.

Granska rörelse i playback

Inspektera inte bara frame grabs. Titta på klippet i fullskärm, sedan igen på en telefon. Rörelseproblem avslöjar sig i playback, inte screenshots.

Om en uppskalning ser fantastisk ut pausad och konstig i rörelse är exporten inte redo.

Smarta exports slår max-exports

Creators väljer ofta ”högsta kvalitet tillgänglig”. Det låter säkert, men det är inte alltid användbart.

För short-form-distribution, tänk i termer av plattformsanpassning:

| Destination | Bättre default-tankesätt | Vad du ska undvika |

|---|---|---|

| TikTok | Rent, stabilt HD-master | Stora filer med marginell synlig vinst |

| Instagram Reels | Stark kompressionsresistens | Översharpenade exports som bryts efter upload |

| YouTube Shorts | Krispig text och stabil rörelse | Onödigt översized renders om källan var svag |

Poängen är inte att 4K är dåligt. Poängen är att 4K inte automatiskt är bättre för varje social upload.

En praktisk export-policy

Använd den här regelsatsen:

-

Exportera för plattformen, inte din stolthet

Tittare bryr sig om klarhet och smidighet mer än din renderinställningsmeny. -

Behåll en högkvalitativt arkiv-master

Spara en ren master för framtida återanvändning, crops eller klientleverans. -

Skapa plattformspecifika derivat

En arkivfil, sedan exports anpassade för vertikalt, fyrkantigt eller horisontellt behov. -

Kolla det uppladdade resultatet

Sociala plattformar är en del av renderkedjan. Din lokala export är inte det slutliga utseendet.

Många creators kompromissar kvalitet vid export. De spenderar tid på uppskalning, sedan lämnar det slutliga resultatet till plattformskomprimering utan strategi. Smarta export-presets skyddar arbetet du redan gjort.

Automatisera uppskalning i en ShortGenius-pipeline

Manuell uppskalning fungerar när du fixar ett klipp. Det bryts ner när du producerar socialt innehåll varje vecka över flera kanaler.

Det är flaskhalsen för team. Enligt Perfect Corp coverage of AI video enhancer workflow limitations är den största utmaningen att integrera uppskalning i multi-kanal-workflows eftersom de flesta fristående verktyg saknar batch-processing i skala eller API-tillgänglighet. En unified publishing-pipeline betyder mer än ännu en isolerad förbättringsapp.

Vad automation faktiskt ska göra

En användbar automatiserad pipeline lägger inte bara till ”upscale”.

Den ska hantera en kedja som denna:

- Ingest källklippet

- Routera det efter innehållstyp

- Applicera rätt förbättringspreset

- Skicka resultatet till redigering

- Installera och paketera för varje kanal

- Schemalägga distribution

Den strukturen förvandlar uppskalning från ett reparationssteg till infrastruktur.

Var det passar i produktionen

För short-form-team är den bästa insättnings punkten vanligtvis tidigt. Rengör det visuella assetet innan captions, branding, ominramning och exports.

Det betyder något eftersom varje senare steg beror på att källan ser stabil ut. Om du lägger till animerade captions, cut-ins och brand-overlays på svagt material först, och sedan försöker uppskalning senare, tvingar du modellen att tolka designelement och kompressionsskador samtidigt.

En mer pålitlig ordning är:

| Steg | Bättre sekvens |

|---|---|

| Källhantering | Välj och godkänn raw-klipp |

| Förbättring | Upskala och rengör rörelse först |

| Edit-lager | Lägg till captions, trims, branding, voice |

| Distribution | Exportera per plattform och publicera |

En plattformsnämning, använd där den hör hemma

I ett unified workflow kan ShortGenius sitta i den produktionskedjan som ett alternativ för team som vill ha video-sammanställning, voiceovers, redigering, ominstallning, schemaläggning och API-driven automation i samma miljö. Den typen av setup betyder något när du försöker förvandla rough material till upprepningsbart output utan att bolla filer mellan separata appar. Om du bygger ett bredare system kring återkommande kanalproduktion är den här guiden till https://shortgenius.com/blog/youtube-automatisering-ai-din-guide-till-skalbart-innehallsarbetsflode relevant eftersom automation bara fungerar när varje produktionssteg kopplar rent.

Vad som fungerar och vad som inte gör det

Vad som fungerar

- Behandla uppskalning som ett förbehandlingssteg

- Spara presets per materialklass

- Automatisera repetitiva pass, inte estetisk bedömning

- Behålla ett mänskligt review-steg innan publicering

Vad som inte fungerar

- Skicka varje klipp genom samma förbättringsprofil

- Automatisera utan QC-ägarskap

- Bygga en pipeline som kräver manuell filhantering mellan verktyg

- Anta att AI-genererat och organiskt material beter sig samma under uppskalning

Vinsten är inte bara bättre utseende material. Vinsten är att ta bort ännu en manuell flaskhals från innehållsproduktion.

För byråer, brand-team och högvolym-creators är det den fundamentala skiftet. Upskalning slutar vara en speciell fix för dåliga filer och blir en standard bakgrundsprocess. Du återställer mer användbart material, spenderar mindre tid på repetitiv rengöring och håller output-kvalitet konsekvent över kanaler.

Om du vill förvandla det här workflowet till ett upprepningsbart system för ShortGenius (AI Video / AI Ad Generator) video-skapande, redigering, ominstallning, voiceovers, schemaläggning och automatiserad publicering i en plattform, så att uppskalning kan passa in i en bredare produktionspipeline istället för att leva som en engångsmanuell uppgift.