En kreatörs guide till att bemästra läppsynk AI

Upptäck hur läppsynk AI revolutionerar videoproduktion. Lär dig vad det är, hur det fungerar och hur du använder det för att skapa perfekt dubbade videor för en global publik.

Har du någonsin velat tala vilket språk som helst i dina videor, med munnen som perfekt matchar varje enskilt ord, även om du inte kan språket? Det är precis vad lip-sync AI gör möjligt. I grunden tar den här tekniken en separat ljudspår och animerar automatiskt en persons mun – eller en avatars – för att synka perfekt med det.

Det här är inte bara ett snyggt partytrick; det är ett enormt steg framåt som gör innehållsskapande och lokalisering tillgängligt för alla.

Varför Lip Sync AI är viktigt för skapare

Tänk på lip-sync AI som en digital dockspelare för dina videor. Under lång tid var realistisk läppsynkronisering något som bara högbudget-filmstudior med dedikerade VFX-team kunde åstadkomma. Det innebar att animera munrörelser bildruta för bildruta. Nu ligger den samma kraften i händerna på skapare överallt, och det förändrar helt hur video skapas för plattformar som YouTube, TikTok och Instagram.

AI:ns huvuduppgift är att överbrygga gapet mellan det du ser och det du hör, och skapa en helt sömlös och trovärdig upplevelse för tittaren. Glöm de gamla, klumpiga dubningarna där ljudet är plågsamt ur synk. Den här tekniken säkerställer att en talares mun rör sig i perfekt harmoni med en ny ljudspår, oavsett om det är ett annat språk, en ominspelad voiceover eller till och med ett manus läst av en AI-röst.

Utöka din räckvidd och spara tid

Påverkan på innehållsskapare är enorm. Du är inte längre begränsad till ditt modersmål eller fast i besväret med dyra ominspelningar bara för att fixa ett litet ljudfel.

Den här tekniken ger dig kraften att:

- Bryta språkhinder: Dubba dina videor till flera språk på nolltid. Du kan öppna upp ditt innehåll för massiva internationella publiker utan att någonsin behöva säga ett ord spanska, japanska eller hindi.

- Skala innehåll utan ansträngning: Ta en video och återanvänd den för olika globala marknader. Allt du behöver göra är att byta ut ljudfilen och låta AI:n sköta resten.

- Höja produktionsvärdet: Skapa professionella voiceovers för dina annonser eller sociala medie-videor och se till att din on-screen-talang eller avatar ser helt naturlig och autentisk ut.

Det här är inte bara en teknisk nyhet; det är en strategisk fördel. Lip sync AI låter soloskapsare och små team tävla globalt och producera flerspråkigt innehåll som tidigare bara var möjligt för stora mediebolag.

I slutändan handlar det här verktyget om att jobba smartare, inte hårdare. Genom att automatisera vad som en gång var en tröttande efterproduktionsuppgift, frigörs du att fokusera på det du är bäst på: att komma på bra idéer. För att verkligen se helheten är det bra att förstå den bredare världen av AI Powered Content Creation och hur verktyg som det här omformar hela branschen. Lip-sync AI är en nyckelbit i det pusslet och ger dig förmågan att connecta med fler människor på ett mycket mer autentiskt sätt.

Hur Lip Sync AI faktiskt fungerar

Har du någonsin undrat vad som händer under huven på en lip-sync AI? Det är inte bara en digital dockteater som rör munnen upp och ner. Tänk på det mer som en sofistikerad översättningstjänst, men istället för att konvertera ord från ett språk till ett annat översätter den ljud till otroligt precisa ansiktsrörelser.

Låt oss använda en analogi. Om du skulle lära en robot att tala skulle du inte bara visa den alfabetet. Du skulle lära den hur varje bokstav låter. Lip-sync AI gör något väldigt liknande genom att bryta ner din ljudspår i de minsta enheterna av ljud, som kallas fonem. Till exempel bryts ordet "hello" ner i distinkta ljud som "h", "eh", "l" och "ow".

När AI:n har identifierat dessa fonem går den igång med sin huvuduppgift: att mappa varje ljud till exakt den munform en person gör när den säger det. Dessa visuella munformer kallas visemer. AI:n har tränats på berg av data, så den vet instinktivt att "f"-ljudet betyder att överkäks-tänderna ska nudda underläppen. Det är en blixtsnabb översättning från ljud till visuellt.

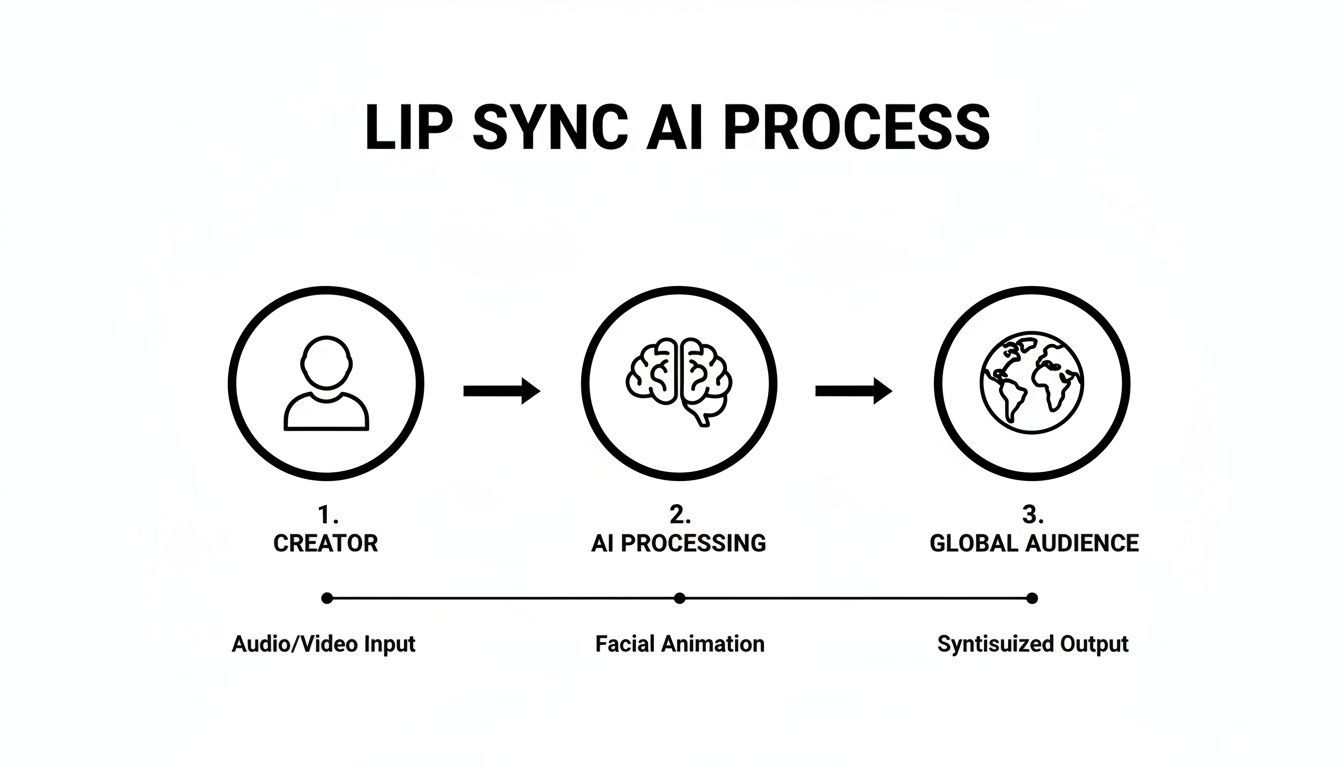

Den här diagrammet bryter ner hur ett stycke innehåll går från en enkel inspelning från din sida till en video redo för en global publik.

Som du ser tillhandahåller skaparen råmaterialen, AI:n gör det tunga lyftet, och resultatet är polerat innehåll som connectar med tittare var som helst.

De två kärningredienserna

För att åstadkomma det här digitala magin behöver AI:n egentligen bara två saker från dig. Den här enkelheten är en stor del av vad som gör verktyg som ShortGenius så användbara för skapare som behöver jobba snabbt.

- Ljudfilen: Det här är din ritning. Det kan vara en voiceover du just spelat in, en professionellt dubbad ljudspår för ett nytt språk eller någon annan inspelning av någon som talar. Ju renare ljudet desto bättre. Kristallklart, tydligt tal ger AI:n en mycket enklare uppsättning fonem att jobba med, vilket alltid leder till ett mer exakt och trovärdigt resultat.

- Videoklippet eller avatar: Det här är din duk. Du kan använda en video av en riktig person eller till och med en statisk bild av en AI-genererad avatar. AI:n använder den här visuella basen för att generera och lägga på de nya, perfekt synkade munrörelserna.

Men moderna deep learning-algoritmer stannar inte där. De går ett steg längre genom att analysera nyanserna i ljudet – tonen, känslan, till och med talarens hastighet. Det hjälper till att göra den slutliga animationen mycket mer naturlig. I grunden handlar lip-sync AI om den expertförmågan att sync audio video så sömlöst att tittaren aldrig ens tänker på det.

Slutsatsen är den här: Det handlar inte bara om att röra på läpparna. Det är en djup analys av ljud som översätter tal till realistiska ansiktsuttryck och fångar de små detaljerna som gör en prestation verkligen mänsklig.

Den här nivån av automatisering driver på en seriös branschtillväxt. Den globala marknaden för läppsynk-teknik är på väg att hoppa från USD 1.12 miljarder 2024 till uppskattade USD 5.76 miljarder år 2034. Det faktum att ljuddriven maskininlärning redan har en 40.7% marknadsandel visar hur vital den här tekniken har blivit för att ta innehåll globalt.

Samma teknologi är en nyckelkomponent i många AI-video-verktyg. Det är det som låter en skapare förvandla en enda stillbild till en fängslande, dynamisk video. Du kan dyka djupare i hur det fungerar genom att kolla in vår guide om hur man transformerar bilder till video med AI.

Praktiska tillämpningar för skapare och marknadsförare

Att känna till de tekniska detaljerna om lip sync AI är en sak, men den riktiga magin händer när du ser hur det öppnar nya kreativa och affärsmässiga dörrar. För skapare och marknadsförare är det här inte bara en nyhet; det är ett seriöst verktyg för att skala innehåll, nå nya marknader och verkligen connecta med publiker runt om i världen.

Den mest uppenbara och kraftfulla användningsfallet är innehållslokalisering. Säg att du har en TikTok som går viralt eller en YouTube-tutorial du lagt ner ditt hjärta i. Istället för att vara begränsad till bara engelsktalande kan du nu skapa versioner för spanska, hindi eller japanska publiker på nolltid. AI:n slänger inte bara på en ny ljudspår – den animerar om dina läpp-rörelser omsorgsfullt för att matcha det nya språket, så att den slutliga videon känns helt naturlig.

Det här skriver om regelboken för global expansion. Det gamla sättet att lokalisera en videokampanj innebar att anlita röstskådespelare för varje språk, boka dyr studiotid och plöja igenom veckor eller månader av efterproduktion. Nu är hela arbetsflödet snabbare och mycket mer prisvärt.

Från globala annonser till AI-avatars

Utöver att bara översätta videor låser lip sync AI upp en hel rad strategier för att bygga varumärken och skapa fängslande annonser. I grunden utnyttjar varje tillämpning förmågan att separera vad någon säger från hur de ser ut när de säger det.

Här är några revolutionerande sätt som den här tekniken används just nu:

- Skapa engagerande AI-avatars: Du kan ta en enda bild – av en maskot, en grundare eller en virtuell influencer – och ge den liv. Mata in en text-to-speech-voiceover, och du har en oändlig källa till sociala medie-innehåll utan att någon någonsin behöver stå framför en kamera.

- Lokalisera annonskampanjer: Ett varumärke kan producera en fantastisk, högbudget-annons och sedan använda AI för att anpassa den för dussintals internationella marknader. Det håller varumärkesidentiteten konsekvent samtidigt som budskapet känns lokalt och personligt. Den här approachen är en räddare för annonsplattformar som kräver en stadig ström av färskt kreativt material. Du kan se hur det fungerar i en bredare strategi genom att kolla in vår guide om att skapa effective AI UGC-style ads.

- Enkla ljudkorrigeringar: Vi har alla varit där. Du avslutar en perfekt videoeditering, bara för att märka ett misstag i voiceovern. Istället för en frustrerande ominspelning kan du bara spela in den korrigerade ljudraden och låta AI:n sömlöst patcha in den, med perfekt matchande läppar.

Den riktiga kraften här är decoupling av det visuella från ljudet. Det ger skapare enorm flexibilitet att experimentera, korrigera misstag och anpassa innehåll för olika plattformar och publiker utan att börja från scratch varje gång.

För att visa hur de här idéerna blir verklighet, här är en snabb uppdelning av hur skapare och varumärken använder lip sync AI.

Lip Sync AI-tillämpningar för skapare och varumärken

| Use Case | Primary Benefit | Example Application |

|---|---|---|

| Global Content Distribution | Audience Growth | En YouTuber översätter sin toppresterande video till 5 nya språk för att nå en global publik och tredubblar sin potentiella tittarskara. |

| Multilingual Ad Campaigns | Increased ROI | Ett D2C-varumärke skapar 10 lokalisade versioner av en enda annons för olika länder och förbättrar annonsrelevans och konverteringsgrader. |

| AI Influencers & Avatars | Content Scalability | Ett företag använder sin animerade maskot för att skapa dagliga sociala medie-uppdateringar utan att behöva ett videoteam för varje inlägg. |

| Post-Production Fixes | Time & Cost Savings | En filmskapare korrigerar en feldragen rad i en avgörande scen utan ominspelning och sparar tusentals dollar. |

Det här är inte bara en mindre förbättring – det är en fundamental förändring i hur video skapas.

AI-video-dubbningmarknaden värderades till $31.5 miljoner 2024 och förväntas skjuta i höjden till $397 miljoner år 2032. Den här explosiva tillväxten beror helt på den otroliga tids- och pengabesparing den ger. En flerspråkig kampanj som en gång krävde en enorm budget och månader av arbete kan nu vändas runt på mindre än en vecka för under $2,000, och lägger global räckvidd i händerna på soloskapsare. Du kan lära dig mer om the evolving economics of AI lip sync technology och se hur det förändrar hela skaparekonomin.

Hur man väljer rätt Lip Sync AI-verktyg

Med en flod av nya verktyg som kommer ut på marknaden kan det kännas som att skjuta i mörkret att välja rätt lip sync AI. Men alla plattformar är inte byggda lika, och fel val kan lämna dig med robotiska, klumpiga videor som skrämmer bort tittare istället för att engagera dem. Du behöver en enkel checklista för att skära igenom marknadsföringsfluffet.

Den absoluta toppfaktorn är kvaliteten på synken i sig. Ser den slutliga videon naturlig ut, eller faller den in i den kusliga "uncanny valley"? Ett bra verktyg förstår de små, subtila rörelserna hos en riktig mun – hur den formas kring olika ljud och connectar med talarens uttryck.

En billig eller dåligt tränad AI kanske bara fladdrar munnen öppet och stängt, vilket är en omedelbar hint om att något är fejk. Det bästa sättet att bedöma det är att ta samma korta ljudklipp och köra det genom några olika verktyg. Lägg resultaten sida vid sida och lita på din magkänsla.

Utvärdera nyckelfunktioner och prestanda

Utöver ren realism måste du tänka på dina specifika kreativa behov. Det perfekta verktyget för en flerspråkig företagsutbildare är troligen överdrivet för en meme-skapare. Att nagla utvärderingsprocessen i förväg sparar dig en värld av huvudvärk senare.

Här är de essentiella sakerna att leta efter:

- Språk- och accentstöd: Det här är en dealbreaker om du vill nå en global publik. Ta reda på hur många språk verktyget stödjer och, lika viktigt, hur bra det hanterar olika accenter och dialekter. Ett verktyg som kan nagla en glasgow-accent är mycket mer imponerande än ett som bara funkar med en generisk, robotig röst.

- Bearbetningshastighet: Hur länge kommer du stirra på en framstegsbar för ett ett-minutersklipp? I världen av kortformatigt innehåll är hastighet allt. Vissa plattformar kan vända en video på minuter, medan andra får dig att vänta i evighet.

- Användarvänlighet: Ett verktyg med en miljon funktioner är värdelöst om gränssnittet är en mardröm. Leta efter en ren, enkel design som låter dig ladda upp din video och ljud, och applicera läppsynken på bara några klick. Plattformar som ShortGenius siktar på att göra det här steget till en sömlös del av en mycket större videoproduktionspipeline.

Det ultimata målet är att hitta en lösning som passar in i din befintliga process utan att skapa nya flaskhalsar. Det rätta verktyget ska kännas som en förlängning av din kreativa verktygslåda, inte ännu ett komplicerat stycke mjukvara du måste lära dig.

Överväg integration och marknadstrender

Slutligen, tänk på den större bilden. Hur passar den här lip sync AI in i ditt arbetsflöde? Funkar den bra med de videoediterare du redan älskar? Kan den hantera de videoformat och upplösningar du behöver? Sömlös integration är lika kritisk som teknisk prestanda.

Den explosiva tillväxten i det här området berättar allt du behöver veta. Marknaden för AI i media, som inkluderar läppsynk-teknik, förväntas svälla från USD 8.21 miljarder 2024 till USD 51.08 miljarder år 2030. Den här typen av snabb expansion betyder att sofistikerad audio-visuell AI snabbt blir en kärndel av varje modern innehållsstrategi. Du kan få mer detaljer om the AI media market on datainsightsmarket.com.

Genom att välja ett välunderstött verktyg som ständigt förbättras löser du inte bara ett problem för idag – du investerar i din förmåga att skapa fantastiskt innehåll i åratal framöver.

En steg-för-steg-guide till din första Lip Sync-video

Okej, låt oss sätta igång på riktigt. Att göra din första video med lip sync AI är inte så komplicerat som det låter. Vi kan bryta ner det i en enkel, fyrastegsprocess som tar dig från en grov idé till en färdig video redo att dela.

Det här är det grundläggande arbetsflödet du hittar i plattformar som ShortGenius, som lägger den här kraftfulla tekniken rätt i din handflata.

Steg 1: Förbered ditt ljudspår

Allt börjar med ljudet. Tänk på det som ritningen för din video – AI:n behöver ett rent, klart spår för att räkna ut vilka munformer som ska skapas. Du kan spela in din egen röst eller använda en kvalitets text-to-speech-generator för en konsekvent krispig narration.

För bästa resultat, se till att ditt ljud har minimalt med bakgrundsbrus. Att tala tydligt gör också stor skillnad. Ju mer distinkta dina ord är, desto bättre kan AI:n matcha läpprörelserna. Att få det här första steget rätt lägger grunden för ett mycket mer trovärdigt resultat.

Steg 2: Välj ditt video- eller avatar-klipp

Nästa upp, du behöver välja vem (eller vad) som ska prata. Det kan vara ett videoklipp du redan har av någon som talar eller till och med bara en statisk bild av en AI-avatar du skapat. Nyckeln här är ett klart skott av ansiktet.

Här är ett pro tips: En rakt på-fram, frontalt vinkel funkar bäst. AI:n behöver en direkt, ohindrad vy av munnen för att generera realistiska rörelser. Om ansiktet är vänd åt sidan eller något blockerar vyn kommer den slutliga animationen att se lite off ut.

Kvaliteten på dina inputs bestämmer direkt kvaliteten på ditt output. Ett skarpt, välbelyst video och rent ljud ger AI:n det bästa möjliga materialet att jobba med, minimerar fel och säkerställer ett mer livaktigt resultat.

Steg 3: Applicera Lip Sync AI

Här börjar den riktiga kulen, och det är oftast bara en fråga om att klicka på en knapp. När du laddat upp dina ljud- och videofiler till verktyget applicerar du bara läppsynk-funktionen. AI:n går sedan igång, bryter ner ljuden i ditt ljud och skapar helt nya munrörelser på ditt video-subjekt för att matcha.

Hela processen är förvånansvärt snabb, ofta bara några minuter. Medan AI:n gör det tunga lyftet kan du förbereda dig för det sista och viktigaste steget.

Steg 4: Granska och förfina outputen

Ingen AI får det perfekt varje gång, så en slutlig kontroll är avgörande. Titta på den genererade videon och lägg märke till timingen noga. Ser synken naturlig ut? Finns det några konstiga ryckningar eller stunder där läpparna inte riktigt matchar ljudet?

De flesta bra verktyg ger dig alternativ att göra små justeringar. Ibland räcker det med att flytta ljudtimingen lite eller köra om en specifik sektion för att släta ut knutar. När du är nöjd är din video redo att exporteras. Den här processen är en kärndel av många AI-video-arbetsflöden, och du kan se hur den passar in i den större bilden genom att läsa vår guide om text-to-video AI models.

Har du frågor om Lip Sync AI? Vi har svaren.

Att hoppa in i ny teknik väcker alltid några frågor. Det är helt normalt. Låt oss ta itu med några av de vanligaste jag hör från skapare om lip sync AI så att du kan komma igång med att skapa grymt innehåll direkt.

Hur hanterar Lip Sync AI olika språk?

Det här är en stor en. Den goda nyheten är att de flesta topp-AI-modeller är tränade på gigantiska dataset fyllda med otaliga timmar flerspråkigt tal. Det betyder att de är förvånansvärt duktiga på att hantera inte bara olika språk, utan också olika accenter. Det handlar inte bara om ord; det handlar om att lära sig de specifika munformerna – det tekniska namnet är visemer – som hör till varje unikt ljud.

Självklart är inte alla verktyg byggda lika. Du kommer märka att prestandan kan variera kraftigt mellan plattformar, vilket är varför jag alltid rekommenderar att köra ett kort testklipp på ditt målspråk innan du commitar till ett stort projekt. De bästa systemen fångar de subtila nyanserna och får talaren att se ut som en native, istället för att applicera en generisk, "one-size-fits-all"-munrörelse som bara känns fel.

Vad är skillnaden mellan Lip Sync och dubbning?

Det är lätt att blanda ihop de här två, men de är egentligen två sidor av samma mynt som jobbar tillsammans för att få en video att kännas autentisk på ett nytt språk.

Tänk så här:

- Video Dubbing: Det här handlar om ljudet. Det är processen att byta ut den ursprungliga röstspåret mot ett nytt, vanligtvis på ett annat språk.

- Lip Sync: Det här är den visuella uppföljningen. När det nya ljudet är lagt applicerar AI:n digitala ändringar på talarens munrörelser för att perfekt matcha den nya dialogen.

När du kombinerar dem får du en helt lokaliserad video. Ljudet stämmer, och det visuella matchar. En hanterar vad du hör, den andra vad du ser.

Den här ett-två-kombinationen är vad som låter en skapare ta en enda video och få den att kännas native för publiker var som helst i världen, utan den distraherande ur-synk-känslan som omedelbart drar tittaren ur upplevelsen.

Hur undviker jag den kusliga "Uncanny Valley"-effekten?

Ah, "uncanny valley". Det är den konstiga, obehagliga känslan när något ser nästan mänskligt ut, men några subtila saker är inte riktigt rätt. Det är en verklig oro med lip sync AI, men du kan absolut undvika det.

Först och främst, börja alltid med högkvalitativt källmaterial. Ett krispigt, välbelyst video eller en polerad avatar ger AI:n en mycket renare duk att jobba med. Om du matar in suddigt eller lågupplöst material ber du praktiskt taget om ett konstigt resultat.

Nästa, fokusera på ditt ljudkvalitet. Använd en högkvalitativ AI-röst som låter naturlig, eller ännu bättre, en ren inspelning av en mänsklig röstskådespelare. En robotig, platt röst ihop med realistiska läpprörelser är ett recept för omedelbar kuslighet.

Slutligen, kom ihåg att lägga till de subtila mänskliga toucherna. En AI-genererad scen kan kännas lite steril på egen hand. Att lägga till små saker som naturliga huvudrörelser, realistiskt blinkande eller till och med ett intressant bakgrund kan få hela videon att kännas mer jordnära och levande, och dra den rätt ur uncanny valley.

Redo att skapa fantastiska, flerspråkiga videor utan krångel? ShortGenius integrerar kraftfulla AI-läppsynk-funktioner i ett komplett videoproduktionsarbetsflöde. Producera professionella annonser och sociala innehåll på minuter. Börja skapa gratis på shortgenius.com.