En guide till juridiska frågor med AI-skådespelare i reklam

Navigera de juridiska frågorna med AI-skådespelare i reklam. Vår guide täcker upphovsrätt, publicitetsrätter och FTC-regler för att hålla dina kampanjer lagliga och säkra.

Att använda AI-skådespelare i dina annonser öppnar upp en värld av kreativa möjligheter, men du måste absolut få grepp om de stora juridiska problemen med AI-skådespelare i reklam innan du dyker in. De största farorna är upphovsrättsintrång kopplat till AI-träningsdata, att oavsiktligt kränka en verklig persons publicitetsrätt och att drabbas av böter för vilseledande praxis enligt FTC-regler och nya delstatslagar om deepfakes. Att hantera detta rätt från början är det enda sättet att undvika ett mycket kostsamt juridiskt kaos.

De nya juridiska riskerna med AI-skådespelare i reklam

Att kliva in i AI-driven reklam är spännande, det råder det inget tvivel om. Men det är som att vandra in i en labyrint av juridiska fällor som du inte ens visste fanns. Tänk så här: du är regissören, men osynliga juridiska ramverk som upphovsrätt, publicitetsrätt och konsumentskyddslagar är dockmakarna. Om du ignorerar dem kan hela din kampanj rasa samman.

Det här nya landskapet medför risker som traditionell reklam aldrig stött på. Ditt varumärke kan stämmas för upphovsrättsintrång bara för att AI-modellen tränades på skyddade bilder utan tillstånd. Det är också chockerande enkelt för ett AI-genererat ansikte att se lite för mycket ut som en verklig person, vilket kan utlösa en stämning för att ha stulit deras likhet.

Viktiga juridiska utmaningar att förutse

De juridiska problemen med AI-skådespelare är inte längre bara hypotetiska; de leder till verkliga kampanjnedtagningar, massiva böter och allvarlig skada på varumärkets rykte. Att veta exakt vad du står inför är det första steget mot att skapa en reklamstrategi som är både innovativ och juridiskt sund.

Här är en uppdelning av vad du behöver hålla koll på:

- Upphovsrättsintrång: Tränades AI:n på upphovsrättsskyddade foton eller konstverk? I så fall kan din slutliga annons juridiskt betraktas som ett "derivatverk", vilket gör dig ansvarig för intrånget.

- Kränkningar av publicitetsrätten: Om din AI-skådespelare ens vagt liknar en verklig person – deras ansikte, röst eller allmänna stil – kan du stämmas för att ha använt deras likhet i kommersiellt syfte utan tillstånd.

- Vilseledande reklampraktiker: Federal Trade Commission (FTC) är kristallklar: annonser måste vara sanningstrogna. Att använda AI-skådespelare för falska videobetyg eller för att antyda ett godkännande som aldrig skett är en snabb väg till problem.

- Navigera deepfake-lagar: Fler och fler delstater inför lagar för att strama åt syntetiska medier. Det skapar en rörig lapptäcke av regler som varierar beroende på var din publik finns.

För att ge dig en klarare bild här är en snabb sammanfattning av de viktigaste juridiska hindren du kommer att stöta på.

Viktiga juridiska risker med AI-skådespelare i ett nötskal

| Juridiskt riskområde | Vad det betyder för dina annonser | Möjliga konsekvenser |

|---|---|---|

| Upphovsrättsintrång | AI-modellen använde upphovsrättsskyddade bilder för träning, vilket gör din annons till ett potentiellt "derivatverk". | Stämningar, nedtagningsmeddelanden och ekonomiska skadestånd. |

| Publicitetsrätt | Din AI-skådespelare liknar oavsiktligt en verklig persons ansikte, röst eller distinkta persona. | Rättsliga åtgärder från individen för obehörig kommersiell användning av deras likhet. |

| FTC & vilseledande annonser | Användning av AI för att skapa falska betyg, vilseledande produktdemos eller falska godkännanden. | Kraftiga FTC-böter, rättsliga sanktioner och allvarlig skada på varumärkets rykte. |

| Deepfake- & integritetslagar | Kränkning av nya delstatspecifika lagar som reglerar skapande och användning av syntetiska medier. | Civilt eller straffrättsliga böter, beroende på delstat och kränkningens natur. |

Att förstå och navigera dessa risker handlar inte bara om att undvika böter; det handlar om att bygga förtroende i en era där konsumenter blir alltmer skeptiska till det de ser online.

Genom att proaktivt hantera dessa risker förvandlar du juridiska hinder till en konkurrensfördel. Ett compliant tillvägagångssätt skyddar inte bara ditt företag utan bygger också förtroende hos en publik som blir alltmer vaksam mot syntetiskt innehåll.

I slutändan är målet att utnyttja AI:ns otroliga kraft utan att snubbla in i uppenbara juridiska fällor. Det är ett ekosystem som även inkluderar de företag som bygger dessa kraftfulla verktyg. Om du vill se ett exempel på vilka som är aktiva i det här området kan du kolla in copycat247 homepage. Genom att hålla dig uppdaterad och skapa en tydlig compliance-plan kan du innovera med självförtroende.

Upphovsrättsminfältet gömt i AI-träningsdata

När det gäller AI i reklam är det enskilt största juridiska bekymret upphovsrättsintrång. Hela problemet börjar med hur dessa modeller faktiskt lär sig. Generativ AI uppfinner inte saker ur tomma intet; den tränas på enorma datamängder, ofta med miljontals bilder, videor och texter som skrapats direkt från internet. Det är där problemen börjar.

Tänk på en AI-modell som en musiker som lyssnar på varje låt som någonsin gjorts för att förstå hur man komponerar. Om musikern sedan spottar ur sig en ny melodi som låter misstänkt lik en berömd, upphovsrättsskyddad melodi har de gått över gränsen. Samma princip gäller här. Din annons kan byggas på en grund av licensfritt material utan att du ens vet om det.

Denna dolda ansvarighet innebär att ditt varumärke kan hållas ansvarigt för upphovsrättsintrång även om du har de bästa avsikterna. Den AI-genererade skådespelaren eller scenen i din annons kan tekniskt sett vara ett "derivatverk" – en ny skapelse som är lite för nära ett befintligt upphovsrättsskyddat verk. Och du har ingen aning om vad den tränades på för att producera det.

De grumliga vattnen kring "substantial similarity"

I domstol kokar testet för upphovsrättsintrång ofta ner till ett koncept som kallas "substantial similarity". Det handlar inte om att bevisa att AI:n gjort en pixel-för-pixel-kopia. Det är mycket mer suddigt. Den verkliga frågan är om en vanlig person skulle titta på AI:ns output och känna igen att det kopierats från ett skyddat verk.

För en annonsör är den här otydligheten en enorm risk. Om AI:n genererar en karaktär för din kampanj som har samma skruvade, igenkännbara stil som en berömd tecknad karaktär kan du få en stämning. Den ursprunglige konstnären behöver inte bevisa att AI:n replikerade deras verk exakt, bara att den "totala konceptet och känslan" är densamma.

Och de juridiska striderna eskalerar redan. Sent 2025 hade en våg av rättstvister lett till 47 upphovsrättsmål mot AI-företag i USA ensamt, många som grupptalan. I högprofilerade exempel har företag som Disney och Universal Studios hävdat att AI-verktyg tränats på deras blockbuster-filmer utan tillstånd, vilket skapar en allvarlig riskkedja för alla som använder de visuella element som dessa verktyg genererar.

Varför du inte kan lita på "fair use"-försvaret

AI-företag försvarar sig ofta genom att hävda att deras träningsprocess är "fair use", en juridisk doktrin som tillåter begränsad användning av upphovsrättsskyddat material för saker som forskning eller kommentar. Men det argumentet blir otroligt svagt så fort AI:ns output används i kommersiellt syfte – som en annons.

Domstolar tittar på fyra nyckelfaktorer för att avgöra om något är fair use:

- Syftet med användningen: Är det för vinst eller utbildning? Reklam är rent kommersiell, vilket är ett stort minus för ett fair use-påstående.

- Karaktären på det ursprungliga verket: Att använda kreativa verk som foton och illustrationer är mycket svårare att försvara än att använda faktiska data.

- Mängden använt verk: Kopierade AI-modellen "hjärtat" i det ursprungliga verket, även om den inte använde hela?

- Påverkan på marknaden: Skadar den AI-genererade bilden den ursprunglige skapares möjlighet att sälja eller licensiera sitt eget verk? Om din AI-bild ersätter behovet av att köpa ett stockfoto är det tydlig marknadsskada.

För marknadsförare är det att luta sig mot ett fair use-försvar ett vad du nästan garanterat förlorar. Den kommersiella naturen hos en reklamkampanj sänker argumentet från start. För att få bättre koll på att skydda dina egna kreativa tillgångar är det smart att kolla in bredare överväganden kring immaterialrätt.

Kärnproblemet är inte bara vad AI:n skapar, utan vad den lärde sig från. Om träningsdata är juridiskt tveksamt bär varje innehåll den genererar den ärvda risken rakt in i dina reklamkampanjer.

I slutändan faller ansvaret på dig – annonsören – att ställa tuffa frågor om var dina AI-tillgångar kommer ifrån. Att välja AI-plattformar som använder licensierade eller etiskt framtagna träningsdata handlar inte bara om att göra rätt; det är en kritisk juridisk sköld för ditt varumärke.

Skydda mänsklig identitet i AI-eran

Långt bortom upphovsrätt blir de juridiska problemen med AI-skådespelare i reklam personliga. Snabbt. Här stöter vi på publicitetsrätten – den grundläggande rätten varje person har att kontrollera hur deras namn, bild och likhet används för kommersiell vinning.

Tänk på det som ett personligt varumärkeskydd på din identitet. Om du använder AI för att skapa en "digital tvilling" av en kändis – eller till och med en vanlig person – för en annons utan deras explicita tillstånd korsar du en allvarlig juridisk gräns. Det är i princip identitetsstöld för vinst, och domstolarna tar det inte lätt på.

Det handlar inte bara om att skapa en perfekt, fotorealistisk kopia heller. Lagen skyddar ofta vilken egenskap som helst som pekar direkt på en specifik person. Det kan vara deras röst, en berömd pose eller till och med en kliché de är kända för. Att skapa en virtuell influencer som känns lite för bekant för en verklig kändis är en stämning som väntar på att hända.

Det växande hotet från obehöriga digitala replikor

Deepfake-teknikens explosion har satt detta i rampljuset, och lagstiftare kämpar för att hänga med. Delstater inför nu lagar specifikt utformade för att bekämpa obehörigt skapande och användning av digitala replikor. För marknadsförare och skapare betyder det att de gamla sätten att få samtycke är officiellt döda.

Du kan inte längre lita på ett standardmodellsläpp och anta att det täcker skapandet av en AI-version av den personen. Den juridiska marken har skiftat, och den nya standarden är explicita, informerade samtycken som specifikt nämner AI-generering. Allt mindre lämnar ditt varumärke vidöppet för risker.

En nyckel-dom har verkligen drivit hem denna poäng. Den visade att även när federala upphovsrätts- eller varumärkeslagar inte riktigt passar för fall av röstkloning kan delstatsnivåns medborgarrätts- och publicitetslagar fortfarande ge kraftfullt skydd för individer vars identiteter kapats av AI. Det lägger ansvaret tydligt på annonsörer att känna till och respektera dessa delstatslagar.

Skapa ett AI-säkert samtyckesformulär

När du får tillstånd att bygga en AI-skådespelare baserad på en verklig person måste ditt tillvägagångssätt vara helt annorlunda. Samtycke- och frigivningsformulären måste vara vattentäta och lämna absolut inget utrymme för tolkning. Ett riktigt solitt AI-släpp ska ge dig specifika, entydiga rättigheter.

För att hålla dig på rätt sida av lagen måste din samtyckesprocess täcka dessa nyckelpunkter:

- Explicita rätten att skapa en digital replika: Formuläret måste ange, utan tvekan, att du avser att skapa en digital version av personen med AI.

- Definierad användningsomfattning: Var precis. Specificera exakt hur och var AI-replikan kommer att användas – vilka kampanjer, på vilka plattformar och hur länge.

- Godkännanderättigheter för AI-output: Detta är en stor förhandlingsfråga. Får personen granska och godkänna de slutliga AI-genererade scenerna innan de publiceras?

- Framtida användning och modifieringar: Kontraktet måste klargöra om du har rätt att ändra AI-replikan eller använda den i framtida kampanjer som inte planerats ännu. Vagt språk här är en massiv ansvarighet.

För att se hur kraven har förändrats, jämför hur traditionellt samtycke skiljer sig från vad som behövs för AI.

Samtyckeschecklista för verklig person vs AI-skådespelare

Denna tabell belyser de kritiska skillnaderna mellan ett standardfrigivningsformulär och ett utformat för att skapa en AI-replika.

| Samtyckesfaktor | Krävs för verklig person | Kritiskt för AI-replika |

|---|---|---|

| Användning av likhet | Standardmodellsläpp för foton/videor. | Explicita tillstånd att generera en digital klon. |

| Användningstid | Tydligt definierad tid (t.ex. ett år). | Måste specificera om rättigheterna är eviga eller tidsbegränsade. |

| Rätt att modifiera | Begränsat till standardredigering (färgkorrigering etc.). | Måste ge rättigheter att ändra AI:ns prestation/dialog. |

| Medieomfattning | Specificerar plattformar (t.ex. sociala medier, TV). | Täcker brett alla nuvarande och framtida digitala medier. |

I slutändan handlar det att navigera publicitetsrätten i AI-åldern om transparens och respekt. Att få kristallklart samtycke handlar inte bara om att kryssa en juridisk ruta – det handlar om att skydda ditt varumärke och hedra rättigheterna hos de personer vars identiteter driver ditt kreativa arbete.

Hålla sig på rätt sida av FTC

Långt bortom labyrinten av upphovsrätt och publicitetsrätt kliver en annan stor spelare in i ringen när du använder AI-skådespelare: Federal Trade Commission (FTC). FTC:s uppdrag är enkelt: skydda konsumenter från annonser som ljuger eller vilseleder. De bryr sig inte om din annons skapades av ett team konstnärer eller en sofistikerad algoritm – om den är vilseledande är det ett problem.

I grunden är FTC:s regel rak: En annons får inte vara vilseledande. Denna standard gäller allt som annonsen säger och antyder, inklusive påståenden om den AI-teknik som används för att skapa den. Om din AI-skådespelare påstår att ett nytt proteinpulver bygger muskler 2x snabbare bättre du ha solid vetenskaplig bevisning för att backa upp det, precis som om en mänsklig kändis sagt det.

Myndigheten går också hårt åt det de kallar "AI-washing". Det är när ett företag blåser upp sina AI-förmågor oproportionerligt. Att hylla din kampanj som ett banbrytande AI-prestation när den bara utför några grundläggande automatiserade uppgifter är ett säkert sätt att hamna på FTC:s radar.

De två sanningarna du måste upprätthålla

När AI-skådespelare är inblandade jonglerar du plötsligt med två ansvarssatser. Du måste vara ärlig om vad du säljer och ärlig om teknologin du använder för att sälja det.

Tänk på det som en tvådelad integritetskontroll:

- Sanning i annonsens budskap: Är påståendena, demonstrationerna eller betygen som din AI-skådespelare presenterar faktiskt sanna? En AI-genererad video av en glad "kund" som hyllar din produkt är rakt vilseledande om kunden inte existerar.

- Sanning i dina tekniska påståenden: Överdriver du vad din AI kan göra? Om du påstår att din AI levererar perfekt personanpassade annonser men den bara ändrar bakgrundsfärgen baserat på plats vilseleder du din publik.

FTC är inte intresserad av den tekniska processen bakom annonsen. De fokuserar på budskapet en genomsnittlig person tar med sig.

Regulatorer skojar inte

Det här är inte bara en varning på näven. FTC jagar aktivt företag för vilseledande AI-marknadsföring och skickar ett tydligt budskap om att använda "AI" som buzzword inte är en fri biljett till ogrundade påståenden.

FTC har gjort det klart: om du gör ett påstående om din AI måste du kunna bevisa det. Annonsörer måste ha robust bevisning för varje prestandapåstående, precis som för vilken annan produktfunktion som helst.

Och det här är inte någon avlägsen framtida scen – det händer nu. Vid mitten av 2025 hade FTC redan inlett minst ett dussin verkställighetsåtgärder mot 'AI-washing.' Ett utmärkt exempel var stämningen i augusti 2025 mot Air AI för falska påståenden om att deras AI kunde helt ersätta mänskliga säljare. Det här fallet understryker de allvarliga juridiska och finansiella riskerna för marknadsförare som hyllar sina AI-verktyg utan bevis. Du kan läsa mer om FTC:s utvecklade syn på AI-lag.

När måste du avslöja?

Det här leder oss till en kritisk fråga: när måste du berätta för folk att de tittar på en AI-genererad skådespelare? Det finns ingen enskild federal lag med en hård regel ännu, men FTC:s allmänna principer om vilseledning ger oss en ganska tydlig vägledning.

Självtestet är detta: "Skulle kunskapen om att det är AI förändra hur en konsument förstår annonsen?"

Om du använder en AI-skådespelare för att posera som en verklig läkare som rekommenderar ett tillskott eller en faktisk kund som delar en personlig historia är det att inte avslöja att det är AI nästan säkert vilseledande. Underlåtenheten är missvisande eftersom den ger godkännandet en trovärdighet det inte har.

För att vara säker och bygga förtroende blir tydliga och framträdande avslöjanden den nya standarden. En enkel, synlig etikett som #AIGenerated kan gå långt för att hålla dig före reglerna och på rätt sida av dina kunder.

Din praktiska compliance-checklista för AI-annonser

Okej, låt oss lämna teorin och komma till vad du faktiskt behöver göra. Att tackla det juridiska minfältet med AI i reklam handlar om att ha en solid, upprepningsbar process. Det här handlar inte om att kväva kreativitet med byråkrati; det handlar om att bygga räcken så ditt team kan innovera med självförtroende.

Tänk på den här checklistan som din förflygningsrutin innan du lanserar någon AI-driven kampanj. Genom att bygga in dessa steg i ditt arbetsflöde skapar du en grund av compliance som skyddar ditt varumärke, respekterar individuella rättigheter och håller dig på rätt sida av regulatorer. Låt oss gå igenom den.

Steg 1: Granska ditt AI-verktyg och dess träningsdata

Innan du ens tänker på att generera en bild måste du lyfta på huven på din AI-plattform. Den juridiska statusen för din slutliga annons är direkt kopplad till den data som AI-modellen tränades på. Att bara anta att ett betalt verktyg är "säkert" är ett massivt, och potentiellt mycket dyrt, vad.

Du behöver ställa din AI-leverantör direkta frågor och verkligen gräva i deras användarvillkor. En respekterad leverantör bör vara öppen om var deras data kommer ifrån.

- Kräv datatransparens: Fråga rakt ut: Tränades din modell på licensierade, public domain- eller etiskt framtagna data? Om du får ett vagt, svepande svar är det en enorm varningssignal.

- Kolla efter en indemnitetsklausul: Täcker leverantören dina juridiska räkningar om deras verktyg spottar ut något som leder till stämning? Det kallas indemnifiering. Du kommer märka att många plattformar lägger 100% av den juridiska risken på dig, användaren.

- Leta efter "kommersiellt säkra" verktyg: Vissa plattformar marknadsför specifikt sina modeller som säkra för kommersiell användning. Det är ofta ett gott tecken, eftersom det brukar betyda att de gjort hemläxan kring datarättigheter.

Steg 2: Säkra vattentäta rättigheter och samtycken

Detta är icke-förhandlingsbart. Om din annons involverar en digital dubbel av en verklig person – eller till och med en avatar som ser mycket ut som någon – behöver du explicita samtycken. Ditt gamla modellsläpp duger inte här. Dina avtal måste nu vara specifika och tänka på framtiden.

Namnet på spelet är informerat samtycke. Du måste vara kristallklar med att du avser att skapa och använda en AI-genererad version av en person, och specificera exakt hur, var och hur länge. Eventuell otydlighet i det kontraktet är i princip en öppen inbjudan till en stämning längre fram.

Detta är mer än att få en signatur; det handlar om tydlig kommunikation. Ett stenfast AI-släpp bör täcka alla baser för att undvika framtida huvudvärk.

- Specificera AI-generering: Kontraktet måste uttryckligen ange att du har rätt att skapa en "digital replika" eller "AI-genererad likhet".

- Definiera användningsomfattningen: Var detaljerad. Beskriv vilka plattformar AI-skådespelaren kommer att visas på, typerna av kampanjer och den exakta användningstiden.

- Hantera modifieringsrättigheter: Tillåter kontraktet dig att justera AI:ns prestation? Kan du ändra dess dialog eller placera den i helt nya scener? Specificera det.

Steg 3: Granska varje AI-genererat output noggrant

När AI:n har skapat något för dig börjar det riktiga arbetet. Varje enskild bild, video och voiceover behöver en mänsklig granskning. Detta är din sista försvarslinje mot intrång, och du kan inte hoppa över det.

Anta aldrig att bara för att en bild är "ny" är den juridiskt ren. Dessa modeller kan – och gör – oavsiktligt efterlikna skyddade stilar, karaktärer eller till och med varumärkeslogotyper.

- Kolla efter 'substantial similarity': Ser eller känns outputen lite för nära en berömd filmkaraktär, ett konstverk eller en specifik konstnärs signaturstil? Om din magkänsla säger att det är för nära är det troligen det. Släng det och generera ett nytt.

- Skanna efter varumärken: Titta noga på bakgrunderna. Smög AI:n in en logotyp, ett varumärkesnamn eller en distinkt produktform?

- Lyssna efter röstlikhet: Om du genererar ljud, låter rösten kusligt lik en berömd skådespelare eller offentlig person? Det är en potentiell kränkning av publicitetsrätten som väntar på att hända.

Steg 4: Inför tydliga avslöjanden och begrunda påståenden

Slutligen måste du vara ärlig mot din publik och följa FTC-regler. Det betyder att vara transparent om användning av AI när det spelar roll och, viktigast av allt, backa upp varje påstående din annons gör med kalla, hårda bevis.

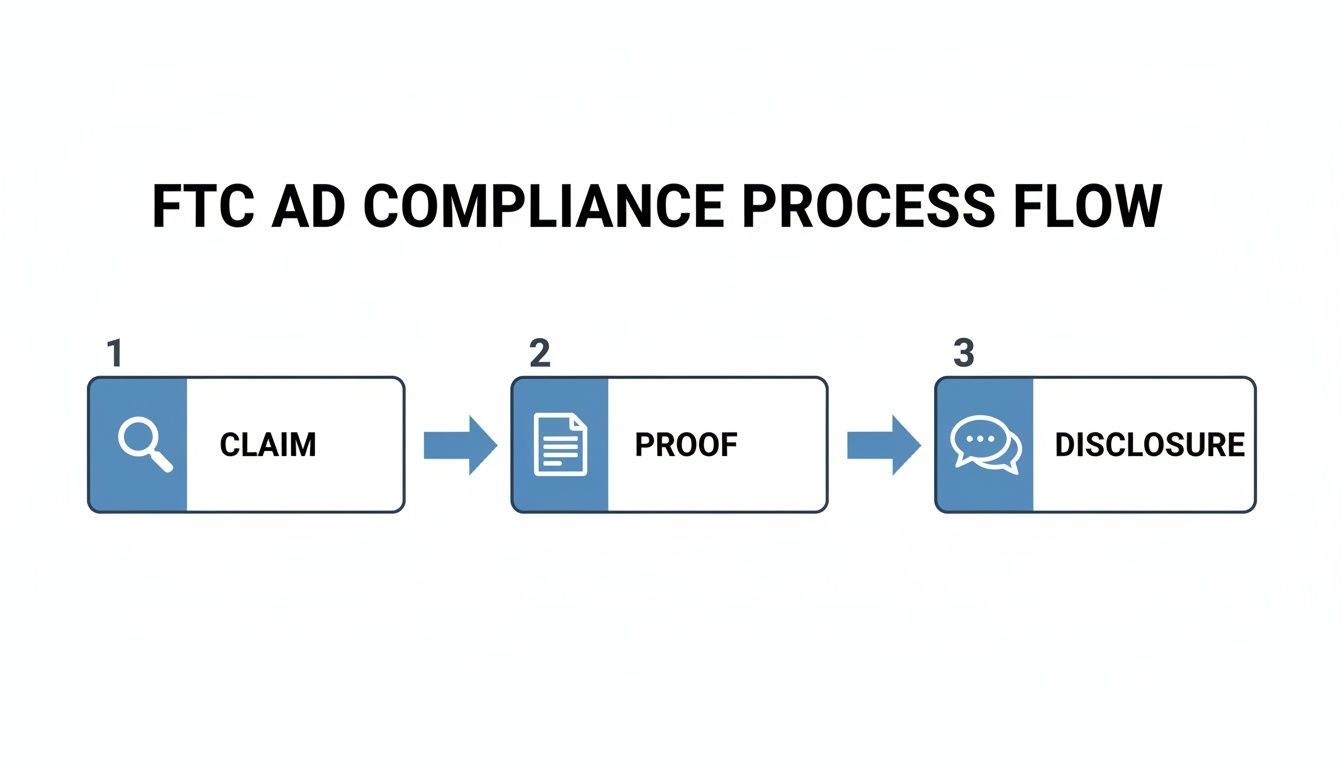

Detta enkla flödesschema bryter ner FTC:s kärnförväntan för vilken annons som helst, AI-driven eller ej.

Det är en enkel cykel: för varje påstående du gör måste du ha bevis som backar upp det och ge en tydlig avslöjande. Den här loopen säkerställer att din reklam är sanningsenlig och försvarbar.

- Avslöja när det spelar roll: Om en typisk person kan luras att tro att din AI-skådespelare är en verklig person – som en läkare som ger medicinska råd eller en kund som hyllar en produkt – måste du avslöja det. En enkel #AIGenerated eller #AIAd räcker.

- Begrunda alla påståenden: Varje faktapåstående din AI-skådespelare gör behöver bevis. Om din AI-talsperson säger att en produkt är "50% mer effektiv" bättre du ha den kliniska studien som bevisar det innan annonsen ser dagens ljus.

- Bygg en 'bevisningsfil': För varje kampanj, vänj dig vid att skapa en fil som innehåller all data, studier och bevis som stödjer annonsens påståenden. Om FTC knackar på blir den filen din bästa vän.

Vanliga frågor om AI-skådespelare i reklam

Att hoppa in i AI-driven reklam väcker ofta fler frågor än svar. Den juridiska sidan är fortfarande lite som Vilda Västern, vilket kan göra det svårt att känna sig säker på dina beslut. Låt oss ta itu med några av de vanligaste frågorna som marknadsförare ställer om de juridiska problemen med AI-skådespelare i annonser. Mitt mål här är att ge dig raka svar så du kan bygga smartare, säkrare kampanjer.

Måste jag avslöja att min annons använder en AI-skådespelare?

Alltmer är svaret ja. Även om det inte finns en stor federal lag som kräver det för varje annons skiftar marken definitivt. Det bästa sättet att tänka på det är genom linsen av FTC:s regler mot vilseledande praxis. Om det att inte berätta att en skådespelare är AI skulle vilseleda någon måste du absolut avslöja det. Tänk på att använda en AI-genererad "läkare" för att plugga ett hälsoprodukt – att läkaren inte är verklig är en ganska stor grej.

Dessutom gör plattformarna redan valet åt dig. Stora aktörer som Meta och YouTube kräver nu etiketter för realistiskt AI-genererat innehåll, så avslöjande blir en grundläggande kostnad för att driva verksamhet.

Här är den enkla regel jag följer: Om det finns någon chans att en vanlig person kan luras, lägg till ett tydligt och enkelt avslöjande som #AIGenerated. Det handlar inte bara om att följa regler som kanske kommer; det handlar om att bygga förtroende hos din publik, vilket är ovärderligt.

Att vara öppen hanterar förväntningar och skyddar ditt varumärke, speciellt när folk blir smartare (och mer skeptiska) kring syntetiska medier.

Kan jag stämmas om mitt AI-verktyg skapar en intrångsbild?

Absolut. Ett stort missförstånd är att om AI-verktyget skapar rötan är det verktygets leverantör som måste städa upp. Så fungerar inte upphovsrättslagen. Det företag som publicerar den intrångsrika annonsen – ditt företag – kan hållas direkt ansvarigt. Det kallas ofta sekundär ansvarighet, och det betyder att du delar den juridiska risken.

Även om AI-plattformen också får problem fritar det inte dig. Därför måste du läsa användarvillkoren för varje AI-verktyg du använder. Vissa plattformar kan erbjuda indemnifiering (de täcker dina juridiska räkningar), men många är skrivna för att lägga allt juridiskt ansvar på dig som användare.

Ditt bästa försvar är att vara proaktiv. Granska varje AI-genererad bild för kusliga likheter med befintliga upphovsrättsskyddade verk. Och försök hålla dig till AI-plattformar som är transparenta om var deras träningsdata kommer ifrån – de som använder lagligt licensierade eller public domain-data är alltid ett säkrare val.

Vad är skillnaden mellan ett stockfoto och en AI-person?

Den nyckelskillnaden kokar ner till var de juridiska rättigheterna kommer ifrån. När du licensierar ett stockfoto av en person kommer det med ett modellsläpp. Det är ett juridiskt dokument där den verkliga människan på fotot har gett sitt samtycke för kommersiell användning av deras likhet. Det är ditt juridiska säkerhetsnät.

En AI-genererad person har inget modellsläpp eftersom, ja, de inte existerar. Men det öppnar en helt ny burk med maskar som du inte behöver oroa dig för med stockfoton.

- Oavsiktlig dubbelgångare: AI-bilden kan slumpmässigt se ut precis som en verklig person, vilket skapar ett överraskande publicitetsrättskrav du aldrig såg komma.

- Upphovsrättsminfält: Bilden i sig kan utmanas baserat på vad AI:n tränades på. Om modellen lärde sig från en databas med skyddade bilder kan din "originala" AI-person juridiskt betraktas som en intrångskopia.

I princip byter du med en AI-person ut en känd, tydlig juridisk process (modellsläpp) mot en ny, grumlig uppsättning risker kopplade till upphovsrätt och identitet.

Hur kan jag säkert skapa en AI-varumärkesavatar?

Om du vill skapa en AI-varumärkesavatar eller influencer utan att få ett skrämmande brev från en advokat längre fram behöver du en plan. Du kan inte bara improvisera.

Börja med att säkerställa att avataren är helt unik. Var kreativ med detaljerade prompts och tweak manuellt resultaten för att styra det slutliga utseendet långt från verkliga personer eller befintliga karaktärer. Håll en logg över denna kreativa process – det kan vara avgörande bevis för att visa att du avsåg att skapa något helt originalt.

Nästa, ge din avatar ett unikt namn och bakhistoria som har ingen koppling till en verklig person. Gör en varumärkessökning för avatarens namn och till och med dess visuella design för att säkerställa att du inte trampar på ett annat varumärkes tår.

Slutligen, gå igenom ditt AI-verktygs användarvillkor. Du behöver vara säker på att de ger dig full kommersiell äganderätt eller åtminstone en bred kommersiell licens för allt du skapar. Att vara transparent med din publik om att avataren är AI går också långt för att undvika både juridiska och PR-problem.

Redo att skapa högpresterande annonser utan juridisk gissningslek och höga produktionskostnader? ShortGenius är en AI-reklamplattform utformad för skapare och marknadsförare som behöver producera imponerande kortformade video- och bildannonser för alla stora sociala plattformar. Generera koncept, manus och visuellt material på sekunder, anpassa dem med ditt varumärkeskit och driftsätt kampanjer som ger resultat. Prova ShortGenius idag och börja bygga bättre annonser, snabbare.