Um Guia para Questões Legais com Atores IA na Publicidade

Navegue pelas questões legais com atores IA na publicidade. O nosso guia aborda direitos de autor, direitos de publicidade e regras da FTC para manter as suas campanhas em conformidade e seguras.

Utilizar atores de IA nos seus anúncios abre um mundo de possibilidades criativas, mas tem absolutamente de compreender os principais problemas legais com atores de IA na publicidade antes de mergulhar de cabeça. Os maiores campos minados são a violação de direitos de autor ligada aos dados de formação da IA, violar acidentalmente o direito de publicidade de uma pessoa real e ser penalizado por práticas enganosas ao abrigo das regras da FTC e das novas leis estaduais sobre deepfakes. Fazer isto bem desde o início é a única forma de evitar uma confusão legal muito dispendiosa.

Os Novos Riscos Legais dos Atores de IA na Publicidade

Entrar no mundo da publicidade alimentada por IA é excitante, sem dúvida. Mas é como caminhar para um labirinto de armadilhas legais de que nem sequer sabia da existência. Pense nisto desta forma: você é o realizador, mas enquadramentos legais invisíveis como direitos de autor, direitos de publicidade e leis de proteção ao consumidor são os marionetistas. Se os ignorar, toda a sua campanha pode desabar.

Este novo terreno traz riscos que a publicidade tradicional simplesmente nunca enfrentou. A sua marca pode ser processada por violação de direitos de autor só porque o modelo de IA foi treinado com imagens protegidas sem permissão. É também chocantemente fácil uma cara gerada por IA parecer um pouco demasiado com uma pessoa real, provocando um processo por roubo da sua semelhança.

Principais Desafios Legais a Antecipar

Os problemas legais com atores de IA já não são apenas hipotéticos; estão a levar a takedowns reais de campanhas, multas massivas e danos graves à reputação de uma marca. Saber exatamente com o que se está a defrontar é o primeiro passo para criar uma estratégia de anúncios inovadora e legalmente sólida.

Aqui está uma análise do que tem de vigiar:

- Violação de Direitos de Autor: A IA treinou-se com fotos ou arte protegidas por direitos de autor? Se sim, o seu anúncio final pode ser legalmente considerado uma "obra derivada", tornando-o responsável por violação.

- Violações do Direito de Publicidade: Se o seu ator de IA se assemelhar vagamente a uma pessoa real — a cara, a voz ou o estilo geral —, pode enfrentar um processo por usar a sua semelhança para ganho comercial sem permissão.

- Práticas de Publicidade Enganosas: A Federal Trade Commission (FTC) é cristalina: os anúncios devem ser verídicos. Usar atores de IA para testemunhos falsos em vídeo ou para implicar um endorsement que nunca aconteceu é um caminho rápido para problemas.

- Navegar nas Leis de Deepfake: Cada vez mais estados estão a aprovar leis para apertar o cerco à media sintética. Isto cria um mosaico confuso de regulamentos que muda consoante o local do seu público.

Para o ajudar a ter uma visão mais clara, aqui está um resumo rápido dos principais obstáculos legais que encontrará.

Principais Riscos Legais com Atores de IA de Relance

| Área de Risco Legal | O Que Significa para os Seus Anúncios | Consequência Potencial |

|---|---|---|

| Violação de Direitos de Autor | O modelo de IA usou imagens protegidas por direitos de autor para formação, tornando o seu anúncio uma potencial "obra derivada". | Processos judiciais, notificações de takedown e danos financeiros. |

| Direito de Publicidade | O seu ator de IA assemelha-se acidentalmente à cara, voz ou persona distinta de uma pessoa real. | Ação legal da indivíduo por uso comercial não autorizado da sua semelhança. |

| FTC e Anúncios Enganosos | Usar IA para criar testemunhos falsos, demos de produto enganosas ou endorsements falsos. | Multas pesadas da FTC, sanções legais e danos graves à reputação da marca. |

| Leis de Deepfake e Privacidade | Violar novas leis específicas de estados que regulam a criação e uso de media sintética. | Penalizações civis ou criminais, dependendo do estado e da natureza da violação. |

Compreender e navegar estes riscos não é só evitar penalizações; é construir confiança numa era em que os consumidores são cada vez mais céticos face ao que veem online.

Ao abordar proativamente estes riscos, transforma obstáculos legais numa vantagem competitiva. Uma abordagem em conformidade não só protege o seu negócio, como constrói confiança com um público cada vez mais cauteloso face a conteúdo sintético.

Em última análise, o objetivo é aproveitar o poder incrível da IA sem cair em armadilhas legais óbvias. É um ecossistema que também inclui as empresas que constroem estas ferramentas poderosas. Se quiser ver um exemplo de quem está neste espaço, pode consultar a página inicial da copycat247. Ao manter-se informado e criar um plano claro de conformidade, pode inovar com confiança.

O Campo Minado de Direitos de Autor Escondido nos Dados de Formação da IA

Quando se trata de IA na publicidade, a maior dor de cabeça legal é a violação de direitos de autor. Todo o problema começa com a forma como estes modelos realmente aprendem. A IA generativa não inventa coisas do nada; é treinada com conjuntos de dados absolutamente massivos, muitas vezes contendo milhões de imagens, vídeos e textos recolhidos diretamente da internet. É aí que os problemas começam.

Imagine um modelo de IA como um músico que ouve todas as músicas alguma vez feitas para descobrir como compor. Se esse músico depois produzir uma melodia nova que soa suspeitosamente como uma melodia famosa protegida por direitos de autor, cruzou uma linha. O mesmo princípio aplica-se aqui. O seu anúncio pode ser construído sobre uma base de material não licenciado sem você saber.

Esta responsabilidade oculta significa que, mesmo com as melhores intenções, a sua marca pode ser responsabilizada por violação de direitos de autor. O ator ou cena gerados por IA no seu anúncio podem ser tecnicamente uma "obra derivada" — uma criação nova que está um pouco demasiado próxima de uma peça existente protegida por direitos de autor. E você não teria ideia do que foi usado para a produzir.

As Águas Turvas da "Semelhança Substancial"

Em tribunal, o teste para violação de direitos de autor resume-se frequentemente a um conceito chamado "semelhança substancial." Não se trata de provar que a IA fez uma cópia pixel por pixel. É muito mais nebuloso. A verdadeira questão é se uma pessoa comum olharia para a saída da IA e reconheceria que foi copiada de uma obra protegida.

Para um anunciante, essa ambiguidade é um risco enorme. Se uma IA gerar uma personagem para a sua campanha que tem o mesmo estilo peculiar e reconhecível de uma personagem de cartoon famosa, pode estar à espera de um processo. O artista original não tem de provar que a IA replicou a sua obra exatamente, só que o "conceito total e sensação" são os mesmos.

E as batalhas legais já estão a intensificar-se. Até finais de 2025, uma onda de litígios trouxe cerca de 47 processos por direitos de autor contra empresas de IA só nos EUA, muitos como ações coletivas. Em exemplos de alto perfil, empresas como Disney e Universal Studios alegaram que ferramentas de IA foram treinadas com os seus filmes blockbuster sem permissão, criando uma cadeia séria de risco para qualquer um que use as imagens geradas por essas ferramentas.

Porquê Não Pode Contar com a Defesa de "Uso Justo"

As empresas de IA tentam frequentemente defender-se alegando que o seu processo de formação é "uso justo," uma doutrina legal que permite o uso limitado de material protegido por direitos de autor para coisas como investigação ou comentário. Mas esse argumento torna-se incrivelmente frágil no momento em que a saída da IA é usada para fins comerciais — como um anúncio.

Os tribunais olham para quatro fatores chave para decidir se algo é uso justo:

- Finalidade do Uso: É para lucro ou para educação? A publicidade é puramente comercial, o que é um grande ponto contra uma alegação de uso justo.

- Natureza da Obra Original: Usar obras criativas como fotos e ilustrações é muito mais difícil de defender do que usar dados factuais.

- Quantidade da Obra Usada: O modelo de IA copiou o "coração" da peça original, mesmo que não usasse tudo?

- Efeito no Mercado: A imagem gerada por IA prejudica a capacidade do criador original de vender ou licenciar a sua própria obra? Se a sua imagem de IA substitui a necessidade de comprar uma foto stock, isso é um dano claro ao mercado.

Para os marketeers, apoiar-se numa defesa de uso justo é uma aposta que quase certamente perde. A natureza comercial de uma campanha publicitária afunda o argumento desde o início. Para ter um melhor controlo na proteção dos seus próprios ativos criativos, investigar considerações mais amplas sobre propriedade intelectual é um passo inteligente.

O problema central não é só o que a IA cria, mas o que aprendeu. Se os dados de formação forem legalmente questionáveis, cada peça de conteúdo que gera carrega esse risco herdado diretamente para as suas campanhas publicitárias.

Em última análise, o ónus recai sobre si — o anunciante — para fazer perguntas difíceis sobre a origem dos seus ativos de IA. Escolher plataformas de IA que usam dados de formação licenciados ou obtidos eticamente não é só fazer o correto; é um escudo legal crítico para a sua marca.

Proteger a Identidade Humana na Era da IA

Passando além dos direitos de autor, os problemas legais com atores de IA na publicidade tornam-se pessoais. Rápido. É aqui que nos deparamos com o direito de publicidade — o direito fundamental que cada pessoa tem de controlar como o seu nome, imagem e semelhança são usados para ganho comercial.

Pense nisto como uma marca registada pessoal na sua identidade. Se usar IA para criar um "gêmeo digital" de uma celebridade — ou mesmo de uma pessoa comum — para um anúncio sem obter a sua permissão explícita, está a cruzar uma linha legal séria. É essencialmente roubo de identidade para lucro, e os tribunais não o estão a levar de ânimo leve.

Isto não é só sobre criar uma cópia perfeita e fotorrealista. A lei protege frequentemente qualquer característica que aponte diretamente para uma pessoa específica. Isso pode ser a voz, uma pose famosa ou até uma frase célebre. Criar um influencer virtual que pareça um pouco demasiado familiar a uma celebridade do mundo real é um processo à espera de acontecer.

A Ameaça Crescente de Réplicas Digitais Não Autorizadas

A explosão da tecnologia deepfake trouxe esta questão para o centro das atenções, e os legisladores estão a tentar acompanhar. Os estados estão agora a aprovar leis especificamente concebidas para combater a criação e uso não autorizados de réplicas digitais. Para marketeers e criadores, isto significa que as antigas formas de obter consentimento estão oficialmente mortas.

Já não pode confiar num formulário padrão de liberação de modelo e assumir que cobre a criação de uma versão de IA dessa pessoa. O terreno legal mudou, e o novo padrão é o consentimento explícito e informado que menciona especificamente a geração por IA. Qualquer coisa menos deixa a sua marca completamente exposta a riscos.

Uma decisão judicial chave realmente sublinhou este ponto. Mostrou que, mesmo quando as leis federais de direitos de autor ou marca registada não se aplicam perfeitamente a um caso de clonagem de voz, as leis estaduais de direitos civis e publicidade ainda podem fornecer uma proteção poderosa para indivíduos cujas identidades são sequestradas por IA. Isso coloca o ónus diretamente nos anunciantes para conhecerem e respeitarem estas leis estaduais.

Criar um Formulário de Consentimento à Prova de IA

Quando está a obter permissão para construir um ator de IA baseado numa pessoa real, a sua abordagem tem de ser completamente diferente. Os formulários de consentimento e liberação têm de ser herméticos e não deixar espaço para interpretações. Uma verdadeira liberação de IA sólida deve conceder-lhe direitos específicos e inequívocos.

Para ficar do lado certo da lei, o seu processo de consentimento tem de cobrir estes pontos chave:

- Direito Explícito de Criar uma Réplica Digital: O formulário deve afirmar, sem rodeios, que pretende criar uma versão digital da pessoa usando IA.

- Âmbito de Uso Definido: Seja preciso. Especifique exatamente como e onde a réplica de IA será usada — quais campanhas, em que plataformas e por quanto tempo.

- Direitos de Aprovação na Saída de IA: Este é um ponto enorme de negociação. A pessoa tem direito a rever e aprovar as cenas finais geradas por IA antes de serem publicadas?

- Uso Futuro e Modificações: O contrato tem de esclarecer se tem o direito de alterar a réplica de IA ou usá-la em campanhas futuras ainda não planeadas. Linguagem vaga aqui é uma responsabilidade massiva.

Para ver como os requisitos mudaram, basta comparar o consentimento tradicional com o necessário para IA.

Lista de Verificação de Consentimento: Pessoa Real vs Ator de IA

Esta tabela destaca as diferenças críticas entre um formulário de liberação padrão e um concebido para criar uma réplica de IA.

| Fator de Consentimento | Necessário para Pessoa Real | Crítico para Réplica de IA |

|---|---|---|

| Uso de Semelhança | Liberação padrão de modelo para fotos/vídeos. | Permissão explícita para gerar um clone digital. |

| Duração de Uso | Tempo claramente definido (ex.: um ano). | Deve especificar se os direitos são perpétuos ou limitados no tempo. |

| Direitos de Modificação | Limitados a edição padrão (correção de cor, etc.). | Deve conceder direitos para alterar a performance/diálogo da IA. |

| Âmbito de Media | Especifica plataformas (ex.: redes sociais, TV). | Abrange amplamente todas as media digitais atuais e futuras. |

Em última análise, navegar o direito de publicidade na era da IA resume-se a transparência e respeito. Obter consentimento cristalino não é só marcar uma caixa legal — é proteger a sua marca e honrar os direitos das pessoas cujas identidades alimentam o seu trabalho criativo.

Ficar do Lado Certo da FTC

Além do labirinto de direitos de autor e publicidade, outro ator principal entra em cena quando usa atores de IA: a Federal Trade Commission (FTC). O trabalho da FTC é simples: proteger os consumidores de anúncios que mentem ou enganam. Não lhes interessa se o seu anúncio foi criado por uma equipa de artistas ou por um algoritmo sofisticado — se for enganoso, é um problema.

No cerne, a regra da FTC é direta. Um anúncio não pode ser enganoso. Este padrão aplica-se a tudo o que o anúncio diz e implica, incluindo alegações sobre a tecnologia de IA usada para o criar. Se o seu ator de IA alegar que um novo pó proteico ajuda a ganhar músculo 2x mais rápido, melhor ter provas científicas sólidas para o sustentar, tal como teria se uma celebridade humana o dissesse.

A agência também está a apertar o cerco ao que chamam "AI-washing." Isto é quando uma empresa exagera as suas capacidades de IA de forma desproporcionada. Apresentar a sua campanha como uma conquista revolucionária de IA quando só executa algumas tarefas automatizadas básicas é uma forma infalível de entrar no radar da FTC.

As Duas Verdades que Deve Manter

Quando atores de IA entram em jogo, está de repente a gerir duas responsabilidades. Tem de ser honesto sobre o que está a vender e honesto sobre a tecnologia que está a usar para o vender.

Pense nisto como uma verificação de integridade em duas partes:

- Verdade na Mensagem do Anúncio: As alegações, demonstrações ou testemunhos apresentados pelo seu ator de IA são realmente verdadeiros? Um vídeo gerado por IA de um "cliente" feliz a elogiar o seu produto é francamente enganoso se esse cliente não existir.

- Verdade nas Alegações Técnicas: Está a exagerar o que a sua IA pode fazer? Se alegar que a sua IA entrega anúncios perfeitamente personalizados mas na verdade só muda a cor de fundo com base na localização, está a enganar o seu público.

A FTC não está interessada no processo técnico por trás do anúncio. Focam-se na mensagem com que uma pessoa média fica.

Os Reguladores Não Estão a Brincar

Isto não é só um puxão de orelha. A FTC está ativamente a perseguir empresas por marketing de IA enganoso, enviando uma mensagem clara de que usar "IA" como palavra da moda não é um passe livre para fazer alegações sem base.

A FTC deixou claro: se fizer uma alegação sobre a sua IA, tem de a poder provar. Os anunciantes devem ter provas robustas para cada alegação de desempenho, tal como para qualquer outra funcionalidade do produto.

E isto não é um cenário futuro distante — está a acontecer agora. Até meados de 2025, a FTC já tinha lançado pelo menos uma dúzia de ações de execução contra 'AI-washing.' Um exemplo primordial foi o processo de agosto de 2025 contra a Air AI por alegar falsamente que a sua IA podia substituir completamente os representantes de vendas humanos. Este caso sublinha os riscos legais e financeiros sérios para marketeers que exageram as suas ferramentas de IA sem provas. Pode saber mais sobre a posição em evolução da FTC sobre a lei de IA.

Quando Tem de Divulgar?

Isto leva-nos a uma questão crítica: quando tem de dizer às pessoas que estão a ver um ator gerado por IA? Ainda não há uma lei federal única com uma regra rígida, mas os princípios gerais da FTC sobre engano dão-nos um guia bastante claro.

O teste decisivo é este: "Saber que é IA mudaria a forma como um consumidor entende o anúncio?"

Se usar um ator de IA para se passar por um médico real a recomendar um suplemento ou por um cliente real a partilhar uma história pessoal, falhar em divulgar que é IA é quase certamente enganoso. A omissão é enganadora porque dá ao endorsement um sentido de credibilidade que não tem.

Para ficar seguro e construir confiança, divulgações claras e proeminentes estão a tornar-se o novo padrão. Uma etiqueta simples e visível como #AIGenerated pode ir longe em mantê-lo à frente das regulações e do lado certo dos seus clientes.

A Sua Lista de Verificação Prática de Conformidade para Anúncios de IA

Certo, vamos passar da teoria para o que realmente tem de fazer. Abordar o campo minado legal da IA na publicidade é tudo sobre ter um processo sólido e repetível. Isto não é sobre sufocar a criatividade com burocracia; é sobre construir proteções para a sua equipa inovar com confiança.

Pense nesta lista de verificação como a sua rotina pré-voo antes de lançar qualquer campanha alimentada por IA. Ao integrar estes passos diretamente no seu fluxo de trabalho, cria uma base de conformidade que protege a sua marca, respeita os direitos individuais e mantém-o do lado certo dos reguladores. Vamos percorrê-la.

Passo 1: Audite a Sua Ferramenta de IA e os Seus Dados de Formação

Antes de sequer pensar em gerar uma imagem, tem de abrir o capô da sua plataforma de IA. A posição legal do seu anúncio final está diretamente ligada aos dados em que o modelo de IA foi treinado. Assumir que uma ferramenta paga é "segura" é uma aposta massiva e potencialmente muito dispendiosa.

Tem de fazer perguntas diretas ao seu fornecedor de IA e analisar realmente os seus termos de serviço. Qualquer fornecedor respeitável deve ser transparente sobre a origem dos seus dados.

- Exija Transparência de Dados: Pergunte-lhes diretamente: O seu modelo foi treinado com dados licenciados, de domínio público ou obtidos eticamente? Se obtiver uma resposta vaga e evasiva, isso é um sinal vermelho enorme.

- Verifique uma Cláusula de Indemnização: O fornecedor cobrirá as suas despesas legais se a ferramenta produzir algo que o leve a ser processado? Isto chama-se indemnização. Descobrirá que muitas plataformas colocam 100% do risco legal diretamente sobre si, o utilizador.

- Procure Ferramentas "Seguras para Uso Comercial": Algumas plataformas comercializam especificamente os seus modelos como seguros para uso comercial. Isto é frequentemente um bom sinal, pois geralmente significa que fizeram os trabalhos de casa sobre direitos de dados.

Passo 2: Obtenha Direitos e Consentimento Herméticos

Isto é inegociável. Se o seu anúncio envolver um dobro digital de uma pessoa real — ou mesmo um avatar que se pareça muito com alguém —, precisa de consentimento explícito. O seu antigo formulário de liberação de modelo não serve aqui. Os seus acordos agora precisam de ser específicos e pensar no futuro.

O nome do jogo é o consentimento informado. Tem de ser cristalino de que pretende criar e usar uma versão gerada por IA de uma pessoa, especificando exatamente como, onde e por quanto tempo. Qualquer ambiguidade nesse contrato é basicamente um convite aberto para um processo mais tarde.

Isto é mais do que obter uma assinatura; é sobre comunicação clara. Uma liberação de IA sólida como uma rocha deve cobrir todas as bases para prevenir dores de cabeça futuras.

- Especifique Geração por IA: O contrato tem de afirmar explicitamente que tem o direito de criar uma "réplica digital" ou "semelhança gerada por IA."

- Defina o Âmbito de Uso: Seja granular. Descreva em que plataformas o ator de IA aparecerá, os tipos de campanhas e a duração exata de uso.

- Aborde Direitos de Modificação: O contrato permite ajustar a performance da IA? Pode mudar o diálogo ou colocá-la em cenas completamente novas? Especifique.

Passo 3: Escrutine Cada Saída Gerada por IA

Uma vez que a IA cria algo para si, o verdadeiro trabalho começa. Cada imagem, vídeo e voiceover precisa de uma revisão humana. Esta é a sua última linha de defesa contra violação, e não a pode saltar.

Nunca assuma que só porque uma imagem é "nova", está legalmente limpa. Estes modelos podem — e fazem — imitar acidentalmente estilos, personagens ou até logótipos de marcas protegidos.

- Verifique "Semelhança Substancial": A saída parece ou soa um pouco demasiado próxima de uma personagem de filme famosa, uma peça de arte ou o estilo assinatura de um artista particular? Se o seu instinto disser que está demasiado próximo, provavelmente está. Descarte e gere uma nova.

- Procure Marcas Registadas: Olhe atentamente para os fundos. A IA inseriu um logótipo, um nome de marca ou uma forma de produto distinta?

- Ouça Semelhanças Vocais: Se estiver a gerar áudio, a voz soa assustadoramente semelhante a um ator famoso ou figura pública? Isso é uma potencial violação de direito de publicidade à espera de acontecer.

Passo 4: Implemente Divulgações Claras e Substitua Alegações

Finalmente, tem de ser honesto com o seu público e jogar pelas regras da FTC. Isto significa ser transparente sobre o uso de IA quando importa e, o mais importante, sustentar cada alegação do seu anúncio com provas sólidas.

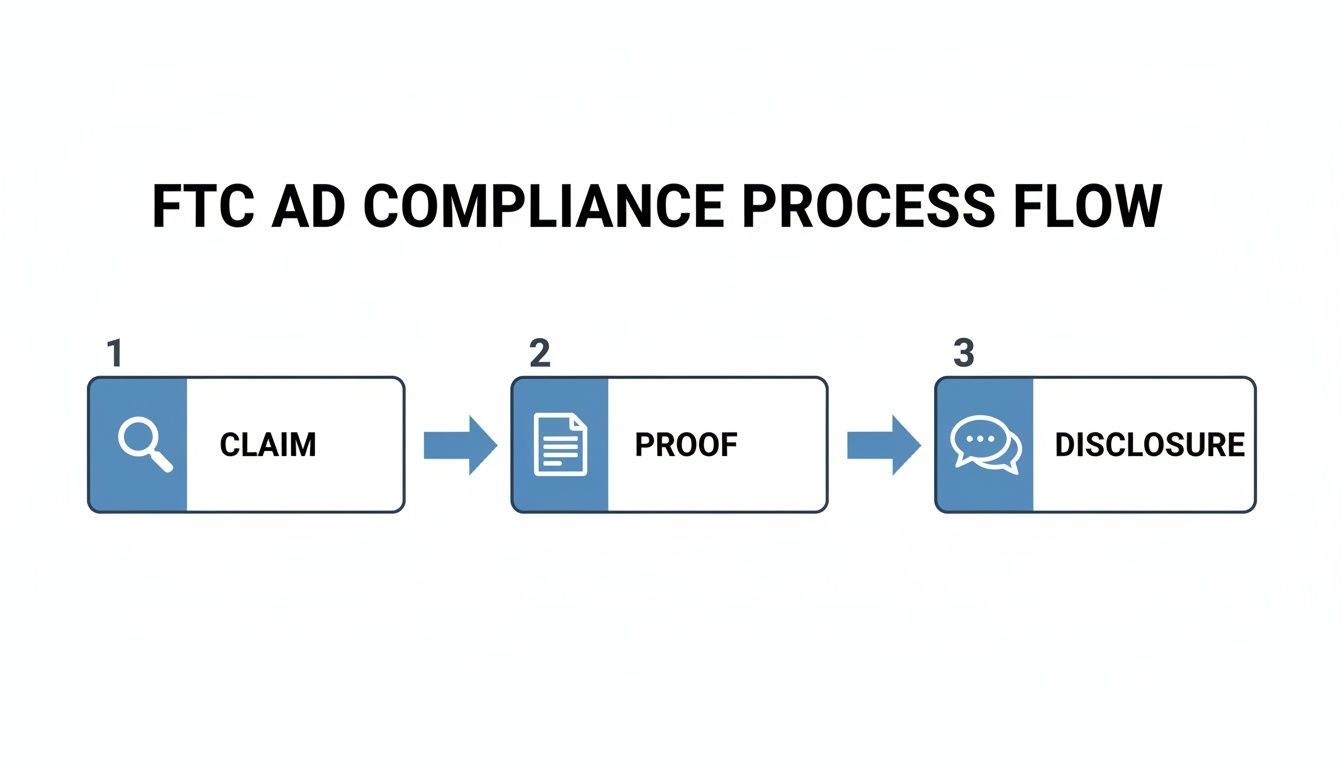

Este fluxograma simples decompõe a expectativa central da FTC para qualquer anúncio, alimentado por IA ou não.

É um ciclo direto: para cada alegação que faz, deve ter provas para a sustentar e fornecer uma divulgação clara. Este ciclo garante que a sua publicidade é verídica e defensável.

- Divulgue Quando Importa: Se uma pessoa típica pudesse ser enganada a pensar que o seu ator de IA é uma pessoa real — como um médico a dar conselhos médicos ou um cliente a elogiar um produto —, precisa de divulgar. Um simples #AIGenerated ou #AIAd pode resolver.

- Substitua Todas as Alegações: Cada declaração factual que o seu ator de IA faz precisa de provas. Se o seu porta-voz de IA disser que um produto é "50% mais eficaz", melhor ter o estudo clínico para o provar antes de o anúncio ver a luz do dia.

- Crie um Ficheiro de Substituição: Para cada campanha, crie o hábito de fazer um ficheiro que contenha todos os dados, estudos e provas que suportam as alegações do seu anúncio. Se a FTC aparecer à porta, esse ficheiro será o seu melhor amigo.

Perguntas Comuns Sobre Atores de IA na Publicidade

Entrar no mundo da publicidade alimentada por IA levanta frequentemente mais perguntas do que respostas. O lado legal ainda é um pouco como o Velho Oeste, o que pode tornar difícil sentir-se confiante nas suas decisões. Vamos abordar algumas das perguntas mais comuns que os marketeers fazem sobre os problemas legais dos atores de IA em anúncios. O meu objetivo aqui é dar-lhe respostas diretas para que possa construir campanhas mais inteligentes e seguras.

Preciso de Divulgar que o Meu Anúncio Usa um Ator de IA?

Cada vez mais, a resposta é sim. Embora não haja uma grande lei federal a obrigar a isso para todos os anúncios, o terreno está definitivamente a mudar. A melhor forma de pensar nisto é através da lente das regras da FTC contra práticas enganosas. Se não dizer a alguém que um ator é IA os enganaria, tem absolutamente de divulgar. Pense em usar um "médico" gerado por IA para promover um produto de saúde — o facto de o médico não ser real é uma questão importante.

Além disso, as plataformas já estão a decidir por si. Grandes players como Meta e YouTube agora exigem rótulos para conteúdo realista gerado por IA, pelo que a divulgação está a tornar-se um custo básico de fazer negócios.

Aqui está a regra simples que sigo: Se houver alguma possibilidade de uma pessoa comum ser enganada, adicione uma divulgação clara e simples como #AIGenerated. Isto não é só sobre seguir regras que possam vir aí; é sobre construir confiança com o seu público, que é inestimável.

Ser frontal gere expectativas e protege a sua marca, especialmente à medida que as pessoas se tornam mais perspicazes (e céticas) face à media sintética.

Posso Ser Processado se a Minha Ferramenta de IA Criar uma Imagem Violadora?

Com certeza. Um equívoco enorme é que, se a ferramenta de IA criar a confusão, o fornecedor da ferramenta é quem tem de limpar. Não é assim que a lei de direitos de autor funciona. A empresa que publica o anúncio violador — ou seja, a sua empresa — pode ser responsabilizada diretamente. Isto chama-se frequentemente responsabilidade secundária, e significa que partilha o risco legal.

Mesmo que a plataforma de IA também tenha problemas, isso não o livra da responsabilidade. É por isso que tem de ler os termos de serviço de qualquer ferramenta de IA que use. Algumas plataformas podem oferecer indemnização (o que significa que cobrirão as suas despesas legais), mas muitas estão redigidas para colocar toda a responsabilidade legal nos seus ombros como utilizador.

A sua melhor defesa é ser proativo. Escrutine cada imagem gerada por IA em busca de semelhanças estranhas com obras protegidas por direitos de autor existentes. E tente ficar com plataformas de IA transparentes sobre a origem dos seus dados de formação — aquelas que usam dados licenciados legalmente ou de domínio público são sempre uma aposta mais segura.

Qual é a Diferença Entre uma Foto Stock e uma Pessoa de IA?

A diferença chave resume-se à origem dos direitos legais. Quando licencia uma foto stock de uma pessoa, vem com uma liberação de modelo. Este é um documento legal em que a pessoa real na foto deu consentimento para a sua semelhança ser usada comercialmente. É a sua manta de segurança legal.

Uma pessoa gerada por IA não tem liberação de modelo porque, bem, não existe. Mas isto abre uma lata de vermes completamente nova de que não tem de se preocupar com fotos stock.

- Sósia Acidental: A imagem de IA pode parecer aleatoriamente com uma pessoa real, criando uma alegação surpresa de direito de publicidade que nunca viu vir.

- Minas de Direitos de Autor: A imagem em si pode ser contestada com base no que a IA aprendeu. Se o modelo foi treinado com uma base de dados de imagens protegidas, a sua "pessoa de IA original" pode ser legalmente considerada uma cópia violadora.

Essencialmente, com uma pessoa de IA, está a trocar um processo legal conhecido e claro (liberações de modelo) por um novo conjunto nebuloso de riscos ligados a direitos de autor e identidade.

Como Posso Criar com Segurança um Avatar de Marca de IA?

Se quiser criar um avatar ou influencer de marca de IA sem receber uma carta assustadora de um advogado mais tarde, precisa de um plano. Não pode improvisar.

Comece por garantir que o avatar é verdadeiramente único. Seja criativo com prompts detalhados e depois ajuste manualmente os resultados para direcionar o aspeto final para longe de qualquer pessoa real ou personagens existentes. Mantenha um registo deste processo criativo — pode ser uma prova crucial para demonstrar que pretendia criar algo totalmente original.

A seguir, dê ao seu avatar um nome e história únicos sem ligação a uma pessoa real. Faça uma pesquisa de marcas registadas para o nome do avatar e até para o seu design visual para garantir que não está a pisar os calos de outra marca.

Finalmente, examine os termos de serviço da sua ferramenta de IA. Precisa de ter a certeza de que lhe concedem propriedade comercial total ou, pelo menos, uma licença comercial ampla para tudo o que criar. Ser transparente com o seu público de que o avatar é de IA também irá longe em evitar problemas legais e de RP.

Pronto para criar anúncios de alto desempenho sem adivinhações legais e custos de produção elevados? ShortGenius é uma plataforma de anúncios de IA concebida para criadores e marketeers que precisam de produzir anúncios de vídeo e imagem de curta duração deslumbrantes para todas as principais plataformas sociais. Gere conceitos, guiões e visuais em segundos, personalize-os com o seu kit de marca e implemente campanhas que dão resultados. Experimente o ShortGenius hoje e comece a construir anúncios melhores, mais rápido.