Problemy prawne z aktorami AI w reklamie dla nowoczesnych marek

Poznaj najważniejsze kwestie prawne związane z aktorami AI w reklamie. Dowiedz się, jak radzić sobie z prawami do wizerunku, prawem autorskim i zgodnością z FTC dla swojej marki.

Witamy w nowej erze reklamy, gdzie aktorzy generowani przez AI przyciągają wzrok i zatrzymują przewijanie na mediach społecznościowych. Chociaż ta technologia otwiera świat kreatywnych możliwości, to również kładzie prawne miny pod nogi marek i twórców. Nawigacja po tych problemach prawnych z aktorami AI w reklamie jest teraz kluczową umiejętnością.

Nowa granica aktorów AI i prawne ryzyka

Prawo gra w szaloną grę w doganianie technologii. Marki mogą teraz wymarzyć i wygenerować całe kampanie wideo z udziałem syntetycznych ludzi, ale ta moc niesie ze sobą ciężar odpowiedzialności. Każdy element — od głosu, który brzmi aż nazbyt znajomo, po twierdzenie o produkcie napisane przez AI — ma realną wagę prawną.

Pomyśl o tym jak o samplingu muzycznym. Zanim wypuścisz nowy utwór, musisz uzyskać zgody na każdy zapożyczony bit, melodię i hook wokalny. To samo dotyczy reklamy AI. Musisz mieć prawa do każdego elementu swojej syntetycznej kreacji, w przeciwnym razie możesz narazić się na poważne kłopoty finansowe i szkodzące marce.

Dlaczego tradycyjne prawa reklamowe zawodzą

Niech będzie jasne: ramy prawne, na których opieraliśmy się od dekad, nie były stworzone dla świata z osobowościami generowanymi przez AI. To tworzy ogromną lukę i nowe, trudne wyzwania dla marketerów przyzwyczajonych do standardowych umów i zgód dla ludzkich talentów. Stare reguły nadal obowiązują, ale są rozciągane w sposób, jakiego wcześniej nie widzieliśmy.

Sprawa obejmuje szereg trudnych pytań, w tym niektórych o pierwszym znaczeniu. Niesie też potencjalnie ciężkie konsekwencje nie tylko dla aktorów głosowych, ale także dla rozwijającego się przemysłu AI, innych posiadaczy i użytkowników praw własności intelektualnej oraz zwykłych obywateli, którzy mogą obawiać się utraty kontroli nad własną tożsamością.

W tym nowym środowisku proaktywna świadomość prawna to nie tylko „miłe do posiadania” — to niezbędny filar każdej nowoczesnej strategii marketingowej. Zrozumienie ryzyk to pierwszy krok ku odpowiedzialnej innowacji i ochronie marki przed kosztowną ślepą plamą. Dla szerszego spojrzenia warto zbadać ogólny krajobraz prawny wokół AI.

Krótki przegląd kluczowych obszarów prawnych ryzyk

Aby to ogarnąć, warto rozłożyć główne wyzwania prawne. Każde z nich reprezentuje potencjalną pułapkę, która może całkowicie wywrócić genialną kampanię. Ta tabela daje szybki podsumowanie głównych prawnych bólów głowy, o których musisz wiedzieć, używając aktorów generowanych przez AI.

| Kluczowe obszary prawnych ryzyk dla AI w reklamie | ||

|---|---|---|

| Obszar prawny | Główne zagadnienie | Potencjalna konsekwencja |

| Prawa do wizerunku i publicity | Użycie osoby generowanej przez AI, która wygląda lub brzmi jak prawdziwa osoba bez zgody. | Pozwy od celebrytów lub zwykłych obywateli za przywłaszczenie ich tożsamości. |

| Własność intelektualna i prawa autorskie | Model AI trenowany na chronionych zdjęciach, wideo lub scenariuszach bez licencji. | Roszczenia o naruszenie praw autorskich, wysokie grzywny i nakazy usunięcia kampanii. |

| FTC i ujawnianie reklam | Brak ujawnienia, że endorsement pochodzi od aktora AI, wprowadzanie konsumentów w błąd. | Działania FTC, grzywny za mylącą reklamę, utrata zaufania konsumentów. |

| Zniesławienie i prywatność | AI tworzy treści, które fałszywie szkodzą reputacji osoby lub marki. | Pozwy o zniesławienie (libel/slander) i roszczenia o naruszenie prywatności. |

W skrócie, musisz myśleć o tym, skąd pochodzi twoja treść generowana przez AI i co ona komunikuje. Błąd w którymkolwiek z tych aspektów może prowadzić do poważnych problemów.

Oto główne kategorie obaw, które każda marka i twórca musi mieć na radarze:

- Prawa do wizerunku i publicity: To duża sprawa. Obejmuje nieautoryzowane użycie wizerunku, głosu lub innej cechy identyfikującej osobę. Nie ma znaczenia, jeśli AI tylko przypomina kogoś — to może wystarczyć, by uruchomić pozew.

- Własność intelektualna i prawa autorskie: To szybko się komplikuje. Kto faktycznie posiada treść stworzoną przez AI? A co ważniejsze, czy model AI był trenowany na górze chronionego materiału zebranego z internetu bez zgody?

- Reguły FTC i ujawnianie: Reguły Federalnej Komisji Handlu dotyczące prawdy w reklamie nie znikają. Reklamy muszą być prawdziwe i nie wprowadzać w błąd, w tym być przejrzyste, gdy aktor AI daje testimonial lub endorsement.

- Zniesławienie i prywatność: AI może zboczyć z toru i wygenerować fałszywe lub szkodliwe informacje o prawdziwych osobach lub konkurencyjnych markach. To szybko prowadzi do roszczeń o libel lub naruszenie prywatności.

Nawigacja po prawie do publicity w erze AI

Spośród wszystkich prawnych min związanych z aktorami AI, prawo do publicity jest prawdopodobnie największe. Pomyśl o tym w ten sposób: każdy ma osobistą markę i prawo do kontrolowania, jak jego imię, twarz, głos lub inna unikalna cecha — jego „wizerunek” — jest używana do zarabiania pieniędzy. W momencie, gdy twój aktor generowany przez AI nawet mgliście przypomina prawdziwą osobę, wchodzisz na pole minowe.

I nie chodzi tylko o stworzenie idealnego deepfake celebryty. Prawo często jest na tyle szerokie, by objąć „podobne głosy” i „podobne wyglądy”, które są na tyle podobne, by ktoś pomyślał o prawdziwej osobie. Jeśli twoja publiczność połączy twojego aktora AI z konkretną osobą, możesz odpowiedzieć za przywłaszczenie jej wizerunku.

Prawdziwy ból głowy dla twórców to sposób, w jaki buduje się te modele AI. Są trenowane na ogromnych ilościach danych, często zbieranych bezpośrednio z internetu. Oznacza to, że AI nauczyło się od niezliczonych prawdziwych twarzy i głosów, co czyni przypadkowe, niepokojące podobieństwo bardzo realnym ryzykiem.

Co liczy się jako użycie komercyjne

Zrozumienie, co oznacza „użycie komercyjne”, jest tu kluczowe. Nie chodzi tylko o umieszczenie twarzy generowanej przez AI na opakowaniu produktu. Za każdym razem, gdy używasz osoby AI w reklamie, by przyciągnąć uwagę i zwiększyć sprzedaż, to cel komercyjny. Szczególnie dotyczy to reklam w stylu UGC, które widzisz wszędzie na Instagramie i YouTube.

Na przykład, jeśli wygenerujesz syntetycznego influencera, który zachwyca się twoją nową linią pielęgnacji skóry, to bezpośrednie użycie komercyjne. Jeśli ten cyfrowy influencer przypadkiem wygląda uderzająco podobnie do prawdziwego twórcy, ten twórca ma mocny argument, że zarabiasz na jego wizerunku bez zgody lub zapłaty.

Sądy już zajmują się tymi bałaganem scenariuszami. Przełomowa sprawa In re Clearview AI Consumer Privacy Litigation to idealny przykład. Powodowie skutecznie argumentowali, że trenowanie AI do rozpoznawania twarzy na ponad 3 miliardach zdjęć zebranych z internetu naruszyło prawa do publicity w kilku stanach.

Orzeczenie sądu wysłało jasny sygnał: „użycie komercyjne” następuje, gdy tożsamości są używane do promowania produktu, nie tylko gdy są sprzedawane jako produkt. Jak szczegółowo opisano w tej analizie praw do publicity od Quinn Emanuel, to orzeczenie otworzyło drzwi dla pozwów zbiorowych z potencjalnie ogromnymi wypłatami.

Kluczowe kwestie dotyczące podobieństwa AI

Aby uniknąć uwikłania się w pozew o prawa do publicity, musisz być czujny. To nie jakaś abstrakcyjna teoria prawna; może prowadzić do paraliżujących opłat prawnych, wymuszonego usunięcia kampanii i poważnego ciosu w reputację marki.

Oto główne rzeczy, na które warto uważać:

- Podobieństwo do celebryty: To najbardziej oczywiste. Generowanie aktora AI, który wygląda lub brzmi jak sławna osoba, to proszenie się o kłopoty. Unikaj promptów typu „stwórz aktora, który wygląda jak [Imię Celebryty]”.

- Podobieństwo do influencera i mikro-influencera: Strefa ryzyka wykracza daleko poza gwiazdy filmowe z pierwszej ligi. Influencerzy z mediów społecznościowych zbudowali własne cenne osobiste marki, a ich prawa do publicity są równie chronione prawnie.

- Zwykli obywatele: Nawet jeśli twój charakter AI przypomina prywatną osobę, ta osoba ma prawa. Jeśli jej wakacyjne zdjęcia zostały nieświadomie wessane do danych treningowych AI, roszczenie może wciąż wypłynąć.

Prawne niebezpieczeństwo nie tkwi w intencji AI, ale w percepcji publiczności. Jeśli rozsądna osoba skojarzy twojego aktora AI z prawdziwą osobą, masz potencjalny problem prawny.

Praktyczne kroki do ochrony kampanii

Musisz być proaktywny, by chronić markę. Nie możesz zakładać, że narzędzie AI wypluje „bezpieczną” lub prawnie oczyszczoną twarz lub głos. Nie ma substytutu dla ludzkiego nadzoru i dobrze zdefiniowanego procesu przeglądu.

Przed wypuszczeniem każdej reklamy z aktorem AI, twój zespół musi przeprowadzić dokładną kontrolę podobieństwa. Oznacza to angażowanie wielu par oczu na finalnej kreacji, z konkretnym celem wykrycia potencjalnych podobieństw do postaci publicznych. Dokumentowanie tego procesu przeglądu może też dać ci warstwę ochrony prawnej, pokazując, że dopełniłeś należytej staranności.

Na koniec dnia, jedyną pewną obroną przed roszczeniem o prawo do publicity jest zapewnienie, że twoi aktorzy generowani przez AI są naprawdę oryginalni. To dodatkowy krok, ale niezbędny, by utrzymać kampanie bezpieczne przed kosztownymi bataliami prawnymi w przyszłości.

Kto posiada występ generowany przez AI?

Więc użyłeś AI do wygenerowania scenariusza, voiceoveru lub nawet całego wideo. Jest genialne. Ale wisi wielkie pytanie: kto faktycznie to posiada? Odpowiedź nie jest prosta i szczerze mówiąc, podważa fundamenty prawa autorskiego. Rozwiązanie tego jest kluczowe dla nawigacji po jednym z największych problemów prawnych z aktorami AI w reklamie.

Obecnie Amerykański Urząd ds. Praw Autorskich ma dość stanowcze stanowisko: dzieło potrzebuje ludzkiego autorstwa, by uzyskać ochronę autorską. Jeśli AI stworzy coś całkowicie samodzielnie, bez znaczącego kierowania procesem kreatywnym przez człowieka, generalnie nie dostanie praw autorskich. Oznacza to, że genialny koncept reklamowy, który właśnie wypluło twoje AI, może nie być prawnie twój.

To tworzy poważny ból głowy dla marketerów. Jeśli nie posiadasz praw autorskich, co powstrzyma konkurenta przed uruchomieniem niemal identycznej reklamy generowanej przez AI? Twoja unikalna kampania i wszystkie zainwestowane w nią pieniądze mogą być na sprzedaż.

Ghostwriter i narzędzie

Dobry sposób myślenia o tym to postrzeganie AI jako superzaawansowanego ghostwritera lub bardzo wyrafinowanego pędzla. Narzędzie samo nie posiada ukończonej książki ani obrazu. Własność zależy od tego, ile kreatywnego kierunku i oryginalnego wkładu pochodzi od osoby używającej narzędzia.

Jeśli dasz nieprecyzyjny prompt typu „stwórz reklamę wideo dla nowych butów sportowych”, AI wykonuje większość ciężkiej pracy. Wyjście jest w większości maszynowe. Ale jeśli to ty pieczołowicie tworzysz szczegółowe prompty, selekcjonujesz wyjścia i dokonujesz znaczących edycji, by to wszystko połączyć, twój przypadek na autorstwo staje się dużo mocniejszy. Im więcej ludzkiej kreatywności wstrzykujesz, tym lepiej masz szanse na uzyskanie praw autorskich.

Kluczowe wnioski dla twórców: twój poziom bezpośredniego, kreatywnego zaangażowania w proces generowania AI buduje podstawę do własności. Proste naciśnięcie przycisku „generate” nie wystarczy, by być uznanym za autora.

Cała ta debata o tym, kto posiada wyjście AI, jest częścią znacznie większej rozmowy o ochronie praw własności intelektualnej w naszym coraz bardziej cyfrowym świecie. W miarę jak te narzędzia stają się normalną częścią pracy kreatywnej, ustalenie, gdzie kończy się ludzkie autorstwo, a zaczyna maszynowa kreacja, będzie centralnym polem bitwy prawnej.

Bałagan z danymi treningowymi

Puzzle własności stają się jeszcze trudniejsze, gdy zajrzysz pod maskę danych treningowych modelu AI. Wiele narzędzi generatywnych AI uczy się, zbierając kolosalne ilości danych z internetu — które oczywiście obejmują chronione obrazy, artykuły, muzykę i wideo. To otwiera bardzo realne ryzyko, że wyjście AI może być uznane za „dzieło pochodne” chronionego materiału kogoś innego.

I to nie jest tylko teoretyczny problem. Na przykład aktorzy głosowi Paul Lehrman i Linnea Sage pozwali Lovo Inc., twierdząc, że firma użyła ich nagrań głosowych bez zgody do trenowania i sprzedaży klonów głosów AI. Sąd pozwolił większości ich roszczeń iść dalej, co naprawdę podkreśla poważne narażenie prawne, gdy dane treningowe AI naruszają istniejące prawa.

Co to oznacza dla ciebie? Oznacza to, że twoja błyszcząca nowa reklama generowana przez AI może przypadkowo zawierać elementy naruszające prawa autorskie innego twórcy, narażając twoją markę na pozew.

Czy możemy to nazwać „fair use”?

Niektórzy deweloperzy i użytkownicy argumentują, że używanie chronionego materiału do trenowania AI jest objęte doktryną prawną „fair use”. Fair use pozwala na ograniczone użycie chronionych dzieł bez zgody w celach takich jak krytyka, komentarz czy badania.

Cała debata w świecie AI sprowadza się do kilku kluczowych pytań:

- Czy jest transformacyjne? Czy wyjście AI tworzy coś zasadniczo nowego, czy to tylko high-tech kopia oryginalnego materiału, na którym było trenowane?

- Czy szkodzi rynkowi? Czy dzieło generowane przez AI konkuruje z lub dewaluuje oryginalne chronione dzieło?

Sądy wciąż pracują nad tymi pytaniami, a grunt prawny jest chwiejny w najlepszym razie. Opieranie się na obronie fair use dla komercyjnej reklamy — która jest explicite stworzona do zarabiania pieniędzy — to duża gra w ruletkę. Dopóki prawo nie stanie się jaśniejsze, najbezpieczniejszym zakładem jest praca z narzędziami AI, które są przejrzyste co do swoich danych treningowych i idealnie oferują ci ochronę przed potencjalnymi roszczeniami autorskimi.

Pozostawanie po właściwej stronie FTC

Teraz porozmawiajmy o Federalnej Komisji Handlu (FTC). Bez względu na to, czy twoja reklama została wymyślona w sali konferencyjnej czy wygenerowana przez algorytm, podstawowa reguła jest ta sama: musi być prawdziwa i nie wprowadzać w błąd. Ta prosta idea staje się dużo bardziej skomplikowana, gdy wrzucisz do miksu aktorów AI.

Zadanie FTC to ochrona konsumentów. Gdy reklama zawiera syntetyczną osobę lub wypluwa twierdzenie stworzone przez AI, potencjał do wprowadzenia w błąd jest ogromny. Dlatego jasne, z góry ujawnienia nie są już tylko miłym dodatkiem; są niezbędne do pozostania zgodnym.

Nakaz prawdy w reklamie

W sercu wszystkiego jest Sekcja 5 Ustawy FTC, która zakazuje „nieuczciwych lub mylących czynów lub praktyk”. Oznacza to, że potrzebujesz solidnych dowodów na każde twierdzenie — wyraźne lub implikowane — przed tym, jak twoja reklama ukaże się światu. Ta reguła dotyczy treści generowanych przez AI tak samo jak tradycyjnej reklamy TV.

Już widzimy wzrost pozwów o fałszywą reklamę na podstawie Lanham Act, celujących konkretnie w reklamy używające deepfake celebrytów. Regulatorzy i sądy spieszą, by nadążyć za mocą AI do oszukiwania. FTC już wszczęła działania egzekucyjne przeciwko firmom za fałszywe twierdzenia AI, jak przesadne przedstawianie, co produkt może zrobić, lub po prostu przyklejanie etykiety „powered by AI” bez dowodu.

Hogan Lovells analiza AI i deepfake reklam podkreśla, jak ostro te pozwy wzrosły, dowodząc, że regulatorzy bardzo pilnie obserwują tę przestrzeń.

Halucynacje AI i fałszywe twierdzenia

Jednym z największych pól minowych jest zjawisko „halucynacji AI”. To gdy model AI z pewnością wymyśla „fakty”, tworząc korzyści produktu, cechy lub nawet testimonials użytkowników z niczego.

Wyobraź sobie, że prosisz AI o napisanie scenariusza dla nowego suplementu zdrowotnego. Może wygenerować linię twierdzącą, że produkt jest „klinicznie udowodniony, by zwiększyć metabolizm o 40%”. Jeśli nie masz wiarygodnych badań naukowych potwierdzających dokładnie tę liczbę, właśnie przekroczyłeś linię fałszywej reklamy.

Reklamodawca — nie AI — jest 100% prawnie odpowiedzialny za każde twierdzenie. Mówienie FTC „AI to napisało” nie jest obroną, która cię uratuje. Musisz niezależnie zweryfikować każde faktyczne stwierdzenie.

To kluczowy punkt kontrolny. Twój zespół potrzebuje kuloodpornego procesu weryfikacji faktów dla wszystkich treści generowanych przez AI, zanim pójdą publicznie.

Ujawnianie aktorów AI i endorsementów

Przejrzystość jest wszystkim, gdy zaangażowany jest aktor AI. Jeśli twoja reklama pokazuje syntetyczną osobę dającą testimonial, konsumenci muszą wiedzieć, że ta osoba nie jest prawdziwa.

Oto kilka sytuacji, gdzie ujawnienie jest absolutnie niezbędne:

- Testimonials AI: Jeśli charakter generowany przez AI mówi „Ten produkt zmienił moje życie”, musi być oczywiste, że to nie prawdziwy klient.

- Syntetyczni influencerzy: Marki pracujące z wirtualnymi influencerami nie mogą przedstawiać ich jako prawdziwych ludzi z autentycznymi doświadczeniami z produktem.

- Deepfake endorsementy: Użycie deepfake celebryty do endorsementu bez wyraźnej zgody to pewny sposób na naruszenie ich praw do publicity i złamanie reguł FTC.

FTC oferuje mnóstwo zasobów na swojej stronie, by pomóc firmom zrozumieć ich obowiązki.

Jak jasno pokazuje portal wskazówek biznesowych FTC, stare zasady reklamy nadal obowiązują, wzmacniając potrzebę prawdy i dowodów dla wszystkich twierdzeń, w tym tych pochodzących z AI.

Oto szybka checklist do sprawdzenia reklam generowanych przez AI pod kątem zgodności z FTC:

- Uzasadnienie twierdzeń: Czy masz solidne dowody na udowodnienie każdego faktycznego twierdzenia w reklamie? Obejmuje to statystyki wydajności, „udowodnione” korzyści lub porównania.

- Jasne ujawnienia: Czy dla przeciętnej osoby jest natychmiast oczywiste, że aktor, testimonial lub endorsement jest generowany przez AI? Nie chowaj tego w drobnym druczku — zrób to jasne i widoczne.

- Unikaj mylących formatów: Czy twoja reklama jest zaprojektowana, by wyglądać jak raport newsowy, post z mediów społecznościowych prawdziwego użytkownika lub niezależna recenzja? Jeśli może wprowadzić konsumenta w błąd, to problem.

- Przegląd implikowanych twierdzeń: Co ktoś rozsądny może wynieść z twojej reklamy, nawet jeśli nie stwierdzisz tego wprost? Te implikowane twierdzenia też muszą być prawdziwe i poparte dowodami.

Jeśli traktujesz każdą treść generowaną przez AI z taką samą prawną uwagą jak pracę ludzką, możesz innowować z pewnością i pozostać po właściwej stronie prawa.

Praktyczny framework do minimalizacji ryzyk prawnych

Znać ryzyka to jedno; zarządzać nimi na co dzień to zupełnie inna sprawa. Jeśli chcesz bezpiecznie nawigować po polu minowym aktorów AI w reklamie, twój zespół potrzebuje jasnego, powtarzalnego frameworka. To nie o duszenie kreatywności — to o budowanie barierek, które pozwalają zespołowi innowować z pewnością.

Po pierwsze: oceń swoje narzędzia AI. Zanim podpiszesz umowę z jakąkolwiek platformą, wgłęb się w ich warunki usługi. Musisz dokładnie wiedzieć, skąd pochodzą ich dane treningowe i jakie prawa faktycznie dostajesz nad treścią, którą tworzysz. Niektórzy dostawcy oferują nawet indemnizację, co jest ogromnym plusem, bo może cię osłonić przed roszczeniami autorskimi w przyszłości.

Opracuj jasną politykę użytkowania AI

Gdy narzędzia są posegregowane, czas stworzyć wewnętrzną Politykę użytkowania AI. Pomyśl o tym jako o oficjalnym playbooku dla zespołu. Musi być prosta, bezpośrednia i określać do’s and don’ts używania generatywnego AI w kampaniach reklamowych.

Twoja polityka powinna przybić kilka kluczowych rzeczy:

- Zatwierdzone narzędzia: Zrób listę konkretnych platform AI, z których zespół może korzystać. To zapobiega używaniu niezatwierdzonych narzędzi, które mogą narazić cię na niepotrzebne ryzyko.

- Zabronione wejścia: Uczyń to krystalicznie jasne: nikt nie powinien nigdy wprowadzać poufnych informacji firmy, danych klientów lub sekretów handlowych do promptu AI.

- Ograniczenia podobieństwa: Ustal twardą regułę: żadnych promptów proszących AI o naśladowanie wizerunku lub głosu jakiejkolwiek prawdziwej osoby, celebryty czy nie.

- Przegląd i zatwierdzenie: Każda treść reklamowa generowana przez AI musi przejść obowiązkowy proces przeglądu ludzkiego, zanim ujrzy światło dzienne.

Ta polityka to twoja pierwsza linia obrony. Wyrównuje wszystkich na tej samej stronie, działając pod tymi samymi wytycznymi świadomymi bezpieczeństwa.

Nakazuj ludzki nadzór zawsze

Nie obchodzi mnie, jak mądre wydaje się narzędzie AI; to żaden substytut ludzkiego osądu. Każda reklama zrobiona z AI musi być sprawdzona przez prawdziwą osobę pod kątem zgodności prawnej, dokładności faktycznej i bezpieczeństwa marki. Podejście „human-in-the-loop” nie jest opcjonalne.

Ludzki nadzór to twoja ostateczna sieć bezpieczeństwa. AI nie rozumie niuansów prawnych, reputacji marki czy wytycznych FTC, ale twój zespół tak. Każda treść generowana przez AI jest odpowiedzialnością twojej firmy w momencie, gdy staje się publiczna.

Zadanie recenzenta to być ostatecznym strażnikiem. Jest tam, by złapać potencjalne katastrofy — jak przypadkowe podobieństwo, nieudowodnione twierdzenie czy mylący język — zanim staną się bardzo realnymi, bardzo drogimi publicznymi problemami.

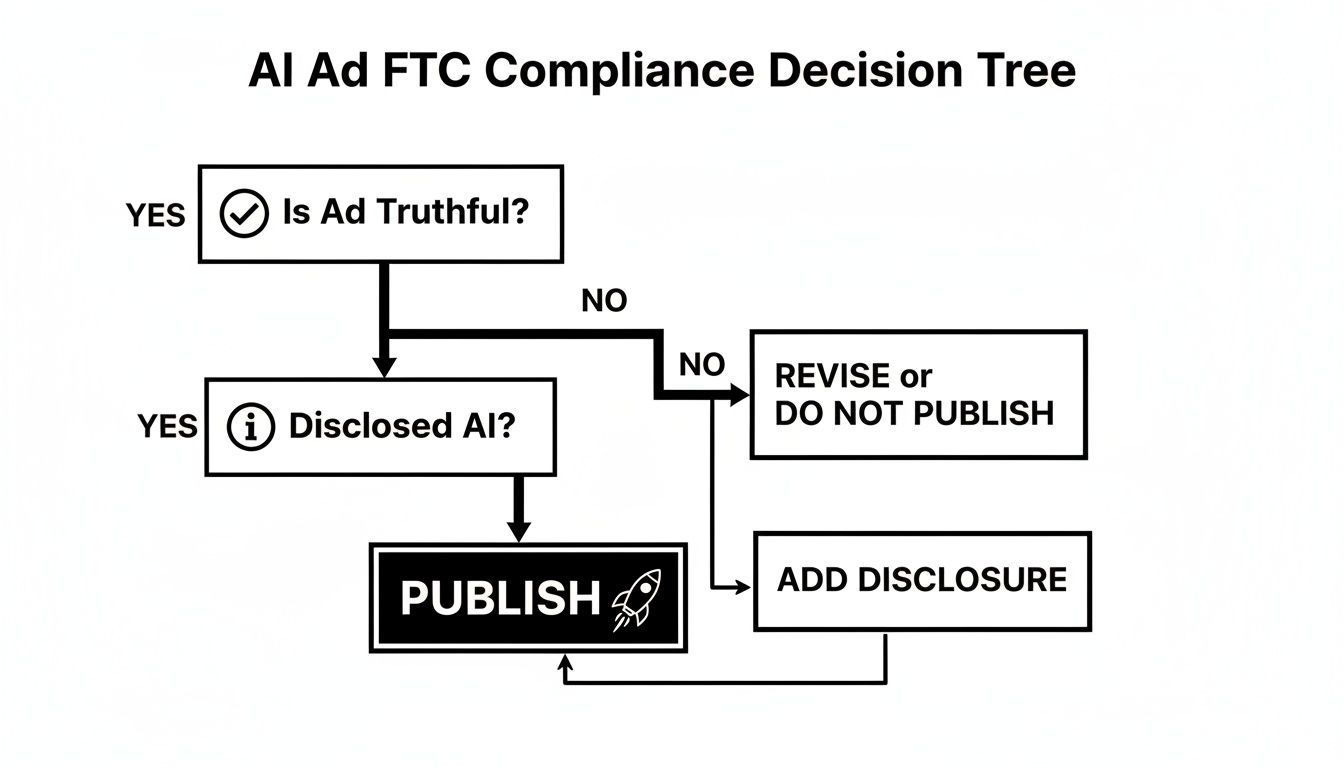

To drzewo decyzyjne daje uproszczoną kontrolę zgodności z regułami FTC przed publikacją reklamy opartej na AI.

Jak pokazuje grafika, prawdomówność i jasne ujawnienie to absolutny, niepodważalny fundament każdej reklamy z udziałem AI.

Lista kontrolna przed publikacją dla twórców

Aby to uczynić martwo prostym dla zespołu, daj im szybką checklistę do przejścia przed wypuszczeniem dowolnej reklamy generowanej przez AI na platformach jak Facebook czy Instagram.

- Skan podobieństwa: Czy co najmniej dwie różne osoby obejrzały reklamę, by upewnić się, że nie przypomina prawdziwej osoby?

- Uzasadnienie twierdzeń: Czy możemy poprzeć każde faktyczne twierdzenie w tekście reklamy lub voiceoverze twardymi dowodami?

- Ujawnienie AI: Jeśli używamy aktora AI do testimonialu lub endorsementu, czy ujawnienie jest niemożliwe do przeoczenia?

- Sprawdzenie praw autorskich: Czy jest coś w wyjściu, co wygląda, jakby zostało podkradzione z chronionego dzieła kogoś innego?

- Zgodność z marką: Czy ta reklama faktycznie brzmi i czuje się jak nasza marka? Czy zgadza się z naszymi wartościami i przekazem?

Wplatając te kroki w swój workflow — ocenę narzędzi, ustalanie polityki, nakaz przeglądu ludzkiego i używanie finalnej checklisty — budujesz silny system do zarządzania największymi zagrożeniami prawnymi. Ten framework cię nie spowalnia; upoważnia zespół do kreatywności z AI, trzymając markę z dala od unikniętych kłopotów prawnych.

Przyszłościowe zabezpieczenie strategii reklamowej AI

Grunt prawny pod reklamą AI ciągle się przesuwa. By wyprzedzać, traktuj zgodność nie jako obowiązek, ale genuine przewagę konkurencyjną. Oznacza to budowanie przejrzystości, zgody i solidnego uzasadnienia prosto w serce procesu kreatywnego od pierwszego dnia.

Nowe prawa pojawiają się cały czas, od federalnych reguł deepfake po stanowe akty prywatności. Ale przez wszystko jedna fundamentalna prawda się nie zmieni: reklamodawca jest zawsze odpowiedzialny za treść reklamy. Przyjęcie tego to pierwszy krok ku zarządzaniu problemami prawnymi z aktorami AI w reklamie.

Proaktywna zgodność prawna to nie strach przed AI — to zdobywanie zaufania konsumentów. Gdy marka jest otwarta co do używania AI i ostrożna w twierdzeniach, jest w dużo lepszej pozycji do budowania trwałej lojalności i unikania drogich starć z regulatorami.

Od ryzyka prawnego do przewagi kreatywnej

Łatwo widzieć te prawne barierki jako blokadę kreatywności, ale to błędne spojrzenie. Pomyśl o nich jako fundamencie mądrej, zrównoważonej innowacji. Gdy zespół zrozumie reguły drogi, może eksperymentować swobodnie i przesuwać granice kreatywności w bezpiecznym frameworku.

Na przykład, wyobraź sobie szybkie testowanie setek wariacji reklam dla nowej kampanii. Ponieważ masz solidny proces przeglądu human-in-the-loop, wiesz, że wszelkie potencjalne naruszenia podobieństwa czy niepoparte twierdzenia zostaną złapane na długo przed publikacją. To połączenie niesamowitej prędkości AI z ostrym ludzkim nadzorem to miejsce, gdzie dzieje się prawdziwa magia, zwłaszcza w performance marketingu.

To odpowiedzialne podejście zapewnia, że twój kreatywny silnik nie stanie się prawnym zobowiązaniem. Będąc na bieżąco z regułami i wplatając etyczne praktyki w workflow, możesz pewnie używać AI do tworzenia wysokowydajnych reklam, które są zarówno przekonujące, jak i prawnie solidne.

Ostatecznie celem jest stworzenie systemu, gdzie prawna staranność i kreatywny blask to dwie strony tej samej monety. Ta zintegrowana strategia pozwala marce zbierać nagrody z reklamy napędzanej AI, osłaniając ją przed bardzo realnymi ryzykami, zapewniając, że wysiłki marketingowe budują wartość marki, a nie rachunki prawne.

Najczęściej zadawane pytania

Wkroczenie w świat reklamy napędzanej AI może wydawać się nawigacją po polu minowym nowych pytań. Rozbijmy niektóre z najczęstszych obaw prawnych, które mają marketerzy w związku z używaniem aktorów AI.

Czy muszę ujawniać używanie aktora AI?

Tak, absolutnie. Przejrzystość to nie tylko dobry pomysł — to prawna konieczność. Federalna Komisja Handlu (FTC) jasno stwierdziła, że reklama nie może być myląca. Jeśli używasz nieistniejącej osoby generowanej przez AI do testimonialu, a konsumenci myślą, że oglądają prawdziwego klienta, przekroczyłeś linię wprowadzania w błąd.

Najlepszą praktyką jest zawsze jasne i widoczne ujawnienie. Prosta notka na ekranie jak „Aktor generowany przez AI” lub „Obraz stworzony z AI” to wszystko, czego potrzeba. Ten prosty krok chroni zaufanie konsumentów, trzyma cię po właściwej stronie prawa i zabezpiecza integralność marki.

Czy mogę być pozwany, jeśli aktor AI przypadkowo wygląda jak ktoś?

To ogromna sprawa, a odpowiedź to zdecydowane „może”. Tu sprawy robią się tricky z prawem do publicity. Jeśli twój charakter generowany przez AI ostatecznie wygląda bardzo podobnie do prawdziwej osoby (zwłaszcza celebryty), możesz znaleźć się w prawnych tarapatach.

Ta osoba może argumentować, że używasz jej wizerunku do sprzedaży produktu bez zgody. Kluczem do uniknięcia tego jest rock-solid proces przeglądu ludzkiego. Ktoś z zespołu musi dać finalnej kreacji przelotny przegląd specjalnie po to, by wychwycić przypadkowe podobieństwa przed naciśnięciem „publish”.

Kluczowy test prawny nie dotyczy twojej intencji; dotyczy tego, jak widzi to publiczność. Jeśli rozsądna osoba może powiązać twojego aktora AI z prawdziwą osobą, jesteś otwarty na potencjalny pozew.

Kto jest prawnie odpowiedzialny za twierdzenia zrobione przez AI?

Ty. Zawsze. Marka za reklamą jest ostatecznie odpowiedzialna za każde pojedyncze twierdzenie, niezależnie czy wypowiedziane przez człowieka czy AI. Jeśli twój aktor AI powie, że twój produkt jest „o 50% skuteczniejszy”, lepiej miej dane, by to poprzeć.

Nie możesz winić „halucynacji AI” — gdy model po prostu wymyśla rzeczy — jeśli FTC zapuka. To nie jest obrona prawna. Dlatego ludzki nadzór jest niepodważalny; każdy fakt, liczba i twierdzenie musi być zweryfikowany przez prawdziwą osobę, zanim reklama ujrzy światło dzienne.

Gotowy do tworzenia wysokowydajnych reklam bez prawnych bólów głowy? ShortGenius pomaga ci szybko generować oszałamiające kampanie wideo w stylu UGC, dając ci kontrolę, by zapewnić zgodność. Poznaj nasze narzędzia i zacznij budować bezpieczniejsze, skuteczniejsze reklamy już dziś. Dowiedz się więcej na https://shortgenius.com.