Przewodnik po kwestiach prawnych związanych z aktorami AI w reklamie

Poznaj kwestie prawne związane z aktorami AI w reklamie. Nasz przewodnik omawia prawa autorskie, prawa do wizerunku i przepisy FTC, aby Twoje kampanie były zgodne z prawem i bezpieczne.

Używanie aktorów AI w swoich reklamach otwiera świat kreatywnych możliwości, ale absolutnie musisz zrozumieć główne kwestie prawne związane z aktorami AI w reklamie, zanim wskoczysz w to na główkę. Największe pola minowe to naruszenie praw autorskich związane z danymi treningowymi AI, przypadkowe naruszenie prawa do wizerunku prawdziwej osoby i kary za wprowadzające w błąd praktyki zgodnie z zasadami FTC i nowymi stanowymi ustawami o deepfake'ach. Doprowadzenie tego do porządku od samego początku to jedyny sposób na uniknięcie bardzo kosztownego prawnego bałaganu.

Nowe ryzyka prawne związane z aktorami AI w reklamie

Wchodzenie w świat reklamy opartej na AI jest ekscytujące, nie ma co do tego wątpliwości. Ale to jak spacer po labiryncie prawnych pułapek, o których nawet nie wiedziałeś. Pomyśl o tym w ten sposób: jesteś reżyserem, ale niewidzialne ramy prawne, takie jak prawa autorskie, prawa do wizerunku i prawa ochrony konsumenta, pociągają za sznurki. Jeśli je zignorujesz, cała twoja kampania może runąć z kretesem.

Ten nowy teren niesie ryzyka, z którymi tradycyjna reklama nigdy się nie spotkała. Twoja marka może zostać pozwana za naruszenie praw autorskich tylko dlatego, że model AI był trenowany na chronionych obrazach bez pytania o zgodę. To również szokująco łatwe, by twarz wygenerowana przez AI wyglądała trochę zbyt podobnie do prawdziwej osoby, co może wywołać pozew o kradzież jej wizerunku.

Kluczowe wyzwania prawne, na które trzeba się przygotować

Kwestie prawne związane z aktorami AI to już nie tylko hipotezy; prowadzą do rzeczywistych wycofań kampanii, ogromnych kar i poważnych szkód dla reputacji marki. Zrozumienie, z czym masz do czynienia, to pierwszy krok do stworzenia strategii reklamowej, która jest zarówno innowacyjna, jak i zgodna z prawem.

Oto przegląd tego, na co musisz uważać:

- Naruszenie praw autorskich: Czy AI trenowało się na chronionych zdjęciach lub sztuce? Jeśli tak, twoja ostateczna reklama może być prawnie uznana za „dzieło pochodne”, co naraża cię na odpowiedzialność za naruszenie.

- Naruszenia prawa do wizerunku: Jeśli twój aktor AI nawet luźno przypomina prawdziwą osobę – jej twarz, głos lub ogólny styl – możesz stanąć przed sądem za używanie jej wizerunku w celach komercyjnych bez zgody.

- Wprowadzające w błąd praktyki reklamowe: Federalna Komisja Handlu (FTC) jest krystalicznie jasna: reklamy muszą być prawdziwe. Używanie aktorów AI do fałszywych wideo-testimoniali lub sugerowania endorsementu, który nigdy nie miał miejsca, to szybka droga do kłopotów.

- Nawigacja po ustawach o deepfake'ach: Coraz więcej stanów wprowadza prawa ograniczające media syntetyczne. To tworzy chaotyczną mozaikę regulacji, która zmienia się w zależności od miejsca, gdzie jest twoja publiczność.

Aby pomóc ci lepiej zrozumieć, oto szybkie podsumowanie głównych prawnych przeszkód, z którymi się zmierzysz.

Kluczowe ryzyka prawne związane z aktorami AI w skrócie

| Obszar ryzyka prawnego | Co to oznacza dla twoich reklam | Potencjalne konsekwencje |

|---|---|---|

| Naruszenie praw autorskich | Model AI używał chronionych obrazów do treningu, co czyni twoją reklamę potencjalnym „dziełem pochodnym”. | Pozwy, żądania usunięcia i odszkodowania finansowe. |

| Prawo do wizerunku | Twój aktor AI przypadkowo przypomina twarz, głos lub charakterystyczną osobowość prawdziwej osoby. | Działania prawne ze strony osoby prywatnej za nieautoryzowane użycie jej wizerunku w celach komercyjnych. |

| FTC i wprowadzające w błąd reklamy | Używanie AI do tworzenia fałszywych testimoniali, mylących demonstracji produktów lub fałszywych endorsementów. | Wysokie kary FTC, sankcje prawne i poważne szkody dla reputacji marki. |

| Ustawy o deepfake'ach i ochronie prywatności | Naruszanie nowych ustaw stanowych regulujących tworzenie i używanie mediów syntetycznych. | Kary cywilne lub karne, w zależności od stanu i charakteru naruszenia. |

Zrozumienie i nawigacja po tych ryzykach to nie tylko unikanie kar; to budowanie zaufania w erze, w której konsumenci są coraz bardziej sceptyczni wobec tego, co widzą online.

Proaktywne zajmowanie się tymi ryzykami przekształca prawne przeszkody w przewagę konkurencyjną. Zgodne z prawem podejście nie tylko chroni twój biznes, ale także buduje zaufanie u publiczności, która jest coraz bardziej ostrożna wobec treści syntetycznych.

Ostatecznie celem jest wykorzystanie niesamowitej mocy AI bez wpadania w oczywiste prawne pułapki. To ekosystem, który obejmuje również firmy tworzące te potężne narzędzia. Jeśli chcesz zobaczyć przykład, kto działa w tej branży, sprawdź stronę główną copycat247. Będąc na bieżąco i tworząc jasny plan zgodności, możesz innowacyjnie działać z pewnością.

Pole minowe praw autorskich ukryte w danych treningowych AI

Jeśli chodzi o AI w reklamie, największym prawnym bólem głowy jest naruszenie praw autorskich. Cały problem zaczyna się od tego, jak te modele faktycznie się uczą. Generatywne AI nie wymyśla rzeczy z niczego; jest trenowane na ogromnych zbiorach danych, często zawierających miliony obrazów, wideo i tekstów pobranych prosto z internetu. To tam zaczyna się kłopot.

Wyobraź sobie model AI jako muzyka, który słucha każdej istniejącej piosenki, by nauczyć się komponować. Jeśli potem wypluje nową melodię, która brzmi podejrzanie podobnie do słynnej, chronionej prawem autorskim, przekroczył granicę. Dokładnie ta sama zasada działa tutaj. Twoja reklama może być zbudowana na fundamencie nieautoryzowanego materiału, o czym nawet nie wiesz.

Ta ukryta odpowiedzialność oznacza, że nawet przy najlepszych intencjach twoja marka może odpowiedzieć za naruszenie praw autorskich. Aktor lub scena wygenerowana przez AI w twojej reklamie może być technicznie „dziełem pochodnym” – nową kreacją zbyt bliską istniejącemu chronionemu utworowi. I nie masz pojęcia, na czym się trenował, by to wytworzyć.

Mętne wody „istotnego podobieństwa”

W sądzie test na naruszenie praw autorskich często sprowadza się do koncepcji zwanej „istotnym podobieństwem”. Nie chodzi o udowodnienie, że AI zrobiło kopię piksel w piksel. To znacznie bardziej niejasne. Prawdziwe pytanie brzmi, czy zwykła osoba patrząc na wynik AI rozpozna, że został skopiowany z chronionego utworu.

Dla reklamodawcy ta niepewność to ogromne ryzyko. Jeśli AI wygeneruje postać do twojej kampanii, która ma ten sam dziwaczny, rozpoznawalny styl co słynna postać z kreskówki, możesz szykować się na pozew. Oryginalny artysta nie musi udowadniać dokładnej replikacji; wystarczy, że „całkowita koncepcja i wrażenie” są takie same.

Bitwy prawne już nabierają tempa. Pod koniec 2025 r. w USA zgłoszono około 47 pozwów o prawa autorskie przeciwko firmom AI, wiele z nich jako zbiorowe. W głośnych przykładach firmy jak Disney i Universal Studios twierdzą, że narzędzia AI trenowały się na ich blockbusterach bez zgody, tworząc poważny łańcuch ryzyka dla każdego, kto używa wizualizacji z tych narzędzi.

Dlaczego nie możesz liczyć na obronę „fair use”

Firmy AI często bronią się, twierdząc, że ich proces treningowy to „fair use”, doktryna prawna pozwalająca na ograniczony użytek chronionego materiału w celach takich jak badania czy komentarz. Ale ten argument staje się niezwykle słaby, gdy wynik AI jest używany komercyjnie – jak w reklamie.

Sądy biorą pod uwagę cztery kluczowe czynniki, by zdecydować, czy coś jest fair use:

- Cel użycia: Czy dla zysku, czy edukacyjny? Reklama to czysto komercyjna działalność, co jest dużym minusem dla roszczenia fair use.

- Charakter oryginalnego utworu: Używanie twórczych dzieł jak zdjęcia czy ilustracje jest znacznie trudniejsze do obrony niż faktyczne dane.

- Ilość wykorzystanego utworu: Czy model AI skopiował „serce” oryginalnego dzieła, nawet jeśli nie całość?

- Wpływ na rynek: Czy obraz wygenerowany przez AI szkodzi zdolności oryginalnego twórcy do sprzedaży lub licencjonowania swojego dzieła? Jeśli twój obraz AI zastępuje potrzebę kupna zdjęcia stockowego, to jasna szkoda rynkowa.

Dla marketerów opieranie się na obronie fair use to zakład, którego prawie na pewno nie wygrasz. Komercyjny charakter kampanii reklamowej praktycznie zatapia argument od samego początku. Aby lepiej zrozumieć ochronę własnych aktywów kreatywnych, warto spojrzeć na szersze kwestie własności intelektualnej.

Kluczowy problem to nie tylko to, co AI tworzy, ale na czym się uczyło. Jeśli dane treningowe są prawnie wątpliwe, każdy kawałek treści, który generuje, przenosi to dziedziczone ryzyko bezpośrednio do twoich kampanii reklamowych.

Ostatecznie ciężar spada na ciebie – reklamodawcę – by zadać trudne pytania o pochodzenie twoich aktywów AI. Wybieranie platform AI używających licencjonowanych lub etycznie pozyskanych danych treningowych to nie tylko robienie właściwej rzeczy; to kluczowa prawna tarcza dla twojej marki.

Ochrona tożsamości ludzkiej w erze AI

Przechodząc poza prawa autorskie, kwestie prawne związane z aktorami AI w reklamie stają się osobiste. Bardzo szybko. Tutaj natykamy się na prawo do wizerunku – podstawowe prawo każdej osoby do kontroli nad używaniem jej imienia, wizerunku i podobieństwa w celach komercyjnych.

Pomyśl o tym jak o osobistym znaku towarowym na twoją tożsamość. Jeśli użyjesz AI do stworzenia „cyfrowego bliźniaka” celebryty – lub nawet zwykłej osoby – do reklamy bez wyraźnej zgody, przekraczasz poważną granicę prawną. To w zasadzie kradzież tożsamości dla zysku, a sądy nie traktują tego lekko.

Nie chodzi tylko o stworzenie idealnej, fotorealistycznej kopii. Prawo często chroni każdą cechę wskazującą bezpośrednio na konkretną osobę. Może to być jej głos, słynna poza czy nawet chwytliwa fraza, z której jest znana. Stworzenie wirtualnego influencera, który wydaje się zbyt znajomy prawdziwej celebrytce, to pozew gotowy do wystrzału.

Rosnące zagrożenie nieautoryzowanymi cyfrowymi replikami

Eksplozja technologii deepfake skierowała uwagę na ten problem, a prawodawcy próbują nadążyć. Stany wprowadzają teraz prawa specjalnie zaprojektowane do walki z nieautoryzowanym tworzeniem i używaniem cyfrowych replik. Dla marketerów i twórców oznacza to, że stare sposoby uzyskiwania zgody są oficjalnie martwe.

Nie możesz już polegać na standardowym formularzu zgody modela i zakładać, że obejmuje on stworzenie wersji AI tej osoby. Grunt prawny się zmienił, a nowy standard to wyraźna, świadoma zgoda specjalnie wspominająca generowanie AI. Wszystko mniej niż to naraża twoją markę na ryzyko.

Kluczowy wyrok sądowy naprawdę podkreślił ten punkt. Pokazał, że nawet gdy federalne prawa autorskie lub znaki towarowe nie pasują idealnie do przypadku klonowania głosu, stanowe prawa cywilne i do wizerunku nadal zapewniają potężną ochronę osobom, których tożsamość jest przejmowana przez AI. To kładzie ciężar prosto na barki reklamodawców, by znali i szanowali te stanowe prawa.

Tworzenie formularza zgody odpornego na AI

Gdy uzyskujesz zgodę na zbudowanie aktora AI na podstawie prawdziwej osoby, twoje podejście musi być całkowicie inne. Formularze zgody i zrzeczenia muszą być szczelne i nie zostawiać miejsca na interpretację. Naprawdę solidne zrzeczenie AI powinno dawać ci konkretne, jednoznaczne prawa.

Aby być po właściwej stronie prawa, twój proces zgody musi obejmować te kluczowe punkty:

- Wyraźne prawo do stworzenia cyfrowej repliki: Formularz musi stwierdzać w sposób niebudzący wątpliwości, że zamierzasz stworzyć cyfrową wersję osoby za pomocą AI.

- Określony zakres użycia: Bądź precyzyjny. Dokładnie opisz, jak i gdzie replika AI będzie używana – w jakich kampaniach, na jakich platformach i przez jak długo.

- Prawa do zatwierdzania wyniku AI: To ogromny punkt negocjacyjny. Czy osoba ma prawo do przeglądu i zatwierdzenia ostatecznych scen wygenerowanych przez AI przed publikacją?

- Przyszłe użycie i modyfikacje: Umowa musi wyjaśniać, czy masz prawo do zmiany repliki AI lub użycia jej w przyszłych kampaniach, które jeszcze nie zostały zaplanowane. Nieprecyzyjne sformułowania to ogromne ryzyko.

Aby zobaczyć, jak zmieniły się wymagania, porównaj tradycyjną zgodę z tym, co potrzebne dla AI.

Lista kontrolna zgody: prawdziwa osoba vs aktor AI

Ta tabela podkreśla kluczowe różnice między standardowym formularzem zrzeczenia a tym zaprojektowanym do tworzenia repliki AI.

| Czynnik zgody | Wymagane dla prawdziwej osoby | Krytyczne dla repliki AI |

|---|---|---|

| Użycie wizerunku | Standardowe zrzeczenie modela dla zdjęć/wideo. | Wyraźna zgoda na generowanie cyfrowego klonu. |

| Czas trwania użycia | Jasno określony okres (np. rok). | Musi określać, czy prawa są wieczyste, czy ograniczone czasowo. |

| Prawa do modyfikacji | Ograniczone do standardowej edycji (korekcja kolorów itp.). | Musi udzielać praw do zmiany występu/dialogu AI. |

| Zakres mediów | Określa platformy (np. media społecznościowe, TV). | Szeroko obejmuje wszystkie bieżące i przyszłe media cyfrowe. |

Ostatecznie nawigacja po prawie do wizerunku w erze AI sprowadza się do przejrzystości i szacunku. Uzyskiwanie krystalicznie jasnej zgody to nie tylko odhaczenie prawnego pudełka – to ochrona twojej marki i szacunek dla praw osób, których tożsamość napędza twoją kreatywną pracę.

Pozostawanie po właściwej stronie FTC

Poza labiryntem praw autorskich i do wizerunku, inny ważny gracz wchodzi na ring, gdy używasz aktorów AI: Federalna Komisja Handlu (FTC). Zadanie FTC jest proste: chronić konsumentów przed reklamami, które kłamią lub wprowadzają w błąd. Nie obchodzi ich, czy twoja reklama została stworzona przez zespół artystów czy zaawansowany algorytm – jeśli jest myląca, to problem.

W swej istocie zasada FTC jest prosta. Reklama nie może być myląca. Ten standard dotyczy wszystkiego, co reklama mówi i sugeruje, w tym twierdzeń o technologii AI użytej do jej stworzenia. Jeśli twój aktor AI twierdzi, że nowy proszek proteinowy buduje mięśnie 2x szybciej, lepiej masz solidne dowody naukowe, tak jak gdyby powiedziała to ludzka celebrytka.

Agencja coraz mocniej ściga to, co nazywają „AI-washingiem”. To gdy firma wyolbrzymia swoje możliwości AI. Reklamowanie swojej kampanii jako przełomowego osiągnięcia AI, gdy wykonuje tylko kilka podstawowych zadań zautomatyzowanych, to pewny sposób na trafienie na radar FTC.

Dwie prawdy, które musisz przestrzegać

Gdy w grę wchodzą aktorzy AI, nagle żonglujesz dwoma zestawami odpowiedzialności. Musisz być szczery co do tego, co sprzedajesz i szczery co do technologii, której używasz do sprzedaży.

Pomyśl o tym jak o dwuczęściowej weryfikacji integralności:

- Prawda w przekazie reklamy: Czy twierdzenia, demonstracje lub testimoniale prezentowane przez twojego aktora AI są prawdziwe? Wideo z szczęśliwym „klientem” wychwalającym twój produkt wygenerowane przez AI jest po prostu mylące, jeśli ten klient nie istnieje.

- Prawda w twierdzeniach o technologii: Czy wyolbrzymiasz, co potrafi twoje AI? Jeśli twierdzisz, że twoje AI dostarcza idealnie spersonalizowane reklamy, ale naprawdę tylko zmienia kolor tła na podstawie lokalizacji, wprowadzasz publiczność w błąd.

FTC nie interesuje techniczny proces za reklamą. Skupiają się na przekazie, z którym wychodzi przeciętna osoba.

Regulatorzy nie żartują

To nie jest klepnięcie po nadgarstku. FTC aktywnie ściga firmy za mylący marketing AI, wysyłając jasny sygnał, że używanie „AI” jako buzzworda nie daje wolnej karty na bezpodstawne twierdzenia.

FTC jasno dała do zrozumienia: jeśli wygłaszasz twierdzenie o swoim AI, musisz być w stanie je udowodnić. Reklamodawcy muszą mieć solidne dowody dla każdego twierdzenia o wydajności, tak jak dla dowolnej innej cechy produktu.

I to nie jest odległa przyszłość – dzieje się teraz. Do połowy 2025 r. FTC uruchomiła co najmniej tuzin działań egzekucyjnych przeciwko „AI-washingowi”. Klasycznym przykładem był pozew z sierpnia 2025 r. przeciwko Air AI za fałszywe twierdzenie, że ich AI może całkowicie zastąpić ludzkich przedstawicieli handlowych. Ta sprawa podkreśla poważne prawne i finansowe ryzyka dla marketerów, którzy nadmuchują swoje narzędzia AI bez dowodów. Możesz dowiedzieć się więcej o ewoluującym stanowisku FTC wobec prawa AI.

Kiedy musisz ujawnić?

To prowadzi do kluczowego pytania: kiedy musisz powiedzieć ludziom, że patrzą na aktora wygenerowanego przez AI? Nie ma jeszcze jednej federalnej ustawy z twardą regułą, ale ogólne zasady FTC dotyczące wprowadzania w błąd dają dość jasny przewodnik.

Testem jest to: „Czy wiedza, że to AI, zmieniłaby zrozumienie reklamy przez konsumenta?”

Jeśli używasz aktora AI, by udawał prawdziwego lekarza polecającego suplement lub rzeczywistego klienta dzielącego się osobistą historią, brak ujawnienia, że to AI, jest prawie na pewno mylący. Pominięcie jest wprowadzające w błąd, bo nadaje endorsementowi wiarygodność, której nie ma.

Aby być bezpiecznym i budować zaufanie, jasne i widoczne ujawnienia stają się nowym standardem. Prosty, widoczny tag jak #AIGenerated może zdziałać cuda w wyprzedzaniu regulacji i pozostawaniu po właściwej stronie klientów.

Twoja praktyczna lista kontrolna zgodności dla reklam AI

Dobra, przejdźmy od teorii do tego, co naprawdę musisz zrobić. Radzenie sobie z prawnym polem minowym AI w reklamie polega na posiadaniu solidnego, powtarzalnego procesu. To nie o duszenie kreatywności biurokracją; to o budowanie barierek, by twój zespół mógł innowacyjnie działać z pewnością.

Pomyśl o tej liście jako o rutynie przedstartowej przed uruchomieniem dowolnej kampanii opartej na AI. Wbudowując te kroki w swój workflow, tworzysz fundament zgodności, który chroni twoją markę, szanuje prawa jednostek i trzyma cię po właściwej stronie regulatorów. Przejdźmy przez to.

Krok 1: Przeprowadź audyt swojego narzędzia AI i jego danych treningowych

Zanim w ogóle pomyślisz o generowaniu obrazu, musisz zajrzeć pod maskę swojej platformy AI. Status prawny twojej ostatecznej reklamy jest bezpośrednio związany z danymi, na których trenował się model AI. Zakładanie, że płatne narzędzie jest „bezpieczne”, to ogromny, potencjalnie bardzo kosztowny hazard.

Musisz zadać dostawcy AI bezpośrednie pytania i naprawdę przeanalizować ich warunki usługi. Renomowany dostawca powinien być otwarty co do pochodzenia danych.

- Żądaj przejrzystości danych: Zapytaj wprost: Czy twój model trenował się na licencjonowanych, domenie publicznej czy etycznie pozyskanych danych? Jeśli dostaniesz mglistą, wymijającą odpowiedź, to ogromna czerwona flaga.

- Sprawdź klauzulę odszkodowawczą: Czy dostawca pokryje twoje rachunki prawne, jeśli ich narzędzie wypluje coś, co cię pozwie? To się nazywa odszkodowanie. Zobaczysz, że wiele platform kładzie 100% ryzyka prawnego na ciebie, użytkownika.

- Szukaj „bezpiecznych komercyjnie” narzędzi: Niektóre platformy specjalnie reklamują swoje modele jako bezpieczne do użytku komercyjnego. To często dobry znak, bo zwykle oznacza, że zrobili pracę domową w kwestii praw do danych.

Krok 2: Zapewnij szczelne prawa i zgodę

To nie podlega negocjacjom. Jeśli twoja reklama obejmuje cyfrowego dublera prawdziwej osoby – lub nawet awatara, który bardzo przypomina kogoś – potrzebujesz wyraźnej zgody. Twój stary formularz zgody modela tu nie wystarczy. Twoje umowy teraz muszą być konkretne i myśleć o przyszłości.

Nazwa gry to świadoma zgoda. Musisz być krystalicznie jasny, że zamierzasz stworzyć i użyć wersję AI osoby, dokładnie opisując jak, gdzie i przez jak długo. Jakakolwiek niejasność w tej umowie to w zasadzie otwarte zaproszenie na pozew w przyszłości.

To więcej niż podpis; to jasna komunikacja. Naprawdę solidne zrzeczenie AI powinno pokrywać wszystkie bazy, by uniknąć przyszłych bólów głowy.

- Określ generowanie AI: Umowa musi wyraźnie stwierdzać, że masz prawo stworzyć „cyfrową replikę” lub „wizerunek wygenerowany przez AI”.

- Określ zakres użycia: Bądź szczegółowy. Opisz, na jakich platformach pojawi się aktor AI, jakie typy kampanii i dokładny czas trwania.

- Rozwiąż prawa do modyfikacji: Czy umowa pozwala ci na dostosowanie występu AI? Czy możesz zmienić dialog lub wrzucić go do zupełnie nowych scen? Opisz to dokładnie.

Krok 3: Przeanalizuj każdy wynik wygenerowany przez AI

Gdy AI coś dla ciebie stworzy, zaczyna się prawdziwa praca. Każdy obraz, wideo i voiceover potrzebuje ludzkiej recenzji. To twoja ostatnia linia obrony przed naruszeniem i nie możesz jej pominąć.

Nigdy nie zakładaj, że tylko dlatego, że obraz jest „nowy”, jest prawnie czysty. Te modele mogą – i robią – przypadkowo naśladować chronione style, postacie czy nawet loga marek.

- Sprawdź „istotne podobieństwo”: Czy wynik wygląda lub wydaje się zbyt podobny do słynnej postaci z filmu, dzieła sztuki czy charakterystycznego stylu konkretnego artysty? Jeśli twój instynkt mówi, że za blisko, to prawdopodobnie jest. Wyrzuć i wygeneruj nowy.

- Skanuj pod kątem znaków towarowych: Przyjrzyj się dokładnie tłom. Czy AI wślizgnął logo, nazwę marki czy charakterystyczny kształt produktu?

- Słuchaj podobieństwa głosu: Jeśli generujesz audio, czy głos brzmi upiornie podobnie do słynnego aktora lub postaci publicznej? To potencjalne naruszenie prawa do wizerunku gotowe do wybuchu.

Krok 4: Wdrażaj jasne ujawnienia i uzasadniaj twierdzenia

W końcu musisz być szczery wobec publiczności i grać według zasad FTC. Oznacza to bycie przejrzystym w używaniu AI, gdy ma to znaczenie, i co najważniejsze – popieranie każdego twierdzenia w reklamie twardymi dowodami.

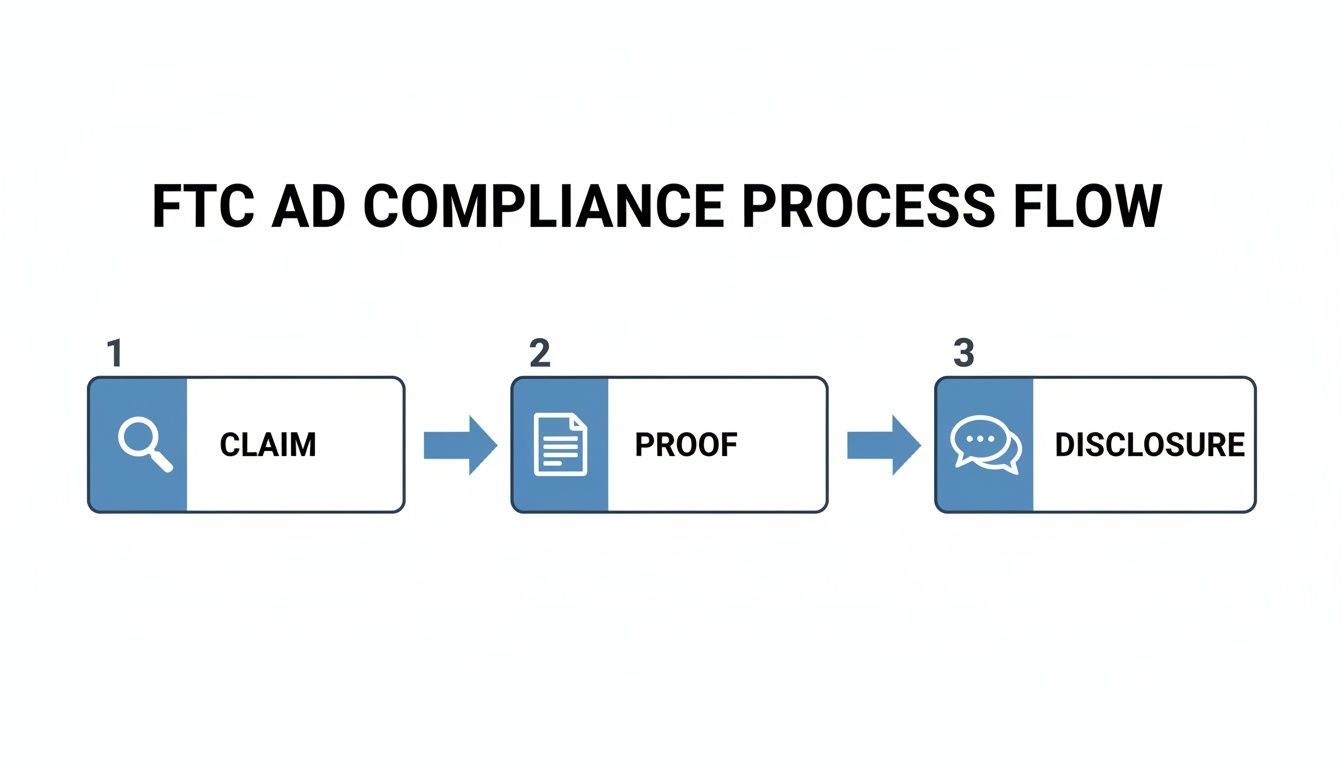

Ten prosty flowchart rozkłada podstawowe oczekiwanie FTC dla dowolnej reklamy, opartej na AI czy nie.

To prosty cykl: dla każdego twierdzenia, które wygłaszasz, musisz mieć dowód i zapewnić jasne ujawnienie. Ta pętla zapewnia, że twoja reklama jest prawdziwa i obronna.

- Ujawniaj, gdy ma to znaczenie: Jeśli przeciętna osoba mogłaby dać się nabrać, myśląc, że twój aktor AI to prawdziwa osoba – jak lekarz dający rady medyczne czy klient wychwalający produkt – musisz to ujawnić. Prosty #AIGenerated lub #AIAd załatwi sprawę.

- Uzasadniaj wszystkie twierdzenia: Każde faktyczne stwierdzenie twojego aktora AI potrzebuje dowodu. Jeśli twój rzecznik AI powie, że produkt jest „50% skuteczniejszy”, lepiej masz badanie kliniczne, zanim reklama ujrzy światło dzienne.

- Buduj „plik uzasadnień”: Dla każdej kampanii wyrobiw sobie nawyk tworzenia pliku z wszystkimi danymi, badaniami i dowodami wspierającymi twierdzenia reklamy. Jeśli FTC zapuka, ten plik będzie twoim najlepszym przyjacielem.

Najczęściej zadawane pytania o aktorów AI w reklamie

Wskakiwanie w reklamę opartą na AI często rodzi więcej pytań niż odpowiedzi. Strona prawna wciąż przypomina Dziki Zachód, co utrudnia pewność decyzji. Rozwiążmy najczęstsze pytania, jakie marketerzy zadają o kwestiach prawnych aktorów AI w reklamach. Moim celem jest dać ci proste odpowiedzi, by budować mądrzejsze, bezpieczniejsze kampanie.

Czy muszę ujawniać, że moja reklama używa aktora AI?

Coraz częściej odpowiedź brzmi tak. Chociaż nie ma jednej wielkiej federalnej ustawy nakazującej to dla każdej reklamy, grunt się zmienia. Najlepszy sposób myślenia to przez pryzmat zasad FTC przeciw wprowadzaniu w błąd. Jeśli niepowiedzenie komuś, że aktor to AI, ich wprowadzi w błąd, absolutnie musisz to ujawnić. Pomyśl o użyciu „lekarza” wygenerowanego przez AI do promowania produktu zdrowotnego – fakt, że lekarz nie jest prawdziwy, to spora sprawa.

Zresztą platformy już decydują za ciebie. Duże gracze jak Meta i YouTube teraz wymagają etykiet dla realistycznych treści wygenerowanych przez AI, więc ujawnienie staje się podstawowym kosztem prowadzenia biznesu.

Oto prosta reguła, której się trzymam: Jeśli istnieje jakakolwiek szansa, że przeciętna osoba da się nabrać, dodaj jasne i proste ujawnienie jak #AIGenerated. To nie tylko o przestrzeganie zasad, które mogą nadejść; to o budowanie zaufania u publiczności, co jest bezcenne.

Bycie otwartym zarządza oczekiwaniami i chroni twoją markę, zwłaszcza gdy ludzie stają się sprytniejsi (i bardziej sceptyczni) wobec mediów syntetycznych.

Czy mogę zostać pozwany, jeśli moje narzędzie AI stworzy naruszający obraz?

Oczywiście. Ogromnym błędem jest myślenie, że jeśli narzędzie AI zrobi bałagan, to dostawca narzędzia musi go posprzątać. Tak nie działa prawo autorskie. Firma, która publikuje naruszającą reklamę – czyli twoja firma – może być bezpośrednio pociągnięta do odpowiedzialności. To często nazywane odpowiedzialnością wtórną, co oznacza, że dzielisz ryzyko prawne.

Nawet jeśli platforma AI też wpadnie w kłopoty, to nie zwalnia cię z odpowiedzialności. Dlatego musisz czytać warunki usługi każdego narzędzia AI, którego używasz. Niektóre platformy mogą oferować odszkodowanie (pokrycie rachunków prawnych), ale wiele jest napisanych tak, by całą odpowiedzialność prawną złożyć na barki użytkownika.

Twoją najlepszą obroną jest proaktywność. Przeanalizuj każdy obraz wygenerowany przez AI pod kątem niepokojących podobieństw do istniejących chronionych dzieł. I staraj się trzymać platform AI, które są przejrzyste co do pochodzenia danych treningowych – te używające legalnie licencjonowanych lub domeny publicznej danych są zawsze bezpieczniejszym wyborem.

Jaka jest różnica między zdjęciem stockowym a osobą AI?

Kluczowa różnica sprowadza się do pochodzenia praw. Gdy licencjonujesz zdjęcie stockowe osoby, przychodzi z model release. To dokument prawny, w którym prawdziwa osoba na zdjęciu wyraziła zgodę na komercyjne użycie swojego wizerunku. To twój prawny koc bezpieczeństwa.

Osoba wygenerowana przez AI nie ma model release, bo, cóż, nie istnieje. Ale to otwiera puszkę pandory, o której nie musisz martwić się przy zdjęciach stockowych.

- Przypadkowy sobowtór: Obraz AI może przypadkowo wyglądać dokładnie jak prawdziwa osoba, tworząc niespodziewane roszczenie z prawa do wizerunku.

- Minowe pola autorskie: Sam obraz może być kwestionowany na podstawie tego, na czym trenowało się AI. Jeśli model uczył się z bazy chronionych obrazów, twoja „oryginalna” osoba AI może być prawnie uznana za naruszającą kopię.

W skrócie, z osobą AI wymieniasz znany, jasny proces prawny (model release) na nowy, mętny zestaw ryzyk związanych z prawami autorskimi i tożsamością.

Jak bezpiecznie stworzyć awatara marki AI?

Jeśli chcesz stworzyć awatara marki lub influencera AI bez otrzymania strasznego listu od prawnika w przyszłości, potrzebujesz planu. Nie możesz improwizować.

Zacznij od upewnienia się, że awatar jest naprawdę unikalny. Bądź kreatywny z szczegółowymi promptami, a potem ręcznie dostosuj wyniki, by ostateczny wygląd był daleko od prawdziwych osób czy istniejących postaci. Zachowaj zapis tego procesu kreatywnego – może być kluczowym dowodem, że zamierzałeś stworzyć coś całkowicie oryginalnego.

Następnie nadaj swojemu awatarowi unikalne imię i historię bez związku z prawdziwą osobą. Zrób wyszukiwanie znaków towarowych dla imienia awatara i nawet jego wizualnego designu, by upewnić się, że nie nadepniesz na odcisk innej marki.

W końcu przejrzyj warunki usługi swojego narzędzia AI. Musisz być pewien, że udzielają ci pełnej własności komercyjnej lub przynajmniej szerokiej licencji komercyjnej na wszystko, co stworzysz. Bycie przejrzystym wobec publiczności, że awatar to AI, również pomoże uniknąć zarówno problemów prawnych, jak i PR-owych.

Gotowy do tworzenia wysokowydajnych reklam bez prawnych domysłów i wysokich kosztów produkcji? ShortGenius to platforma reklamowa AI zaprojektowana dla twórców i marketerów, którzy muszą produkować oszałamiające reklamy wideo i obrazów short-form dla wszystkich głównych platform społecznościowych. Generuj koncepcje, skrypty i wizualizacje w sekundy, potem dostosuj je do swojego brand kita i wdrażaj kampanie, które dają wyniki. Wypróbuj ShortGenius już dziś i zacznij budować lepsze reklamy, szybciej.