لپ سنک AI کو ماسٹر کرنے کا کریئٹر گائیڈ

دریافت کریں کہ لپ سنک AI ویڈیو تخلیق کو کیسے تبدیل کر رہا ہے۔ جانیں یہ کیا ہے، یہ کیسے کام کرتا ہے، اور اس کا استعمال کرکے عالمی سامعین کے لیے کامل ڈب شدہ مواد کیسے بنائیں۔

کیا آپ نے کبھی اپنی ویڈیوز میں کسی بھی زبان میں بولنا چاہا ہے، جہاں آپ کا منہ ہر لفظ سے بالکل مطابقت رکھے، چاہے آپ اس زبان کو نہ جانتے ہوں؟ یہی بالکل lip-sync AI ممکن بناتا ہے۔ اس کی بنیاد یہ ٹیکنالوجی ہے جو الگ آڈیو ٹریک لےتی ہے اور ایک شخص کے منہ کو—یا ایک avatar کے—کو خودکار طور پر اس کے ساتھ بے داغ طور پر ہم آہنگ کر دیتی ہے۔

یہ صرف ایک دلچسپ پارٹی ٹرک نہیں ہے؛ یہ ایک بہت بڑا پیش رفت ہے، جو کنٹینٹ کی تخلیق اور localization کو ہر ایک کے لیے قابل رسائی بناتا ہے۔

Creators کے لیے Lip Sync AI کیوں اہم ہے

lip-sync AI کو اپنی ویڈیوز کے لیے ایک ڈیجیٹل کٹھ پتلی باز سمجھیں۔ طویل عرصے سے، realistic lip synchronization حاصل کرنا صرف ہائی بجٹ فلم سٹوڈیوز کے لیے ممکن تھا جو dedicated VFX ٹیموں کے پاس ہوتے تھے۔ اس کا مطلب تھا منہ کی حرکتوں کو frame by frame تکلیف دہ طریقے سے animate کرنا۔ اب، وہی طاقت ہر جگہ creators کے ہاتھوں میں ہے، اور یہ YouTube، TikTok، اور Instagram جیسے پلیٹ فارمز کے لیے ویڈیو بنانے کا طریقہ مکمل طور پر تبدیل کر رہی ہے۔

اس AI کا بنیادی کام یہ ہے کہ یہ دیکھنے اور سننے کے درمیان فرق کو ختم کر دے، viewer کے لیے بالکل seamless اور believable تجربہ پیدا کرے۔ ان پرانے، کلنکی dubs کو بھول جائیں جہاں آڈیو تکلیف دہ طور پر out of sync ہوتی تھی۔ یہ ٹیک یقینی بناتی ہے کہ speaker کا منہ نئے آڈیو ٹریک کے ساتھ perfect harmony میں حرکت کرے، چاہے وہ مختلف زبان ہو، re-recorded voiceover، یا AI voice سے پڑھا گیا script۔

اپنا Reach بڑھانا اور وقت بچانا

content creators پر اس کا اثر بہت بڑا ہے۔ آپ اب اپنی native language تک محدود نہیں ہیں یا چھوٹی آڈیو غلطی درست کرنے کے لیے مہنگے reshoots کی پریشانی میں پھنسے نہیں رہتے۔

یہ ٹیکنالوجی آپ کو طاقت دیتی ہے:

- زبان کی رکاوٹوں کو توڑنے کے لیے: اپنی ویڈیوز کو فوری طور پر متعدد زبانوں میں dub کریں۔ آپ اپنا کنٹینٹ massive international audiences کے لیے کھول سکتے ہیں بغیر Spanish، Japanese، یا Hindi کا ایک لفظ بولے۔

- کنٹینٹ کو بے درد طریقے سے Scale کریں: ایک ویڈیو لیں اور اسے مختلف global markets کے لیے repurpose کریں۔ آپ کو صرف آڈیو فائل swap کرنی ہے اور AI باقی سب ہینڈل کر لے گا۔

- Production Value کو بڑھائیں: اپنے ads یا social media ویڈیوز کے لیے professional-sounding voiceovers بنائیں اور یقینی بنائیں کہ آپ کا on-screen talent یا avatar بالکل natural اور authentic لگے۔

یہ صرف ایک technical novelty نہیں ہے؛ یہ ایک strategic advantage ہے۔ Lip sync AI solo creators اور small teams کو global scale پر compete کرنے کی اجازت دیتا ہے، multilingual content پیدا کرتے ہوئے جو پہلے صرف large media companies کے لیے ممکن تھا۔

آخر کار، یہ tool اس بارے میں ہے کہ smartly کام کریں، hard نہیں۔ جو پہلے grueling post-production task تھا اسے automate کر کے، یہ آپ کو آزاد کر دیتا ہے کہ آپ اپنے بہترین کام پر فوکس کریں: great ideas سوچنا۔ بڑی تصویر دیکھنے کے لیے، AI Powered Content Creation کی وسیع دنیا کو سمجھنا مددگار ہے اور یہ tools جیسے کہ پوری industry کو کیسے reshape کر رہے ہیں۔ Lip-sync AI اس puzzle کا key piece ہے، جو آپ کو زیادہ لوگوں سے authentic طریقے سے جوڑنے کی صلاحیت دیتا ہے۔

Lip Sync AI اصل میں کیسے کام کرتا ہے

کبھی سوچا کہ lip-sync AI کے نیچے کیا ہو رہا ہے؟ یہ صرف ایک ڈیجیٹل puppet show نہیں ہے جو منہ کو اوپر نیچے ہلا رہا ہو۔ اسے ایک sophisticated translation service کی طرح سمجھیں، لیکن words کو ایک زبان سے دوسری میں تبدیل کرنے کی بجائے، یہ sounds کو incredibly precise facial movements میں translate کرتا ہے۔

ایک analogy استعمال کریں۔ اگر آپ ایک robot کو بولنا سکھا رہے ہوں، تو آپ اسے صرف alphabet نہیں دکھائیں گے۔ آپ اسے بتائیں گے کہ ہر letter sound کیسا ہے۔ Lip-sync AI بالکل ایسا ہی کرتا ہے اپنے آڈیو ٹریک کو سب سے چھوٹے sound units میں توڑ کر، جنہیں phonemes کہتے ہیں۔ مثال کے طور پر، "hello" word کو distinct sounds میں توڑا جاتا ہے جیسے "h," "eh," "l," اور "ow."

جیسے ہی AI ان phonemes کی پہچان کر لیتا ہے، وہ اپنے main task پر کام شروع کر دیتا ہے: ہر sound کو اس exact mouth shape سے map کرنا جو شخص اسے بولتے ہوئے بناتا ہے۔ ان visual mouth shapes کو visemes کہتے ہیں۔ AI کو mountains of data پر train کیا گیا ہے، اس لیے وہ instinctively جانتا ہے کہ "f" sound کا مطلب ہے کہ top teeth bottom lip کو چھوئیں۔ یہ audio سے visual کی lightning-fast translation ہے۔

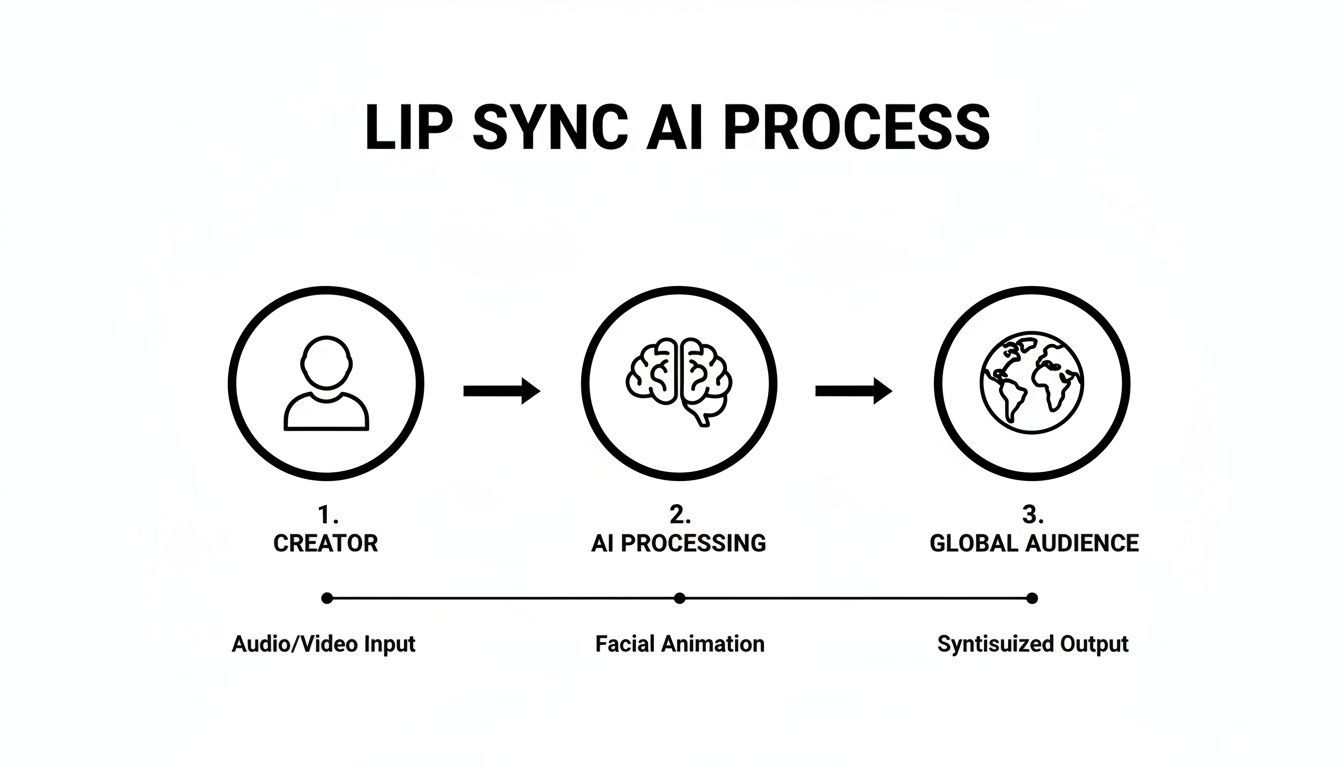

یہ diagram بتاتا ہے کہ ایک content کا piece آپ کے اینڈ سے simple recording سے global audience کے لیے تیار ویڈیو تک کیسے جاتا ہے۔

جیسا کہ آپ دیکھ سکتے ہیں، creator raw materials فراہم کرتا ہے، AI heavy lifting کرتا ہے، اور نتیجہ polished content ہوتا ہے جو کہیں بھی viewers سے جڑتا ہے۔

دو Core Ingredients

اس digital magic کو pull off کرنے کے لیے، AI کو آپ سے واقعی صرف دو چیزیں چاہیے۔ یہ simplicity ہی ShortGenius جیسے tools کو creators کے لیے اتنا useful بناتی ہے جو fast کام کرنا چاہتے ہیں۔

- آڈیو فائل: یہ آپ کا blueprint ہے۔ یہ آپ کی ابھی record کی گئی voiceover ہو سکتی ہے، نئی زبان کے لیے professionally dubbed آڈیو ٹریک، یا کوئی اور speaking کی recording۔ جتنی clean آڈیو، اتنا بہتر۔ Crisp، clear speech AI کو بہت آسان phonemes set دیتی ہے، جو ہمیشہ زیادہ accurate اور believable نتیجہ دیتی ہے۔

- ویڈیو یا Avatar: یہ آپ کا canvas ہے۔ آپ real person کی ویڈیو استعمال کر سکتے ہیں یا AI-generated avatar کی static image بھی۔ AI اس visual base کو استعمال کر کے نئے، perfectly synchronized mouth movements generate اور overlay کرتا ہے۔

لیکن modern deep learning algorithms وہاں رکتا نہیں۔ وہ آڈیو میں nuances کا تجزیہ کرتے ہیں—tone، emotion، حتیٰ کہ speaker کی speed۔ یہ final animation کو دور زیادہ natural بناتا ہے۔ دل میں، lip-sync AI sync audio video کی expert ability کے بارے میں ہے تاکہ viewer کو کبھی اس کا احساس نہ ہو۔

bottom line یہ ہے: یہ صرف lips ہلانے کے بارے میں نہیں۔ یہ sound کا deep analysis ہے جو speech کو realistic facial expressions میں translate کرتا ہے، ان چھوٹی details کو capture کرتے ہوئے جو performance کو truly human بناتی ہیں۔

یہ automation level industry growth کو fuel کر رہا ہے۔ Lip-sync technology کا global market USD 1.12 billion in 2024 سے USD 5.76 billion by 2034 تک jump کرنے کی track پر ہے۔ Audio-driven machine learning کا 40.7% market share یہ دکھاتا ہے کہ یہ tech content کو global لینے کے لیے کتنی vital ہو گئی ہے۔

یہ ہی technology بہت سی AI video tools میں key ingredient ہے۔ یہ creator کو single still photo کو compelling، dynamic video میں تبدیل کرنے کی اجازت دیتی ہے۔ آپ اسے مزید گہرائی سے دیکھ سکتے ہیں ہمارے guide پر transform images into video with AI۔

Creators اور Marketers کے لیے Practical Applications

lip sync AI کی technical details جاننا ایک بات ہے، لیکن real magic تب ہوتی ہے جب آپ دیکھتے ہیں کہ یہ نئے creative اور business doors کیسے کھولتا ہے۔ Creators اور marketers کے لیے، یہ صرف novelty نہیں؛ یہ content scale کرنے، نئے markets tap کرنے، اور دنیا بھر کے audiences سے genuinely connect کرنے کا serious tool ہے۔

سب سے obvious اور powerful use case content localization ہے۔ فرض کریں آپ کا TikTok viral ہو رہا ہے یا YouTube tutorial جس میں آپ نے دل لگایا ہے۔ English speakers تک محدود رہنے کی بجائے، آپ اب Spanish، Hindi، یا Japanese audiences کے لیے versions تقریباً instantly بنا سکتے ہیں۔ AI صرف نئی آڈیو ٹریک نہیں لگاتا—وہ آپ کی lip movements کو carefully reanimate کرتا ہے نئی زبان سے match کرنے کے لیے، final video کو بالکل natural بناتے ہوئے۔

یہ global expansion کے playbook کو مکمل طور پر rewrite کر دیتا ہے۔ Video campaign localize کرنے کا پرانا طریقہ ہر زبان کے لیے voice actors hire کرنا، expensive studio time book کرنا، اور weeks یا months کی post-production میں slog کرنا تھا۔ اب، پورا workflow fast اور far more affordable ہے۔

Global Ads سے AI Avatars تک

ویڈیوز translate کرنے سے آگے، lip sync AI brands build کرنے اور compelling ads بنانے کے لیے whole range of strategies unlock کرتا ہے۔ بنیاد میں، ہر application اس ability کا فائدہ اٹھاتی ہے کہ کسی کا کہنا الگ ہو سکے اس سے کہ وہ کیسا لگتا ہے کہتے ہوئے۔

یہاں چند game-changing طریقے ہیں جو یہ technology اب استعمال ہو رہی ہے:

- Engaging AI Avatars بنانا: آپ ایک single image لے سکتے ہیں—mascot، founder، یا virtual influencer کی—اور اسے زندہ کر دیں۔ بس text-to-speech voiceover feed کریں، اور آپ کے پاس endless social media content ہے بغیر کسی کو camera کے سامنے آنے کی ضرورت۔

- Ad Campaigns Localize کرنا: ایک brand ایک fantastic، high-budget ad produce کر سکتا ہے اور پھر AI سے اسے dozens international markets کے لیے adapt کر سکتا ہے۔ یہ branding consistent رکھتا ہے جبکہ message local اور personal feel کرتا ہے۔ Ad platforms کے لیے جو steady fresh creative demand کرتے ہیں، یہ lifesaver ہے۔ آپ دیکھ سکتے ہیں کہ یہ broader strategy میں کیسے کام کرتا ہے ہمارے guide پر effective AI UGC-style ads بنانے کے بارے میں۔

- Effortless Audio Corrections: ہم سب وہاں رہے ہیں۔ آپ perfect video edit ختم کرتے ہیں، صرف voiceover میں mistake notice کرتے ہیں۔ Frustrating reshoot کی بجائے، آپ corrected audio line record کر کے AI سے seamlessly patch کر سکتے ہیں، lips perfectly match کرتے ہوئے۔

Real power یہاں decoupling ہے visual سے audio۔ یہ creators کو immense flexibility دیتا ہے experiment کرنے، mistakes correct کرنے، اور مختلف platforms اور audiences کے لیے content adapt کرنے کی بغیر scratch سے شروع کیے۔

ان ideas کو life میں لانے کے لیے، یہاں creators اور brands کے lip sync AI استعمال کرنے کا quick breakdown ہے۔

Creators اور Brands کے لیے Lip Sync AI Applications

| Use Case | Primary Benefit | Example Application |

|---|---|---|

| Global Content Distribution | Audience Growth | ایک YouTuber اپنا top-performing video 5 نئی زبانوں میں translate کرتا ہے global audience تک پہنچنے کے لیے، potential viewership کو triple کرتے ہوئے۔ |

| Multilingual Ad Campaigns | Increased ROI | ایک D2C brand ایک single ad کے 10 localized versions مختلف countries کے لیے بناتا ہے، ad relevance اور conversion rates improve کرتے ہوئے۔ |

| AI Influencers & Avatars | Content Scalability | ایک company اپنے animated mascot کو استعمال کر کے daily social media updates بناتی ہے بغیر ہر post کے لیے video team کی ضرورت۔ |

| Post-Production Fixes | Time & Cost Savings | ایک filmmaker crucial scene میں misspoken line correct کرتا ہے بغیر reshoot کے، thousands of dollars بچاتے ہوئے۔ |

یہ صرف minor improvement نہیں—یہ video بنانے کا fundamental shift ہے۔

AI video dubbing market $31.5 million in 2024 میں valued تھا اور $397 million by 2032 تک rocket کرنے کی توقع ہے۔ یہ explosive growth تمام time اور money بچاتی ہے۔ Multilingual campaign جو پہلے huge budget اور months کا کام demand کرتی تھی اب less than a week میں under $2,000 میں turn around ہو سکتی ہے، solo creators کے ہاتھوں میں global reach ڈال دیتی ہے۔ آپ evolving economics of AI lip sync technology کے بارے میں مزید سیکھ سکتے ہیں اور دیکھ سکتے ہیں کہ یہ پوری creator economy کو کیسے change کر رہا ہے۔

صحیح Lip Sync AI Tool کیسے چنیں

Market میں نئے tools کی flood کے ساتھ، صحیح lip sync AI چننا shot in the dark لگ سکتا ہے۔ لیکن تمام platforms ایک جیسے نہیں بنے، اور غلط choice robotic، awkward-looking ویڈیوز دے سکتی ہے جو viewers کو repel کرے بجائے engage کیے۔ آپ کو marketing fluff کو cut کرنے کے لیے simple checklist کی ضرورت ہے۔

Absolute number one factor sync کی quality ہے۔ Final video natural لگتی ہے، یا creepy "uncanny valley" میں dip کر جاتی ہے؟ Great tool real mouth کی tiny، subtle movements کو سمجھتا ہے—different sounds کے گرد کیسے form ہوتا ہے اور speaker کی expression سے connect ہوتا ہے۔

Cheap یا poorly trained AI صرف mouth کو open and closed flap کر سکتا ہے، جو فوری giveaway ہے کہ کچھ fake ہے۔ Best way judge کرنے کی یہی ہے کہ same short audio clip کو چند different tools میں run کریں۔ Results کو side-by-side رکھیں اور اپنے gut پر trust کریں۔

Key Features اور Performance کا Evaluation

Pure realism سے آگے، آپ کو اپنی specific creative needs کے بارے میں سوچنا ہے۔ Multilingual corporate trainer کے لیے perfect tool meme creator کے لیے overkill ہو سکتا ہے۔ Evaluation process کو upfront nail کرنا later headaches بچا دے گا۔

یہاں essential چیزیں ہیں جن کو دیکھیں:

- زبان اور Accent Support: اگر آپ global audience تک پہنچ رہے ہیں تو یہ deal-breaker ہے۔ Tool کتنی languages support کرتا ہے جانیں اور، اتنا ہی important، different accents اور dialects کو کیسے handle کرتا ہے۔ Glaswegian accent nail کرنے والا tool generic، robotic voice والے سے بہت impressive ہے۔

- Processing Speed: One-minute clip کے لیے progress bar کتنی دیر دیکھنی پڑے گی؟ Short-form content کی دنیا میں speed everything ہے۔ کچھ platforms minutes میں video turn around کر دیتے ہیں، جبکہ others eternity لگتی ہے۔

- Ease of Use: Million features والا tool بेकار ہے اگر interface nightmare ہو۔ Clean، simple design تلاش کریں جو video اور audio upload کرنے دے، پھر few clicks میں lip sync apply کرے۔ ShortGenius جیسے platforms اس step کو بہت بڑے video creation pipeline کا seamless part بنانے کی کوشش کرتے ہیں۔

Ultimate goal ایسا solution تلاش کرنا ہے جو آپ کے existing process میں fit ہو بغیر نئے bottlenecks بنائے۔ Right tool آپ کے creative toolkit کا extension لگنا چاہیے، نہ کہ complicated software جو سیکھنا پڑے۔

Integration اور Market Trends کا غور

آخر میں، bigger picture سوچیں۔ یہ lip sync AI آپ کے workflow میں کیسے fit ہوتا ہے؟ کیا یہ آپ کے پسندیدہ video editors کے ساتھ play nice کرتا ہے؟ کیا یہ آپ کی needed video formats اور resolutions handle کر سکتا ہے؟ Smooth integration technical performance جتنا critical ہے۔

اس space میں explosive growth everything بتاتی ہے۔ AI in media کا market، جس میں lip-sync tech شامل ہے، USD 8.21 billion in 2024 سے USD 51.08 billion by 2030 تک balloon کرنے کی توقع ہے۔ یہ rapid expansion مطلب ہے کہ sophisticated audio-visual AI modern content strategy کا core part بن رہا ہے۔ آپ the AI media market on datainsightsmarket.com پر مزید details حاصل کر سکتے ہیں۔

ایسا tool چن کر جو well-supported ہو اور constantly improve ہو رہا ہو، آپ صرف آج کا problem حل نہیں کر رہے—آپ years تک amazing content create کرنے کی ability میں invest کر رہے ہیں۔

آپ کی پہلی Lip Sync Video کے لیے Step-by-Step Guide

ٹھیک ہے، hands dirty کرتے ہیں۔ lip sync AI سے پہلی video بنانا اتنا complicated نہیں جتنا لگتا ہے۔ ہم اسے simple، four-step process میں break کر سکتے ہیں جو rough idea سے share کرنے کے لیے تیار finished video تک لے جائے۔

یہ basic workflow ShortGenius جیسے platforms میں ملے گا، جو یہ powerful tech آپ کے fingertips پر رکھتا ہے۔

Step 1: اپنا Audio Track Prepare کریں

سب کچھ audio سے شروع ہوتا ہے۔ اسے video کا blueprint سمجھیں—AI کو clean، clear track چاہیے mouth shapes figure کرنے کے لیے۔ آپ اپنی voice record کر سکتے ہیں یا quality text-to-speech generator استعمال کریں consistently crisp narration کے لیے۔

Best outcome کے لیے، یقینی بنائیں کہ audio میں little to no background noise ہو۔ Clearly بولنا بھی huge difference لاتا ہے۔ جتنے distinct آپ کے words، اتنا بہتر AI lip movements match کر سکتا ہے۔ یہ پہلا step درست کرنا believable result کے لیے set up کر دیتا ہے۔

Step 2: اپنی Video یا Avatar Select کریں

اگلا، choose کریں کہ کون (یا کیا) بولے گا۔ یہ آپ کی موجودہ speaking کی video clip ہو سکتی ہے یا AI avatar کی static image۔ Key clear shot of the face ہے۔

Pro tip: Straight-on، front-facing angle best کام کرتا ہے۔ AI کو mouth کی direct، unobstructed view چاہیے realistic movements generate کرنے کے لیے۔ اگر face turned away ہو یا کچھ block کر رہا ہو، final animation off لگے گی۔

Inputs کی quality directly output کی quality determine کرتی ہے۔ Sharp، well-lit video اور clean audio AI کو best possible material دیتے ہیں، errors minimize کرتے اور lifelike result ensure کرتے ہیں۔

Step 3: Lip Sync AI Apply کریں

یہاں real fun شروع ہوتا ہے، اور usually صرف button click کرنا ہے۔ جیسے ہی آپ audio اور video files tool میں upload کر دیں، lip sync feature apply کر دیں۔ AI پھر کام پر لگ جاتا ہے، audio میں sounds break down کر کے video subject پر brand new mouth movements create کرتا ہے match کرنے کے لیے۔

پورا process surprisingly fast ہے، often few minutes لگتے ہیں۔ جبکہ AI heavy lifting کر رہا ہے، آپ last اور most important step کے لیے ready ہو جائیں۔

Step 4: Output Review اور Refine کریں

کوئی AI ہر بار perfect نہیں کرتا، اس لیے final check crucial ہے۔ Generated video دیکھیں اور timing پر close attention دیں۔ Sync natural لگتی ہے؟ کوئی weird twitches یا moments جہاں lips audio سے match نہ کریں؟

زیادہ تر good tools small tweaks کے options دیتے ہیں۔ کبھی صرف audio timing nudge کرنا یا specific section re-run کرنا kinks smooth کر دیتا ہے۔ Satisfied ہونے پر، video export کے لیے ready ہے۔ یہ entire process بہت سی AI video workflows کا core part ہے، اور آپ دیکھ سکتے ہیں کہ یہ bigger picture میں کیسے fit ہوتا ہے ہمارے guide پر text-to-video AI models۔

Lip Sync AI کے بارے میں سوالات؟ ہمارے پاس جوابات ہیں۔

کوئی نئی tech میں jump کرنا questions لاتا ہے۔ یہ completely normal ہے۔ آئیں creators سے most common ones tackle کریں lip sync AI کے بارے میں تاکہ آپ straight great content بنانے لگ جائیں۔

Lip Sync AI مختلف زبانوں کو کیسے Handle کرتا ہے؟

یہ بڑا سوال ہے۔ Good news یہ ہے کہ most top-tier AI models gigantic datasets پر train ہیں جن میں countless hours multilingual speech ہے۔ مطلب وہ نہ صرف different languages handle کرنے میں adept ہیں بلکہ different accents بھی۔ یہ صرف words کے بارے میں نہیں؛ specific mouth shapes—technical term visemes—سیکھنا ہے ہر unique sound کے ساتھ۔

Of course، تمام tools ایک جیسے نہیں۔ Performance platform سے platform مختلف ہو سکتی ہے، اسی لیے میں ہمیشہ recommend کرتا ہوں short test clip target language میں run کریں committing سے پہلے big project کو۔ Best systems subtle nuances capture کریں گے، speaker کو native لگائیں گے، generic "one-size-fits-all" mouth movement کی بجائے جو off feel کرتا ہے۔

Lip Sync اور Dubbing میں کیا فرق ہے؟

یہ دونوں mix up کرنا easy ہے، لیکن وہ same coin کے دو sides ہیں، video کو نئی زبان میں authentic feel دینے کے لیے together کام کرتے ہیں۔

اس طرح سوچیں:

- Video Dubbing: یہ audio کے بارے میں ہے۔ Original voice track کو نئے سے swap کرنے کا process، usually دوسری زبان میں۔

- Lip Sync: یہ visual follow-up ہے۔ جیسے ہی نئی audio lay down ہو جائے، AI speaker کی mouth movements digitally alter کرتا ہے new dialogue سے perfectly match کرنے کے لیے۔

جب آپ انہیں combine کریں، آپ completely localized video حاصل کرتے ہیں۔ Sound right ہے، visuals match کرتے ہیں۔ ایک handle کرتا ہے جو آپ سنتے ہیں، دوسرا جو دیکھتے ہیں۔

یہ one-two punch creator کو single video لے کر worldwide audiences کے لیے native feel بنانے دیتا ہے، distracting out-of-sync feeling کے بغیر جو viewer کو فوری experience سے نکال دیتا ہے۔

میں Creepy "Uncanny Valley" Effect کیسے Avoid کر سکتا ہوں؟

Ah، "uncanny valley." وہ weird، unsettling feeling جب کچھ almost human لگتا ہے، لیکن few subtle things just not quite right۔ lip sync AI کے ساتھ real concern ہے، لیکن آپ اسے absolutely avoid کر سکتے ہیں۔

پہلے، ہمیشہ high-quality source material سے start کریں۔ Crisp، well-lit video یا polished avatar AI کو cleaner canvas دیتا ہے۔ Blurry یا low-res footage feed کریں تو weird result مانگ رہے ہیں۔

اگلا، audio quality پر focus کریں۔ Natural sound کرنے والی high-quality AI voice استعمال کریں، یا better، human voice actor کی clean recording۔ Robotic، flat voice realistic lip movements کے ساتھ instant creepiness کی recipe ہے۔

آخر میں، subtle human touches add کریں۔ AI-generated scene own میں sterile feel کر سکتی ہے۔ Natural head movements، realistic blinking، یا interesting background جیسے small things entire video کو grounded اور alive بنا دیں، uncanny valley سے نکال دیں۔

Hassle کے بغیر stunning، multilingual videos بنانے کو ready؟ ShortGenius powerful AI lip sync capabilities کو complete video creation workflow میں integrate کرتا ہے۔ Minutes میں professional ads اور social content produce کریں۔ shortgenius.com پر free create شروع کریں۔