En skaperguide til å mestre lip sync AI

Oppdag hvordan lip sync AI forvandler videoproduksjon. Lær hva det er, hvordan det fungerer, og hvordan du bruker det til å lage perfekt dubbet innhold for et globalt publikum.

Har du noen gang ønsket å snakke ethvert språk i videoene dine, med munnen din som passer perfekt til hvert eneste ord, selv om du ikke kjenner språket? Det er akkurat det lip-sync AI gjør mulig. I bunnen av det tar denne teknologien en separat lydspor og animerer automatisk en persons munn – eller en avatars – for å synkronisere perfekt med det.

Dette er ikke bare et kult triks på festen; det er et stort sprang fremover som gjør innholdsproduksjon og lokalisering tilgjengelig for alle.

Hvorfor lip-sync AI er viktig for skapere

Tenk på lip-sync AI som en digital spøkelsesmann for videoene dine. I lang tid har realistisk leppesynkronisering vært noe bare filmstudioer med høye budsjetter og dedikerte VFX-team har kunnet klare. Det betydde å animere munnbevegelser bilde for bilde på slitsom vis. Nå er den samme kraften i hendene på skapere overalt, og det endrer fullstendig hvordan videoer lages for plattformer som YouTube, TikTok og Instagram.

Hovedjobben til denne AI-en er å tette gapet mellom det du ser og det du hører, og skape en helt sømløs og troverdig opplevelse for seeren. Glem de gamle, klønete dubbingene der lyden er smertefullt ute av synk. Denne teknologien sørger for at en talers munn beveger seg i perfekt harmoni med en ny lydspor, enten det er et annet språk, en nyinnspilt voiceover eller til og med et manus lest av en AI-stemme.

Utvid rekkevidde og spar tid

Påvirkningen på innholdsskapere er enorm. Du er ikke lenger begrenset til ditt morsmål eller fast med bryet av dyre gjenopptak bare for å fikse en liten lydfeil.

Denne teknologien gir deg kraften til å:

- Bryte språkhinder: Dubbe videoene dine til flere språk øyeblikkelig. Du kan åpne innholdet ditt for massive internasjonale publikum uten å måtte si et ord på spansk, japansk eller hindi.

- Skalere innhold sømløst: Ta én video og bruk den på nytt for ulike globale markeder. Alt du trenger å gjøre er å bytte lydfilen og la AI-en håndtere resten.

- Heve produksjonsverdien: Lag profesjonelt lydende voiceovers for annonsene eller sosiale medie-videoene dine og sørg for at talentet ditt på skjermen eller avatar ser helt naturlig og autentisk ut.

Dette er ikke bare en teknisk nysgjerrighet; det er en strategisk fordel. Lip-sync AI lar solo-skapere og små team konkurrere på global skala, og produsere flerspråklig innhold som tidligere bare var mulig for store mediebedrifter.

Til syvende og sist handler dette verktøyet om å jobbe smartere, ikke hardere. Ved å automatisere det som tidligere var en slitsom etterproduksjonsoppgave, frigjør det deg til å fokusere på det du er best på: å komme opp med gode ideer. For å virkelig se det store bildet, hjelper det å forstå den bredere verdenen av AI Powered Content Creation og hvordan verktøy som dette former hele industrien på nytt. Lip-sync AI er en nøkkeldel av den puslespillet og gir deg muligheten til å koble med flere mennesker på en mye mer autentisk måte.

Hvordan lip-sync AI egentlig fungerer

Har du noen gang lurt på hva som skjer under panseret på en lip-sync AI? Det er ikke bare et digitalt dukketeater som beveger en munn opp og ned. Tenk på det mer som en sofistikert oversettelsestjeneste, men i stedet for å konvertere ord fra ett språk til et annet, oversetter den lyder til utrolig presise ansiktsbevegelser.

La oss bruke en analogi. Hvis du skulle lære en robot å snakke, ville du ikke bare vise den alfabetet. Du ville lære den hvordan hver bokstav lyder. Lip-sync AI gjør noe veldig lignende ved å bryte ned lydsporet ditt i de minste lydene, som kalles phonemes. For eksempel brytes ordet "hello" ned i distinkte lyder som "h", "eh", "l" og "ow".

Når AI-en har identifisert disse phonemes, går den i gang med hovedoppgaven: å mappe hver lyd til den eksakte munnformen en person lager når de sier den. Disse visuelle munnformene kalles visemes. AI-en er trent på mengder av data, så den vet instinktivt at "f"-lyden betyr at overtennene skal berøre underleppen. Det er en lynrask oversettelse fra lyd til visuelt.

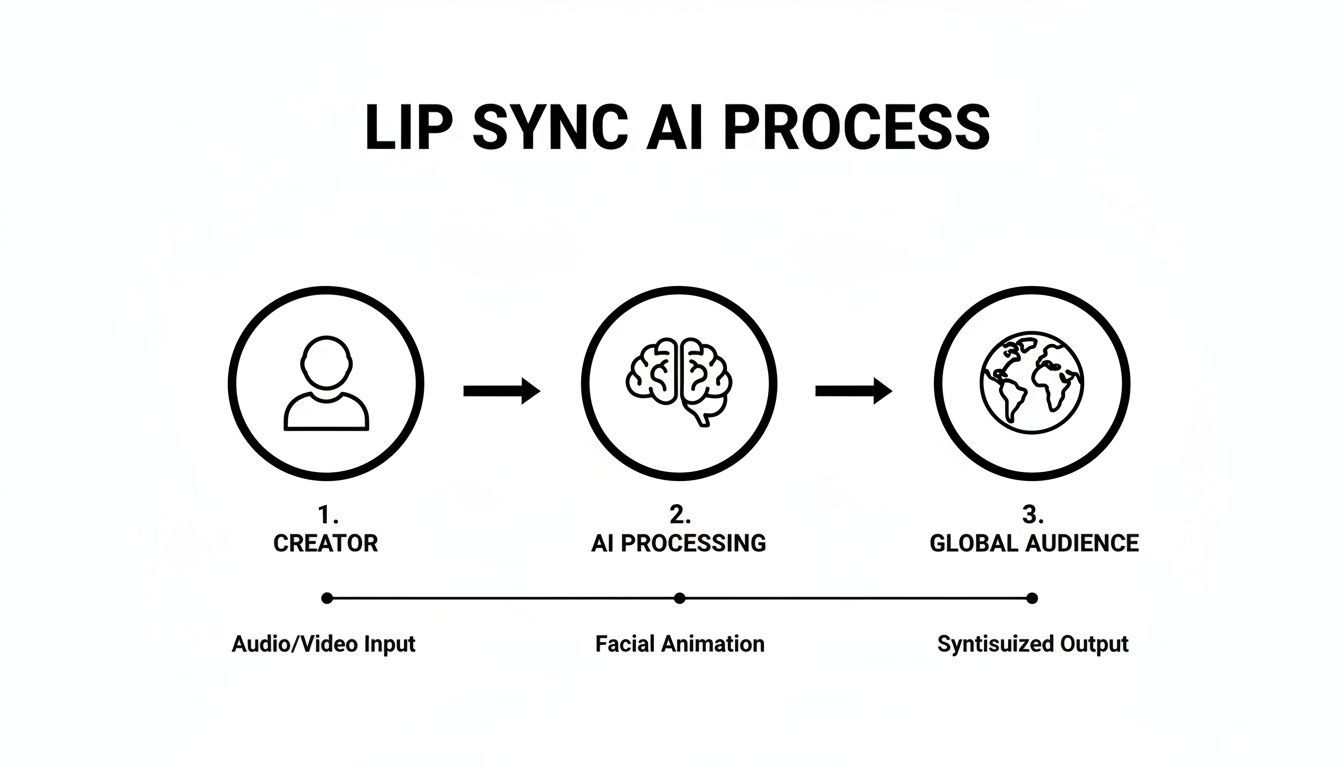

Dette diagrammet bryter ned hvordan et stykke innhold går fra en enkel opptak fra din side til en video klar for et globalt publikum.

Som du ser, leverer skaperen råmaterialet, AI-en gjør det tunge løftet, og resultatet er polert innhold som kobler med seere overalt.

De to kjerneingrediensene

For å få til denne digitale magien trenger AI-en virkelig bare to ting fra deg. Denne enkelheten er en stor del av hva som gjør verktøy som ShortGenius så nyttige for skapere som må jobbe raskt.

- Lydfilen: Dette er din blåkopi. Det kan være en voiceover du nettopp spilte inn, en profesjonelt dubbet lydspor for et nytt språk, eller enhver annen opptak av noen som snakker. Jo renere lyden, desto bedre. Klar, tydelig tale gir AI-en et mye enklere sett med phonemes å jobbe med, noe som alltid fører til et mer nøyaktig og troverdig resultat.

- Videoen eller avatar: Dette er lerretet ditt. Du kan bruke en video av en ekte person eller til og med et statisk bilde av en AI-generert avatar. AI-en bruker dette visuelle grunnlaget til å generere og legge over nye, perfekt synkroniserte munnbevegelser.

Men moderne dypelæringsalgoritmer stopper ikke der. De går et skritt videre ved å analysere nyansene i lyden – tonen, følelsen, til og med talerens hastighet. Dette hjelper til med å gjøre den endelige animasjonen mye mer naturlig. I kjernen handler lip-sync AI om den ekspertmessige evnen til å sync audio video så sømløst at seeren aldri engang tenker på det.

Konklusjonen er denne: Det handler ikke bare om å bevege lepper. Det er en dyp analyse av lyd som oversetter tale til realistiske ansiktsuttrykk, og fanger de små detaljene som gjør en opptreden virkelig menneskelig.

Denne graden av automatisering driver alvorlig vekst i industrien. Det globale markedet for lip-sync-teknologi er på vei til å hoppe fra USD 1,12 milliarder i 2024 til anslåtte USD 5,76 milliarder innen 2034. Faktaen om at lydbasert maskinlæring allerede har en 40,7 % markedsandel viser hvor vital denne teknologien har blitt for å ta innhold globalt.

Den samme teknologien er en nøkkelingrediens i mange AI-video-verktøy. Det er det som lar en skaper forvandle et enkelt stillbilde til en fengslende, dynamisk video. Du kan dykke dypere inn i hvordan dette fungerer ved å sjekke guiden vår om hvordan du transformerer bilder til video med AI.

Praktiske anvendelser for skapere og markedsførere

Å kjenne de tekniske detaljene til lip-sync AI er én ting, men den virkelige magien skjer når du ser hvordan det åpner nye kreative og forretningsdører. For skapere og markedsførere er dette ikke bare en nysgjerrighet; det er et seriøst verktøy for å skalere innhold, nå nye markeder og virkelig koble med publikum rundt om i verden.

Den mest åpenbare og kraftfulle bruken er innholdslokalisering. La oss si du har en TikTok som går viralt eller en YouTube-tutorial du har lagt sjelen din i. I stedet for å være begrenset til kun engelsktalende, kan du nå lage versjoner for spanske, hindi- eller japanske publikum nesten øyeblikkelig. AI-en legger ikke bare på en ny lydspor – den animerer omhyggelig leppbevegelsene dine for å matche det nye språket, og gjør den endelige videoen helt naturlig.

Dette skriver om hele oppskriften for global ekspansjon. Den gamle måten å lokalisere en videokampanje på involverte å hyre stemmeskuespillere for hvert språk, booke dyr studiotid og slite seg gjennom uker eller måneder med etterproduksjon. Nå er hele arbeidsflyten raskere og mye mer overkommelig.

Fra globale annonser til AI-avatare

Utover bare å oversette videoer, låser lip-sync AI opp et helt spekter av strategier for å bygge merker og lage fengslende annonser. I kjernen utnytter hver anvendelse evnen til å skille hva noen sier fra hvordan de ser ut mens de sier det.

Her er noen spillendrende måter denne teknologien brukes på akkurat nå:

- Lage engasjerende AI-avatare: Du kan ta et enkelt bilde – av en maskot, en grunnlegger eller en virtuell influencer – og gi det liv. Bare gi det en text-to-speech-voiceover, så har du en endeløs forsyning av sosiale medie-innhold uten at noen trenger å stå foran et kamera.

- Lokalisere annonskampanjer: Et merke kan produsere én fantastisk, høyt budsjettert annonse og deretter bruke AI til å tilpasse den for dusinvis av internasjonale markeder. Dette holder merkevaren konsistent mens budskapet føles lokalt og personlig. Denne tilnærmingen er en livredder for annonsplattformer som krever en jevn strøm av ferskt kreativt innhold. Du kan se hvordan dette fungerer i en bredere strategi ved å sjekke guiden vår om å lage effektive AI UGC-style annonser.

- Sømløse lydkorrigeringer: Vi har alle vært der. Du fullfører en perfekt videoeditering, bare for å oppdage en feil i voiceoveren. I stedet for et frustrerende gjenopptak kan du bare spille inn den korrigerte lydlinjen og la AI-en sømløst lappe den inn, med perfekt match til leppene dine.

Den virkelige kraften her er å koble fra det visuelle fra lyden. Dette gir skapere enorm fleksibilitet til å eksperimentere, korrigere feil og tilpasse innhold for ulike plattformer og publikum uten å starte fra bunnen av hver gang.

For å vise hvordan disse ideene kommer til live, her er en rask oversikt over hvordan skapere og merker setter lip-sync AI i arbeid.

Lip-sync AI-anvendelser for skapere og merker

| Use Case | Primary Benefit | Example Application |

|---|---|---|

| Global Content Distribution | Audience Growth | En YouTuber oversetter sin best presterende video til 5 nye språk for å nå et globalt publikum, og tredobler potensiell visningsrate. |

| Multilingual Ad Campaigns | Increased ROI | Et D2C-merke lager 10 lokalisert versjoner av én annonse for ulike land, og forbedrer annonsens relevans og konverteringsrater. |

| AI Influencers & Avatars | Content Scalability | Et selskap bruker sin animerte maskot til å lage daglige sosiale medie-oppdateringer uten å trenge et videoteam for hver post. |

| Post-Production Fixes | Time & Cost Savings | En filmskaper korrigerer en feiluttalt linje i en avgjørende scene uten å måtte spille inn på nytt, og sparer tusenvis av dollar. |

Dette er ikke bare en mindre forbedring – det er en fundamental endring i hvordan video lages.

AI-video-dubbing-markedet var verdsatt til $31,5 millioner i 2024 og forventes å skyte i været til $397 millioner innen 2032. Denne eksplosive veksten skyldes den utrolige tiden og pengene det sparer. En flerspråklig kampanje som tidligere krevde et stort budsjett og måneder med arbeid, kan nå snus rundt på under en uke for under $2000, og setter global rekkevidde i hendene på solo-skapere. Du kan lære mer om den evoluerende økonomien til AI lip-sync-teknologi og se hvordan det endrer hele skaperøkonomien.

Hvordan velge riktig lip-sync AI-verktøy

Med en flom av nye verktøy som treffer markedet, kan det å velge riktig lip-sync AI føles som et skudd i blinde. Men ikke alle plattformer er bygget likt, og det feile valget kan etterlate deg med robotaktige, klønete videoer som frastøter seere i stedet for å engasjere dem. Du trenger en enkel sjekkliste for å skjære gjennom markedsføringsfløyellet.

Den absolutte nummer én-faktoren er kvaliteten på synkroniseringen selv. Ser den endelige videoen naturlig ut, eller faller den inn i den grøssende "uncanny valley"? Et godt verktøy forstår de små, subtile bevegelsene til en ekte munn – hvordan den formes rundt ulike lyder og kobles til talerens uttrykk.

En billig eller dårlig trent AI kan bare flappe munnen åpen og lukket, noe som er en umiddelbar give-away på at noe er falskt. Den beste måten å vurdere dette på er å ta den samme korte lydklippet og kjøre det gjennom noen få ulike verktøy. Sett resultatene side om side og stol på magefølelsen din.

Vurdere nøkkelfunksjoner og ytelse

Utover ren realisme må du tenke på dine spesifikke kreative behov. Det perfekte verktøyet for en flerspråklig bedriftslærer er sannsynligvis overkill for en meme-skapere. Å spikre evalueringsprosessen på forhånd vil spare deg for en verden av hodepine senere.

Her er de essensielle tingene å se etter:

- Språk- og aksentstøtte: Dette er en deal-breaker hvis du prøver å nå et globalt publikum. Finn ut hvor mange språk verktøyet støtter og, like viktig, hvor godt det håndterer ulike aksenter og dialekter. Et verktøy som kan spikre en glaswegian-aksent er mye mer imponerende enn ett som bare fungerer med en generisk, robotaktig stemme.

- Behandlingstid: Hvor lenge må du stirre på en fremdriftsbar for et ett-minutts klipp? I verden av kortformet innhold er hastighet alt. Noen plattformer kan snu en video på minutter, mens andre lar deg vente i det som føles som en evighet.

- Brukervennlighet: Et verktøy med en million funksjoner er verdiløst hvis grensesnittet er et mareritt. Se etter et rent, enkelt design som lar deg laste opp video og lyd, og deretter påføre lip-sync med bare noen få klikk. Plattformer som ShortGenius sikter mot å gjøre dette trinnet til en sømløs del av en mye større videoproduksjonsflyt.

Det ultimate målet er å finne en løsning som passer inn i din eksisterende prosess uten å skape nye flaskehalser. Det riktige verktøyet bør føles som en forlengelse av din kreative verktøykasse, ikke et komplisert stykke programvare du må lære.

Vurdere integrasjon og markedsutvikling

Til slutt, tenk større bilde. Hvordan passer denne lip-sync AI inn i arbeidsflyten din? Fungerer den godt med videoredigererne du allerede elsker? Kan den håndtere videformatene og oppløsningene du trenger? Sømløs integrasjon er like kritisk som teknisk ytelse.

Den eksplosive veksten i dette feltet forteller deg alt du trenger å vite. Markedet for AI i media, som inkluderer lip-sync-tech, forventes å vokse fra USD 8,21 milliarder i 2024 til USD 51,08 milliarder innen 2030. Den typen rask ekspansjon betyr at sofistikert lyd-visuell AI raskt blir en kjerne-del av enhver moderne innholdsstrategi. Du kan få mer detaljer om AI-media-markedet på datainsightsmarket.com.

Ved å velge et verktøy som er godt støttet og kontinuerlig forbedres, løser du ikke bare et problem for i dag – du investerer i din evne til å lage fantastisk innhold i årene som kommer.

En trinn-for-trinn-guide til din første lip-sync-video

Greit, la oss sette i gang. Å lage din første video med lip-sync AI er ikke så komplisert som det høres ut. Vi kan bryte det ned i en enkel, firetrinns prosess som tar deg fra en grov idé til en ferdig video klar til å deles.

Dette er den grunnleggende arbeidsflyten du finner i plattformer som ShortGenius, som setter denne kraftfulle teknologien rett under fingertuppene dine.

Trinn 1: Forbered lydsporet ditt

Alt starter med lyden. Tenk på det som blåkopien for videoen din – AI-en trenger et rent, klart spor for å finne ut hvilke munnformer den skal lage. Du kan spille inn din egen stemme eller bruke en kvalitets text-to-speech-generator for en konsekvent klar fortelling.

For det beste resultatet, sørg for at lyden har lite eller ingen bakgrunnsstøy. Å snakke tydelig gjør også en stor forskjell. Jo mer distinkte ordene dine er, desto bedre kan AI-en matche leppbevegelsene. Å få dette første trinnet rett setter deg opp for et mye mer troverdig resultat.

Trinn 2: Velg videoen eller avatar din

Neste opp, du må velge hvem (eller hva) som skal gjøre praten. Dette kan være et videoklipp du allerede har av noen som snakker eller til og med bare et statisk bilde av en AI-avatar du har laget. Nøkkelen her er et klart bilde av ansiktet.

Her er et profftips: En rett-på, frontvendt vinkel fungerer best. AI-en trenger en direkte, uhindret utsikt over munnen for å generere realistiske bevegelser. Hvis ansiktet er vendt bort eller noe blokkerer utsikten, vil den endelige animasjonen se litt feil ut.

Kvaliteten på inputene dine bestemmer direkte kvaliteten på outputen din. En skarp, godt opplyst video og ren lyd gir AI-en det beste mulige materialet å jobbe med, og minimerer feil og sikrer et mer livaktig resultat.

Trinn 3: Påfør lip-sync AI

Dette er der den virkelige moroa begynner, og det er vanligvis bare et spørsmål om å klikke en knapp. Når du har lastet opp lyd- og videofilene til verktøyet, påfører du bare lip-sync-funksjonen. AI-en går deretter i gang, bryter ned lydene i lyden din og lager helt nye munnbevegelser på videoens subjekt for å matche.

Hele prosessen er overraskende rask, ofte bare noen få minutter. Mens AI-en gjør det tunge løftet, kan du forberede deg på det siste og viktigste trinnet.

Trinn 4: Gjennomgå og forbedre outputen

Ingen AI treffer det perfekt hver eneste gang, så en endelig sjekk er avgjørende. Se på den genererte videoen og legg stor vekt på timingen. Ser synkroniseringen naturlig ut? Er det noen rare rykk eller øyeblikk der leppene ikke helt matcher lyden?

De fleste gode verktøy gir deg alternativer for å gjøre små justeringer. Noen ganger kan det å flytte lydtimen litt eller kjøre en spesifikk seksjon på nytt jevne ut enhver krøll. Når du er fornøyd, er videoen din klar til eksport. Denne hele prosessen er en kjerne-del av mange AI-video-arbeidsflyter, og du kan se hvordan den passer inn i det større bildet ved å lese guiden vår om text-to-video AI-modeller.

Har du spørsmål om lip-sync AI? Vi har svar.

Å hoppe inn i ny tech bringer opp noen spørsmål. Det er helt normalt. La oss ta noen av de mest vanlige jeg hører fra skapere om lip-sync AI, så du kan komme rett i gang med å lage flott innhold.

Hvordan håndterer lip-sync AI ulike språk?

Dette er en stor en. Den gode nyheten er at de fleste toppmodeller er trent på gigantiske datasett fylt med utallige timer med flerspråklig tale. Det betyr at de er overraskende dyktige til å håndtere ikke bare ulike språk, men også aksenter. Det handler ikke bare om ord; det handler om å lære de spesifikke munnformene – det tekniske begrepet er visemes – som hører til hver unik lyd.

Selvsagt er ikke alle verktøy bygget likt. Du vil finne at ytelsen kan variere mye fra plattform til plattform, noe som er grunnen til at jeg alltid anbefaler å kjøre et kort testklipp på målspråket ditt før du forplikter deg til et stort prosjekt. De beste systemene vil fange de subtile nyansene og få taleren til å se ut som en innfødt, i stedet for å påføre en generisk, "one-size-fits-all"-munnbevegelse som bare føles feil.

Hva er forskjellen mellom lip-sync og dubbing?

Det er lett å blande disse to, men de er virkelig to sider av samme mynt som jobber sammen for å få en video til å føles autentisk på et nytt språk.

Tenk på det slik:

- Video Dubbing: Dette handler om lyden. Det er prosessen med å bytte ut den originale stemmesporet med en ny, vanligvis på et annet språk.

- Lip Sync: Dette er den visuelle oppfølgingen. Når den nye lyden er lagt ned, går AI-en i gang og endrer digitalt talerens munnbevegelser for å passe perfekt til den nye dialogen.

Når du kombinerer dem, får du en helt lokalisert video. Lyden er riktig, og det visuelle matcher. Den ene håndterer det du hører, den andre håndterer det du ser.

Denne ett-to-punch er det som lar en skaper ta en enkelt video og få den til å føles innfødt for publikum overalt i verden, uten den distraherende, ute-av-synk-følelsen som umiddelbart trekker en seer ut av opplevelsen.

Hvordan kan jeg unngå den grøssende "uncanny valley"-effekten?

Ah, "uncanny valley". Det er den rare, urovekkende følelsen når noe ser nesten menneskelig ut, men noen subtile ting er bare ikke helt riktige. Det er en reell bekymring med lip-sync AI, men du kan absolutt styre unna det.

Først av alt, start alltid med høykvalitets kilde material. En klar, godt opplyst video eller en polert avatar gir AI-en et mye renere lerret å jobbe med. Hvis du gir den uklart eller lavoppløselig footage, ber du praktisk talt om et rart resultat.

Neste, fokuser på lydkvaliteten din. Bruk en høykvalitets AI-stemme som høres naturlig ut, eller enda bedre, en ren opptak av en menneskelig stemmeskuespiller. En robotaktig, flat stemme paret med realistiske leppbevegelser er en oppskrift på umiddelbar grøss.

Til slutt, husk å legge til de subtile menneskelige touchene. En AI-generert scene kan føles litt steril alene. Å legge til små ting som naturlige hodebevegelser, realistisk blunking eller til og med bare en interessant bakgrunn kan gjøre hele videoen mer jordet og levende, og trekke den rett ut av uncanny valley.

Klar til å lage fantastiske, flerspråklige videoer uten bryderi? ShortGenius integrerer kraftfulle AI lip-sync-funksjoner i en komplett videoproduksjonsflyt. Produser profesjonelle annonser og sosiale medie-innhold på minutter. Begynn å lage gratis på shortgenius.com.