Oppnå slående kvalitet: Oppskalér video med AI

Lær en praktisk arbeidsflyt for å oppskalere video med AI. Dekk forberedelse av opptak, optimale innstillinger, batch-behandling og eksport til sosiale medier med ShortGenius.

Du har et klipp som burde fungere.

Kanskje det er et gammelt kundeanbefaling optatt med en telefon. Kanskje det er bruker-generert opptak som treffer følelsen perfekt, men ser mykt ut på en moderne skjerm. Kanskje det er en tidligere topputfører du vil reposte, beskjære og gjøre om til friske short-form-eiendeler. Ideen er sterk. Kildefilen er det ikke.

Det er her videooppskalering med AI slutter å være en nysgjerrighet og begynner å være et produksjonsverktøy.

God AI-oppskalering kan redde opptak du ellers ville kastet. Dårlig AI-oppskalering sløser timer, overdriver komprimeringsstøy og gir ansikter det plastiske, overkokte utseendet som seere legger merke til umiddelbart. Forskjellen kommer ned til arbeidsflyten. Kildekvalitet, modellvalg, batch-håndtering og eksportbeslutninger betyr mer enn markedsføringskravene på et verktøys nettside.

Hvorfor videooppskalering med AI er en skapers superkraft

Lavoppløselige opptak hadde tidligere en hard grense. Du kunne forstørre dem, men du kunne ikke egentlig forbedre dem. Tradisjonell skalering strakte pikslene. Det gjorde klipp større, ikke bedre.

Videooppskalering med AI fungerer annerledes. Den bruker dyp læring til å rekonstruere detaljer, tolke omkringliggende piksler og bevare bevegelse på tvers av rammer. Den siste delen er viktig. Et enkelt bilde kan se skarpt ut og likevel mislykkes som video hvis kanter glitrer eller teksturer flimrer fra ramme til ramme.

Hvorfor skapere bryr seg nå

Dette er ikke lenger en nisje-restaureringstriks. AI Video Upscaling Software-markedet vokste fra $550 million USD i 2024 til $670 million USD i 2025, og forventes å nå $5 milliarder innen 2035, med 22,3 % CAGR, drevet av etterspørsel etter 4K-levering og sterkere visuell kvalitet for engasjement, ifølge Wise Guy Reports on the AI video upscaling software market.

Det stemmer med det skapere håndterer hver uke:

- Gammelt opptak har fortsatt verdi: Tidligere intervjuer, webinarer, demoer og anbefalinger inneholder ofte ideer verdt å republisere.

- UGC fanges sjelden perfekt: Flotte kroker kommer fra ufullkomne klipp.

- Alle plattformer straffer mykhet: Beskjæring, endring av størrelse og rekomprimering av svakt opptak gjør feil mer åpenbare.

Praktisk regel: Bruk AI-oppskalering til å gjenvinne sterkt innhold. Forvent ikke at det redder svak kinematografi, misset fokus eller kraftig bevegelsesuskarphet.

Det er også en bredere arbeidsflyt-vinkel. Hvis du allerede gjør ett asset om til mange, blir oppskalering en del av ompakking, ikke bare reparasjon. Det er derfor det passer naturlig sammen med AI content repurposing. Et enkelt lavoppløselig kilde kan bli shorts, firkantede klipp og oppdaterte reposter hvis du renser kilden før du endrer størrelse og distribuerer den.

Hva det er best på

AI-oppskalering skinner i noen spesifikke situasjoner:

| Use case | Hvorfor det fungerer |

|---|---|

| Arkivklipp | Det kan gjenopprette klarhet uten å manuelt bygge opp hvert skudd |

| Skjermopptak | Det hjelper tekstkanter og UI-elementer å overleve komprimering bedre |

| UGC for annonser | Det hever baseline-kvalitet før tekster, branding og eksport |

| Beskårne sosiale klipp | Ekstra oppløselighetsmargin hjelper når du gjør ett master om til flere formater |

Hvis du trenger en rask repetisjon på hva høyere oppløselig levering betyr i praksis, er denne nedbrytningen av https://shortgenius.com/blog/what-is-4-k-resolution nyttig før du bestemmer om et klipp fortjener en 4K-finish.

Forberede kildeopptak for feilfri oppskalering

Den største feilen med videooppskalering med AI er å mate den med den verste filen du har og håpe modellen utfører mirakler.

Det vil den ikke.

Markedet beveger seg raskt. Det bredere Video Enhancing AI Tool-markedet forventes å nå $1,166 million USD innen 2032, med 37,1 % CAGR, drevet av dyp læringssystemer som leverer øyeblikkelige 2x til 4x oppløsningsforbedringer samtidig som de reduserer båndbredde, ifølge Intel Market Research on the video enhancing AI tool market. Men bedre modeller kansellerer ikke dårlige inndata.

Reviser klippet før du behandler det

Før jeg setter opp noe, sjekker jeg om klippet er en god kandidat eller en felle.

Bruk denne korte revisjonen:

- Komprimerings-skade: Hvis du ser makroblokkering, myggstøy eller utsvert detalj, kan modellen behandle den skaden som ekte tekstur.

- Bevegelsesuskarphet: AI kan skjerpe kanter, men den kan ikke gjenvinne detaljer som aldri eksisterte i rammen.

- Fokus: Litt mykt kan fungere. Misset fokus forblir vanligvis misset.

- Rammestabilitet: Skjelvende klipp er vanskeligere å oppskalere rent, spesielt hvis bakgrunnen allerede faller fra hverandre.

- Filens opprinnelse: Eksporter fra det nærmeste originalen du kan finne. Ikke oppskalér en fil som allerede er komprimert flere ganger.

Velg riktig kilde, ikke bare den største kilden

Skapere jager ofte oppløsning først. Det er bakvendt.

En renere 720p-master kan overgå et slitt 1080p-repost. Det som betyr noe er om kilden bevarer ekte bildeinformasjon. Hvis du har alternativer, velg filen med minst rekomprimering og færrest redigeringer bakt inn i den.

Hvis kilden allerede ser støyete, knasete og ustabil ut i native størrelse, gjør oppskalering vanligvis de problemene lettere å se.

Hva du skal fikse før oppskalering

Litt forberedelse sparer mye rerendering.

-

Beskjær klippet først

Ikke behandle død luft, falske starter eller alternative tagninger hvis du ikke bruker dem. -

Skill opptakstyper

Pratende hoder, gameplay, animasjon og skjermopptak oppfører seg forskjellig. Ikke batch dem under ett preset. -

Håndter åpenbar opprydding tidlig

Hvis filen trenger basic denoise eller deinterlacing, gjør det før oppskaleringspasset. -

Kjør et kort prøveeksempel

Ta et krevende øyeblikk fra klippet. Rask håndbevegelse, hår-detaljer, kamerabevegelse, fin tekst. Hvis prøven mislykkes, vil ikke fullrenderen forbedre seg senere.

Dårlige kandidater for AI-oppskalering

Noen klipp er ikke verdt compute-kraften.

- Sterkt filtrerte sosiale nedlastinger

- Tiny repostede memer

- Opptak med alvorlig lavlys-oppbrytning

- Klipp der ansikter allerede er forvrengt av komprimering

Det høres strengt ut, men det beskytter tiden din. Den beste arbeidsflyten starter med utvelgelse, ikke programvareinnstillinger.

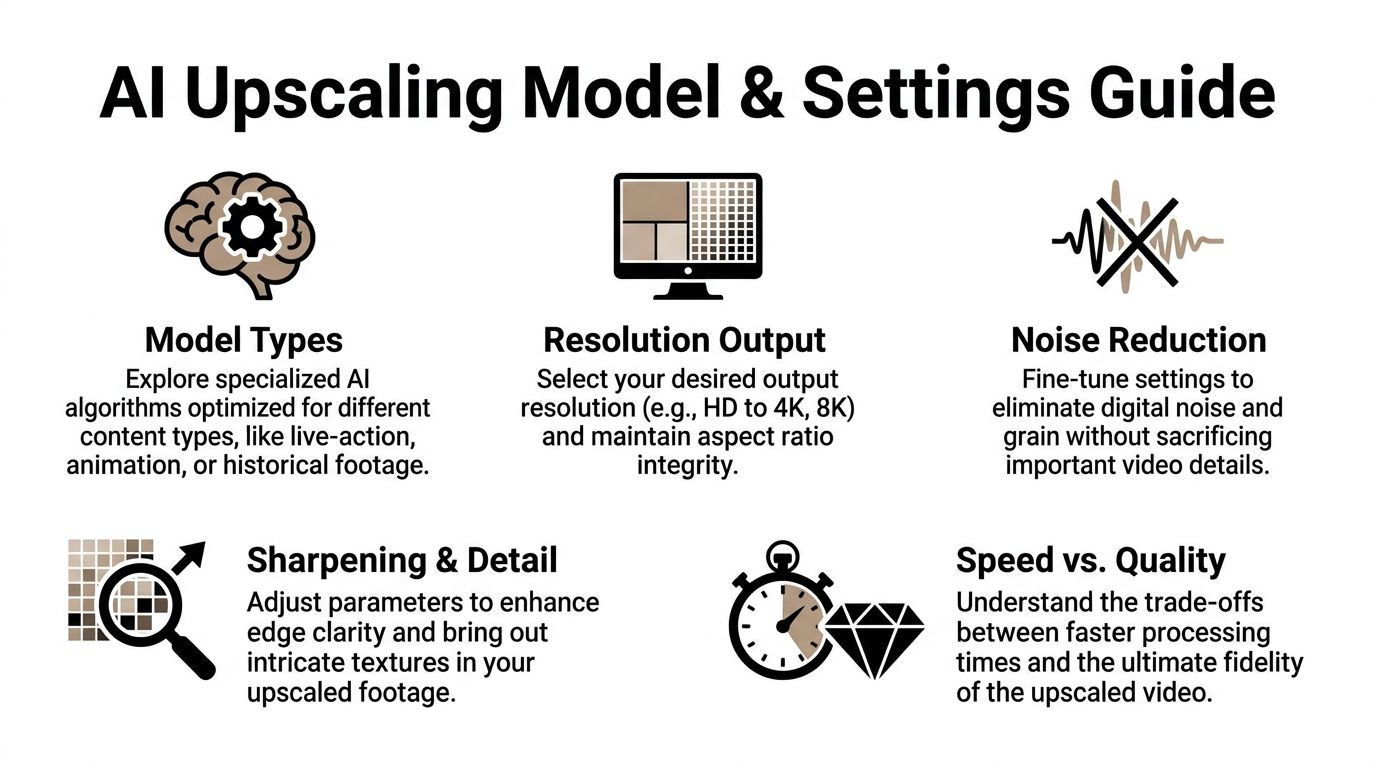

Velge riktig AI-modell og innstillinger

De fleste mislykkede oppskaleringer kommer fra samme vane. Folk laster et klipp, velger høyeste utdata, skyver sharpening for langt og antar at mer prosessering gir bedre kvalitet.

Det gjør det ikke.

Ulike modeller gjør ulike kompromisser. Noen bevarer realisme. Noen finner opp mer tekstur. Noen oppfører seg bra på animasjon og sliter på hud. Noen er stabile på tvers av bevegelse. Andre produserer imponerende stillrammer og stygge temporale artefakter.

Et nyttig benchmark ligger bak alt dette. I AI-oppskalering kan deep-learning-modeller som basicVSR++ oppnå over 13 % høyere VMAF-scores enn tradisjonell Lanczos når de oppskaleres fra 540p til 1080p, med PSNR-gevinster på 2-4 dB, men hardware-grenser på consumer GPU-er kan forårsake 50 %+ feilrater for 4K-klipp lengre enn 2 minutter på grunn av VRAM-mangel, som notert av At Scale Conference coverage of on-device video playback upsampling.

Modellvalg starter med opptakstype

En enkel måte å tenke på modeller:

| Opptakstype | Hva du skal prioritere | Vanlig feilmodus |

|---|---|---|

| Live action | Naturlig hud, stabil bevegelse, moderat sharpening | Voksaktige ansikter |

| Animasjon | Rene linjer, kantkonsistens | Haloing rundt konturer |

| Gameplay | Bevegelseshåndtering, tekst/UI-klarhet | Ghosting i raske scener |

| Arkivopptak | Konservativ rekonstruksjon | Falsk tekstur som endrer det originale utseendet |

Hvis et verktøy tilbyr flere modellfamilier, ikke bruk ett universelt preset. Det er slik du får overskarpete intervjuer og mudret animasjon i samme prosjektmappe.

For redigerere som sammenligner verktøy og arbeidsflyter før de forplikter seg til en stack, hjelper denne oppsummeringen av https://shortgenius.com/blog/beste-ai-videoredigeringsprogramvare med å ramme inn hvor oppskalering passer inn i en større redigerings-pipeline.

Innstillingene som betyr mest

Mange UI-etiketter høres tekniske ut, men oppfører seg på forutsigbare måter.

Denoise

Bruk denoise når kilden har synlig støy som modellen fortsetter å tolke som detaljer. Bruk mindre enn du tror du trenger.

For mye denoise fjerner tekstur fra hud, stoffer og bakgrunner. Så prøver sharpening å bygge opp falsk krisphet på toppen av et flatet bilde.

Deblock

Deblock hjelper når du håndterer komprimerings-skade. Det kan jevne ut stygge blokkanter før oppskalermodellen overdriver dem.

Dette er nyttig på nedlastede klipp og gamle eksporter. Det er farlig på allerede rent opptak fordi det kan mykne kanter du ville bevare.

Sharpen

Sharpen er der renderen ofte ødelegges.

Litt sharpening kan gjenvinne kantdefinisjon. For mye skaper halos, sprøtt hår og det syntetiske «AI-forbedrede» utseendet. Hvis en prøve ser imponerende ut på pause, men stygt i bevegelse, er sharpening ofte synderen.

Den riktige sharpen-innstillingen bør forsvinne inn i den ferdige videoen. Hvis seere kan føle prosesseringen, er det vanligvis for aggressivt.

Oppløsningsstrategi slår brute force

Å gå rett til 4K er ofte feil trekk. For sosialt innhold kan 1080p eller et moderat steg opp se renere ut enn en større fil med oppfunnet detalj.

Her er den praktiske sammenligningen:

| Tilnærming | Fordel | Ulempe |

|---|---|---|

| Direkte hopp til 4K | Maksimal utdata-størrelse | Mer hallusinert detalj, tyngre renders |

| Steg opp til 1080p først | Bedre kontroll, enklere QA | Ekstra beslutningspunkt |

| Moderat oppskalering bare | Raskere, tryggere for sosial levering | Mindre dramatisk før-og-etter |

Den midterste veien vinner overraskende ofte. Du beholder kontroll over tekstur og bevegelse, og unngår å bruke hele natten på å rendere en fil som likevel komprimeres hardt ved opplasting.

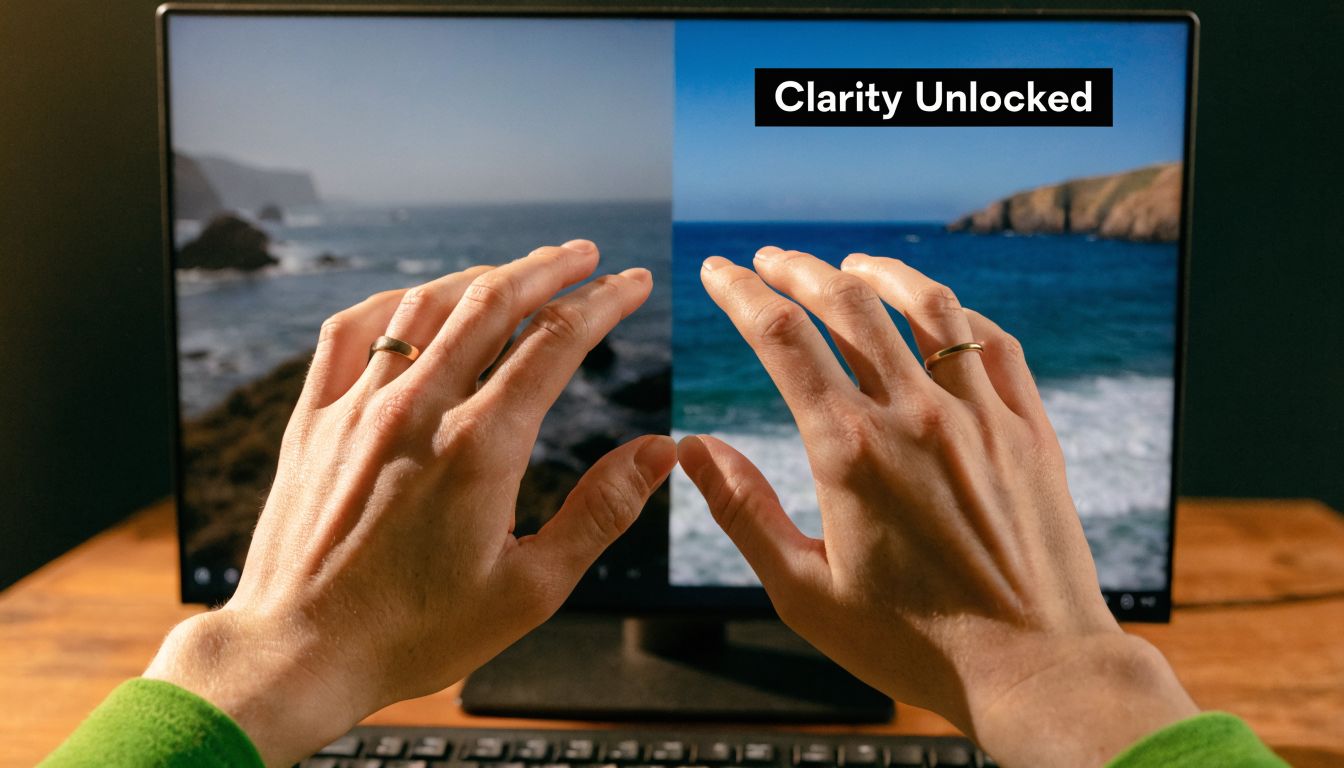

En rask visuell gjennomgang hjelper når du finjusterer dette:

Lokal versus sky-prosessering

Dette valget handler mindre om ideologi og mer om begrensninger.

Lokal prosessering gir deg kontroll. Den binder også opp maskinen din og avslører GPU-grensene raskt.

Sky-prosessering fjerner hardware-flaskehalsen, men du bytter bort noe kontroll over timing, kostnadsstruktur og noen ganger fininnstilte innstillinger avhengig av plattformen.

Velg lokal når:

- Du trenger repeterbare presets på en kjent maskin

- Du tester mye

- Du vil ha direkte tilsyn over hvert pass

Velg sky når:

- GPU-en din fortsetter å feile på lengre klipp

- Du trenger teamtilgang

- Du heller vil fortsette å redigere mens renders skjer et annet sted

Bygg presets, så mistro dem

Presets sparer tid. Blind tillit ødelegger kvalitet.

Hold noen startpresets etter innholdstype, så test hver ny kilde med et kort segment før du lanserer full render. Ett preset for rent pratende-hode-opptak. Et annet for røft UGC. Et annet for animasjon eller skjermopptak.

Den disiplinen betyr mer enn merkevarenavnet på programvaren.

Mestre din batch-oppskalering-arbeidsflyt

Oppskalering av ett klipp er et eksperiment. Oppskalering av tjue klipp er operasjoner.

Mange skapere mister ofte tid. De behandler hver fil som en tilpasset jobb, pass opp eksportene og kjør mislykkede renders på nytt fordi ingenting var organisert fra starten. En batch-arbeidsflyt fikser det.

Ifølge Audials guidance on beginner mistakes in AI video upscaling, anbefaler eksperter å starte med høy kvalitet, minimalt komprimert video og teste inkrementelle oppløsningshopp som 720p til 1080p før 4K for å unngå unaturlige resultater og 4x lengre rendertider. Samme veiledning noterer at aggressive modeller kan produsere 20-30 % artefaktrater i bevegelsestunge scener, som faller til mindre enn 5 % med en riktig arbeidsflyt.

En lokal overnattings-arbeidsflyt

For desktop-verktøy er den sikreste oppsettet bevisst kjedelig.

-

Opprett tre mapper

Bruksource,test-rendersogfinal-upscaled. Hold dem separate. -

Omdøp klipp før køing

Legg til plattform- eller prosjekt-tags i filnavn så du kan spore feil raskt. -

Grupper etter opptaksatferd

Ikke bland skjelvende UGC med polert studio-opptak i ett batch-preset. -

Kjør ett stresstest per gruppe

Velg det vanskeligste klippet i hver kategori. Rask bevegelse, hår, tekst, folkemengdeskudd. Hvis det fungerer, følger de enklere klippene vanligvis. -

Kø fulljobber over natten

La maskinen rendere når du ikke redigerer.

En sky-batch-arbeidsflyt

Sky-arbeidsflyter fungerer bedre når du håndterer volum, samarbeid eller en maskin som ikke tåler belastningen.

Prosessen er annerledes:

- Last opp bare godkjente kilder: Ikke bruk skyen som sorteringsrom.

- Bruk klare navnekonvensjoner: Versjonsforvirring forverres raskt i delte prosjekter.

- Dokumenter presetet: Øyeblikket en god batch lander, lagre den eksakte konfigurasjonen.

- Tildel eierskap for gjennomgang: Noen må spot-sjekke utdata, ikke bare bekrefte at filer eksisterer.

Hva du skal sjekke etter en batch-kjøring

En fullført render-kø er ikke det samme som en brukbar batch.

Gjennomgå disse først:

| Sjekk | Hvorfor det betyr noe |

|---|---|

| Bevegelseskonsistens | Flimring gjemmer seg ofte til avspilling |

| Ansikter og hender | Aggressive modeller mislykkes her først |

| Fin tekst og UI | Flott for skjermopptak, lett å ødelegge |

| Bildehastighetsintegritet | Mismatches skaper hakking ved eksport |

| Aspektforhold | Feil håndtering forårsaker klønete beskjæringer senere |

Batch-oppskalering sparer bare tid hvis din verifiseringsrunde er rask og nådeløs.

Feil som ødelegger skala

De største feilene kommer vanligvis fra prosess, ikke modellkvalitet.

- Ett preset for hvert klipp: Raskt, men upålitelig.

- Ingen prøverender: Det er slik du våkner til en mappe full av ubrukelige filer.

- Hopper over QC fordi thumbnails ser bra ut: Mange artefakter vises bare i avspilling.

- Oppskalering etter flere redigerings-eksporter: Hver re-encode senker taket ditt.

For team er målet ikke bare raskere prosessering. Det er forutsigbar prosessering. Et stabilt batch-system gjør videooppskalering med AI til en del av vanlig produksjon i stedet for en redningsaksjon hver gang et lavoppløselig asset dukker opp.

Etter-oppskalering-redigering og smarte eksport-presets

En oppskalert fil er ikke en ferdig fil.

Den er nærmere et restaurert negativ. Du må fortsatt forme den, sjekke den og eksportere den for stedet den skal leve. Den siste delen betyr noe fordi skapere ofte jager oppløsning mens de ignorerer leveringsbetingelser.

ROI-spørsmålet er ekte. Som Cloudinary’s guide to using AI to upscale video noterer, lover mange verktøy 4K, men plattformer som TikTok og Instagram Reels nedskalerer innhold uansett. Det reiser et praktisk spørsmål for skapere. Er en 4K-oppskalering faktisk gunstig, eller ville en optimalisert HD-eksport prestere like bra for mobil-først-visning?

Opprykningsrunden betyr noe

AI-modeller introduserer ofte subtile problemer som ikke vises i en side-ved-side stillramme.

Vanlige inkluderer:

- Fargeavdrift: Hudtoner kan skifte litt etter forbedring.

- Kantfladder: Fin detalj kan pulsere på tvers av bevegelse.

- Teksturinkonsistens: Hår, stoffer og bakgrunner kan veksle mellom skarpt og mykt.

Jeg behandler etter-oppskalering-redigering som finish-arbeid, ikke valgfri polering.

Fiks farge før eksport

Selv en lett grading kan forene bildet. Match hudtoner, trekk tilbake høylys hvis oppskaleringen gjorde dem sprø, og sørg for at svarte ikke har blitt knasete.

Gjennomgå bevegelse i avspilling

Ikke inspiser bare ramme-grabs. Se klippet i fullskjerm, deretter igjen på en telefon. Bevegelsesproblemer avslører seg i avspilling, ikke skjermbilder.

Hvis en oppskalering ser flott ut på pause og rart i bevegelse, er eksporten ikke klar.

Smarte eksporter slår max-eksporter

Skapere tyr ofte til «høyeste kvalitet tilgjengelig». Det høres trygt ut, men det er ikke alltid nyttig.

For short-form-distribusjon, tenk i termer av plattformtilpasning:

| Destinasjon | Bedre standardtankegang | Hva du skal unngå |

|---|---|---|

| TikTok | Rent, stabilt HD-master | Store filer med marginal synlig gevinst |

| Instagram Reels | Sterk komprimeringsmotstand | Over-sharpenede eksporter som brytes etter opplasting |

| YouTube Shorts | Krisp tekst og stabil bevegelse | Unødvendig oversized renders hvis kilden var svak |

Poenget er ikke at 4K er dårlig. Det er at 4K ikke automatisk er bedre for hver sosiale opplasting.

En praktisk eksport-policy

Bruk dette regelsettet:

-

Eksporter for plattformen, ikke din stolthet

Seere bryr seg om klarhet og jevnhet mer enn renderinnstillingene dine. -

Hold en høy-kvalitet arkiv-master

Lagre en ren master for fremtidig gjenbruk, beskjæringer eller klientlevering. -

Opprett plattformspesifikke derivater

Ett arkivfil, deretter eksporter tilpasset for vertikalt, firkantet eller horisontalt behov. -

Sjekk det opplastede resultatet

Sosiale plattformer er en del av renderkjeden. Din lokale eksport er ikke det endelige utseendet.

Mange skapere kompromitterer kvalitet ved eksport. De bruker tid på oppskalering, deretter overlater det endelige resultatet til plattformkomprimering uten strategi. Smarte eksport-presets beskytter arbeidet du allerede har gjort.

Automatisere oppskalering i en ShortGenius-pipeline

Manuell oppskalering fungerer når du fikser ett klipp. Den bryter sammen når du produserer sosialt innhold hver uke på tvers av flere kanaler.

Det er flaskehalsen for team. Ifølge Perfect Corp coverage of AI video enhancer workflow limitations, er den største utfordringen å integrere oppskalering i multi-kanal-arbeidsflyter fordi de fleste frittstående verktøy mangler batch-prosessering i skala eller API-tilgjengelighet. En unified publiserings-pipeline betyr mer enn en isolert forbedringsapp.

Hva automatisering egentlig skal gjøre

En nyttig automatisert pipeline legger ikke bare «til oppskalering».

Den skal håndtere en kjede slik:

- Innta kildeklippet

- Ruter det etter innholdstype

- Bruk riktig forbedringspreset

- Send resultatet inn i redigering

- Endre størrelse og pakke for hver kanal

- Planlegg distribusjon

Den strukturen gjør oppskalering fra et reparasjonstrinn til infrastruktur.

Hvor det passer inn i produksjon

For short-form-team er det beste innsettingsspunktet vanligvis tidlig. Rens det visuelle assetet før tekster, branding, reframing og eksport.

Det betyr noe fordi hvert senere trinn avhenger av at kilden ser stabil ut. Hvis du legger til animerte tekster, cut-ins og brand-overlays på svakt opptak først, og så prøver å oppskalere senere, tvinger du modellen til å tolke designelementer og komprimerings-skade samtidig.

En mer pålitelig rekkefølge er:

| Trinn | Bedre sekvens |

|---|---|

| Kildehåndtering | Velg og godkjenn råklipp |

| Forbedring | Oppskalér og rens bevegelse først |

| Redigeringslag | Legg til tekster, beskjæringer, branding, voice |

| Distribusjon | Eksporter per plattform og publiser |

Ett plattformnevning, brukt der det hører hjemme

I en unified arbeidsflyt kan ShortGenius sitte i den produksjonskjeden som ett valg for team som vil ha video-samling, voiceovers, redigering, endring av størrelse, planlegging og API-drevet automatisering i samme miljø. Den typen oppsett betyr noe når du prøver å gjøre røft opptak om til repeterbar output uten å bounce filer på tvers av separate apper. Hvis du bygger et bredere system rundt gjentakende kanalproduksjon, er denne guiden til https://shortgenius.com/blog/youtube-automatisering-ai relevant fordi automatisering bare fungerer når hvert produksjonstrinn kobles rent.

Hva som fungerer og hva som ikke fungerer

Hva som fungerer

- Behandle oppskalering som et preprocessing-trinn

- Lagre presets etter opptaksklasse

- Automatiser repeterbare pass, ikke estetisk dom

- Hold et menneskelig gjennomgangstrinn før publisering

Hva som ikke fungerer

- Send hvert klipp gjennom samme forbedringsprofil

- Automatiser uten QC-eierskap

- Bygg en pipeline som krever manuell filhåndtering mellom verktøy

- Anta at AI-generert og organisk opptak oppfører seg likt under oppskalering

Seieren er ikke bare bedre utseende opptak. Seieren er å fjerne ett til manuelt flaskehals fra innholdsproduksjon.

For byråer, brand-team og høyt-volum-skapere er det den fundamentale skiftet. Oppskalering slutter å være en spesiell fiks for dårlige filer og blir en standard bakgrunnsprosess. Du gjenvinner mer brukbart opptak, bruker mindre tid på repeterbar opprydding og holder output-kvalitet konsistent på tvers av kanaler.

Hvis du vil gjøre denne arbeidsflyten om til et repeterbart system, bringer ShortGenius (AI Video / AI Ad Generator) videoproduksjon, redigering, endring av størrelse, voiceovers, planlegging og automatisert publisering inn i én plattform, så oppskalering kan passe inn i en bredere produksjons-pipeline i stedet for å leve som en engangs manuell oppgave.