En guide til juridiske utfordringer med AI-skuespillere i annonsering

Naviger de juridiske utfordringene med AI-skuespillere i annonsering. Vår guide dekker opphavsrett, personrettigheter og FTC-regler for å holde kampanjene dine i samsvar og trygge.

Å bruke AI-skuespillere i annonsene dine åpner opp for en verden av kreative muligheter, men du må absolutt sette deg inn i de store juridiske utfordringene med AI-skuespillere i reklame før du kaster deg ut i det. De største minefeltene er opphavsrettsbrudd knyttet til AI-treningsdata, utilsiktet krenkelse av en reell persons rett til egen fremtoning, og bøter for villedende praksis under FTC-regler og nye statlige deepfake-lover. Å få dette riktig fra starten er den eneste måten å unngå en svært kostbar juridisk rot på.

De nye juridiske risikoene ved AI-skuespillere i reklame

Å trå inn i AI-drevet reklame er spennende, det er det ingen tvil om. Men det er som å gå inn i et labyrint av juridiske feller du ikke engang visste eksisterte. Tenk på det slik: du er regissøren, men usynlige juridiske rammeverk som opphavsrett, rettigheter til fremtoning og forbrukerbeskyttelseslover er trådtrekkere. Ignorerer du dem, kan hele kampanjen din kollapse.

Dette nye terrenget medfører risikoer som tradisjonell reklame aldri har stått overfor. Merkevaren din kan bli saksøkt for opphavsrettsbrudd bare fordi AI-modellen ble trent på beskyttede bilder uten å spørre. Det er også sjokkerende enkelt for et AI-generert ansikt å ligne litt for mye på en ekte person, noe som utløser søksmål for tyveri av deres likhet.

Viktige juridiske utfordringer å forberede seg på

De juridiske utfordringene med AI-skuespillere er ikke lenger bare hypotetiske; de fører til reelle kampanjenedleggelser, massive bøter og alvorlig skade på merkevarens omdømme. Å vite nøyaktig hva du står overfor er det første steget mot å skape en annonsestrategi som er både innovativ og juridisk holdbar.

Her er en oversikt over hva du må passe på:

- Opphavsrettsbrudd: Ble AI trent på opphavsrettsbeskyttede bilder eller kunst? I så fall kan den ferdige annonsen din juridisk betraktes som et «derivatverk», noe som gjør deg ansvarlig for bruddet.

- Krenkelse av rett til fremtoning: Hvis AI-skuespiller din til og med vagelig ligner en ekte person – ansiktet, stemmen eller generell vibe – kan du møte søksmål for å ha brukt deres likhet til kommersiell gevinst uten tillatelse.

- Villedende reklamepraksis: Federal Trade Commission (FTC) er krystallklar: annonser må være sannferdige. Å bruke AI-skuespillere til falske videotestimonials eller å antyde en godkjennelse som aldri har skjedd, er en rask vei til trøbbel.

- Navigere deepfake-lover: Stadig flere stater vedtar lover for å stramme inn på syntetisk media. Dette skaper en rotete patchwork av reguleringer som endres avhengig av hvor publikum ditt er.

For å hjelpe deg med å få et klarere bilde, her er en rask oppsummering av de viktigste juridiske hindringene du vil møte.

Viktige juridiske risikoer med AI-skuespillere i et blikk

| Juridisk risikoområde | Hva det betyr for annonsene dine | Mulig konsekvens |

|---|---|---|

| Opphavsrettsbrudd | AI-modellen brukte opphavsrettsbeskyttede bilder til trening, noe som gjør annonsen din til et potensielt «derivatverk». | Søksmål, nedleggelsesvarsler og økonomiske erstatninger. |

| Rett til fremtoning | AI-skuespiller din ligner tilfeldigvis et ekte persons ansikt, stemme eller distinkte persona. | Juridisk tiltale fra personen for uautorisert kommersiell bruk av deres likhet. |

| FTC & villedende annonser | Bruk av AI til å skape falske testimonials, misledende produktdemos eller falske godkjennelser. | Tunge FTC-bøter, juridiske sanksjoner og alvorlig skade på merkevarens omdømme. |

| Deepfake & personvernslover | Krenkelse av nye statssspesifikke lover som regulerer skapelse og bruk av syntetisk media. | Sivile eller strafferettslige bøter, avhengig av staten og bruddets art. |

Å forstå og navigere disse risikoene handler ikke bare om å unngå bøter; det handler om å bygge tillit i en æra der forbrukere er stadig mer skeptiske til det de ser på nettet.

Ved å proaktivt adressere disse risikoene, forvandler du juridiske hindringer til en konkurransefordel. En compliant tilnærming beskytter ikke bare virksomheten din, men bygger også tillit hos et publikum som er stadig mer skeptisk til syntetisk innhold.

Til syvende og sist er målet å utnytte den utrolige kraften i AI uten å snuble i åpenbare juridiske feller. Det er et økosystem som også inkluderer selskapene som bygger disse kraftfulle verktøyene. Hvis du vil se et eksempel på hvem som er i dette miljøet, kan du sjekke copycat247 homepage. Ved å holde deg oppdatert og lage en klar compliance-plan, kan du innovere med selvtillit.

Opphavsrettsminfeltet gjemt i AI-treningsdata

Når det gjelder AI i reklame, er det største juridiske hodepinet opphavsrettsbrudd. Hele problemet starter med hvordan disse modellene faktisk lærer. Generativ AI finner ikke opp ting ut av det blå; den er trent på massive datasett, ofte med millioner av bilder, videoer og tekster skrapet rett fra internett. Det er der trøbbelen begynner.

Tenk på en AI-modell som en musiker som lytter til enhver sang noensinne laget for å finne ut hvordan man komponerer. Hvis musikeren deretter spytter ut en ny melodi som høres mistenkelig ut som en berømt, opphavsrettsbeskyttet melodi, har de krysset en grense. Det samme prinsippet gjelder her. Annonsen din kan være bygget på et fundament av ulisensiert materiale uten at du noen gang visste det.

Denne skjulte ansvarsbyrden betyr at selv om du har de beste intensjonene, kan merkevaren din holdes ansvarlig for opphavsrettsbrudd. Den AI-genererte skuespilleren eller scenen i annonsen din kan teknisk sett være et «derivatverk» – en ny skapelse som er litt for nærme et eksisterende opphavsrettsbeskyttet verk. Og du ville ikke hatt en anelse om hva den var trent på for å produsere det.

De mudrede vannene rundt «substantial similarity»

I retten koker testen for opphavsrettsbrudd ofte ned til et konsept kalt «substantial similarity». Dette handler ikke om å bevise at AI lagde en piksel-for-piksel-kopi. Det er mye mer uklart. Det reelle spørsmålet er om en vanlig person ville se på AI-ens output og erkennen at det var kopiert fra et beskyttet verk.

For en annonsør er denne tvetydigheten en enorm risiko. Hvis en AI genererer en karakter for kampanjen din som har den samme quirky, gjenkjennelige stilen som en berømt tegnefilmfigur, kan du vente et søksmål. Den opprinnelige kunstneren trenger ikke å bevise at AI replikerte arbeidet deres nøyaktig, bare at det «totale konseptet og følelsen» er det samme.

Og de juridiske kampene eskalerer allerede. Mot slutten av 2025 hadde en bølge av søksmål ført til 47 opphavsrettssøksmål mot AI-selskaper i USA alene, mange som gruppesøksmål. I høyt profilerte eksempler har selskaper som Disney og Universal Studios hevdet at AI-verktøy ble trent på deres blockbuster-filmer uten tillatelse, noe som skaper en alvorlig kjedereaksjon av risiko for alle som bruker visualene disse verktøyene genererer.

Hvorfor du ikke kan stole på «fair use»-forsvaret

AI-selskaper prøver ofte å forsvare seg ved å hevde at treningsprosessen deres er «fair use», en juridisk doktrine som tillater begrenset bruk av opphavsrettsbeskyttet materiale til ting som forskning eller kommentar. Men det argumentet blir utrolig svakt i det øyeblikket AI-ens output brukes til kommersielle formål – som en annonse.

Retten ser på fire nøkkelfaktorer for å avgjøre om noe er fair use:

- Formålet med bruken: Er det for profitt eller utdanning? Reklame er rent kommersiell, noe som er et stort minus for et fair use-krav.

- Artens natur i det opprinnelige verket: Å bruke kreative verk som bilder og illustrasjoner er mye vanskeligere å forsvare enn å bruke faktiske data.

- Mengden av verket brukt: Kopierte AI-modellen «hjertet» i det opprinnelige verket, selv om den ikke brukte hele?

- Effekt på markedet: Skader det AI-genererte bildet den opprinnelige skaperens evne til å selge eller lisensiere sitt eget verk? Hvis AI-bildet ditt erstatter behovet for å kjøpe et stockfoto, er det klar markeds-skade.

For markedsførere er det å lene seg på et fair use-forsvar et spill du nesten garantert taper. Den kommersielle naturen til en annonskampanje synker argumentet fra starten av. For å få bedre grep om å beskytte dine egne kreative eiendeler, er det lurt å se på bredere hensyn til immaterialrett.

Kjernespørsmålet er ikke bare hva AI skaper, men hva den lærte fra. Hvis treningsdataene er juridisk tvilsomme, bærer hvert stykke innhold den genererer den arvede risikoen direkte inn i reklamekampanjene dine.

Til syvende og sist faller byrden på deg – annonsøren – å stille tøffe spørsmål om hvor AI-eiendelene dine kommer fra. Å velge AI-plattformer som bruker lisensierte eller etisk kildebaserte treningsdata handler ikke bare om å gjøre det rette; det er en kritisk juridisk skjold for merkevaren din.

Beskytte menneskelig identitet i AI-æraen

Utover opphavsrett blir de juridiske utfordringene med AI-skuespillere i reklame personlige. Raskt. Her støter vi på retten til fremtoning – den grunnleggende retten enhver person har til å kontrollere hvordan navn, bilde og likhet brukes til kommersiell gevinst.

Tenk på det som et personlig varemerke på identiteten din. Hvis du bruker AI til å lage en «digital tvilling» av en kjendis – eller til og med en hverdagsmenneske – til en annonse uten å få deres eksplisitte tillatelse, krysser du en alvorlig juridisk grense. Det er i hovedsak identitetstyveri for profitt, og rettene tar det ikke lett på.

Dette handler ikke bare om å lage en perfekt, fotorealistisk kopi heller. Loven beskytter ofte enhver karakteristikk som peker direkte på en spesifikk person. Det kan være stemmen deres, en berømt positur eller til og med en slagord de er kjent for. Å lage en virtuell influencer som føles litt for kjent for en ekte kjendis, er et søksmål som venter på å skje.

Den voksende trusselen fra uautoriserte digitale replikaer

Eksplosjonen av deepfake-teknologi har tvunget dette spørsmålet i søkelyset, og lovgivere kjemper for å henge med. Stater vedtar nå lover spesifikt designet for å bekjempe uautorisert skapelse og bruk av digitale replikaer. For markedsførere og skapere betyr dette at de gamle måtene å få samtykke på er offisielt døde.

Du kan ikke lenger stole på et standard modellslipp-skjema og anta at det dekker skapelsen av en AI-versjon av den personen. Det juridiske grunnlaget har skiftet, og den nye standarden er eksplisitt, informert samtykke som spesifikt nevner AI-generering. Alt mindre etterlater merkevaren din vid åpen for risiko.

Et nøkkelrettslig avgjørelse understreket virkelig dette poenget. Det viste at selv når føderale opphavsretts- eller varemerkelovgivninger ikke passer helt til en sak om stemmekloning, kan statsnivåets borgerrettigheter og fremtoningslover fortsatt gi kraftig beskyttelse for individer hvis identiteter kapres av AI. Det plasserer byrden firkantet på annonsører å kjenne og respektere disse statslovene.

Lage et AI-sikkert samtykkeskjema

Når du får tillatelse til å bygge en AI-skuespiller basert på en ekte person, må tilnærmingen din være helt annerledes. Samtykke- og slipp-skjemaene må være vanntette og etterlate absolutt ingen rom for tolkning. Et virkelig solid AI-slipp bør gi deg spesifikke, entydige rettigheter.

For å holde deg på rett side av loven, må samtykkesprosessen din dekke disse nøkkelpunkter:

- Eksplisitt rett til å skape en digital replika: Skjemaet må si det i klare ord: at du har til hensikt å skape en digital versjon av personen ved hjelp av AI.

- Avgrenset bruksomfang: Vær presis. Spesifiser nøyaktig hvordan og hvor AI-replikaen vil brukes – hvilke kampanjer, på hvilke plattformer og i hvor lang tid.

- Godkjenningsrettigheter på AI-output: Dette er et stort forhandlings punkt. Får personen se og godkjenne de endelige AI-genererte scenene før de publiseres?

- Fremtidig bruk og endringer: Kontrakten må klargjøre om du har rett til å endre AI-replikaen eller bruke den i fremtidige kampanjer som ikke er planlagt ennå. Uklart språk her er en massiv risiko.

For å se hvordan kravene har endret seg, se bare på hvordan tradisjonelt samtykke sammenlignes med det som kreves for AI.

Ekte person vs AI-skuespiller samtykkesjekkliste

Denne tabellen fremhever de kritiske forskjellene mellom et standard slipp-skjema og et designet for å skape en AI-replika.

| Samtykdefaktor | Kreves for ekte person | Kritisk for AI-replika |

|---|---|---|

| Bruk av likhet | Standard modellslipp for bilder/videoer. | Eksplisitt tillatelse til å generere en digital klone. |

| Brukstid | Klart definert tid (f.eks. ett år). | Må spesifisere om rettighetene er evige eller tidsbegrenset. |

| Retter til endring | Begrenset til standard redigering (fargekorreksjon osv.). | Må gi rettigheter til å endre AI-ens opptreden/dialog. |

| Medieomfang | Spesifiserer plattformer (f.eks. sosiale medier, TV). | Dekker bredt alle nåværende og fremtidige digitale medier. |

Til syvende og sist handler navigering av retten til fremtoning i AI-alderen om transparens og respekt. Å få krystallklart samtykke handler ikke bare om å krysse av en juridisk boks – det handler om å beskytte merkevaren din og ære rettighetene til menneskene hvis identiteter driver det kreative arbeidet ditt.

Holde deg på rett side av FTC

Utover labyrinten av opphavsrett og fremtoningsrettigheter, entrer en annen stor aktør ringen når du bruker AI-skuespillere: Federal Trade Commission (FTC). FTCs jobb er enkel: beskytte forbrukere mot annonser som lyver eller villeder. De bryr seg ikke om annonsen din ble laget av et team av kunstnere eller en sofistikert algoritme – hvis den er villedende, er det et problem.

I kjernen er FTCs regel enkel. En annonse kan ikke være villedende. Denne standarden gjelder alt annonsen sier og antyder, inkludert påstander om AI-teknologien brukt til å lage den. Hvis AI-skuespiller din hevder at et nytt proteinpulver bygger muskler 2x raskere, bedre du ha solid vitenskapelig bevis å støtte det opp med, akkurat som hvis en menneskelig kjendis sa det.

Byrået kommer også hardt ned på det de kaller «AI-washing». Dette er når et selskap blåser opp AI-kapasitetene sine langt ut over proporsjoner. Å omtale kampanjen din som et banebrytende AI-prestasjon når den bare utfører noen grunnleggende automatiske oppgaver, er en sikker måte å havne på FTCs radar.

De to sannhetene du må opprettholde

Når AI-skuespillere er involvert, jonglerer du plutselig to sett med ansvar. Du må være ærlig om hva du selger og ærlig om teknologien du bruker til å selge det.

Tenk på det som en to-delt integritetskontroll:

- Sannhet i annonsens budskap: Er påstandene, demonstrasjonene eller testimonials presentert av AI-skuespiller din faktisk sanne? En AI-generert video av en fornøyd «kunde» som hyller produktet ditt er direkte villedende hvis kunden ikke eksisterer.

- Sannhet i teknologipåstander: Overdriver du hva AI-en din kan gjøre? Hvis du hevder at AI-en din leverer perfekt personaliserte annonser, men den bare endrer bakgrunnsfarge basert på plassering, villeder du publikum ditt.

FTC er ikke interessert i den tekniske prosessen bak annonsen. De fokuserer på budskapet en gjennomsnittlig person går bort med.

Regulatorer tuller ikke

Dette er ikke bare en klaps på håndleddet. FTC forfølger aktivt selskaper for villedende AI-markedsføring, og sender et klart budskap om at å bruke «AI» som et buzzword ikke er en frikort til å komme med grunnløse påstander.

FTC har gjort det klart: hvis du kommer med en påstand om AI-en din, må du kunne bevise det. Annonsører må ha robust bevis for enhver ytelsespåstand, akkurat som for enhver annen produktfunksjon.

Og dette er ikke noe fjernt fremtidsscenario – det skjer nå. Mot midten av 2025 hadde FTC allerede startet minst et dusin håndhevelsesaksjoner mot 'AI-washing.' Et fremtredende eksempel var søksmålet i august 2025 mot Air AI for å ha hevdet falskt at AI-en deres kunne erstatte menneskelige selgere fullstendig. Denne saken understreker de alvorlige juridiske og økonomiske risikoene for markedsførere som overdrev AI-verktøyene sine uten bevis. Du kan lære mer om FTCs evolusjonære holdning til AI-lov.

Når må du opplyse om det?

Dette bringer oss til et kritisk spørsmål: når må du fortelle folk at de ser på en AI-generert skuespiller? Det finnes ikke én føderal lov med en hard og rask regel ennå, men FTCs generelle prinsipper om villedelse gir oss en ganske klar veiledning.

Litmustesten er denne: «Ville kunnskap om at dette er AI endre hvordan en forbruker forstår annonsen?»

Hvis du bruker en AI-skuespiller til å pose som en ekte lege som anbefaler et tilskudd eller en faktisk kunde som deler en personlig historie, er det å unnlate å opplyse om at det er AI nesten helt sikkert villedende. Utelatelsen er misledende fordi den gir godkjennelsen en troverdighet den egentlig ikke har.

For å holde deg trygg og bygge tillit, blir klare og fremtredende opplysninger den nye standarden. Et enkelt, synlig merke som #AIGenerated kan gå langt i å holde deg foran reguleringene og på rett side av kundene dine.

Din praktiske compliance-sjekkliste for AI-annonser

Greit, la oss gå forbi teorien og ned til hva du faktisk må gjøre. Å takle det juridiske minfeltet med AI i reklame handler om å ha en solid, gjentakbar prosess. Dette handler ikke om å kvele kreativitet med rød tape; det handler om å bygge rekkverk slik at teamet ditt kan innovere med selvtillit.

Tenk på denne sjekklisten som din før-fly-rutine før du lanserer enhver AI-drevet kampanje. Ved å bygge disse trinnene rett inn i arbeidsflyten din, skaper du et fundament av compliance som beskytter merkevaren din, respekterer individuelle rettigheter og holder deg på rett side av regulatorer. La oss gå gjennom den.

Trinn 1: Gransk AI-verktøyet ditt og treningsdataene

Før du i det hele tatt tenker på å generere et bilde, må du løfte på panseret på AI-plattformen din. Den juridiske statusen til den ferdige annonsen din er direkte knyttet til dataene AI-modellen ble trent på. Å bare anta at et betalt verktøy er «trygt» er en massiv, og potensielt svært kostbar, gambling.

Du må stille AI-leverandøren din noen direkte spørsmål og grave deg inn i deres vilkår for tjeneste. Enhver seriøs leverandør bør være åpen om hvor dataene deres kommer fra.

- Krev datatransparens: Spør dem rett ut: Ble modellen din trent på lisensierte, public domain- eller etisk kildebaserte data? Hvis du får et vagt, avvisende svar, er det et stort rødt flagg.

- Sjekk for en erstatningsklausul: Vil leverandøren dekke juridiske regninger hvis verktøyet deres spytter ut noe som får deg saksøkt? Dette kalles erstatning. Du vil oppdage at mange plattformer legger 100 % av den juridiske risikoen på deg, brukeren.

- Se etter «kommersiell sikre» verktøy: Noen plattformer markedsfører spesifikt modellene sine som trygge for kommersiell bruk. Dette er ofte et godt tegn, da det vanligvis betyr at de har gjort leksene sine på datarettigheter.

Trinn 2: Sikre vanntette rettigheter og samtykke

Dette er uforhandlelig. Hvis annonsen din involverer en digital dobbeltgjenganger av en ekte person – eller til og med en avatar som ser mye ut som noen – trenger du eksplisitt samtykke. Ditt gamle modellslipp-skjema holder ikke her. Avtalene dine må nå være spesifikke og tenke på fremtiden.

Navnet på spillet er informert samtykke. Du må være krystallklar om at du har til hensikt å skape og bruke en AI-generert versjon av en person, og stave ut nøyaktig hvordan, hvor og i hvor lang tid. Enhver tvetydighet i den kontrakten er i bunn og grunn en åpen invitasjon til et søksmål nedover veien.

Dette er mer enn bare å få en signatur; det handler om klar kommunikasjon. Et steinsikkert AI-slipp bør dekke alle baser for å forhindre fremtidige hodepiner.

- Spesifiser AI-generering: Kontrakten må eksplisitt si at du har rett til å skape en «digital replika» eller «AI-generert likhet».

- Definer bruksomfanget: Vær detaljert. Skisser hvilke plattformer AI-skuespilleren vil vises på, typene kampanjer og den eksakte brukstiden.

- Adresse rettigheter til endring: Lar kontrakten deg justere AI-ens opptreden? Kan du endre dialogen eller plassere den i helt nye scener? Spesifiser det.

Trinn 3: Gransk hver AI-genererte output

Når AI skaper noe for deg, begynner det virkelige arbeidet. Hvert eneste bilde, video og voiceover trenger en menneskelig gjennomgang. Dette er din siste forsvarslinje mot brudd, og du kan ikke hoppe over det.

Aldri anta at bare fordi et bilde er «nytt», er det juridisk rent. Disse modellene kan – og gjør – tilfeldig etterligne beskyttede stiler, karakterer eller til og med merkelogoer.

- Sjekk for «substantial similarity»: Ser eller føles outputen litt for nærme en berømt filmkarakter, et kunstverk eller en bestemt kunstners signaturstil? Hvis instinktet ditt sier det er for nærme, er det sannsynligvis det. Kast det og generer et nytt.

- Skann for varemerker: Se nøye på bakgrunnene. Har AI smuglet inn et logo, et merkenavn eller en distinkt produktform?

- Lytta etter stemmelikhet: Hvis du genererer lyd, høres stemmen mistenkelig lik ut som en berømt skuespiller eller offentlig figur? Det er en potensiell krenkelse av retten til fremtoning som venter på å skje.

Trinn 4: Implementer klare opplysninger og underbygg påstander

Til slutt må du være ærlig med publikum ditt og følge FTC-regler. Dette betyr å være transparent om bruk av AI når det teller og, viktigst av alt, å støtte opp hver påstand annonsen din gjør med harde, konkrete bevis.

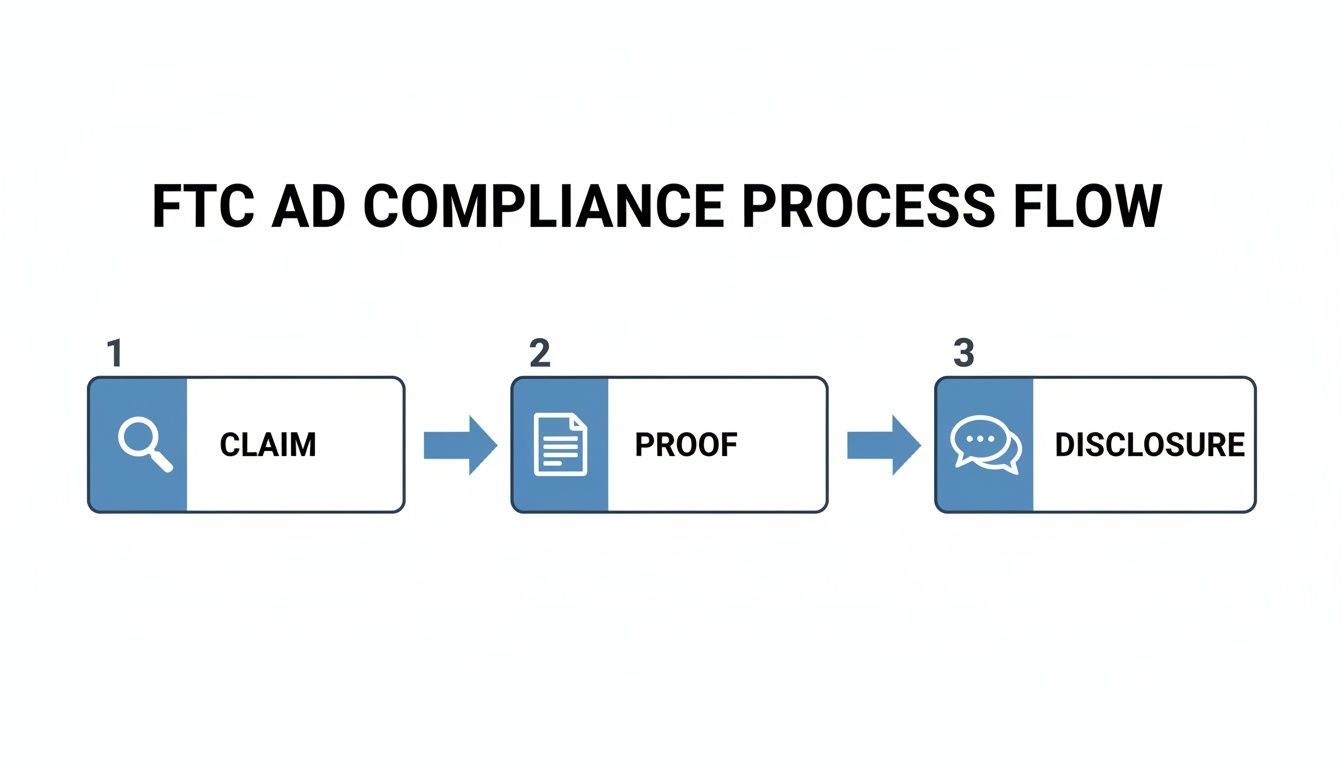

Denne enkle flytskjemaet bryter ned FTCs kjerneforventning for enhver annonse, AI-drevet eller ei.

Det er en enkel syklus: for enhver påstand du kommer med, må du ha bevis å støtte det opp med og gi en klar opplysning. Denne løkken sikrer at reklame din er sannferdig og forsvarlig.

- Opplys når det teller: Hvis en typisk person kan bli lurt til å tro at AI-skuespiller din er en ekte person – som en lege som gir medisinske råd eller en kunde som hyller et produkt – må du opplyse om det. Et enkelt #AIGenerated eller #AIAd kan gjøre susen.

- Underbygg alle påstander: Hver eneste faktiske uttalelse AI-skuespiller din kommer med trenger bevis. Hvis AI-talsmannen din sier at et produkt er «50 % mer effektivt», bedre du ha den kliniske studien klar før annonsen ser dagens lys.

- Bygg en «underbyggelsesmappe»: For enhver kampanje, vær i vanen med å lage en mappe som inneholder alle data, studier og bevis som støtter annonsens påstander. Hvis FTC banker på døren, vil den mappen være din beste venn.

Vanlige spørsmål om AI-skuespillere i reklame

Å hoppe inn i AI-drevet reklame reiser ofte flere spørsmål enn svar. Den juridiske siden er fortsatt litt som Ville vesten, noe som kan gjøre det tøft å føle seg trygg på beslutningene dine. La oss ta tak i noen av de mest vanlige spørsmålene markedsførere stiller om de juridiske utfordringene med AI-skuespillere i annonser. Målet mitt her er å gi deg rett frem svar slik at du kan bygge smartere, tryggere kampanjer.

Må jeg opplyse om at annonsen min bruker en AI-skuespiller?

Stadig oftere er svaret ja. Selv om det ikke finnes én stor føderal lov som pålegger dette for hver annonse, skifter grunnen definitivt. Den beste måten å tenke på det er gjennom linsen til FTCs regler mot villedende praksis. Hvis det å ikke fortelle noen at en skuespiller er AI ville villeder dem, må du absolutt opplyse om det. Tenk på å bruke en AI-generert «lege» til å promotere et helseprodukt – det faktum at legen ikke er ekte er ganske viktig.

I tillegg tar plattformene allerede valget for deg. Store aktører som Meta og YouTube krever nå merkelapper for realistisk AI-generert innhold, så opplysning blir en grunnleggende kostnad ved å drive virksomhet.

Her er den enkle regelen jeg følger: Hvis det er noen sjanse for at en vanlig person kan bli lurt, legg til en klar og enkel opplysning som #AIGenerated. Dette handler ikke bare om å følge regler som kanskje kommer; det handler om å bygge tillit hos publikum ditt, som er uvurderlig.

Å være åpen håndterer forventninger og beskytter merkevaren din, spesielt etter hvert som folk blir smartere (og mer skeptiske) til syntetisk media.

Kan jeg bli saksøkt hvis AI-verktøyet mitt lager et bruddende bilde?

Absolutt. Et stort misforståelse er at hvis AI-verktøyet lager sølet, er det verktøyets leverandør som må rydde opp. Sånn fungerer ikke opphavsrettsloven. Selskapet som publiserer den bruddende annonsen – altså ditt selskap – kan holdes direkte ansvarlig. Dette kalles ofte sekundæransvar, og det betyr at du deler den juridiske risikoen.

Selv om AI-plattformen også får trøbbel, slipper ikke du unna. Derfor må du lese vilkårene for tjeneste for ethvert AI-verktøy du bruker. Noen plattformer kan tilby erstatning (betyr at de dekker juridiske regninger), men mange er skrevet for å legge alt juridisk ansvar på deg som bruker.

Ditt beste forsvar er å være proaktiv. Gransk hvert eneste AI-genererte bilde for uncannye likheter med eksisterende opphavsrettsbeskyttede verk. Og prøv å holde deg til AI-plattformer som er transparente om hvor treningsdataene deres kommer fra – de som bruker juridisk lisensierte eller public domain-data er alltid et tryggere valg.

Hva er forskjellen mellom et stockfoto og en AI-person?

Den nøkkelforskjellen koker ned til hvor de juridiske rettighetene kommer fra. Når du lisensierer et stockfoto av en person, kommer det med en modellslipp. Dette er et juridisk dokument der den ekte mennesket på bildet har gitt samtykke til kommersiell bruk av deres likhet. Det er ditt juridiske sikkerhetsnett.

En AI-generert person har ikke modellslipp fordi, vel, de ikke eksisterer. Men dette åpner en hel boks med ormer du ikke trenger å bekymre deg for med stockfotos.

- Tilfeldig dobbeltgjenganger: AI-bildet kan tilfeldig se akkurat ut som en ekte person, og skape et overraskende krav om retten til fremtoning du aldri så komme.

- Opphavsrettsmineland: Bildet selv kan utfordres basert på hva AI ble trent på. Hvis modellen lærte fra en database med beskyttede bilder, kan din «opprinnelige» AI-person juridisk betraktes som en bruddende kopi.

I bunn og grunn bytter du med en AI-person ut en kjent, klar juridisk prosess (modellslipp) med et nytt, mudret sett med risikoer knyttet til opphavsrett og identitet.

Hvordan kan jeg trygt lage en AI-merkeavatar?

Hvis du vil lage en AI-merkeavatar eller influencer uten å få et skummelt brev fra en advokat nedover veien, trenger du en plan. Du kan ikke bare improvisere.

Start med å sikre at avatar er virkelig en av en kind. Vær kreativ med detaljerte prompts og juster manuelt resultatene for å styre det endelige utseendet langt unna ekte mennesker eller eksisterende karakterer. Hold en logg over denne kreative prosessen – det kan være avgjørende bevis for å bevise at du hadde til hensikt å skape noe helt originalt.

Neste, gi avataren et unikt navn og bakhistorie som har ingen kobling til en ekte person. Gjør et varemerk søk for avatarens navn og til og med det visuelle designet for å sikre at du ikke tråkker på en annen merkevares tær.

Til slutt, gå gjennom AI-verktøyets vilkår for tjeneste. Du må være sikker på at de gir deg full kommersiell eierskap eller, i det minste, en bred kommersiell lisens for alt du skaper. Å være transparent med publikum om at avatar er AI vil også gå langt i å avverge både juridiske og PR-problemer.

Klar til å lage høytytende annonser uten juridisk gjetting og høye produksjonskostnader? ShortGenius er en AI-annonseplattform designet for skapere og markedsførere som trenger å produsere fantastiske kortform-video- og bildeannonser for alle store sosiale plattformer. Generer konsepter, manus og visuals på sekunder, tilpass dem med merkevarekitet ditt og rull ut kampanjer som gir resultater. Prøv ShortGenius i dag og begynn å bygge bedre annonser, raskere.