Juridische problemen met AI-acteurs in advertenties voor moderne merken

Ontdek de belangrijkste juridische problemen met AI-acteurs in advertenties. Leer hoe je omgaat met publiciteitsrechten, auteursrecht en FTC-naleving voor je merk.

Welkom in het nieuwe tijdperk van reclame, waar AI-gegenereerde acteurs de aandacht trekken en scrolls stoppen op sociale media. Hoewel deze technologie een wereld van creatieve mogelijkheden opent, legt het ook een juridisch mijnenveld bloot voor merken en makers. Het navigeren door deze juridische kwesties met AI-acteurs in reclame is nu een cruciale vaardigheid.

De Nieuwe Frontier van AI-Acteurs en Juridische Risico's

De wet speelt een koortsachtig spel van inhaalslag met technologie. Merken kunnen nu hele videocampagnes bedenken en genereren met synthetische mensen, maar deze macht brengt een zware reeks verantwoordelijkheden met zich mee. Elk element – van een stem die net iets te vertrouwd klinkt tot een productclaim die een AI schrijft – draagt juridisch gewicht.

Denk eraan als bij muzieksampling. Voordat je een nieuwe track kunt droppen, moet je elke geleende beat, melodie en vocale hook vrijgeven. Het is hetzelfde in AI-reclame. Je moet de rechten hebben op elk stukje van je synthetische creatie, anders kun je jezelf in serieuze financiële en merkbeschadigende problemen storten.

Waarom Traditionele Reclamewetten Tekortschieten

Laten we duidelijk zijn: de juridische kaders waarop we decennia lang hebben vertrouwd, waren niet gebouwd voor een wereld met AI-gegenereerde persoonlijkheden. Dit creëert een enorme kloof en enkele lastige nieuwe uitdagingen voor marketeers die gewend zijn aan standaardcontracten en vrijwaringsverklaringen voor menselijk talent. De oude regels gelden nog steeds, maar ze worden op manieren uitgerekt die we nog niet eerder hebben gezien.

De zaak omvat een aantal moeilijke vragen, waarvan sommige van primeur zijn. Het draagt ook potentieel zware gevolgen niet alleen voor stemacteurs, maar ook voor de opkomende AI-industrie, andere houders en gebruikers van intellectueel eigendom, en gewone burgers die vrezen voor het verlies van controle over hun eigen identiteit.

In deze nieuwe omgeving is proactief juridisch bewustzijn niet zomaar een 'leuk om te hebben' – het is een essentieel onderdeel van elke moderne marketingstrategie. Het begrijpen van de risico's is de eerste stap naar verantwoord innoveren en je merk beschermen tegen een kostbare blinde vlek. Voor een breder overzicht is het de moeite waard om het algemene juridische landschap rond AI te verkennen.

Een Snelle Blik op de Belangrijkste Juridische Risicogebieden

Om hier grip op te krijgen, helpt het om de belangrijkste juridische uitdagingen uit te splitsen. Elke vertegenwoordigt een mogelijke valkuil die een anders briljante campagne volledig kan ontsporen. Deze tabel geeft een snelle samenvatting van de primaire juridische kopzorgen waar je rekening mee moet houden bij het gebruik van AI-gegenereerde acteurs.

| Belangrijkste Juridische Risicogebieden voor AI in Reclame | ||

|---|---|---|

| Juridisch Gebied | Kernprobleem | Mogelijk Gevolg |

| Likeness & Publicity Rights | Gebruik van een AI-gegenereerde persoon die lijkt of klinkt als een echt individu zonder toestemming. | Rechtszaken van beroemdheden of particulieren wegens misbruik van hun identiteit. |

| IP & Copyright | AI-model is getraind op auteursrechtelijk beschermde foto's, video's of scripts zonder licentie. | Auteursrechtschendingclaims, hoge boetes en bevelen om de campagne offline te halen. |

| FTC & Ad Disclosures | Nalaten te onthullen dat een aanbeveling van een AI-acteur komt, misleidt consumenten. | FTC-handhaving, boetes voor misleidende reclame, verlies van consumentenvertrouwen. |

| Defamation & Privacy | AI creëert inhoud die vals de reputatie van een persoon of merk schaadt. | Lasterschadezaken (schriftelijke/lasterlijke laster) en claims van privacyschending. |

Essentieel is dat je moet nadenken over waar je AI-gegenereerde inhoud vandaan komt en wat het communiceert. Als je een van beide verkeerd doet, kan dat leiden tot serieuze problemen.

Hier zijn de belangrijkste categorieën van zorg die elk merk en elke maker op de radar moet hebben:

- Likeness en Publicity Rights: Dit is een grote. Het omvat het ongeautoriseerde gebruik van iemands beeld, stem of andere identificerende kenmerken. Het maakt niet uit of de AI alleen lijkt op iemand – dat kan genoeg zijn om een rechtszaak te triggeren.

- Intellectueel Eigendom en Copyright: Dit wordt snel ingewikkeld. Wie bezit eigenlijk de inhoud die een AI creëert? En belangrijker nog, is het AI-model getraind op een berg auteursrechtelijk beschermd materiaal dat zonder toestemming van internet is gehaald?

- FTC en Disclosure-regels: De regels van de Federal Trade Commission over waarheid in reclame verdwijnen niet. Reclames moeten waarheidsgetrouw en niet misleidend zijn, en dat omvat transparantie wanneer een AI-acteur een getuigenis of aanbeveling geeft.

- Laster en Privacy: AI kan ontsporen en valse of schadelijke informatie genereren over echte mensen of zelfs concurrerende merken. Dit kan snel leiden tot claims van laster of privacyschending.

Navigeren door het Right of Publicity in het AI-tijdperk

Van alle juridische valkuilen die verband houden met AI-acteurs is het recht op publiciteit waarschijnlijk de grootste. Denk er zo aan: iedereen heeft een persoonlijk merk, en ze bezitten het recht om te controleren hoe hun naam, gezicht, stem of ander uniek kenmerk – hun 'likeness' – wordt gebruikt om geld te verdienen. Zodra je AI-gegenereerde acteur ook maar vaag lijkt op een echt persoon, dwaal je een juridisch mijnenveld in.

En dit gaat niet alleen over het creëren van een perfecte deepfake van een beroemdheid. De wet is vaak breed genoeg om 'sound-alikes' en 'look-alikes' te dekken die net vergelijkbaar genoeg zijn om iemand aan de echte persoon te laten denken. Als je publiek je AI-acteur verbindt met een specifiek individu, kun je aansprakelijk zijn voor misbruik van hun likeness.

De echte kopzorge voor makers is hoe deze AI-modellen zijn gebouwd. Ze zijn getraind op verbluffende hoeveelheden data, vaak direct van internet gehaald. Dat betekent dat de AI heeft geleerd van talloze echte gezichten en stemmen, wat een accidentele, griezelige gelijkenis een zeer reëel risico maakt.

Wat Telt als Commercieel Gebruik

Begrijpen wat 'commercieel gebruik' betekent is hier cruciaal. Het gaat niet alleen om het plakken van een AI-gegenereerd gezicht op een productverpakking. Elke keer dat je een AI-persoon gebruikt in een reclame om aandacht te trekken en verkopen te stimuleren, is dat een commercieel doel. Dit geldt vooral voor de user-generated content (UGC)-stijl reclames die je overal op Instagram en YouTube ziet.

Bijvoorbeeld, als je een synthetische influencer genereert om enthousiast te doen over je nieuwe huidverzorgingslijn, is dat direct commercieel gebruik. Als die digitale influencer toevallig opvallend lijkt op een echte maker, heeft die maker een sterk geval dat je profiteert van hun likeness zonder toestemming of betaling.

Rechtbanken pakken deze rommelige scenario's al aan. De baanbrekende In re Clearview AI Consumer Privacy Litigation-zaak is een perfect voorbeeld. Eisers stelden succesvol dat het trainen van een gezichtsherkennings-AI op meer dan 3 miljard internetfoto's publicity rights schond in verschillende staten.

De beslissing van de rechtbank stuurde een duidelijk signaal: 'commercieel gebruik' vindt plaats wanneer identiteiten worden gebruikt om een product te promoten, niet alleen wanneer ze worden verkocht als het product. Zoals gedetailleerd in deze analyse van publicity rights van Quinn Emanuel, heeft deze uitspraak de deur wijd opengezet voor class-action rechtszaken met potentieel oogstrelende uitkeringen.

Belangrijke Overwegingen voor AI-Likeness

Om verstrikt te raken in een publicity rights-rechtszaak te vermijden, moet je waakzaam zijn. Dit is geen abstracte juridische theorie; het kan leiden tot verlammende juridische kosten, gedwongen campagne-offlines en een grote klap voor de reputatie van je merk.

Hier zijn de grote dingen om op te letten:

- Celebrity Likeness: Dit is het meest voor de hand liggende. Een AI-acteur genereren die eruitziet of klinkt als een beroemd persoon is vragen om problemen. Vermijd prompts zoals 'creëer een acteur die lijkt op [Celebrity Name].'

- Influencer en Micro-Influencer Gelijkenis: Het gevaargebied strekt zich ver uit voorbij A-lijst filmsterren. Sociale media-influencers hebben hun eigen waardevolle persoonlijke merken opgebouwd, en hun publicity rights zijn net zo juridisch beschermd.

- Gewone Individuen: Zelfs als je AI-personage lijkt op een particuliere burger, heeft die persoon rechten. Als hun vakantiefoto's onknowingly in de trainingsdata van de AI zijn gezogen, kan een claim nog steeds opduiken.

Het juridische gevaar ligt niet in de intentie van de AI, maar in de perceptie van het publiek. Als een redelijk persoon je AI-acteur associeert met een echt individu, heb je een potentieel juridisch probleem.

Praktische Stappen om Je Campagnes te Beschermen

Je moet proactief zijn om je merk te beschermen. Je kunt niet zomaar aannemen dat een AI-tool een 'veilig' of juridisch vrijgegeven gezicht of stem uitspuwt. Er is geen substituut voor menselijk toezicht en een goed gedefinieerd beoordelingsproces.

Voordat een reclame met een AI-acteur live gaat, moet je team een grondige likeness-check doen. Dit betekent meerdere paren ogen op de finale creatie, met het specifieke doel om mogelijke gelijkenissen met publieke figuren te spotten. Het documenteren van dit beoordelingsproces kan je ook een laag juridische bescherming geven door te tonen dat je je huiswerk hebt gedaan.

Aan het eind van de dag is de enige waterdichte verdediging tegen een right of publicity-claim ervoor zorgen dat je AI-gegenereerde acteurs werkelijk origineel zijn. Het is een extra stap, maar essentieel om je campagnes veilig te houden voor kostbare juridische gevechten verderop.

Wie Bezit een AI-GeGenereerde Optreden?

Dus, je hebt een AI gebruikt om een script, voiceover of misschien zelfs een hele video te genereren. Het is briljant. Maar een enorme vraag hangt in de lucht: wie bezit dit ding eigenlijk? Het antwoord is niet eenvoudig en prikt eerlijk gezegd aan de fundamenten van het auteursrecht. Dit goed krijgen is cruciaal om een van de grootste juridische kwesties met AI-acteurs in reclame te navigeren.

Momenteel heeft het U.S. Copyright Office een vrij stevige houding: een werk heeft menselijke auteurschap nodig om auteursrechtbescherming te krijgen. Als een AI iets helemaal zelf creëert, zonder dat een mens het creatieve proces op een betekenisvolle manier stuurt, krijgt het over het algemeen geen auteursrecht. Dat betekent dat het geweldige reclameconcept dat je AI net heeft uitgespuugd mogelijk niet juridisch van jou is.

Dit creëert een serieuze kopzorge voor marketeers. Als je het auteursrecht niet bezit, wat houdt een concurrent dan tegen om een bijna identieke AI-gegenereerde reclame te draaien? Je unieke campagne, en al het geld dat je erin hebt geïnvesteerd, kan voor het oprapen liggen.

De Ghostwriter en Het Hulpmiddel

Een goede manier om hierover na te denken is de AI te zien als een supergeavanceerde ghostwriter of een zeer geavanceerde kwast. Het hulpmiddel zelf bezit niet het afgewerkte boek of de schilderij. Eigendom hangt af van hoeveel creatieve sturing en originele input van de persoon komt die het hulpmiddel gebruikt.

Als je een vage prompt geeft zoals 'creëer een video-reclame voor een nieuwe sneaker', doet de AI het meeste zware werk. De output is grotendeels machinegemaakt. Maar als jij degene bent die moeizaam gedetailleerde prompts creëert, de outputs cureert en significante bewerkingen doet om het allemaal samen te voegen, wordt je geval voor auteurschap veel sterker. Hoe meer menselijke creativiteit je injecteert, hoe beter je kans op het verkrijgen van een auteursrecht.

Een cruciaal takeaway voor makers is dat je niveau van directe, creatieve betrokkenheid bij het AI-generatieproces de basis legt voor eigendom. Gewoon op een 'generate'-knop drukken is niet genoeg om als auteur te worden beschouwd.

Dit hele debat over wie de output van een AI bezit maakt deel uit van een veel groter gesprek over het beschermen van intellectuele eigendomsrechten in onze steeds digitalere wereld. Naarmate deze hulpmiddelen een normaal onderdeel worden van creatief werk, zal uitvissen waar menselijk auteurschap eindigt en machinecreatie begint een centraal juridisch slagveld worden.

De Rommelige Realiteit van Trainingsdata

Het eigendomspuzzel wordt nog ingewikkelder als je onder de motorkap kijkt naar de trainingsdata van het AI-model. Veel generatieve AI-hulpmiddelen leren door kolossale hoeveelheden data van internet te scrapen – wat natuurlijk auteursrechtelijk beschermde afbeeldingen, artikelen, muziek en video's omvat. Dit opent het zeer reële risico dat de output van de AI als een 'afgeleid werk' kan worden beschouwd van iemands anders beschermde materiaal.

En dit is geen theoretisch probleem. Bijvoorbeeld, stemacteurs Paul Lehrman en Linnea Sage sleepten Lovo Inc. voor de rechter, met de claim dat het bedrijf hun stemopnames zonder toestemming gebruikte om AI-stemklonen te trainen en te verkopen. De rechtbank liet de meeste van hun claims doorgaan, wat echt de serieuze juridische blootstelling benadrukt wanneer AI-trainingsdata bestaande rechten schendt.

Wat betekent dit voor jou? Het betekent dat je glanzende nieuwe AI-gegenereerde reclame per ongeluk elementen kan bevatten die inbreuk maken op het auteursrecht van een andere maker, waardoor je merk aansprakelijk wordt voor een rechtszaak.

Kunnen We Het Gewoon 'Fair Use' Noemen?

Sommige ontwikkelaars en gebruikers beweren dat het gebruik van auteursrechtelijk beschermd materiaal om een AI te trainen valt onder de juridische doctrine van 'fair use'. Fair use staat beperkte gebruik van auteursrechtelijk beschermde werken toe zonder toestemming voor dingen zoals kritiek, commentaar of onderzoek.

Het hele debat in de AI-wereld draait om een paar kernvragen:

- Is het Transformatief? Creëert de output van de AI iets fundamenteel nieuws, of is het gewoon een high-tech kopie van het originele materiaal waarop het is getraind?

- Schaadt het de Markt? Concureert het AI-gegenereerde werk met of devalueert het het originele auteursrechtelijk beschermde werk?

De rechtbanken werken nog door deze vragen heen, en de juridische grond is op zijn best wankel. Leunen op een fair use-verdediging voor een commerciële reclame – die expliciet is gemaakt om geld te verdienen – is een grote gok. Totdat de wet duidelijker wordt, is de veiligste weddenschap werken met AI-hulpmiddelen die transparant zijn over hun trainingsdata en, ideaal gezien, je bescherming bieden tegen mogelijke auteursrechtsclaims.

Aan de Juiste Kant van de FTC Blijven

Nu, laten we praten over de Federal Trade Commission (FTC). Of je reclame nu is bedacht in een vergaderzaal of gegenereerd door een algoritme, de kernregel is dezelfde: het moet waarheidsgetrouw en niet misleidend zijn. Dit eenvoudige idee wordt een stuk ingewikkelder als je AI-acteurs in de mix gooit.

De taak van de FTC is consumenten te beschermen. Wanneer een reclame een synthetisch persoon bevat of een claim spuwt gemaakt door AI, is het potentieel om mensen te misleiden enorm. Daarom zijn duidelijke, upfront disclosures niet langer zomaar een 'leuk om te hebben'; ze zijn een must om compliant te blijven.

Het Mandaat van Waarheid in Reclame

In het hart van alles staat Section 5 van de FTC Act, die 'onredelijke of misleidende handelingen of praktijken' verbiedt. Dit betekent dat je solide bewijs nodig hebt voor elke claim die je maakt – expliciet of impliciet – voordat je reclame ooit het daglicht ziet. Deze regel geldt voor AI-gegenereerde inhoud net zoveel als voor een traditionele tv-commercial.

We zien al een piek in rechtszaken over valse reclame onder de Lanham Act, specifiek gericht op reclames die deepfake-celebrities gebruiken. Regulators en rechtbanken haasten zich om in te halen met de macht van AI om te misleiden. De FTC heeft al handhavingsacties ondernomen tegen bedrijven voor het maken van valse AI-claims, zoals het overdrijven van wat een product kan doen of gewoon een 'AI-powered'-label plakken zonder bewijs.

Een Hogan Lovells-analyse over AI en deepfake-reclames benadrukt hoe scherp deze rechtszaken zijn gestegen, wat bewijst dat regulators deze ruimte zeer, zeer nauwlettend in de gaten houden.

AI-Hallucinaties en Valse Claims

Een van de grootste mijnenvelden hier is het fenomeen van AI-'hallucinaties'. Dit is wanneer een AI-model zelfverzekerd 'feiten' verzint, productvoordelen, functies of zelfs gebruikersgetuigenissen uit het niets creëert.

Stel je voor dat je een AI vraagt een script te schrijven voor een nieuw gezondheidssupplement. Het zou een regel kunnen genereren die claimt dat het product 'klinisch bewezen de stofwisseling met 40% verhoogt'. Als je geen geloofwaardig wetenschappelijk onderzoek hebt om dat exacte getal te ondersteunen, heb je net de lijn overschreden naar valse reclame.

De adverteerder – niet de AI – is 100% juridisch verantwoordelijk voor elke claim die wordt gemaakt. De FTC vertellen 'de AI heeft het geschreven' is geen verdediging die je ergens brengt. Je moet elke feitelijke verklaring onafhankelijk verifiëren.

Dit is een cruciaal controlepunt. Je team heeft een waterdicht proces nodig voor fact-checking van alle AI-gegenereerde kopie voordat het publiek wordt.

AI-Acteurs en Aanbevelingen Onthullen

Transparantie is alles wanneer een AI-acteur betrokken is. Als je reclame een synthetisch persoon toont die een getuigenis geeft, moeten consumenten weten dat die persoon niet echt is.

Hier zijn een paar situaties waarin disclosure absoluut essentieel is:

- AI-Getuigenissen: Als een AI-gegenereerd personage zegt: 'Dit product heeft mijn leven veranderd', moet het duidelijk zijn dat ze geen echte klant zijn.

- Synthetische Influencers: Merken die werken met virtuele influencers mogen ze niet presenteren als echte mensen met echte, authentieke ervaringen met een product.

- Deepfake-Aanbevelingen: Een celebrity-deepfake gebruiken om iets aan te bevelen zonder hun expliciete toestemming is een gegarandeerde manier om hun publicity rights te schenden en FTC-regels te breken.

De FTC biedt volop bronnen op haar website om bedrijven te helpen hun verantwoordelijkheden te begrijpen.

Zoals het business guidance portal van de FTC duidelijk maakt, gelden de oude-school principes van reclame nog steeds, wat de noodzaak voor waarheid en bewijs voor alle claims versterkt, inclusief die van een AI.

Hier is een snelle checklist om je AI-gegenereerde reclames door te lopen voor FTC-compliance:

- Claim Substantiatie: Heb je solide bewijs om elke feitelijke claim in de reclame te bewijzen? Dit omvat prestatiestatistieken, 'bewezen' voordelen of vergelijkingen die je maakt.

- Duidelijke Disclosures: Is het onmiddellijk duidelijk voor de gemiddelde persoon dat een acteur, getuigenis of aanbeveling AI-gegenereerd is? Begraaf het niet in kleine letters – maak het duidelijk en opvallend.

- Misleidende Format Vermijden: Is je reclame ontworpen om eruit te zien als een nieuwsbericht, een echte gebruikerspost op sociale media of een onafhankelijke recensie? Als het een consument kan misleiden, is het een probleem.

- Impliciete Claims Controleren: Wat zou iemand redelijkerwijs uit je reclame kunnen halen, zelfs als je het niet expliciet stelt? Die impliciete claims moeten ook waarheidsgetrouw zijn en ondersteund door bewijs.

Als je elke stukje AI-gegenereerde inhoud behandelt met dezelfde juridische controle als je menselijke werk, kun je met vertrouwen innoveren en aan de juiste kant van de wet blijven.

Een Praktisch Framework voor het Beperken van Juridische Risico's

De risico's kennen is één ding; ze dagelijks beheren is iets heel anders. Als je veilig wilt navigeren door het juridisch mijnenveld van AI-acteurs in reclame, heeft je team een duidelijk, herhaalbaar framework nodig. Dit gaat niet over creativiteit verstikken – het gaat over het bouwen van vangrails die je team laten innoveren met vertrouwen.

Eerst en vooral: vet je AI-hulpmiddelen. Voordat je je aanmeldt voor een platform, duik in de details van hun algemene voorwaarden. Je moet precies weten waar hun trainingsdata vandaan komt en welke rechten je eigenlijk krijgt over de inhoud die je creëert. Sommige aanbieders bieden zelfs indemnificatie, wat een enorme plus is omdat het je kan beschermen tegen auteursrechtsclaims verderop.

Ontwikkel een Duidelijk AI-Gebruiksbeleid

Zodra je hulpmiddelen zijn geregeld, is het tijd om een intern AI-Gebruiksbeleid te creëren. Denk hieraan als het officiële spelboek voor je team. Het moet eenvoudig, direct zijn en de do's en don'ts van het gebruik van generatieve AI voor je reclamecampagnes uitspellen.

Je beleid moet een paar kernzaken vastnagelen:

- Goedgekeurde Hulpmiddelen: Maak een lijst van de specifieke AI-platforms die je team mag gebruiken. Dit voorkomt dat mensen rogue gaan met ongeteste hulpmiddelen die onnodig risico kunnen blootleggen.

- Verboden Inputs: Maak kristalhelder dat niemand vertrouwelijke bedrijfsinfo, klantdata of handelsgeheimen ooit in een AI-prompt mag stoppen.

- Likeness Beperkingen: Leg een harde regel vast: geen prompts die de AI vragen om de likeness of stem van een echt persoon na te bootsen, beroemdheid of niet.

- Beoordeling en Goedkeuring: Elke stukje AI-gegenereerde reclame-inhoud moet door een verplicht menselijk beoordelingsproces gaan voordat het ooit live gaat.

Dit beleid is je eerste verdedigingslinie. Het brengt iedereen op dezelfde pagina, werkend onder dezelfde veiligheidsbewuste richtlijnen.

Mandateer Altijd Menselijk Toezicht

Hoe slim een AI-hulpmiddel ook lijkt, het is geen substituut voor menselijk oordeel. Elke reclame gemaakt met AI moet worden beoordeeld door een echt persoon op juridische compliance, feitelijke nauwkeurigheid en merkveiligheid. Deze 'human-in-the-loop'-aanpak is niet optioneel.

Menselijk toezicht is je ultieme vangnet. Een AI begrijpt geen juridische nuance, merk reputatie of FTC-richtlijnen, maar je team wel. Elke stukje AI-gegenereerde inhoud is de verantwoordelijkheid van je bedrijf op het moment dat het publiek wordt.

De taak van de beoordelaar is de finale poortwachter te zijn. Ze zijn er om potentiële rampen op te vangen – zoals een accidentele likeness, een onbewezen claim of misleidende taal – voordat ze veranderen in zeer echte, zeer dure publieke problemen.

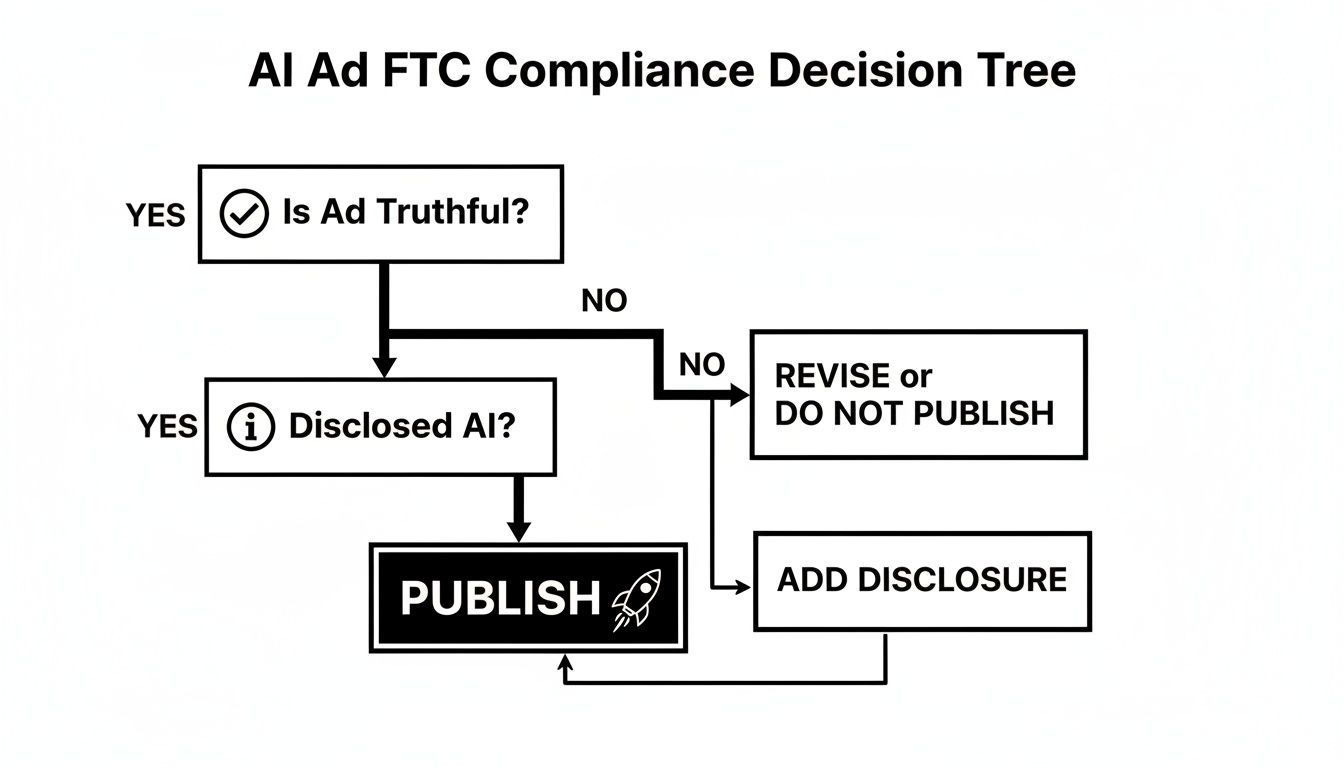

Deze beslissingsboom geeft je een vereenvoudigde compliance-check voor FTC-regels voordat je een AI-aangedreven reclame publiceert.

Zoals de grafiek laat zien, zijn waarheid en duidelijke disclosure de absolute, niet-onderhandelbare basis voor elke reclame die AI omvat.

Pre-Publicatie Checklist voor Makers

Om dit doodsimpel te maken voor je team, geef ze een snelle checklist om door te lopen voordat ze een AI-gegenereerde reclame live pushen op platforms zoals Facebook of Instagram.

- Likeness Scan: Hebben ten minste twee verschillende mensen naar de reclame gekeken om er zeker van te zijn dat het niet lijkt op een echt persoon?

- Claim Substantiatie: Kunnen we elke feitelijke claim in de reclamekopie of voiceover ondersteunen met hard bewijs?

- AI Disclosure: Gebruiken we een AI-acteur voor een getuigenis of aanbeveling, is de disclosure onmogelijk te missen?

- Copyright Check: Is er iets in de output dat lijkt alsof het is overgenomen van iemands anders auteursrechtelijk beschermde werk?

- Merk Alignement: Klinkt en voelt deze reclame echt als ons merk? Past het bij onze waarden en boodschap?

Door deze stappen in je workflow te weven – hulpmiddelen vetten, beleid stellen, menselijke beoordeling verplichten en een finale checklist gebruiken – bouw je een sterk systeem voor het beheren van de grootste juridische bedreigingen. Dit framework vertraagt je niet; het geeft je team de macht om creatief te zijn met AI terwijl het het merk buiten vermijdbare juridische problemen houdt.

Je AI-Reclamestrategie Future-Proof Maken

De juridische grond onder AI-reclame beweegt voortdurend. Om voor te blijven, moet je compliance behandelen niet als een corvee, maar als een echte concurrentievoordeel. Dit betekent transparantie, toestemming en solide substantiatie recht in het hart van je creatieve proces bouwen vanaf dag één.

Nieuwe wetten duiken voortdurend op, van federale deepfake-regels tot staatsniveau privacywetten. Maar door alles heen blijft één fundamentele waarheid hetzelfde: de adverteerder is altijd verantwoordelijk voor de inhoud van de reclame. Dit accepteren is de eerste stap naar het beheren van de juridische kwesties met AI-acteurs in reclame.

Proactieve juridische compliance gaat niet over bang zijn voor AI – het gaat over het verdienen van consumentenvertrouwen. Wanneer een merk open is over hoe het AI gebruikt en voorzichtig met zijn claims, staat het in een veel betere positie om duurzame loyaliteit op te bouwen en dure confrontaties met regulators te vermijden.

Van Juridisch Risico naar Creatief Voordeel

Het is makkelijk om deze juridische vangrails te zien als een creatieve wegversperring, maar dat is de verkeerde manier om ernaar te kijken. Zie ze als de basis voor slim, duurzaam innoveren. Zodra je team de regels van de weg begrijpt, kunnen ze vrij experimenteren en creatieve grenzen verkennen binnen een veilig framework.

Stel je voor dat je honderden reclamevarianten snel test voor een nieuwe campagne. Omdat je een solide human-in-the-loop beoordelingsproces hebt, weet je dat mogelijke likeness-inbreuken of onondersteunde claims lang voordat ze live gaan worden opgevangen. Die mix van de ongelooflijke snelheid van AI met scherp menselijk toezicht is waar de echte magie gebeurt, vooral in performance marketing.

Deze verantwoorde aanpak zorgt ervoor dat je creatieve motor niet verandert in een juridische aansprakelijkheid. Door bovenop de regels te blijven en ethische praktijken in je workflow te integreren, kun je met vertrouwen AI gebruiken om hoogpresterende reclames te creëren die zowel overtuigend als juridisch solide zijn.

Uiteindelijk is het doel een systeem te creëren waarin juridische ijver en creatieve briljantheid twee kanten van dezelfde munt zijn. Deze geïntegreerde strategie laat je merk de vruchten plukken van AI-gedreven reclame terwijl het het beschermt tegen de zeer reële risico's, en zorgt ervoor dat je marketinginspanningen merkwaarde opbouwen, geen juridische rekeningen.

Veelgestelde Vragen

Stap in de wereld van AI-gedreven reclame voelt als navigeren door een mijnenveld van nieuwe vragen. Laten we enkele van de meest voorkomende juridische zorgen van marketeers uitsplitsen als het gaat om het gebruik van AI-acteurs.

Moet Ik Mijn Gebruik van een AI-Acteur Onthullen?

Ja, absoluut. Transparantie is niet zomaar een goed idee – het is een juridische noodzaak. De Federal Trade Commission (FTC) is zeer duidelijk dat reclame niet misleidend mag zijn. Als je een niet-bestaand, AI-gegenereerd persoon gebruikt om een getuigenis te geven, en consumenten denken dat ze een echte klant kijken, heb je de lijn overschreden naar misleidend gebied.

De beste praktijk is altijd duidelijke en opvallende disclosure. Een eenvoudige on-screen notitie zoals 'AI-gegenereerde acteur' of 'Afbeelding gemaakt met AI' is alles wat nodig is. Deze eenvoudige stap beschermt consumentenvertrouwen, houdt je aan de juiste kant van de wet en waarborgt de integriteit van je merk.

Kan Ik Aangesproken Worden als een AI-Acteur Toevallig op Iemand Lijkt?

Dit is een grote, en het antwoord is een definitief 'misschien'. Hier wordt het tricky met het recht op publiciteit. Als je AI-gegenereerde personage veel lijkt op een echt persoon (vooral een beroemdheid), kun je in heet juridisch water belanden.

Die persoon kan beweren dat je hun likeness gebruikt om een product te verkopen zonder hun toestemming. De sleutel om dit te vermijden is een rotsvast menselijk beoordelingsproces. Iemand in je team moet de finale creatie nakijken specifiek om accidentele gelijkenissen te spotten voordat je op 'publish' drukt.

De cruciale juridische test gaat niet over je intentie; het gaat over hoe het publiek het ziet. Als een redelijk persoon je AI-acteur kan koppelen aan een echt individu, ben je open voor een mogelijke rechtszaak.

Wie Is Juridisch Verantwoordelijk voor Claims die een AI Maakt?

Jij bent. Altijd. Het merk achter de reclame is uiteindelijk verantwoordelijk voor elke claim die wordt gemaakt, of die nu door een mens of een AI wordt gesproken. Als je AI-acteur zegt dat je product '50% effectiever' is, heb je beter de data om dat te ondersteunen.

Je kunt een AI-'hallucinatie' – wanneer het model gewoon dingen verzint – niet de schuld geven als de FTC aanklopt. Dat is geen juridische verdediging. Daarom is menselijk toezicht niet onderhandelbaar; elk feit, cijfer en claim moet worden geverifieerd door een echt persoon voordat je reclame ooit live gaat.

Klaar om hoogpresterende reclames te creëren zonder de juridische kopzorgen? ShortGenius helpt je verbluffende, UGC-stijl videocampagnes snel te genereren terwijl het je de controle geeft om compliance te garanderen. Ontdek onze hulpmiddelen en begin vandaag nog met het bouwen van veiligere, effectievere reclames. Lees meer op https://shortgenius.com.