Gids voor juridische kwesties met AI-acteurs in advertenties

Navigeer de juridische kwesties met AI-acteurs in advertenties. Onze gids behandelt auteursrecht, publiciteitsrechten en FTC-regels om je campagnes rechtsgeldig en veilig te houden.

Het gebruik van AI-acteurs in je advertenties opent een wereld van creatieve mogelijkheden, maar je moet absoluut de belangrijkste juridische problemen met AI-acteurs in reclame begrijpen voordat je erin duikt. De grootste mijnenvelden zijn auteursrechtschendingen gekoppeld aan AI-trainingsdata, het per ongeluk schenden van het recht op publiciteit van een echt persoon, en boetes krijgen voor misleidende praktijken onder FTC-regels en nieuwe staatswetten over deepfakes. Dit vanaf het begin goed aanpakken is de enige manier om een zeer kostbare juridische puinhoop te vermijden.

De Nieuwe Juridische Risico's van AI-Acteurs in Reclame

Stap in de wereld van AI-gedreven reclame is spannend, geen twijfel mogelijk. Maar het is als een doolhof vol juridische valkuilen waarvan je niet eens wist dat ze bestonden. Denk er zo over: jij bent de regisseur, maar onzichtbare juridische kaders zoals auteursrecht, publiciteitsrechten en consumentenbeschermingswetten zijn de poppenspelers. Negeer je ze, dan kan je hele campagne instorten.

Dit nieuwe terrein brengt risico's met zich mee die traditionele reclame nooit heeft gekend. Je merk kan vervolgd worden voor auteursrechtschending alleen omdat het AI-model is getraind op beschermde afbeeldingen zonder toestemming te vragen. Het is ook schokkend eenvoudig dat een AI-gegenereerd gezicht te veel lijkt op een echt persoon, wat een rechtszaak wegens diefstal van hun gelijkenis kan uitlokken.

Belangrijkste Juridische Uitdagingen om op te Anticperen

De juridische problemen met AI-acteurs zijn niet langer hypothetisch; ze leiden tot echte campagnetakedowns, enorme boetes en ernstige schade aan de reputatie van een merk. Weten waar je precies tegenop moet boksen is de eerste stap naar een reclame strategie die zowel innovatief als juridisch solide is.

Hier is een overzicht van waar je op moet letten:

- Auteursrechtschending: Heeft de AI getraind op auteursrechtelijk beschermde foto's of kunst? Zo ja, dan kan je uiteindelijke advertentie juridisch als een "afgeleid werk" worden beschouwd, waardoor je aansprakelijk bent voor schending.

- Schending van Publiciteitsrecht: Als je AI-acteur ook maar vaag lijkt op een echt persoon – hun gezicht, stem of algemene uitstraling – kun je een rechtszaak krijgen wegens commercieel gebruik van hun gelijkenis zonder toestemming.

- Misleidende Reclamepraktijken: De Federal Trade Commission (FTC) is kristalhelder: advertenties moeten waarheidsgetrouw zijn. AI-acteurs gebruiken voor nep-video-testimonials of om een niet-bestaande goedkeuring te suggereren is een snelle weg naar problemen.

- Deepfaktenwetten Navigeren: Steeds meer staten voeren wetten in om synthetische media aan banden te leggen. Dit creëert een rommelig lappendeken van regelgeving dat afhangt van waar je publiek zich bevindt.

Om je een duidelijker beeld te geven, hier is een snelle samenvatting van de belangrijkste juridische hobbels die je tegenkomt.

Belangrijkste Juridische Risico's van AI-Acteurs in een Oogopslag

| Juridisch Risicogebied | Wat het voor Jouw Advertenties Betekent | Mogelijk Gevolg |

|---|---|---|

| Auteursrechtschending | Het AI-model gebruikte auteursrechtelijk beschermde afbeeldingen voor training, waardoor je advertentie een potentieel "afgeleid werk" is. | Rechtszaken, takedown-verzoeken en financiële schadevergoedingen. |

| Publiciteitsrecht | Je AI-acteur lijkt per ongeluk op het gezicht, de stem of de kenmerkende persona van een echt persoon. | Juridische actie van het individu wegens ongeautoriseerd commercieel gebruik van hun gelijkenis. |

| FTC & Misleidende Advertenties | AI gebruiken om nep-testimonials, misleidende productdemo's of valse goedkeuringen te creëren. | Zware FTC-boetes, juridische sancties en ernstige schade aan merkreputatie. |

| Deepfake- & Privacywetten | Het schenden van nieuwe staats-specifieke wetten die de creatie en het gebruik van synthetische media reguleren. | Burgerlijke of strafrechtelijke sancties, afhankelijk van de staat en de aard van de schending. |

Deze risico's begrijpen en navigeren gaat niet alleen om het vermijden van boetes; het gaat om het opbouwen van vertrouwen in een tijdperk waarin consumenten steeds sceptischer zijn over wat ze online zien.

Door deze risico's proactief aan te pakken, transformeer je juridische hobbels in een concurrentievoordeel. Een conforme aanpak beschermt niet alleen je bedrijf, maar bouwt ook vertrouwen op bij een publiek dat steeds alerter is op synthetische content.

Uiteindelijk is het doel om de ongelooflijke kracht van AI te benutten zonder in voor de hand liggende juridische vallen te struikelen. Het is een ecosysteem dat ook de bedrijven omvat die deze krachtige tools bouwen. Wil je een voorbeeld zien van wie in deze ruimte zit, bekijk dan de copycat247 homepage. Door geïnformeerd te blijven en een duidelijk complianceplan te maken, kun je met vertrouwen innoveren.

Het Auteursrechtenmijnenveld Verborgen in AI-Trainingsdata

Als het om AI in reclame gaat, is de grootste juridische hoofdpijn auteursrechtschending. Het hele probleem begint met hoe deze modellen eigenlijk leren. Generatieve AI verzint niet zomaar dingen uit het niets; het is getraind op enorme datasets, vaak met miljoenen afbeeldingen, video's en teksten die rechtstreeks van internet zijn gehaald. Daar begint de ellende.

Stel je een AI-model voor als een muzikant die naar elk ooit gemaakt lied luistert om te leren componeren. Als die muzikant dan een nieuw nummer uitbraakt dat verdacht veel lijkt op een beroemde, auteursrechtelijk beschermde melodie, heeft hij een grens overschreden. Het exacte dezelfde principe geldt hier. Je advertentie kan gebouwd zijn op een fundament van ongeautoriseerd materiaal zonder dat je het ooit weet.

Deze verborgen aansprakelijkheid betekent dat zelfs met de beste intenties, je merk verantwoordelijk kan zijn voor auteursrechtschending. De AI-gegenereerde acteur of scène in je advertentie kan technisch een "afgeleid werk" zijn – een nieuwe creatie die net iets te dicht bij een bestaand auteursrechtelijk beschermd stuk ligt. En je hebt geen idee waarop het getraind was om het te produceren.

De Troebele Wateren van "Substantiële Gelijkenis"

In de rechtbank draait de test voor auteursrechtschending vaak om een concept genaamd "substantiële gelijkenis." Dit gaat niet om het bewijzen dat een AI een pixel-voor-pixel kopie heeft gemaakt. Het is veel vager. De echte vraag is of een gewoon persoon naar de output van de AI kijkt en herkent dat het gekopieerd is van een beschermd werk.

Voor een reclamemaker is die ambiguïteit een enorm risico. Als een AI een personage genereert voor je campagne dat dezelfde eigenzinnige, herkenbare stijl heeft als een beroemd stripfiguur, kun je een rechtszaak verwachten. De oorspronkelijke kunstenaar hoeft niet te bewijzen dat de AI hun werk exact heeft gerepliceerd, alleen dat het "totale concept en gevoel" hetzelfde is.

En de juridische gevechten lopen al op. Eind 2025 waren er al 47 auteursrechtszaken aangespannen tegen AI-bedrijven in de VS alleen, velen als class-action zaken. In spraakmakende voorbeelden hebben bedrijven als Disney en Universal Studios beweerd dat AI-tools zijn getraind op hun blockbusterfilms zonder toestemming, wat een serieuze keten van risico's creëert voor iedereen die de visuals van die tools gebruikt.

Waarom Je Niet Kunt Leunen op de "Fair Use"-Verdediging

AI-bedrijven proberen zich vaak te verdedigen door te claimen dat hun trainingsproces "fair use" is, een juridische doctrine die beperkt gebruik van auteursrechtelijk materiaal toestaat voor dingen als onderzoek of commentaar. Maar dat argument wordt ongelooflijk zwak zodra de output van de AI voor commercieel doel wordt gebruikt – zoals een advertentie.

Rechtbanken kijken naar vier sleutelfactoren om te beslissen of iets fair use is:

- Doel van het Gebruik: Is het voor winst of voor onderwijs? Reclame is puur commercieel, wat een grote streep door je fair use-claim haalt.

- Aard van het Oorspronkelijke Werk: Creatieve werken zoals foto's en illustraties verdedigen is veel moeilijker dan feitelijke data.

- Hoeveelheid van het Gebruikte Werk: Heeft het AI-model het "hart" van het oorspronkelijke stuk gekopieerd, zelfs als het niet het hele ding gebruikte?

- Effect op de Markt: Schaadt de AI-gegenereerde afbeelding de mogelijkheid van de oorspronkelijke maker om hun werk te verkopen of te licentiëren? Als je AI-afbeelding de noodzaak vervangt om een stockfoto te kopen, is dat duidelijke marktschade.

Voor marketeers is leunen op een fair use-verdediging een gok die je bijna zeker verliest. De commerciële aard van een reclamecampagne torpedeert het argument vanaf het begin. Om je eigen creatieve assets beter te beschermen, is het slim om breidere intellectuele eigendomsaspecten te onderzoeken.

Het kernprobleem is niet alleen wat de AI creëert, maar waaraan het geleerd heeft. Als de trainingsdata juridisch twijfelachtig is, draagt elke gegenereerde content dat overgeërfde risico rechtstreeks over naar je reclamecampagnes.

Uiteindelijk ligt de last bij jou – de reclamemaker – om moeilijke vragen te stellen over waar je AI-assets vandaan komen. Kiezen voor AI-platforms die gelicenseerde of ethisch verkregen trainingsdata gebruiken is niet alleen het juiste doen; het is een cruciaal juridisch schild voor je merk.

Het Beschermen van Menselijke Identiteit in het AI-Tijdperk

Voorbij auteursrecht worden de juridische problemen met AI-acteurs in reclame persoonlijk. Snel. Hier botsen we op het publiciteitsrecht – het fundamentele recht dat iedereen heeft om te bepalen hoe hun naam, beeld en gelijkenis commercieel worden gebruikt.

Denk eraan als een persoonlijk handelsmerk op je identiteit. Als je AI gebruikt om een "digitale tweeling" van een celebrity – of zelfs een alledaags persoon – voor een advertentie te maken zonder hun expliciete toestemming, overschrijd je een serieuze juridische grens. Het is in wezen identiteitsdiefstal voor winst, en de rechtbanken nemen het niet licht op.

Dit gaat niet alleen om het maken van een perfecte, fotorealistische kopie. De wet beschermt vaak elke kenmerk dat direct wijst op een specifiek persoon. Dat kan hun stem zijn, een beroemde pose, of zelfs een catchphrase waar ze bekend om staan. Een virtuele influencer creëren die te vertrouwd voelt met een echte celebrity is een rechtszaak die staat te gebeuren.

De Groeiende Dreiging van Ongeautoriseerde Digitale Replica's

De explosie van deepfake-technologie heeft dit probleem in de schijnwerpers gezet, en wetgevers haasten zich om bij te benen. Staten voeren nu wetten in die specifiek gericht zijn op het ongeautoriseerde creëren en gebruiken van digitale replica's. Voor marketeers en makers betekent dit dat de oude manieren van toestemming krijgen officieel verleden tijd zijn.

Je kunt niet langer vertrouwen op een standaard model release-formulier en aannemen dat het de creatie van een AI-versie van die persoon dekt. Het juridische landschap is verschoven, en de nieuwe standaard is expliciete, geïnformeerde toestemming die specifiek AI-generatie noemt. Alles minder laat je merk wijd open voor risico's.

Een belangrijke rechterlijke uitspraak maakte dit punt echt duidelijk. Het toonde aan dat zelfs als federale auteursrechten- of handelsmerkenwetten niet helemaal passen bij een geval van stemklonen, staats-niveau burgerrechten- en publiciteitswetten nog steeds krachtige bescherming bieden voor individuen wiens identiteiten door AI worden gekaapt. Dat legt de last rechtstreeks bij reclamemakers om deze staatswetten te kennen en te respecteren.

Een AI-Bestendige Toestemmingsformulier Opstellen

Wanneer je toestemming krijgt om een AI-acteur te bouwen gebaseerd op een echt persoon, moet je aanpak volledig anders zijn. De toestemmings- en releaseformulieren moeten waterdicht zijn en absoluut geen ruimte voor interpretatie laten. Een echt solide AI-release moet je specifieke, ondubbelzinnige rechten geven.

Om aan de juiste kant van de wet te blijven, moet je toestemmingsproces deze sleutelpuntjes dekken:

- Expliciet Recht om een Digitale Replica te Creëren: Het formulier moet ondubbelzinnig stellen dat je van plan bent een digitale versie van de persoon te maken met AI.

- Scope van Gebruik Gedefinieerd: Wees precies. Stel exact vast hoe en waar de AI-replica zal worden gebruikt – welke campagnes, op welke platforms en voor hoe lang.

- Goedkeuringsrechten op AI-Output: Dit is een groot onderhandelingspunt. Mag de persoon de finale AI-gegenereerde scènes beoordelen en goedkeuren voordat ze gepubliceerd worden?

- Toekomstig Gebruik en Wijzigingen: Het contract moet verduidelijken of je het recht hebt om de AI-replica te wijzigen of te gebruiken in toekomstige campagnes die nog niet gepland zijn. Vage taal hier is een enorme aansprakelijkheid.

Om te zien hoe de eisen zijn veranderd, vergelijk gewoon traditionele toestemming met wat nodig is voor AI.

Toestemming Real Person vs AI-Actor Checklist

Deze tabel belicht de cruciale verschillen tussen een standaard release-formulier en een die ontworpen is voor het creëren van een AI-replica.

| Toestemmingsfactor | Vereist voor Echt Persoon | Cruciaal voor AI-Replica |

|---|---|---|

| Gebruik van Gelijkenis | Standaard model release voor foto's/video's. | Expliciete toestemming om een digitale kloon te genereren. |

| Duur van Gebruik | Duidelijk gedefinieerde tijd (bijv. één jaar). | Moet specificeren of rechten eeuwigdurend of tijdsgebonden zijn. |

| Wijzigingsrechten | Beperkt tot standaard bewerking (kleurcorrectie, enz.). | Moet rechten verlenen om de AI-prestatie/dialoog te wijzigen. |

| Scope van Media | Specificeert platforms (bijv. social media, TV). | Breed dekken van alle huidige en toekomstige digitale media. |

Uiteindelijk draait navigeren van het publiciteitsrecht in het AI-tijdperk om transparantie en respect. Kristalheldere toestemming krijgen is niet alleen een juridisch hokje afvinken – het gaat om het beschermen van je merk en het eren van de rechten van de mensen wiens identiteiten je creatieve werk aandrijven.

Aan de Juiste Kant van de FTC Blijven

Voorbij het doolhof van auteursrecht en publiciteitsrechten komt een andere grote speler in het spel wanneer je AI-acteurs gebruikt: de Federal Trade Commission (FTC). De taak van de FTC is eenvoudig: consumenten beschermen tegen advertenties die liegen of misleiden. Ze geven niet om of je advertentie is gemaakt door een team kunstenaars of een geavanceerd algoritme – als het misleidend is, is het een probleem.

In de kern is de regel van de FTC eenvoudig. Een advertentie mag niet misleidend zijn. Deze standaard geldt voor alles wat de advertentie zegt en impliceert, inclusief claims over de AI-technologie die gebruikt is om het te maken. Als je AI-acteur claimt dat een nieuw proteïnepoeder spieren 2x sneller opbouwt, heb je beter solide wetenschappelijk bewijs om dat te staven, net als wanneer een menselijke celebrity het zou zeggen.

De instantie pakt ook hard aan wat ze "AI-washing" noemen. Dit is wanneer een bedrijf zijn AI-mogelijkheden zwaar overdrijft. Je campagne aanprijzen als een baanbrekende AI-prestatie terwijl het slechts een paar basisautomatiseringstaken uitvoert, is een gegarandeerde manier om op de radar van de FTC te komen.

De Twee Waarheden Die Je Moet Handhaven

Wanneer AI-acteurs betrokken zijn, jongleer je plots twee sets verantwoordelijkheden. Je moet eerlijk zijn over wat je verkoopt en eerlijk over de technologie die je gebruikt om het te verkopen.

Denk eraan als een tweedelige integriteitscheck:

- Waarheid in de Boodschap van Je Advertentie: Zijn de claims, demonstraties of testimonials van je AI-acteur daadwerkelijk waar? Een AI-gegenereerde video van een blije "klant" die over je product rapt is ronduit misleidend als die klant niet bestaat.

- Waarheid in Je Tech-Claims: Blaas je op wat je AI kan? Als je claimt dat je AI perfect gepersonaliseerde advertenties levert maar het verandert alleen de achtergrondkleur op basis van locatie, misleid je je publiek.

De FTC interesseert zich niet voor het technische proces achter de advertentie. Ze richten zich op de boodschap waarmee een gemiddeld persoon wegloopt.

Regulators Menen het Menens

Dit is niet zomaar een tik op de vingers. De FTC zet actief bedrijven achterna voor misleidende AI-marketing, en stuurt een duidelijk bericht dat "AI" als buzzword geen vrijbrief is voor ongefundeerde claims.

De FTC heeft het duidelijk gemaakt: als je een claim maakt over je AI, moet je die kunnen bewijzen. Reclamemakers moeten robuust bewijs hebben voor elke prestatieclaim, net als voor elke andere productfunctie.

En dit is geen verre toekomstscenario – het gebeurt nu al. Midden 2025 had de FTC al minstens een dozijn handhavingsacties gestart tegen 'AI-washing.' Een prime voorbeeld was de rechtszaak van augustus 2025 tegen Air AI wegens valse claims dat hun AI menselijke verkopers volledig kon vervangen. Deze zaak onderstreept de serieuze juridische en financiële risico's voor marketeers die hun AI-tools overhype zonder bewijs. Je kunt meer leren over de evoluerende houding van de FTC ten opzichte van AI-wetgeving.

Wanneer Moet Je Openbaren?

Dit brengt ons bij een cruciale vraag: wanneer moet je mensen vertellen dat ze naar een AI-gegenereerde acteur kijken? Er is nog geen enkele federale wet met een harde regel, maar de algemene principes van de FTC over misleiding geven een vrij duidelijke gids.

De toetssteen is deze: "Zou weten dat het AI is de manier waarop een consument de advertentie begrijpt veranderen?"

Als je een AI-acteur gebruikt om als een echte dokter een supplement aan te bevelen of als een echte klant een persoonlijk verhaal te delen, is het nalaten om te openbaren dat het AI is bijna zeker misleidend. De weglating is misleidend omdat het de goedkeuring een geloofwaardigheid geeft die het niet heeft.

Om veilig te blijven en vertrouwen op te bouwen, worden duidelijke en prominente openbaringen de nieuwe standaard. Een eenvoudige, zichtbare tag zoals #AIGenerated kan een lange weg gaan in het voorblijven op regelgeving en aan de juiste kant van je klanten blijven.

Je Praktische Compliance Checklist voor AI-Advertenties

Goed, laten we voorbij de theorie gaan en kijken naar wat je daadwerkelijk moet doen. Het juridische mijnenveld van AI in reclame aanpakken draait om een solide, herhaalbaar proces. Dit gaat niet om creativiteit verstikken met bureaucratie; het gaat om het bouwen van vangrails zodat je team met vertrouwen kan innoveren.

Denk aan deze checklist als je pre-flight routine voordat je een AI-gedreven campagne lanceert. Door deze stappen in je workflow te integreren, creëer je een basis van compliance die je merk beschermt, individuele rechten respecteert en je aan de juiste kant van toezichthouders houdt. Laten we het doornemen.

Stap 1: Auditeer Je AI-Tool en Zijn Trainingsdata

Voordat je zelfs maar denkt aan het genereren van een afbeelding, moet je onder de motorkap van je AI-platform kijken. De juridische status van je finale advertentie hangt direct samen met de data waarop dat AI-model is getraind. Ervan uitgaan dat een betaald tool "veilig" is, is een enorme, en potentieel zeer kostbare, gok.

Je moet je AI-leverancier directe vragen stellen en echt in hun algemene voorwaarden duiken. Elke gerenommeerde aanbieder zou open moeten zijn over waar hun data vandaan komt.

- Eis Data-Transparantie: Vraag het rechtuit: Is je model getraind op gelicenseerde, public domain of ethisch verkregen data? Als je een vaag, ontwijkend antwoord krijgt, is dat een enorme rode vlag.

- Controleer op een Indemniteitsclausule: Dekken zij je juridische kosten als hun tool iets uitbraakt dat je een rechtszaak oplevert? Dit heet indemnificatie. Je zult ontdekken dat veel platforms 100% van het juridische risico bij jou, de gebruiker, leggen.

- Zoek naar "Commercieel Veilige" Tools: Sommige platforms adverteren hun modellen specifiek als veilig voor commercieel gebruik. Dit is vaak een goed teken, omdat het meestal betekent dat ze hun huiswerk over datarechten hebben gedaan.

Stap 2: Beveilig Waterdichte Rechten en Toestemming

Dit is niet onderhandelbaar. Als je advertentie een digitale dubbelganger van een echt persoon betreft – of zelfs een avatar die veel lijkt op iemand – heb je expliciete toestemming nodig. Je oude model release-formulier snijdt hier geen hout. Je overeenkomsten moeten nu specifiek zijn en vooruitdenken.

De naam van het spel is geïnformeerde toestemming. Je moet kristalhelder zijn dat je van plan bent een AI-gegenereerde versie van een persoon te creëren en te gebruiken, en exact vaststellen hoe, waar en voor hoe lang. Elke ambiguïteit in dat contract is basically een open uitnodiging voor een rechtszaak later.

Dit is meer dan een handtekening krijgen; het gaat om duidelijke communicatie. Een rotsvaste AI-release moet alle bases dekken om toekomstige problemen te voorkomen.

- Specificeer AI-Generatie: Het contract moet expliciet stellen dat je het recht hebt om een "digitale replica" of "AI-gegenereerde gelijkenis" te creëren.

- Definieer de Scope van Gebruik: Wees gedetailleerd. Schets op welke platforms de AI-acteur zal verschijnen, de typen campagnes en de exacte duur van gebruik.

- Behandel Wijzigingsrechten: Staat het contract toe dat je de prestatie van de AI aanpast? Kun je de dialoog veranderen of het in volledig nieuwe scènes droppen? Stel het vast.

Stap 3: Scrutinize Elke AI-Gegenereerde Output

Zodra de AI iets voor je creëert, begint het echte werk. Elke afbeelding, video en voice-over heeft een menselijke review nodig. Dit is je laatste verdedigingslinie tegen schending, en je kunt het niet overslaan.

Ga er nooit van uit dat een "nieuwe" afbeelding juridisch schoon is. Deze modellen kunnen – en doen – per ongeluk beschermde stijlen, personages of zelfs merkhuisstijlen nabootsen.

- Controleer op 'Substantiële Gelijkenis': Lijkt de output of voelt het een beetje te dicht bij een beroemd filmfiguur, kunstwerk of de kenmerkende stijl van een bepaalde kunstenaar? Als je intuïtie zegt dat het te dichtbij is, is het dat waarschijnlijk. Dump het en genereer een nieuwe.

- Scan op Handelsmerken: Kijk goed naar de achtergronden. Heeft de AI een logo, merknaam of kenmerkend productvorm geslopen?

- Luister naar Stemgelijkenis: Als je audio genereert, klinkt de stem griezelig vergelijkbaar met een beroemde acteur of publieke figuur? Dat is een potentieel publiciteitsrecht-schending die staat te gebeuren.

Stap 4: Implementeer Duidelijke Openbaringen en Onderbouw Claims

Ten slotte moet je eerlijk zijn tegen je publiek en je aan FTC-regels houden. Dit betekent transparant zijn over het gebruik van AI wanneer het ertoe doet en, het belangrijkste, elke claim in je advertentie onderbouwen met keihard bewijs.

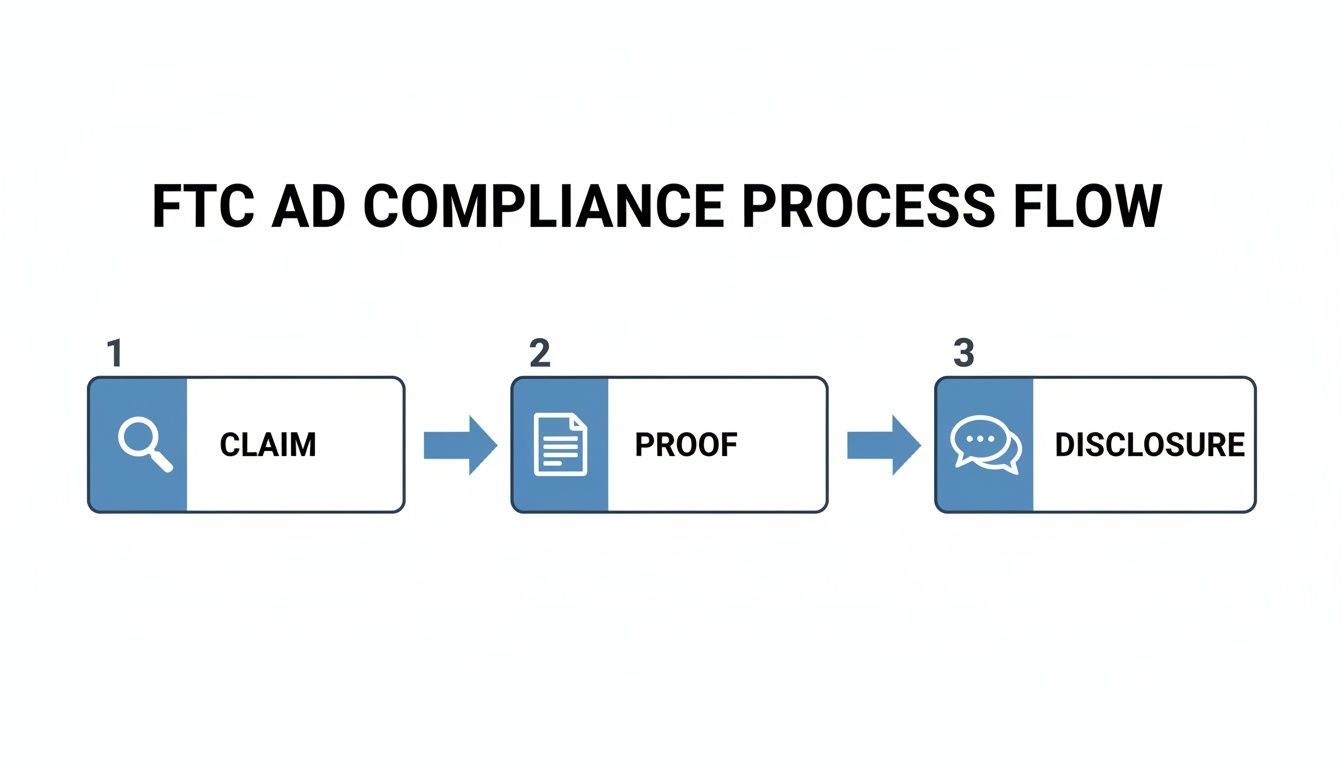

Deze eenvoudige flowchart breekt de kernverwachting van de FTC voor elke advertentie af, AI-gedreven of niet.

Het is een eenvoudige cyclus: voor elke claim die je maakt, moet je bewijs hebben om het te staven en een duidelijke openbaring bieden. Deze lus zorgt ervoor dat je reclame waarheidsgetrouw en verdedigbaar is.

- Openbaar Wanneer het Ertoe Doet: Als een typisch persoon misleid zou kunnen worden tot denken dat je AI-acteur echt is – zoals een dokter die medisch advies geeft of een klant die over een product rapt – moet je het openbaren. Een eenvoudige #AIGenerated of #AIAd kan volstaan.

- Onderbouw Alle Claims: Elke feitelijke uitspraak van je AI-acteur heeft bewijs nodig. Als je AI-woordvoerder zegt dat een product "50% effectiever" is, heb je beter de klinische studie om het te bewijzen voordat die advertentie het licht ziet.

- Bouw een 'Onderbouwingsdossier': Voor elke campagne, maak de gewoonte om een dossier aan te leggen met alle data, studies en bewijs die je reclameclaims ondersteunen. Als de FTC ooit aanklopt, is dat dossier je beste vriend.

Veelgestelde Vragen over AI-Acteurs in Reclame

Springen in AI-gedreven reclame roept vaak meer vragen op dan antwoorden. De juridische kant is nog een beetje als het Wilde Westen, wat het moeilijk maakt om vertrouwen te hebben in je beslissingen. Laten we enkele van de meest gestelde vragen van marketeers over de juridische problemen van AI-acteurs in advertenties aanpakken. Mijn doel is om je directe antwoorden te geven zodat je slimmere, veiligere campagnes kunt bouwen.

Moet Ik Openbaren Dat Mijn Advertentie een AI-Actor Gebruikt?

Steeds meer is het antwoord ja. Hoewel er geen één grote federale wet is die dit voor elke advertentie verplicht, verschuift het landschap zeker. De beste manier om erover na te denken is door de lens van de FTC-regels tegen misleidende praktijken. Als niet vertellen dat een acteur AI is iemand zou misleiden, moet je het absoluut openbaren. Denk aan een AI-gegenereerde "dokter" die een gezondheidsproduct plugt – het feit dat de dokter niet echt is, is een vrij groot ding.

Bovendien maken de platforms de keuze al voor je. Grote spelers zoals Meta en YouTube vereisen nu labels voor realistische AI-gegenereerde content, dus openbaring wordt een basis kost van zakendoen.

Hier is de simpele regel die ik volg: Als er kans is dat een gewoon persoon misleid zou kunnen worden, voeg een duidelijke en eenvoudige openbaring toe zoals #AIGenerated. Dit gaat niet alleen om regels volgen die eraan komen; het gaat om vertrouwen opbouwen bij je publiek, wat onbetaalbaar is.

Open zijn beheert verwachtingen en beschermt je merk, vooral naarmate mensen slimmer (en sceptischer) worden over synthetische media.

Kan Ik Aangesproken Worden Als Mijn AI-Tool een Schendend Afbeelding Maakt?

Zeker weten. Een groot misverstand is dat als de AI-tool de rotzooi maakt, de leverancier het moet opruimen. Zo werkt auteursrecht niet. Het bedrijf dat de schendende advertentie publiceert – jouw bedrijf dus – kan direct aansprakelijk worden gesteld. Dit wordt vaak secundaire aansprakelijkheid genoemd, en het betekent dat je het juridische risico deelt.

Zelfs als het AI-platform ook in de problemen komt, laat dat jou niet vrijuit gaan. Daarom moet je de algemene voorwaarden lezen van elke AI-tool die je gebruikt. Sommige platforms bieden indemnificatie (betekent dat ze je juridische kosten dekken), maar velen zijn geschreven om alle juridische verantwoordelijkheid bij jou als gebruiker te leggen.

Je beste verdediging is proactief zijn. Scrutinize elke AI-gegenereerde afbeelding op griezelige gelijkenissen met bestaand auteursrechtelijk werk. En probeer te blijven bij AI-platforms die transparant zijn over waar hun trainingsdata vandaan komt – die met legaal gelicenseerde of public domain data zijn altijd veiliger.

Wat is het Verschil Tussen een Stockfoto en een AI-Persoon?

Het belangrijkste verschil draait om waar de juridische rechten vandaan komen. Wanneer je een stockfoto van een persoon licenseert, komt het met een model release. Dit is een juridisch document waarin de echte mens op de foto toestemming heeft gegeven voor commercieel gebruik van hun gelijkenis. Het is je juridische veiligheidsdeken.

Een AI-gegenereerde persoon heeft geen model release omdat, nou ja, ze niet bestaan. Maar dit opent een heel nieuw blik wormen waar je bij stockfoto's geen zorgen over hebt.

- Per ongeluk Doppelgänger: De AI-afbeelding kan toevallig precies lijken op een echt persoon, wat een onverwachte publiciteitsrecht-claim creëert.

- Auteursrechtenmijnen: De afbeelding zelf kan worden aangevochten op basis van waarop de AI is getraind. Als het model leerde van een database beschermde afbeeldingen, kan je "originele" AI-persoon juridisch als een schendende kopie worden beschouwd.

Kortom, met een AI-persoon ruil je een bekend, duidelijk juridisch proces (model releases) voor een nieuw, troebel set risico's gekoppeld aan auteursrecht en identiteit.

Hoe Kan Ik Veilig een AI-Merksavatar Creëren?

Als je een AI-merksavatar of influencer wilt creëren zonder later een eng juridisch briefje te krijgen, heb je een plan nodig. Je kunt het niet zomaar improviseren.

Begin met ervoor te zorgen dat de avatar echt uniek is. Wees creatief met gedetailleerde prompts en pas de resultaten handmatig aan om de finale look ver weg te sturen van echte mensen of bestaande personages. Houd een record bij van dit creatieve proces – het kan cruciaal bewijs zijn om te bewijzen dat je iets totaal origineels wilde creëren.

Geef je avatar vervolgens een unieke naam en backstory die geen connectie heeft met een echt persoon. Doe een handelsmerkzoekopdracht voor de naam van de avatar en zelfs het visuele ontwerp om zeker te zijn dat je niet op de tenen van een ander merk trapt.

Ten slotte, doorloop de algemene voorwaarden van je AI-tool. Je moet zeker weten dat ze je volledige commerciële eigendom verlenen of op zijn minst een brede commerciële licentie voor alles wat je creëert. Transparant zijn tegen je publiek dat de avatar AI is, helpt ook om zowel juridische als PR-problemen af te wenden.

Klaar om hoogpresterende advertenties te creëren zonder juridisch giswerk en hoge productiekosten? ShortGenius is een AI-reclameplatform ontworpen voor makers en marketeers die verbluffende short-form video- en image-advertenties moeten produceren voor alle grote social platforms. Genereer concepten, scripts en visuals in seconden, pas ze aan met je brand kit en zet campagnes uit die resultaten opleveren. Probeer ShortGenius vandaag en begin met betere advertenties, sneller.