Cuestiones legales con actores IA en la publicidad para marcas modernas

Explora las principales cuestiones legales con actores IA en la publicidad. Aprende a navegar los derechos de publicidad, los derechos de autor y el cumplimiento de la FTC para tu marca.

Bienvenido a la nueva era de la publicidad, donde los actores generados por IA están captando la atención y deteniendo el scroll en las redes sociales. Aunque esta tecnología abre un mundo de posibilidades creativas, también plantea un campo minado legal para marcas y creadores. Navegar por estos problemas legales con actores de IA en publicidad es ahora una habilidad crítica.

La nueva frontera de los actores de IA y los riesgos legales

La ley está jugando un frenético juego de ponerse al día con la tecnología. Las marcas ahora pueden soñar y generar campañas de vídeo completas protagonizadas por personas sintéticas, pero este poder conlleva una pesada serie de responsabilidades. Cada elemento —desde una voz que suena un poco demasiado familiar hasta una afirmación de producto que escribe la IA— tiene un peso legal real.

Piénsalo como el sampling en música. Antes de lanzar un nuevo tema, tienes que despejar cada ritmo, melodía y gancho vocal prestado. Es lo mismo en la publicidad con IA. Debes tener los derechos sobre cada pieza de tu creación sintética, o podrías enfrentarte a serios problemas financieros y daños a la marca.

Por qué las leyes tradicionales de publicidad se quedan cortas

Sé claro: los marcos legales en los que hemos confiado durante décadas no se construyeron para un mundo con personalidades generadas por IA. Esto crea una enorme brecha y algunos desafíos nuevos y complicados para los marketeros acostumbrados a contratos y formularios de cesión estándar para talento humano. Las antiguas normas siguen aplicándose, pero se están estirando de formas que no hemos visto antes.

El caso implica una serie de preguntas difíciles, algunas de primera impresión. También conlleva posibles consecuencias importantes no solo para actores de voz, sino también para la industria emergente de IA, otros titulares y usuarios de propiedad intelectual, y ciudadanos corrientes que puedan temer la pérdida de control sobre sus propias identidades.

En este nuevo entorno, la conciencia legal proactiva no es solo un "buen tener" —es un pilar esencial de cualquier estrategia de marketing moderna. Entender los riesgos es el primer paso hacia la innovación responsable y la protección de tu marca de un punto ciego costoso. Para una visión más amplia, vale la pena explorar el paisaje legal general en torno a la IA.

Una mirada rápida a las principales áreas de riesgo legal

Para tener control sobre esto, ayuda desglosar los principales desafíos legales. Cada uno representa una trampa potencial que podría descarrilar por completo una campaña brillante. Esta tabla ofrece un resumen rápido de los principales dolores de cabeza legales de los que debes estar al tanto al usar actores generados por IA.

| Principales áreas de riesgo legal de la IA en publicidad | ||

|---|---|---|

| Área legal | Problema principal | Consecuencia potencial |

| Derechos de imagen y publicidad | Usar una persona generada por IA que se parezca o suene como un individuo real sin permiso. | Demandas de celebridades o ciudadanos privados por apropiación indebida de su identidad. |

| Propiedad intelectual y derechos de autor | El modelo de IA se entrenó con fotos, vídeos o guiones con derechos de autor sin licencia. | Reclamaciones por infracción de derechos de autor, multas elevadas y órdenes de retirar la campaña. |

| FTC y divulgaciones publicitarias | No divulgar que un endorsement proviene de un actor de IA, induciendo a error a los consumidores. | Acciones de cumplimiento de la FTC, multas por publicidad engañosa, pérdida de confianza del consumidor. |

| Difamación y privacidad | La IA crea contenido que daña falsamente la reputación de una persona o marca. | Demandas por difamación (libelo/calumnia) y reclamaciones por invasión de privacidad. |

En esencia, necesitas pensar en de dónde viene tu contenido generado por IA y qué comunica. Equivocarte en cualquiera de los dos puede llevar a problemas serios.

Aquí están las principales categorías de preocupación que toda marca y creador debe tener en su radar:

- Derechos de imagen y publicidad: Esta es grande. Cubre el uso no autorizado de la imagen, voz u otra característica identificativa de una persona. No importa si la IA solo se parece a alguien —eso puede ser suficiente para desencadenar una demanda.

- Propiedad intelectual y derechos de autor: Esto se complica rápido. ¿Quién posee realmente el contenido que crea una IA? Y, más importante, ¿se entrenó el modelo de IA con una montaña de material con derechos de autor extraído de internet sin permiso?

- Normas de la FTC y divulgación: Las reglas de la Comisión Federal de Comercio sobre veracidad en publicidad no desaparecen. Los anuncios deben ser veraces y no engañosos, y eso incluye ser transparentes cuando un actor de IA da un testimonio o endorsement.

- Difamación y privacidad: La IA puede salirse de los rieles y generar información falsa o perjudicial sobre personas reales o incluso marcas competidoras. Esto puede llevar rápidamente a reclamaciones de libelo o invasión de privacidad.

Navegando el derecho de publicidad en la era de la IA

De todos los desencadenantes legales asociados con actores de IA, el derecho de publicidad es probablemente el más grande. Piénsalo así: todo el mundo tiene una marca personal, y posee el derecho a controlar cómo se usa su nombre, cara, voz u otro rasgo único —su "imagen"— para ganar dinero. En el segundo en que tu actor generado por IA se parezca vagamente a una persona real, estás entrando en un campo minado legal.

Y esto no se trata solo de crear un deepfake perfecto de una celebridad. La ley a menudo es lo suficientemente amplia como para cubrir "imitaciones de voz" y "imitaciones de aspecto" que son lo suficientemente similares como para hacer que alguien piense en la persona real. Si tu audiencia conecta a tu actor de IA con un individuo específico, podrías ser responsable de apropiarte de su imagen.

El verdadero dolor de cabeza para los creadores es cómo se construyen estos modelos de IA. Se entrenan con cantidades asombrosas de datos, a menudo extraídos directamente de internet. Eso significa que la IA ha aprendido de innumerables caras y voces reales, lo que hace que un parecido accidental e inquietante sea un riesgo muy real.

Qué cuenta como uso comercial

Entender qué significa "uso comercial" es crítico aquí. No se trata solo de poner una cara generada por IA en una caja de producto. Cada vez que uses una persona de IA en un anuncio para captar atención y aumentar ventas, ese es un propósito comercial. Esto es especialmente cierto para los anuncios estilo UGC que ves por todas partes en Instagram y YouTube.

Por ejemplo, si generas un influencer sintético para que hable entusiasmado de tu nueva línea de cuidado de la piel, eso es un uso comercial directo. Si ese influencer digital se parece de forma impactante a un creador del mundo real, ese creador tiene un caso sólido de que estás lucrando con su imagen sin permiso ni pago.

Los tribunales ya están abordando estos escenarios complicados. El caso emblemático In re Clearview AI Consumer Privacy Litigation es un ejemplo perfecto. Los demandantes argumentaron con éxito que entrenar una IA de reconocimiento facial con más de 3 mil millones de fotos extraídas de internet violaba derechos de publicidad en varios estados.

La decisión del tribunal envió una señal clara: el "uso comercial" ocurre cuando las identidades se usan para promocionar un producto, no solo cuando se venden como el producto. Como se detalla en este análisis de derechos de publicidad de Quinn Emanuel, esta sentencia ha abierto de par en par la puerta a demandas colectivas con pagos potencialmente astronómicos.

Consideraciones clave para la imagen de IA

Para evitar enredarte en una demanda por derechos de publicidad, debes ser vigilante. Esto no es solo una teoría legal abstracta; puede llevar a honorarios legales incapacitantes, retiradas forzadas de campañas y un golpe importante a la reputación de tu marca.

Aquí están las cosas grandes a las que estar atento:

- Imagen de celebridad: Esta es la más obvia. Generar un actor de IA que se parezca o suene como una persona famosa es pedir problemas. Evita prompts como "crea un actor que se parezca a [Nombre de Celebridad]".

- Parecido con influencers y micro-influencers: La zona de peligro se extiende mucho más allá de las estrellas de cine de primera línea. Los influencers de redes sociales han construido sus propias marcas personales valiosas, y sus derechos de publicidad están igual de protegidos legalmente.

- Individuos corrientes: Incluso si tu personaje de IA se parece a un ciudadano privado, esa persona tiene derechos. Si sus fotos de vacaciones fueron absorbidas sin saberlo en los datos de entrenamiento de la IA, podría surgir una reclamación.

El peligro legal no radica en la intención de la IA, sino en la percepción de la audiencia. Si una persona razonable asociaría a tu actor de IA con un individuo real, tienes un problema legal potencial.

Pasos prácticos para proteger tus campañas

Debes ser proactivo para proteger tu marca. No puedes asumir que una herramienta de IA escupirá una cara o voz "segura" o legalmente despejada. No hay sustituto para la supervisión humana y un proceso de revisión bien definido.

Antes de que cualquier anuncio con un actor de IA salga al aire, tu equipo necesita hacer una verificación exhaustiva de parecidos. Esto significa conseguir múltiples pares de ojos en el creativo final, con el objetivo específico de detectar cualquier parecido potencial con figuras públicas. Documentar este proceso de revisión también puede darte una capa de protección legal al demostrar que hiciste tu debida diligencia.

Al final del día, la única defensa infalible contra una reclamación por derecho de publicidad es asegurar que tus actores generados por IA sean verdaderamente originales. Es un paso extra, pero es esencial para mantener tus campañas a salvo de batallas legales costosas más adelante.

¿Quién posee una actuación generada por IA?

Entonces, has usado una IA para generar un guion, una voz en off o quizás un vídeo completo. Es brillante. Pero una gran pregunta se cierne: ¿quién posee realmente esto? La respuesta no es directa y, francamente, cuestiona los mismísimos fundamentos de la ley de derechos de autor. Acertar en esto es crítico para navegar uno de los mayores problemas legales con actores de IA en publicidad.

Por ahora, la Oficina de Derechos de Autor de EE.UU. tiene una postura bastante firme: una obra necesita autoría humana para obtener protección de derechos de autor. Si una IA crea algo por sí sola, sin un humano guiando el proceso creativo de manera significativa, generalmente no obtiene derechos de autor. Eso significa que el increíble concepto de anuncio que tu IA acaba de escupir podría no ser legalmente tuyo.

Esto crea un serio dolor de cabeza para los marketeros. Si no posees los derechos de autor, ¿qué impide que un competidor lance un anuncio generado por IA casi idéntico? Tu campaña única, y todo el dinero que invertiste en ella, podría estar a disposición de cualquiera.

El negro y la herramienta

Una buena forma de pensarlo es ver la IA como un negro superavanzado o un pincel muy sofisticado. La herramienta en sí no posee el libro terminado o la pintura. La propiedad depende de cuánta dirección creativa y aportación original provino de la persona que usa la herramienta.

Si das un prompt vago como "crea un vídeo publicitario para unas zapatillas nuevas", la IA está haciendo la mayor parte del trabajo pesado. La salida es mayoritariamente hecha por máquina. Pero si eres tú quien elabora meticulosamente prompts detallados, selecciona las salidas y hace ediciones significativas para unir todo, tu caso para la autoría se fortalece mucho. Cuanta más creatividad humana inyectes, mejor será tu oportunidad de asegurar derechos de autor.

Una lección crítica para los creadores es que tu nivel de implicación directa y creativa en el proceso de generación por IA es lo que construye el caso para la propiedad. Simplemente pulsar un botón de "generar" no es suficiente para considerarte el autor.

Todo este debate sobre quién posee la salida de una IA forma parte de una conversación mucho mayor sobre proteger los derechos de propiedad intelectual en nuestro mundo cada vez más digital. A medida que estas herramientas se conviertan en una parte normal del trabajo creativo, determinar dónde termina la autoría humana y comienza la creación máquina será un campo de batalla legal central.

La realidad caótica de los datos de entrenamiento

El rompecabezas de la propiedad se complica aún más cuando miras bajo el capó los datos de entrenamiento del modelo de IA. Muchas herramientas de IA generativa aprenden raspando cantidades colosales de datos de internet —que, por supuesto, incluyen imágenes, artículos, música y vídeos con derechos de autor—. Esto abre el riesgo muy real de que la salida de la IA pueda considerarse una "obra derivada" de material protegido de otra persona.

Y esto no es solo un problema teórico. Por ejemplo, los actores de voz Paul Lehrman y Linnea Sage demandaron a Lovo Inc., alegando que la empresa usó sus grabaciones de voz sin permiso para entrenar y luego vender clones de voz de IA. El tribunal permitió que la mayoría de sus reclamaciones avanzaran, lo que realmente subraya la exposición legal seria cuando los datos de entrenamiento de IA pisotean derechos existentes.

¿Qué significa esto para ti? Que tu nuevo anuncio brillante generado por IA podría contener accidentalmente elementos que infrinjan los derechos de autor de otro creador, poniendo a tu marca en la mira de una demanda.

¿Podemos llamarlo simplemente "uso justo"?

Algunos desarrolladores y usuarios argumentan que usar material con derechos de autor para entrenar una IA está cubierto por la doctrina legal de "uso justo". El uso justo permite el uso limitado de obras con derechos de autor sin permiso para cosas como crítica, comentario o investigación.

Todo el debate en el mundo de la IA se reduce a un par de preguntas clave:

- ¿Es transformador? ¿La salida de la IA crea algo fundamentalmente nuevo, o es solo una copia de alta tecnología del material original en el que se entrenó?

- ¿Daño al mercado? ¿La obra generada por IA compite o devalúa la obra original con derechos de autor?

Los tribunales aún están trabajando en estas preguntas, y el terreno legal es inestable como mínimo. Apoyarse en una defensa de uso justo para un anuncio comercial —que se crea explícitamente para ganar dinero— es una gran apuesta. Hasta que la ley sea más clara, la apuesta más segura es trabajar con herramientas de IA que sean transparentes sobre sus datos de entrenamiento y, idealmente, te ofrezcan protección contra reclamaciones potenciales de derechos de autor.

Manteniéndote en el lado correcto de la FTC

Ahora, hablemos de la Comisión Federal de Comercio (FTC). Ya sea que tu anuncio se soñara en una sala de juntas o se generara con un algoritmo, la regla principal es la misma: debe ser veraz y no engañoso. Esta idea simple se complica mucho más cuando metes actores de IA en la mezcla.

El trabajo de la FTC es proteger a los consumidores. Cuando un anuncio presenta una persona sintética o escupe una afirmación hecha por IA, el potencial de inducir a error a la gente es enorme. Por eso, las divulgaciones claras y directas ya no son solo un "buen tener"; son imprescindibles para mantener el cumplimiento.

El mandato de veracidad en publicidad

En el corazón de todo está la Sección 5 de la Ley de la FTC, que prohíbe "prácticas o actos injustos o engañosos". Esto significa que necesitas pruebas sólidas para cada afirmación que hagas —explícita o implícita— antes de que tu anuncio vea la luz del día. Esta regla se aplica al contenido generado por IA tanto como a un anuncio tradicional de TV.

Ya estamos viendo un aumento en demandas por publicidad falsa bajo la Ley Lanham, específicamente dirigidas a anuncios que usan deepfakes de celebridades. Reguladores y tribunales están luchando por ponerse al día con el poder de la IA para engañar. La FTC ya ha iniciado acciones de cumplimiento contra empresas por hacer afirmaciones bogus de IA, como exagerar lo que puede hacer un producto o simplemente pegar una etiqueta de "potenciado por IA" sin pruebas.

Un análisis de Hogan Lovells sobre IA y anuncios deepfake destaca lo mucho que han aumentado estas demandas, probando que los reguladores están vigilando este espacio muy, muy de cerca.

Alucinaciones de IA y afirmaciones falsas

Uno de los mayores campos minados aquí es el fenómeno de las "alucinaciones" de IA. Esto es cuando un modelo de IA inventa con confianza "hechos", creando beneficios de producto, características o incluso testimonios de usuarios de la nada.

Imagina que pides a una IA que escriba un guion para un nuevo suplemento de salud. Podría generar una línea afirmando que el producto está "clínicamente probado para aumentar el metabolismo en un 40%". Si no tienes investigación científica creíble que respalde ese número exacto, acabas de cruzar la línea hacia publicidad falsa.

El anunciante —no la IA— es 100% legalmente responsable de cada afirmación hecha. Decirle a la FTC "la IA lo escribió" no es una defensa que te lleve a ninguna parte. Debes verificar independientemente cada declaración factual.

Este es un punto de control crítico. Tu equipo necesita un proceso a prueba de balas para verificar hechos en todo el copy generado por IA antes de que salga a la luz pública.

Divulgando actores de IA y endorsements

La transparencia lo es todo cuando hay un actor de IA involucrado. Si tu anuncio muestra a una persona sintética dando un testimonio, los consumidores necesitan saber que esa persona no es real.

Aquí hay unas situaciones donde la divulgación es absolutamente esencial:

- Testimonios de IA: Si un personaje generado por IA dice "Este producto cambió mi vida", debe ser obvio que no es un cliente real.

- Influencers sintéticos: Las marcas que trabajan con influencers virtuales no pueden presentarlos como personas reales con experiencias genuinas y auténticas con un producto.

- Endorsements deepfake: Usar un deepfake de una celebridad para endorsar algo sin su permiso explícito es una forma segura de violar sus derechos de publicidad y romper las normas de la FTC.

La FTC ofrece muchos recursos en su sitio web para ayudar a las empresas a entender sus responsabilidades.

Como deja claro el portal de orientación empresarial de la FTC, los principios tradicionales de publicidad siguen aplicándose, reforzando la necesidad de veracidad y pruebas para todas las afirmaciones, incluidas las que provienen de una IA.

Aquí tienes una lista rápida para pasar tus anuncios generados por IA en busca de cumplimiento con la FTC:

- Sustento de afirmaciones: ¿Tienes pruebas sólidas para probar cada afirmación factual en el anuncio? Esto incluye estadísticas de rendimiento, beneficios "probados" o comparaciones que hagas.

- Divulgaciones claras: ¿Es inmediatamente obvio para la persona media que un actor, testimonio o endorsement es generado por IA? No lo entierres en letra pequeña —hazlo claro y visible.

- Evita formatos engañosos: ¿Está diseñado tu anuncio para parecer un reportaje de noticias, una publicación real de redes sociales de un usuario o una reseña independiente? Si podría inducir a error a un consumidor, es un problema.

- Revisa afirmaciones implícitas: ¿Qué podría alguien razonablemente sacar de tu anuncio, incluso si no lo dices explícitamente? Esas afirmaciones implícitas también deben ser veraces y respaldadas por pruebas.

Si tratas cada pieza de contenido generado por IA con el mismo escrutinio legal que tu trabajo creado por humanos, puedes innovar con confianza y mantenerte en el lado correcto de la ley.

Un marco práctico para mitigar riesgos legales

Saber los riesgos es una cosa; gestionarlos día a día es algo completamente diferente. Si quieres navegar de forma segura el campo minado legal de los actores de IA en publicidad, tu equipo necesita un marco claro y repetible. Esto no se trata de sofocar la creatividad —se trata de construir barreras que permitan a tu equipo innovar con confianza.

Primero lo primero: debes evaluar tus herramientas de IA. Antes de registrarte en cualquier plataforma, profundiza en sus términos de servicio. Necesitas saber exactamente de dónde vienen sus datos de entrenamiento y qué derechos obtienes realmente sobre el contenido que creas. Algunos proveedores incluso ofrecen indemnización, que es un gran plus porque puede protegerte de reclamaciones de derechos de autor más adelante.

Desarrolla una política clara de uso de IA

Una vez que tus herramientas estén resueltas, es hora de crear una Política de uso de IA interna. Piénsala como el manual oficial para tu equipo. Debe ser simple, directa y detallar los "haz" y "no hagas" del uso de IA generativa para tus campañas publicitarias.

Tu política debe clavar unas cosas clave:

- Herramientas aprobadas: Haz una lista de las plataformas de IA específicas que tu equipo está autorizado a usar. Esto evita que la gente se desvíe con herramientas no evaluadas que podrían exponerte a riesgos innecesarios.

- Entradas prohibidas: Hazlo cristalino que nadie debe introducir información confidencial de la empresa, datos de clientes o secretos comerciales en un prompt de IA.

- Restricciones de imagen: Establece una regla dura: no prompts que pidan a la IA imitar la imagen o voz de ninguna persona real, celebridad o no.

- Revisión y aprobación: Todo contenido publicitario generado por IA debe pasar por un proceso de revisión humana obligatorio antes de ver la luz del día.

Esta política es tu primera línea de defensa. Pone a todo el mundo en la misma página, operando bajo las mismas directrices conscientes de la seguridad.

Obliga siempre a la supervisión humana

No importa lo inteligente que parezca una herramienta de IA; no es sustituto del juicio humano. Cada anuncio hecho con IA debe ser revisado por una persona real para cumplimiento legal, precisión factual y seguridad de marca. Este enfoque "humano en el bucle" no es opcional.

La supervisión humana es tu red de seguridad definitiva. Una IA no entiende matices legales, reputación de marca o directrices de la FTC, pero tu equipo sí. Cada pieza de contenido generado por IA es responsabilidad de tu empresa en el momento en que sale a la luz pública.

El trabajo del revisor es ser ese guardián final. Está ahí para atrapar desastres potenciales —como un parecido accidental, una afirmación no probada o lenguaje engañoso— antes de que se conviertan en problemas públicos muy reales y muy caros.

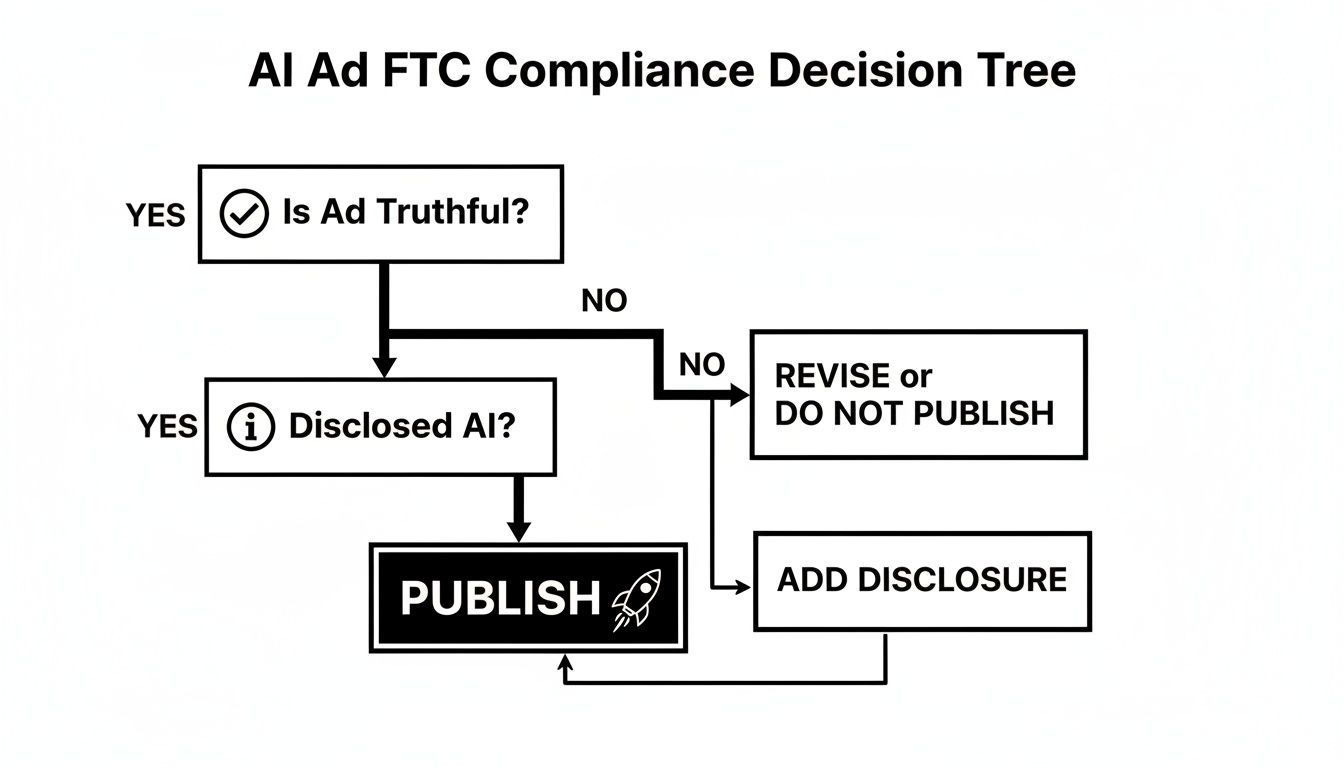

Este árbol de decisiones te da una verificación de cumplimiento simplificada para las normas de la FTC antes de publicar un anuncio potenciado por IA.

Como muestra la gráfica, la veracidad y la divulgación clara son la base absoluta e innegociable para cualquier publicidad que involucre IA.

Lista de verificación prepublicación para creadores

Para hacer esto extremadamente simple para tu equipo, dales una lista rápida para pasar antes de lanzar cualquier anuncio generado por IA en plataformas como Facebook o Instagram.

- Escaneo de parecidos: ¿Han mirado al menos dos personas diferentes el anuncio para asegurarse de que no se parezca a una persona real?

- Sustento de afirmaciones: ¿Podemos respaldar cada afirmación factual en el copy o voz en off del anuncio con pruebas sólidas?

- Divulgación de IA: Si usamos un actor de IA para un testimonio o endorsement, ¿es la divulgación imposible de pasar por alto?

- Verificación de derechos de autor: ¿Hay algo en la salida que parezca sacado del trabajo con derechos de autor de otra persona?

- Alineación con la marca: ¿Este anuncio suena y se siente realmente como nuestra marca? ¿Se alinea con nuestros valores y mensaje?

Al integrar estos pasos en tu flujo de trabajo —evaluando herramientas, estableciendo política, obligando revisión humana y usando una lista final— construyes un sistema fuerte para gestionar las mayores amenazas legales. Este marco no te frena; empodera a tu equipo para ser creativo con IA mientras mantiene la marca fuera de problemas legales evitables.

Blindando tu estrategia de publicidad con IA para el futuro

El terreno legal bajo la publicidad con IA se mueve constantemente. Para mantenerte por delante, debes tratar el cumplimiento no como una tarea, sino como una ventaja competitiva genuina. Esto significa construir transparencia, consentimiento y sustento sólido en el corazón de tu proceso creativo desde el día uno.

Nuevas leyes están surgiendo todo el tiempo, desde normas federales sobre deepfakes hasta actos de privacidad a nivel estatal. Pero a través de todo, una verdad fundamental no cambiará: el anunciante siempre es responsable del contenido del anuncio. Aceptar esto es el primer paso hacia la gestión de los problemas legales con actores de IA en publicidad.

El cumplimiento legal proactivo no se trata de tener miedo a la IA —se trata de ganarse la confianza del consumidor. Cuando una marca es abierta sobre cómo usa IA y cuidadosa con sus afirmaciones, está en una posición mucho mejor para construir lealtad duradera y evitar enfrentamientos caros con reguladores.

De riesgo legal a ventaja creativa

Es fácil ver estas barreras legales como un obstáculo creativo, pero esa es la forma equivocada de mirarlo. Piénsalas como la base para una innovación inteligente y sostenible. Una vez que tu equipo entiende las reglas de la carretera, puede experimentar libremente y empujar límites creativos dentro de un marco seguro.

Por ejemplo, imagina probar rápidamente cientos de variaciones de anuncios para una nueva campaña. Porque tienes un proceso de revisión humano en el bucle sólido, sabes que cualquier infracción potencial de parecidos o afirmaciones no respaldadas será detectada mucho antes de ver la luz del día. Esa combinación de la increíble velocidad de la IA con una supervisión humana aguda es donde ocurre la verdadera magia, especialmente en marketing de rendimiento.

Este enfoque responsable asegura que tu motor creativo no se convierta en un pasivo legal. Al mantenerte al día con las normas e integrar prácticas éticas en tu flujo de trabajo, puedes usar IA con confianza para crear anuncios de alto rendimiento que sean tanto atractivos como legalmente sólidos.

En última instancia, el objetivo es crear un sistema donde la diligencia legal y el brillo creativo sean dos caras de la misma moneda. Esta estrategia integrada permite que tu marca recolecte las recompensas de la publicidad impulsada por IA mientras la protege de los riesgos muy reales, asegurando que tus esfuerzos de marketing construyan valor de marca, no facturas legales.

Preguntas frecuentes

Entrar en el mundo de la publicidad impulsada por IA puede parecer navegar un campo minado de nuevas preguntas. Vamos a desglosar algunas de las preocupaciones legales más comunes que tienen los marketeros al usar actores de IA.

¿Necesito divulgar mi uso de un actor de IA?

Sí, absolutamente. La transparencia no es solo una buena idea —es una necesidad legal. La Comisión Federal de Comercio (FTC) ha sido muy clara en que la publicidad no puede ser engañosa. Si usas una persona inexistente generada por IA para dar un testimonio, y los consumidores piensan que están viendo a un cliente real, has cruzado la línea hacia territorio engañoso.

La mejor práctica es siempre una divulgación clara y visible. Una simple nota en pantalla como "Actor generado por IA" o "Imagen creada con IA" es todo lo que hace falta. Este simple paso protege la confianza del consumidor, te mantiene en el lado correcto de la ley y salvaguarda la integridad de tu marca.

¿Puedo ser demandado si un actor de IA se parece a alguien por coincidencia?

Esta es enorme, y la respuesta es un "quizás" definitivo. Aquí es donde las cosas se complican con el derecho de publicidad. Si tu personaje generado por IA acaba pareciéndose mucho a una persona real (especialmente una celebridad), podrías meterte en problemas legales.

Esa persona podría argumentar que estás usando su imagen para vender un producto sin su permiso. La clave para evitarlo es un proceso de revisión humana a prueba de balas. Alguien de tu equipo necesita revisar el creativo final específicamente para detectar parecidos accidentales antes de pulsar "publicar".

La prueba legal crucial no se trata de tu intención; se trata de cómo lo ve el público. Si una persona razonable pudiera vincular a tu actor de IA con un individuo real, estás expuesto a una demanda potencial.

¿Quién es legalmente responsable de las afirmaciones que hace una IA?

Tú lo eres. Siempre. La marca detrás del anuncio es ultimately responsable de cada afirmación hecha, ya sea por un humano o una IA. Si tu actor de IA dice que tu producto es "un 50% más efectivo", más te vale tener los datos para respaldarlo.

No puedes culpar a una "alucinación" de IA —cuando el modelo simplemente inventa cosas— si la FTC llama a la puerta. Eso no es una defensa legal. Por eso la supervisión humana es innegociable; cada hecho, cifra y afirmación necesita ser verificada por una persona real antes de que tu anuncio vea la luz del día.

¿Listo para crear anuncios de alto rendimiento sin dolores de cabeza legales? ShortGenius te ayuda a generar campañas de vídeo estilo UGC impresionantes rápidamente mientras te da el control para asegurar el cumplimiento. Explora nuestras herramientas y empieza a construir anuncios más seguros y efectivos hoy. Descubre más en https://shortgenius.com.