Guia del creador per dominar la IA de sincronització labial

Descobreix com la IA de sincronització labial transforma la creació de vídeo. Aprèn què és, com funciona i com utilitzar-la per crear contingut perfectament doblat per a una audiència global.

Mai has volgut parlar qualsevol idioma als teus vídeos, amb la boca sincronitzant-se perfectament amb cada paraula, encara que no coneguis l'idioma? Això és exactament el que fa possible el lip-sync AI. En el seu nucli, aquesta tecnologia pren una pista d'àudio separada i anima automàticament la boca d'una persona —o d'un avatar— per sincronitzar-se perfectament amb ella.

Això no és només un truc divertit de festa; és un gran avanç cap endavant, fent que la creació de contingut i la localització siguin accessibles per a tothom.

Per què el Lip Sync AI és important per als creadors

Pensa en el lip-sync AI com un titellaire digital pels teus vídeos. Durant molt de temps, obtenir una sincronització labial realista era alguna cosa que només els estudis de cinema d'alt pressupost amb equips dedicats de VFX podien aconseguir. Significava animar els moviments de la boca quadre per quadre de manera exigent. Ara, aquest mateix poder està a les mans dels creadors de tot el món, i està canviant completament com es fan els vídeos per a plataformes com YouTube, TikTok i Instagram.

La tasca principal d'aquesta IA és tancar la bretxa entre el que veus i el que sents, creant una experiència completament fluida i creïble per al espectador. Oblida aquells doblatges antics i torpes on l'àudio està dolorosament desfasat. Aquesta tecnologia assegura que la boca del parlant es mogui en perfecta harmonia amb una nova pista d'àudio, ja sigui un altre idioma, una veu en off regravada o fins i tot un guió llegit per una veu d'IA.

Expandint el teu abast i estalviant temps

L'impacte en els creadors de contingut és enorme. Ja no estàs limitat al teu idioma natiu ni has d'afrontar la molèstia de gravacions noves cares només per corregir un petit error d'àudio.

Aquesta tecnologia et dona el poder de:

- Trencar barreres idiomàtiques: Dobla els teus vídeos instantàniament a múltiples idiomes. Pots obrir el teu contingut a audiències internacionals massives sense necessitar parlar ni una paraula d'espanyol, japonès o hindi.

- Escalar contingut sense esforç: Pren un vídeo i reutilitza'l per a diferents mercats globals. Només has de canviar el fitxer d'àudio i deixar que l'IA s'encarregui de la resta.

- Elevar el valor de producció: Crea veus en off amb so professional pels teus anuncis o vídeos de xarxes socials i assegura't que el teu talent en pantalla o avatar sembli completament natural i autèntic.

Això no és només una novetat tècnica; és un avantatge estratègic. El lip sync AI permet als creadors individuals i equips petits competir a escala global, produint contingut multilingüe que abans només era possible per a grans empreses mediàtiques.

Finalment, aquesta eina tracta de treballar de manera més intel·ligent, no més dura. Automatitzant una tasca de postproducció que abans era esgotadora, etallibera per centrar-te en allò que fas millor: idees genials. Per veure el panorama complet, ajuda entendre el món més ampli de la Creació de contingut impulsada per IA i com eines com aquesta estan remodelant tota la indústria. El lip-sync AI és una peça clau d'aquest trencaclosques, donant-te la capacitat de connectar amb més gent d'una manera molt més autèntica.

Com funciona realment el Lip Sync AI

Alguna vegada t'has preguntat què passa sota el capot d'un lip-sync AI? No és només un espectacle de titelles digital movent una boca amunt i avall. Pensa-hi més com un servei de traducció sofisticat, però en lloc de convertir paraules d'un idioma a un altre, tradueix sons en moviments facials increïblement precisos.

Fem servir una analogia. Si estiguessis ensenyant a un robot a parlar, no li ensenyaries només l'alfabet. Li ensenyarries com sona cada lletra. El lip-sync AI fa alguna cosa molt semblant descomponen la teva pista d'àudio en les unitats més petites de so, que es diuen phonemes. Per exemple, la paraula "hello" es descompon en sons diferents com "h", "eh", "l" i "ow".

Un cop l'IA ha identificat aquests fonemes, es posa mans a l'obra amb la seva tasca principal: mapear cada so a la forma exacta de boca que una persona fa quan el diu. Aquestes formes visuals de boca es diuen visemes. L'IA ha estat entrenada amb muntanyes de dades, així que sap instintivament que el so "f" significa que els dents superiors han de tocar el llavi inferior. És una traducció relampant de l'àudio al visual.

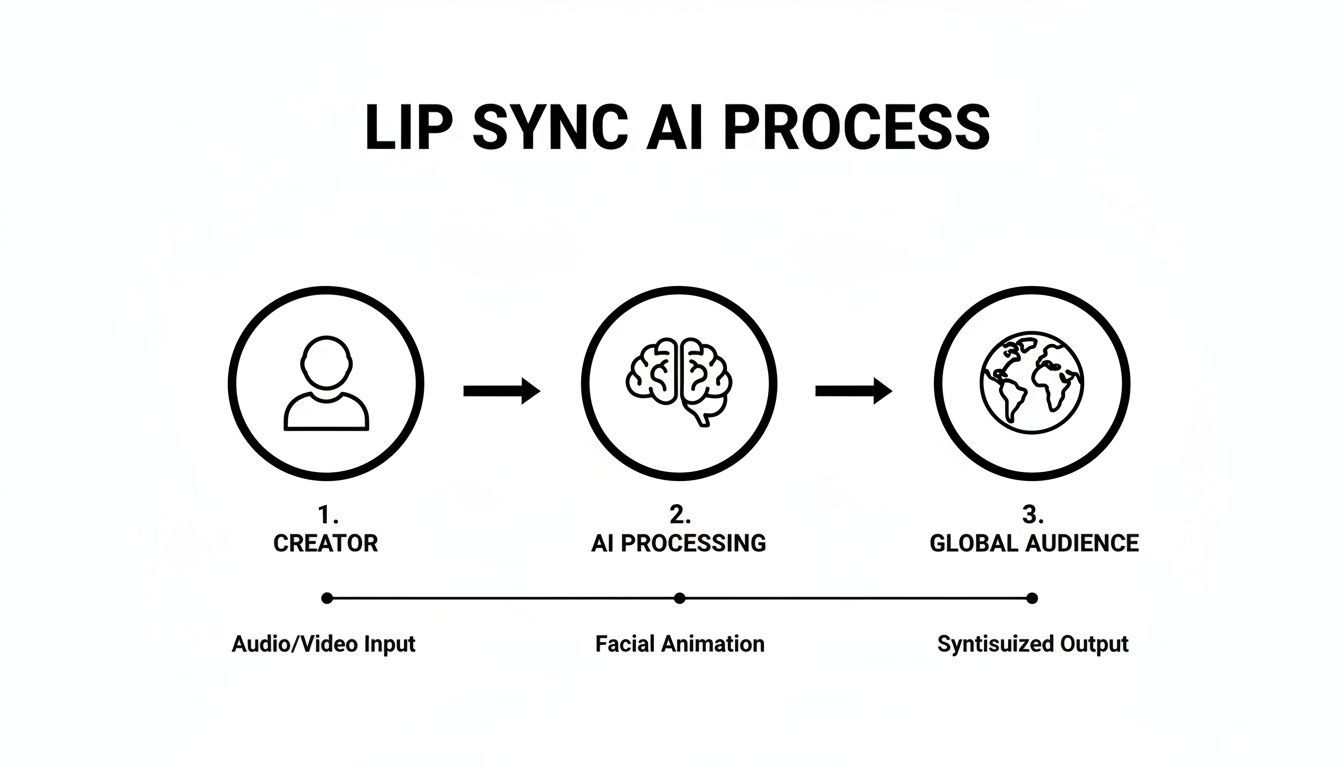

Aquest diagrama desglossa com un tros de contingut passa d'una gravació senzilla al teu costat a un vídeo preparat per a una audiència global.

Com pots veure, el creador proporciona els materials crus, l'IA fa el treball pesat i el resultat és contingut polit que connecta amb espectadors qualsevol lloc.

Els dos ingredients principals

Per aconseguir aquesta màgia digital, l'IA realment només necessita dues coses de tu. Aquesta simplicitat és una gran part del que fa eines com ShortGenius tan útils per als creadors que han de treballar ràpid.

- El fitxer d'àudio: Aquest és el teu pla. Podria ser una veu en off que acabes de gravar, una pista d'àudio doblada professionalment per a un nou idioma o qualsevol altra gravació de parla. L'àudio més net, millor. Una parla nítida i clara dóna a l'IA un conjunt molt més fàcil de fonemes per treballar, cosa que sempre porta a un resultat més precís i creïble.

- El vídeo o avatar: Aquest és el teu llenç. Pots utilitzar un vídeo d'una persona real o fins i tot una imatge estàtica d'un avatar generat per IA. L'IA utilitza aquesta base visual per generar i superposar els nous moviments de boca perfectament sincronitzats.

Però els algorismes moderns d'aprenentatge profund no s'aturen aquí. Van un pas més enllà analitzant les nuances de l'àudio: el to, l'emoció, fins i tot la velocitat del parlant. Això ajuda a fer que l'animació final sembli molt més natural. En el seu cor, el lip-sync AI tracta de l'habilitat expert per sincronitzar àudio vídeo tan sense costures que l'espectador ni tan sols hi pensa.

El fons de l'assumpte és aquest: No es tracta només de moure llavis. És un anàlisi profunda del so que tradueix la parla en expressions facials realistes, capturant els petits detalls que fan que una actuació sembli realment humana.

Aquest nivell d'automatització està impulsant un creixement industrial seriós. El mercat global per a la tecnologia de lip-sync està en camí de saltar des de USD 1.12 billion el 2024 fins a un estimat de USD 5.76 billion el 2034. El fet que l'aprenentatge automàtic impulsat per àudio ja comandi un 40.7% de quota de mercat mostra com de vital és aquesta tecnologia per portar el contingut al món.

Aquesta mateixa tecnologia és un ingredient clau en moltes eines de vídeo IA. És el que permet a un creador convertir una sola foto estàtica en un vídeo dinàmic i atractiu. Pots aprofundir en com funciona això consultant la nostra guia sobre com transformar imatges en vídeo amb IA.

Aplicacions pràctiques per a creadors i màrqueters

Coneixer els detalls tècnics del lip sync AI és una cosa, però la màgia real passa quan veus com obre noves portes creatives i de negocis. Per als creadors i màrqueters, això no és només una novetat; és una eina seriosa per escalar contingut, accedir a nous mercats i connectar realment amb audiències arreu del món.

El cas d'ús més obvi i potent és la localització de contingut. Digues que tens un TikTok que es fa viral o un tutorial de YouTube en què has posat tot el teu cor. En lloc de limitar-te només als parlants d'anglès, ara pots crear versions per a audiències espanyoles, hindi o japoneses gairebé instantàniament. L'IA no només afegeix una nova pista d'àudio: reanima cuidadosamente els moviments dels llavis per adaptar-se al nou idioma, fent que el vídeo final sembli completament natural.

Això reescriu completament el llibre de regles per a l'expansió global. L'antiga manera de localitzar una campanya de vídeo implicava contractar actors de veu per a cada idioma, reservar temps d'estudi car i lluitar setmanes o mesos de postproducció. Ara, tot aquest flux de treball és més ràpid i molt més assequible.

Des d'anuncis globals fins a avatars IA

Més enllà de només traduir vídeos, el lip sync AI desbloqueja tota una gamma d'estratègies per construir marques i crear anuncis atractius. En el seu nucli, cada aplicació aprofita la capacitat de separar el que algú diu de com sembla mentre ho diu.

Aquí tens algunes maneres revolucionàries en què s'està utilitzant aquesta tecnologia ara mateix:

- Creant avatars IA atractius: Pots prendre una sola imatge —d'un mascota, un fundador o un influencer virtual— i donar-li vida. Només alimenta'l amb una veu text-to-speech i tens un subministrament endless de contingut per xarxes socials sense que ningú hagi d'anar davant d'una càmera.

- Localitzant campanyes publicitàries: Una marca pot produir un anunci fantàstic d'alt pressupost i després utilitzar IA per adaptar-lo a desenes de mercats internacionals. Això manté la coherència de la marca mentre fa que el missatge sembli local i personal. Aquest enfocament és un salvavides per a plataformes publicitàries que demanen un flux constant de creativitat fresca. Pots veure com funciona en una estratègia més ampla consultant la nostra guia sobre com crear anuncis UGC-style efectius amb IA.

- Correccions d'àudio sense esforç: Tots hem estat allà. Acabes un edit de vídeo perfecte, només per adonar-te d'un error en la veu en off. En lloc d'una regravació frustrant, pots gravar la línia d'àudio corregida i deixar que l'IA la parchegi sense costures, adaptant els llavis perfectament.

El veritable poder aquí és la desacoblament del visual de l'àudio. Això dóna als creadors una flexibilitat immensa per experimentar, corregir errors i adaptar contingut per a diferents plataformes i audiències sense començar de zero cada vegada.

Per mostrar com aquestes idees prenen vida, aquí tens un desglossament ràpid de com els creadors i marques estan posant el lip sync AI en marxa.

Aplicacions de Lip Sync AI per a creadors i marques

| Cas d'ús | Benefici principal | Aplicació d'exemple |

|---|---|---|

| Distribució global de contingut | Creixement d'audiència | Un youtuber tradueix el seu vídeo més exitós a 5 idiomes nous per arribar a una audiència global, triplicant el seu potencial de visualitzacions. |

| Campanyes publicitàries multilingües | ROI augmentat | Una marca D2C crea 10 versions localitzades d'un sol anunci per a diferents països, millorant la rellevància i taxes de conversió dels anuncis. |

| Influencers IA i avatars | Escalabilitat de contingut | Una empresa utilitza la seva mascota animada per crear actualitzacions diàries de xarxes socials sense necessitar un equip de vídeo per a cada publicació. |

| Correccions de postproducció | Estalvi de temps i costos | Un cineasta corregeix una línia mal dita en una escena clau sense regravar, estalviant milers de dòlars. |

Això no és només una millora menor: és un canvi fonamental en com es fan els vídeos.

El mercat de doblatge de vídeo amb IA va ser valorat en $31.5 million el 2024 i s'espera que dispari fins a $397 million el 2032. Aquest creixement explosiu es deu a l'increïble estalvi de temps i diners que proporciona. Una campanya multilingüe que abans demanava un pressupost enorme i mesos de treball ara es pot girar en menys d'una setmana per menys de $2,000, posant un abast global a les mans dels creadors individuals. Pots aprendre més sobre l'economia evolutiva de la tecnologia de lip sync IA i veure com està canviant tota l'economia dels creadors.

Com triar la eina de Lip Sync AI adequada

Amb una allau de noves eines entrant al mercat, triar el lip sync AI adequat pot semblar un tret a les fosques. Però no totes les plataformes estan construïdes igual, i la tria equivocada pot deixar-te amb vídeos robòtics i estranys que espanten els espectadors en lloc d'atreure'ls. Necessites una llista de verificació senzilla per tallar el fluff de màrqueting.

El factor absolutament número u és la qualitat de la sincronització en si. El vídeo final sembla natural, o cau en aquella vall escalofriadora de "uncanny valley"? Una gran eina entén els moviments petits i subtils d'una boca real: com es forma al voltant de diferents sons i es connecta amb l'expressió del parlant.

Una IA barata o mal entrenada pot només obrir i tancar la boca, cosa que és una pista immediata que alguna cosa és falsa. La millor manera de jutjar-ho és agafar el mateix clip curt d'àudio i passar-lo per diverses eines. Posar els resultats l'un al costat de l'altre i confiar en el teu instint.

Avaluant característiques clau i rendiment

Més enllà del realisme pur, has de pensar en les teves necessitats creatives específiques. L'eina perfecta per un formador corporatiu multilingüe probablement és excessiva per a un creador de memes. Clavar el teu procés d'avaluació des del principi t'estalviarà molts maldecaps més endavant.

Aquí tens les coses essencials a buscar:

- Suport d'idiomes i accents: Això és un trencaclosques si intentes arribar a una audiència global. Averigua quants idiomes suporta l'eina i, igual d'important, com maneja diferents accents i dialectes. Una eina que pot clavar un accent de Glasgow és molt més impressionant que una que només funciona amb una veu genèrica i robòtica.

- Velocitat de processament: Quant temps estaràs mirant una barra de progrés per un clip d'un minut? En el món del contingut de format curt, la velocitat ho és tot. Algunes plataformes poden girar un vídeo en minuts, mentre que altres et faran esperar una eternitat.

- Facilitat d'ús: Una eina amb un milió de funcions no val res si la interfície és una pesadilla. Busca un disseny net i senzill que et permeti pujar el teu vídeo i àudio, i aplicar el lip sync en només uns clics. Plataformes com ShortGenius aspiren a fer aquest pas una part sense costures d'un pipeline de creació de vídeo molt més gran.

L'objectiu final és trobar una solució que s'ajusti al teu procés existent sense crear nous obstacles. L'eina adequada hauria de semblar una extensió del teu kit d'eines creatives, no un altre tros de software complicat que has d'aprendre.

Considerant integració i tendències de mercat

Finalment, pensa en el panorama general. Com s'ajusta aquest lip sync AI al teu flux de treball? Funciona bé amb els editors de vídeo que ja t'agraden? Pot manejar els formats i resolucions de vídeo que necessites? Una integració suau és tan crítica com el rendiment tècnic.

El creixement explosiu en aquest espai t'ho diu tot. El mercat de l'IA en mitjans, que inclou tecnologia de lip-sync, s'espera que s'inflacion des de USD 8.21 billion el 2024 fins a USD 51.08 billion el 2030. Aquest tipus d'expansió ràpida significa que l'IA audiovisual sofisticada es converteix ràpidament en una part central de qualsevol estratègia de contingut moderna. Pots obtenir més detalls sobre el mercat de mitjans IA a datainsightsmarket.com.

Triant una eina ben suportada i que millora constantment, no només resols un problema per avui: estàs invertint en la teva capacitat de crear contingut impressionant durant anys.

Una guia pas a pas per al teu primer vídeo de Lip Sync

D'acord, anem a posar-nos mans a l'obra. Fer el teu primer vídeo amb lip sync AI no és tan complicat com sona. El podem desglossar en un procés senzill de quatre passos que et porta d'una idea rudimentària a un vídeo acabat llest per compartir.

Aquest és el flux de treball bàsic que trobaràs en plataformes com ShortGenius, que posa aquesta tecnologia potent just als teus dits.

Pas 1: Prepara la teva pista d'àudio

Tot comença amb l'àudio. Pensa-hi com el pla del teu vídeo: l'IA necessita una pista neta i clara per descobrir quines formes de boca crear. Pots gravar la teva pròpia veu o utilitzar un generador de text-to-speech de qualitat per a una narració consistentment nítida.

Per al millor resultat, assegura't que el teu àudio tingui poc o cap soroll de fons. Parlar clarament també marca una gran diferència. Quant més distinctes siguin les teves paraules, millor l'IA podrà adaptar els moviments dels llavis. Encertar aquest primer pas et prepara per a un resultat molt més creïble.

Pas 2: Selecciona el teu vídeo o avatar

Següent, has d'escollir qui (o què) farà la parla. Pot ser un clip de vídeo que ja tens d'algú parlant o fins i tot només una imatge estàtica d'un avatar IA que has creat. La clau aquí és una visió clara de la cara.

Aquí tens un consell pro: Un angle frontal directe funciona millor. L'IA necessita una vista directa i sense obstruccions de la boca per generar moviments realistes. Si la cara està girada o alguna cosa bloqueja la vista, l'animació final semblarà una mica estranya.

La qualitat dels teus inputs determina directament la qualitat de la teva sortida. Un vídeo nitid i ben il·luminat i un àudio net proporcionen a l'IA el millor material possible per treballar, minimitzant errors i assegurant un resultat més viu.

Pas 3: Aplica el Lip Sync AI

Aquí és on comença la diversió real, i normalment només és qüestió de fer clic en un botó. Un cop hagis pujat els teus fitxers d'àudio i vídeo a l'eina, només aplica la funció de lip sync. L'IA llavors es posa a treballar, descomponen els sons del teu àudio i creant nous moviments de boca al teu subjecte de vídeo per adaptar-se.

Tot el procés és sorprenentment ràpid, sovint prenent només uns minuts. Mentre l'IA fa el treball pesat, pots preparar-te per l'últim i més important pas.

Pas 4: Revisa i refina la sortida

Cap IA ho encerta perfecte cada vegada, així que una verificació final és crucial. Mira el vídeo generat i presta atenció al temps. La sincronització sembla natural? Hi ha algun tic estrany o moments on els llavis no s'adapten bé a l'àudio?

La majoria d'eines bones et donen opcions per fer petits ajustos. De vegades, només desplaçar lleugerament el temps d'àudio o tornar a executar una secció específica pot suavitzar qualsevol problema. Un cop estiguis satisfet, el teu vídeo està llest per exportar. Aquest procés sencer és una part central de molts fluxos de treball de vídeo IA, i pots veure com s'ajusta al panorama general llegint la nostra guia sobre models IA text-to-video.

Tens preguntes sobre Lip Sync AI? Tenim respostes.

Saltar a qualsevol nova tecnologia porta algunes preguntes. És completament normal. Anem a tractar algunes de les més comunes que sento de creadors sobre el lip sync AI perquè puguis anar directament a fer gran contingut.

Com maneja el Lip Sync AI diferents idiomes?

Aquesta és grossa. La bona notícia és que la majoria de models IA de primer nivell estan entrenats amb conjunts de dades gegants plens d'hores innombrables de parla multilingüe. Això significa que són sorprenentment hàbils no només amb diferents idiomes, sinó també amb diferents accents. No es tracta només de paraules; tracta d'aprendre les formes específiques de boca —el terme tècnic és visemes— que van amb cada so únic.

És clar, no totes les eines estan construïdes igual. Trobaràs que el rendiment pot variar realment d'una plataforma a una altra, per això sempre recomano executar un clip curt de prova en el teu idioma objectiu abans de comprometre't amb un gran projecte. Els millors sistemes capturaran aquestes nuances subtils, fent que el parlant sembli natiu, en lloc d'aplicar un moviment de boca genèric "one-size-fits-all" que simplement sembla estrany.

Quina és la diferència entre Lip Sync i doblatge?

És fàcil barrejar aquests dos, però realment són dues cares de la mateixa moneda, treballant junts per fer que un vídeo sembli autèntic en un nou idioma.

Pensa-ho així:

- Doblatge de vídeo: Això tracta de l'àudio. És el procés de canviar la pista de veu original per una nova, normalment en un altre idioma.

- Lip Sync: Això és el seguiment visual. Un cop posada la nova àudio, l'IA es posa a treballar, alterant digitalment els moviments de boca del parlant per adaptar-se perfectament al nou diàleg.

Quan els combines, obtens un vídeo completament localitzat. El so és correcte i els visuals s'adapten. Un maneja el que sents, l'altre maneja el que veus.

Aquest cop d'un-dos és el que permet a un creador prendre un sol vídeo i fer-lo semblar natiu per a audiències qualsevol lloc del món, sense aquella sensació distractor d'estar desfasat que immediatament treu l'espectador de l'experiència.

Com puc evitar l'efecte escalofriant de "Uncanny Valley"?

Ah, la "uncanny valley". És aquella sensació estranya i inquietant quan alguna cosa sembla gairebé humana, però uns quants detalls subtils no estan del tot bé. És una preocupació real amb el lip sync AI, però pots evitar-la absolutament.

Primer, sempre comença amb material font d'alta qualitat. Un vídeo nitid i ben il·luminat o un avatar polit dóna a l'IA un llenç molt més net per treballar. Si li dones material borros o de baixa resolució, pràcticament estàs demanant un resultat estrany.

Segon, centra't en la qualitat del teu àudio. Utilitza una veu IA d'alta qualitat que soni natural, o millor encara, una gravació neta d'un actor de veu humà. Una veu robòtica i plana combinada amb moviments de llavis realistes és una recepta per a una escalfor instantània.

Finalment, recorda afegir aquells tocs humans subtils. Una escena generada per IA pot semblar una mica estèril per si sola. Afegir coses petites com moviments naturals de cap, parpelleigs realistes o fins i tot un fons interessant pot fer que tot el vídeo sembli més arrelat i viu, traient-lo directament de la uncanny valley.

Llist per crear vídeos multilingües impressionants sense molèsties? ShortGenius integra capacitats potents de lip sync IA en un flux de treball complet de creació de vídeo. Produïu anuncis professionals i contingut social en minuts. Comença a crear gratis a shortgenius.com.