En skaberens guide til at mestre Lip Sync AI

Opdag, hvordan lip sync AI forvandler videooprettelse. Lær, hvad det er, hvordan det virker, og hvordan du bruger det til at skabe perfekt dubbet indhold til et globalt publikum.

Har du nogensinde drømt om at tale ethvert sprog i dine videoer, med din mund der perfekt matcher hvert eneste ord, selvom du ikke kender sproget? Det er præcis hvad lip-sync AI gør muligt. I kernen tager denne teknologi en separat lydspor og animerer automatisk en persons mund – eller en avatars – for at synkronisere perfekt med det.

Det er ikke bare et fedt festkneb; det er et kæmpe spring fremad, der gør indholdsoprettelse og lokalisering tilgængelig for alle.

Hvorfor Lip Sync AI betyder noget for skabere

Tænk på lip-sync AI som en digital marionetspiller for dine videoer. I lang tid har realistisk læbesynkronisering kun været noget, som high-budget-filmstudier med dedikerede VFX-hold kunne klare. Det betød at animere mundbevægelser frame for frame på en besværlig måde. Nu er den samme kraft i hænderne på skabere overalt, og det ændrer fuldstændig, hvordan videoer laves til platforme som YouTube, TikTok og Instagram.

Det primære job for denne AI er at lukke kløften mellem det, du ser, og det, du hører, og skabe en helt sømløs og overbevisende oplevelse for seeren. Glem de gamle, klodsede dobninger, hvor lyden er smertefuldt ude af synk. Denne teknologi sikrer, at en talers mund bevæger sig i perfekt harmoni med en ny lydspor, uanset om det er et andet sprog, en genindspillet voiceover eller endda et script læst af en AI-stemme.

Udvid din rækkevidde og spar tid

Påvirkningen på indholdsskabere er enorm. Du er ikke længere begrænset til dit modersmål eller fast i besværet med dyre genoptagelser bare for at rette en lille lydfejl.

Denne teknologi giver dig kraften til at:

- Knuse sprogbarrierer: Dub dine videoer øjeblikkeligt til flere sprog. Du kan åbne dit indhold op for massive internationale publikum uden nogensinde at skulle tale et ord spansk, japansk eller hindi.

- Skalér indhold uden besvær: Tag én video og genbrug den til forskellige globale markeder. Alt, du skal gøre, er at skifte lydfilen, og lad AI'en håndtere resten.

- Løft produktionsværdien: Skab professionelt lydende voiceovers til dine annoncer eller sociale medie-videoer og sørg for, at dit on-screen talent eller avatar ser helt naturligt og autentisk ud.

Det er ikke bare en teknisk nyhed; det er en strategisk fordel. Lip sync AI gør det muligt for solo-skabere og små teams at konkurrere globalt og producere flersproget indhold, der tidligere kun var muligt for store medievirksomheder.

I sidste ende handler dette værktøj om at arbejde smartere, ikke hårdere. Ved at automatisere det, der tidligere var en udmattende post-produktionsopgave, frigør det dig til at fokusere på det, du er bedst til: at komme med gode idéer. For at se det store billede hjælper det at forstå den bredere verden af AI Powered Content Creation og hvordan værktøjer som dette omskaber hele branchen. Lip-sync AI er et nøgleelement i det puslespil og giver dig muligheden for at forbinde med flere mennesker på en meget mere autentisk måde.

Hvordan Lip Sync AI egentlig fungerer

Har du nogensinde undret dig over, hvad der foregår under hætten i en lip-sync AI? Det er ikke bare et digitalt dukketeater, der bevæger en mund op og ned. Tænk på det mere som en sofistikeret oversættelsestjeneste, men i stedet for at konvertere ord fra ét sprog til et andet oversætter den lyde til utroligt præcise ansigtsbevægelser.

Lad os bruge en analogi. Hvis du skulle lære en robot at tale, ville du ikke bare vise det alfabetet. Du ville lære det, hvordan hvert bogstav lyder. Lip-sync AI gør noget meget lignende ved at nedbryde dit lydspor i de mindste lydeneheter, som kaldes fonemer. For eksempel nedbrydes ordet "hello" i distinkte lyde som "h", "eh", "l" og "ow".

Når AI'en har identificeret disse fonemer, går den i gang med sin hovedopgave: at kortlægge hver lyd til den præcise mundform, en person laver, når de siger det. Disse visuelle mundformer kaldes visemer. AI'en er trænet på bjerge af data, så den ved instinktivt, at "f"-lyden betyder, at de øverste tænder skal røre underlæben. Det er en lynhurtig oversættelse fra lyd til visuel.

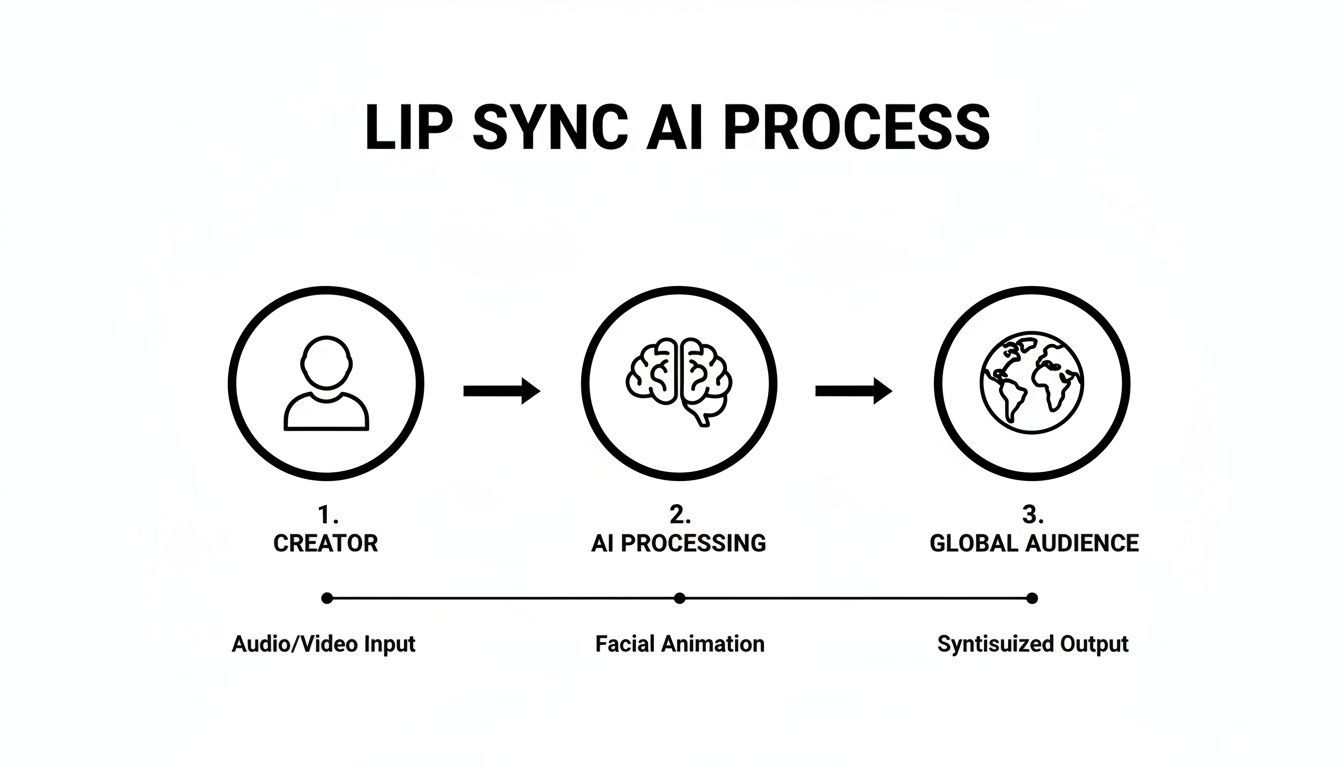

Dette diagram bryder ned, hvordan et stykke indhold går fra en simpel optagelse fra din side til en video, der er klar til et globalt publikum.

Som du kan se, leverer skaberen de rå materialer, AI'en gør det tunge løft, og resultatet er poleret indhold, der forbinder med seere overalt.

De to kerneingredienser

For at udføre denne digitale magi har AI'en kun brug for to ting fra dig. Denne enkelhed er en stor del af, hvad der gør værktøjer som ShortGenius så nyttige for skabere, der skal arbejde hurtigt.

- Lydfilen: Dette er dit blåtryk. Det kan være en voiceover, du lige har optaget, en professionelt dubbet lydspor til et nyt sprog eller enhver anden optagelse af en person, der taler. Jo renere lyden er, desto bedre. Klar, tydelig tale giver AI'en et meget lettere sæt fonemer at arbejde med, hvilket altid fører til et mere præcist og overbevisende resultat.

- Videoen eller avatar: Dette er dit lærred. Du kan bruge en video af en rigtig person eller endda et statisk billede af en AI-genereret avatar. AI'en bruger dette visuelle grundlag til at generere og overlejre de nye, perfekt synkroniserede mundbevægelser.

Men moderne deep learning-algoritmer stopper ikke der. De går et skridt videre ved at analysere nuancerne i lyden – tonen, følelsen, endda talerens hastighed. Dette hjælper med at gøre den endelige animation meget mere naturlig. I hjertet handler lip-sync AI om den ekspertise at sync audio video så sømløst, at seeren aldrig tænker over det.

Bundlinjen er denne: Det handler ikke bare om at bevæge læber. Det er en dyb analyse af lyd, der oversætter tale til realistiske ansigtsudtryk og fanger de små detaljer, der gør en præstation føles ægte menneskelig.

Dette niveau af automatisering driver alvorlig branchevækst. Det globale marked for lip-sync-teknologi er på vej til at springe fra USD 1,12 milliarder i 2024 til et estimeret USD 5,76 milliarder inden 2034. Fakta om, at audio-drevet machine learning allerede ejer en 40,7% markedsandel, viser, hvor vital denne tech er blevet for at tage indhold globalt.

Denne samme teknologi er en nøgleingrediens i mange AI-video-værktøjer. Det er det, der tillader en skaber at forvandle et enkelt stillbillede til en overbevisende, dynamisk video. Du kan dykke dybere ned i, hvordan det fungerer, ved at tjekke vores guide om, hvordan du transformerer billeder til video med AI.

Praktiske anvendelser for skabere og marketere

At kende de tekniske detaljer om lip sync AI er én ting, men den ægte magi sker, når du ser, hvordan det åbner nye kreative og forretningsdøre. For skabere og marketere er dette ikke bare en nyhed; det er et seriøst værktøj til at skalere indhold, trænge ind på nye markeder og virkelig forbinde med publikum rundt om i verden.

Det mest oplagte og kraftfulde brugstilfælde er indholdslokalisering. Lad os sige, du har en TikTok, der går viralt, eller en YouTube-tutorial, du har lagt sjæl i. I stedet for at være begrænset til kun engelsktalende, kan du nu skabe versioner til spanske, hindi- eller japanske publikum næsten øjeblikkeligt. AI'en smider ikke bare en ny lydspor på – den reanimerer omhyggeligt dine læbebevægelser for at matche det nye sprog og gør den endelige video helt naturlig.

Dette skriver fuldstændig om på strategien for global udvidelse. Den gamle måde at lokalisere en videokampagne involverede at hyre stemmeskuespillere til hvert sprog, booke dyr studietid og slæbe sig gennem uger eller måneder af post-produktion. Nu er hele workflowet hurtigere og langt mere overkommeligt.

Fra globale annoncer til AI-avatare

Ud over bare at oversætte videoer åbner lip sync AI en hel række strategier til at bygge brands og skabe overbevisende annoncer. I kernen udnytter hver applikation evnen til at adskille, hvad nogen siger, fra hvordan de ser ud, mens de siger det.

Her er nogle revolutionerende måder, denne teknologi bruges på lige nu:

- Skab engagerede AI-avatare: Du kan tage et enkelt billede – af et maskot, en grundlægger eller en virtuel influencer – og bringe det til live. Mat det bare med en text-to-speech-voiceover, og du har en uendelig forsyning af sociale medie-indhold uden, at nogen nogensinde skal foran et kamera.

- Lokalisér annoncekampagner: Et brand kan producere én fantastisk, high-budget-annonce og derefter bruge AI til at tilpasse den til dusinvis af internationale markeder. Dette holder brandinget konsistent, mens beskeden føles lokal og personlig. Denne tilgang er en redning for annonceplatforme, der kræver en konstant strøm af frisk kreativitet. Du kan se, hvordan det fungerer i en bredere strategi ved at tjekke vores guide til at skabe effektive AI UGC-style annoncer.

- Uanstrengte lydrettelser: Vi har alle været der. Du færdiggør en perfekt videoeditering, kun for at opdage en fejl i voiceoveren. I stedet for en frustrerende genoptagelse kan du bare optage den rettede lydlinje og lade AI'en sømløst patch den ind og matche dine læber perfekt.

Den ægte kraft her er at adskille det visuelle fra lyden. Dette giver skabere enorm fleksibilitet til at eksperimentere, rette fejl og tilpasse indhold til forskellige platforme og publikum uden at starte forfra hver gang.

For at vise, hvordan disse idéer bliver til virkelighed, her er en hurtig nedbrydning af, hvordan skabere og brands sætter lip sync AI i værk.

Lip Sync AI-anvendelser for skabere og brands

| Brugstilfælde | Primær fordel | Eksempel på anvendelse |

|---|---|---|

| Global indholdsfordeling | Publikumsvækst | En YouTuber oversætter deres topvideo til 5 nye sprog for at nå et globalt publikum og tredoble deres potentielle visninger. |

| Flersprogede annoncekampagner | Øget ROI | Et D2C-brand skaber 10 lokaliserede versioner af én annonce til forskellige lande og forbedrer annonce-relevans og konverteringsrater. |

| AI-influencere & avatare | Indholdsskalering | Et firma bruger sit animerede maskot til at skabe daglige sociale medie-opdateringer uden at have brug for et videoteam til hver post. |

| Post-produktionsrettelser | Tids- og omkostningsbesparelser | En filminstruktør retter en forkert udtalt linje i en afgørende scene uden genoptagelse og sparer tusindvis af dollars. |

Dette er ikke bare en mindre forbedring – det er en fundamental forandring i, hvordan videoer laves.

AI-video-dubbingsmarkedet blev værdsat til $31,5 millioner i 2024 og forventes at rocket til $397 millioner inden 2032. Denne eksplosive vækst skyldes den utrolige tid og penge, det sparer. En flersproget kampagne, der engang krævede et kæmpe budget og måneder af arbejde, kan nu vendes rundt på mindre end en uge for under $2.000 og sætte global rækkevidde i hænderne på solo-skabere. Du kan lære mere om den evoluerende økonomi i AI lip sync-teknologi og se, hvordan det ændrer hele skabereøkonomien.

Hvordan du vælger det rigtige Lip Sync AI-værktøj

Med en flod af nye værktøjer, der rammer markedet, kan det føles som at skyde i blinde at vælge det rigtige lip sync AI. Men ikke alle platforme er bygget ens, og det forkerte valg kan efterlade dig med robotagtige, akavede videoer, der afskrækker seere i stedet for at engagere dem. Du har brug for en simpel tjekliste til at skære gennem marketing-fluffet.

Det absolut vigtigste faktor er kvaliteten af selve synkroniseringen. Ser den endelige video naturlig ud, eller falder den ned i det uhyggelige "uncanny valley"? Et godt værktøj forstår de små, subtile bevægelser i en rigtig mund – hvordan den formes omkring forskellige lyde og forbinder til talerens udtryk.

Et billigt eller dårligt trænet AI kan bare klappe munden op og ned, hvilket er en umiddelbar afsløring af, at noget er falsk. Den bedste måde at vurdere dette på er at tage det samme korte lydklip og køre det gennem et par forskellige værktøjer. Sammenlign resultaterne side om side og stol på din mavefornemmelse.

Evaluer nøglefunktioner og ydeevne

Ud over ren realisme skal du tænke på dine specifikke kreative behov. Det perfekte værktøj til en flersproget corporate-trainer er sandsynligvis overkill for en meme-skaber. At nagle din evalueringsproces fra starten vil spare dig for en verden af hovedpine senere.

Her er de essentielle ting at kigge efter:

- Sprog- og accentstøtte: Dette er et deal-breaker, hvis du vil nå et globalt publikum. Find ud af, hvor mange sprog værktøjet støtter, og lige så vigtigt, hvor godt det håndterer forskellige accenter og dialekter. Et værktøj, der kan nagle en glasgowsk accent, er meget mere imponerende end et, der kun virker med en generisk, robotagtig stemme.

- Behandlinghastighed: Hvor længe skal du stirre på en fremskridtsbjælke for et ett-minuts klip? I verden af short-form-indhold er hastighed alt. Nogle platforme kan vende en video på få minutter, mens andre lader dig vente i evigheder.

- Brugervenlighed: Et værktøj med en million funktioner er værdiløst, hvis grænsefladen er et mareridt. Kig efter et rent, simpelt design, der lader dig uploade din video og lyd, og derefter anvende lip sync i bare få klik. Platforme som ShortGenius sigter mod at gøre dette skridt til en sømløs del af en meget større videoproduktionspipeline.

Det ultimative mål er at finde en løsning, der passer ind i din eksisterende proces uden at skabe nye flaskehalse. Det rigtige værktøj skal føles som en forlængelse af dit kreative værktøjssæt, ikke endnu et kompliceret stykke software, du skal lære.

Overvej integration og markedsudviklinger

Til sidst, tænk på det store billede. Hvordan passer dette lip sync AI ind i din workflow? Spiller det godt med de videoeditors, du allerede elsker? Kan det håndtere de videoformater og opløsninger, du har brug for? Sømløs integration er lige så kritisk som teknisk ydeevne.

Den eksplosive vækst i dette område siger alt, du behøver at vide. Markedet for AI i medier, som inkluderer lip-sync-tech, forventes at svulme fra USD 8,21 milliarder i 2024 til USD 51,08 milliarder inden 2030. Den slags hurtig udvidelse betyder, at sofistikeret audio-visuel AI hurtigt bliver til en kerne-del af enhver moderne indholdsstrategi. Du kan få flere detaljer om AI-mediemarkedet på datainsightsmarket.com.

Ved at vælge et værktøj, der er godt understøttet og konstant bliver bedre, løser du ikke bare et problem for i dag – du investerer i din evne til at skabe fantastisk indhold i årevis frem.

En trin-for-trin-guide til din første Lip Sync-video

Okay, lad os blive grimme med det. At lave din første video med lip sync AI er ikke så kompliceret, som det lyder. Vi kan bryde det ned i en simpel, fire-trins proces, der tager dig fra en grov idé til en færdig video klar til at dele.

Dette er den grundlæggende workflow, du finder i platforme som ShortGenius, der placerer denne kraftfulde tech lige ved dine fingre.

Trin 1: Forbered dit lydspor

Alt starter med lyden. Tænk på det som blåtrykket for din video – AI'en har brug for en ren, klar bane for at finde ud af, hvilke mundformer den skal skabe. Du kan optage din egen stemme eller bruge en kvalitets text-to-speech-generator for en konsekvent klar fortælling.

For det bedste resultat skal du sørge for, at din lyd har lidt eller ingen baggrundsstøj. At tale tydeligt gør også en kæmpe forskel. Jo mere distinkte dine ord er, desto bedre kan AI'en matche læbebevægelserne. At få dette første trin rigtigt sætter dig op til et meget mere overbevisende resultat.

Trin 2: Vælg din video eller avatar

Næste op, skal du vælge, hvem (eller hvad) der skal tale. Dette kan være et videoklip, du allerede har, af nogen der taler, eller endda bare et statisk billede af en AI-avatar, du har skabt. Nøglen her er et klart billede af ansigtet.

Her er et pro-tip: En ligeud, forfra-vinkel fungerer bedst. AI'en har brug for en direkte, uhindret udsigt over munden for at generere realistiske bevægelser. Hvis ansigtet er vendt væk eller noget blokkerer udsigten, vil den endelige animation se en smule forkert ud.

Kvaliteten af dine inputs bestemmer direkte kvaliteten af dit output. Et skarpt, velbelyst video og ren lyd giver AI'en det bedst mulige materiale at arbejde med og minimerer fejl og sikrer et mere livagtigt resultat.

Trin 3: Anvend Lip Sync AI

Her starter den ægte sjov, og det er normalt bare et spørgsmål om at klikke på en knap. Når du har uploadet dine lyd- og videofiler til værktøjet, anvender du bare lip sync-funktionen. AI'en går derefter i gang med at nedbryde lyderne i din lyd og skabe helt nye mundbevægelser på dit videosubjekt for at matche.

Hele processen er overraskende hurtig og tager ofte bare få minutter. Mens AI'en gør det tunge løft, kan du forberede dig på det sidste og vigtigste trin.

Trin 4: Gennemse og forfin outputtet

Ingen AI får det perfekt hver gang, så en endelig tjek er afgørende. Se den genererede video og hold øje med timingen. Ser synkroniseringen naturlig ud? Er der nogen mærkelige ryk eller øjeblikke, hvor læberne ikke helt matcher lyden?

De fleste gode værktøjer giver dig muligheder for at lave små justeringer. Nogle gange kan det bare være at flytte lydtimingen en smule eller køre en specifik sektion igen for at glatte knuderne ud. Når du er tilfreds, er din video klar til eksport. Hele denne proces er en kerne-del af mange AI-video-workflows, og du kan se, hvordan det passer ind i det store billede ved at læse vores guide om text-to-video AI-modeller.

Har du spørgsmål om Lip Sync AI? Vi har svarene.

At hoppe ind i ny tech vækker altid nogle spørgsmål. Det er fuldstændig normalt. Lad os tage nogle af de mest almindelige, jeg hører fra skabere om lip sync AI, så du kan komme direkte til at lave fantastisk indhold.

Hvordan håndterer Lip Sync AI forskellige sprog?

Dette er et stort et. Den gode nyhed er, at de fleste topklasse AI-modeller er trænet på kæmpe datasæt fyldt med utallige timer flersproget tale. Det betyder, at de er overraskende dygtige til ikke kun at håndtere forskellige sprog, men også forskellige accenter. Det handler ikke bare om ord; det handler om at lære de specifikke mundformer – det tekniske udtryk er visemer – der hører til hver unik lyd.

Selvfølgelig er ikke alle værktøjer bygget ens. Du vil finde, at ydeevnen virkelig kan variere fra én platform til en anden, hvilket er grunden til, at jeg altid anbefaler at køre et kort testklip i dit målsprog, før du forpligter dig til et stort projekt. De bedste systemer fanger de subtile nuancer og gør taleren til en indfødt, i stedet for at anvende en generisk, "one-size-fits-all"-mundbevægelse, der bare føles forkert.

Hvad er forskellen på Lip Sync og dubbing?

Det er let at forveksle disse to, men de er virkelig to sider af samme mønt, der arbejder sammen for at gøre en video autentisk på et nyt sprog.

Tænk på det sådan her:

- Video dubbing: Dette handler om lyden. Det er processen med at skifte den originale stemmebane ud med en ny, normalt på et andet sprog.

- Lip Sync: Dette er den visuelle opfølgning. Når den nye lyd er lagt, går AI'en i gang med digitalt at ændre talerens mundbevægelser for perfekt at matche den nye dialog.

Når du kombinerer dem, får du en fuldstændig lokaliserede video. Lyden er rigtig, og det visuelle matcher. Den ene håndterer, hvad du hører, den anden håndterer, hvad du ser.

Denne one-two punch er det, der lader en skaber tage en enkelt video og gøre den føles indfødt for publikum overalt i verden uden den distraherende, ude af synk-følelse, der umiddelbart trækker en seer ud af oplevelsen.

Hvordan undgår jeg den uhyggelige "uncanny valley"-effekt?

Ah, "uncanny valley". Det er den mærkelige, urolige følelse, når noget ser næsten menneskeligt ud, men et par subtile ting bare ikke er helt rigtige. Det er en reel bekymring med lip sync AI, men du kan absolut undgå det.

Først og fremmest, start altid med høj kvalitet kilde-materiale. Et klart, velbelyst video eller en poleret avatar giver AI'en et meget renere lærred at arbejde med. Hvis du giver den uskarpt eller lavopløseligt optagelse, beder du praktisk talt om et mærkeligt resultat.

Næst, fokusér på din lydkvalitet. Brug en høj kvalitet AI-stemme, der lyder naturlig, eller bedre endnu, en ren optagelse af en menneskelig stemmeskuespiller. En robotagtig, flad stemme parret med realistiske læbebevægelser er en opskrift på øjeblikkelig uhyggelighed.

Til sidst, husk at tilføje de subtile menneskelige touch. En AI-genereret scene kan føles lidt steril alene. At tilføje små ting som naturlige hovedbevægelser, realistisk blinken eller endda bare en interessant baggrund kan gøre hele videoen mere jordet og levende og trække den lige ud af uncanny valley.

Klar til at skabe fantastiske, flersprogede videoer uden besvær? ShortGenius integrerer kraftfulde AI lip sync-funktioner i en komplet videoproduktionsworkflow. Producer professionelle annoncer og socialt indhold på minutter. Start med at skabe gratis på shortgenius.com.