Lås op for slående kvalitet: Upscale Video AI

Lær en praktisk arbejdsproces til at opskalere video med AI. Dæk forberedelse af optagelser, optimale indstillinger, batch-behandling og eksport til sociale medier med ShortGenius.

Du har et klip, der burde fungere.

Måske er det et gammelt klienttestimonial optaget på en telefon. Måske er det user-generated footage, der rammer følelsen perfekt, men ser blødt ud på en moderne skærm. Måske er det en tidligere topperformer, du vil reposte, beskjære og forvandle til friske short-form assets. Ideen er stærk. Kildefilen er det ikke.

Det er her, AI-videoopskalering stopper med at være en nysgerrighed og begynder at være et produktionsværktøj.

God AI-videoopskalering kan redde footage, du ellers ville smide væk. Dårlig AI-videoopskalering spilder timer, overdriver kompressionsstøj og giver ansigter det plastiske, overkogte udseende, som seere bemærker øjeblikkeligt. Forskellen handler om workflow. Kildekvalitet, modelvalg, batch-håndtering og eksportbeslutninger betyder mere end marketingpåstandene på et værktøjs hjemmeside.

Hvorfor AI-videoopskalering er en creators superpower

Low-resolution footage havde tidligere en hård loft. Du kunne forstørre det, men du kunne ikke rigtig forbedre det. Traditionel skalering strakte pixels. Det gjorde klip større, ikke bedre.

AI-videoopskalering fungerer anderledes. Den bruger deep learning til at rekonstruere detaljer, fortolke omgivende pixels og bevare bevægelse på tværs af frames. Den sidste del betyder noget. Et enkelt billede kan se skarpt ud og stadig fejle som video, hvis kanter shimmerer eller teksturer flimrer fra frame til frame.

Hvorfor creators bryder sig om det nu

Det er ikke længere en niche restoration-trick. AI Video Upscaling Software-markedet voksede fra $550 million USD i 2024 til $670 million USD i 2025 og forventes at nå $5 billion ved 2035 med en 22,3% CAGR, drevet af efterspørgsel efter 4K-levering og stærkere visuel kvalitet for engagement, ifølge Wise Guy Reports on the AI video upscaling software market.

Det stemmer overens med, hvad creators håndterer hver uge:

- Gammelt footage har stadig værdi: Tidligere interviews, webinars, demos og testimonials indeholder ofte idéer værd at genudgive.

- UGC er sjældent perfekt optaget: Store hooks kommer fra imperfecte klip.

- Alle platforme straffer blødhed: Beskæring, ændring af størrelse og rekomprimering af svagt footage gør fejl mere åbenbare.

Praktisk regel: Brug AI-opskalering til at genskabe stærkt indhold. Forvent ikke, at det redder svag cinematografi, misset fokus eller kraftig motion blur.

Der er også en bredere workflow-vinkel. Hvis du allerede forvandler ét asset til mange, bliver opskalering en del af repackaging, ikke kun reparation. Det er derfor, det passer naturligt sammen med AI content repurposing. Et enkelt low-res-kilde kan blive til shorts, square edits og refreshed reposts, hvis du renser kilden, før du ændrer størrelse og distribuerer den.

Hvad det er bedst til

AI-opskalering skinner i nogle specifikke situationer:

| Use case | Hvorfor det virker |

|---|---|

| Arkivklip | Det kan genskabe klarhed uden manuelt at genopbygge hvert shot |

| Screen recordings | Det hjælper tekstkanter og UI-elementer med at overleve kompression bedre |

| UGC til ads | Det hæver baseline-kvalitet før captions, branding og exports |

| Beskårne social edits | Ekstra resolution headroom hjælper, når du forvandler én master til flere formater |

Hvis du har brug for en hurtig opfriskning af, hvad higher-resolution delivery betyder i praksis, er denne gennemgang af https://shortgenius.com/blog/what-is-4-k-resolution nyttig, før du beslutter, om et klip fortjener en 4K-finish.

Forberedelse af kildefootage til fejlfri opskalering

Den største fejl med AI-videoopskalering er at fodre det med den værste fil, du har, og håbe, at modellen udfører magi.

Det gør den ikke.

Markedet bevæger sig hurtigt. Det bredere Video Enhancing AI Tool-marked forventes at nå $1.166 million USD ved 2032 med en 37,1% CAGR, drevet af deep learning-systemer, der leverer øjeblikkelige 2x til 4x resolution boosts, mens de reducerer båndbredde, ifølge Intel Market Research on the video enhancing AI tool market. Men bedre modeller annullerer ikke dårlige inputs.

Audit klippet, før du behandler det

Før jeg sætter noget i kø, tjekker jeg, om klippet er en god kandidat eller en fælde.

Brug denne korte audit:

- Kompressionsskade: Hvis du ser macroblocking, mosquito noise eller smeared detail, kan modellen behandle den skade som ægte tekstur.

- Motion blur: AI kan skærpe kanter, men det kan ikke genskabe detaljer, der aldrig eksisterede i frameet.

- Fokus: Let blødt kan være arbejdeligt. Misset fokus forbliver ofte misset.

- Frame stability: Skælvende klip er sværere at opskalere rent, især hvis baggrunden allerede falder fra hinanden.

- File lineage: Eksportér fra den nærmeste original, du kan finde. Upscalér ikke en fil, der allerede er blevet komprimeret flere gange.

Vælg den rigtige kilde, ikke bare den største kilde

Creators jager ofte resolution først. Det er bagvendt.

En renere 720p-master kan overgå en slidt 1080p-repost. Det, der betyder noget, er, om kilden bevarer ægte billedeinformation. Hvis du har valg, vælg filen med mindst rekomprimering og færrest edits bagt ind i den.

Hvis kilden allerede ser noisy, crunchy og ustabil ud i native størrelse, gør opskalering normalt de problemer lettere at se.

Hvad du skal rette, før opskalering

Lidt prep sparer masser af rerenders.

-

Trim klippet først

Behandl ikke dead air, false starts eller alternate takes, hvis du ikke bruger dem. -

Separat footage-typer

Talking head, gameplay, animation og screen capture opfører sig forskelligt. Batch dem ikke under ét preset. -

Håndter åbenlys cleanup tidligt

Hvis filen har brug for basic denoise eller deinterlacing, gør det før din upscale-pass. -

Kør et kort sample

Tag et krævende øjeblik fra klippet. Hurtig håndbevægelse, hår-detail, kamera-motion, fin tekst. Hvis samplet fejler, bliver den fulde render ikke bedre senere.

Dårlige kandidater til AI-opskalering

Nogle klip er ikke værd computen.

- Heavily filtered social downloads

- Tiny reposted memes

- Footage med alvorlig low-light breakup

- Klip, hvor ansigter allerede er forvrænget af kompression

Det lyder strengt, men det beskytter din tid. Det bedste workflow starter med udvælgelse, ikke software-indstillinger.

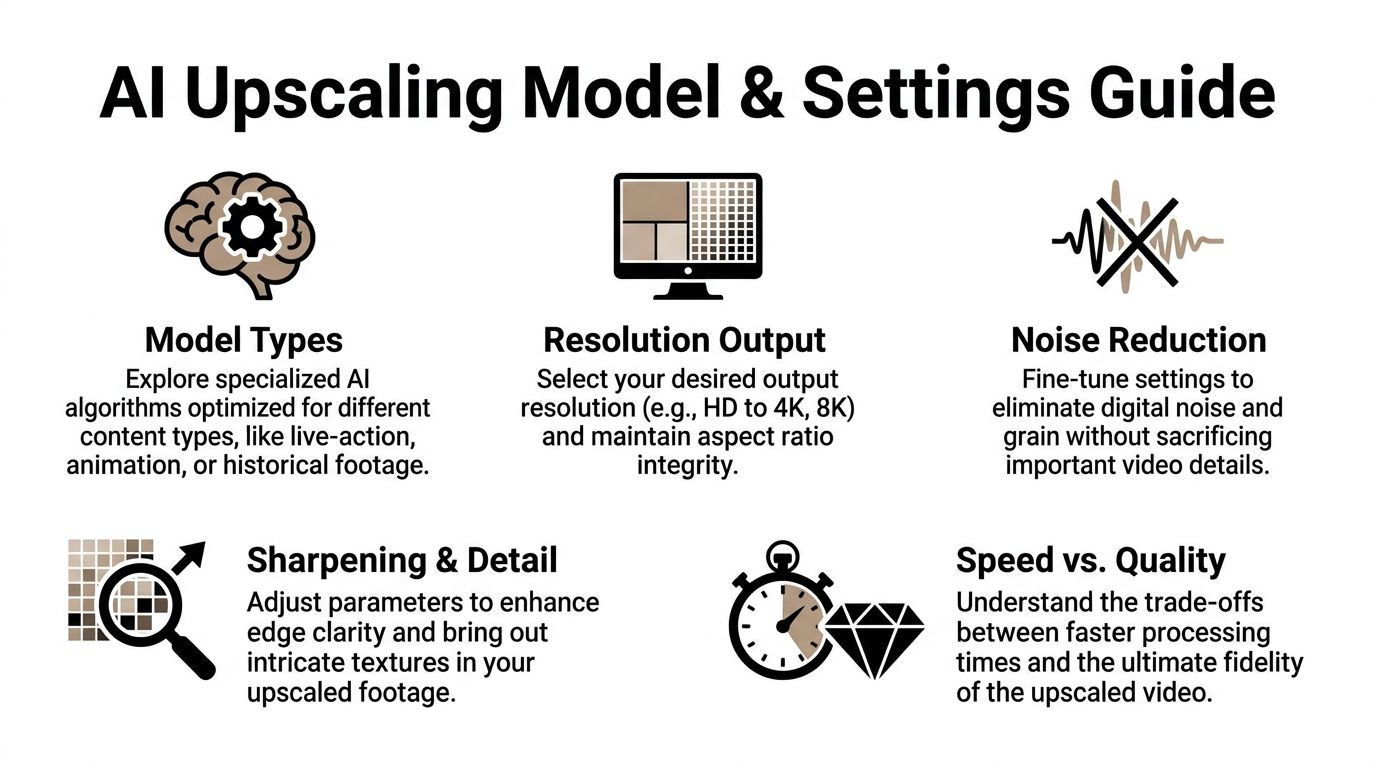

Vælg den rigtige AI-model og indstillinger

De fleste mislykkede upscales kommer fra samme vane. Folk loader et klip, vælger den højeste output, skubber sharpening for langt og antager, at mere processing betyder mere kvalitet.

Det gør det ikke.

Forskellige modeller laver forskellige trade-offs. Nogle bevarer realisme. Nogle finder mere tekstur op. Nogle opfører sig godt på animation og kæmper med hud. Nogle er stabile på tværs af motion. Andre producerer imponerende still frames og stygge temporal artifacts.

Et nyttigt benchmark ligger bag det hele. I AI-opskalering kan deep-learning-modeller som basicVSR++ opnå over 13% højere VMAF-scores end traditionel Lanczos, når de opskaleres fra 540p til 1080p, med PSNR-gevinster på 2-4dB, men hardware-grænser på consumer GPUs kan forårsage 50%+ fejlrate for 4K-klip længere end 2 minutter på grund af VRAM-mangel, som noteret af At Scale Conference coverage of on-device video playback upsampling.

Modelvalg starter med footage-type

En simpel måde at tænke på modeller:

| Footage-type | Hvad du skal prioritere | Almindelig fejlmode |

|---|---|---|

| Live action | Naturlig hud, stabil motion, tilbageholden sharpening | Waxy ansigter |

| Animation | Rene linjer, edge-konsistens | Haloing rundt om outlines |

| Gameplay | Motion-håndtering, tekst/UI-klarhed | Ghosting i hurtige scener |

| Arkivfootage | Konservativ rekonstruktion | Fake tekstur, der ændrer det originale look |

Hvis et værktøj tilbyder flere model-familier, brug ikke ét universal preset. Det er sådan, du får overskarpnede interviews og mudret animation i samme projektmappe.

For editors, der sammenligner værktøjer og workflows, før de forpligter sig til en stack, hjælper denne roundup af https://shortgenius.com/blog/bedste-ai-videoediteringssoftware med at ramme ind, hvor opskalering passer ind i en større edit-pipeline.

De indstillinger, der betyder mest

Mange UI-labels lyder tekniske, men opfører sig på forudsigelige måder.

Denoise

Brug denoise, når kilden har synligt støj, som modellen fortsat tager for detaljer. Brug mindre, end du tror, du har brug for.

For meget denoise fjerner tekstur fra hud, stof og baggrunde. Så prøver sharpening at genopbygge fake crispness ovenpå et fladt billede.

Deblock

Deblock hjælper, når du håndterer kompressionsskade. Det kan glatte stygge block-kanter ud, før upscale-modellen overdriver dem.

Det er nyttigt på downloadede klip og gamle exports. Det er farligt på footage, der allerede er rent, fordi det kan blødgøre kanter, du ville bevare.

Sharpen

Sharpen er, hvor renderen ofte bliver ødelagt.

Lidt sharpening kan genskabe edge-definition. For meget skaber halos, sprød hår og det syntetiske “AI enhanced”-look. Hvis et sample ser imponerende ud på pause, men stygt i motion, er sharpening ofte synderen.

Den rigtige sharpen-indstilling skal forsvinde i den endelige video. Hvis seere kan mærke processing, er det normalt for aggressivt.

Resolution-strategi slår brute force

At gå direkte til 4K er ofte det forkerte træk. Til social content kan 1080p eller et beskedent skridt op se renere ud end en større fil med opfundet detalje.

Her er den praktiske sammenligning:

| Tilgang | Fordel | Ulempe |

|---|---|---|

| Direkte spring til 4K | Maksimal output-størrelse | Mere hallucineret detalje, tungere renders |

| Skridt op til 1080p først | Bedre kontrol, lettere QA | Ekstra beslutningspunkt |

| Moderat upscale kun | Hurtigere, sikrere til social delivery | Mindre dramatisk before-and-after |

Den midterste sti vinder overraskende ofte. Du bevarer kontrol over tekstur og motion, og du undgår at bruge hele natten på at rendere en fil, der stadig bliver hårdt komprimeret ved upload.

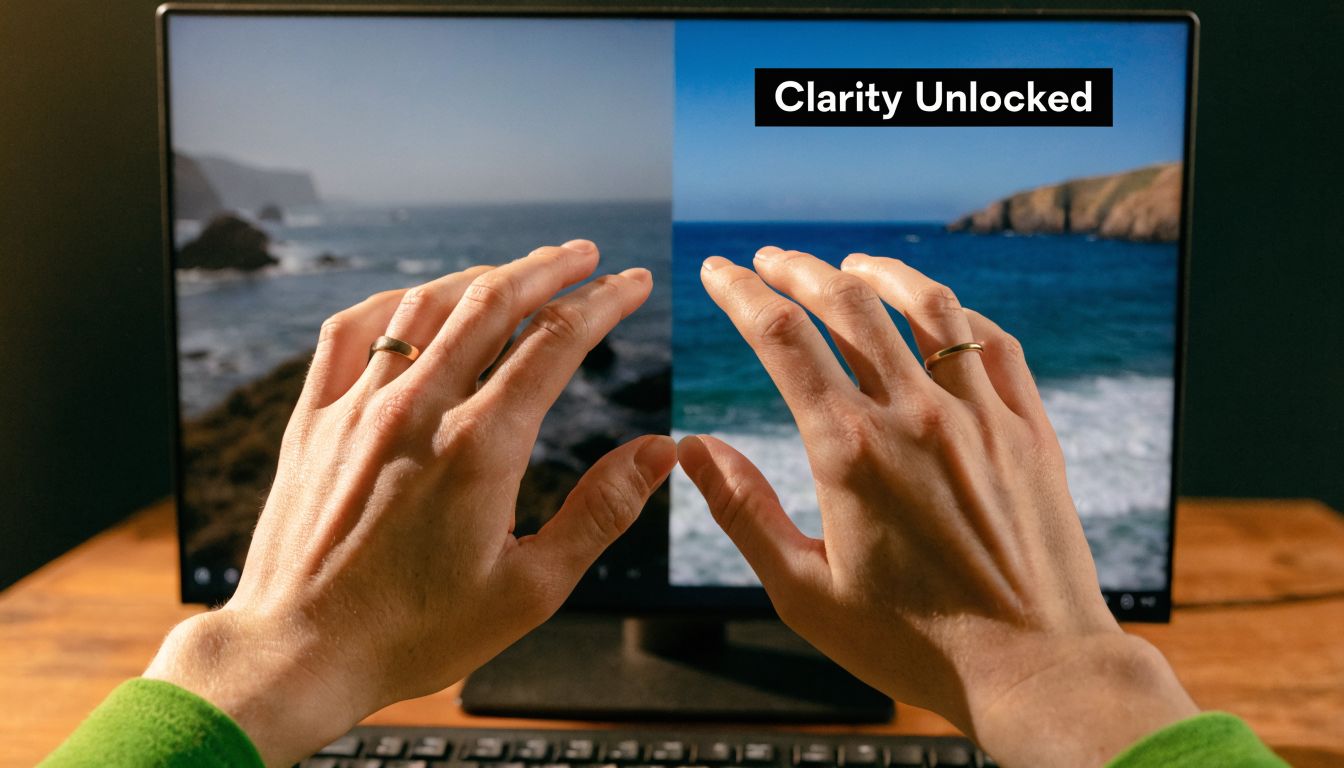

En hurtig visuel walkthrough hjælper, når du finjusterer dette:

Local versus cloud processing

Dette valg handler mindre om ideologi og mere om begrænsninger.

Local processing giver dig kontrol. Det binder også din maskine og afslører dine GPU-grænser hurtigt.

Cloud processing fjerner hardware-b bottlenecken, men du handler noget kontrol over timing, omkostningsstruktur og somme tider fine-grained indstillinger afhængig af platformen.

Vælg local, når:

- Du har brug for gentagne presets på en kendt maskine

- Du tester tungt

- Du vil have direkte oversight af hver pass

Vælg cloud, når:

- Din GPU fejler på længere klip

- Du har brug for team-adgang

- Du hellere vil fortsætte med at editere, mens renders sker et andet sted

Byg presets, så mistro dem

Presets sparer tid. Blind tillid ødelægger kvalitet.

Hold et par startpresets efter content-type, så test hver ny kilde med et kort segment, før du lancerer den fulde render. Ét preset til rent talking-head footage. Et andet til rough UGC. Et andet til animation eller screen recordings.

Den disciplin betyder mere end softwaremærket.

Mestre din batch-upscale workflow

Opskalering af ét klip er et eksperiment. Opskalering af tyve klip er operationer.

Mange creators spilder ofte tid. De behandler hver fil som et custom-job, babysitter exports og kører failed renders igen, fordi intet var organiseret fra starten. Et batch-workflow retter det.

Ifølge Audials guidance on beginner mistakes in AI video upscaling anbefaler eksperter at starte med high-quality, minimalt komprimeret video og teste inkrementelle resolution-springs som 720p til 1080p før 4K for at undgå unaturlige resultater og 4x længere render-tider. Den samme vejledning noterer, at aggressive modeller kan producere 20-30% artifact-rater i motion-tunge scener, der falder til mindre end 5% med et korrekt workflow.

Et local overnight-workflow

Til desktop-værktøjer er den sikreste opsætning kedelig med vilje.

-

Opret tre mapper

Brugsource,test-rendersogfinal-upscaled. Hold dem adskilt. -

Omdøb klip, før du sætter i kø

Tilføj platform- eller projekt-tags til filnavne, så du kan spore fejl hurtigt. -

Gruppér efter footage-opførsel

Bland ikke skælvende UGC med poleret studio-footage i ét batch-preset. -

Kør ét stress-test pr. gruppe

Vælg det sværeste klip i hver kategori. Hurtig motion, hår, tekst, crowd shots. Hvis det virker, følger de lettere klip normalt. -

Sæt fulde jobs i kø overnight

Lad maskinen rendere, når du ikke editor.

Et cloud batch-workflow

Cloud-workflows fungerer bedre, når du håndterer volumen, samarbejde eller en maskine, der ikke kan tage belastningen.

Processen er anderledes:

- Upload kun godkendte kilder: Brug ikke cloud som din sorteringsrum.

- Brug klare navnekonventioner: Versionsforvirring stiger hurtigt i delte projekter.

- Dokumentér presetten: I det øjeblik en god batch lander, gem den eksakte konfiguration.

- Tildel review-ejerskab: Nogen skal spot-check outputs, ikke bare bekræfte, at filer eksisterer.

Hvad du skal tjekke efter en batch-kørsel

En afsluttet render-kø er ikke det samme som en brugbar batch.

Review disse først:

| Tjek | Hvorfor det betyder noget |

|---|---|

| Motion-konsistens | Flicker gemmer sig ofte, indtil playback |

| Ansigt og hænder | Aggressive modeller fejler her først |

| Fin tekst og UI | Super til screen recordings, let at bryde |

| Frame rate-integritet | Mismatches skaber stutter ved export |

| Aspect ratio | Forkert håndtering forårsager awkward crops senere |

Batch-opskalering sparer kun tid, hvis din verifikationspass er hurtig og nådesløs.

Fejl, der ødelægger scale

De største fiaskoer kommer normalt fra process, ikke modelkvalitet.

- Ét preset til hvert klip: Hurtigt, men upålideligt.

- Ingen sample-render: Det er sådan, du vågner op til en mappe fuld af ubrugelige filer.

- Springer QC over, fordi thumbnails ser godt ud: Mange artifacts vises kun i playback.

- Opskalering efter flere edit-exports: Hver re-encode sænker dit loft.

For teams handler målet ikke kun om hurtigere processing. Det handler om forudsigelig processing. Et stabilt batch-system gør AI-videoopskalering til en del af regular production i stedet for en redningsmission hver gang et low-res-asset dukker op.

Post-upscale editing og smarte export-presets

En opskaleret fil er ikke en færdig fil.

Den er tættere på en restaureret negative. Du skal stadig forme den, tjekke den og eksportere den til stedet, den skal leve. Den sidste del betyder noget, fordi creators ofte jager resolution, mens de ignorerer delivery-betingelser.

ROI-spørgsmålet er ægte. Som Cloudinary’s guide to using AI to upscale video noterer, lover mange værktøjer 4K, men platforme som TikTok og Instagram Reels downscaler ofte content alligevel. Det rejser et praktisk spørgsmål for creators. Er en 4K-upscale gavnlig, eller ville en optimeret HD-export præstere lige så godt til mobile-first viewing?

Cleanup-pass betyder noget

AI-modeller introducerer ofte subtile problemer, der ikke viser sig i et side-om-side still-frame.

Almindelige inkluderer:

- Color drift: Hudtoner kan skifte let efter enhancement.

- Edge chatter: Fin detalje kan pulsere på tværs af motion.

- Texture-inkonsistens: Hår, stof og baggrunde kan skifte mellem skarpt og blødt.

Jeg behandler post-upscale editing som finishing-arbejde, ikke valgfri polish.

Rett farve, før export

Selv en let grade kan eniforme billedet. Match hudtoner, træk highlights tilbage, hvis opskaleringen gjorde dem sprøde, og sørg for, at blacks ikke er blevet crunchy.

Review motion i playback

Inspektér ikke kun frame grabs. Se klippet full screen, så igen på en telefon. Motion-problemer afslører sig i playback, ikke screenshots.

Hvis en upscale ser fantastisk ud pauset og mærkelig i bevægelse, er exporten ikke klar.

Smarte exports slår max-exports

Creators falder ofte tilbage på “highest quality available”. Det lyder sikkert, men det er ikke altid nyttigt.

Til short-form distribution, tænk i termer af platform fit:

| Destination | Bedre default-tankegang | Hvad du skal undgå |

|---|---|---|

| TikTok | Rent, stabilt HD-master | Store filer med marginal synlig gevinst |

| Instagram Reels | Stærk kompressionsmodstand | Over-sharpenede exports, der bryder efter upload |

| YouTube Shorts | Crisp tekst og stabil motion | Unødvendigt oversized renders, hvis kilde var svag |

Pointen er ikke, at 4K er dårligt. Pointen er, at 4K ikke automatisk er bedre til hver social upload.

En praktisk export-politik

Brug dette regel-sæt:

-

Exportér til platformen, ikke din stolthed

Seere bryder sig om klarhed og smoothhed mere end din render-indstillingmenu. -

Hold en high-quality archive-master

Gem en ren master til fremtidig genbrug, crops eller klient-levering. -

Opret platform-specifikke derivatives

Én archive-fil, så exports tunet til vertical, square eller horizontal behov. -

Tjek det uploadede resultat

Social platforme er en del af render-kæden. Din lokale export er ikke det endelige look.

Mange creators kompromitterer kvalitet ved export. De bruger tid på opskalering, så overlader det endelige resultat til platform-kompression uden strategi. Smarte export-presets beskytter det arbejde, du allerede har gjort.

Automatisering af opskalering i en ShortGenius-pipeline

Manuel opskalering fungerer, når du retter ét klip. Det bryder sammen, når du producerer social content hver uge på tværs af flere kanaler.

Det er bottlenecken for teams. Ifølge Perfect Corp coverage of AI video enhancer workflow limitations er den største udfordring at integrere opskalering i multi-channel workflows, fordi de fleste standalone-værktøjer mangler batch-processing i scale eller API-tilgængelighed. En unified publishing-pipeline betyder mere end endnu en isoleret enhancement-app.

Hvad automatisering egentlig skal gøre

En nyttig automatiseret pipeline tilføjer ikke bare “add upscale”.

Den skal håndtere en kæde som denne:

- Ingest kildeklippet

- Routér det efter content-type

- Anvend den rigtige enhancement-preset

- Send resultatet ind i editing

- Resize og package til hver kanal

- Planlæg distribution

Den struktur forvandler opskalering fra et repair-skridt til infrastruktur.

Hvor det passer ind i production

For short-form teams er det bedste indsætningspunkt normalt tidligt. Rens det visuelle asset, før captions, branding, reframing og exports.

Det betyder noget, fordi hvert senere skridt afhænger af, at kilden ser stabil ud. Hvis du tilføjer animerede captions, cut-ins og brand overlays på svagt footage først, så prøver at opskalere senere, tvinger du modellen til at fortolke design-elementer og kompressionsskade på samme tid.

En mere pålidelig rækkefølge er:

| Stadium | Bedre sekvens |

|---|---|

| Source-håndtering | Vælg og godkend raw-klip |

| Enhancement | Upscale og rens motion først |

| Edit-lag | Tilføj captions, trims, branding, voice |

| Distribution | Export pr. platform og publich |

Én platform-mention, brugt hvor det hører hjemme

I et unified workflow kan ShortGenius sidde i den produktionskæde som ét valg for teams, der vil have video-assembly, voiceovers, editing, resizing, scheduling og API-drevet automatisering i samme miljø. Den slags opsætning betyder noget, når du prøver at forvandle rough footage til repeatable output uden at bounce filer på tværs af separate apps. Hvis du bygger et bredere system omkring recurring channel-production, er denne guide til https://shortgenius.com/blog/youtube-automatisering-ai relevant, fordi automatisering kun virker, når hvert produktionsskridt forbinder rent.

Hvad der virker og hvad der ikke virker

Hvad virker

- Behandle opskalering som et preprocessing-stadium

- Gem presets efter footage-klasse

- Automatiser repetitive passes, ikke æstetisk dom

- Hold et human review-skridt før publish

Hvad der ikke virker

- Send hvert klip gennem samme enhancement-profil

- Automatiser uden QC-ejerskab

- Byg en pipeline, der kræver manuel file wrangling mellem værktøjer

- Antag, at AI-generated og organic footage opfører sig ens under upscale

Gevinsten er ikke kun bedre-lookende footage. Gevinsten er at fjerne endnu ét manuelt bottleneck fra content-production.

For agencies, brand-teams og high-volume creators er det den fundamentale skift. Opskalering stopper med at være en speciel fix for dårlige filer og bliver en standard baggrundsproces. Du genskaber mere brugbart footage, bruger mindre tid på repetitive cleanup og holder output-kvalitet konsistent på tværs af kanaler.

Hvis du vil forvandle dette workflow til et repeatable system, bringer ShortGenius (AI Video / AI Ad Generator) video creation, editing, resizing, voiceovers, scheduling og automated publishing ind i én platform, så opskalering kan passe ind i en bredere produktionspipeline i stedet for at leve som en one-off manuel opgave.