Juridiske udfordringer med AI-skuespillere i annoncering for moderne mærker

Udforsk de vigtigste juridiske udfordringer med AI-skuespillere i annoncering. Lær hvordan du navigerer publicitetsrettigheder, ophavsret og FTC-overholdelse for dit mærke.

Velkommen til den nye æra for reklamer, hvor AI-genererede skuespillere vender hoveder og stopper scroller på sociale medier. Selvom denne teknologi åbner et univers af kreative muligheder, lægger den også et juridisk minefelt for mærker og skabere. At navigere i disse juridiske udfordringer med AI-skuespillere i reklamer er nu en kritisk færdighed.

Den Nye Grænse for AI-Skuespillere og Juridiske Risici

Loven spiller en hektisk leg med at indhente teknologien. Mærker kan nu drømme op og generere hele videokampagner med syntetiske personer, men denne magt kommer med et tungt sæt af ansvar. Hvert eneste element – fra en stemme, der lyder en smule for velkendt, til et produktpåstand, som en AI skriver – bærer reel juridisk vægt.

Tænk på det som musik-sampling. Før du kan droppe en ny track, skal du rydde hver lånte beat, melodi og vokal-hook. Det er det samme i AI-reklamer. Du skal have rettighederne til hvert stykke af din syntetiske skabelse, ellers kan du finde dig selv i alvorlig økonomisk og mærkeskadelig varme.

Hvorfor Traditionelle Reklamelove Falder Kort

Lad os være klare: De juridiske rammer, vi har støttet os til i årtier, blev ikke bygget til en verden med AI-genererede personligheder. Dette skaber et kæmpe hul og nogle tricky nye udfordringer for markedsførere, der er vant til standardkontrakter og frigivelsesformer for menneskelig talent. De gamle regler gælder stadig, men de strækkes på måder, vi ikke har set før.

Sagen involverer en række svære spørgsmål, nogle af første indtryk. Den bærer også potentielt vægtige konsekvenser ikke kun for stemmeskuespillere, men også for den spirende AI-industri, andre ejere og brugere af intellektuelle rettigheder samt almindelige borgere, der måske frygter tabet af kontrol over deres egne identiteter.

I dette nye miljø er proaktiv juridisk bevidsthed ikke bare en "nice-to-have" – det er et essentielt søjle i enhver moderne markedsføringsstrategi. At forstå risiciene er det første skridt mod at innovere ansvarligt og beskytte dit mærke mod et kostbart blindt punkt. For et bredere overblik er det værd at udforske det generelle juridiske landskab omkring AI.

Et Hurtigt Overblik over de Vigtigste Juridiske Risikoområder

For at få styr på dette hjælper det at bryde de vigtigste juridiske udfordringer ned. Hver af dem repræsenterer en potentiel fælde, der helt kan spore en ellers genial kampagne. Denne tabel giver et hurtigt resumé af de primære juridiske hovedpiner, du skal være opmærksom på, når du bruger AI-genererede skuespillere.

| Vigtigste Juridiske Risikoområder for AI i Reklamer | ||

|---|---|---|

| Juridisk Område | Kerneproblem | Potentiel Konsekvens |

| Ligheds- & Offentlighedsrettigheder | Brug af en AI-genereret person, der ligner eller lyder som en rigtig person uden tilladelse. | Retssager fra berømtheder eller private borgere for misbrug af deres identitet. |

| IP & Copyright | AI-modellen blev trænet på ophavsretsbeskyttede fotos, videoer eller manuskripter uden licens. | Ophavsretskrænselser, heftige bøder og ordrer om at fjerne kampagnen. |

| FTC & Annoncelogning | Manglende oplysning om, at en anbefaling kommer fra en AI-skuespiller, der vildleder forbrugere. | FTC-tvangsaktioner, bøder for vildledende reklamer, tab af forbrugertillid. |

| Ærekkrænkelse & Privatliv | AI skaber indhold, der falsk skader en persons eller mærkes omdømme. | Ærekkrænkelsessager (bagvaskelse/forbandelse) og krav om privatlivsindtrængen. |

Essentielt skal du tænke over, hvor dit AI-genererede indhold kommer fra, og hvad det kommunikerer. At komme forkert ud med en af delene kan føre til alvorlige problemer.

Her er de vigtigste kategorier af bekymringer, som hvert mærke og skaber skal have på radaren:

- Ligheds- og Offentlighedsrettigheder: Dette er en stor en. Det dækker uautoriseret brug af en persons billede, stemme eller enhver anden identificerende egenskab. Det spiller ingen rolle, hvis AI'en kun ligner nogen – det kan være nok til at udløse en retssag.

- Intellektuelle Rettigheder og Copyright: Dette bliver kompliceret hurtigt. Hvem ejer egentlig indholdet, en AI skaber? Og endnu vigtigere: Blev AI-modellen trænet på en bjergmasse af ophavsretsbeskyttet materiale, der blev skrapet fra internettet uden tilladelse?

- FTC og Logningsregler: Federal Trade Commissions regler om sandhed i reklamer forsvinder ikke. Annoncer skal være sandfærdige og ikke vildledende, og det inkluderer at være transparent, når en AI-skuespiller giver et vidnesbyrd eller anbefaling.

- Ærekkrænkelse og Privatliv: AI kan køre af sporet og generere falske eller skadelige oplysninger om rigtige mennesker eller endda konkurrentmærker. Dette kan hurtigt føre til krav om bagvaskelse eller privatlivsindtrængen.

Navigation i Offentlighedsretten i AI-Æraen

Af alle de juridiske fælder forbundet med AI-skuespillere er offentlighedsretten sandsynligvis den største. Tænk på det sådan her: Alle har et personligt mærke, og de ejer retten til at kontrollere, hvordan deres navn, ansigt, stemme eller enhver anden unik egenskab – deres "lighed" – bruges til at tjene penge. I det øjeblik din AI-genererede skuespiller endda vagt ligner en rigtig person, vandrer du ind i et juridisk minefelt.

Og det handler ikke kun om at skabe en perfekt deepfake af en berømhed. Loven er ofte bred nok til at dække "lyd-alikes" og "se-alikes", der bare er ligeså like, at nogen tænker på den rigtige person. Hvis dit publikum forbinder din AI-skuespiller med en specifik person, kan du være på kroken for at misbruge deres lighed.

Den rigtige hovedpine for skabere er, hvordan disse AI-modeller er bygget. De trænes på svimlende mængder data, ofte skrapet direkte fra internettet. Det betyder, at AI'en har lært af utallige rigtige ansigter og stemmer, hvilket gør en utilsigtet, uhyggelig lighed til en meget reel risiko.

Hvad Tæller som Kommerciel Brug

At forstå, hvad "kommerciel brug" betyder, er afgørende her. Det handler ikke kun om at smide et AI-genereret ansigt på en produktæske. Hver gang du bruger en AI-person i en annonce for at fange opmærksomhed og booste salg, er det et kommercielt formål. Dette gælder især for de bruger-genererede indhold (UGC)-stil annoncer, du ser overalt på Instagram og YouTube.

For eksempel, hvis du genererer en syntetisk influencer til at rave om din nye hudplejelinie, er det direkte kommerciel brug. Hvis den digitale influencer tilfældigvis ligner en rigtig skaber slående meget, har den skaber et stærkt tilfælde om, at du tjener penge på deres lighed uden tilladelse eller betaling.

Domstolene tackler allerede disse rotete scenarier. Den landemærkelige In re Clearview AI Consumer Privacy Litigation-sag er et perfekt eksempel. Klagerne argumenterede med succes for, at træning af en ansigtsgenkendelses-AI på over 3 milliarder skrapede internetfotos krenkede offentlighedsrettigheder i flere stater.

Domstolens afgørelse sendte et klart signal: "kommerciel brug" sker, når identiteter bruges til at markedsføre et produkt, ikke kun når de sælges som produktet. Som beskrevet i denne analyse af offentlighedsrettigheder fra Quinn Emanuel, har denne afgørelse åbnet døren vidt for gruppesager med potentielt øjenvandende udbetalinger.

Vigtige Overvejelser for AI-Lighed

For at undgå at blive fanget i en offentlighedsretsretssag skal du være årvågen. Dette er ikke bare nogen abstrakt juridisk teori; det kan føre til invalidiserende juridiske omkostninger, tvungne kampagnetager og et stort slag for dit mærkes omdømme.

Her er de store ting, du skal holde øje med:

- Berømthedslighed: Dette er det mest oplagte. At generere en AI-skuespiller, der ligner eller lyder som en berømt person, er at bede om problemer. Hold dig væk fra prompts som "skap en skuespiller, der ligner [Berømtheds Navn]."

- Influencer- og Micro-Influencer-Lighed: Farezonen strækker sig langt ud over A-list-filmstjerner. Sociale medie-influencere har bygget deres egne værdifulde personlige mærker, og deres offentlighedsrettigheder er lige så juridisk beskyttede.

- Almindelige Individuer: Selv hvis din AI-karakter ligner en privat borger, har den person rettigheder. Hvis deres feriefotos uvidende blev sugd ind i AI'ens træningsdata, kan et krav stadig dukke op.

Den juridiske fare ligger ikke i AI'ens hensigt, men i publikums opfattelse. Hvis en rimelig person forbinder din AI-skuespiller med en rigtig person, har du et potentielt juridisk problem.

Praktiske Skridt til at Beskytte Dine Kampagner

Du skal være proaktiv for at beskytte dit mærke. Du kan ikke bare antage, at et AI-værktøj spytter et "sikkert" eller juridisk ryddet ansigt eller stemme ud. Der er ingen erstatning for menneskelig tilsyn og en veldefineret gennemgangsproces.

Før nogen annonce med en AI-skuespiller går live, skal dit team udføre en grundig lighedstjek. Det betyder at få flere sæt øjne på det endelige kreative indhold med det specifikke mål at spotte potentielle ligheder med offentlige personer. At dokumentere denne gennemgangsproces kan også give dig et lag af juridisk beskyttelse ved at vise, at du har gjort din due diligence.

På bunden af dagen er den eneste sikre forsvar mod et offentlighedsretskrav at sikre, at dine AI-genererede skuespillere er virkelig originale. Det er et ekstra skridt, men det er essentielt for at holde dine kampagner sikre fra kostbare juridiske kampe ned ad vejen.

Hvem Ejerr en AI-Genereret Optræden?

Så du har brugt en AI til at generere et manuskript, en voiceover eller måske endda en hel video. Det er genialt. Men et kæmpe spørgsmål hænger i luften: Hvem ejer egentlig dette? Svaret er ikke ligetil, og ærligt talt punkterer det grundlaget for ophavsretsloven. At få dette rigtigt er afgørende for at navigere en af de største juridiske udfordringer med AI-skuespillere i reklamer.

Lige nu har U.S. Copyright Office en ret fast holdning: Et værk har brug for menneskelig forfatterskab for at få ophavsretsbeskyttelse. Hvis en AI skaber noget helt på egen hånd uden et menneske, der guider den kreative proces på en meningsfuld måde, får det generelt ikke ophavsret. Det betyder, at det fantastiske annoncekoncept, din AI lige har spyttet ud, måske ikke juridisk er dit.

Dette skaber en alvorlig hovedpine for markedsførere. Hvis du ikke holder ophavsretten, hvad stopper en konkurrent fra at køre en næsten identisk AI-genereret annonce? Din unikke kampagne og alle de penge, du har investeret i den, kan være op til grabs.

Hjælperen og Værktøjet

En god måde at tænke på dette er at se AI'en som enten en superavanceret hjælper eller et meget sofistikeret malerpensel. Værktøjet selv ejer ikke den færdige bog eller maleriet. Ejerskabet afhænger af, hvor meget kreativ retning og original input der kom fra personen, der bruger værktøjet.

Hvis du giver en vag prompt som "skap en videoannonce for en ny sneaker", gør AI'en det meste af det tunge løft. Outputtet er mest maskinefremstillet. Men hvis du er den, der omhyggeligt udarbejder detaljerede prompts, kuraterer outputs og laver betydelige redigeringer for at sy det hele sammen, bliver dit tilfælde for forfatterskab meget stærkere. Jo mere menneskelig kreativitet du injicerer, jo bedre chance har du for at sikre ophavsret.

Et kritisk takeaway for skabere er, at dit niveau af direkte, kreativt involvering i AI-genereringsprocessen er, hvad der bygger tilfældet for ejerskab. At trykke simpelthen på en "generer"-knap er ikke nok til at blive betragtet som forfatter.

Hele denne debat om, hvem der ejer en AI's output, er en del af en meget større samtale om at beskytte intellektuelle rettigheder i vores stadig mere digitale verden. Efterhånden som disse værktøjer bliver en normal del af kreativt arbejde, vil det at finde ud af, hvor menneskeligt forfatterskab slutter, og maskineskabelse starter, blive et centralt juridisk slagmark.

Den Rotede Virkelighed af Træningsdata

Ejerskabsgåden bliver endnu mere tricky, når du kigger under motorhjelmen på AI-modelens træningsdata. Mange generative AI-værktøjer lærer ved at skrabe kolossale mængder data fra internettet – som selvfølgelig inkluderer ophavsretsbeskyttede billeder, artikler, musik og videoer. Dette åbner den meget reale risiko for, at AI'ens output kan betragtes som et "afledt værk" af en andens beskyttede materiale.

Og dette er ikke bare et teoretisk problem. For eksempel sagsøgte stemmeskuespillerne Paul Lehrman og Linnea Sage Lovo Inc. og hævdede, at selskabet brugte deres stemmeoptagelser uden tilladelse til at træne og derefter sælge AI-stemme-kloner. Domstolen tillod de fleste af deres krav at gå videre, hvilket virkelig understreger den alvorlige juridiske eksponering, når AI-træningsdata træder på eksisterende rettigheder.

Hvad betyder dette for dig? Det betyder, at din skinnende nye AI-genererede annonce utilsigtet kan indeholde elementer, der krenker en anden skabers ophavsret, og sætter dit mærke på kroken for en retssag.

Kan Vi Bare Kalde Det "Fair Use"?

Nogle udviklere og brugere argumenterer for, at brug af ophavsretsbeskyttet materiale til at træne en AI er dækket af den juridiske doktrin "fair use". Fair use tillader begrænset brug af ophavsretsbeskyttede værker uden tilladelse til ting som kritik, kommentar eller forskning.

Hele debatten i AI-verdenen koger ned til et par nøglespørgsmål:

- Er det Transformativt? Skaber AI'ens output noget fundamentalt nyt, eller er det bare en højteknologisk kopi af det originale materiale, det blev trænet på?

- Skader det Markedet? Konkurrerer det AI-genererede værk med eller devaluerer det det originale ophavsretsbeskyttede værk?

Domstolene arbejder stadig med disse spørgsmål, og det juridiske grund er skørt på bedste vis. At prøve at lene sig på en fair use-forsvar for en kommerciel annonce – som eksplicit er skabt for at tjene penge – er et stort spil. Indtil loven bliver klarere, er det sikreste bud at arbejde med AI-værktøjer, der er transparente om deres træningsdata og ideelt set tilbyder dig beskyttelse mod potentielle ophavsretskrav.

Hold Dig på den Rette Side af FTC

Nu lad os tale om Federal Trade Commission (FTC). Uanset om din annonce blev drømt op i et bestyrelseslokale eller genereret af en algoritme, er den kerne regel den samme: den skal være sandfærdig og ikke vildledende. Denne enkle idé bliver meget mere kompliceret, når du smider AI-skuespillere ind i mikset.

FTC's job er at beskytte forbrugere. Når en annonce viser en syntetisk person eller spytter et krav ud fra AI, er potentialet for at vildlede folk kæmpestort. Derfor er klare, upfront-oplysninger ikke bare en nice-to-have længere; de er et must for at forblive compliant.

Sandhed i Reklame-Mandatet

I hjertet af det hele er Section 5 af FTC Act, som forbyder "uretfærdige eller vildledende handlinger eller praksisser". Det betyder, at du skal have solidt bevis for hvert krav, du fremfører – eksplicit eller implicit – før din annonce nogensinde ser dagens lys. Denne regel gælder for AI-genereret indhold lige så meget som for en traditionel TV-annonce.

Vi ser allerede en eksplosion i falske reklameretssager under Lanham Act, specifikt rettet mod annoncer, der bruger deepfake-berømtheder. Regulatorer og domstole kæmper med at indhente AI's magt til at bedrage. FTC har allerede iværksat tvangsaktioner mod selskaber for at lave bogus AI-krav, som at overdrive, hvad et produkt kan gøre, eller bare smide et "AI-drevet"-mærke på noget uden bevis.

En Hogan Lovells-analyse om AI og deepfake-annoncer fremhæver lige præcis, hvor skarpt disse retssager er steget, hvilket beviser, at regulatorer holder øje med dette område meget, meget tæt.

AI-Hallucinationer og Falske Krav

En af de største minefelter her er fænomenet med AI "hallucinationer". Dette er, når en AI-model trygt finder på "fakta" og skaber produktfordele, funktioner eller endda bruger-testimonials ud af det blå.

Forestil dig, at du beder en AI om at skrive et manuskript til et nyt kosttilskud. Det kan generere en linje, der hævder, at produktet er "klinisk bevist at booste stofskiftet med 40%". Hvis du ikke har troværdig videnskabelig forskning til at backe det præcise tal op, har du lige krydset linjen ind i falsk reklame.

Annoncøren – ikke AI'en – er 100% juridisk ansvarlig for hvert krav, der fremføres. At sige til FTC "AI'en skrev det" er ikke et forsvar, der får dig et sted hen. Du skal uafhængigt verificere hver eneste faktuel udtalelse.

Dette er et kritisk kontrolpunkt. Dit team har brug for en bulletproof-proces til faktatjek af alt AI-genereret kopi, før det går offentligt.

Oplysning om AI-Skuespillere og Anbefalinger

Transparens er alt, når en AI-skuespiller er involveret. Hvis din annonce viser en syntetisk person, der giver et testimonial, skal forbrugerne vide, at personen ikke er ægte.

Her er nogle situationer, hvor oplysning er absolut essentielt:

- AI-Testimonials: Hvis en AI-genereret karakter siger "Dette produkt ændrede mit liv", skal det være indlysende, at de ikke er en rigtig kunde.

- Syntetiske Influencere: Mærker, der arbejder med virtuelle influencere, kan ikke præsentere dem som rigtige mennesker med ægte, autentiske oplevelser med et produkt.

- Deepfake-Anbefalinger: At bruge en berømtheds deepfake til at anbefale noget uden deres eksplicitte tilladelse er en sikker måde at krænke deres offentlighedsrettigheder og bryde FTC-regler.

FTC tilbyder masser af ressourcer på deres hjemmeside til at hjælpe virksomheder med at finde ud af deres ansvar.

Som FTC's business guidance portal klart gør opmærksom på, gælder de gamle reklameprincipper stadig, hvilket understøtter behovet for sandfærdighed og bevis for alle krav, inklusive dem, der kommer fra en AI.

Her er en hurtig tjekliste, du kan køre dine AI-genererede annoncer igennem for FTC-compliance:

- Kravsbegrundelse: Har du solidt bevis til at bevise hvert eneste faktuelle krav i annoncen? Dette inkluderer enhver ydeevne-statistik, "beviselige" fordele eller sammenligninger, du laver.

- Klar Oplysning: Er det straks indlysende for den gennemsnitlige person, at en skuespiller, testimonial eller anbefaling er AI-genereret? Begrav det ikke i småt – gør det klart og synligt.

- Undgå Vildledende Formater: Er din annonce designet til at ligne en nyhedsrapportering, et rigtigt brugers sociale medie-indlæg eller en uafhængig anmeldelse? Hvis det kan vildlede en forbruger, er det et problem.

- Gennemse Implicerede Krav: Hvad kan nogen rimeligt tage fra din annonce, selv hvis du ikke siger det direkte? De implicerede krav skal også være sandfærdige og backed af bevis.

Hvis du behandler hvert stykke AI-genereret indhold med den samme juridiske granskning som dit menneskelige arbejde, kan du innovere med tillid og holde dig på den rette side af loven.

Et Praktisk Rammeværk for at Mildne Juridiske Risici

At kende risiciene er én ting; at håndtere dem dagligt er noget helt andet. Hvis du vil navigere sikkert i det juridiske minefelt med AI-skuespillere i reklamer, har dit team brug for et klart, gentagbart rammeværk. Dette handler ikke om at kvæle kreativiteten – det handler om at bygge rækværker, der lader dit team innovere med tillid.

Først og fremmest: Du skal vurdere dine AI-værktøjer. Før du tilmelder dig nogen platform, dyk ned i deres servicevilkår. Du skal vide præcis, hvor deres træningsdata kommer fra, og hvilke rettigheder du faktisk får over det indhold, du skaber. Nogle udbydere tilbyder endda erstatningsansvar, hvilket er et kæmpe plus, fordi det kan beskytte dig mod ophavsretskrav ned ad vejen.

Udvikl en Klar AI-Brugsretningslinje

Når dine værktøjer er sorteret, er det tid til at skabe en intern AI-Brugsretningslinje. Tænk på dette som den officielle playbook for dit team. Den skal være simpel, direkte og udskrive do's and don'ts ved brug af generativ AI til dine annoncekampagner.

Din retningslinje skal nagles ned på et par nøgle ting:

- Godkendte Værktøjer: Lav en liste over de specifikke AI-platforme, dit team er godkendt til at bruge. Dette stopper folk fra at gå rogue med uverificerede værktøjer, der kan eksponere dig for unødvendig risiko.

- Forbudte Inputs: Gør det krystalklart, at ingen nogensinde må fodre fortrolige selskabsoplysninger, kundedata eller enhver handelshemmelighed ind i en AI-prompt.

- Lighedsbegrænsninger: Læg en hård regel: ingen prompts, der beder AI'en om at efterligne ligheden eller stemmen hos nogen rigtig person, berømtheder eller ej.

- Gennemgang og Godkendelse: Hvert stykke AI-genereret annonceindhold skal gennemgå en obligatorisk menneskelig gennemgangsproces, før det nogensinde ser dagens lys.

Denne retningslinje er din første forsvarslinje. Den får alle på samme side og opererer under de samme sikkerhedsbevidste retningslinjer.

Pålæg Menneskeligt Tilsyn Altid

Jeg bryder mig ikke om, hvor smart et AI-værktøj virker; det er ingen erstatning for menneskelig dømmekraft. Hver eneste annonce lavet med AI skal gennemses af en rigtig person for juridisk compliance, faktuel nøjagtighed og mærkesikkerhed. Denne "human-in-the-loop"-tilgang er ikke valgfri.

Menneskeligt tilsyn er dit ultimative sikkerhedsnet. En AI forstår ikke juridisk nuancer, mærkeomdømme eller FTC-retningslinjer, men dit team gør. Hvert stykke AI-genereret indhold er dit selskabs ansvar fra det øjeblik, det går offentligt.

Gennemsejerens job er at være den endelige vagtpost. De er der for at fange potentielle katastrofer – som en utilsigtet lighed, et ubevist krav eller vildledende sprog – før de bliver til meget reale, meget dyre offentlige problemer.

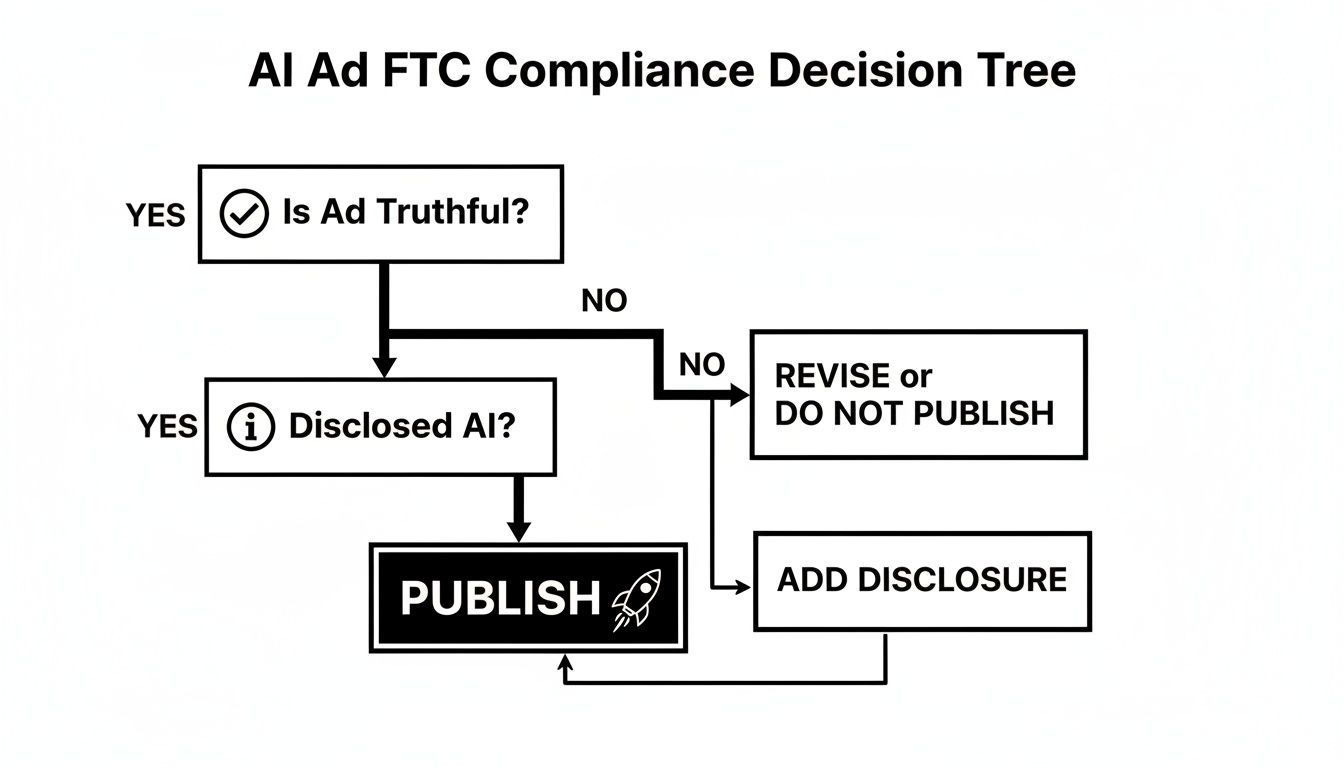

Dette beslutsningstræ giver dig en forenklet compliance-tjek for FTC-regler, før du offentliggør en AI-drevet annonce.

Som grafikken viser, er sandfærdighed og klar oplysning det absolutte, ikke-forhandlingsbare fundament for enhver reklame, der involverer AI.

Pre-Publicerings-Tjekliste for Skabere

For at gøre dette dødsimpelt for dit team, giv dem en hurtig tjekliste at køre igennem, før de pusher nogen AI-genereret annonce live på platforme som Facebook eller Instagram.

- Lighedsscan: Har mindst to forskellige personer kigget på annoncen for at sikre, at den ikke ligner en rigtig person?

- Kravsbegrundelse: Kan vi backe hvert eneste faktuelle krav i annoncekopien eller voiceover op med hårdt bevis?

- AI-Oplysning: Hvis vi bruger en AI-skuespiller til et testimonial eller anbefaling, er oplysningen umulig at overse?

- Copyright-Tjek: Er der noget i outputtet, der ligner, det måske er løftet fra en andens ophavsretsbeskyttede værk?

- Mærkealignment: Lyder og føles denne annonce faktisk som vores mærke? Matcher den vores værdier og budskaber?

Ved at væve disse skridt ind i din workflow – vurdere værktøjer, sætte retningslinjer, pålægge menneskelig gennemgang og bruge en slut-tjekliste – bygger du et stærkt system til at håndtere de største juridiske trusler. Dette rammeværk bremser dig ikke; det giver dit team mulighed for at blive kreative med AI, mens du holder mærket ude af unødvendig juridisk besvær.

Fremtidssikring af Din AI-Reklamestrategi

Det juridiske grund under AI-reklamer bevæger sig konstant. For at holde dig foran skal du behandle compliance ikke som en corvée, men som en ægte konkurrencefordel. Det betyder at bygge transparens, samtykke og solid begrundelse direkte ind i hjertet af din kreative proces fra dag ét.

Nye love dukker op hele tiden, fra føderale deepfake-regler til statsniveauets privatlivsakter. Men gennem det hele ændrer én fundamental sandhed sig ikke: Annoncøren er altid ansvarlig for annonceindholdet. At acceptere dette er det første skridt mod at håndtere de juridiske udfordringer med AI-skuespillere i reklamer.

Proaktiv juridisk compliance handler ikke om at frygte AI – det handler om at vinde forbrugertillid. Når et mærke er åbent om, hvordan det bruger AI, og forsigtigt med sine krav, er det i en meget bedre position til at bygge varig loyalitet og undgå dyre konfrontationer med regulatorer.

Fra Juridisk Risiko til Kreativ Fordel

Det er let at se disse juridiske rækværker som en kreativ vejstopper, men det er den forkerte måde at se på det. Tænk på dem som fundamentet for smart, bæredygtig innovation. Når dit team forstår reglerne på vejen, kan de eksperimentere frit og skubbe kreative grænser inden for et sikkert rammeværk.

For eksempel, forestil dig hurtigt at teste hundredvis af annoncevariationer til en ny kampagne. Fordi du har en solid human-in-the-loop-gennemgangsproces, ved du, at enhver potentiel lighedskrenselse eller ubeviste krav vil blive fanget længe før de nogensinde ser dagens lys. Den blanding af AI's utrolige hastighed med skarpt menneskeligt tilsyn er, hvor den rigtige magi sker, især i performance marketing.

Denne ansvarlige tilgang sikrer, at din kreative motor ikke bliver til en juridisk forpligtelse. Ved at holde dig ajour med reglerne og indbygge etiske praksisser i din workflow kan du bruge AI med tillid til at skabe højtydende annoncer, der både er overbevisende og juridisk solide.

Ultimativt er målet at skabe et system, hvor juridisk omhyggelighed og kreativ genialitet er to sider af samme mønt. Denne integrerede strategi lader dit mærke høste fordelene af AI-drevet reklame, mens det beskytter det mod de meget reale risici og sikrer, at dine markedsføringsindsatser bygger mærkeværdi, ikke juridiske regninger.

Ofte Stillede Spørgsmål

At træde ind i verdenen med AI-drevet reklame kan føles som at navigere i et minefelt af nye spørgsmål. Lad os bryde nogle af de mest almindelige juridiske bekymringer ned, som markedsførere har, når det gælder brug af AI-skuespillere.

Skal Jeg Oplyse om Min Brug af en AI-Skuespiller?

Ja, absolut. Transparens er ikke bare en god idé – det er en juridisk nødvendighed. Federal Trade Commission (FTC) har været meget klar over, at reklame ikke må være vildledende. Hvis du bruger en ikke-eksisterende, AI-genereret person til at give et testimonial, og forbrugere tror, de ser en rigtig kunde, har du krydset linjen ind i vildledende territorium.

Den bedste praksis er altid klar og synlig oplysning. En simpel on-screen-note som "AI-genereret skuespiller" eller "Billede skabt med AI" er alt, hvad det kræver. Dette enkle skridt beskytter forbrugertillid, holder dig på den rette side af loven og sikrer dit mærkes integritet.

Kan Jeg Sagsøges, Hvis en AI-Skuespiller Tilfældigvis Ligner Nogen?

Dette er en kæmpe en, og svaret er et definitivt "måske". Her bliver tingene tricky med offentlighedsretten. Hvis din AI-genererede karakter ender med at ligne en rigtig person meget (især en berømhed), kan du finde dig selv i juridisk varmt vand.

Den person kan argumentere for, at du bruger deres lighed til at sælge et produkt uden deres tilladelse. Nøglen til at undgå dette er en rock-solid menneskelig gennemgangsproces. Nogen på dit team skal give det endelige kreative et hurtigt overblik specifikt for at spotte enhver utilsigtet lighed, før du trykker "publicer".

Det afgørende juridiske test handler ikke om din hensigt; det handler om, hvordan offentligheden ser det. Hvis en rimelig person kan forbinde din AI-skuespiller med en rigtig person, er du åben for en potentiel retssag.

Hvem Er Juridisk Ansvarlig for Krav, en AI Fremfører?

Du er. Altid. Mærket bag annoncen er ultimativt ansvarlig for hvert eneste krav, uanset om det er talt af et menneske eller en AI. Hvis din AI-skuespiller siger, at dit produkt er "50% mere effektivt", skal du bedre have dataene til at backe det op.

Du kan ikke skyde skylden på en AI-"hallucination" – når modellen bare finder ting på – hvis FTC banker på. Det er ikke et juridisk forsvar. Derfor er menneskeligt tilsyn ikke-forhandlingsbart; hver faktum, tal og krav skal verificeres af en rigtig person, før din annonce nogensinde ser dagens lys.

Klar til at skabe højtydende annoncer uden de juridiske hovedpiner? ShortGenius hjælper dig med at generere fantastiske, UGC-stil videokampagner hurtigt, mens du får kontrollen til at sikre compliance. Udforsk vores værktøjer og start med at bygge sikrere, mere effektive annoncer i dag. Find ud af mere på https://shortgenius.com.