Voiceover zum Video hinzufügen: Der vollständige Leitfaden (2026)

Lernen Sie, wie Sie Voiceover zu Videos mit KI, einem Profi-Mikrofon oder Ihrem Smartphone hinzufügen. Unser Leitfaden behandelt Aufnahme, Synchronisation, Bearbeitung und Audio-Optimierung für Social Media.

Sie haben das wahrscheinlich schon erlebt. Die Visuals sind sauber, die Schnitte scharf, die Untertitel passen, und das Video fühlt sich trotzdem flach an, sobald Sie es abspielen. Meistens liegt das Problem nicht am Material. Es ist der Voiceover.

Auf Short-Form-Plattformen verzeihen Zuschauer vieles, bevor sie schwaches Audio verzeihen. Ein gedämpftes Lesen, harte Raumhall, schlechtes Timing oder eine robotische KI-Stimme können einen polierten Schnitt billig wirken lassen. Ein klarer, gezielter Voiceover tut das Gegenteil. Er gibt dem Video Struktur, Ton und Schwung.

Die gute Nachricht ist: Voiceover zu Video hinzufügen zu lernen, erfordert kein volles Studio. Wichtiger ist die richtige Aufnahmemethode zu wählen, sauber zu synchronisieren und die Postproduktion zu machen, die die meisten Tutorials überspringen.

Warum Ihr Video einen großartigen Voiceover braucht

Viele Creator behandeln Voiceover wie das letzte Häkchen. Etwas schnell aufnehmen, auf die Timeline ziehen, Musik runterdrehen, exportieren. Genau dieser Workflow ist der Grund, warum so viele Videos besser aussehen als sie klingen.

Ein starker Voiceover behebt drei gängige Probleme auf einmal. Er erklärt, was der Zuschauer sieht, setzt den emotionalen Ton und trägt das Tempo, wenn die Visuals allein nicht reichen. Das zählt bei Tutorials, Produkt-Demos, Ads, faceless Content, Talking-Head-Explainer und fast jedem Short-Form-Format, wo die ersten Sekunden entscheiden, ob jemand bleibt oder weiterscrollt.

Die Business-Seite erzählt dieselbe Geschichte. Der globale Voice-Over-Markt wurde 2024 mit 4,2 Milliarden Dollar bewertet und soll bis 2034 auf 8,6 Milliarden Dollar wachsen, laut Voice-Over-Branchenmarkt-Daten. Solches Wachstum zeigt, wie wichtig narrativer Content in Marketing, Bildung, Ads und Social Video geworden ist.

Was schlechter Voiceover wirklich macht

Schlechter Voiceover klingt nicht nur unpoliert. Er erzeugt Reibung.

- Er verlangsamt das Verständnis, wenn die Darstellung vage oder zu schnell ist.

- Er schwächt das Vertrauen, wenn Raumhall, Clipping oder robotische Formulierungen das Audio nachlässig wirken lassen.

- Er schadet der Retention, weil Zuschauer härter arbeiten müssen, um der Botschaft zu folgen.

- Er zerstört das Brand-Gefühl, wenn jedes Video anders klingt.

Ein guter Voiceover sollte unsichtbar wirken. Der Zuschauer sollte nicht über das Audio nachdenken. Er sollte einfach weiterschauen.

Sie haben mehr als einen Weg

Es gibt keinen einzigen richtigen Workflow. Es gibt drei praktische.

Manche Creator nutzen das Handy, wenn Speed wichtiger als Polierter ist. Manche nehmen mit einem dedizierten Mikro auf, weil ihre eigene Stimme zum Brand gehört. Andere verwenden KI, weil sie Konsistenz, schnellere Iteration oder Mehrsprachigkeit brauchen. Alle drei können funktionieren. Der Unterschied ist, ob Sie das Audio aufräumen und die Methode zum Job passen.

Voiceover-Aufnahmemethode wählen

Die falsche Methode schafft Extraarbeit, bevor Sie editieren. Ich habe Creator gesehen, die mehr Zeit mit der Reparatur einer hastigen Aufnahme verbracht haben, als eine bessere von vornherein zu machen.

Wählen Sie basierend auf der Rolle des Voiceovers in Ihrem Content. Wenn Ihr Publikum Ihnen für Ihre Persönlichkeit folgt, zählt Ihre eigene Stimme mehr. Wenn Sie eine Content-Maschine für Ads, Explainer oder Produktvideos betreiben, zählen Skalierbarkeit und Konsistenz mehr als Performance.

Voiceover-Methoden-Vergleich

| Methode | Kosten | Audio-Qualität | Speed & Komfort | Am besten für |

|---|---|---|---|---|

| Smartphone | Niedrig | Akzeptabel in einem ruhigen Raum, begrenzte Kontrolle | Schnellste Aufnahme | Stories, schnelle Updates, Rough Drafts |

| Pro-Mikro | Mittel bis hoch | Beste Kontrolle und natürlichstes Ergebnis | Langsamer, da Aufnahme und Cleanup Zeit brauchen | Personal Brands, YouTube, Premium-Ads, Bildung |

| AI-Voice-Generator | Variiert je Tool | Kann stark klingen mit richtigen Einstellungen, schwächer wenn generisch | Sehr schnell für Produktion und Revisionen | Faceless Channels, Agenturen, Mehrsprach-Content, Varianten-Tests |

Smartphone-Aufnahme funktioniert, wenn Speed alles ist

Ein Handy reicht für temporären Content, Casual-Clips oder Momente, wo Authentizität mehr zählt als Polierter. Bei schnellen Reactions, Behind-the-Scenes-Updates oder Same-Day-Trend-Posts kann Komfort siegen.

Aber Handys legen jeden unbehandelten-Raum-Problem offen. Harte Wände erzeugen Reflexionen. Distanz tötet Präsenz. Eingemischte Mics lassen wenig Raum, den Sound später zu formen.

Nutzen Sie ein Handy, wenn:

- Sie schnell publishen müssen

- Sie in einem ruhigen, weichen Raum aufnehmen

- Der Content bewusst casual ist

Lassen Sie es, wenn der Voiceover Sales-Copy, Teaching oder Brand-Positioning trägt.

Ein dediziertes Mikrofon gibt Kontrolle

Wenn Ihre Stimme zum Produkt gehört, lohnt ein richtiges Mic-Setup. Sie bekommen besseren Ton, weniger Raumrauschen und viel vorhersehbarere Ergebnisse im Edit. Das ist der beste Weg für Creator, die eine erkennbare Stimme aufbauen, und für alle, die den Sound auf YouTube, Instagram, TikTok und Paid Social halten wollen.

Der Trade-off ist Zeit. Manuelle Aufnahme braucht Setup, Retakes, Editing und grundlegende Audio-Behandlung. Diese Arbeit zahlt sich aus, wenn Konsistenz zählt.

Arbeitsregel: Wenn Sie dieselbe Stimme über Monate vertraut machen wollen, nutzen Sie ein echtes Mic und bauen ein wiederholbares Aufnahme-Setup auf.

AI-Voice-Generator siegen bei Speed und Skala

KI ist die praktische Wahl bei Volumen. Sie ist nützlich, um Hooks zu testen, Narrator-Stile zu wechseln, Skripte zu lokalisieren oder ein konsistentes Sound über ein Team zu halten.

Der Nachteil ist klar. Generischer Output klingt generisch. Ohne Anpassung von Timing, Betonung und Skript-Formulierung fühlt sich das Ergebnis leblos an. KI funktioniert am besten, wenn Sie sie wie einen Narrator behandeln, der noch Anweisungen braucht.

Ein einfacher Entscheidungsfilter hilft:

- Handy nutzen für schnellen, wegwerfbaren oder hochcasual Content.

- Pro-Mic nutzen, wenn Voice-Qualität zu Ihrem Ruf gehört.

- KI nutzen, wenn Turnaround, Konsistenz oder Mehrsprach-Produktion am wichtigsten ist.

Professionellen Voiceover manuell aufnehmen

Wenn Sie Ihre eigene Stimme aufnehmen, kommt die meiste Qualität aus dem Setup, bevor Sie recorden. Eine mittelmäßige Lesung in einem kontrollierten Raum schlägt meist eine tolle in einem schlechten Raum.

Professionelle Praxis ist unkompliziert. Nutzen Sie ein dynamisches Mikrofon, dann wenden Sie einen Hochpassfilter bei 80-100 Hz und Kompression bei 4:1 Ratio an, um die Stimme konsistent bei -12 bis -6 dB LUFS zu halten, wie in Lightworks Voiceover-Best-Practices beschrieben.

Mit dem Raum beginnen, nicht dem Mic

Ein tolles Mikrofon in einem reflektierenden Raum klingt immer noch schlecht. Bevor Sie an Plugins oder Presets denken, reduzieren Sie Raumprobleme.

Gute Improvisationsoptionen:

- Ein Schrank mit Kleidung, weil weiche Materialien Reflexionen absorbieren

- Eine Ecke mit Vorhängen, Teppichen und weichem Mobiliar

- Ein Desk-Setup mit Decken oder Akustikpaneelen in der Nähe

Vermeiden Sie Küchen, leere Büros und Räume mit kahlen Wänden. Diese Räume übertreiben harte Reflexionen und machen die Stimme distant.

Mic-Technik zählt mehr, als die meisten Anfänger denken

Distanz und Winkel formen die Aufnahme sofort. Halten Sie ca. 15-30 cm Abstand zum Mic und sprechen Sie leicht off-axis statt direkt drauf. Das reduziert Plosives und Mund-Blasts bei Wörtern mit harten Konsonanten.

Ein paar Gewohnheiten verbessern Ergebnisse schnell:

- Pop-Filter nutzen: Er fängt Luftstöße ab, bevor sie die Kapsel treffen.

- Offene Haltung halten: Eine eingeknickte Haltung macht Lesungen klein klingen.

- Position markieren: Wenn Sie sich bewegen, ändert sich der Ton zwischen Takes.

- Room Tone aufnehmen: Ein paar Sekunden Stille helfen bei späterem Cleanup.

Nehmen Sie einen kurzen Test auf, hören Sie mit Kopfhörern zu, bevor Sie voll durchgehen. Ein lautes Setup nach zehn Minuten Narration zu reparieren ist eine schmerzhafte Lektion.

Wie ein Editor den File später bearbeiten wird, aufnehmen

Versuchen Sie nicht, das ganze Skript in einem Helden-Take zu nageln. Nehmen Sie in Abschnitten auf. Lassen Sie Pausen zwischen Zeilen. Bei Fehlern pausieren, Satz sauber wiederholen und weiter. Das gibt klare Edit-Punkte.

Ein simpler Workflow:

- Für Sprache schreiben, nicht für Lesen. Kürzere Zeilen klingen natürlicher.

- Stimme aufwärmen. Ein kalter First-Take klingt meist steif.

- Gain konservativ setzen. Clipping zerstört gute Takes.

- In WAV aufnehmen, wenn möglich. Das gibt später mehr Flexibilität.

- Zwei Versionen von Key-Lines machen. Eine neutral, eine energiegeladener.

Der erste Cleanup-Durchgang

Nach der Aufnahme die Basisbehandlung machen, bevor Sie synchronisieren.

- Hochpassfilter bei 80-100 Hz anwenden

- Leichte EQ für Klarheit hinzufügen

- 4:1 Kompression nutzen

- Stimme in den Zielbereich normalisieren

- Offensichtliche Klicks, Atemzüge oder Hintergrundstörungen entfernen

Das ist der Unterschied zwischen roher Aufnahme und einem Voiceover, der gut in einem Social-Video-Mix sitzt.

Flawless AI-Voiceovers mit ShortGenius generieren

Sie finalisieren einen Short-Form-Edit, droppen eine AI-Stimme rein, und es fühlt sich immer noch billig an. Die Wörter sind richtig. Das Timing falsch. Der Ton verfehlt den Hook. Auf TikTok und Instagram zeigt sich das schnell in der Retention.

AI-Voiceover funktioniert am besten als Produktionssystem, nicht als Magie-Button. Es gibt schnelle Revisionen, konsistente Delivery über Batches und viel weniger Rerecording bei Skript-Änderungen. Der Trade-off ist Direction. Ohne Formung von Skript, Timing und Post-Processing klingt der Output flach, selbst mit gutem Voice-Model.

Einige Analysen von AI-Voice-Workflows berichten von massiven Zeitersparnissen durch automatisches Cleanup und stärkerer Zuhörerreaktion auf gut trainierte geklonte Stimmen als auf generischem Text-to-Speech. Das passt zu dem, was Creator in der Praxis sehen. Der Hauptgewinn ist nicht nur Speed. Es ist die Fähigkeit, multiple Hooks, Töne und Line-Reads zu testen, bevor Sie den Final-Cut committen.

Für AI-Delivery schreiben

AI interpretiert Copy wörtlich. Dichte Sätze, gestapelte Klauseln und vage Betonungspunkte erzeugen den bekannten synthetischen Rhythmus, der Watch-Time killt.

Skripte für AI haben meist:

- eine Idee pro Satz

- klare Stress-Wörter nah am Zeilenende

- kurze Übergänge zwischen Szenen

- bewusste Pausenpunkte

- Formulierungen, die gesprochen klingen, nicht publiziert

Ich kürze Opening-Lines für Social härter als für YouTube. Wenn der erste Satz nicht sauber unter drei Sekunden landen kann, schreibe ich um, bevor ich Voice-Einstellungen anrühre.

Bei Mehrsprach-Versionen Skript vor der Generierung fixen, nicht danach. Direkte Übersetzung erhält oft die Bedeutung, verliert aber den Rhythmus. Für Teams, die Ads, Tutorials oder Creator-Clips lokalisieren, ist diese Anleitung zum genauen Übersetzen von Voice- und Audio-Dateien nützlich, da Formulierung und Delivery meist angepasst werden müssen, bevor der Final-Render kommt.

Der Workflow in ShortGenius

Ein guter AI-Workflow hält Schreiben, Voice-Auswahl und Revisionen nah beieinander. Deshalb nutzen viele Creator ShortGenius für AI-Voiceover und Short-Form-Video-Produktion statt den Job über separate Script-, TTS-, Subtitle- und Editing-Tools zu splitten.

Ein praktischer Workflow sieht so aus:

-

Per Szene draften Narration an visuelle Beats anpassen, nicht ans volle Concept-Doc.

-

Voice wählen, die zum Format passt UGC-Style-Promos brauchen einen anderen Read als faceless Explainer oder Produkt-Demos.

-

Timing bewusst setzen Etwas langsamer klingt oft selbstbewusster. Etwas schneller kann für Urgency gehen, aber nur bei sparsem Skript.

-

Kurze Sample zuerst rendern Hook und eine Mid-Video-Sektion testen, bevor das volle Skript generiert wird.

-

Schlechte Lines auf Skript-Ebene fixen Wenn Betonung falsch klingt, Satz umschreiben. Einstellungen können nur so viel.

-

Alternativen generieren Zwei oder drei Versionen der Opening-Line machen. Das ist einer der einfachsten Wege, Retention zu verbessern, ohne den ganzen Edit umzubauen.

Hier ein Walkthrough, wenn Sie den Flow in Aktion sehen wollen.

Was nutzbares AI von poliertem AI trennt

Schlechte AI-Voiceovers scheitern vorhersehbar. Das Skript ist überladen. Der Default-Rhythmus unangetastet. Die Stimme passt nicht zum Footage. Der Render geht direkt in die Timeline ohne Audio-Finishing.

Creator mit starken Social-Ergebnissen generieren und exportieren nicht nur. Sie behandeln AI-Narration wie Rohmaterial. Das heißt: Aussprache anpassen, lange Lines in saubere Phrasen splitten und leichte Post-Work laufen, damit die Stimme durch Phone-Speaker schneidet, ohne hart zu klingen.

AI-Narration klingt natürlich, wenn das Skript gut directed ist und die exportierte Datei wie echte Voiceover-Audio finished wird.

Dieser Extra-Polish macht AI nutzbar für High-Volume-Social-Produktion. Er schließt auch die Qualitätslücke zwischen schneller synthetischer Narration und dem engeren, bewussteren Sound, den man mit professioneller Voice-Arbeit assoziiert.

Voiceover perfekt synchronisieren und editieren

Sobald die Datei existiert, ist das Schwierige nicht, sie in die Timeline zu droppen. Es ist, sie nativ im Video wirken zu lassen, statt obendraufgelegt.

Wenn Ihr Source-Clip schon störendes Camera-Audio, Fan-Noise oder zufällige Rede hat, zuerst rausmachen. Ein simples Tool zum Entfernen von existierendem Audio aus Ihrem Video spart Zeit, bevor Sie die finale Narration syncen.

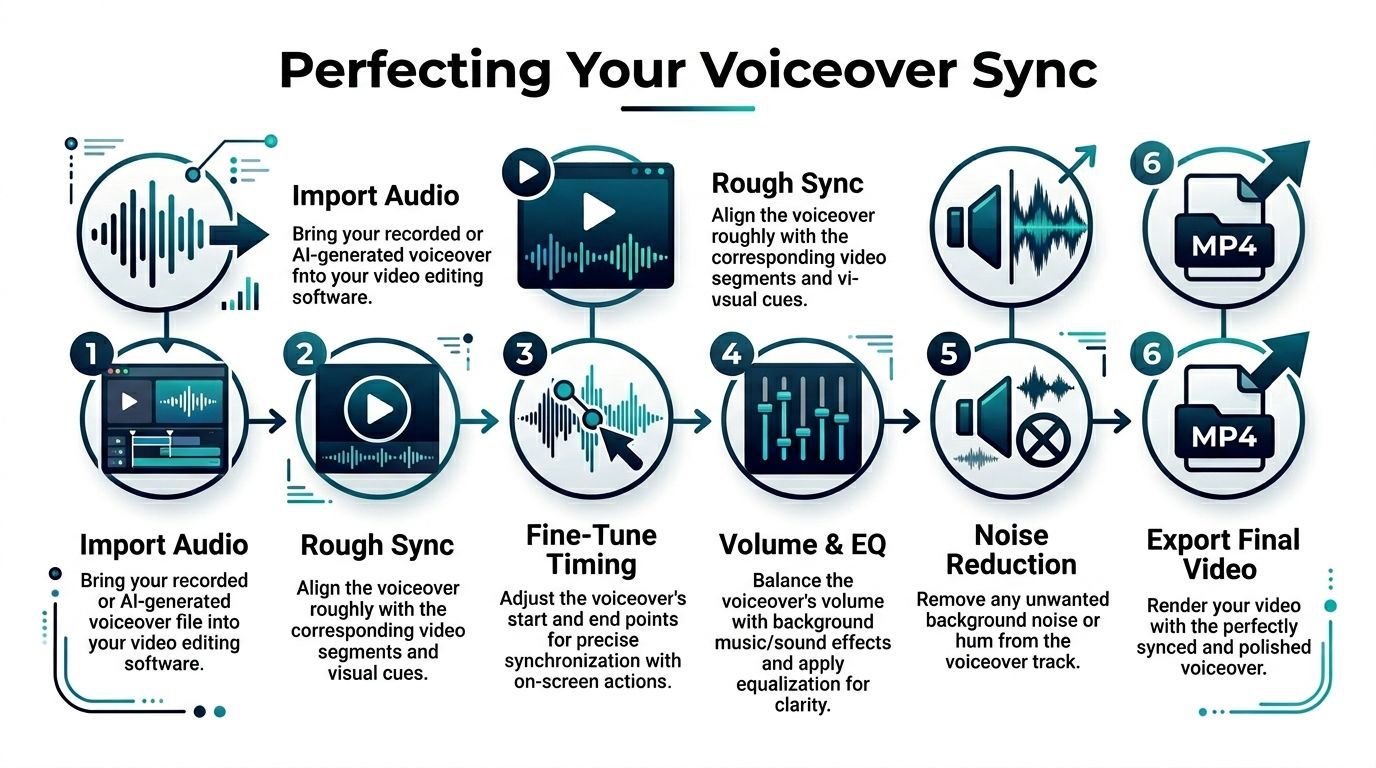

Mit Rough-Sync starten

Audio in Premiere Pro, DaVinci Resolve, CapCut, Final Cut, VEED oder welchen Editor Sie nutzen, importieren. Voiceover auf eigene Spur unter das Video droppen und nach Bedeutung alignen, nicht nach Frame-Perfection.

Für Rough-Sync fokussieren:

- wo die erste gesprochene Phrase beginnen soll

- wo visuelle Actions verbale Unterstützung brauchen

- wo Stille unangetastet bleiben soll

Wenn der Voiceover zu einem Skript aufgezeichnet wurde, das zum Edit passt, geht das schnell. Wenn das Skript nach dem Cut geändert wurde, Lines trimmen oder Clips bewegen erwarten.

Mit Waveforms und visuellen Cues fine-tunen

In die Timeline zoomen und Satz für Satz hören. Tight Sync zählt am meisten, wenn Narration eine sichtbare Action, On-Screen-Text, Handbewegung oder Produkt-Reveal referenziert.

Nutzen:

- Waveform-Peaks für offensichtliche Speech-Starts

- Marker für key visuelle Beats

- Kleine Trims statt großer Shifts, wenn Sie nah dran sind

Overlap-Edits für smoothen Flow nutzen

Ein Anfänger-Cut klingt oft abrupt, weil jede Voice-Line genau beim neuen Shot startet. Das ist nicht immer der beste Move.

Zwei einfache Editing-Patterns helfen:

- J-Cut: Nächste Voice-Line beginnt vor dem visuellen Wechsel.

- L-Cut: Aktuelle Voice-Line läuft nach dem visuellen Wechsel weiter.

Diese Edits machen das Video intentionaler und lassen die Stimme den Zuschauer durch Übergänge führen.

Wenn ein Cut jumpy wirkt, nicht immer das Bild zuerst fixen. Oft ist der smoothere Fix, Audio um einen Bruchteil zu bewegen.

Voice, Music und Effects balancieren

Nachdem Timing gesetzt ist, die Spur mixen. Die Stimme gewinnt immer. Background-Music unterstützt die Energie, ohne um Attention zu konkurrieren.

Ein praktischer Finishing-Pass:

- Music unter Dialogue runterdrehen

- Störende Atemzüge nur entfernen, wenn sie focus ziehen

- Line-Starts und -Ends sauber faden

- Übergänge auf Speakern und Kopfhörern checken

- Einmal komplett anschauen, ohne Timeline zu touchen

Dieser finale Real-Time-Watch fängt mehr Probleme als endlose Micro-Adjustments.

Advanced Tips zum Polieren Ihres Voiceover-Audios

Roh-Voiceover ist fast nie fertiges Voiceover. Das ist der Schritt, den die meisten Creator hetzen, und er trennt oft credible Content von homemade.

Der Grund ist einfach. Zuschauer reagieren schneller auf Sound, als sie ihn bewusst analysieren. Wenn die Stimme matschig, noisy, dünn, hart oder inkonsistent ist, fühlen sie Widerstand, bevor sie wissen warum.

Ein starker Grund, Polish nicht zu skippen: Audience-Verhalten. Eine Wistia-Studie fand, dass Audio-Qualitätsprobleme 42 % der Zuschauer innerhalb der ersten 5 Sekunden Short-Form-Videos verlassen lassen, und Forschung zum Voice-Numerosity-Effekt ergab, dass multiple Stimmen die Überzeugungskraft und Funding auf Kickstarter um über 30 % steigern können, wie in SMU’s Zusammenfassung zu Voiceovers im Video-Marketing beschrieben.

Noise zuerst cleanen, bevor die Stimme enhanced wird

Viele springen direkt zu EQ. Das ist rückwärts, wenn die Spur Hiss, Hum, Room-Tone oder Low-End-Rumble hat.

Zuerst entfernen, was nicht da sein sollte:

- Noise-Reduction leicht nutzen, damit die Stimme nicht watery wird

- Gate vorsichtig, wenn Room-Noise zwischen Phrasen sitzt

- Rumble cutten vor Clarity-Boost

- Schlechte Atemzüge und Mouth-Clicks trimmen nur, wenn sie stören

Heavy Cleanup kann die Stimme schlechter machen als das Original. Das Ziel ist nicht steriles Audio. Es ist kontrolliertes Audio.

EQ für Klarheit, nicht für Impressiveness

Gutes EQ klingt solo oft langweilig und im Full-Mix exzellent. Sie schaffen Intelligibility, kein Radio-Drama.

Nützliche Moves:

- Hochpass-Filtering, um Low-Rumble zu clearen

- Muddy Low-Mids cutten, wenn die Stimme boxed wirkt

- Touch of Presence für klare Konsonanten hinzufügen

- Harshness oder Sibilance reduzieren, wenn der Top-End beißt

Wenn Sie nach einem aggressiven EQ-Move eine dramatische Transformation hören, ist es oft zu viel.

Kompression als Konsistenz-Tool

Kompression hält die Stimme vor dem Zuschauer statt in Volume zu bouncen. Sie macht leise Lines verständlich und verhindert, dass laute jumpen.

Was funktioniert:

- moderate Kompression

- Gain-Reduction, die kontrolliert klingt, nicht gesquashed

- Output-Level nach Kompression matchen

Was nicht:

- Leben aus dem Read pressen

- Nach Kompression überhell machen

- Schlechte Mic-Technik mit Plugins fixen versuchen

Praktische Regel: Wenn Sie den Compressor arbeiten hören, zurückfahren.

Timing, Stille und multiple Stimmen

Audio-Polish ist nicht nur technisch. Es ist editorial.

Manchmal ist der smarteste Move eine halbe Sekunde Stille vor der Key-Line. Manchmal eine Phrase cutten, die das Visuelle wiederholt. Und in manchen Formaten schafft eine zweite Stimme Kontrast, der Attention hochhält.

Multiple Stimmen sind besonders nützlich für:

- Dialogue-Style-Ads

- Skits und UGC-Style-Promos

- Before-and-After-Vergleiche

- Tutorials mit Host- und Customer-Lines

Wichtig ist Maß. Zwei distincte Stimmen wirken dynamisch. Zu viele machen ein Short-Video messy.

Video für Social Media exportieren und publishen

Beim Export sollten kreative Entscheidungen schon fertig sein. Export schützt die Arbeit, statt zu hoffen, die Plattform fixxt es.

Final-File einfach und platform-freundlich halten. Mit cleanem Audio exportieren, dann die gerenderte Datei anschauen, bevor Sie uploaden. Probleme zeigen sich oft erst nach Export, besonders abrupte Cuts, fehlende Fades und Music, die lauter rauskommt als erwartet.

Final-Checklist vor Publish

- Voll-Export einmal anschauen: Nicht scrubben. Durchspielen.

- Erste Sekunden genau checken: Opening-Line muss sofort klar sein.

- Captions verifizieren: Captions sollten Voiceover supporten, nicht bekämpfen.

- Auf Phone-Speakern hören: Da wird viel Short-Form geurteilt.

- Music-Balance nochmal checken: Mix, der auf Kopfhörern fine war, kann auf Mobile muddy werden.

- Ende sauber auflösen: Kein clippedes Final-Wort, Music-Tail oder awkward Stille.

Captions sind Teil der Audio-Strategie

Guter Voiceover und gute Captions arbeiten zusammen. Captions helfen silenten Viewern, verbessern Accessibility und reinforce Key-Lines, wenn der Feed noisy oder distracting ist.

Für TikTok, Instagram Reels, YouTube Shorts und Facebook-Video ist das beste Ergebnis meist eine klare gesprochene Spur mit cleanem On-Screen-Text. Wenn die Stimme erklärt und Captions die Message clean echoen, wird das Video leichter in mehr Viewing-Conditions zu folgen.

Starkes narrated Video publishen kommt auf eine Gewohnheit runter. Audio nicht als Layer behandeln. Als Spine des Videos.

Wenn Sie einen schnelleren Weg wollen, um zu scripten, natürliche Voiceovers zu generieren, Szenen zu assemblen, Captions hinzuzufügen, Varianten zu swappen und über Channels zu publishen – alles aus einem Workflow –, probieren Sie ShortGenius (AI Video / AI Ad Generator). Es ist für Creator und Teams gebaut, die Ideen in poliertes Social Video umwandeln wollen, ohne einen Stack separater Tools zu stitchen.