Atemberaubende Qualität freischalten: Video mit KI hochskalieren

Erfahren Sie einen praktischen Workflow zum Hochskalieren von Videos mit KI. Von der Vorbereitung des Materials über optimale Einstellungen und Batch-Verarbeitung bis zum Export für soziale Medien mit ShortGenius.

Du hast einen Clip, der funktionieren sollte.

Vielleicht ist es ein altes Kunden-Testimonial, das mit dem Handy aufgenommen wurde. Vielleicht ist es user-generated Footage, die die Emotion perfekt trifft, aber auf modernen Bildschirmen weich wirkt. Vielleicht ist es ein früherer Top-Performer, den du reposten, zuschneiden und in frische Short-Form-Assets umwandeln möchtest. Die Idee ist stark. Die Quelldatei nicht.

Genau hier hört upscale video ai auf, eine Neuheit zu sein, und wird zu einem Produktions-Tool.

Gutes AI-Upscaling kann Footage retten, die du sonst wegwerfen würdest. Schlechtes AI-Upscaling verschwendet Stunden, übertreibt Kompressionsrauschen und verleiht Gesichtern diesen plastischen, überkochten Look, den Zuschauer sofort bemerken. Der Unterschied liegt im Workflow. Quellenqualität, Modellwahl, Batch-Verarbeitung und Export-Entscheidungen zählen mehr als die Marketing-Versprechen auf der Homepage eines Tools.

Warum AI Video Upscaling die Superkraft der Creator ist

Low-Resolution-Footage hatte früher eine harte Obergrenze. Du konntest es vergrößern, aber nicht wirklich verbessern. Traditionelles Scaling dehnte nur Pixel. Es machte Clips größer, nicht besser.

AI video upscaling funktioniert anders. Es nutzt Deep Learning, um Details zu rekonstruieren, umliegende Pixel zu interpretieren und Bewegungen über Frames hinweg zu erhalten. Letzteres ist entscheidend. Ein einzelnes Bild kann scharf aussehen und als Video trotzdem scheitern, wenn Kanten flimmern oder Texturen von Frame zu Frame flackern.

Warum Creator das jetzt interessiert

Das ist kein Nischen-Restorationstrick mehr. Der AI Video Upscaling Software Market wuchs von 550 Millionen USD im Jahr 2024 auf 670 Millionen USD im Jahr 2025 und soll bis 2035 5 Milliarden USD erreichen, mit einer CAGR von 22,3 %, getrieben durch die Nachfrage nach 4K-Delivery und stärkerer visueller Qualität für Engagement, laut Wise Guy Reports on the AI video upscaling software market.

Das passt zu dem, womit Creator wöchentlich zu tun haben:

- Alte Footage hat immer noch Wert: Frühere Interviews, Webinare, Demos und Testimonials enthalten oft Ideen, die sich lohnen, neu zu veröffentlichen.

- UGC ist selten perfekt aufgenommen: Tolle Hooks kommen aus unperfekten Clips.

- Jede Plattform bestraft Weichheit: Zuschneiden, Größenänderung und Rekomprimierung schwacher Footage macht Fehler deutlicher.

Praktische Regel: Nutze AI-Upscaling, um starken Content zu retten. Erwarte nicht, dass es schwache Kameraführung, verpassten Fokus oder starkes Bewegungsunschärfe rettet.

Es gibt auch einen breiteren Workflow-Aspekt. Wenn du bereits ein Asset in viele umwandelst, wird Upscaling Teil des Repackagings, nicht nur der Reparatur. Deshalb passt es nahtlos zu AI content repurposing. Eine einzige Low-Res-Quelldatei kann zu Shorts, quadratischen Edits und erfrischten Reposts werden, wenn du die Quelle bereinigst, bevor du sie änderst und verteilst.

Wofür es am besten geeignet ist

AI-Upscaling glänzt in wenigen spezifischen Situationen:

| Anwendungsfall | Warum es funktioniert |

|---|---|

| Archiv-Clips | Es stellt Klarheit wieder her, ohne jeden Shot manuell neu aufzubauen |

| Screen Recordings | Es hilft, dass Textkanten und UI-Elemente Kompression besser überstehen |

| UGC für Ads | Es hebt die Basisqualität, bevor Captions, Branding und Exports hinzukommen |

| Zugeschnittene Social-Edits | Extra Auflösungsspielraum hilft, wenn du einen Master in mehrere Formate umwandelst |

Falls du eine schnelle Auffrischung brauchst, was höhere Auflösung in der Praxis bedeutet, ist diese Aufschlüsselung von https://shortgenius.com/blog/what-is-4-k-resolution nützlich, bevor du entscheidest, ob ein Clip ein 4K-Finish verdient.

Quelldatei für makelloses Upscaling vorbereiten

Der größte Fehler bei upscale video ai ist, dem Tool die schlechteste Datei zu geben und zu hoffen, dass das Modell Magie wirkt.

Das tut es nicht.

Der Markt bewegt sich schnell. Der breitere Video Enhancing AI Tool Market soll bis 2032 1.166 Millionen USD erreichen, mit einer CAGR von 37,1 %, angetrieben durch Deep-Learning-Systeme, die sofortige 2x bis 4x-Auflösungs-Boosts liefern und Bandbreite reduzieren, laut Intel Market Research on the video enhancing AI tool market. Aber bessere Modelle heben schlechte Eingaben nicht auf.

Clip vor der Verarbeitung prüfen

Bevor ich etwas in die Warteschlange lege, überprüfe ich, ob der Clip ein guter Kandidat ist oder eine Falle.

Nutze diese kurze Prüfung:

- Kompressionsschäden: Bei Macroblocking, Mosquito Noise oder verschmierten Details könnte das Modell diesen Schaden als echte Textur behandeln.

- Bewegungsunschärfe: AI kann Kanten schärfen, aber keine Details rekonstruieren, die im Frame nie existierten.

- Fokus: Leicht weich ist machbar. Verpasster Fokus bleibt meist verpasst.

- Frame-Stabilität: Wackelige Clips sind schwer sauber zu upscalen, besonders wenn der Hintergrund schon auseinanderfällt.

- Datei-Herkunft: Exportiere vom nächsten Original, das du findest. Nicht upscalen, was schon mehrmals komprimiert wurde.

Richtige Quelle wählen, nicht nur die größte

Creator jagen oft zuerst Auflösung. Das ist verkehrt.

Ein sauberes 720p-Master kann ein ramponiertes 1080p-Repost schlagen. Entscheidend ist, ob die Quelle echte Bildinformationen erhält. Bei Optionen wähle die Datei mit der wenigsten Rekomprimierung und den wenigsten eingebauten Edits.

Wenn die Quelle schon bei nativer Größe noisy, knackig und instabil wirkt, macht Upscaling diese Probleme meist sichtbarer.

Was vor dem Upscaling zu beheben ist

Eine kleine Vorbereitung spart viele Re-Renders.

-

Clip zuerst zuschneiden

Verarbeite keine Totenstille, Fehlstarts oder Alternativ-Takes, die du nicht brauchst. -

Footage-Typen trennen

Talking Head, Gameplay, Animation und Screen Capture verhalten sich unterschiedlich. Nicht unter einem Preset batchen. -

Offensichtliche Reinigung früh erledigen

Wenn die Datei grundlegendes Denoise oder Deinterlacing braucht, mach das vor dem Upscale-Durchgang. -

Kurzen Sample-Run machen

Nimm einen anspruchsvollen Moment aus dem Clip. Schnelle Handbewegung, Haar-Details, Kamerabewegung, feiner Text. Scheitert das Sample, wird der volle Render nicht besser.

Schlechte Kandidaten für AI-Upscaling

Manche Clips lohnen die Rechenleistung nicht.

- Stark gefilterte Social-Downloads

- Winzige repostete Memes

- Footage mit starker Low-Light-Zerlegung

- Clips, bei denen Gesichter schon durch Kompression verzerrt sind

Das klingt streng, schützt aber deine Zeit. Der beste Workflow beginnt mit Auswahl, nicht mit Software-Einstellungen.

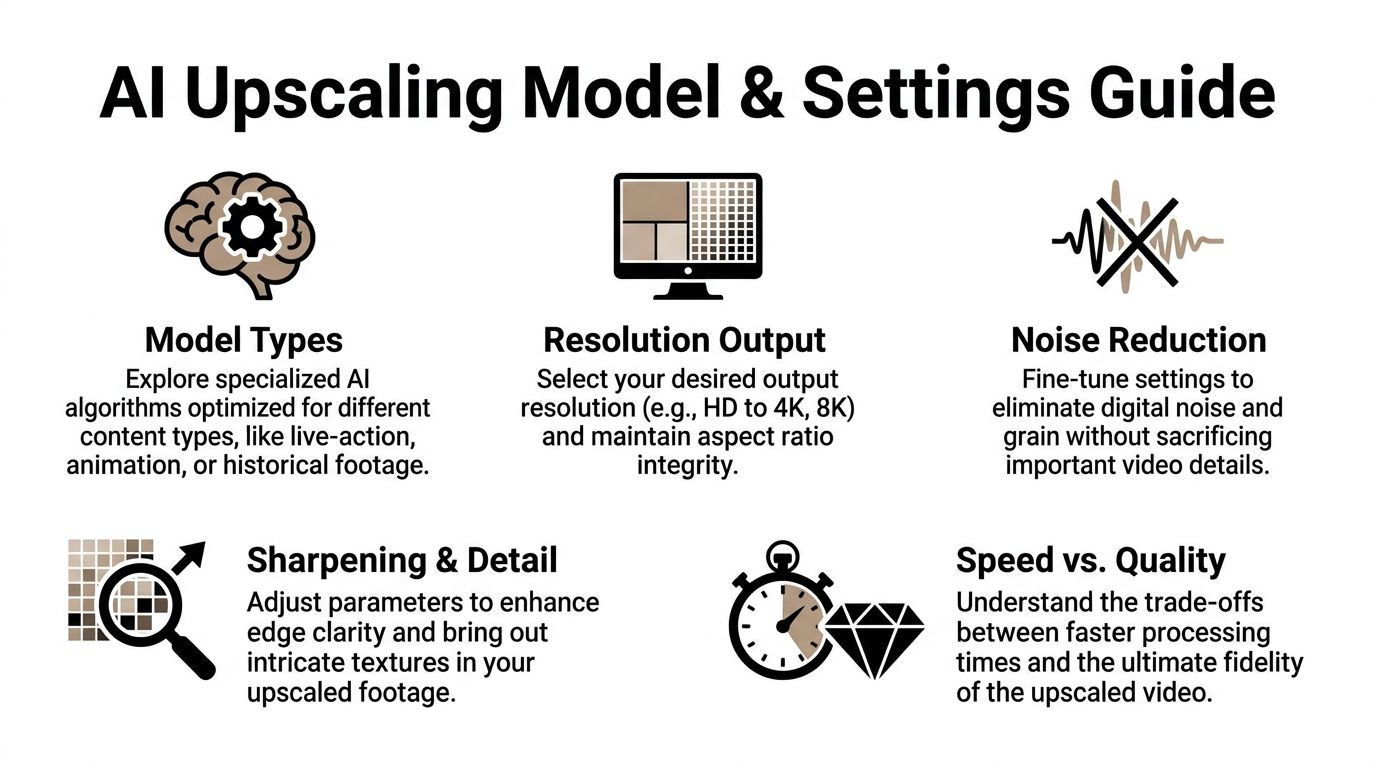

Richtiges AI-Modell und Einstellungen wählen

Die meisten fehlgeschlagenen Upscales kommen aus derselben Gewohnheit. Leute laden einen Clip, wählen die höchste Ausgabe, treiben Sharpening zu weit und gehen davon aus, dass mehr Verarbeitung mehr Qualität bedeutet.

Tut es nicht.

Unterschiedliche Modelle machen unterschiedliche Kompromisse. Manche erhalten Realismus. Manche erfinden mehr Textur. Manche funktionieren gut bei Animation und schlecht bei Haut. Manche sind stabil bei Bewegung. Andere erzeugen beeindruckende Standbilder und hässliche temporale Artefakte.

Ein nützlicher Benchmark steckt dahinter. Bei AI-Upscaling können Deep-Learning-Modelle wie basicVSR++ über 13 % höhere VMAF-Scores als traditionelles Lanczos erreichen, wenn sie 540p auf 1080p upscalen, mit PSNR-Gewinnen von 2-4 dB, aber Hardware-Limits auf Consumer-GPUs können zu 50 %+ Fehlerraten bei 4K-Clips länger als 2 Minuten durch VRAM-Mangel führen, wie in der At Scale Conference coverage of on-device video playback upsampling notiert.

Modellwahl beginnt mit Footage-Typ

Eine einfache Denkweise zu Modellen:

| Footage-Typ | Was priorisieren | Häufiger Fehlmodus |

|---|---|---|

| Live Action | Natürliche Haut, stabile Bewegung, zurückhaltendes Sharpening | Wachsige Gesichter |

| Animation | Saubere Linien, Kanten-Konsistenz | Haloing um Umrisse |

| Gameplay | Bewegungsbehandlung, Text/UI-Klarheit | Ghosting in schnellen Szenen |

| Archiv-Footage | Konservative Rekonstruktion | Fake-Textur, die den Original-Look verändert |

Wenn ein Tool mehrere Modell-Familien bietet, nutze kein universelles Preset. So landest du mit überschärften Interviews und matschiger Animation im selben Projektordner.

Für Editoren, die Tools und Workflows vergleichen, bevor sie sich festlegen, hilft diese Übersicht von https://shortgenius.com/blog/beste-ki-video-bearbeitungssoftware dabei, wo Upscaling in einen größeren Edit-Pipeline passt.

Die wichtigsten Einstellungen

Viele UI-Labels klingen technisch, verhalten sich aber vorhersehbar.

Denoise

Denoise nutzen, wenn die Quelle sichtbares Noise hat, das das Modell für Details hält. Weniger verwenden, als du denkst.

Zu viel Denoise entzieht Textur von Haut, Stoffen und Hintergründen. Dann versucht Sharpening, fake Knackigkeit auf ein abgeflachtes Bild aufzubauen.

Deblock

Deblock hilft bei Kompressionsschäden. Es glättet hässliche Blockkanten, bevor das Upscale-Modell sie übertreibt.

Nützlich bei Downloads und alten Exports. Gefährlich bei schon sauberer Footage, da es Kanten weich macht, die du erhalten wolltest.

Sharpen

Sharpen ist der Punkt, wo der Render oft ruiniert wird.

Ein bisschen Sharpening kann Kantendefinition wiederherstellen. Zu viel erzeugt Halos, spröde Haare und diesen synthetischen „AI enhanced“-Look. Sieht ein Sample pausiert beeindruckend, aber in Bewegung hässlich aus, ist Sharpening oft schuld.

Die richtige Sharpen-Einstellung sollte im finalen Video verschwinden. Wenn Zuschauer die Verarbeitung spüren, ist sie meist zu aggressiv.

Auflösungsstrategie schlägt Brute Force

Direkt auf 4K zu gehen ist oft der falsche Zug. Für Social-Content kann 1080p oder ein moderater Schritt sauberer wirken als eine große Datei mit erfundenen Details.

Hier der praktische Vergleich:

| Ansatz | Vorteil | Nachteil |

|---|---|---|

| Direkt auf 4K | Maximale Ausgabgröße | Mehr halluzinierte Details, schwerere Renders |

| Erst auf 1080p | Bessere Kontrolle, einfachere QA | Extra Entscheidungspunkt |

| Nur moderates Upscale | Schneller, sicherer für Social-Delivery | Weniger dramatische Before-and-After |

Der mittlere Weg gewinnt überraschend oft. Du behältst Kontrolle über Textur und Bewegung und vermeidest, die ganze Nacht an einem Render zu hängen, der beim Upload eh hart komprimiert wird.

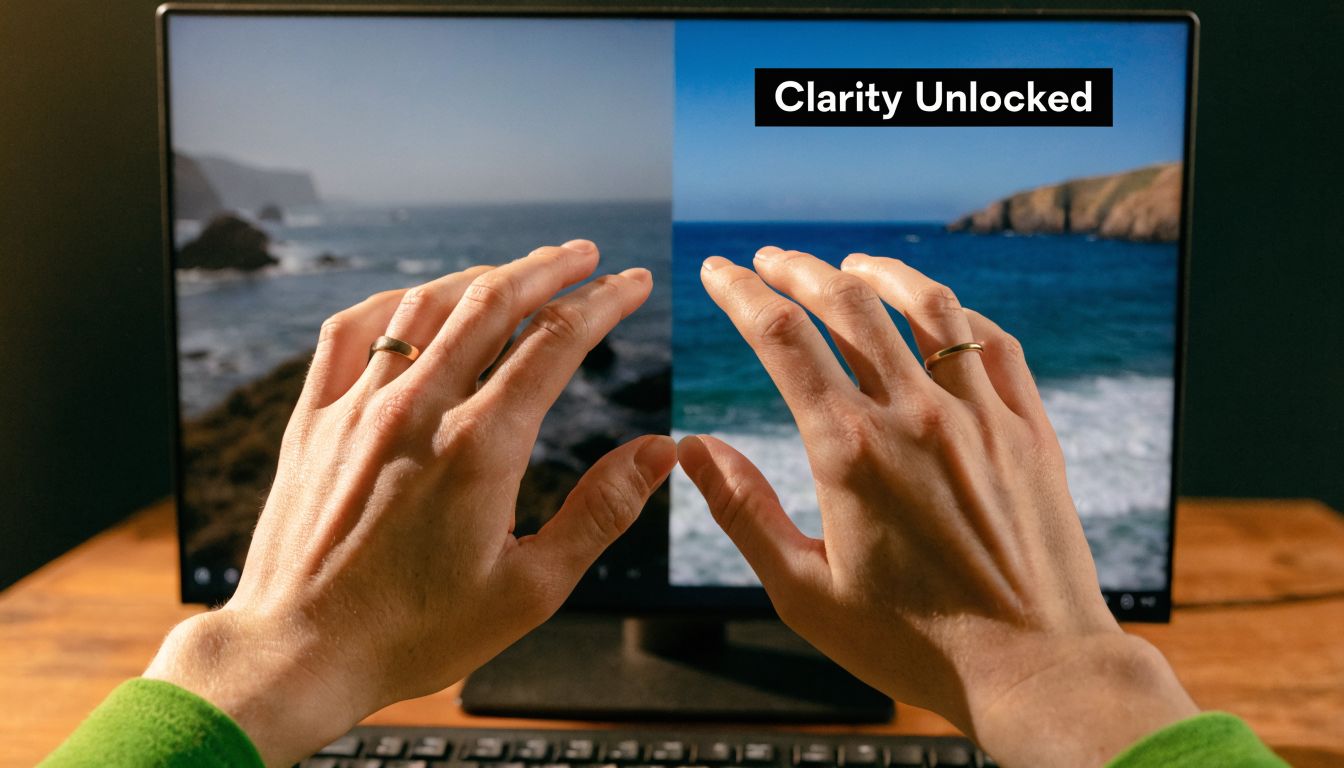

Ein schneller visueller Walkthrough hilft beim Einstellen:

Local vs. Cloud-Verarbeitung

Diese Wahl geht weniger um Ideologie, mehr um Einschränkungen.

Local processing gibt Kontrolle. Es bindet aber deine Maschine und deckt GPU-Limits schnell auf.

Cloud processing beseitigt Hardware-Engpässe, kostet aber Kontrolle über Timing, Kostenstruktur und manchmal feine Einstellungen, je nach Plattform.

Local wählen, wenn:

- Du wiederholbare Presets auf einer bekannten Maschine brauchst

- Du stark testest

- Du direkte Aufsicht über jeden Durchgang willst

Cloud wählen, wenn:

- Deine GPU bei längeren Clips scheitert

- Du Team-Zugriff brauchst

- Du lieber editierst, während Renders anderswo laufen

Presets bauen, ihnen dann misstrauen

Presets sparen Zeit. Blindes Vertrauen zerstört Qualität.

Halte ein paar Start-Presets nach Content-Typ, teste aber jede neue Quelle mit einem kurzen Segment, bevor du den vollen Render startest. Ein Preset für saubere Talking-Head-Footage. Ein anderes für raue UGC. Ein weiteres für Animation oder Screen Recordings.

Diese Disziplin zählt mehr als der Markenname der Software.

Batch-Upscaling-Workflow meistern

Upscaling eines Clips ist ein Experiment. Upscaling von zwanzig Clips sind Operationen.

Viele Creator verlieren häufig Zeit. Sie behandeln jede Datei wie einen Custom-Job, babysitten Exports und rerunnen fehlgeschlagene Renders, weil nichts organisiert war. Ein Batch-Workflow behebt das.

Laut Audials guidance on beginner mistakes in AI video upscaling empfehlen Experten, mit hochwertiger, minimal komprimierter Video zu starten und inkrementelle Auflösungssprünge wie 720p auf 1080p vor 4K zu testen, um unnatürliche Ergebnisse und 4x längere Renderzeiten zu vermeiden. Dieselbe Anleitung merkt an, dass aggressive Modelle 20-30 % Artefakt-Raten in bewegungsintensiven Szenen erzeugen können, die auf weniger als 5 % mit einem richtigen Workflow sinken.

Local Overnight-Workflow

Für Desktop-Tools ist die sicherste Einrichtung absichtlich langweilig.

-

Drei Ordner erstellen

Nutzesource,test-rendersundfinal-upscaled. Halte sie getrennt. -

Clips vor dem Queuen umbenennen

Füge Platform- oder Projekt-Tags zu Dateinamen hinzu, um Fehlschläge schnell nachzuverfolgen. -

Nach Footage-Verhalten gruppieren

Mische nicht wackelige UGC mit polierter Studio-Footage in einem Batch-Preset. -

Einen Stress-Test pro Gruppe laufen

Nimm den schwierigsten Clip in jeder Kategorie. Schnelle Bewegung, Haare, Text, Menschenmengen. Funktioniert der, folgen die leichteren meist. -

Voll-Jobs über Nacht queuen

Lass die Maschine rendern, wenn du nicht editierst.

Cloud-Batch-Workflow

Cloud-Workflows funktionieren besser bei Volumen, Kollaboration oder Maschinen, die die Last nicht packen.

Der Prozess unterscheidet sich:

- Nur genehmigte Quellen hochladen: Nutze die Cloud nicht als Sortierraum.

- Klare Namenskonventionen verwenden: Versionsverwirrung eskaliert schnell in geteilten Projekten.

- Preset dokumentieren: Sobald ein guter Batch landet, speichere die exakte Konfiguration.

- Review-Verantwortung zuweisen: Jemand muss Outputs spot-checken, nicht nur bestätigen, dass Dateien existieren.

Was nach einem Batch-Run prüfen

Eine fertige Render-Warteschlange ist nicht dasselbe wie ein nutzbarer Batch.

Diese zuerst reviewen:

| Prüfung | Warum wichtig |

|---|---|

| Bewegungs-Konsistenz | Flimmern zeigt sich oft erst beim Abspielen |

| Gesichter und Hände | Aggressive Modelle scheitern hier zuerst |

| Feiner Text und UI | Super für Screen Recordings, leicht zu zerstören |

| Framerate-Integrität | Abweichungen erzeugen Stottern beim Export |

| Aspect Ratio | Falsche Handhabung führt zu awkward Crops später |

Batch-Upscaling spart Zeit nur, wenn dein Verifizierungs-Durchgang schnell und gnadenlos ist.

Fehler, die Skalierung ruinieren

Die größten Fehlschläge kommen meist aus dem Prozess, nicht aus Modellqualität.

- Ein Preset für jeden Clip: Schnell, aber unzuverlässig.

- Kein Sample-Render: So wachst du zu einem Ordner voller unbrauchbarer Dateien auf.

- QC überspringen, weil Thumbnails gut aussehen: Viele Artefakte zeigen sich nur beim Abspielen.

- Upscaling nach mehreren Edit-Exports: Jeder Re-Encode senkt deine Obergrenze.

Für Teams geht es nicht nur um schnellere Verarbeitung. Es geht um vorhersehbare Verarbeitung. Ein stabiles Batch-System macht upscale video ai zum regulären Produktionsteil statt einer Rettungsmission bei jedem Low-Res-Asset.

Post-Upscale-Editing und smarte Export-Presets

Eine upscalierte Datei ist keine fertige Datei.

Sie ist eher wie ein restauriertes Negativ. Du musst sie noch formen, prüfen und für ihren Zielort exportieren. Letzteres zählt, weil Creator oft Auflösung jagen und Delivery-Bedingungen ignorieren.

Die ROI-Frage ist real. Wie Cloudinary’s guide to using AI to upscale video notiert, versprechen viele Tools 4K, aber Plattformen wie TikTok und Instagram Reels downscalen Content eh oft. Das stellt Creator vor eine praktische Frage: Lohnt sich ein 4K-Upscale, oder würde ein optimierter HD-Export für Mobile-First-Viewing genauso gut performen?

Der Cleanup-Durchgang zählt

AI-Modelle führen oft subtile Probleme ein, die in Side-by-Side-Stillbildern nicht auffallen.

Häufige sind:

- Farbdrift: Hauttöne können nach der Verbesserung leicht verschieben.

- Kantenflattern: Feine Details können bei Bewegung pulsieren.

- Textur-Inkonsistenz: Haare, Stoffe und Hintergründe können zwischen scharf und weich wechseln.

Ich behandle Post-Upscale-Editing wie Abschlussarbeit, nicht optionale Politur.

Farbe vor Export fixen

Selbst eine leichte Grading kann das Bild vereinheitlichen. Hauttöne angleichen, Highlights zurückziehen, falls das Upscale sie spröde gemacht hat, und sicherstellen, dass Schwarztöne nicht knackig wurden.

Bewegung im Playback reviewen

Nicht nur Frame-Grabs prüfen. Clip fullscreen anschauen, dann nochmal auf dem Handy. Bewegungsprobleme zeigen sich beim Abspielen, nicht in Screenshots.

Wenn ein Upscale pausiert toll und in Bewegung seltsam wirkt, ist der Export nicht bereit.

Smarte Exports schlagen Max-Exports

Creator greifen oft zu „höchste verfügbare Qualität“. Klingt sicher, ist aber nicht immer nützlich.

Für Short-Form-Distribution in Platform-Fit denken:

| Ziel | Bessere Default-Mindset | Was vermeiden |

|---|---|---|

| TikTok | Sauberes, stabiles HD-Master | Riesige Dateien mit marginalem sichtbarem Gewinn |

| Instagram Reels | Starke Kompressionsresistenz | Über-sharpened Exports, die nach Upload zerbrechen |

| YouTube Shorts | Knackiger Text und stabile Bewegung | Überdimensionierte Renders bei schwacher Quelle |

Der Punkt ist nicht, dass 4K schlecht ist. Es ist, dass 4K nicht automatisch für jeden Social-Upload besser ist.

Praktische Export-Policy

Nutze diese Regelset:

-

Für die Plattform exportieren, nicht für deinen Stolz

Zuschauer kümmern sich um Klarheit und Flüssigkeit mehr als um dein Render-Menü. -

High-Quality-Archive-Master behalten

Sauberes Master für zukünftige Wiederverwendung, Crops oder Client-Delivery speichern. -

Plattform-spezifische Derivate erstellen

Eine Archivdatei, dann Exports für vertical, square oder horizontal. -

Upload-Ergebnis prüfen

Social-Plattformen sind Teil der Render-Kette. Dein lokaler Export ist nicht das finale Aussehen.

Viele Creator kompromittieren Qualität beim Export. Sie investieren in Upscaling, dann übergeben das Finale der Plattform-Kompression ohne Strategie. Smarte Export-Presets schützen die Arbeit, die du schon gemacht hast.

Upscaling in einem ShortGenius-Pipeline automatisieren

Manuelles Upscaling funktioniert bei einem Clip. Es bricht zusammen, wenn du wöchentlich Social-Content über mehrere Kanäle produzierst.

Das ist der Engpass für Teams. Laut Perfect Corp coverage of AI video enhancer workflow limitations ist die größte Herausforderung, Upscaling in Multi-Channel-Workflows zu integrieren, weil die meisten Standalone-Tools keine Batch-Verarbeitung im Scale oder API-Verfügbarkeit bieten. Eine einheitliche Publishing-Pipeline zählt mehr als eine weitere isolierte Enhancement-App.

Was Automation wirklich tun sollte

Eine nützliche automatisierte Pipeline „fügt“ nicht nur Upscale hinzu.

Sie sollte eine Kette handhaben wie diese:

- Quelldatei ingestieren

- Nach Content-Typ routen

- Richtiges Enhancement-Preset anwenden

- Ergebnis in Editing weiterleiten

- Für jeden Kanal resizen und packen

- Distribution planen

Diese Struktur macht Upscaling aus einem Reparatur-Schritt zu Infrastruktur.

Wo es in die Produktion passt

Für Short-Form-Teams ist der beste Einstiegspunkt meist früh. Visuelles Asset bereinigen, bevor Captions, Branding, Reframing und Exports kommen.

Das zählt, weil jeder spätere Schritt auf stabiler Quelle basiert. Fügst du animierte Captions, Cut-Ins und Brand-Overlays auf schwache Footage, dann versuchst du später zu upscalen, zwingst du das Modell, Design-Elemente und Kompressionsschäden gleichzeitig zu interpretieren.

Eine zuverlässigere Reihenfolge ist:

| Stufe | Bessere Sequenz |

|---|---|

| Source Handling | Raw-Clip auswählen und genehmigen |

| Enhancement | Upscale und Bewegung zuerst reinigen |

| Edit-Layer | Captions, Trims, Branding, Voice hinzufügen |

| Distribution | Pro Plattform exportieren und publishen |

Eine Plattform-Erwähnung, wo sie hingehört

In einem einheitlichen Workflow kann ShortGenius in diese Produktionskette als Option für Teams passen, die Video-Assembly, Voiceovers, Editing, Resizing, Scheduling und API-getriebene Automation in einer Umgebung wollen. Solch ein Setup zählt, wenn du raue Footage in wiederholbare Outputs umwandelst, ohne Dateien zwischen Apps zu hüpfen. Wenn du ein breiteres System um wiederkehrende Kanal-Produktion baust, ist diese Anleitung zu https://shortgenius.com/blog/youtube-automatisierung-ki relevant, weil Automation nur funktioniert, wenn jeder Produktionsschritt sauber verbindet.

Was funktioniert und was nicht

Was funktioniert

- Upscaling als Preprocessing-Stufe behandeln

- Presets nach Footage-Klasse speichern

- Wiederholbare Durchgänge automatisieren, nicht ästhetisches Urteil

- Menschlichen Review-Schritt vor Publish behalten

Was nicht

- Jeden Clip durch dasselbe Enhancement-Profil schicken

- Automatisieren ohne QC-Verantwortung

- Pipeline bauen, die manuelles File-Wrangling zwischen Tools braucht

- Annehmen, dass AI-generierte und organische Footage unter Upscale gleich reagieren

Der Gewinn ist nicht nur besser aussehende Footage. Der Gewinn ist, einen weiteren manuellen Engpass aus der Content-Produktion zu entfernen.

Für Agenturen, Brand-Teams und High-Volume-Creator ist das der fundamentale Wandel. Upscaling hört auf, eine spezielle Fix für schlechte Dateien zu sein, und wird zu einem standardmäßigen Hintergrundprozess. Du rettest mehr nutzbare Footage, verbringst weniger Zeit mit repetitiver Reinigung und hältst Output-Qualität konsistent über Kanäle.

Wenn du diesen Workflow in ein wiederholbares System umwandeln möchtest, bringt ShortGenius (AI Video / AI Ad Generator) Video-Erstellung, Editing, Resizing, Voiceovers, Scheduling und automatisierte Publishing in eine Plattform, sodass Upscaling in eine breitere Produktions-Pipeline passt, statt als einmaliger manueller Task zu existieren.