Ein Leitfaden zu rechtlichen Problemen mit KI-Schauspielern in der Werbung

Navigieren Sie die rechtlichen Probleme mit KI-Schauspielern in der Werbung. Unser Leitfaden behandelt Urheberrecht, Persönlichkeitsrechte und FTC-Regeln, um Ihre Kampagnen konform und sicher zu halten.

Die Nutzung von KI-Schauspielern in Ihren Anzeigen eröffnet eine Welt kreativer Möglichkeiten, aber Sie müssen sich unbedingt mit den wichtigsten rechtlichen Problemen bei KI-Schauspielern in der Werbung auseinandersetzen, bevor Sie eintauchen. Die größten Minenfelder sind Urheberrechtsverletzungen im Zusammenhang mit KI-Trainingsdaten, das unbeabsichtigte Verletzen des Persönlichkeitsrechts einer realen Person und Strafen für täuschende Praktiken gemäß FTC-Regeln und neuen staatlichen Deepfake-Gesetzen. Das von Anfang an richtig zu machen, ist der einzige Weg, um ein sehr teures rechtliches Durcheinander zu vermeiden.

Die neuen rechtlichen Risiken von KI-Schauspielern in der Werbung

Der Einstieg in KI-gestützte Werbung ist aufregend, keine Frage. Aber es ist wie das Betreten eines Labyrinths aus rechtlichen Stolperdrähten, von denen Sie nicht einmal wussten, dass sie existieren. Stellen Sie es sich so vor: Sie sind der Regisseur, aber unsichtbare rechtliche Rahmenbedingungen wie Urheberrecht, Persönlichkeitsrechte und Verbraucherschutzgesetze sind die Puppenspieler. Ignorieren Sie sie, und Ihre gesamte Kampagne könnte zusammenbrechen.

Dieses neue Terrain birgt Risiken, denen traditionelle Werbung nie ausgesetzt war. Ihre Marke könnte verklagt werden wegen Urheberrechtsverletzung, nur weil das KI-Modell auf geschützten Bildern ohne Erlaubnis trainiert wurde. Es ist zudem erschreckend einfach, dass ein KI-generiertes Gesicht einem realen Menschen zu ähnlich sieht und eine Klage wegen Diebstahls ihres Äußeren auslöst.

Wichtige rechtliche Herausforderungen im Voraus antizipieren

Die rechtlichen Probleme mit KI-Schauspielern sind keine Hypothesen mehr; sie führen zu realen Kampagnenabbrüchen, massiven Strafen und erheblichen Schäden am Markenimage. Genau zu wissen, wogegen Sie ankämpfen, ist der erste Schritt zu einer Werbestrategie, die innovativ und rechtlich einwandfrei ist.

Hier eine Aufschlüsselung der Punkte, auf die Sie achten müssen:

- Urheberrechtsverletzung: Wurde die KI auf urheberrechtlich geschützten Fotos oder Kunstwerken trainiert? Wenn ja, könnte Ihre fertige Anzeige rechtlich als „abgeleitetes Werk“ gelten und Sie haftbar machen.

- Verletzungen des Persönlichkeitsrechts: Wenn Ihr KI-Schauspieler auch nur vage einem realen Menschen ähnelt – Gesicht, Stimme oder allgemeine Ausstrahlung –, könnten Sie verklagt werden, weil Sie ihr Äußeres ohne Erlaubnis kommerziell genutzt haben.

- Täuschende Werbepraxis: Die Federal Trade Commission (FTC) ist glasklar: Anzeigen müssen wahrheitsgemäß sein. KI-Schauspieler für gefälschte Video-Testimonials oder implizite Empfehlungen zu verwenden, ist ein schneller Weg in die Probleme.

- Deepfake-Gesetze navigieren: Immer mehr Bundesstaaten erlassen Gesetze gegen synthetische Medien. Das schafft ein chaotisches Flickenteppich-Regelwerk, das je nach Zielgruppe variiert.

Um Ihnen ein klareres Bild zu geben, hier eine kurze Zusammenfassung der wichtigsten rechtlichen Hürden.

Wichtige rechtliche Risiken von KI-Schauspielern auf einen Blick

| Rechtsrisikobereich | Bedeutung für Ihre Anzeigen | Mögliche Konsequenz |

|---|---|---|

| Urheberrechtsverletzung | Das KI-Modell wurde mit urheberrechtlich geschützten Bildern trainiert, was Ihre Anzeige zu einem potenziellen „abgeleiteten Werk“ macht. | Klagen, Löschungsaufforderungen und finanzielle Schadensersatzforderungen. |

| Persönlichkeitsrecht | Ihr KI-Schauspieler ähnelt zufällig dem Gesicht, der Stimme oder der markanten Persona einer realen Person. | Rechtliche Schritte der betroffenen Person wegen unbefugter kommerzieller Nutzung ihres Äußeren. |

| FTC & Täuschende Anzeigen | Einsatz von KI für gefälschte Testimonials, irreführende Produkt-Demos oder falsche Empfehlungen. | Hohe FTC-Strafen, rechtliche Sanktionen und schwere Schäden am Markenimage. |

| Deepfake- & Datenschutzgesetze | Verletzung neuer staatspezifischer Gesetze zur Regulierung der Erstellung und Nutzung synthetischer Medien. | Zivil- oder strafrechtliche Strafen, je nach Bundesstaat und Art der Verletzung. |

Diese Risiken zu verstehen und zu navigieren, geht über das Vermeiden von Strafen hinaus; es geht darum, Vertrauen aufzubauen in einer Ära, in der Verbraucher zunehmend skeptisch gegenüber dem sind, was sie online sehen.

Indem Sie diese Risiken proaktiv angehen, verwandeln Sie rechtliche Hürden in einen Wettbewerbsvorteil. Ein konformer Ansatz schützt nicht nur Ihr Geschäft, sondern baut auch Vertrauen bei einem Publikum auf, das synthetische Inhalte zunehmend misstrauisch beäugt.

Letztlich geht es darum, die unglaubliche Kraft der KI zu nutzen, ohne in offensichtliche rechtliche Fallen zu tappen. Es ist ein Ökosystem, zu dem auch die Unternehmen gehören, die diese mächtigen Tools entwickeln. Wenn Sie ein Beispiel sehen möchten, wer in diesem Bereich tätig ist, schauen Sie sich die copycat247-Startseite an. Indem Sie informiert bleiben und einen klaren Konformitätsplan erstellen, können Sie innovativ und selbstbewusst agieren.

Das Urheberrechts-Minenfeld in KI-Trainingsdaten

Bei KI in der Werbung ist der größte rechtliche Kopfschmerz die Urheberrechtsverletzung. Das Problem beginnt damit, wie diese Modelle eigentlich lernen. Generative KI erfindet nicht einfach aus dem Nichts; sie wird auf massiven Datensätzen trainiert, die oft Millionen von Bildern, Videos und Texten enthalten, die direkt aus dem Internet gekratzt wurden. Da fängt der Ärger an.

Stellen Sie sich ein KI-Modell wie einen Musiker vor, der jeden existierenden Song hört, um zu lernen, wie man komponiert. Wenn dieser Musiker dann einen neuen Song spuckt, der verdächtig nach einer berühmten, urheberrechtlich geschützten Melodie klingt, hat er eine Grenze überschritten. Dasselbe Prinzip gilt hier. Ihre Anzeige könnte auf einer Basis unlizenzierter Materialien aufgebaut sein, ohne dass Sie es wissen.

Diese versteckte Haftung bedeutet, dass selbst bei besten Absichten Ihre Marke für Urheberrechtsverletzungen haftbar gemacht werden könnte. Der KI-generierte Schauspieler oder die Szene in Ihrer Anzeige könnte technisch ein „abgeleitetes Werk“ sein – eine neue Kreation, die einem existierenden urheberrechtlich geschützten Stück zu ähnlich ist. Und Sie hätten keine Ahnung, womit es trainiert wurde, um das zu erzeugen.

Die trüben Gewässer der „Substantial Similarity“

Vor Gericht läuft der Test auf Urheberrechtsverletzung oft auf ein Konzept namens „substantial similarity“ hinaus. Es geht nicht darum, zu beweisen, dass eine KI ein Pixel-für-Pixel-Kopie gemacht hat. Es ist viel verschwommener. Die eigentliche Frage ist, ob ein normaler Mensch das KI-Ergebnis ansieht und erkennt, dass es aus einem geschützten Werk kopiert wurde.

Für Werbetreibende ist diese Unklarheit ein enormes Risiko. Wenn eine KI einen Charakter für Ihre Kampagne erzeugt, der denselben skurrilen, erkennbaren Stil wie eine berühmte Cartoon-Figur hat, könnte eine Klage drohen. Der Originalkünstler muss nicht beweisen, dass die KI sein Werk exakt repliziert hat, nur dass das „gesamte Konzept und Gefühl“ dasselbe ist.

Und die rechtlichen Auseinandersetzungen nehmen bereits zu. Bis Ende 2025 gab es allein in den USA 47 Urheberrechtsklagen gegen KI-Unternehmen, viele als Sammelklagen. In prominenten Fällen warfen Unternehmen wie Disney und Universal Studios vor, dass KI-Tools ohne Erlaubnis auf ihren Blockbustern trainiert wurden, was eine ernste Risikokette für alle schafft, die die von diesen Tools erzeugten Visuals nutzen.

Warum Sie sich nicht auf die „Fair Use“-Verteidigung verlassen können

KI-Unternehmen versuchen oft, sich mit dem Argument zu verteidigen, ihr Trainingsprozess sei „fair use“, eine Rechtsdoktrin, die begrenzte Nutzung urheberrechtlich geschützter Materialien für Zwecke wie Forschung oder Kommentar erlaubt. Aber dieses Argument wird unglaublich schwach, sobald die KI-Ausgabe kommerziell genutzt wird – wie in einer Anzeige.

Gerichte prüfen vier Schlüsselfaktoren, um zu entscheiden, ob etwas fair use ist:

- Zweck der Nutzung: Geht es um Profit oder Bildung? Werbung ist rein kommerziell, was ein großer Schlag gegen eine fair-use-Behauptung ist.

- Art des Originalwerks: Kreative Werke wie Fotos und Illustrationen sind viel schwerer zu verteidigen als faktenbasierte Daten.

- Umfang des genutzten Werks: Hat das KI-Modell das „Herz“ des Originals kopiert, auch wenn nicht das Ganze?

- Auswirkung auf den Markt: Schadet das KI-generierte Bild der Fähigkeit des Originalschöpfers, sein Werk zu verkaufen oder zu lizenzieren? Wenn Ihr KI-Bild den Bedarf an einem Stockfoto ersetzt, ist das klarer Marktschaden.

Für Marketer ist das Wetten auf eine fair-use-Verteidigung ein Glücksspiel, das Sie fast sicher verlieren. Die kommerzielle Natur einer Werbekampagne versenkt das Argument von vornherein. Um Ihre eigenen kreativen Assets besser zu schützen, ist ein Blick auf breitere geistige Eigentumsüberlegungen ein kluger Schachzug.

Das Kernproblem ist nicht nur, was die KI schafft, sondern wovon sie gelernt hat. Wenn die Trainingsdaten rechtlich fragwürdig sind, trägt jeder von ihr generierte Inhalt dieses übertragene Risiko direkt in Ihre Werbekampagnen.

Letztlich liegt die Last bei Ihnen – dem Werbetreibenden –, schwierige Fragen zu stellen, woher Ihre KI-Assets stammen. KI-Plattformen zu wählen, die lizenzierte oder ethisch bezogene Trainingsdaten nutzen, ist nicht nur das Richtige; es ist ein kritischer rechtlicher Schutzschild für Ihre Marke.

Den Schutz der menschlichen Identität im KI-Zeitalter

Jenseits des Urheberrechts werden die rechtlichen Probleme mit KI-Schauspielern in der Werbung persönlich. Sehr schnell. Hier stoßen wir auf das Persönlichkeitsrecht – das grundlegende Recht jeder Person, zu kontrollieren, wie ihr Name, Bild und Äußeres für kommerzielle Zwecke genutzt werden.

Stellen Sie es sich als persönliches Markenzeichen Ihrer Identität vor. Wenn Sie KI nutzen, um einen „digitalen Zwilling“ eines Prominenten – oder sogar eines ganz normalen Menschen – für eine Anzeige ohne explizite Erlaubnis zu erzeugen, überschreiten Sie eine ernste rechtliche Grenze. Es ist im Wesentlichen Identitätsdiebstahl zum Profit, und die Gerichte nehmen das nicht auf die leichte Schulter.

Es geht auch nicht nur um perfekte, fotorealistische Kopien. Das Gesetz schützt oft jede Eigenschaft, die direkt auf eine bestimmte Person hinweist. Das könnte ihre Stimme, eine berühmte Pose oder sogar ein Markenzeichen-Spruch sein. Einen virtuellen Influencer zu schaffen, der einem realen Prominenten zu vertraut vorkommt, ist eine Klage in Wartestellung.

Die wachsende Bedrohung durch unbefugte digitale Repliken

Die Explosion der Deepfake-Technologie hat dieses Thema ins Rampenlicht gerückt, und Gesetzgeber ringen darum, mitzuhalten. Bundesstaaten erlassen nun Gesetze speziell gegen die unbefugte Erstellung und Nutzung digitaler Repliken. Für Marketer und Kreative bedeutet das: Die alten Methoden zur Einholung von Zustimmungen sind offiziell tot.

Sie können sich nicht mehr auf ein Standard-Model-Release-Formular verlassen und annehmen, es decke die Erstellung einer KI-Version ab. Der rechtliche Boden hat sich verschoben, und der neue Standard ist explizite, informierte Zustimmung, die KI-Generierung speziell erwähnt. Alles weniger macht Ihre Marke weit angreifbar.

Ein Schlüsselurteil hat diesen Punkt eindrücklich verdeutlicht. Es zeigte, dass selbst wenn Bundes-Urheberrechts- oder Markenrechtsgesetze nicht ganz passen bei Voice-Cloning-Fällen, staatsrechtliche Bürgerrechte- und Persönlichkeitsrechtsgesetze dennoch starken Schutz für Individuen bieten, deren Identitäten von KI entführt werden. Das legt die Last klar bei den Werbetreibenden, diese Staatsgesetze zu kennen und zu respektieren.

Ein KI-sicheres Zustimmungsformular erstellen

Wenn Sie Erlaubnis einholen, um einen KI-Schauspieler auf Basis einer realen Person zu bauen, muss Ihr Ansatz komplett anders sein. Die Zustimmungs- und Freigabequittungen müssen wasserdicht sein und absolut keinen Interpretationsspielraum lassen. Eine wirklich solide KI-Freigabe sollte Ihnen spezifische, eindeutige Rechte geben.

Um auf der sicheren Seite des Gesetzes zu bleiben, muss Ihr Zustimmungsprozess diese Schlüsselpunkte abdecken:

- Explizites Recht zur Erstellung einer digitalen Replik: Das Formular muss unzweideutig angeben, dass Sie beabsichtigen, eine digitale Version der Person mittels KI zu erzeugen.

- Definiertes Nutzungsumfang: Seien Sie präzise. Legen Sie genau fest, wie und wo die KI-Replik verwendet wird – welche Kampagnen, auf welchen Plattformen und wie lange.

- Genehmigungsrechte für KI-Ausgabe: Das ist ein riesiger Verhandlungsgegenstand. Darf die Person die finalen KI-generierten Szenen vor Veröffentlichung prüfen und absegnen?

- Zukünftige Nutzung und Änderungen: Der Vertrag muss klären, ob Sie das Recht haben, die KI-Replik zu verändern oder in zukünftigen, noch nicht geplanten Kampagnen zu nutzen. Vage Formulierungen hier sind eine massive Haftungsquelle.

Um zu sehen, wie sich die Anforderungen geändert haben, vergleichen Sie traditionelle Zustimmung mit dem, was für KI benötigt wird.

Zustimmungs-Checkliste: Realer Mensch vs. KI-Schauspieler

Diese Tabelle hebt die kritischen Unterschiede zwischen einem Standard-Freigabeformular und einem für die Erstellung einer KI-Replik hervor.

| Zustimmungsfaktor | Erforderlich für realen Menschen | Kritisch für KI-Replik |

|---|---|---|

| Nutzung des Äußeren | Standard-Model-Release für Fotos/Videos. | Explizite Erlaubnis zur Generierung eines digitalen Klons. |

| Nutzungsdauer | Klar definierte Zeit (z. B. ein Jahr). | Muss angeben, ob Rechte ewig oder zeitlich begrenzt sind. |

| Änderungsrechte | Begrenzt auf Standard-Bearbeitung (Farbkorrektur usw.). | Muss Rechte zur Änderung der KI-Performance/Dialoge gewähren. |

| Medienumfang | Spezifiziert Plattformen (z. B. Social Media, TV). | Umfassend für alle aktuellen und zukünftigen digitalen Medien. |

Letztlich kommt das Navigieren des Persönlichkeitsrechts im KI-Zeitalter auf Transparenz und Respekt an. Kristallklare Zustimmung ist nicht nur das Abhaken eines rechtlichen Kästchens – es geht darum, Ihre Marke zu schützen und die Rechte der Menschen zu ehren, deren Identitäten Ihre kreative Arbeit antreiben.

Auf der richtigen Seite der FTC bleiben

Jenseits des Labyrinths aus Urheberrecht und Persönlichkeitsrechten tritt ein weiterer großer Akteur in den Ring, wenn Sie KI-Schauspieler nutzen: die Federal Trade Commission (FTC). Die Aufgabe der FTC ist einfach: Verbraucher vor lügenden oder irreführenden Anzeigen zu schützen. Es ist ihnen egal, ob Ihre Anzeige von einem Team Künstler oder einem ausgeklügelten Algorithmus erstellt wurde – wenn sie täuschend ist, ist es ein Problem.

Im Kern ist die FTC-Regel unkompliziert. Eine Anzeige darf nicht täuschen. Dieser Standard gilt für alles, was die Anzeige sagt und impliziert, einschließlich Behauptungen zur genutzten KI-Technologie. Wenn Ihr KI-Schauspieler behauptet, ein neues Proteinpulver baue Muskeln 2x schneller auf, brauchen Sie harte wissenschaftliche Beweise, genau wie bei einem menschlichen Promi.

Die Behörde geht auch hart gegen sogenanntes „AI-Washing“ vor. Das ist, wenn ein Unternehmen seine KI-Fähigkeiten maßlos übertreibt. Ihre Kampagne als bahnbrechende KI-Leistung zu bewerben, wenn sie nur ein paar einfache Automatisierungen macht, ist ein sicherer Weg, auf dem Radar der FTC zu landen.

Die zwei Wahrheiten, die Sie einhalten müssen

Bei KI-Schauspielern jonglieren Sie plötzlich mit zwei Verantwortungsbereichen. Sie müssen ehrlich sein bezüglich dem, was Sie verkaufen, und bezüglich der Technologie, mit der Sie es verkaufen.

Stellen Sie es sich als zweiteilige Integritätsprüfung vor:

- Wahrheit in der Botschaft Ihrer Anzeige: Sind die Behauptungen, Demos oder Testimonials Ihres KI-Schauspielers tatsächlich wahr? Ein KI-generiertes Video eines glücklichen „Kunden“, der über Ihr Produkt schwärmt, ist purer Betrug, wenn dieser Kunde nicht existiert.

- Wahrheit in Ihren Technik-Behauptungen: Übertreiben Sie, was Ihre KI kann? Wenn Sie behaupten, Ihre KI liefere perfekt personalisierte Anzeigen, aber sie wechselt nur die Hintergrundfarbe je nach Standort, täuschen Sie Ihr Publikum.

Die FTC interessiert sich nicht für den technischen Prozess hinter der Anzeige. Sie fokussieren sich auf die Botschaft, mit der ein durchschnittlicher Mensch weggeht.

Regulatoren meinen es ernst

Das ist kein Klaps auf die Finger. Die FTC verfolgt aktiv Unternehmen wegen täuschender KI-Marketing und sendet die klare Botschaft, dass „KI“ als Buzzword kein Freifahrtschein für unbegründete Behauptungen ist.

Die FTC hat klargestellt: Wenn Sie eine Behauptung über Ihre KI machen, müssen Sie sie beweisen können. Werbetreibende brauchen robuste Beweise für jede Leistungsbehauptung, genau wie für jede andere Produktmerkmal.

Und das ist kein ferner Zukunftsszenario – es passiert jetzt. Bis Mitte 2025 hatte die FTC bereits mindestens ein Dutzend Durchsetzungsmaßnahmen gegen „AI-Washing“ eingeleitet. Ein Paradebeispiel war die Klage von August 2025 gegen Air AI, die fälschlich behauptete, ihre KI könne menschliche Verkäufer vollständig ersetzen. Dieser Fall unterstreicht die ernsten rechtlichen und finanziellen Risiken für Marketer, die ihre KI-Tools ohne Beweis übertreiben. Mehr zur sich wandelnden Haltung der FTC zum KI-Recht erfahren Sie hier.

Wann müssen Sie offenlegen?

Das bringt uns zu einer kritischen Frage: Wann müssen Sie mitteilen, dass die Leute einen KI-generierten Schauspieler sehen? Es gibt noch kein einheitliches Bundesgesetz mit fester Regel, aber die allgemeinen FTC-Prinzipien zur Täuschung geben eine klare Leitlinie.

Der Lackmustest lautet: „Würde das Wissen, dass es sich um KI handelt, die Wahrnehmung der Anzeige durch den Verbraucher verändern?“

Wenn Sie einen KI-Schauspieler als echten Arzt einsetzen, der ein Nahrungsergänzungsmittel empfiehlt, oder als realen Kunden, der eine persönliche Geschichte teilt, ist das Verschweigen, dass es KI ist, fast sicher täuschend. Die Unterlassung ist irreführend, weil sie der Empfehlung eine Glaubwürdigkeit verleiht, die sie nicht hat.

Um sicher zu gehen und Vertrauen aufzubauen, werden klare und prominente Offenlegungen zum neuen Standard. Ein einfacher, sichtbarer Tag wie #AIGenerated kann weit helfen, Vorschriften voraus zu sein und auf der richtigen Seite Ihrer Kunden zu stehen.

Ihre praktische Konformitäts-Checkliste für KI-Anzeigen

In Ordnung, lassen Sie uns die Theorie hinter uns lassen und zu dem kommen, was Sie tatsächlich tun müssen. Das Bewältigen des rechtlichen Minenfelds der KI in der Werbung geht um einen soliden, wiederholbaren Prozess. Es geht nicht darum, Kreativität mit Bürokratie zu ersticken; es geht darum, Schienen zu bauen, damit Ihr Team selbstbewusst innovieren kann.

Denken Sie an diese Checkliste als Ihre Vorflug-Routine vor dem Start jeder KI-gestützten Kampagne. Indem Sie diese Schritte direkt in Ihren Workflow einbauen, schaffen Sie eine Basis der Konformität, die Ihre Marke schützt, individuelle Rechte respektiert und Sie auf der richtigen Seite der Regulatoren hält. Lassen Sie uns sie durchgehen.

Schritt 1: Auditieren Sie Ihr KI-Tool und seine Trainingsdaten

Bevor Sie überhaupt an die Generierung eines Bilds denken, müssen Sie unter die Haube Ihrer KI-Plattform schauen. Die rechtliche Lage Ihrer finalen Anzeige hängt direkt von den Daten ab, auf denen das KI-Modell trainiert wurde. Einfach anzunehmen, ein bezahltes Tool sei „sicher“, ist ein massives – und potenziell sehr teures – Risiko.

Sie müssen Ihren KI-Anbieter direkte Fragen stellen und tief in deren Nutzungsbedingungen graben. Jeder seriöse Anbieter sollte offenlegen, woher die Daten stammen.

- Fordern Sie Daten-Transparenz: Fragen Sie direkt: Wurde Ihr Modell mit lizenzierten, Public-Domain- oder ethisch bezogenen Daten trainiert? Eine vage, ausweichende Antwort ist eine riesige Warnlampe.

- Prüfen Sie auf Indemnitäts-Klausel: Übernimmt der Anbieter Ihre Rechtskosten, wenn ihr Tool etwas erzeugt, das Sie verklagt? Das heißt Indemnifizierung. Viele Plattformen schieben 100 % des rechtlichen Risikos auf Sie, den Nutzer.

- Suchen Sie „kommerziell sichere“ Tools: Manche Plattformen vermarkten ihre Modelle explizit als sicher für kommerzielle Nutzung. Das ist oft ein gutes Zeichen, da es bedeutet, dass sie ihre Hausaufgaben zu Datenrechten gemacht haben.

Schritt 2: Wasserdichte Rechte und Zustimmungen sichern

Das ist unverhandelbar. Wenn Ihre Anzeige einen digitalen Doppelgänger einer realen Person beinhaltet – oder sogar einen Avatar, der jemandem ähnelt –, brauchen Sie explizite Zustimmung. Ihr altes Model-Release-Formular reicht hier nicht aus. Ihre Vereinbarungen müssen spezifisch sein und in die Zukunft denken.

Der Name des Spiels ist informierte Zustimmung. Sie müssen glasklar machen, dass Sie beabsichtigen, eine KI-generierte Version einer Person zu erzeugen und zu nutzen, und genau festlegen, wie, wo und wie lange. Jede Unklarheit in diesem Vertrag ist quasi eine offene Einladung zu einer Klage später.

Das ist mehr als eine Unterschrift; es geht um klare Kommunikation. Eine felsensolide KI-Freigabe sollte alle Basen abdecken, um zukünftige Kopfschmerzen zu vermeiden.

- Spezifizieren Sie KI-Generierung: Der Vertrag muss explizit festlegen, dass Sie das Recht haben, eine „digitale Replik“ oder „KI-generiertes Äußeres“ zu erzeugen.

- Definieren Sie den Nutzungsumfang: Gehen Sie ins Detail. Legen Sie fest, auf welchen Plattformen der KI-Schauspieler erscheint, welche Kampagnentypen und die exakte Nutzungsdauer.

- Regeln Sie Änderungsrechte: Erlaubt der Vertrag Anpassungen der KI-Performance? Können Sie den Dialog ändern oder sie in völlig neue Szenen setzen? Schreiben Sie es klar.

Schritt 3: Jede KI-generierte Ausgabe prüfen

Sobald die KI etwas für Sie erzeugt, beginnt die eigentliche Arbeit. Jedes einzelne Bild, Video und Voiceover braucht eine menschliche Überprüfung. Das ist Ihre letzte Verteidigungslinie gegen Verletzungen, und Sie dürfen sie nicht überspringen.

Nehmen Sie nie an, dass ein „neues“ Bild rechtlich sauber ist. Diese Modelle können – und tun – versehentlich geschützte Stile, Charaktere oder sogar Markenlogos nachahmen.

- Prüfen Sie auf „Substantial Similarity“: Sieht oder fühlt sich die Ausgabe einem berühmten Filmcharakter, einem Kunstwerk oder dem Markenstil eines Künstlers zu ähnlich? Wenn Ihr Instinkt „zu nah“ sagt, ist es das wahrscheinlich. Weg damit und neu generieren.

- Scannen Sie auf Marken: Schauen Sie genau in die Hintergründe. Hat die KI ein Logo, einen Markennamen oder eine markante Produktform hereingeschmuggelt?

- Hören Sie auf Stimmenähnlichkeit: Bei Audio-Generierung: Klingt die Stimme unheimlich wie ein berühmter Schauspieler oder öffentliche Figur? Das ist eine potenzielle Persönlichkeitsrechtsverletzung in Wartestellung.

Schritt 4: Klare Offenlegungen umsetzen und Behauptungen belegen

Zuletzt müssen Sie ehrlich zu Ihrem Publikum sein und FTC-Regeln einhalten. Das bedeutet, KI-Nutzung transparent zu machen, wo es zählt, und – am wichtigsten – jede Behauptung Ihrer Anzeige mit harten Beweisen zu untermauern.

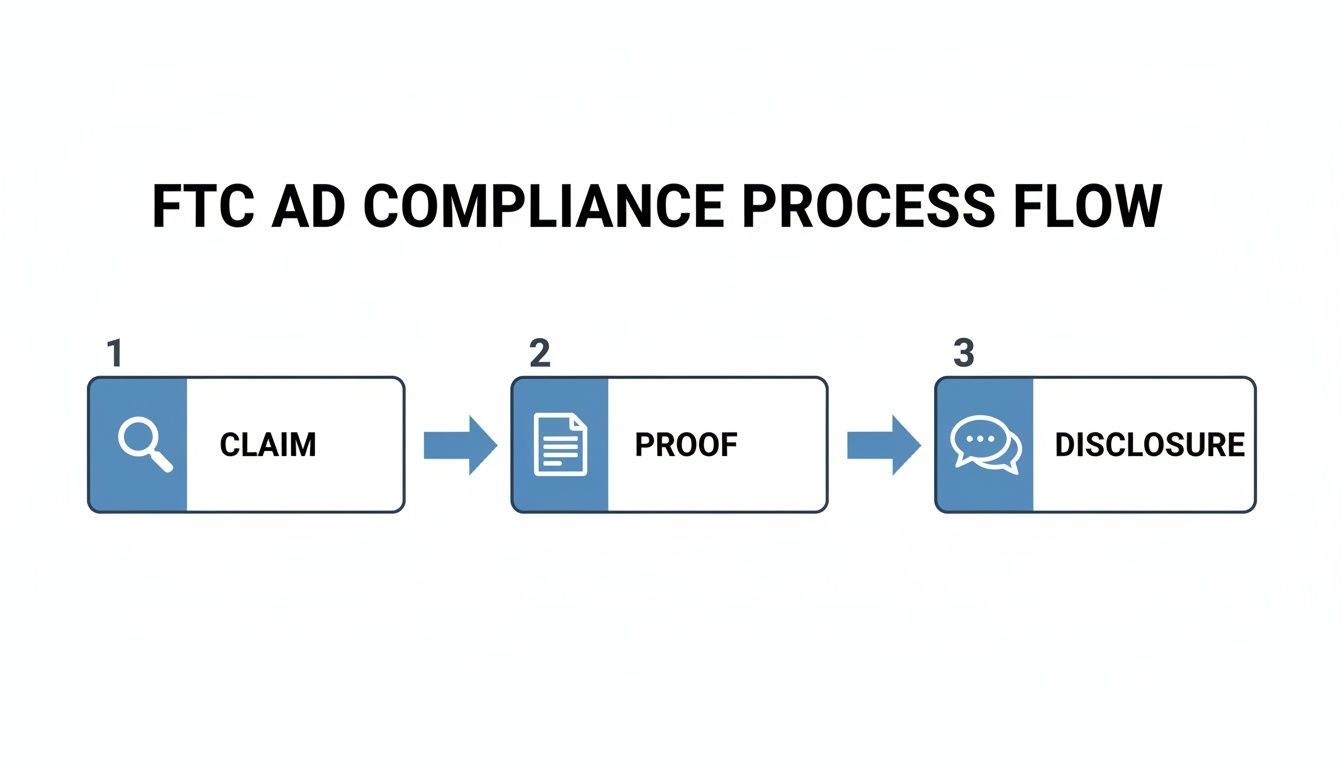

Dieser einfache Flussdiagramm zerlegt die Kern-Erwartung der FTC für jede Anzeige, KI-basiert oder nicht.

Es ist ein simpler Kreislauf: Für jede Behauptung, die Sie machen, brauchen Sie Beweise und eine klare Offenlegung. Dieser Loop sorgt dafür, dass Ihre Werbung wahrheitsgemäß und verteidbar ist.

- Offenlegen, wo es zählt: Wenn ein normaler Mensch denken könnte, Ihr KI-Schauspieler sei echt – wie ein Arzt, der medizinischen Rat gibt, oder ein Kunde, der über ein Produkt schwärmt –, müssen Sie es offenlegen. Ein simpler #AIGenerated oder #AIAd reicht.

- Alle Behauptungen belegen: Jede faktenbasierte Aussage Ihres KI-Sprechers braucht Beweise. Wenn Ihr KI-Sprecher sagt, ein Produkt sei „50 % effektiver“, brauchen Sie die klinische Studie vor dem Launch.

- Eine „Belegdatei“ erstellen: Für jede Kampagne machen Sie zur Gewohnheit, eine Datei mit allen Daten, Studien und Beweisen anzulegen, die Ihre Ansprüche stützen. Wenn die FTC anklopft, ist das Ihr bester Freund.

Häufige Fragen zu KI-Schauspielern in der Werbung

Der Einstieg in KI-gestützte Werbung wirft oft mehr Fragen auf als Antworten. Die rechtliche Seite ist noch ein bisschen wie das Wilde Westen, was es schwer macht, sich sicher zu fühlen. Lassen Sie uns einige der häufigsten Fragen von Marktern zu den rechtlichen Problemen von KI-Schauspielern in Anzeigen angehen. Mein Ziel ist, Ihnen direkte Antworten zu geben, damit Sie klügere, sicherere Kampagnen bauen können.

Muss ich offenlegen, dass meine Anzeige einen KI-Schauspieler nutzt?

Immer öfter lautet die Antwort: Ja. Es gibt zwar kein großes Bundesgesetz, das das für jede Anzeige vorschreibt, aber der Boden verschiebt sich definitiv. Denken Sie darüber nach durch die Linse der FTC-Regeln gegen täuschende Praktiken. Wenn das Verschweigen, dass ein Schauspieler KI ist, jemanden täuscht, müssen Sie es offenlegen. Stellen Sie sich einen KI-generierten „Arzt“ vor, der ein Gesundheitsprodukt bewirbt – dass der Arzt nicht real ist, ist eine große Sache.

Außerdem treffen die Plattformen die Wahl schon für Sie. Große Player wie Meta und YouTube verlangen nun Labels für realistische KI-generierte Inhalte, sodass Offenlegung zum Grundkosten des Geschäfts wird.

Hier die einfache Regel, die ich befolge: Wenn ein normaler Mensch getäuscht werden könnte, fügen Sie eine klare und einfache Offenlegung wie #AIGenerated hinzu. Das geht über kommende Regeln hinaus; es baut Vertrauen bei Ihrem Publikum auf, was unbezahlbar ist.

Offen zu sein, managt Erwartungen und schützt Ihre Marke, besonders wenn die Leute schlauer (und skeptischer) gegenüber synthetischen Medien werden.

Kann ich verklagt werden, wenn mein KI-Tool ein verletzendes Bild erzeugt?

Klar. Ein großer Irrtum ist, dass der Anbieter des KI-Tools den Dreck aufräumen muss, wenn es schiefgeht. So funktioniert Urheberrecht nicht. Das Unternehmen, das die verletzende Anzeige veröffentlicht – also Ihres – kann direkt haftbar gemacht werden. Das heißt oft sekundäre Haftung, und es bedeutet, Sie teilen das Risiko.

Selbst wenn die KI-Plattform auch Ärger bekommt, lässt das Sie nicht vom Haken. Deshalb müssen Sie die Nutzungsbedingungen jedes KI-Tools lesen. Manche bieten Indemnifizierung (sie übernehmen Ihre Rechtskosten), aber viele schieben die volle Verantwortung auf Sie als Nutzer.

Ihre beste Verteidigung ist Proaktivität. Prüfen Sie jedes KI-generierte Bild auf unheimliche Ähnlichkeiten zu existierenden urheberrechtlich geschützten Werken. Und bleiben Sie bei KI-Plattformen, die transparent über ihre Trainingsdaten sind – solche mit legal lizenzierten oder Public-Domain-Daten sind immer sicherer.

Was ist der Unterschied zwischen einem Stockfoto und einer KI-Person?

Der Schlüsselunterschied liegt darin, woher die Rechte stammen. Bei einem lizenzierten Stockfoto einer Person liegt ein Model Release vor. Das ist ein rechtliches Dokument, in dem der reale Mensch in dem Foto seine Zustimmung zur kommerziellen Nutzung seines Äußeren gegeben hat. Es ist Ihre rechtliche Sicherheitsdecke.

Eine KI-generierte Person hat kein Model Release, weil sie nun mal nicht existiert. Aber das öffnet eine ganze Dose Würmer, mit der Sie bei Stockfotos nicht rechnen müssen.

- Zufälliger Doppelgänger: Das KI-Bild könnte rein zufällig wie ein realer Mensch aussehen und eine überraschende Persönlichkeitsrechtsklage auslösen.

- Urheberrechtsfallen: Das Bild selbst könnte auf Basis der Trainingsdaten der KI angefochten werden. Wenn das Modell aus einer Datenbank geschützter Bilder lernte, könnte Ihre „originale“ KI-Person rechtlich eine verletzende Kopie sein.

Im Grunde tauschen Sie bei einer KI-Person einen bekannten, klaren rechtlichen Prozess (Model Releases) gegen ein neues, undurchsichtiges Risikobündel aus Urheberrecht und Identität.

Wie erstelle ich sicher einen KI-Brand-Avatar?

Wenn Sie einen KI-Brand-Avatar oder Influencer ohne furchterregenden Brief von einem Anwalt später erstellen wollen, brauchen Sie einen Plan. Improvisieren geht nicht.

Beginnen Sie damit, sicherzustellen, dass der Avatar wirklich einzigartig ist. Seien Sie kreativ mit detaillierten Prompts und passen Sie die Ergebnisse manuell an, um das finale Aussehen weit weg von realen Menschen oder existierenden Charakteren zu lenken. Halten Sie einen Nachweis dieses kreativen Prozesses – das könnte entscheidendes Beweismaterial sein, um zu zeigen, dass Sie etwas völlig Originelles beabsichtigten.

Geben Sie Ihrem Avatar einen einzigartigen Namen und eine Hintergrundgeschichte ohne Verbindung zu realen Personen. Führen Sie eine Markensuche für den Namen des Avatars und sogar sein visuelles Design durch, um sicherzustellen, dass Sie nicht auf Zehen anderer Marken treten.

Zuletzt durchforsten Sie die Nutzungsbedingungen Ihres KI-Tools. Sie müssen sicherstellen, dass sie Ihnen volle kommerzielle Eigentumsrechte oder mindestens eine breite kommerzielle Lizenz für alles Gewriegene geben. Transparent zu sein gegenüber Ihrem Publikum, dass der Avatar KI ist, hilft auch enorm, rechtliche und PR-Probleme abzuwenden.

Bereit, hochperformante Anzeigen ohne rechtliche Unsicherheiten und hohe Produktionskosten zu erstellen? ShortGenius ist eine KI-Werbeplattform für Kreative und Marketer, die atemberaubende Short-Form-Video- und Bildanzeigen für alle großen Social-Plattformen brauchen. Generieren Sie Konzepte, Skripte und Visuals in Sekunden, passen Sie sie mit Ihrem Brand-Kit an und starten Sie Kampagnen, die Ergebnisse liefern. Testen Sie ShortGenius heute und bauen Sie bessere Anzeigen, schneller.