Leitfaden für Creator: Lip Sync AI meistern

Entdecken Sie, wie Lip Sync AI die Videoerstellung revolutioniert. Erfahren Sie, was es ist, wie es funktioniert und wie Sie es nutzen, um perfekt synchronisierte Inhalte für ein globales Publikum zu erstellen.

Hast du dich je gefragt, ob du in deinen Videos jede Sprache sprechen kannst, wobei dein Mund jedes einzelne Wort perfekt nachahmt, auch wenn du die Sprache nicht kennst? Genau das macht Lip-Sync-KI möglich. Im Kern nimmt diese Technologie eine separate Audispur und animiert automatisch den Mund einer Person – oder eines Avatars – perfekt synchron dazu.

Das ist nicht nur ein cooler Partytrick; es ist ein riesiger Fortschritt, der Content-Erstellung und Lokalisierung für alle zugänglich macht.

Warum Lip-Sync-KI für Creator wichtig ist

Stell dir Lip-Sync-KI als digitalen Puppenspieler für deine Videos vor. Lange Zeit war realistische Lip-Synchronisation nur etwas für High-Budget-Filmstudios mit dedizierten VFX-Teams möglich. Das bedeutete, Mundbewegungen frameweise mühsam zu animieren. Jetzt liegt diese Power in den Händen von Creatorn überall, und es verändert komplett, wie Videos für Plattformen wie YouTube, TikTok und Instagram produziert werden.

Die Haupt Aufgabe dieser KI ist es, die Lücke zwischen dem, was du siehst, und dem, was du hörst, zu schließen, und so ein nahtloses und überzeugendes Erlebnis für den Zuschauer zu schaffen. Vergiss die alten, klobigen Dubs, bei denen der Ton schmerzhaft asynchron war. Diese Tech sorgt dafür, dass der Mund des Sprechers in perfekter Harmonie mit einer neuen Audispur bewegt wird, egal ob das eine andere Sprache, ein neu aufgenommener Voiceover oder sogar ein Skript ist, das von einer KI-Stimme gelesen wird.

Deine Reichweite erweitern und Zeit sparen

Der Einfluss auf Content-Creator ist enorm. Du bist nicht mehr auf deine Muttersprache beschränkt oder musst teure Nachdrehs machen, nur um einen kleinen Audiofehler zu beheben.

Diese Technologie gibt dir die Power zu:

- Sprachbarrieren durchbrechen: Deine Videos sofort in mehrere Sprachen dopen. Du kannst deinen Content für riesige internationale Zielgruppen öffnen, ohne ein Wort Spanisch, Japanisch oder Hindi zu sprechen.

- Content mühelos skalieren: Nimm ein Video und passe es für verschiedene globale Märkte an. Du musst nur die Audiodatei austauschen und die KI übernimmt den Rest.

- Produktionswert steigern: Professionell klingende Voiceovers für deine Ads oder Social-Media-Videos erstellen und sicherstellen, dass dein On-Screen-Talent oder Avatar komplett natürlich und authentisch wirkt.

Das ist nicht nur eine technische Neuheit; es ist ein strategischer Vorteil. Lip-Sync-KI ermöglicht es Solo-Creatorn und kleinen Teams, global zu konkurrieren, und multilingualen Content zu produzieren, der früher nur großen Medienkonzernen möglich war.

Letztendlich geht es mit diesem Tool darum, smarter zu arbeiten, nicht härter. Indem es eine einst mühsame Postproduktionsaufgabe automatisiert, kannst du dich auf das konzentrieren, was du am besten kannst: Tolle Ideen entwickeln. Um das große Ganze zu verstehen, hilft es, die breitere Welt der AI Powered Content Creation und wie Tools wie dieses die gesamte Branche umgestalten, kennenzulernen. Lip-Sync-KI ist ein Schlüsselstück dieses Puzzles und gibt dir die Fähigkeit, authentischer mit mehr Menschen in Kontakt zu treten.

Wie Lip-Sync-KI eigentlich funktioniert

Hast du dich je gefragt, was unter der Haube einer Lip-Sync-KI vor sich geht? Es ist nicht nur eine digitale Puppenshow, die einen Mund auf und zu bewegt. Stell es dir eher wie einen ausgeklügelten Übersetzungsdienst vor, der statt Wörter von einer Sprache in eine andere zu konvertieren, Laute in unglaublich präzise Gesichtsbewegungen übersetzt.

Lass uns eine Analogie verwenden. Wenn du einem Roboter das Sprechen beibringen würdest, würdest du ihm nicht nur das Alphabet zeigen. Du würdest ihm beibringen, wie jeder Buchstabe klingt. Lip-Sync-KI macht etwas Ähnliches, indem sie deine Audispur in die kleinsten Klangeinheiten zerlegt, die Phoneme genannt werden. Zum Beispiel wird das Wort „hello“ in einzelne Laute wie „h“, „eh“, „l“ und „ow“ zerlegt.

Sobald die KI diese Phoneme identifiziert hat, macht sie sich an ihre Hauptaufgabe: Jedem Laut die exakte Mundform zuzuordnen, die eine Person macht, wenn sie ihn sagt. Diese visuellen Mundformen heißen Viseme. Die KI wurde mit Bergen von Daten trainiert, sodass sie instinktiv weiß, dass der „f“-Laut bedeutet, dass die oberen Zähne die Unterlippe berühren. Es ist eine blitzschnelle Übersetzung von Audio zu Visual.

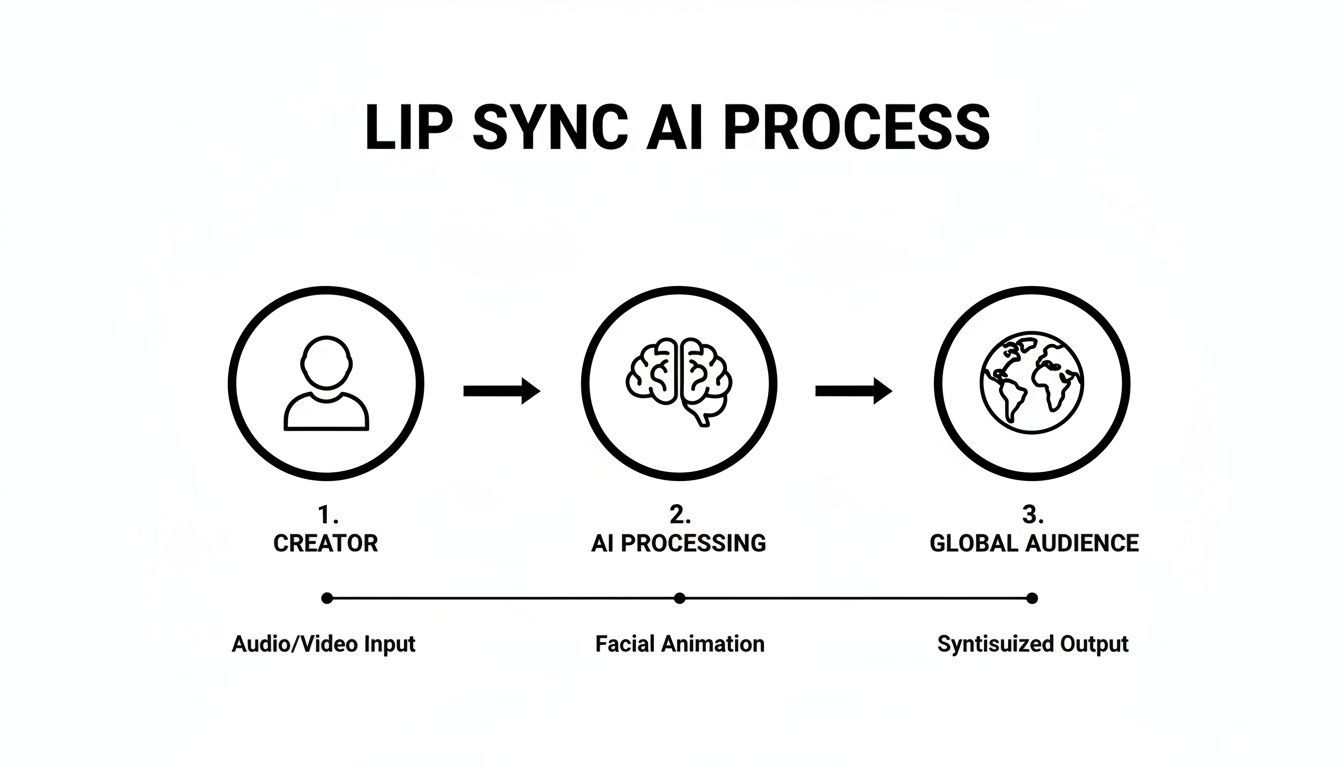

Dieses Diagramm zerlegt, wie ein Content-Stück von einer einfachen Aufnahme auf deiner Seite zu einem Video wird, das für ein globales Publikum bereit ist.

Wie du siehst, liefert der Creator die Rohmaterialien, die KI erledigt die schwere Arbeit, und das Ergebnis ist polierter Content, der Zuschauer überall anspricht.

Die zwei Kernzutaten

Um diese digitale Magie zu zaubern, braucht die KI wirklich nur zwei Dinge von dir. Diese Einfachheit ist ein großer Teil dessen, was Tools wie ShortGenius so nützlich für Creator macht, die schnell arbeiten müssen.

- Die Audiodatei: Das ist dein Bauplan. Es könnte ein Voiceover sein, das du gerade aufgenommen hast, eine professionell gedoppte Audiospur für eine neue Sprache oder jede andere Aufnahme von jemandem, der spricht. Je sauberer das Audio, desto besser. Klar, knackige Sprache gibt der KI eine viel einfachere Menge an Phonemen, was immer zu einem genaueren und überzeugenderen Ergebnis führt.

- Das Video oder der Avatar: Das ist deine Leinwand. Du kannst ein Video von einer realen Person oder sogar ein statisches Bild eines KI-generierten Avatars verwenden. Die KI nutzt diese visuelle Basis, um neue, perfekt synchronisierte Mundbewegungen zu generieren und zu überlagern.

Aber moderne Deep-Learning-Algorithmen hören nicht dort auf. Sie gehen einen Schritt weiter, indem sie die Nuancen im Audio analysieren – den Ton, die Emotion, sogar die Geschwindigkeit des Sprechers. Das macht die finale Animation viel natürlicher. Im Kern geht es bei Lip-Sync-KI um die experte Fähigkeit, Audio und Video zu synchronisieren, so nahtlos, dass der Zuschauer nie darüber nachdenkt.

Das Fazit lautet: Es geht nicht nur um bewegte Lippen. Es ist eine tiefe Analyse von Klängen, die Sprache in realistische Gesichtsausdrücke übersetzt und die kleinen Details einfängt, die eine Performance wirklich menschlich wirken lassen.

Dieses Maß an Automatisierung treibt ernsthaftes Branchenwachstum an. Der globale Markt für Lip-Sync-Technologie soll von USD 1,12 Milliarden im Jahr 2024 auf geschätzte USD 5,76 Milliarden bis 2034 springen. Die Tatsache, dass audio-gesteuertes Machine Learning bereits einen 40,7%igen Marktanteil hält, zeigt, wie essenziell diese Tech für die Globalisierung von Content geworden ist.

Diese gleiche Technologie ist ein Schlüsselbestandteil vieler KI-Video-Tools. Sie ermöglicht es einem Creator, ein einzelnes Standfoto in ein überzeugendes, dynamisches Video zu verwandeln. Du kannst tiefer eintauchen, indem du unseren Guide anschaust, wie man Bilder mit KI in Videos umwandelt.

Praktische Anwendungen für Creator und Marketer

Die technischen Details von Lip-Sync-KI zu kennen ist eine Sache, aber die echte Magie passiert, wenn du siehst, wie sie neue kreative und geschäftliche Türen öffnet. Für Creator und Marketer ist das keine bloße Neuheit; es ist ein ernstzunehmendes Tool, um Content zu skalieren, neue Märkte anzuzapfen und wirklich mit Zielgruppen auf der ganzen Welt in Kontakt zu treten.

Der offensichtlichste und mächtigste Anwendungsfall ist Content-Lokalisierung. Sagen wir, du hast einen viralen TikTok oder ein YouTube-Tutorial, in das du dein Herzblut gesteckt hast. Statt dich auf Englisch-Sprecher zu beschränken, kannst du jetzt Versionen für spanisch-, hindi- oder japanischsprachige Zielgruppen fast instant erstellen. Die KI legt nicht einfach eine neue Audiospur drauf – sie animiert deine Lippenbewegungen sorgfältig neu, um zur neuen Sprache zu passen, sodass das finale Video komplett natürlich wirkt.

Das schreibt das Playbook für globale Expansion komplett um. Der alte Weg, eine Video-Kampagne zu lokalisieren, beinhaltete das Einstellen von Sprechern für jede Sprache, das Buchen teurer Studiozeit und das Durchackern von Wochen oder Monaten Postproduktion. Jetzt ist dieser gesamte Workflow schneller und viel günstiger.

Von globalen Ads bis zu KI-Avataren

Jenseits der reinen Übersetzung von Videos schaltet Lip-Sync-KI eine ganze Palette von Strategien für Markenaufbau und überzeugende Ads frei. Im Kern nutzt jede Anwendung die Fähigkeit, das, was jemand sagt, von dem zu trennen, wie er dabei aussieht.

Hier sind ein paar spielerändernde Wege, wie diese Technologie gerade genutzt wird:

- Überzeugende KI-Avatare erstellen: Nimm ein einzelnes Bild – von einem Maskottchen, einem Gründer oder einem virtuellen Influencer – und bring es zum Leben. Füttere es mit einem Text-to-Speech-Voiceover, und du hast eine endlose Versorgung mit Social-Media-Content, ohne dass jemand vor eine Kamera muss.

- Ad-Kampagnen lokalisieren: Eine Marke kann eine fantastische, high-budget Ad produzieren und dann KI nutzen, um sie für Dutzende internationale Märkte anzupassen. Das hält die Branding konsistent, während die Botschaft lokal und persönlich wirkt. Dieser Ansatz ist ein Lebensretter für Ad-Plattformen, die einen stetigen Strom frischer Creatives verlangen. Du kannst sehen, wie das in einer breiteren Strategie funktioniert, in unserem Guide zu effektiven AI UGC-style Ads.

- Mühelose Audio-Korrekturen: Wir kennen das alle. Du hast einen perfekten Video-Edit fertig, nur um einen Fehler im Voiceover zu bemerken. Statt frustrierendem Nachdreh kannst du einfach die korrigierte Audiozeile aufnehmen und die KI nahtlos einpatchen lassen, mit perfekter Lippenpassung.

Die echte Power hier liegt im Entkoppeln von Visual und Audio. Das gibt Creatorn immense Flexibilität, um zu experimentieren, Fehler zu korrigieren und Content für verschiedene Plattformen und Zielgruppen anzupassen, ohne jedes Mal von vorne zu beginnen.

Um zu zeigen, wie diese Ideen zum Leben erweckt werden, hier eine schnelle Aufschlüsselung, wie Creator und Marken Lip-Sync-KI einsetzen.

Lip-Sync-KI-Anwendungen für Creator und Marken

| Use Case | Primary Benefit | Example Application |

|---|---|---|

| Global Content Distribution | Audience Growth | Ein YouTuber übersetzt sein Top-Video in 5 neue Sprachen, um ein globales Publikum zu erreichen, und verdreifacht so die potenzielle Reichweite. |

| Multilingual Ad Campaigns | Increased ROI | Eine D2C-Marke erstellt 10 lokalisierte Versionen einer einzigen Ad für verschiedene Länder und verbessert Relevanz und Conversion-Rates. |

| AI Influencers & Avatars | Content Scalability | Ein Unternehmen nutzt sein animiertes Maskottchen für tägliche Social-Media-Updates, ohne ein Video-Team für jeden Post zu brauchen. |

| Post-Production Fixes | Time & Cost Savings | Ein Filmemacher korrigiert eine falsch gesprochene Zeile in einer entscheidenden Szene, ohne nachzudrehen, und spart Tausende von Dollar. |

Das ist keine kleine Verbesserung – es ist ein fundamentaler Wandel, wie Videos gemacht werden.

Der Markt für KI-Video-Dubbing wurde 2024 mit $31,5 Millionen bewertet und soll bis 2032 auf $397 Millionen explodieren. Dieses explosive Wachstum kommt von der enormen Zeit- und Kostenersparnis. Eine mehrsprachige Kampagne, die früher ein riesiges Budget und Monate Arbeit brauchte, kann jetzt in weniger als einer Woche für unter $2.000 umgesetzt werden und legt globale Reichweite in die Hände von Solo-Creatorn. Du kannst mehr über die sich wandelnde Ökonomie der AI Lip-Sync-Technologie erfahren und sehen, wie sie die gesamte Creator-Economy verändert.

Wie du das richtige Lip-Sync-KI-Tool auswählst

Bei der Flut neuer Tools auf dem Markt fühlt sich die Auswahl des richtigen Lip-Sync-KI-Tools wie ein Schuss ins Blaue an. Aber nicht alle Plattformen sind gleich gebaut, und die falsche Wahl kann dich mit robotischen, awkward wirkenden Videos zurücklassen, die Zuschauer abschrecken statt zu fesseln. Du brauchst eine einfache Checkliste, um den Marketing-Hype zu durchschauen.

Der absolut wichtigste Faktor ist die Qualität der Sync selbst. Sieht das finale Video natürlich aus, oder rutscht es in das gruselige „Uncanny Valley“? Ein gutes Tool versteht die winzigen, subtilen Bewegungen eines echten Munds – wie er sich um verschiedene Laute formt und mit dem Ausdruck des Sprechers verbindet.

Eine billige oder schlecht trainierte KI könnte den Mund einfach auf und zu flattern lassen, was sofort verrät, dass etwas gefakt ist. Der beste Weg, das zu beurteilen, ist, denselben kurzen Audioclip durch ein paar verschiedene Tools zu jagen. Stelle die Ergebnisse nebeneinander und vertraue deinem Bauchgefühl.

Wichtige Features und Performance bewerten

Jenseits reiner Realismus musst du an deine spezifischen kreativen Bedürfnisse denken. Das perfekte Tool für einen multilingualen Corporate-Trainer ist wahrscheinlich Overkill für einen Meme-Creator. Ein solider Evaluationsprozess von vornherein spart dir später Kopfschmerzen.

Hier sind die essenziellen Dinge, auf die du achten solltest:

- Sprachen- und Akzentunterstützung: Das ist ein Dealbreaker, wenn du globale Zielgruppen erreichen willst. Finde heraus, wie viele Sprachen das Tool unterstützt und, ebenso wichtig, wie gut es mit verschiedenen Akzenten und Dialekten umgeht. Ein Tool, das einen Glasgower Akzent nagelt, ist viel beeindruckender als eines, das nur mit einer generischen, robotischen Stimme klarkommt.

- Verarbeitungsgeschwindigkeit: Wie lange musst du auf eine Progress-Bar starren für einen einminütigen Clip? In der Welt des Short-Form-Contents ist Speed alles. Manche Plattformen liefern in Minuten ab, andere lassen dich ewig warten.

- Bedienfreundlichkeit: Ein Tool mit einer Million Features ist nutzlos, wenn die Oberfläche ein Albtraum ist. Suche nach einem cleanen, einfachen Design, das dir erlaubt, Video und Audio hochzuladen und die Lip-Sync in ein paar Klicks anzuwenden. Plattformen wie ShortGenius machen diesen Schritt zu einem nahtlosen Teil eines viel größeren Video-Produktions-Pipelines.

Das ultimative Ziel ist eine Lösung zu finden, die in deinen bestehenden Prozess passt, ohne neue Engpässe zu schaffen. Das richtige Tool sollte sich wie eine Erweiterung deines kreativen Toolkits anfühlen, nicht wie eine weitere komplizierte Software, die du lernen musst.

Integration und Markttrends berücksichtigen

Denk schließlich ans große Ganze. Wie passt diese Lip-Sync-KI in deinen Workflow? Spielt sie gut mit deinen geliebten Video-Editoren? Kann sie die Videoformate und Auflösungen handhaben, die du brauchst? Nahtlose Integration ist genauso kritisch wie technische Performance.

Das explosive Wachstum in diesem Bereich sagt alles. Der Markt für KI in Medien, einschließlich Lip-Sync-Tech, soll von USD 8,21 Milliarden im Jahr 2024 auf USD 51,08 Milliarden bis 2030 anwachsen. Diese rasante Expansion bedeutet, dass ausgefeilte audio-visuelle KI schnell zu einem Kernbestandteil jeder modernen Content-Strategie wird. Mehr Details zum AI-Media-Markt auf datainsightsmarket.com findest du hier.

Indem du ein gut unterstütztes Tool wählst, das ständig besser wird, löst du nicht nur ein Problem für heute – du investierst in deine Fähigkeit, jahrelang tollen Content zu erstellen.

Ein Schritt-für-Schritt-Guide zu deinem ersten Lip-Sync-Video

Okay, lass uns die Hände schmutzig machen. Dein erstes Video mit Lip-Sync-KI zu machen ist nicht so kompliziert, wie es klingt. Wir können es in einen einfachen Vier-Schritte-Prozess zerlegen, der dich von einer groben Idee zu einem fertigen Video bringt, das du teilen kannst.

Das ist der grundlegende Workflow, den du in Plattformen wie ShortGenius findest, die diese powerful Tech direkt in Reichweite legen.

Schritt 1: Bereite deine Audi Spur vor

Alles beginnt mit dem Audio. Denk daran als an den Bauplan für dein Video – die KI braucht eine saubere, klare Spur, um herauszufinden, welche Mundformen sie erstellen soll. Du kannst deine eigene Stimme aufnehmen oder einen hochwertigen Text-to-Speech-Generator für eine konstant knackige Narration verwenden.

Für das beste Ergebnis achte darauf, dass dein Audio wenig bis gar kein Hintergrundgeräusch hat. Klar sprechen macht auch einen riesigen Unterschied. Je deutlicher deine Wörter sind, desto besser kann die KI die Lippenbewegungen anpassen. Dieser erste Schritt richtig zu machen, legt den Grundstein für ein viel überzeugenderes Ergebnis.

Schritt 2: Wähle dein Video oder deinen Avatar

Als Nächstes musst du wählen, wer (oder was) sprechen wird. Das kann ein Video-Clip sein, den du schon hast, von jemandem, der spricht, oder einfach ein statisches Bild eines KI-Avatars, den du erstellt hast. Der Schlüssel ist ein klares Bild des Gesichts.

Hier ein Pro-Tipp: Ein gerader, frontaler Winkel funktioniert am besten. Die KI braucht einen direkten, unverschlossenen Blick auf den Mund, um realistische Bewegungen zu generieren. Wenn das Gesicht abgewandt ist oder etwas die Sicht blockiert, sieht die finale Animation ein bisschen daneben aus.

Die Qualität deiner Inputs bestimmt direkt die Qualität deines Outputs. Ein scharfes, gut beleuchtetes Video und sauberes Audio geben der KI das beste Material, minimieren Fehler und sorgen für ein lebensechteres Ergebnis.

Schritt 3: Wende die Lip-Sync-KI an

Hier beginnt der echte Spaß, und es ist meist nur eine Knopfdruck-Sache. Sobald du deine Audio- und Videodateien ins Tool hochgeladen hast, wendest du einfach die Lip-Sync-Funktion an. Die KI macht sich dann ans Werk, zerlegt die Laute in deinem Audio und erstellt brandneue Mundbewegungen auf deinem Video-Subjekt, die passen.

Der gesamte Prozess ist überraschend schnell, dauert oft nur Minuten. Während die KI die schwere Arbeit macht, kannst du dich auf den letzten und wichtigsten Schritt vorbereiten.

Schritt 4: Überprüfe und verfeinere das Output

Keine KI ist jedes Mal perfekt, daher ist eine finale Überprüfung entscheidend. Schau dir das generierte Video an und achte genau auf das Timing. Sieht die Sync natürlich aus? Gibt es seltsame Zuckungen oder Momente, wo die Lippen nicht ganz zum Audio passen?

Die meisten guten Tools bieten Optionen für kleine Anpassungen. Manchmal hilft es schon, das Audio-Timing leicht zu verschieben oder einen bestimmten Abschnitt neu zu laufen zu lassen, um Unebenheiten zu glätten. Sobald du zufrieden bist, ist dein Video exportbereit. Dieser gesamte Prozess ist ein Kernbestandteil vieler KI-Video-Workflows, und du kannst sehen, wie er ins große Ganze passt, in unserem Guide zu Text-to-Video-KI-Modellen.

Hast du Fragen zu Lip-Sync-KI? Wir haben Antworten.

Bei jedem neuen Tech-Sprung kommen Fragen auf. Das ist total normal. Lass uns einige der häufigsten angehen, die ich von Creatorn zu Lip-Sync-KI höre, damit du direkt loslegen kannst.

Wie geht Lip-Sync-KI mit verschiedenen Sprachen um?

Das ist eine große. Die gute Nachricht: Die meisten Top-KI-Modelle sind auf gigantischen Datensätzen trainiert mit unzähligen Stunden multilingualer Sprache. Das macht sie überraschend gut darin, nicht nur verschiedene Sprachen, sondern auch Akzente zu handhaben. Es geht nicht nur um Wörter; es geht darum, die spezifischen Mundformen – der technische Begriff ist Viseme – zu lernen, die zu jedem einzigartigen Laut gehören.

Klar, nicht alle Tools sind gleich. Die Performance kann stark variieren, weshalb ich immer empfehle, einen kurzen Testclip in deiner Zielsprache zu laufen, bevor du dich auf ein großes Projekt festlegst. Die besten Systeme erfassen diese subtilen Nuancen und lassen den Sprecher wie einen Native wirken, statt eine generische „Einheitsgröße“-Mundbewegung anzuwenden, die einfach daneben ist.

Was ist der Unterschied zwischen Lip-Sync und Dubbing?

Es ist leicht, das zu verwechseln, aber es sind zwei Seiten derselben Medaille, die zusammenarbeiten, um ein Video in einer neuen Sprache authentisch wirken zu lassen.

Stell es dir so vor:

- Video-Dubbing: Das geht um das Audio. Es ist der Prozess, die originale Stimmspur durch eine neue zu ersetzen, meist in einer anderen Sprache.

- Lip-Sync: Das ist der visuelle Nachfolger. Sobald die neue Audio drauf ist, macht die KI sich ans Werk und verändert digital die Mundbewegungen des Sprechers, um perfekt zur neuen Dialog zu passen.

Wenn du sie kombinierst, bekommst du ein komplett lokales Video. Der Sound stimmt, und die Visuals passen. Eins kümmert sich um das, was du hörst, das andere um das, was du siehst.

Dieser One-Two-Punch ermöglicht es einem Creator, ein einzelnes Video weltweit nativ wirken zu lassen, ohne dieses ablenkende, asynchrone Gefühl, das den Zuschauer sofort aus dem Erlebnis reißt.

Wie vermeide ich den gruseligen „Uncanny-Valley“-Effekt?

Ah, das „Uncanny Valley“. Dieses seltsame, unheimliche Gefühl, wenn etwas fast menschlich wirkt, aber ein paar subtile Dinge einfach nicht stimmen. Es ist eine echte Sorge bei Lip-Sync-KI, aber du kannst es absolut vermeiden.

Zuerst immer mit hochwertigem Ausgangsmaterial starten. Ein klares, gut beleuchtetes Video oder ein polierter Avatar gibt der KI eine viel sauberere Leinwand. Wenn du unscharfe oder low-res Footage fütterst, forderst du quasi ein weirdes Ergebnis heraus.

Als Nächstes auf deine Audioqualität achten. Verwende eine hochwertige KI-Stimme, die natürlich klingt, oder besser, eine saubere Aufnahme eines menschlichen Sprechers. Eine robotische, flache Stimme mit realistischen Lippenbewegungen ist ein Rezept für sofortiges Gruseln.

Zuletzt, subtile menschliche Touches hinzufügen. Eine reine KI-Szene kann steril wirken. Kleine Dinge wie natürliche Kopfdrehungen, realistisches Blinzeln oder einfach ein interessanter Hintergrund können das gesamte Video geerdeter und lebendiger machen und es direkt aus dem Uncanny Valley holen.

Bereit, atemberaubende, mehrsprachige Videos ohne Aufwand zu erstellen? ShortGenius integriert powerful Lip-Sync-KI-Fähigkeiten in einen vollständigen Video-Erstellungs-Workflow. Produziere professionelle Ads und Social-Content in Minuten. Kostenlos auf shortgenius.com starten.