Débloquez une qualité époustouflante : Upscale vidéo IA

Apprenez un flux de travail pratique pour l'upscale vidéo IA. Préparation des rushes, paramètres optimaux, traitement par lots et exportation pour les réseaux sociaux avec ShortGenius.

Vous avez un clip qui devrait fonctionner.

Peut-être s’agit-il d’un ancien témoignage client enregistré avec un téléphone. Peut-être s’agit-il d’images générées par les utilisateurs qui capturent l’émotion à la perfection, mais qui paraissent floues sur un écran moderne. Peut-être s’agit-il d’une ancienne vidéo performante que vous voulez republicer, recadrer et transformer en actifs courts frais. L’idée est forte. Le fichier source ne l’est pas.

C’est là que la mise à l'échelle vidéo par IA cesse d’être une nouveauté pour devenir un outil de production.

Une bonne mise à l'échelle IA peut sauver des images que vous jetteriez autrement. Une mauvaise mise à l'échelle IA gaspille des heures, exagère le bruit de compression et donne aux visages cet aspect plastique, trop cuit que les spectateurs remarquent instantanément. La différence repose sur le flux de travail. La qualité de la source, le choix du modèle, la gestion par lots et les décisions d’exportation comptent plus que les promesses marketing sur la page d’accueil d’un outil.

Pourquoi la mise à l'échelle vidéo par IA est un superpouvoir pour les créateurs

Les images en basse résolution avaient autrefois un plafond rigide. On pouvait les agrandir, mais pas vraiment les améliorer. L’agrandissement traditionnel étirait les pixels. Il rendait les clips plus grands, pas meilleurs.

La mise à l'échelle vidéo par IA fonctionne autrement. Elle utilise l’apprentissage profond pour reconstruire les détails, interpréter les pixels environnants et préserver le mouvement entre les images. Cette dernière partie est cruciale. Une seule image peut sembler nette et tout de même échouer en vidéo si les bords scintillent ou si les textures clignotent d’une image à l’autre.

Pourquoi les créateurs s’y intéressent maintenant

Ce n’est plus un truc de restauration de niche. Le marché des logiciels de mise à l'échelle vidéo par IA est passé de 550 millions USD en 2024 à 670 millions USD en 2025, et devrait atteindre 5 milliards USD d’ici 2035, avec un TCAC de 22,3 %, stimulé par la demande de diffusion en 4K et une qualité visuelle accrue pour l’engagement, selon Wise Guy Reports sur le marché des logiciels de mise à l'échelle vidéo par IA.

Ça correspond à ce que les créateurs affrontent chaque semaine :

- Les anciennes images ont encore de la valeur : Les anciennes entrevues, webinaires, démos et témoignages contiennent souvent des idées qui valent la peine d’être republiées.

- Le UGC n’est rarement capturé parfaitement : Les bons accroches viennent de clips imparfaits.

- Chaque plateforme pénalise le flou : Le recadrage, le redimensionnement et la reconcompression d’images faibles rendent les défauts plus évidents.

Règle pratique : Utilisez la mise à l'échelle IA pour récupérer du contenu fort. N’espérez pas qu’elle sauve une cinématographie faible, un focus manqué ou un flou de mouvement important.

Il y a aussi un angle plus large pour le flux de travail. Si vous transformez déjà un actif en plusieurs, la mise à l'échelle fait partie du reconditionnement, pas seulement de la réparation. C’est pourquoi elle s’intègre naturellement à côté de la repurposing de contenu par IA. Une seule source en basse résolution peut devenir des shorts, des montages carrés et des republications rafraîchies si vous nettoyez la source avant de la redimensionner et de la distribuer.

Ce qu’elle fait de mieux

La mise à l'échelle IA excelle dans quelques situations spécifiques :

| Cas d’utilisation | Pourquoi ça fonctionne |

|---|---|

| Clips d’archives | Elle peut restaurer la clarté sans reconstruire manuellement chaque plan |

| Enregistrements d’écran | Elle aide les bords de texte et les éléments d’interface à mieux résister à la compression |

| UGC pour pubs | Elle élève la qualité de base avant les sous-titres, le branding et les exports |

| Montages sociaux recadrés | La résolution supplémentaire donne de la marge quand on transforme un maître en plusieurs formats |

Si vous avez besoin d’un rappel rapide sur ce que signifie une diffusion en résolution supérieure en pratique, ce résumé de https://shortgenius.com/blog/what-is-4-k-resolution est utile avant de décider si un clip mérite une finition en 4K.

Préparer les images source pour une mise à l'échelle impeccable

La plus grande erreur avec la mise à l'échelle vidéo par IA, c’est de lui donner le pire fichier que vous avez et d’espérer que le modèle fasse de la magie.

Ça n’arrivera pas.

Le marché avance vite. Le marché plus large des outils d’amélioration vidéo par IA devrait atteindre 1 166 millions USD d’ici 2032, avec un TCAC de 37,1 %, alimenté par des systèmes d’apprentissage profond qui offrent des boosts de résolution 2x à 4x instantanés tout en réduisant la bande passante, selon Intel Market Research sur le marché des outils d’amélioration vidéo par IA. Mais de meilleurs modèles n’annulent pas de mauvaises entrées.

Auditez le clip avant de le traiter

Avant de mettre quoi que ce soit en file d’attente, je vérifie si le clip est un bon candidat ou un piège.

Utilisez cet audit court :

- Dommages de compression : Si vous voyez du macroblocage, du bruit de moustique ou des détails étalés, le modèle pourrait traiter ces dommages comme une vraie texture.

- Flou de mouvement : L’IA peut aiguiser les bords, mais elle ne peut pas récupérer des détails qui n’ont jamais existé dans l’image.

- Focus : Légèrement flou peut être gérable. Un focus manqué reste généralement manqué.

- Stabilité des images : Les clips tremblants sont plus difficiles à mettre à l’échelle proprement, surtout si l’arrière-plan se désintègre déjà.

- Lignage du fichier : Exportez à partir de l’original le plus proche que vous puissiez trouver. N’augmentez pas la taille d’un fichier déjà compressé plusieurs fois.

Choisissez la bonne source, pas juste la plus grande source

Les créateurs追uent souvent la résolution en premier. C’est à l’envers.

Un maître 720p plus propre peut surpasser une republication 1080p malmenée. Ce qui compte, c’est si la source préserve de vraies informations d’image. Si vous avez des options, choisissez le fichier avec le moins de recompression et le moins d’éditions intégrées.

Si la source semble déjà bruyante, croquante et instable à sa taille native, la mise à l’échelle rend généralement ces problèmes plus visibles.

Ce qu’il faut corriger avant la mise à l’échelle

Un peu de préparation évite beaucoup de rerendus.

-

Recadrez le clip en premier

Ne traitez pas les silences morts, les faux départs ou les prises alternatives si vous ne les utiliserez pas. -

Séparez les types d’images

Tête parlante, jeu vidéo, animation et capture d’écran se comportent différemment. Ne les mettez pas en lot sous un seul préréglage. -

Faites le nettoyage évident tôt

Si le fichier a besoin d’un débruitage de base ou d’un désentrelacement, faites-le avant votre passe de mise à l’échelle. -

Testez un échantillon court

Prenez un moment exigeant du clip. Mouvement rapide de la main, détails de cheveux, mouvement de caméra, texte fin. Si l’échantillon échoue, le rendu complet ne s’améliorera pas plus tard.

Mauvais candidats pour la mise à l’échelle IA

Certains clips ne valent pas la puissance de calcul.

- Téléchargements sociaux fortement filtrés

- Mèmes republiés minuscules

- Images avec une rupture sévère en faible luminosité

- Clips où les visages sont déjà déformés par la compression

Ça semble strict, mais ça protège votre temps. Le meilleur flux de travail commence par la sélection, pas par les réglages du logiciel.

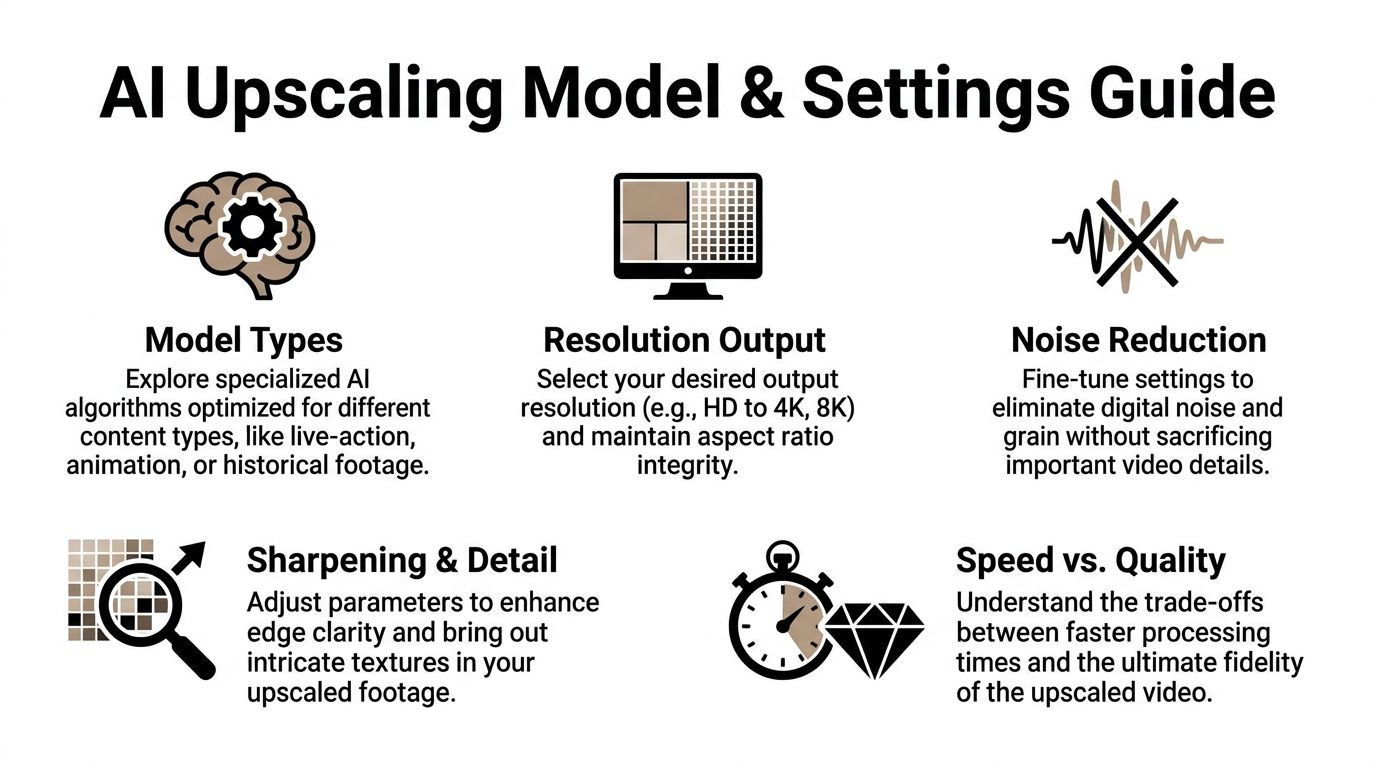

Choisir le bon modèle IA et les bons réglages

La plupart des mises à l’échelle ratées viennent de la même habitude. Les gens chargent un clip, choisissent la sortie la plus élevée, poussent l’aiguisage trop loin et supposent que plus de traitement égale plus de qualité.

Ça n’est pas vrai.

Différents modèles font différents compromis. Certains préservent le réalisme. Certains inventent plus de texture. Certains fonctionnent bien sur l’animation et peinent sur la peau. Certains sont stables en mouvement. D’autres produisent des images fixes impressionnantes et des artefacts temporels laids.

Un benchmark utile sous-tend tout ça. En mise à l’échelle IA, des modèles d’apprentissage profond comme basicVSR++ peuvent obtenir plus de 13 % de scores VMAF supérieurs à Lanczos traditionnel lors de la mise à l’échelle de 540p à 1080p, avec des gains PSNR de 2-4 dB, mais les limites matérielles sur les GPU grand public peuvent causer des taux d’échec de plus de 50 % pour les clips 4K de plus de 2 minutes en raison de pénuries de VRAM, comme noté par la couverture de la At Scale Conference sur l’upsampling vidéo en lecture sur appareil.

Le choix du modèle commence par le type d’images

Une façon simple de penser aux modèles :

| Type d’images | À prioriser | Mode d’échec courant |

|---|---|---|

| Action en direct | Peau naturelle, mouvement stable, aiguisage modéré | Visages cireux |

| Animation | Lignes nettes, consistance des bords | Auréoles autour des contours |

| Jeu vidéo | Gestion du mouvement, clarté du texte/UI | Fantômes dans les scènes rapides |

| Images d’archives | Reconstruction conservatrice | Texture artificielle qui change l’aspect original |

Si un outil offre plusieurs familles de modèles, n’utilisez pas un préréglage universel. C’est comme ça que vous obtenez des entrevues trop aiguisées et de l’animation boueuse dans le même dossier de projet.

Pour les monteurs qui comparent outils et flux de travail avant de s’engager dans une pile, ce résumé de https://shortgenius.com/blog/meilleurs-logiciels-montage-video-ia aide à situer la mise à l’échelle dans un pipeline d’édition plus large.

Les réglages qui comptent le plus

Beaucoup d’étiquettes d’interface semblent techniques, mais se comportent de façon prévisible.

Débruitage

Utilisez le débruitage quand la source a un bruit visible que le modèle confond avec des détails. Utilisez-en moins que ce que vous pensez nécessaire.

Trop de débruitage enlève la texture de la peau, des tissus et des arrière-plans. Puis l’aiguisage essaie de reconstruire une netteté artificielle sur une image aplatie.

Déblocage

Le déblocage aide quand vous gérez des dommages de compression. Il peut lisser les bords de blocs laids avant que le modèle de mise à l’échelle ne les exagère.

C’est utile sur les clips téléchargés et les anciens exports. C’est dangereux sur des images déjà propres car il peut adoucir les bords que vous vouliez préserver.

Aiguisage

L’aiguisage, c’est là que le rendu est souvent ruiné.

Un peu d’aiguisage peut récupérer la définition des bords. Trop crée des auréoles, des cheveux cassants et cet aspect synthétique « amélioré par IA ». Si un échantillon semble impressionnant en pause mais laid en mouvement, l’aiguisage est souvent le coupable.

Le bon réglage d’aiguisage devrait disparaître dans la vidéo finale. Si les spectateurs sentent le traitement, c’est généralement trop agressif.

La stratégie de résolution bat la force brute

Aller directement à 4K est souvent le mauvais coup. Pour le contenu social, 1080p ou un pas modeste vers le haut peut sembler plus propre qu’un fichier plus gros avec des détails inventés.

Voici la comparaison pratique :

| Approche | Avantage | Inconvénient |

|---|---|---|

| Saut direct à 4K | Taille de sortie maximale | Plus de détails halluciné, rendus plus lourds |

| Pas vers 1080p d’abord | Meilleur contrôle, QA plus facile | Point de décision supplémentaire |

| Mise à l’échelle modérée seulement | Plus rapide, plus sûr pour la diffusion sociale | Moins dramatique avant/après |

Ce chemin du milieu gagne étonnamment souvent. Vous gardez le contrôle sur la texture et le mouvement, et vous évitez de passer la nuit à rendre un fichier qui se fait quand même comprimer durement au téléchargement.

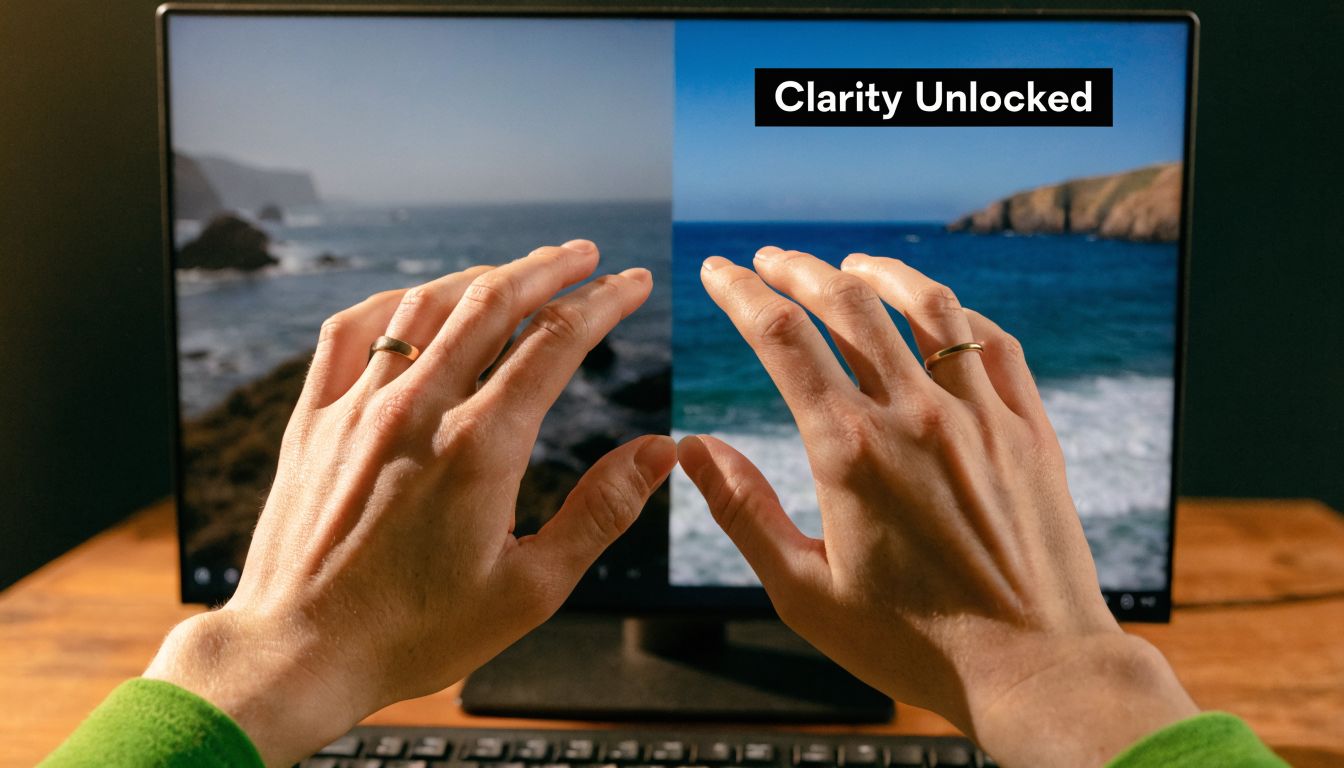

Un aperçu visuel rapide aide quand vous affinez ça :

Traitement local versus cloud

Ce choix est moins idéologique et plus une question de contraintes.

Le traitement local vous donne du contrôle. Il accapare aussi votre machine et expose vite les limites de votre GPU.

Le traitement cloud enlève le goulot d’étranglement matériel, mais vous échangez un peu de contrôle sur le timing, la structure de coûts et parfois les réglages fins selon la plateforme.

Choisissez local quand :

- Vous avez besoin de préréglages répétables sur une machine connue

- Vous testez intensivement

- Vous voulez superviser directement chaque passe

Choisissez cloud quand :

- Votre GPU plante sur les clips plus longs

- Vous avez besoin d’accès équipe

- Vous préférez continuer à éditer pendant que les rendus se font ailleurs

Créez des préréglages, puis méfiez-vous-en

Les préréglages économisent du temps. La confiance aveugle détruit la qualité.

Gardez quelques préréglages de départ par type de contenu, puis testez chaque nouvelle source avec un segment court avant de lancer le rendu complet. Un préréglage pour les têtes parlantes nettes. Un autre pour le UGC brut. Un autre pour l’animation ou les enregistrements d’écran.

Cette discipline compte plus que le nom de marque du logiciel.

Maîtriser votre flux de travail de mise à l’échelle par lots

Mettre à l’échelle un clip, c’est une expérience. Mettre à l’échelle vingt clips, c’est des opérations.

Beaucoup de créateurs perdent souvent du temps. Ils traitent chaque fichier comme un travail sur mesure, surveillent les exports et refont les rendus ratés parce que rien n’était organisé au départ. Un flux de travail par lots corrige ça.

Selon le guide d’Audials sur les erreurs de débutants en mise à l’échelle vidéo par IA, les experts recommandent de commencer avec de la vidéo de haute qualité, peu compressée, et de tester des sauts de résolution incrémentaux comme 720p à 1080p avant 4K pour éviter des résultats non naturels et des temps de rendu 4x plus longs. Le même guide note que les modèles agressifs peuvent produire des taux d’artefacts de 20-30 % dans les scènes riches en mouvement, tombant à moins de 5 % avec un bon flux de travail.

Un flux de travail local overnight

Pour les outils de bureau, la configuration la plus sûre est ennuyeuse exprès.

-

Créez trois dossiers

Utilisezsource,test-rendersetfinal-upscaled. Gardez-les séparés. -

Renommez les clips avant de les mettre en file d’attente

Ajoutez des étiquettes de plateforme ou de projet aux noms de fichiers pour tracer vite les échecs. -

Regroupez par comportement des images

Ne mélangez pas UGC tremblant et images de studio polies dans un préréglage de lot. -

Faites un test de stress par groupe

Choisissez le clip le plus dur de chaque catégorie. Mouvement rapide, cheveux, texte, plans de foule. Si ça marche, les clips plus faciles suivent généralement. -

Mettez les jobs complets en file d’attente overnight

Laissez la machine rendre quand vous n’éditez pas.

Un flux de travail par lots cloud

Les flux cloud fonctionnent mieux quand vous gérez du volume, de la collaboration ou une machine qui ne suit pas.

Le processus est différent :

- Téléchargez seulement les sources approuvées : N’utilisez pas le cloud comme salle de tri.

- Utilisez des conventions de nommage claires : La confusion de versions s’accumule vite dans les projets partagés.

- Documentez le préréglage : Dès qu’un bon lot arrive, sauvegardez la configuration exacte.

- Assignez la propriété de revue : Quelqu’un doit vérifier les sorties, pas juste confirmer que les fichiers existent.

Ce qu’il faut vérifier après un lot

Une file d’attente de rendu terminée n’est pas un lot utilisable.

Vérifiez ça en premier :

| Vérification | Pourquoi ça compte |

|---|---|

| Consistance du mouvement | Le clignotement se cache souvent jusqu’à la lecture |

| Visages et mains | Les modèles agressifs échouent ici en premier |

| Texte fin et UI | Super pour les enregistrements d’écran, facile à casser |

| Intégrité du taux d’images | Les mismatches créent des saccades à l’export |

| Ratio d’aspect | Une mauvaise gestion cause des recadrages gênants plus tard |

La mise à l’échelle par lots ne fait gagner du temps que si votre passe de vérification est rapide et impitoyable.

Erreurs qui ruinent l’échelle

Les plus gros échecs viennent généralement du processus, pas de la qualité du modèle.

- Un préréglage pour tous les clips : Rapide, mais peu fiable.

- Pas d’échantillon rendu : C’est comme ça que vous vous réveillez avec un dossier plein de fichiers inutilisables.

- Sauter le QC parce que les miniatures semblent bonnes : Beaucoup d’artefacts n’apparaissent qu’en lecture.

- Mise à l’échelle après plusieurs exports d’édition : Chaque ré-encodage abaisse votre plafond.

Pour les équipes, l’objectif n’est pas juste un traitement plus rapide. C’est un traitement prévisible. Un système de lots stable fait de la mise à l’échelle vidéo par IA une partie de la production régulière au lieu d’une mission de sauvetage à chaque actif en basse résolution.

Édition post-mise à l’échelle et préréglages d’export intelligents

Un fichier mis à l’échelle n’est pas un fichier fini.

C’est plus proche d’un négatif restauré. Vous devez encore le façonner, le vérifier et l’exporter pour l’endroit où il va vivre. Cette dernière partie compte parce que les créateurs追uent souvent la résolution en ignorant les conditions de diffusion.

La question du ROI est réelle. Comme le guide de Cloudinary sur l’utilisation de l’IA pour mettre à l’échelle la vidéo le note, beaucoup d’outils promettent la 4K, mais des plateformes comme TikTok et Instagram Reels la réduisent souvent quand même. Ça pose une question pratique pour les créateurs. Une mise à l’échelle 4K est-elle bénéfique, ou un export HD optimisé performerait-il aussi bien pour une visualisation mobile d’abord ?

La passe de nettoyage compte

Les modèles IA introduisent souvent des problèmes subtils qui n’apparaissent pas dans un cadre fixe côte à côte.

Les courants incluent :

- Dérive des couleurs : Les tons de peau peuvent shifter légèrement après amélioration.

- Chatter des bords : Les détails fins peuvent pulser en mouvement.

- Inconsistance de texture : Cheveux, tissus et arrière-plans peuvent alterner entre net et flou.

Je traite l’édition post-mise à l’échelle comme un travail de finition, pas un polissage optionnel.

Corrigez les couleurs avant l’export

Même un léger étalonnage peut unifier l’image. Alignez les tons de peau, réduisez les hautes lumières si la mise à l’échelle les a rendues cassantes, et assurez-vous que les noirs ne sont pas devenus croquants.

Revoyez le mouvement en lecture

N’inspectez pas seulement des captures d’images. Regardez le clip en plein écran, puis encore sur un téléphone. Les problèmes de mouvement se révèlent en lecture, pas en captures d’écran.

Si une mise à l’échelle semble géniale en pause et étrange en mouvement, l’export n’est pas prêt.

Les exports intelligents battent les exports max

Les créateurs optent souvent pour « qualité la plus élevée disponible ». Ça semble sûr, mais ce n’est pas toujours utile.

Pour la distribution short-form, pensez en termes de compatibilité plateforme :

| Destination | Meilleure approche par défaut | À éviter |

|---|---|---|

| TikTok | Maître HD net et stable | Fichiers énormes avec gain visible marginal |

| Instagram Reels | Résistance forte à la compression | Exports trop aiguisés qui cassent après téléchargement |

| YouTube Shorts | Texte net et mouvement stable | Rendus surdimensionnés inutilement si source faible |

Le point n’est pas que la 4K est mauvaise. C’est que la 4K n’est pas automatiquement meilleure pour chaque téléchargement social.

Une politique d’export pratique

Utilisez cet ensemble de règles :

-

Exportez pour la plateforme, pas pour votre fierté

Les spectateurs se soucient de la clarté et de la fluidité plus que de votre menu de réglages de rendu. -

Gardez un maître d’archive haute qualité

Sauvegardez un maître net pour une réutilisation future, des recadrages ou une livraison client. -

Créez des dérivés spécifiques à la plateforme

Un fichier d’archive, puis des exports adaptés aux besoins verticaux, carrés ou horizontaux. -

Vérifiez le résultat téléchargé

Les plateformes sociales font partie de la chaîne de rendu. Votre export local n’est pas l’aspect final.

Beaucoup de créateurs compromettent la qualité à l’export. Ils passent du temps à mettre à l’échelle, puis livrent le résultat final à la compression de la plateforme sans stratégie. Des préréglages d’export intelligents protègent le travail déjà fait.

Automatiser la mise à l’échelle dans un pipeline ShortGenius

La mise à l’échelle manuelle fonctionne quand vous corrigez un clip. Elle s’effondre quand vous produisez du contenu social chaque semaine sur plusieurs canaux.

C’est le goulot d’étranglement pour les équipes. Selon la couverture de Perfect Corp sur les limitations des flux de travail d’améliorateur vidéo IA, le plus grand défi est d’intégrer la mise à l’échelle dans des flux multi-canaux parce que la plupart des outils autonomes manquent de traitement par lots à grande échelle ou de disponibilité API. Un pipeline de publication unifié compte plus qu’une autre app d’amélioration isolée.

Ce que l’automatisation devrait vraiment faire

Un pipeline automatisé utile ne fait pas juste « ajouter la mise à l’échelle ».

Il devrait gérer une chaîne comme ça :

- Ingérer le clip source

- Le router par type de contenu

- Appliquer le bon préréglage d’amélioration

- Passer le résultat à l’édition

- Redimensionner et emballer pour chaque canal

- Planifier la distribution

Cette structure transforme la mise à l’échelle d’une étape de réparation en infrastructure.

Où ça s’insère en production

Pour les équipes short-form, le meilleur point d’insertion est généralement tôt. Nettoyez l’actif visuel avant les sous-titres, le branding, le reframing et les exports.

Ça compte parce que chaque étape ultérieure dépend de la stabilité de la source. Si vous ajoutez des sous-titres animés, des cut-ins et des superpositions de marque sur des images faibles d’abord, puis essayez de mettre à l’échelle plus tard, vous forcez le modèle à interpréter les éléments de design et les dommages de compression en même temps.

Un ordre plus fiable est :

| Étape | Meilleure séquence |

|---|---|

| Gestion source | Sélectionner et approuver le clip brut |

| Amélioration | Mise à l’échelle et nettoyage du mouvement d’abord |

| Couche d’édition | Ajouter sous-titres, recadrages, branding, voix |

| Distribution | Exporter par plateforme et publier |

Une mention de plateforme, utilisée où elle va

Dans un flux unifié, ShortGenius peut s’insérer dans cette chaîne de production comme une option pour les équipes qui veulent assemblage vidéo, voix off, édition, redimensionnement, planification et automatisation pilotée par API dans le même environnement. Ce genre de configuration compte quand vous essayez de transformer des images brutes en sortie répétable sans rebondir des fichiers entre apps séparées. Si vous construisez un système plus large autour de la production récurrente de canaux, ce guide sur https://shortgenius.com/blog/automatisation-youtube-ia est pertinent parce que l’automatisation ne fonctionne que si chaque étape de production se connecte proprement.

Ce qui fonctionne et ce qui ne fonctionne pas

Ce qui fonctionne

- Traiter la mise à l’échelle comme une étape de prétraitement

- Sauvegarder des préréglages par classe d’images

- Automatiser les passes répétitives, pas le jugement esthétique

- Garder une étape de revue humaine avant publication

Ce qui ne fonctionne pas

- Envoyer chaque clip via le même profil d’amélioration

- Automatiser sans propriété QC

- Construire un pipeline qui requiert un maniement manuel de fichiers entre outils

- Supposer que les images générées par IA et organiques se comportent pareil sous mise à l’échelle

La victoire n’est pas juste des images plus belles. La victoire, c’est enlever un goulot d’étranglement manuel de plus de la production de contenu.

Pour les agences, équipes de marque et créateurs à haut volume, c’est le changement fondamental. La mise à l’échelle cesse d’être un fix spécial pour les mauvais fichiers et devient un processus de fond standard. Vous récupérez plus d’images utilisables, passez moins de temps sur le nettoyage répétitif et gardez une qualité de sortie cohérente entre les canaux.

Si vous voulez transformer ce flux de travail en système répétable, ShortGenius (AI Video / AI Ad Generator) regroupe création vidéo, édition, redimensionnement, voix off, planification et publication automatisée dans une seule plateforme, pour que la mise à l’échelle s’intègre dans un pipeline de production plus large au lieu de rester une tâche manuelle ponctuelle.