Un guide des enjeux juridiques avec les acteurs IA en publicité

Naviguez les enjeux juridiques avec les acteurs IA en publicité. Notre guide couvre le droit d'auteur, les droits à l'image et les règles de la FTC pour garder vos campagnes conformes et sécuritaires.

Utiliser des acteurs IA dans vos publicités ouvre un monde de possibilités créatives, mais vous devez absolument vous familiariser avec les principaux enjeux légaux liés aux acteurs IA en publicité avant de vous lancer. Les plus grands pièges sont la violation de droits d'auteur liée aux données d'entraînement de l'IA, la violation accidentelle du droit à l'image d'une personne réelle, et les pénalités pour pratiques trompeuses en vertu des règles de la FTC et des nouvelles lois provinciales sur les deepfakes. Bien faire les choses dès le départ est la seule façon d'éviter un très coûteux bourbier juridique.

Les nouveaux risques légaux des acteurs IA en publicité

Se lancer dans la publicité propulsée par l'IA est excitant, pas de doute. Mais c'est comme marcher dans un labyrinthe de pièges juridiques dont vous ignoriez même l'existence. Imaginez ceci : vous êtes le réalisateur, mais des cadres légaux invisibles comme les droits d'auteur, les droits à l'image et les lois sur la protection des consommateurs sont les marionnettistes. Si vous les ignorez, toute votre campagne pourrait s'effondrer.

Ce nouveau terrain comporte des risques qu'affrontait rarement la publicité traditionnelle. Votre marque pourrait être poursuivie pour violation de droits d'auteur simplement parce que le modèle d'IA a été entraîné sur des images protégées sans permission. Il est aussi étonnamment facile pour un visage généré par IA de ressembler un peu trop à une personne réelle, déclenchant une poursuite pour vol de son image.

Principaux défis légaux à anticiper

Les enjeux légaux liés aux acteurs IA ne sont plus de simples hypothèses ; ils entraînent des retraits de campagnes réels, des amendes massives et des dommages graves à la réputation d'une marque. Savoir exactement à quoi vous faites face est le premier pas vers une stratégie publicitaire à la fois innovante et légalement solide.

Voici un résumé de ce qu'il faut surveiller :

- Violation de droits d'auteur : L'IA a-t-elle été entraînée sur des photos ou de l'art protégé par droit d'auteur ? Si oui, votre publicité finale pourrait être considérée légalement comme une « œuvre dérivée », vous rendant responsable de la violation.

- Violations du droit à l'image : Si votre acteur IA ressemble vaguement à une personne réelle – son visage, sa voix ou son style général –, vous pourriez faire face à une poursuite pour utilisation commerciale de son image sans permission.

- Pratiques publicitaires trompeuses : La Federal Trade Commission (FTC) est claire : les publicités doivent être véridiques. Utiliser des acteurs IA pour de faux témoignages vidéo ou pour laisser entendre une approbation qui n'a jamais eu lieu est un billet direct pour les ennuis.

- Naviguer les lois sur les deepfakes : De plus en plus d'États adoptent des lois pour réprimer les médias synthétiques. Cela crée un patchwork réglementaire chaotique qui varie selon l'endroit où se trouve votre public.

Pour vous donner une image plus claire, voici un résumé rapide des principaux obstacles légaux que vous rencontrerez.

Principaux risques légaux des acteurs IA en un coup d'œil

| Domaine de risque légal | Ce que cela signifie pour vos publicités | Conséquence potentielle |

|---|---|---|

| Violation de droits d'auteur | Le modèle d'IA a utilisé des images protégées pour son entraînement, rendant votre publicité une potentielle « œuvre dérivée ». | Poursuites judiciaires, avis de retrait et dommages financiers. |

| Droit à l'image | Votre acteur IA ressemble accidentellement au visage, à la voix ou à la personnalité distinctive d'une personne réelle. | Action en justice de l'individu pour utilisation commerciale non autorisée de son image. |

| FTC et publicités trompeuses | Utiliser l'IA pour créer de faux témoignages, des démos de produits trompeuses ou de fausses approbations. | Amendes salées de la FTC, sanctions judiciaires et dommages graves à la réputation de la marque. |

| Lois sur les deepfakes et la vie privée | Violation de nouvelles lois spécifiques aux États réglementant la création et l'utilisation de médias synthétiques. | Pénalités civiles ou criminelles, selon l'État et la nature de la violation. |

Comprendre et naviguer ces risques ne consiste pas seulement à éviter les pénalités ; il s'agit de bâtir la confiance dans une ère où les consommateurs sont de plus en plus sceptiques face à ce qu'ils voient en ligne.

En abordant proactivement ces risques, vous transformez les obstacles légaux en avantage concurrentiel. Une approche conforme protège non seulement votre entreprise, mais bâtit aussi la confiance auprès d'un public de plus en plus méfiant envers le contenu synthétique.

En fin de compte, l'objectif est d'exploiter le pouvoir incroyable de l'IA sans tomber dans des pièges légaux évidents. C'est un écosystème qui inclut aussi les entreprises qui développent ces outils puissants. Si vous voulez voir un exemple de qui est dans ce domaine, consultez la page d'accueil de copycat247. En restant informé et en créant un plan de conformité clair, vous pouvez innover en toute confiance.

Le champ de mines des droits d'auteur caché dans les données d'entraînement de l'IA

Quand il s'agit d'IA en publicité, le plus gros mal de tête légal est la violation de droits d'auteur. Tout le problème commence par la façon dont ces modèles apprennent vraiment. L'IA générative n'invente pas les choses de toutes pièces ; elle est entraînée sur d'énormes ensembles de données, souvent contenant des millions d'images, de vidéos et de textes scraping directement sur Internet. C'est là que les ennuis commencent.

Imaginez un modèle d'IA comme un musicien qui écoute toutes les chansons jamais créées pour apprendre à composer. Si ce musicien produit ensuite une nouvelle mélodie qui ressemble suspectement à une célèbre mélodie protégée par droit d'auteur, il a franchi une ligne. Le même principe s'applique ici. Votre publicité pourrait être construite sur une base de matériel non autorisé sans que vous le sachiez.

Cette responsabilité cachée signifie que même avec les meilleures intentions, votre marque pourrait être tenue responsable de violation de droits d'auteur. L'acteur ou la scène générés par IA dans votre publicité pourraient techniquement être une « œuvre dérivée » – une nouvelle création un peu trop proche d'une œuvre existante protégée. Et vous n'auriez aucune idée sur quoi il a été entraîné pour la produire.

Les eaux troubles de la « similitude substantielle »

Devant les tribunaux, le test pour violation de droits d'auteur se résume souvent à un concept appelé « similitude substantielle ». Il ne s'agit pas de prouver que l'IA a fait une copie pixel par pixel. C'est beaucoup plus flou. La vraie question est de savoir si une personne ordinaire regarderait la sortie de l'IA et reconnaîtrait qu'elle a été copiée d'une œuvre protégée.

Pour un publicitaire, cette ambiguïté est un risque énorme. Si une IA génère un personnage pour votre campagne qui a le même style excentrique et reconnaissable qu'un célèbre personnage de dessin animé, vous pourriez vous retrouver en cour. L'artiste original n'a pas à prouver que l'IA a répliqué son œuvre exactement, juste que le « concept global et l'impression » sont les mêmes.

Et les batailles juridiques s'intensifient déjà. D'ici fin 2025, une vague de litiges a entraîné environ 47 poursuites pour droits d'auteur contre des entreprises d'IA aux États-Unis seulement, beaucoup sous forme d'actions collectives. Dans des exemples très médiatisés, des entreprises comme Disney et Universal Studios ont allégué que des outils d'IA ont été entraînés sur leurs films à succès sans permission, créant une chaîne de risques sérieuse pour quiconque utilise les visuels générés par ces outils.

Pourquoi vous ne pouvez pas compter sur la défense du « fair use »

Les entreprises d'IA tentent souvent de se défendre en prétendant que leur processus d'entraînement est du « fair use », une doctrine légale permettant une utilisation limitée de matériel protégé pour des fins comme la recherche ou le commentaire. Mais cet argument devient incroyablement fragile dès que la sortie de l'IA est utilisée à des fins commerciales – comme une publicité.

Les tribunaux examinent quatre facteurs clés pour décider si quelque chose est du fair use :

- But de l'utilisation : Est-ce pour le profit ou l'éducation ? La publicité est purement commerciale, ce qui est un gros point contre une revendication de fair use.

- Nature de l'œuvre originale : Utiliser des œuvres créatives comme des photos et des illustrations est beaucoup plus difficile à défendre que d'utiliser des données factuelles.

- Quantité de l'œuvre utilisée : Le modèle d'IA a-t-il copié le « cœur » de l'œuvre originale, même sans utiliser l'ensemble ?

- Effet sur le marché : L'image générée par IA nuit-elle à la capacité du créateur original de vendre ou de licencier son œuvre ? Si votre image IA remplace le besoin d'acheter une photo stock, c'est un préjudice clair pour le marché.

Pour les marketeurs, s'appuyer sur une défense de fair use est un pari que vous êtes presque sûr de perdre. La nature commerciale d'une campagne publicitaire coule l'argument dès le départ. Pour mieux protéger vos propres actifs créatifs, examiner les considérations plus larges en propriété intellectuelle est une sage décision.

Le problème central n'est pas seulement ce que l'IA crée, mais ce qu'elle a appris. Si les données d'entraînement sont juridiquement douteuses, chaque contenu qu'elle génère transporte ce risque hérité directement dans vos campagnes publicitaires.

En fin de compte, le fardeau incombe à vous – le publicitaire – de poser des questions difficiles sur l'origine de vos actifs IA. Choisir des plateformes IA qui utilisent des données d'entraînement licenciées ou sourcées éthiquement n'est pas seulement une question de bien faire ; c'est un bouclier légal critique pour votre marque.

Protéger l'identité humaine à l'ère de l'IA

Au-delà des droits d'auteur, les enjeux légaux liés aux acteurs IA en publicité deviennent personnels. Très vite. C'est ici que nous tombons sur le droit à l'image – le droit fondamental de chaque personne à contrôler l'utilisation commerciale de son nom, de son image et de son likeness.

Imaginez-le comme une marque de commerce personnelle sur votre identité. Si vous utilisez l'IA pour créer un « jumeau numérique » d'une célébrité – ou même d'une personne ordinaire – pour une publicité sans obtenir leur permission explicite, vous franchissez une ligne légale sérieuse. C'est essentiellement du vol d'identité à des fins lucratives, et les tribunaux ne le prennent pas à la légère.

Il ne s'agit pas seulement de créer une copie parfaite et photoréaliste, non plus. La loi protège souvent toute caractéristique qui pointe directement vers une personne spécifique. Cela pourrait être sa voix, une pose célèbre ou même une phrase d'accroche pour laquelle elle est connue. Créer un influenceur virtuel qui semble un peu trop familier à une célébrité du monde réel est une poursuite en attente.

La menace croissante des répliques numériques non autorisées

L'explosion de la technologie deepfake a mis ce problème sous les projecteurs, et les législateurs s'efforcent de suivre. Les États adoptent maintenant des lois conçues spécifiquement pour combattre la création et l'utilisation non autorisées de répliques numériques. Pour les marketeurs et créateurs, cela signifie que les anciennes façons d'obtenir un consentement sont officiellement mortes.

Vous ne pouvez plus vous fier à un formulaire de libération standard et supposer qu'il couvre la création d'une version IA de cette personne. Le terrain légal a changé, et la nouvelle norme est un consentement explicite et informé qui mentionne spécifiquement la génération par IA. Tout ce qui est en deçà expose votre marque à un risque énorme.

Une décision clé des tribunaux a vraiment illustré ce point. Elle a montré que même quand les lois fédérales sur le droit d'auteur ou les marques de commerce ne s'appliquent pas parfaitement à un cas de clonage vocal, les lois civiles au niveau des États sur les droits et la publicité peuvent encore offrir une protection puissante aux individus dont l'identité est détournée par l'IA. Cela place le fardeau carrément sur les publicitaires pour connaître et respecter ces lois des États.

Rédiger un formulaire de consentement à l'épreuve de l'IA

Quand vous obtenez une permission pour créer un acteur IA basé sur une personne réelle, votre approche doit être complètement différente. Les formulaires de consentement et de libération doivent être étanches et ne laisser aucune place à l'interprétation. Une libération IA vraiment solide doit vous accorder des droits spécifiques et sans ambiguïté.

Pour rester du bon côté de la loi, votre processus de consentement doit couvrir ces points clés :

- Droit explicite de créer une réplique numérique : Le formulaire doit indiquer, sans équivoque, que vous avez l'intention de créer une version numérique de la personne à l'aide d'IA.

- Portée d'utilisation définie : Soyez précis. Indiquez exactement comment et où la réplique IA sera utilisée – quelles campagnes, sur quelles plateformes, et pour combien de temps.

- Droits d'approbation sur la sortie IA : C'est un point majeur de négociation. La personne peut-elle examiner et approuver les scènes finales générées par IA avant leur publication ?

- Utilisation future et modifications : Le contrat doit clarifier si vous avez le droit de modifier la réplique IA ou de l'utiliser dans de futures campagnes non planifiées. Un langage vague ici est une responsabilité massive.

Pour voir comment les exigences ont changé, comparez le consentement traditionnel à ce qui est nécessaire pour l'IA.

Consentement pour personne réelle vs acteur IA

Ce tableau met en lumière les différences critiques entre un formulaire de libération standard et un conçu pour créer une réplique IA.

| Facteur de consentement | Requis pour personne réelle | Critique pour réplique IA |

|---|---|---|

| Utilisation de l'image | Libération standard pour photos/vidéos. | Permission explicite pour générer un clone numérique. |

| Durée d'utilisation | Temps clairement défini (p. ex., un an). | Doit spécifier si les droits sont perpétuels ou limités dans le temps. |

| Droits de modification | Limités à la retouche standard (correction des couleurs, etc.). | Doit accorder des droits pour modifier la performance/dialogue de l'IA. |

| Portée des médias | Spécifie les plateformes (p. ex., médias sociaux, TV). | Couvre largement tous les médias numériques actuels et futurs. |

En fin de compte, naviguer le droit à l'image à l'âge de l'IA se résume à la transparence et au respect. Obtenir un consentement cristallin ne consiste pas seulement à cocher une case légale – c'est protéger votre marque et honorer les droits des personnes dont l'identité alimente votre travail créatif.

Rester du bon côté de la FTC

Au-delà du labyrinthe des droits d'auteur et des droits à l'image, un autre acteur majeur entre en jeu quand vous utilisez des acteurs IA : la Federal Trade Commission (FTC). Le rôle de la FTC est simple : protéger les consommateurs des publicités qui mentent ou trompent. Ils se fichent si votre publicité a été créée par une équipe d'artistes ou un algorithme sophistiqué – si elle est trompeuse, c'est un problème.

Au cœur, la règle de la FTC est directe. Une publicité ne peut pas être trompeuse. Cette norme s'applique à tout ce que dit et implique la publicité, y compris les affirmations sur la technologie IA utilisée pour la créer. Si votre acteur IA affirme qu'une nouvelle poudre protéinée aide à bâtir du muscle 2x plus vite, vous feriez mieux d'avoir des preuves scientifiques solides pour le soutenir, comme si une célébrité humaine l'avait dit.

L'agence s'en prend aussi durement à ce qu'ils appellent l'« AI-washing ». C'est quand une entreprise exagère démesurément ses capacités IA. Vanter votre campagne comme une percée IA révolutionnaire alors qu'elle ne fait que quelques tâches automatisées basiques est une façon sûre d'attirer l'attention de la FTC.

Les deux vérités que vous devez respecter

Quand des acteurs IA entrent en jeu, vous jonglez soudainement avec deux ensembles de responsabilités. Vous devez être honnête sur ce que vous vendez et honnête sur la technologie que vous utilisez pour le vendre.

Imaginez cela comme un contrôle d'intégrité en deux parties :

- Vérité dans le message de votre publicité : Les affirmations, démonstrations ou témoignages présentés par votre acteur IA sont-ils vraiment vrais ? Une vidéo générée par IA d'un « client » heureux qui vante votre produit est franchement trompeuse si ce client n'existe pas.

- Vérité dans vos affirmations technologiques : Exagérez-vous ce que peut faire votre IA ? Si vous prétendez que votre IA produit des publicités parfaitement personnalisées mais qu'elle ne change que la couleur de fond selon la localisation, vous trompez votre public.

La FTC ne s'intéresse pas au processus technique derrière la publicité. Ils se concentrent sur le message qu'une personne moyenne retient.

Les régulateurs ne rigolent pas

Ce n'est pas juste une tape sur les doigts. La FTC poursuit activement les entreprises pour marketing IA trompeur, envoyant un message clair que l'utilisation du mot « IA » comme buzzword n'est pas un laissez-passer pour des affirmations sans fondement.

La FTC l'a dit clairement : si vous faites une affirmation sur votre IA, vous devez pouvoir la prouver. Les publicitaires doivent avoir des preuves solides pour chaque affirmation de performance, comme pour n'importe quelle autre caractéristique de produit.

Et ce n'est pas un scénario futur lointain – c'est en train de se passer maintenant. Dès mi-2025, la FTC avait déjà lancé au moins une douzaine d'actions d'exécution contre l'« AI-washing ». Un exemple prime était la poursuite d'août 2025 contre Air AI pour avoir faussement prétendu que son IA pouvait complètement remplacer les représentants des ventes humains. Ce cas souligne les risques légaux et financiers sérieux pour les marketeurs qui surévaluent leurs outils IA sans preuves. Vous pouvez en apprendre plus sur la position évolutive de la FTC sur le droit de l'IA.

Quand devez-vous divulguer ?

Cela nous amène à une question critique : quand devez-vous dire aux gens qu'ils regardent un acteur généré par IA ? Il n'y a pas encore de loi fédérale unique avec une règle stricte, mais les principes généraux de la FTC sur la tromperie nous donnent un guide clair.

Le test décisif est celui-ci : « Est-ce que savoir que c'est de l'IA changerait la façon dont un consommateur comprend la publicité ? »

Si vous utilisez un acteur IA pour se faire passer pour un vrai médecin recommandant un supplément ou un client réel partageant une histoire personnelle, ne pas divulguer qu'il s'agit d'IA est presque certainement trompeur. L'omission est trompeuse parce qu'elle donne à l'approbation une crédibilité qu'elle n'a pas vraiment.

Pour rester en sécurité et bâtir la confiance, des divulgations claires et proéminentes deviennent la nouvelle norme. Un simple étiquetage visible comme #AIGenerated peut aller loin pour vous garder en avance sur les réglementations et du bon côté de vos clients.

Votre liste de vérification pratique de conformité pour les publicités IA

Bon, passons de la théorie à ce que vous devez vraiment faire. Affronter le champ de mines légal de l'IA en publicité consiste à avoir un processus solide et répétable. Il ne s'agit pas d'étouffer la créativité avec de la paperasse ; il s'agit de mettre des garde-fous pour que votre équipe puisse innover en confiance.

Imaginez cette liste comme votre routine pré-vol avant de lancer n'importe quelle campagne propulsée par IA. En intégrant ces étapes directement dans votre flux de travail, vous créez une base de conformité qui protège votre marque, respecte les droits individuels et vous garde du bon côté des régulateurs. Parcourons-la.

Étape 1 : Auditez votre outil IA et ses données d'entraînement

Avant même de penser à générer une image, vous devez ouvrir le capot de votre plateforme IA. La position légale de votre publicité finale est directement liée aux données sur lesquelles le modèle IA a été entraîné. Supposer qu'un outil payant est « sûr » est un pari massif, et potentiellement très coûteux.

Vous devez poser des questions directes à votre fournisseur IA et examiner vraiment leurs conditions de service. Tout fournisseur réputé devrait être transparent sur l'origine de ses données.

- Exigez la transparence des données : Demandez-leur franchement : Votre modèle a-t-il été entraîné sur des données licenciées, de domaine public ou sourcées éthiquement ? Si vous obtenez une réponse vague et évasive, c'est un énorme signal d'alarme.

- Vérifiez une clause d'indemnisation : Le fournisseur couvrira-t-il vos factures légales si son outil produit quelque chose qui vous fait poursuivre ? C'est ce qu'on appelle l'indemnisation. Vous verrez que de nombreuses plateformes placent 100 % du risque légal sur vous, l'utilisateur.

- Cherchez des outils « sûrs pour usage commercial » : Certaines plateformes commercialisent spécifiquement leurs modèles comme sûrs pour un usage commercial. C'est souvent bon signe, car cela signifie généralement qu'ils ont fait leurs devoirs sur les droits des données.

Étape 2 : Sécurisez des droits et un consentement étanches

Ceci est non négociable. Si votre publicité implique un double numérique d'une personne réelle – ou même un avatar qui ressemble beaucoup à quelqu'un –, vous avez besoin d'un consentement explicite. Votre ancien formulaire de libération standard ne suffira pas. Vos accords doivent maintenant être spécifiques et penser à l'avenir.

Le nom du jeu est le consentement informé. Vous devez être cristallin sur votre intention de créer et d'utiliser une version générée par IA d'une personne, en indiquant exactement comment, où et pour combien de temps. Toute ambiguïté dans ce contrat est基本上 une invitation ouverte à une poursuite plus tard.

Il s'agit de plus qu'une simple signature ; c'est une communication claire. Une libération IA solide comme le roc doit couvrir toutes les bases pour éviter les maux de tête futurs.

- Spécifiez la génération IA : Le contrat doit indiquer explicitement que vous avez le droit de créer une « réplique numérique » ou une « image générée par IA ».

- Définissez la portée d'utilisation : Soyez granulaire. Décrivez sur quelles plateformes l'acteur IA apparaîtra, les types de campagnes et la durée exacte d'utilisation.

- Traitez les droits de modification : Le contrat vous permet-il d'ajuster la performance de l'IA ? Pouvez-vous changer son dialogue ou l'insérer dans de nouvelles scènes complètement ? Indiquez-le clairement.

Étape 3 : Examinez chaque sortie générée par IA

Une fois que l'IA crée quelque chose pour vous, le vrai travail commence. Chaque image, vidéo et voiceover a besoin d'un examen humain. C'est votre dernière ligne de défense contre la violation, et vous ne pouvez pas la sauter.

N'assumez jamais qu'une image « nouvelle » est légalement propre. Ces modèles peuvent – et font – imiter accidentellement des styles protégés, des personnages ou même des logos de marque.

- Vérifiez la « similitude substantielle » : La sortie ressemble-t-elle ou se sent-elle un peu trop proche d'un célèbre personnage de film, d'une œuvre d'art ou du style signature d'un artiste particulier ? Si votre instinct dit que c'est trop proche, ça l'est probablement. Jetez-la et générez-en une nouvelle.

- Scannez les marques de commerce : Regardez attentivement les arrière-plans. L'IA a-t-elle glissé un logo, un nom de marque ou une forme de produit distinctive ?

- Écoutez les similitudes vocales : Si vous générez de l'audio, la voix ressemble-t-elle de façon inquiétante à un acteur célèbre ou une figure publique ? C'est une violation potentielle du droit à l'image en attente.

Étape 4 : Implémentez des divulgations claires et justifiez les affirmations

Enfin, vous devez être honnête avec votre public et respecter les règles de la FTC. Cela signifie être transparent sur l'utilisation de l'IA quand cela compte et, surtout, appuyer chaque affirmation de votre publicité avec des preuves solides.

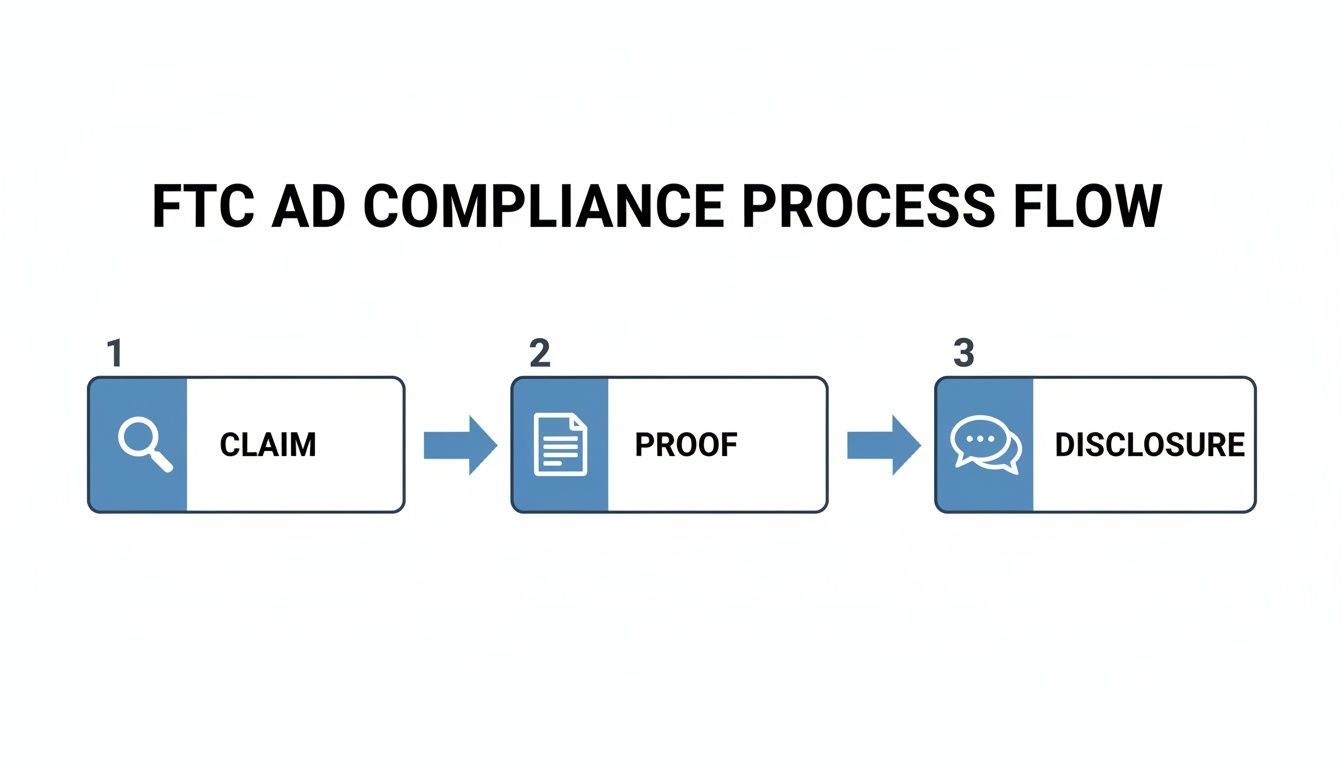

Ce simple diagramme de flux décompose l'attente principale de la FTC pour n'importe quelle publicité, propulsée par IA ou non.

C'est un cycle simple : pour chaque affirmation que vous faites, vous devez avoir une preuve pour la soutenir et fournir une divulgation claire. Cette boucle assure que votre publicité est véridique et défendable.

- Divulguez quand cela compte : Si une personne typique pourrait être trompée en pensant que votre acteur IA est une vraie personne – comme un médecin donnant des conseils médicaux ou un client vantant un produit –, vous devez le divulguer. Un simple #AIGenerated ou #AIAd peut faire l'affaire.

- Justifiez toutes les affirmations : Chaque déclaration factuelle faite par votre acteur IA a besoin de preuves. Si votre porte-parole IA dit qu'un produit est « 50 % plus efficace », vous feriez mieux d'avoir l'étude clinique pour le prouver avant que la publicité ne voie le jour.

- Créez un « dossier de justification » : Pour chaque campagne, adoptez l'habitude de créer un dossier contenant toutes les données, études et preuves qui soutiennent les affirmations de votre publicité. Si la FTC frappe à votre porte, ce dossier sera votre meilleur ami.

Questions courantes sur les acteurs IA en publicité

Se lancer dans la publicité propulsée par IA soulève souvent plus de questions que de réponses. Le côté légal est encore un peu comme le Far West, ce qui peut rendre difficile d'être confiant dans vos décisions. Tacklons certaines des questions les plus courantes que se posent les marketeurs sur les enjeux légaux des acteurs IA en publicité. Mon objectif est de vous donner des réponses directes pour que vous puissiez bâtir des campagnes plus intelligentes et plus sécuritaires.

Dois-je divulguer que ma publicité utilise un acteur IA ?

De plus en plus, la réponse est oui. Bien qu'il n'y ait pas une grande loi fédérale imposant cela pour chaque publicité, le vent tourne. La meilleure façon de penser à cela est à travers le prisme des règles de la FTC contre les pratiques trompeuses. Si ne pas dire qu'un acteur est IA tromperait quelqu'un, vous devez absolument le divulguer. Pensez à utiliser un « médecin » généré par IA pour promouvoir un produit de santé – le fait que le médecin n'est pas réel est une grosse affaire.

De plus, les plateformes font déjà le choix pour vous. Les gros joueurs comme Meta et YouTube exigent maintenant des étiquettes pour le contenu réaliste généré par IA, donc la divulgation devient un coût de base des affaires.

Voici la règle simple que je suis : S'il y a la moindre chance qu'une personne ordinaire soit trompée, ajoutez une divulgation claire et simple comme #AIGenerated. Ce n'est pas seulement pour suivre des règles qui pourraient arriver ; c'est pour bâtir la confiance avec votre public, ce qui est inestimable.

Être franc gère les attentes et protège votre marque, surtout alors que les gens deviennent plus avisés (et plus sceptiques) face aux médias synthétiques.

Puis-je être poursuivi si mon outil IA crée une image infringing ?

Absolument. Une énorme idée fausse est que si l'outil IA fait le désordre, c'est le fournisseur de l'outil qui doit nettoyer. Ce n'est pas comme ça que fonctionne le droit d'auteur. L'entreprise qui publie la publicité infringing – votre entreprise – peut être tenue directement responsable. C'est souvent appelé responsabilité secondaire, et cela signifie que vous partagez le risque légal.

Même si la plateforme IA a aussi des ennuis, cela ne vous innocente pas. C'est pourquoi vous devez lire les conditions de service de tout outil IA que vous utilisez. Certaines plateformes pourraient offrir une indemnisation (couvrant vos factures légales), mais beaucoup sont rédigées pour placer toute la responsabilité légale sur vos épaules en tant qu'utilisateur.

Votre meilleure défense est d'être proactif. Examinez chaque image générée par IA pour toute ressemblance uncanny avec une œuvre existante protégée. Et essayez de vous en tenir à des plateformes IA transparentes sur l'origine de leurs données d'entraînement – celles qui utilisent des données légalement licenciées ou de domaine public sont toujours plus sécuritaires.

Quelle est la différence entre une photo stock et une personne IA ?

La différence clé se résume à l'origine des droits légaux. Quand vous licencez une photo stock d'une personne, elle vient avec une libération de modèle. C'est un document légal où la vraie personne sur la photo a donné son consentement pour une utilisation commerciale de son image. C'est votre couverture légale de sécurité.

Une personne générée par IA n'a pas de libération de modèle parce qu'elle, ben, n'existe pas. Mais cela ouvre une boîte de vers complètement nouvelle dont vous n'avez pas à vous soucier avec les photos stock.

- Double accidentel : L'image IA pourrait ressembler au hasard à une personne réelle, créant une réclamation surprise de droit à l'image que vous n'avez jamais vue venir.

- Mines de droits d'auteur : L'image elle-même pourrait être contestée en fonction de ce sur quoi l'IA a été entraînée. Si le modèle a appris d'une base de données d'images protégées, votre « personne IA originale » pourrait légalement être considérée comme une copie infringing.

Essentiellement, avec une personne IA, vous échangez un processus légal connu et clair (libérations de modèle) contre un nouvel ensemble de risques troubles liés aux droits d'auteur et à l'identité.

Comment créer en toute sécurité un avatar de marque IA ?

Si vous voulez créer un avatar ou influenceur de marque IA sans recevoir une lettre effrayante d'un avocat plus tard, vous avez besoin d'un plan. Vous ne pouvez pas improviser.

Commencez par vous assurer que l'avatar est vraiment unique. Soyez créatif avec des prompts détaillés puis retouchez manuellement les résultats pour éloigner le look final de toute personne réelle ou personnage existant. Gardez un dossier de ce processus créatif – cela pourrait être une preuve cruciale pour démontrer que vous aviez l'intention de créer quelque chose de totalement original.

Ensuite, donnez à votre avatar un nom et une histoire uniques sans lien avec une personne réelle. Faites une recherche de marque pour le nom de l'avatar et même son design visuel pour vous assurer de ne pas marcher sur les plates-bandes d'une autre marque.

Enfin, passez au peigne fin les conditions de service de votre outil IA. Vous devez être sûr qu'elles vous accordent une propriété commerciale complète ou, à tout le moins, une licence commerciale large pour tout ce que vous créez. Être transparent avec votre public sur le fait que l'avatar est IA ira aussi loin pour éviter les problèmes légaux et de RP.

Prêt à créer des publicités performantes sans devinettes légales et coûts de production élevés ? ShortGenius est une plateforme de publicité IA conçue pour les créateurs et marketeurs qui doivent produire des publicités vidéo et image courtes époustouflantes pour toutes les grandes plateformes sociales. Générez des concepts, scripts et visuels en secondes, puis personnalisez-les avec votre kit de marque et déployez des campagnes qui obtiennent des résultats. Essayez ShortGenius dès aujourd'hui et commencez à bâtir de meilleures publicités, plus vite.