Desbloqueie Qualidade Impressionante: Upscale de Vídeo com IA

Aprenda um fluxo de trabalho prático para fazer upscale de vídeo com IA. Cubra preparação de filmagens, configurações ideais, processamento em lote e exportação para redes sociais com ShortGenius.

Você tem um clipe que deveria funcionar.

Talvez seja um depoimento antigo de cliente gravado no celular. Talvez seja uma filmagem gerada por usuário que acerta na emoção, mas parece suave em uma tela moderna. Talvez seja um top performer do passado que você quer republicar, recortar e transformar em assets de short-form frescos. A ideia é forte. O arquivo de origem não é.

É aí que o upscale video ai para de ser uma novidade e começa a ser uma ferramenta de produção.

Bom upscale com IA pode resgatar filmagens que você jogaria fora. Um upscale ruim com IA desperdiça horas, exagera o ruído de compressão e dá rostos com aquela aparência plástica e cozida demais que os espectadores notam na hora. A diferença está no fluxo de trabalho. Qualidade da origem, escolha do modelo, tratamento em lote e decisões de exportação importam mais do que as promessas de marketing na página inicial de uma ferramenta.

Por Que o Upscale de Vídeo com IA É um Superpoder dos Criadores

Filmagens de baixa resolução costumavam ter um teto rígido. Você podia ampliá-las, mas não realmente melhorá-las. O escalonamento tradicional esticava os pixels. Tornava os clipes maiores, não melhores.

O upscale de vídeo com IA funciona de forma diferente. Ele usa aprendizado profundo para reconstruir detalhes, interpretar pixels ao redor e preservar o movimento entre frames. Essa última parte importa. Uma única imagem pode parecer nítida e ainda falhar como vídeo se as bordas tremularem ou texturas piscarem de frame para frame.

Por que os criadores se importam agora

Isso não é mais um truque de restauração de nicho. O mercado de Software de Upscale de Vídeo com IA cresceu de US$ 550 milhões em 2024 para US$ 670 milhões em 2025, e deve atingir US$ 5 bilhões até 2035, com um CAGR de 22,3%, impulsionado pela demanda por entrega em 4K e maior qualidade visual para engajamento, de acordo com o Wise Guy Reports sobre o mercado de software de upscale de vídeo com IA.

Isso acompanha o que os criadores lidam toda semana:

- Filmagens antigas ainda têm valor: Entrevistas passadas, webinars, demos e depoimentos frequentemente contêm ideias que valem a pena republicar.

- UGC raramente é capturado perfeitamente: Ganchos incríveis vêm de clipes imperfeitos.

- Toda plataforma pune a suavidade: Recortar, redimensionar e recomprimir filmagens fracas torna os defeitos mais óbvios.

Regra prática: Use upscale com IA para recuperar conteúdo forte. Não espere que ele salve cinematografia fraca, foco perdido ou borrão de movimento pesado.

Há também um ângulo mais amplo de fluxo de trabalho. Se você já está transformando um asset em vários, o upscale se torna parte do reempacotamento, não só de reparo. É por isso que ele se encaixa naturalmente ao lado do reaproveitamento de conteúdo com IA. Uma única origem de baixa resolução pode virar shorts, edições quadradas e reposts renovados se você limpar a origem antes de redimensionar e distribuir.

Onde ele brilha mais

O upscale com IA se destaca em algumas situações específicas:

| Caso de uso | Por que funciona |

|---|---|

| Clipes de arquivo | Pode restaurar clareza sem reconstruir manualmente cada toma |

| Gravações de tela | Ajuda bordas de texto e elementos de UI a sobreviverem melhor à compressão |

| UGC para anúncios | Eleva a qualidade base antes de legendas, branding e exportações |

| Edições sociais recortadas | Resolução extra dá margem quando se transforma um master em múltiplos formatos |

Se você precisar de um lembrete rápido sobre o que a entrega em resolução mais alta significa na prática, esta análise de https://shortgenius.com/blog/what-is-4-k-resolution é útil antes de decidir se um clipe merece um acabamento em 4K.

Preparando a Filmagem de Origem para um Upscale Impecável

O maior erro com upscale video ai é alimentar a ferramenta com o pior arquivo que você tem e esperar que o modelo faça mágica.

Não vai rolar.

O mercado está avançando rápido. O mercado mais amplo de Ferramentas de Melhoria de Vídeo com IA deve atingir US$ 1.166 milhões até 2032, com um CAGR de 37,1%, impulsionado por sistemas de aprendizado profundo que entregam boosts de resolução 2x a 4x instantâneos enquanto reduzem o uso de banda, de acordo com o Intel Market Research sobre o mercado de ferramentas de melhoria de vídeo com IA. Mas modelos melhores não cancelam entradas ruins.

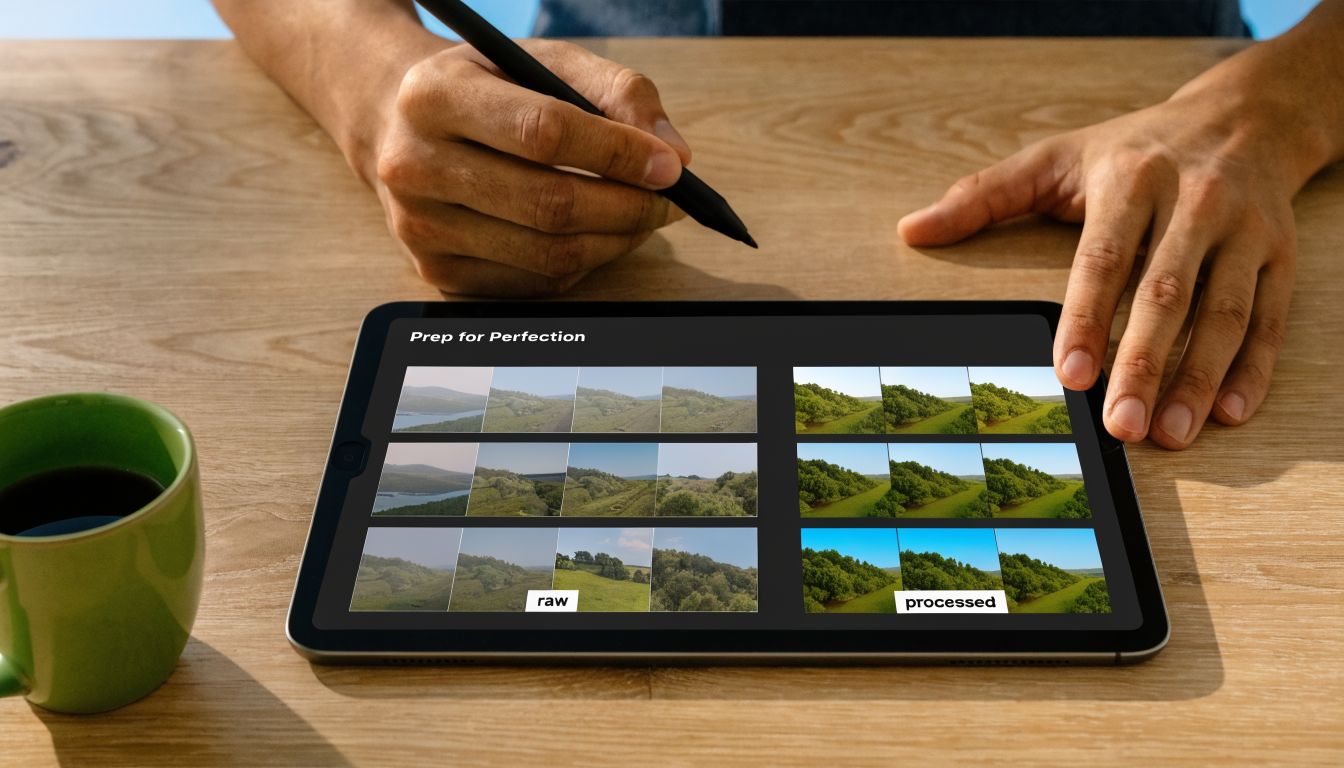

Audite o clipe antes de processá-lo

Antes de enfileirar qualquer coisa, eu verifico se o clipe é um bom candidato ou uma armadilha.

Use esta auditoria curta:

- Danos de compressão: Se você vê macroblocos, ruído de mosquito ou detalhes borrados, o modelo pode tratar esse dano como textura real.

- Borrão de movimento: A IA pode afiar bordas, mas não recupera detalhes que nunca existiram no frame.

- Foco: Suavidade leve pode ser viável. Foco perdido geralmente continua perdido.

- Estabilidade de frame: Clipes tremidos são mais difíceis de upscale limpo, especialmente se o fundo já se desfaz.

- Linhagem do arquivo: Exporte da origem mais próxima que encontrar. Não faça upscale de um arquivo já comprimido várias vezes.

Escolha a origem certa, não só a maior origem

Criadores frequentemente perseguem resolução primeiro. Isso é ao contrário.

Um master 720p mais limpo pode superar um repost 1080p detonado. O que importa é se a origem preserva informação de imagem real. Se tiver opções, escolha o arquivo com menos recompressão e menos edições embutidas.

Se a origem já parece ruidosa, crocante e instável no tamanho nativo, o upscale geralmente torna esses problemas mais fáceis de ver.

O que corrigir antes do upscale

Um pouco de preparo economiza muitas re-renderizações.

-

Recorte o clipe primeiro

Não processe ar morto, falsos começos ou takes alternativos se não for usá-los. -

Separe tipos de filmagem

Talking head, gameplay, animação e captura de tela se comportam diferente. Não os agrupe em um preset só. -

Faça a limpeza óbvia cedo

Se o arquivo precisar de denoise básico ou deinterlacing, faça isso antes da passada de upscale. -

Execute uma amostra curta

Pegue um momento exigente do clipe. Movimento rápido de mão, detalhe de cabelo, movimento de câmera, texto fino. Se a amostra falhar, o render completo não vai melhorar depois.

Candidatos ruins para upscale com IA

Alguns clipes não valem o compute.

- Downloads sociais com filtros pesados

- Memes repostados minúsculos

- Filmagens com quebra severa em pouca luz

- Clipes onde rostos já estão distorcidos por compressão

Parece rígido, mas protege seu tempo. O melhor fluxo de trabalho começa com seleção, não com configurações de software.

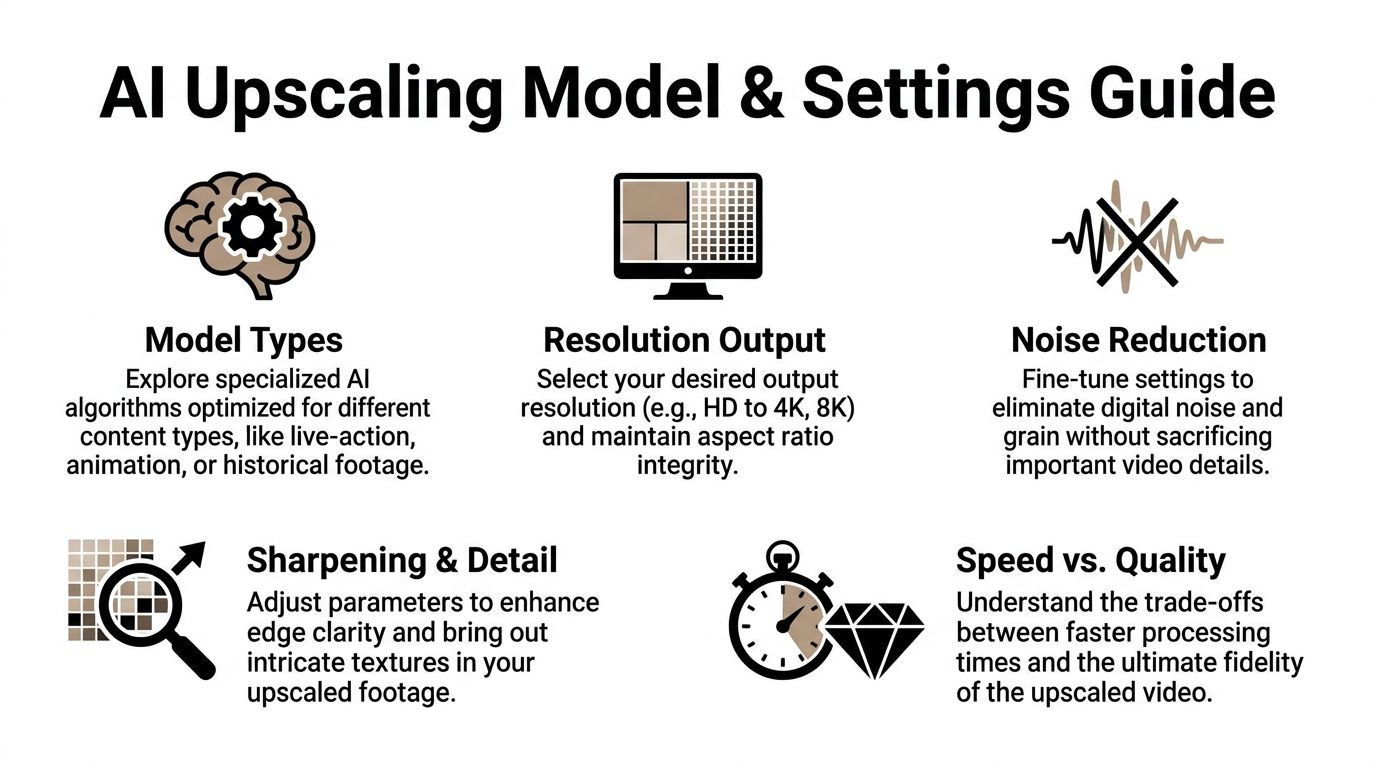

Escolhendo o Modelo e Configurações Certos de IA

A maioria dos upscales falhados vem do mesmo hábito. As pessoas carregam um clipe, escolhem a maior saída, exageram no sharpening e assumem que mais processamento é igual a mais qualidade.

Não é.

Diferentes modelos fazem trocas diferentes. Alguns preservam realismo. Alguns inventam mais textura. Alguns se saem bem em animação e lutam com pele. Alguns são estáveis em movimento. Outros produzem frames estáticos impressionantes e artefatos temporais feios.

Um benchmark útil está por trás de tudo isso. No upscale com IA, modelos de deep learning como basicVSR++ podem alcançar mais de 13% de pontuação VMAF superior ao Lanczos tradicional ao escalar de 540p para 1080p, com ganhos de PSNR de 2-4dB, mas limites de hardware em GPUs de consumidor podem causar taxas de falha de 50%+ para clipes 4K com mais de 2 minutos devido a falta de VRAM, como notado na cobertura da At Scale Conference sobre upsampling de vídeo em dispositivo.

Escolha de modelo começa com o tipo de filmagem

Uma forma simples de pensar sobre modelos:

| Tipo de filmagem | O que priorizar | Modo de falha comum |

|---|---|---|

| Live action | Pele natural, movimento estável, sharpening contido | Rostos encerados |

| Animação | Linhas limpas, consistência de borda | Haloing ao redor de contornos |

| Gameplay | Tratamento de movimento, clareza de texto/UI | Ghosting em cenas rápidas |

| Filmagem de arquivo | Reconstrução conservadora | Textura falsa que muda a aparência original |

Se uma ferramenta oferecer famílias de modelos múltiplas, não use um preset universal. É assim que você acaba com entrevistas oversharpened e animação lamacenta na mesma pasta de projeto.

Para editores comparando ferramentas e fluxos de trabalho antes de se comprometerem com uma stack, este resumo de https://shortgenius.com/blog/melhores-softwares-edicao-video-ia ajuda a enquadrar onde o upscale se encaixa em uma pipeline de edição maior.

As configurações que mais importam

Muitos rótulos de UI soam técnicos, mas se comportam de formas previsíveis.

Denoise

Use denoise quando a origem tem ruído visível que o modelo continua confundindo com detalhe. Use menos do que você acha que precisa.

Denoise demais tira textura de pele, tecido e fundos. Aí o sharpening tenta reconstruir nitidez falsa em cima de uma imagem achatada.

Deblock

Deblock ajuda quando você lida com danos de compressão. Pode suavizar bordas de bloco feias antes que o modelo de upscale as exagere.

Isso é útil em clipes baixados e exports antigos. É perigoso em filmagens já limpas porque pode suavizar bordas que você queria preservar.

Sharpen

Sharpen é onde o render frequentemente é arruinado.

Um pouco de sharpening pode recuperar definição de borda. Demais cria halos, cabelo quebradiço e aquela aparência sintética de “melhorado por IA”. Se uma amostra parece impressionante pausada mas feia em movimento, o sharpening é frequentemente o culpado.

A configuração certa de sharpen deve desaparecer no vídeo final. Se os espectadores sentirem o processamento, geralmente é agressivo demais.

Estratégia de resolução vence força bruta

Ir direto para 4K frequentemente é o movimento errado. Para conteúdo social, 1080p ou um passo modesto pode parecer mais limpo que um arquivo maior com detalhe inventado.

Aqui vai a comparação prática:

| Abordagem | Vantagem | Desvantagem |

|---|---|---|

| Pulo direto para 4K | Tamanho de saída máximo | Mais detalhe alucinado, renders mais pesados |

| Passo para 1080p primeiro | Melhor controle, QA mais fácil | Ponto de decisão extra |

| Upscale moderado só | Mais rápido, mais seguro para entrega social | Menos dramático antes-e-depois |

Esse caminho do meio vence surpreendentemente muitas vezes. Você mantém controle sobre textura e movimento, e evita passar a noite toda renderizando um arquivo que ainda vai ser comprimido forte no upload.

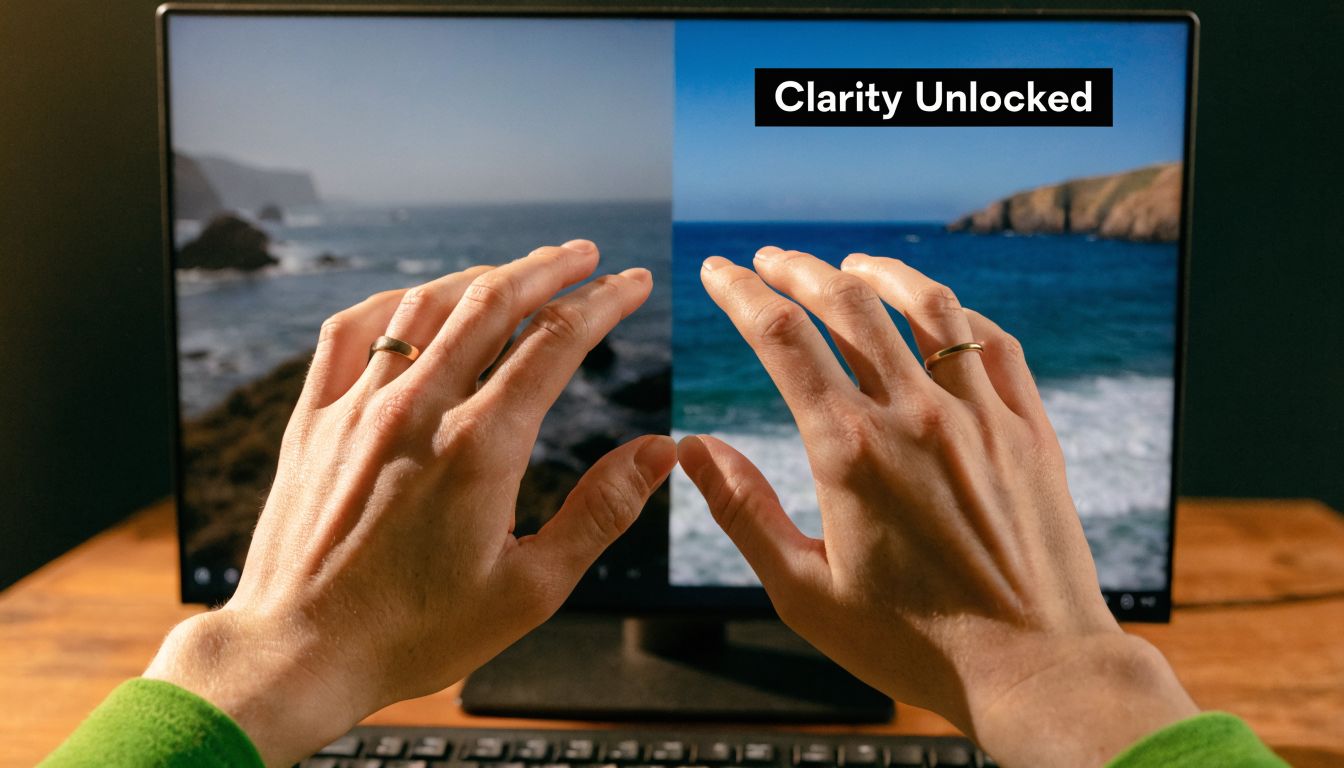

Um walkthrough visual rápido ajuda ao ajustar isso:

Processamento local versus cloud

Essa escolha é menos sobre ideologia e mais sobre restrições.

Processamento local dá controle. Também prende sua máquina e expõe limites de GPU rápido.

Processamento cloud remove o gargalo de hardware, mas você troca controle sobre timing, estrutura de custo e às vezes configurações finas dependendo da plataforma.

Escolha local quando:

- Você precisa de presets repetíveis em uma máquina conhecida

- Você está testando muito

- Você quer supervisão direta de cada passada

Escolha cloud quando:

- Sua GPU falha em clipes longos

- Você precisa de acesso em equipe

- Você prefere continuar editando enquanto renders acontecem em outro lugar

Crie presets, depois desconfie deles

Presets economizam tempo. Confiança cega destrói qualidade.

Mantenha alguns presets iniciais por tipo de conteúdo, depois teste cada nova origem com um segmento curto antes de lançar o render completo. Um preset para talking-head limpa. Outro para UGC rough. Outro para animação ou gravações de tela.

Essa disciplina importa mais que a marca do software.

Dominando Seu Fluxo de Trabalho de Upscale em Lote

Upscale de um clipe é um experimento. Upscale de vinte clipes é operação.

Muitos criadores perdem tempo frequentemente. Eles tratam cada arquivo como um job customizado, ficam de babá nos exports e reexecutam renders falhados porque nada foi organizado no início. Um fluxo de lote corrige isso.

De acordo com a orientação da Audials sobre erros de iniciante em upscale de vídeo com IA, especialistas recomendam começar com vídeo de alta qualidade e minimamente comprimido e testar saltos incrementais de resolução como 720p para 1080p antes de 4K para evitar resultados não naturais e tempos de render 4x maiores. A mesma orientação nota que modelos agressivos podem produzir taxas de artefato de 20-30% em cenas com muito movimento, caindo para menos de 5% com um fluxo de trabalho adequado.

Um fluxo de trabalho local overnight

Para ferramentas desktop, a configuração mais segura é chata de propósito.

-

Crie três pastas

Usesource,test-rendersefinal-upscaled. Mantenha-as separadas. -

Renomeie clipes antes de enfileirar

Adicione tags de plataforma ou projeto aos nomes de arquivos para rastrear falhas rápido. -

Agrupe por comportamento de filmagem

Não misture UGC tremido com filmagem de estúdio polida em um preset de lote. -

Execute um stress test por grupo

Pegue o clipe mais difícil de cada categoria. Movimento rápido, cabelo, texto, takes de multidão. Se funcionar, os clipes mais fáceis geralmente seguem. -

Enfileire jobs completos overnight

Deixe a máquina renderizar quando você não está editando.

Um fluxo de trabalho de lote cloud

Fluxos cloud funcionam melhor quando você lida com volume, colaboração ou uma máquina que não aguenta a carga.

O processo é diferente:

- Faça upload só de origens aprovadas: Não use a cloud como sala de triagem.

- Use convenções de nomenclatura claras: Confusão de versão se acumula rápido em projetos compartilhados.

- Documente o preset: No momento em que um bom lote cai, salve a configuração exata.

- Atribua propriedade de revisão: Alguém precisa checar saídas, não só confirmar que arquivos existem.

O que checar após um lote rodar

Uma fila de render completada não é o mesmo que um lote utilizável.

Revise isso primeiro:

| Checagem | Por que importa |

|---|---|

| Consistência de movimento | Flicker frequentemente se esconde até a reprodução |

| Rostos e mãos | Modelos agressivos falham aqui primeiro |

| Texto fino e UI | Ótimo para gravações de tela, fácil de quebrar |

| Integridade de frame rate | Desalinhamentos criam stutter no export |

| Aspect ratio | Tratamento incorreto causa recortes estranhos depois |

Upscale em lote só economiza tempo se sua passada de verificação for rápida e implacável.

Erros que destroem a escala

As maiores falhas geralmente vêm do processo, não da qualidade do modelo.

- Um preset para todo clipe: Rápido, mas não confiável.

- Sem render de amostra: É assim que você acorda com uma pasta cheia de arquivos inutilizáveis.

- Pular QC porque thumbnails parecem bons: Muitos artefatos só aparecem na reprodução.

- Upscale após múltiplos exports de edição: Toda re-codificação baixa seu teto.

Para equipes, o objetivo não é só processamento mais rápido. É processamento previsível. Um sistema de lote estável torna o upscale video ai parte da produção regular em vez de uma missão de resgate toda vez que um asset de baixa resolução aparece.

Edição Pós-Upscale e Presets de Export Inteligentes

Um arquivo upscalado não é um arquivo finalizado.

É mais como um negativo restaurado. Você ainda precisa moldá-lo, checá-lo e exportá-lo para o lugar onde vai viver. Essa última parte importa porque criadores frequentemente perseguem resolução ignorando condições de entrega.

A questão de ROI é real. Como o guia da Cloudinary sobre usar IA para upscale de vídeo nota, muitas ferramentas prometem 4K, mas plataformas como TikTok e Instagram Reels frequentemente fazem downscale no conteúdo de qualquer jeito. Isso levanta uma pergunta prática para criadores. Um upscale em 4K está se provando benéfico, ou um export HD otimizado performaria tão bem para visualização mobile-first?

A passada de limpeza importa

Modelos de IA frequentemente introduzem problemas sutis que não aparecem em um frame still lado a lado.

Comuns incluem:

- Desvio de cor: Tons de pele podem mudar levemente após a melhoria.

- Chatter de borda: Detalhe fino pode pulsar em movimento.

- Inconsistência de textura: Cabelo, tecido e fundos podem alternar entre nítido e suave.

Eu trato a edição pós-upscale como trabalho de acabamento, não polimento opcional.

Corrija cor antes do export

Mesmo um grade leve pode unificar a imagem. Combine tons de pele, puxe highlights se o upscale os tornou quebradiços e certifique-se de que pretos não viraram crocantes.

Revise movimento na reprodução

Não inspecione só grabs de frame. Assista o clipe em tela cheia, depois de novo no celular. Problemas de movimento se revelam na reprodução, não em screenshots.

Se um upscale parece ótimo pausado e estranho em movimento, o export não está pronto.

Exports inteligentes vencem exports máximos

Criadores frequentemente defaultam para “maior qualidade disponível”. Parece seguro, mas nem sempre é útil.

Para distribuição short-form, pense em termos de encaixe na plataforma:

| Destino | Mentalidade de default melhor | O que evitar |

|---|---|---|

| TikTok | Master HD limpo e estável | Arquivos enormes com ganho visível marginal |

| Instagram Reels | Resistência forte a compressão | Exports oversharpened que quebram após upload |

| YouTube Shorts | Texto nítido e movimento estável | Renders desnecessariamente oversized se origem era fraca |

O ponto não é que 4K é ruim. É que 4K não é automaticamente melhor para todo upload social.

Uma política de export prática

Use este conjunto de regras:

-

Exporte para a plataforma, não para o seu orgulho

Espectadores se importam com clareza e suavidade mais que o menu de configurações de render. -

Mantenha um master de arquivo de alta qualidade

Salve um master limpo para reuso futuro, recortes ou entrega a cliente. -

Crie derivados específicos por plataforma

Um arquivo de arquivo, depois exports ajustados para vertical, quadrado ou horizontal. -

Cheque o resultado enviado

Plataformas sociais fazem parte da cadeia de render. Seu export local não é a aparência final.

Muitos criadores comprometem qualidade no export. Gastam tempo upscalando, depois entregam o resultado final à compressão da plataforma sem estratégia. Presets de export inteligentes protegem o trabalho que você já fez.

Automatizando Upscale em uma Pipeline ShortGenius

Upscale manual funciona quando você está consertando um clipe. Desmorona quando você está produzindo conteúdo social toda semana em múltiplos canais.

Esse é o gargalo para equipes. De acordo com a cobertura da Perfect Corp sobre limitações de fluxo de trabalho de aprimorador de vídeo com IA, o maior desafio é integrar upscale em fluxos multi-canal porque a maioria das ferramentas standalone falta processamento em lote em escala ou disponibilidade de API. Uma pipeline de publicação unificada importa mais que outro app de melhoria isolado.

O que a automação realmente deve fazer

Uma pipeline automatizada útil não só “adiciona upscale”.

Ela deve lidar com uma cadeia assim:

- Ingerir o clipe de origem

- Roteá-lo por tipo de conteúdo

- Aplicar o preset de melhoria certo

- Passar o resultado para edição

- Redimensionar e empacotar para cada canal

- Agendar distribuição

Essa estrutura transforma upscale de um passo de reparo em infraestrutura.

Onde se encaixa na produção

Para equipes short-form, o melhor ponto de inserção geralmente é cedo. Limpe o asset visual antes de legendas, branding, reframe e exports.

Isso importa porque todo passo posterior depende da origem parecendo estável. Se você adicionar legendas animadas, cut-ins e overlays de marca em filmagem fraca primeiro, depois tentar upscale depois, você força o modelo a interpretar elementos de design e danos de compressão ao mesmo tempo.

Uma ordem mais confiável é:

| Estágio | Sequência melhor |

|---|---|

| Tratamento de origem | Selecione e aprove raw clip |

| Melhoria | Upscale e limpe movimento primeiro |

| Camada de edição | Adicione legendas, recortes, branding, voz |

| Distribuição | Exporte por plataforma e publique |

Uma menção à plataforma, usada onde pertence

Em um fluxo unificado, o ShortGenius pode se encaixar nessa cadeia de produção como uma opção para equipes que querem montagem de vídeo, voiceovers, edição, redimensionamento, agendamento e automação via API no mesmo ambiente. Esse tipo de setup importa quando você está tentando transformar filmagem rough em output repetível sem pular arquivos entre apps separados. Se você está construindo um sistema mais amplo em torno de produção recorrente de canais, este guia para https://shortgenius.com/blog/automacao-ia-youtube é relevante porque automação só funciona quando cada passo de produção se conecta limpo.

O que funciona e o que não

O que funciona

- Tratar upscale como estágio de pré-processamento

- Salvar presets por classe de filmagem

- Automatizar passadas repetitivas, não julgamento estético

- Manter um passo de revisão humana antes de publicar

O que não

- Enviar todo clipe pelo mesmo perfil de melhoria

- Automatizar sem propriedade de QC

- Construir uma pipeline que exija wrangling manual de arquivos entre ferramentas

- Assumir que filmagem gerada por IA e orgânica se comportam igual no upscale

A vitória não é só filmagem com aparência melhor. A vitória é remover mais um gargalo manual da produção de conteúdo.

Para agências, equipes de marca e criadores de alto volume, essa é a mudança fundamental. Upscale para de ser um conserto especial para arquivos ruins e vira um processo de fundo padrão. Você recupera mais filmagem utilizável, gasta menos tempo em limpezas repetitivas e mantém qualidade de output consistente nos canais.

Se você quiser transformar esse fluxo de trabalho em um sistema repetível, o ShortGenius (AI Video / AI Ad Generator) traz criação de vídeo, edição, redimensionamento, voiceovers, agendamento e publicação automatizada em uma única plataforma, para que o upscale possa se encaixar em uma pipeline de produção mais ampla em vez de viver como uma tarefa manual isolada.